Índice analítico[Ocultar][Mostrar]

As bases de datos vectoriais representan un cambio significativo na forma en que xestionamos e interpretamos os datos, especialmente nos campos da intelixencia artificial e da aprendizaxe automática.

A función fundamental destas bases de datos é manexar eficazmente os vectores de alta dimensión, que son a materia prima dos modelos de aprendizaxe automática e inclúen a conversión de entrada de texto, imaxe ou audio en representacións numéricas no espazo multidimensional.

Para aplicacións como sistemas de recomendación, recoñecemento de obxectos, recuperación de imaxes e detección de fraudes, esta transformación é algo máis que almacenamento; é unha porta a poderosas capacidades en buscas de semellanza e consultas de veciños máis próximos.

Máis profundamente, o poder das bases de datos vectoriais reside na súa capacidade para traducir grandes cantidades de datos complicados e non estruturados en vectores que captan o contexto e o significado do contido orixinal.

As funcións de busca melloradas que se fan posibles ao incorporar modelos nesta codificación inclúen a posibilidade de consultar os vectores circundantes para atopar imaxes ou frases relacionadas.

As bases de datos vectoriais son únicas porque están construídas con técnicas de indexación avanzadas como o índice de ficheiros invertido (IVF) e o mundo pequeno navegable xerárquico (HNSW), o que mellora a súa velocidade e eficiencia ao mesmo tempo que localiza os veciños máis próximos en espazos de N dimensión.

Hai unha clara diferenza entre as bases de datos vectoriais e as clásicas. As bases de datos convencionais son excelentes para organizar os datos en conxuntos organizados que están optimizados para CRUD e se adhiren aos esquemas establecidos.

Non obstante, cando se trata da natureza dinámica e complicada dos datos de alta dimensión, esta rixidez comeza a converterse nun obstáculo.

Pola contra, as bases de datos vectoriais ofrecen un grao de flexibilidade e eficiencia que os equivalentes tradicionais non poden igualar, especialmente para aplicacións que dependen moito. aprendizaxe de máquina e intelixencia artificial. Non só son escalables e competentes en buscas de semellanzas.

As bases de datos vectoriais son particularmente útiles para aplicacións de IA xerativa. Para garantir que o material creado conserva a integridade contextual, estas aplicacións, que inclúen o procesamento da linguaxe natural e a xeración de imaxes, dependen da rápida recuperación e comparación das incorporacións.

Entón, nesta peza, miraremos as principais bases de datos vectoriais para o teu próximo proxecto.

1. Milvus

Milvus é unha base de datos de vectores de código aberto pioneira deseñada principalmente para aplicacións de IA, incluíndo buscas de semellanza integradas e MLOps potentes.

Diferénciase das bases de datos relacionais convencionais, que na súa maioría manexan datos estruturados, debido a esta capacidade, que lle permite indexar vectores nunha escala de billóns sen precedentes.

A dedicación de Milvus á escalabilidade e a alta dispoñibilidade demóstrase pola forma en que se desenvolveu desde a súa primeira versión ata Milvus 2.0, totalmente distribuída e nativa da nube.

Concretamente, Milvus 2.0 presenta un deseño totalmente nativo da nube que pretende unha dispoñibilidade sorprendente do 99.9% mentres se escala máis aló de centos de nodos.

Para aqueles que buscan unha solución de base de datos vectorial fiable, esta edición é moi recomendable xa que non só engade funcións sofisticadas como unha conexión multi-nube e un panel administrativo, senón que tamén mellora os niveis de coherencia dos datos para o desenvolvemento flexible de aplicacións.

Unha vantaxe notable de Milvus é o seu enfoque impulsado pola comunidade, que ofrece soporte multilingüe e unha extensa cadea de ferramentas adaptada ás demandas dos desenvolvedores.

No sector das TI, a súa escalabilidade e fiabilidade na nube, xunto coas súas capacidades de busca vectorial de alto rendemento en grandes conxuntos de datos, fan que sexa unha opción popular.

Ademais, mellora a eficiencia das súas operacións mediante unha capacidade de busca híbrida que combina a busca por semellanza de vectores co filtrado escalar.

Milvus ten un panel administrativo cun claro interface co usuario, un conxunto completo de API e unha arquitectura escalable e axustable.

A comunicación con aplicacións externas é facilitada pola capa de acceso, mentres que o equilibrio de carga e a xestión de datos están coordinados polo servizo coordinador, que serve de mando central.

A permanencia da base de datos está soportada pola capa de almacenamento de obxectos, mentres que os nodos traballadores realizan actividades para garantir a escalabilidade.

prezos

É de uso gratuíto para todos.

2. FAIS

O equipo de investigación de AI de Facebook desenvolveu unha biblioteca de vangarda chamada Facebook AI Similarity Search que está deseñada para facer que a agrupación de vectores densos e a busca de semellanzas sexan máis efectivas.

A súa creación foi impulsada pola esixencia de mellorar as capacidades de busca de semellanzas de Facebook AI mediante a utilización de metodoloxías fundamentais de vangarda.

En comparación coas implementacións baseadas en CPU, a implementación de GPU de última xeración de FAISS pode acelerar os tempos de busca de cinco a dez veces, converténdoa nunha ferramenta inestimable para unha variedade de aplicacións, incluíndo sistemas de recomendación e identificación de significados similares en tamaños considerables. conxuntos de datos non estruturados como texto, audio e vídeo.

FAISS pode manexar unha ampla gama de métricas de semellanza, como a semellanza coseno, o produto interno e a métrica L2 (distancia euclidiana) de uso común.

Estas medicións facilitan a realización de buscas de semellanza precisas e flexibles en varios tipos de datos. Funcións como o procesamento por lotes, os intercambios de precisión e velocidade e a compatibilidade con buscas precisas e aproximadas aumentan aínda máis a súa flexibilidade.

Ademais, FAISS ofrece un método escalable para manexar conxuntos de datos masivos ao permitir que os índices sexan almacenados no disco.

O ficheiro invertido, a cuantificación do produto (PQ) e a PQ mellorada son só algunhas das técnicas innovadoras que constitúen a base de investigación de FAISS e que engaden a súa eficacia á hora de indexar e buscar campos vectoriais de alta dimensión.

Estas estratexias refórzanse con enfoques de vangarda, como os algoritmos de selección k acelerados pola GPU e o filtrado previo das distancias PQ, o que garante a capacidade de FAISS para producir resultados de busca rápidos e precisos mesmo en conxuntos de datos de miles de millóns de escala.

prezos

É de uso gratuíto para todos.

3. Piña

Pinecone é líder en bases de datos vectoriais, que ofrece un servizo xestionado nativo da nube que está especialmente construído para mellorar o rendemento das aplicacións de IA de gran potencia.

Está deseñado especificamente para xestionar incrustacións de vectores, que son esenciais para a IA xerativa, a busca semántica e as aplicacións que utilizan modelos de linguaxe masiva.

A IA agora pode comprender a información semántica grazas a estas incorporacións, que actúan de forma efectiva como memoria a longo prazo para tarefas complicadas.

Pinecone é único xa que integra perfectamente as capacidades das bases de datos tradicionais co rendemento mellorado dos índices vectoriais, o que permite o almacenamento e consulta eficientes e a gran escala de incrustacións.

Isto fai que sexa a opción perfecta en situacións nas que a complexidade e o volume de datos implicados fan que as bases de datos estándar baseadas en escalares sexan inadecuadas.

Pinecone ofrece aos desenvolvedores unha solución sen problemas debido ao seu enfoque de servizo xestionado, que simplifica a integración e os procedementos de admisión de datos en tempo real.

Son compatibles con numerosas operacións de datos, incluíndo a obtención, actualización, eliminación, consulta e publicación de datos.

Pinecone garante ademais que as consultas que representan modificacións en tempo real, como subidas e eliminacións, dean respostas correctas e de baixa latencia para índices con miles de millóns de vectores.

En situacións dinámicas, esta característica é esencial para preservar a relevancia e a frescura dos resultados das consultas.

Ademais, a asociación de Pinecone con Airbyte a través da conexión Pinecone aumenta a súa versatilidade e flexibilidade, o que permite unha integración fluida de datos desde unha variedade de fontes.

A través desta relación, os custos e a eficiencia pódense optimizar garantindo que só se manexa a información recentemente adquirida mediante a sincronización de datos incremental.

O deseño do conector enfatiza a sinxeleza, só precisa de parámetros de configuración mínimos e é extensible, o que permite melloras futuras.

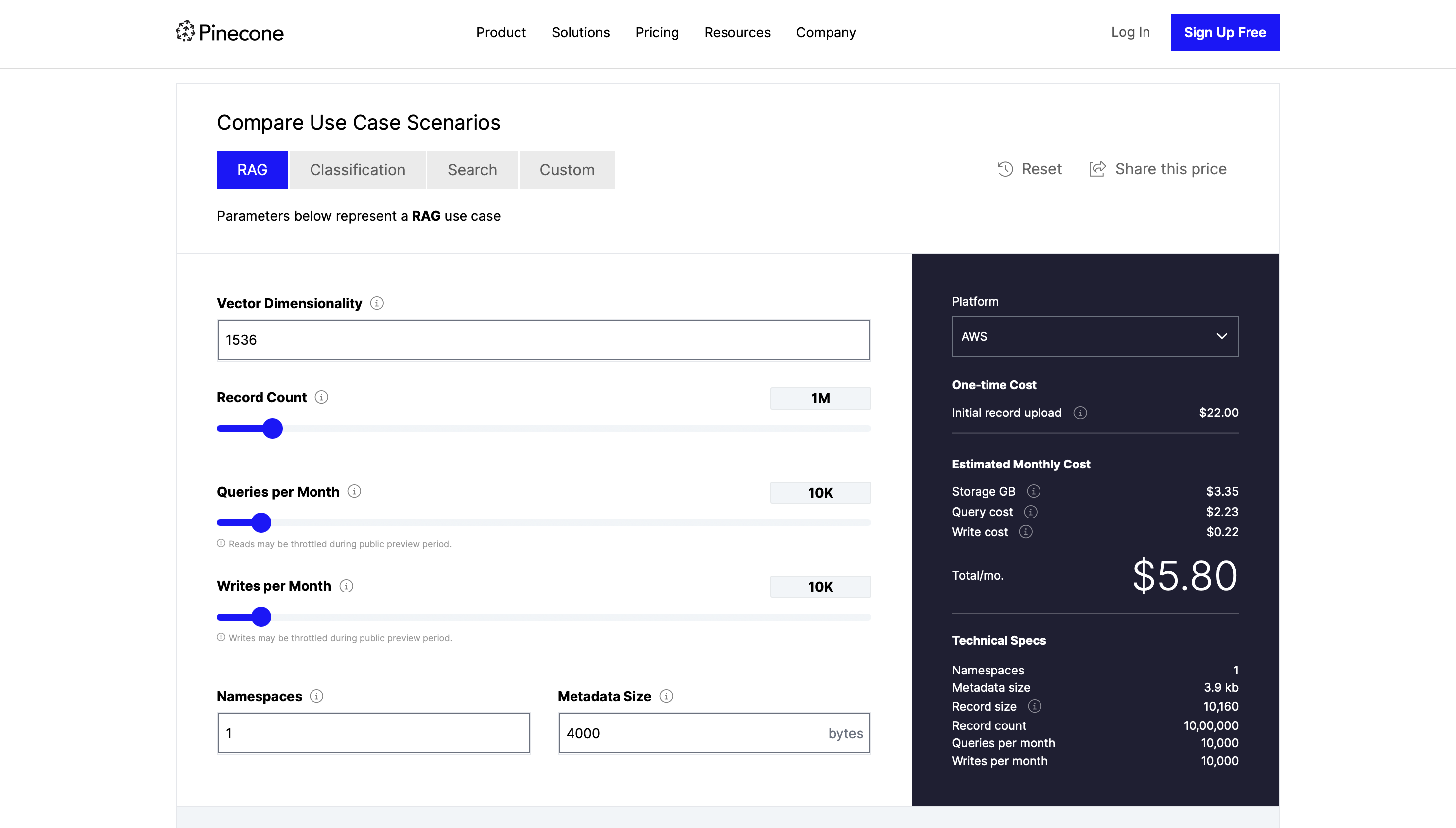

prezos

O prezo premium comeza a partir de 5.80 dólares ao mes para o caso de uso RAG.

4. Weaviate

Weaviate é unha base de datos de vectores innovadora que está dispoñible como software de código aberto que transforma a forma en que accedemos e usamos os datos.

Weaviate fai uso das capacidades de busca vectorial, que permiten buscas sofisticadas e conscientes do contexto en conxuntos de datos grandes e complicados, en contraste coas bases de datos típicas que dependen de valores escalares e consultas predefinidas.

Con este método, podes localizar o contido en función do seu parecido con outros contidos, o que mellora a intuitividade das buscas e a relevancia dos resultados.

A súa integración fluida cos modelos de aprendizaxe automática é unha das súas características principais; isto permítelle funcionar como algo máis que unha simple solución de almacenamento de datos; tamén permite comprender e analizar datos mediante intelixencia artificial.

A arquitectura de Weaviate incorpora esta integración a fondo, o que permite analizar datos complexos sen o uso de ferramentas adicionais.

O seu soporte para modelos de datos gráficas tamén proporciona un punto de vista diferente sobre os datos como entidades vinculadas, expoñendo patróns e coñecementos que poderían perderse nas arquitecturas de bases de datos convencionais.

Debido á arquitectura modular de Weaviate, os clientes poden engadir capacidades como a vectorización de datos e a creación de copias de seguridade segundo sexa necesario.

A súa versión fundamental funciona como unha base de datos especializada en datos vectoriais, e pódese ampliar con outros módulos para satisfacer diferentes necesidades.

A súa escalabilidade vese aínda máis mellorada polo seu deseño modular, que garante que non se sacrificará a velocidade en resposta ao aumento da cantidade de datos e das demandas de consulta.

Un método versátil e eficaz de interactuar cos datos almacenados é posible grazas ao soporte da base de datos para as API RESTful e GraphQL.

En particular, GraphQL é seleccionado pola súa capacidade para realizar rapidamente consultas complexas baseadas en gráficos, o que permite aos usuarios obter exactamente os datos que desexan sen obter cantidades excesivas ou insuficientes de datos.

Weaviate é máis fácil de usar nunha variedade de bibliotecas de clientes e linguaxes de programación grazas á súa API flexible.

Para aqueles que buscan explorar Weaviate máis, hai unha infinidade de documentación e titoriais dispoñibles, desde a configuración e configuración da súa instancia ata mergullos en profundidade nas súas capacidades como a busca vectorial, a integración de aprendizaxe automática e o deseño de esquemas.

Podes acceder á mesma tecnoloxía potente que fai que a información sexa dinámica e accionable tanto se decides operar Weaviate localmente, nun computación en nube ambiente ou a través do servizo de nube xestionado por Weaviate.

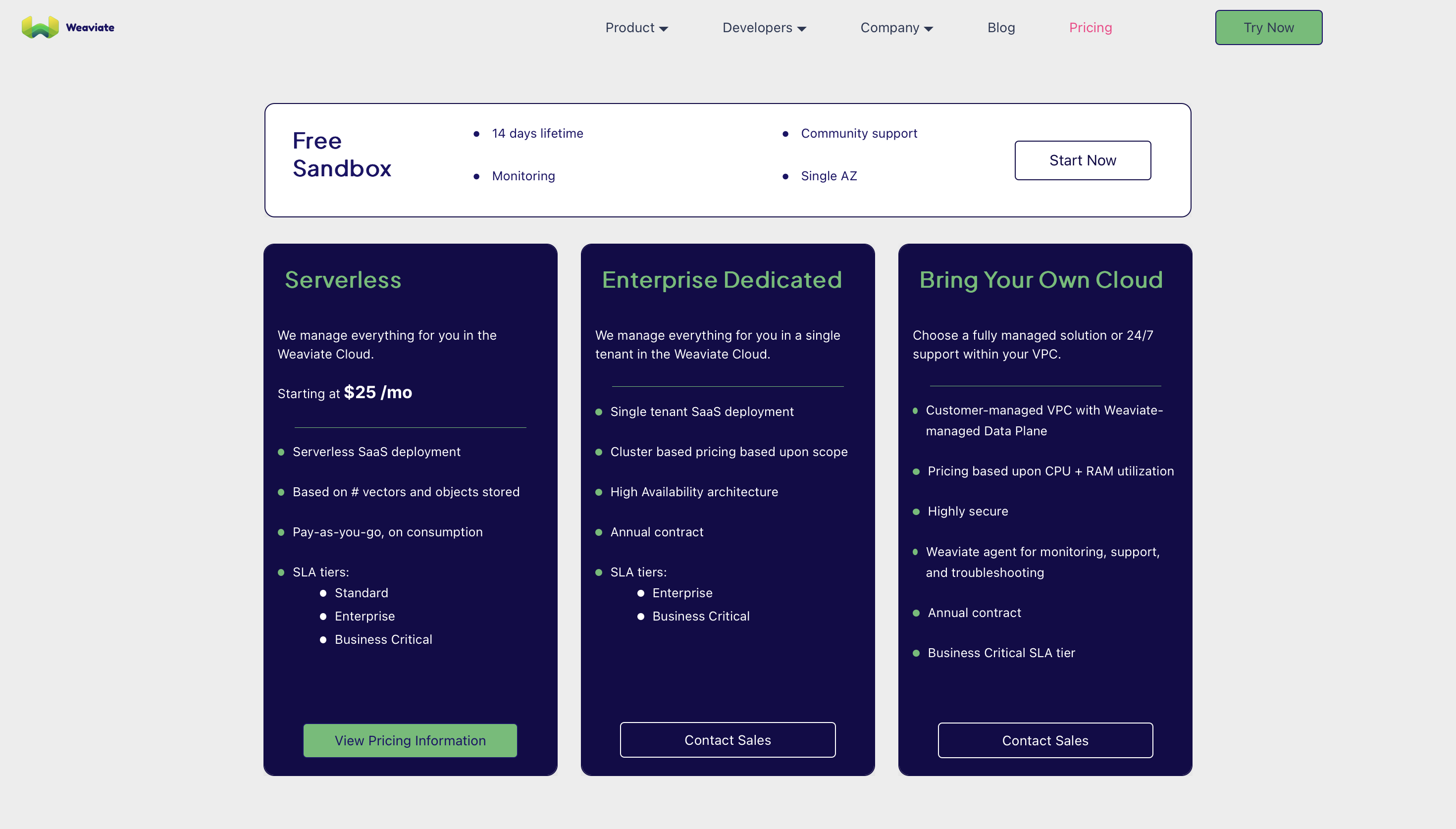

prezos

O prezo premium da plataforma comeza a partir de 25 dólares ao mes para sen servidor.

5. Chroma

Chroma é unha base de datos vectorial de vangarda que ten como obxectivo revolucionar a recuperación e o almacenamento de datos, especialmente para aplicacións que impliquen aprendizaxe automática e intelixencia artificial.

Dado que Chroma traballa con vectores en lugar de números escalares, a diferenza das bases de datos estándar, é moi bo para xestionar datos complicados e de gran dimensión.

Este é un gran avance na tecnoloxía de recuperación de datos xa que permite buscas máis sofisticadas baseadas na semellanza semántica do material en lugar de coincidencias de palabras clave precisas.

Unha característica notable de Chroma é a súa capacidade para traballar con varias solucións de almacenamento subxacentes, como ClickHouse para axustes escalados e DuckDB para instalacións autónomas, o que garante flexibilidade e adaptación a varios casos de uso.

Chroma está feito pensando na sinxeleza, a velocidade e a análise. Está dispoñible para un amplo espectro de desenvolvedores con SDK para Python e JavaScript/TypeScript.

Ademais, Chroma fai un gran énfase na facilidade de uso, permitindo aos desenvolvedores configurar rapidamente unha base de datos permanente apoiada por DuckDB ou unha base de datos en memoria para probar.

A capacidade de construír obxectos de colección que se asemellan a táboas en bases de datos convencionais, onde os datos de texto se poden inserir e transformar automaticamente en incrustacións utilizando modelos como todo-MiniLM-L6-v2, aumenta aínda máis esta versatilidade.

O texto e as incrustacións pódense integrar perfectamente, o que é esencial para as aplicacións que precisan comprender a semántica dos datos.

O fundamento do método de semellanza vectorial de Chroma son os conceptos matemáticos de ortogonalidade e densidade, que son esenciais para comprender a representación e comparación de datos nas bases de datos.

Estas ideas permiten que Chroma realice buscas de semellanza significativas e eficientes tendo en conta as ligazóns semánticas entre os elementos de datos.

Recursos como titoriais e directrices están accesibles para persoas que queiran explorar Chroma máis. Inclúen orientación paso a paso sobre como configurar a base de datos, crear coleccións e realizar buscas de semellanza.

prezos

Podes comezar a usalo de balde.

6. Vespa

Vespa é unha plataforma que está a transformar o manexo en liña da intelixencia artificial e os grandes datos.

O propósito fundamental de Vespa é permitir cálculos de baixa latencia en grandes conxuntos de datos, o que lle permite almacenar, indexar e analizar facilmente texto, datos vectoriais e estruturados.

Vespa distínguese pola súa capacidade para proporcionar respostas rápidas a calquera escala, independentemente da natureza das consultas, opcións ou inferencias de modelos aprendidos por máquina que se manexan.

A flexibilidade de Vespa móstrase no seu motor de busca e base de datos vectoriais totalmente funcional, que permiten moitas buscas dentro dunha única consulta, que van desde datos vectoriais (ANN), léxicos e estruturados.

Independentemente da escala, podes crear aplicacións de busca amigables e sensibles con capacidades de intelixencia artificial en tempo real grazas a esta integración de inferencia de modelos aprendidos por máquina cos teus datos.

Porén, Vespa é algo máis que buscar; tamén se trata de comprender e personalizar os encontros.

As excelentes ferramentas de personalización e suxestión proporcionan recomendacións dinámicas e actuais dirixidas a usuarios ou circunstancias específicas.

Vespa é un cambio de xogo para quen queira entrar tamén no espazo da IA conversacional, xa que ofrece a infraestrutura necesaria para almacenar e explorar datos de texto e vectores en tempo real, o que permite o desenvolvemento de axentes de IA máis avanzados e prácticos.

Con tokenización e derivación completas, as buscas de texto completo, as buscas de veciños máis próximos e as consultas de datos estruturados son compatibles coas amplas capacidades de consulta da plataforma.

Diferénciase en que pode xestionar de forma eficaz consultas complicadas combinando varias dimensións de busca.

Vespa é unha potencia computacional para aplicacións de IA e aprendizaxe automática porque o seu motor de cálculo pode xestionar expresións matemáticas complexas sobre escalares e tensores.

En funcionamento, a Vespa está feita para ser sinxela de usar e expandible.

Axiliza os procesos repetitivos, que van desde a configuración do sistema e o desenvolvemento de aplicacións ata a xestión de datos e nodos, permitindo operacións de produción seguras e ininterrompidas.

A arquitectura de Vespa garante que se expanda cos teus datos, mantendo a súa fiabilidade e rendemento.

prezos

Podes comezar a usalo de balde.

7. cuadrante

Qdrant é unha plataforma flexible de bases de datos vectoriales que ofrece un conxunto único de capacidades para satisfacer as crecentes demandas de aplicacións de IA e aprendizaxe automática.

Na súa fundación, Qdrant é un motor de busca de semellanzas de vectores que ofrece unha API fácil de usar para almacenar, atopar e manter vectores, así como datos de carga útil.

Esta característica é crucial para varias aplicacións, como sistemas de busca e recomendación semánticas, que requiren interpretar formatos de datos complicados.

A plataforma está construída pensando na eficiencia e a escalabilidade, capaz de manexar conxuntos de datos masivos con miles de millóns de puntos de datos.

Ofrece varias métricas de distancia, incluíndo a semellanza coseno, a distancia euclidiana e o produto de puntos, o que o fai adaptable en moitos escenarios de uso.

O deseño ofrece un filtrado complexo, como cadeas, rangos e xeofiltros, para satisfacer diversas necesidades de busca.

Qdrant é accesible para os desenvolvedores de varias formas, incluíndo unha imaxe de Docker para configuracións locais rápidas, un cliente Python para aqueles que se familiarizan co idioma e un servizo na nube para un ambiente de produción máis robusto.

A adaptabilidade de Qdrant permite unha integración perfecta con calquera configuración tecnolóxica ou necesidade de proceso.

Ademais, a interface amigable de Qdrant simplifica a xestión de bases de datos vectoriales. A plataforma está pensada para ser sinxela para usuarios de todos os niveis de habilidade, desde a creación de clústeres ata a xeración de claves API para un acceso seguro.

A súa capacidade de carga masiva e a API asíncrona melloran a súa eficiencia, polo que é unha ferramenta moi útil para os desenvolvedores que tratan con enormes cantidades de datos.

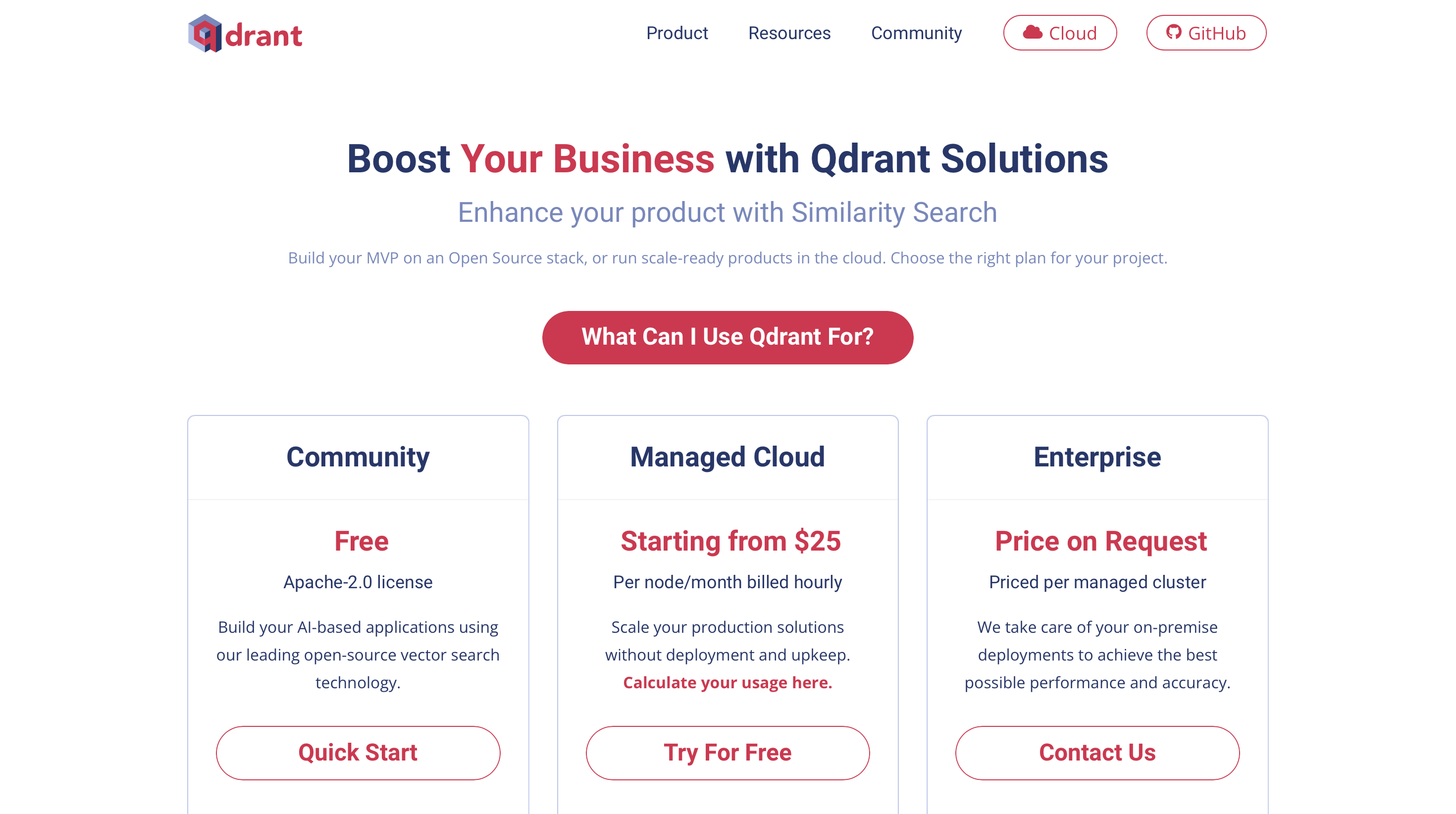

prezos

Podes comezar a usalo de balde e os prezos premium comezan a partir de 25 USD por nodo/mes facturados por hora

8. Astra

As capacidades superiores de busca vectorial e a arquitectura sen servidor de AstraDB están a transformar as aplicacións xerativas de IA.

AstraDB é unha excelente opción para xestionar buscas complexas e sensibles ao contexto a través dunha variedade de tipos de datos, xa que está construído sobre a base sólida de Apache Cassandra e combina perfectamente escalabilidade, estabilidade e rendemento.

A capacidade de AstraDB para xestionar cargas de traballo heteroxéneas, incluídos os datos de transmisión, non vectoriais e vectoriais, conservando unha latencia extremadamente baixa para operacións de consulta e actualización simultáneas, é unha das súas vantaxes máis notables.

Esta adaptabilidade é esencial para as aplicacións de IA xerativa, que requiren streaming e procesamento de datos en tempo real para proporcionar respostas de IA precisas e conscientes do contexto.

A solución sen servidor de AstraDB fai que o desenvolvemento sexa aínda máis sinxelo, liberando aos desenvolvedores para que se concentren na creación de aplicacións de IA innovadoras en lugar de xestionar a infraestrutura de backend.

Desde unha guía de inicio rápido ata leccións en profundidade sobre a creación de chatbots e sistemas de recomendación, AstraDB permite aos desenvolvedores realizar rapidamente as súas ideas de IA a través de API fiables e interfaces fluidas con ferramentas e plataformas coñecidas.

Os sistemas de intelixencia artificial xerativa de nivel empresarial deben priorizar a seguridade e o cumprimento, e AstraDB ofrece en ambas as frontes.

Proporciona funcións de seguridade corporativa profundas e certificacións de conformidade, que garanten que as aplicacións de IA desenvolvidas en AstraDB cumpren as directrices máis estritas de privacidade e protección de datos.

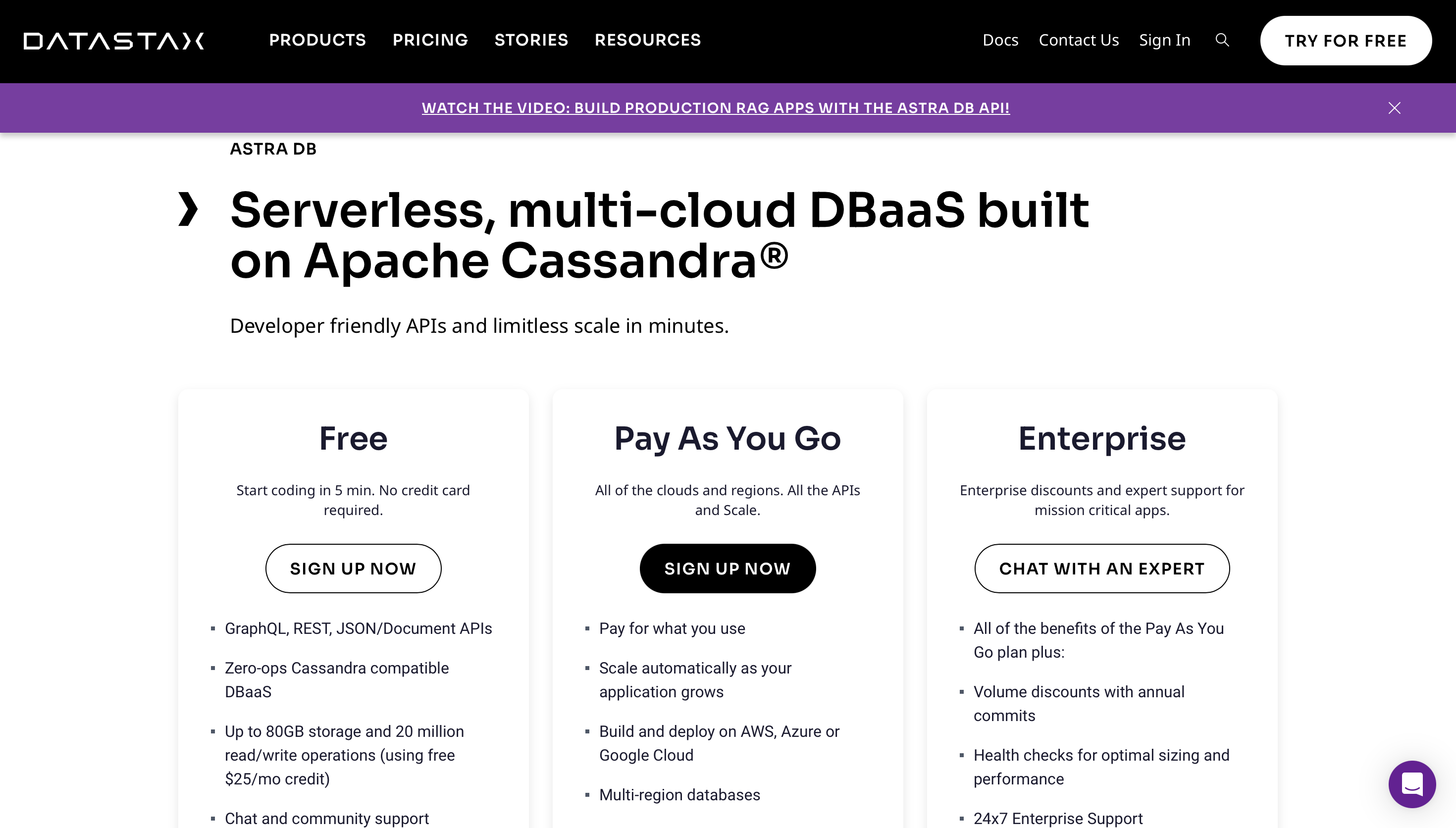

prezos

Podes comezar a usalo de balde e ofrece un modelo de pago por uso.

9. OpenSearch

OpenSearch aparece como unha opción atractiva para aqueles que exploran bases de datos vectoriales, especialmente para desenvolver sistemas de IA adaptables, escalables e a proba de futuro.

OpenSearch é unha base de datos de vectores de código aberto todo incluído que combina o poder da análise, a busca vectorial sofisticada e a busca convencional nun só sistema cohesionado.

Ao usar modelos de incorporación de aprendizaxe automática para codificar o significado e o contexto de múltiples formularios de datos (documentos, fotos e audio) en vectores para buscas de semellanza, esta integración é especialmente útil para os desenvolvedores que buscan incluír a comprensión semántica nas súas aplicacións de busca.

Aínda que OpenSearch ten moito que ofrecer, é vital lembrar que en comparación con Elasticsearch, houbo moitos menos cambios de código, especialmente en módulos críticos como linguaxes de script e procesadores de pipeline de inxestión.

Elasticsearch pode ter capacidades máis sofisticadas debido ao maior esforzo de desenvolvemento, o que leva a diferenzas de rendemento, conxunto de funcións e actualizacións entre ambos.

OpenSearch compensa cun gran número de seguidores da comunidade e unha dedicación ás ideas de código aberto, o que resulta nunha plataforma aberta e adaptable.

Admite unha ampla gama de aplicacións máis aló da busca e da analítica, como a analítica de observabilidade e seguridade, o que o converte nunha ferramenta flexible para tarefas intensivas en datos.

A estratexia impulsada pola comunidade garante melloras e integracións continuas para manter a plataforma actualizada e única.

prezos

Podes comezar a usalo de balde.

10. Azure AI Search

Azure AI Search é unha plataforma forte que mellora as capacidades de busca dentro das aplicacións xerativas de IA.

Destaca porque admite a busca vectorial, un mecanismo para indexar, almacenar e recuperar incrustacións de vectores dentro dun índice de busca.

Esta función axuda a descubrir documentos comparables no espazo vectorial, obtendo resultados de busca máis relevantes para o contexto.

Azure AI Search distínguese pola súa compatibilidade con situacións híbridas, nas que as buscas de vectores e palabras clave se realizan simultáneamente, o que resulta nun conxunto de resultados unificado que con frecuencia supera a eficacia de cada técnica utilizada por si soa.

A combinación de material vectorial e non vectorial no mesmo índice permite unha experiencia de busca máis completa e flexible.

A función de busca vectorial en Azure AI Search é amplamente accesible e gratuíta para todos os niveis de Azure AI Search.

É extremadamente flexible para unha variedade de casos de uso e preferencias de desenvolvemento debido á súa compatibilidade con varios contornos de desenvolvemento, que se proporciona a través do sitio de Azure. APOS DE DESCANSO, e SDK para Python, JavaScript e.NET, entre outros.

Coa súa profunda integración co ecosistema de IA de Azure, Azure AI Search ofrece máis que unha simple busca; tamén mellora o potencial do ecosistema para as aplicacións xerativas de IA.

Azure OpenAI Studio para a incorporación de modelos e Azure AI Services para a recuperación de imaxes son só dous exemplos dos servizos que se inclúen nesta integración.

Azure AI Search é unha solución flexible para desenvolvedores que desexen incorporar funcións de busca sofisticadas nas súas aplicacións debido ao seu amplo soporte, que permite unha ampla gama de aplicacións, desde busca de semellanza e busca multimodal ata busca híbrida e busca multilingüe.

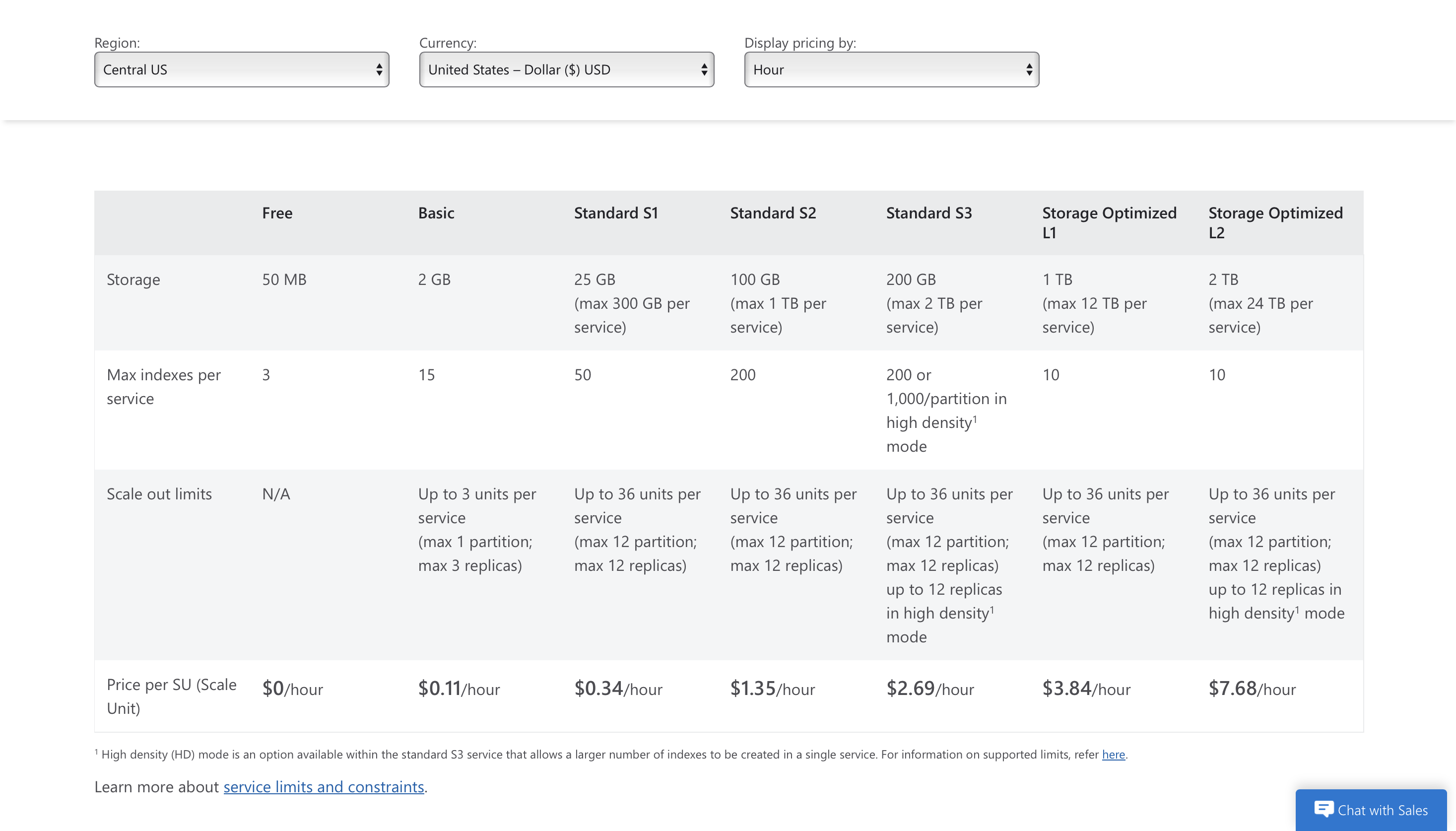

prezos

Podes comezar a usalo de forma gratuíta e os prezos premium comezan a partir de 0.11 USD/hora.

Conclusión

As bases de datos vectoriais están a transformar a xestión de datos na IA mediante a xestión de vectores de gran dimensión, o que permite realizar buscas de semellanzas fortes e consultas rápidas de veciños máis próximos en aplicacións como sistemas de recomendación e detección de fraudes.

Co uso de algoritmos de indexación sofisticados, estas bases de datos converten datos complicados non estruturados en vectores significativos ao tempo que proporcionan a velocidade e flexibilidade que as bases de datos tradicionais non teñen.

Entre as plataformas destacadas destacan Pinecone, que brilla nas aplicacións de IA xerativa; FAISS, creado por Facebook AI para a agrupación de vectores densos; e Milvus, que é coñecida pola súa escalabilidade e arquitectura nativa da nube.

Weaviate combina a aprendizaxe automática coa busca consciente do contexto, mentres que Vespa e Chroma destacan polas súas capacidades informáticas de baixa latencia e facilidade de uso, respectivamente.

As bases de datos vectoriais son ferramentas vitais para desenvolver tecnoloxías de IA e de aprendizaxe automática xa que plataformas como Qdrant, AstraDB, OpenSearch e Azure AI Search ofrecen unha variedade de servizos, desde arquitecturas sen servidor ata amplas capacidades de busca e análise.

Deixe unha resposta