Table of Contents[Ferstopje][Toanje]

Vector-databases fertsjintwurdigje in wichtige ferskowing yn hoe't wy gegevens beheare en ynterpretearje, benammen op it mêd fan keunstmjittige yntelliginsje en masine learen.

De fûnemintele funksje fan dizze databases is om heechdimensjonale fektors effektyf te behanneljen, dy't it grûnstof binne fan masine-learmodellen en omfetsje de konverzje fan tekst, ôfbylding of audio-ynput yn numerike foarstellings yn multydimensionale romte.

Foar tapassingen lykas oanbefellingssystemen, objektherkenning, opheljen fan foto's en fraudedeteksje is dizze transformaasje mear as allinich opslach; it is in doar nei krêftige mooglikheden yn sykaksjes op oerienkomst en fragen neist buorlju.

Djipperer is de krêft fan fektordatabases yn har kapasiteit om grutte hoemannichten unstrukturearre, yngewikkelde gegevens oer te setten yn fektors dy't de kontekst en betsjutting fan 'e orizjinele ynhâld fange.

De ferbettere sykfunksjes dy't mooglik makke wurde troch it ynbêdzjen fan modellen yn dizze kodearring omfetsje de mooglikheid om omlizzende fektors te freegjen om relatearre ôfbyldings of útdrukkingen te finen.

Vector databases binne unyk yn dat se binne boud op avansearre yndeksearjen techniken lykas Inverted File Index (IVF) en Hierarchical Navigable Small World (HNSW), dy't ferbettert harren snelheid en effisjinsje by it lokalisearjen fan neiste buorlju yn N-dimensionale romten.

D'r is in dúdlik ferskil tusken vector- en klassike databases. Konvinsjonele databases binne geweldich by it organisearjen fan gegevens yn organisearre sets dy't CRUD-optimalisearre binne en folgje oan ynstelde skema's.

By it omgean mei de dynamyske en yngewikkelde aard fan heechdimensjonale gegevens, begjint dizze rigiditeit lykwols in hinder te wurden.

Yn tsjinstelling biede fektordatabases in graad fan fleksibiliteit en effisjinsje dy't tradisjonele ekwivalinten net lykweardich binne, benammen foar applikaasjes dy't sterk fertrouwe op masine learen en keunstmjittige yntelliginsje. Se binne net allinich skalberber en bekwaam yn sykaksjes op oerienkomst.

Vector-databases binne benammen nuttich foar generative AI-applikaasjes. Om te garandearjen dat it makke materiaal kontekstuele yntegriteit behâldt, binne dizze applikaasjes - dy't natuerlike taalferwurking en ôfbyldingsgeneraasje omfetsje - ôfhinklik fan it rappe opheljen en fergelykjen fan ynbêdingen.

Dat yn dit stik sille wy de topfektordatabases sjen foar jo folgjende projekt.

1. Milvus

Milvus is in pionierjende iepen-boarne-fektordatabase dy't primêr ûntworpen is foar AI-applikaasjes, ynklusyf ynbêde sykaksjes op oerienkomst en krêftige MLOps.

It ferskilt fan konvinsjonele relational databases, dy't meastentiids omgean struktureare gegevens, fanwege dizze kapasiteit, dy't it mooglik makket om vectoren te yndeksearjen op in ungewoane trillion skaal.

De tawijing fan Milvus oan skalberens en hege beskikberens wurdt oantoand troch de manier wêrop it hat ûntwikkele fan har earste ferzje nei de folslein ferdielde, wolk-native Milvus 2.0.

Spesifyk eksposearret Milvus 2.0 in folslein wolk-native ûntwerp dat as doel is op in ferrassende 99.9% beskikberens by it skaaljen fan boppe hûnderten knopen.

Foar dyjingen dy't op syk binne nei in betroubere oplossing foar fektordatabase, komt dizze edysje tige oan te rieden, om't it net allinich ferfine funksjes tafoegje lykas in multi-wolkferbining en in bestjoerlik paniel, mar it ferbetteret ek gegevenskonsistinsjenivo's foar fleksibele applikaasjeûntwikkeling.

In opmerklik foardiel fan Milvus is syn mienskip-oandreaune oanpak, dy't meartalige stipe leveret en in wiidweidige toolchain ôfstimd op 'e easken fan ûntwikkelders.

Yn 'e IT-sektor meitsje har skaalberens en betrouberens fan' e wolk, tegearre mei har heechprestearjende fektorsykfunksjes op grutte datasets, it in populêre opsje.

Derneist ferbettert it de effisjinsje fan har operaasjes mei in hybride sykmooglikheid dy't sykopdracht foar fektorgelikens kombinearret mei skalêre filtering.

Milvus hat in bestjoerlik paniel mei in dúdlik brûkersynterface, in folsleine set fan API's, en in skalbere en ynstelbere arsjitektuer.

Kommunikaasje mei eksterne applikaasjes wurdt fasilitearre troch de tagong laach, wylst load balancing en gegevens behear wurde koördinearre troch de koördinator tsjinst, dy't tsjinnet as it sintrale kommando.

De permaninsje fan 'e databank wurdt stipe troch de objektopslachlaach, wylst arbeidersknooppunten aktiviteiten útfiere om skaalberens te garandearjen.

Pricing

It is fergees te brûken foar elkenien.

2. FAISS

Facebook's AI-ûndersyksteam ûntwikkele in nijsgjirrige bibleteek neamd Facebook AI Similarity Search dy't is ûntworpen om dichte fektorklustering en sykjen nei oerienkomst effektiver te meitsjen.

De skepping dêrfan waard dreaun troch de eask om Facebook AI's sykmasjines foar gelikensens te ferbetterjen troch gebrûk te meitsjen fan avansearre fûnemintele metodologyen.

Yn ferliking mei CPU-basearre ymplemintaasjes kin de moderne GPU-ymplemintaasje fan FAISS de syktiden mei fiif oant tsien kear fersnelle, wêrtroch it in ûnskatbere wearde ark is foar in ferskaat oan applikaasjes, ynklusyf oanbefellingssystemen en de identifikaasje fan ferlykbere betsjuttingen yn sizable unstrukturearre datasets lykas tekst, audio en fideo.

FAISS kin in breed skala oan oerienkomstmetriken behannelje, lykas cosinus-oerienkomst, ynderlik produkt, en de meast brûkte L2-metrik (Euklidyske ôfstân).

Dizze mjittingen meitsje it makliker om krekte en fleksibele sykaksjes op oerienkomst te dwaan oer ferskate gegevenssoarten. Funksjes lykas batchferwurking, ôfwikselingen foar presyzje-snelheid, en stipe foar sawol krekte as sawat sykopdrachten fergrutsje de fleksibiliteit fierder.

Derneist biedt FAISS in skalbere metoade foar it behanneljen fan massive datasets troch it tastean fan yndeksen te bewarjen op skiif.

It omkearde bestân, produktkwantisaasje (PQ), en ferbettere PQ binne mar in pear fan 'e ynnovative techniken dy't de ûndersyksfûns fan FAISS útmeitsje en tafoegje oan syn effektiviteit as it giet om yndeksearjen en sykjen fan heechdimensjonale fektorfjilden.

Dizze strategyen wurde fersterke troch moderne oanpak lykas GPU-fersnelde k-seleksje-algoritmen en foarfiltering fan PQ-ôfstannen, en garandearje de kapasiteit fan FAISS om rappe en krekte sykresultaten te produsearjen, sels yn datasets op miljard skaal.

Pricing

It is fergees te brûken foar elkenien.

3. pine cone

Pinecone is in lieder yn fektordatabases, en leveret in wolk-native, beheare tsjinst dy't spesjaal is boud om de prestaasjes fan heech-oandreaune AI-applikaasjes te ferbetterjen.

It is spesifyk ûntworpen om fektor-ynbêdingen te behanneljen, dy't essensjeel binne foar generative AI, semantysk sykjen, en applikaasjes mei massive taalmodellen.

AI kin no semantyske ynformaasje begripe troch dizze ynbêdingen, dy't effektyf fungearje as in lange-termyn ûnthâld foar yngewikkelde taken.

Pinecone is unyk yn dat it de mooglikheden fan tradisjonele databases naadloos yntegreart mei de ferbettere prestaasjes fan fektoryndeksen, wêrtroch it effisjinte en grutskalige opslaan en freegjen fan ynbêden mooglik is.

Dit makket it de perfekte opsje yn situaasjes dêr't de kompleksiteit en it folume fan gegevens belutsen meitsje standert skalaar-basearre databases ûnfoldwaande.

Pinecone biedt ûntwikkelders in probleemfrije oplossing fanwegen syn managed service-oanpak, dy't de prosedueres foar yntegraasje en real-time gegevensopname streamlines.

Tal fan gegevens operaasjes wurde stipe troch it, ynklusyf opheljen, bywurkjen, wiskjen, opfreegje, en upserting gegevens.

Pinecone garandearret fierder dat queries dy't real-time wizigingen fertsjintwurdigje, lykas upserts en deletions, korrekte antwurden mei lege latency leverje foar yndeksen mei miljarden vectoren.

Yn dynamyske situaasjes is dizze funksje essensjeel foar it behâld fan de relevânsje en frisheid fan queryresultaten.

Derneist fergruttet it gearwurkingsferbân fan Pinecone mei Airbyte fia de Pinecone-ferbining syn veelzijdigheid en fleksibiliteit, wêrtroch soepele gegevensyntegraasje fan in ferskaat oan boarnen mooglik is.

Troch dizze relaasje kinne kosten en effisjinsje wurde optimalisearre troch te garandearjen dat allinich nij oankocht ynformaasje wurdt behannele troch inkrementele datasyngronisaasje.

It ûntwerp fan 'e connector beklammet de ienfâld, dy't gewoan minimale opsetparameters nedich is, en it is útwreidber, wêrtroch takomstige ferbetteringen mooglik binne.

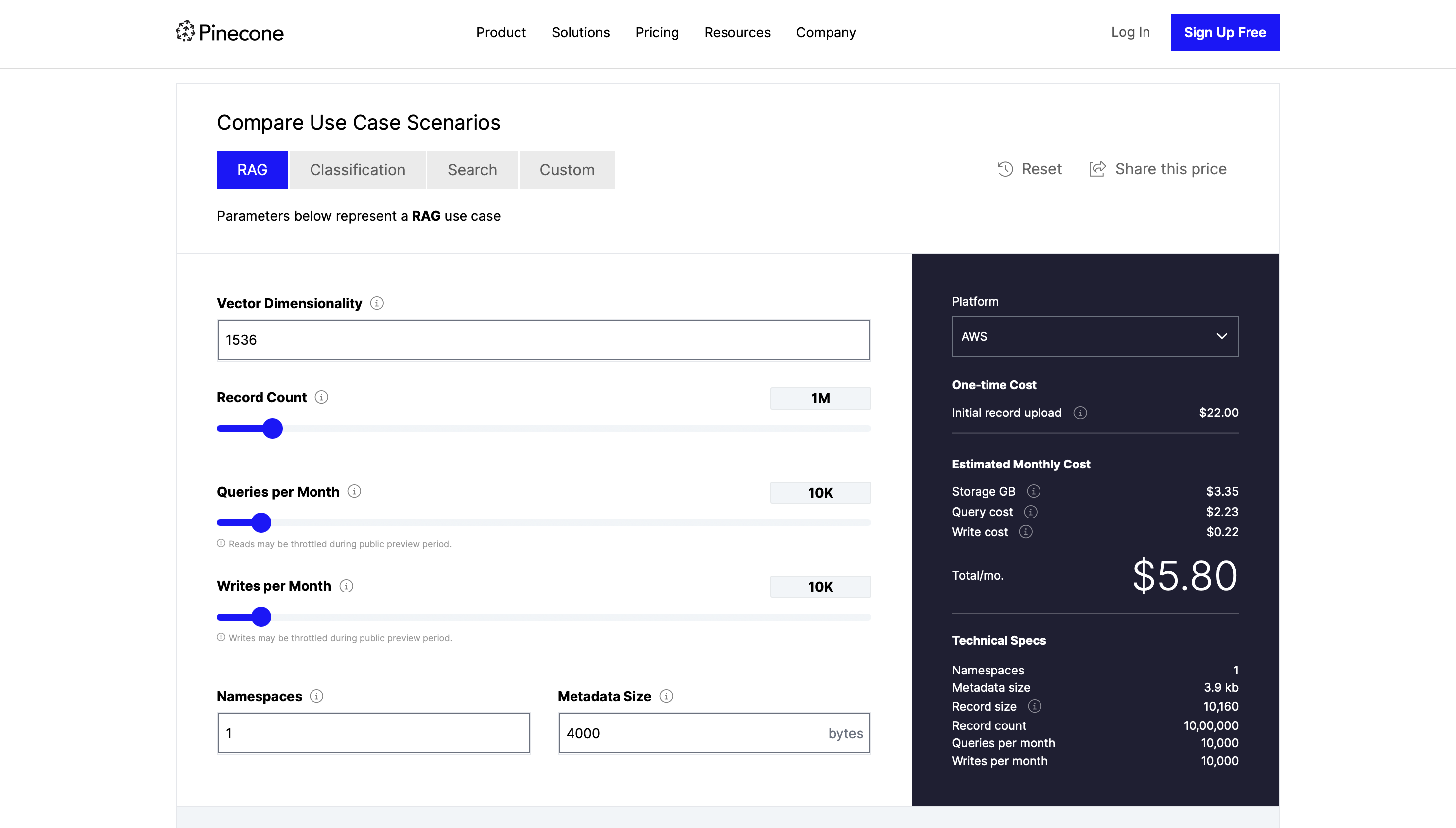

Pricing

De preemjepriis begjint fan $ 5.80 / moanne foar it gebrûk fan RAG.

4. Weaviate

Weaviate is in ynnovative fektordatabase dy't beskikber is as iepen boarne software dy't de manier transformeart wêrop wy tagong krije ta en gebrûk meitsje fan gegevens.

Weaviate makket gebrûk fan fektorsykfunksjes, dy't ferfine, kontekstbewuste sykopdrachten mooglik meitsje oer grutte, yngewikkelde datasets, yn tsjinstelling ta typyske databases dy't ôfhinklik binne fan skalêre wearden en foarôf definieare fragen.

Mei dizze metoade kinne jo ynhâld fine op basis fan hoe ferlykber it is mei oare ynhâld, wat de yntuïtiviteit fan sykopdrachten en de relevânsje fan 'e resultaten ferbetteret.

It soepele yntegraasje mei masine learen modellen is ien fan syn primêre skaaimerken; dit lit it funksjonearje as mear dan gewoan in oplossing foar gegevensopslach; it lit ek gegevens wurde begrepen en analysearre mei help fan keunstmjittige yntelliginsje.

De arsjitektuer fan Weaviate omfettet dizze yntegraasje yngeand, wêrtroch it mooglik is om komplekse gegevens te analysearjen sûnder ekstra ark te brûken.

De stipe foar grafyske gegevensmodellen leveret ek in oar sicht op gegevens as keppele entiteiten, bleatstelling fan patroanen en ynsjoggen dy't koenen wurde mist yn konvinsjonele database-arsjitektueren.

Fanwegen de modulêre arsjitektuer fan Weaviate kinne klanten mooglikheden tafoegje lykas gegevensfektorisaasje en oanmeitsjen fan reservekopy as nedich.

De fûnemintele ferzje fungearret as in databank foar spesjalistyske fektorgegevens, en it kin wurde útwreide mei oare modules om oan ferskate behoeften te foldwaan.

De skalberens dêrfan wurdt fierder ferbettere troch it modulêre ûntwerp, dat garandearret dat snelheid net wurdt opoffere yn reaksje op tanimmende gegevenshoeveelheden en fraachfragen.

In alsidige en effektive metoade foar ynteraksje mei de opsleine gegevens wurdt mooglik makke troch de stipe fan 'e database foar sawol RESTful as GraphQL API's.

Benammen GraphQL wurdt selektearre fanwegen syn fermogen om yngewikkelde, op grafyk basearre queries rap út te fieren, wêrtroch brûkers krekt de gegevens kinne krije dy't se wolle sûnder tefolle of net genôch gegevens te krijen.

Weaviate is brûkerfreonliker yn in ferskaat oan kliïntbiblioteken en programmeartalen troch syn fleksibele API.

Foar dyjingen dy't Weaviate fierder wolle ferkenne, is d'r in oerfloed fan dokumintaasje en tutorials beskikber, fan it ynstellen en konfigurearjen fan jo eksimplaar oant djippe dûken yn syn mooglikheden lykas fektorsykjen, yntegraasje fan masine learen, en skema-ûntwerp.

Jo kinne tagong krije ta deselde krêftige technology dy't ynformaasje dynamysk en aksjeber makket, of jo beslute om Weaviate lokaal te operearjen, yn in wolk Computing omjouwing, of fia de Weaviate managed cloud service

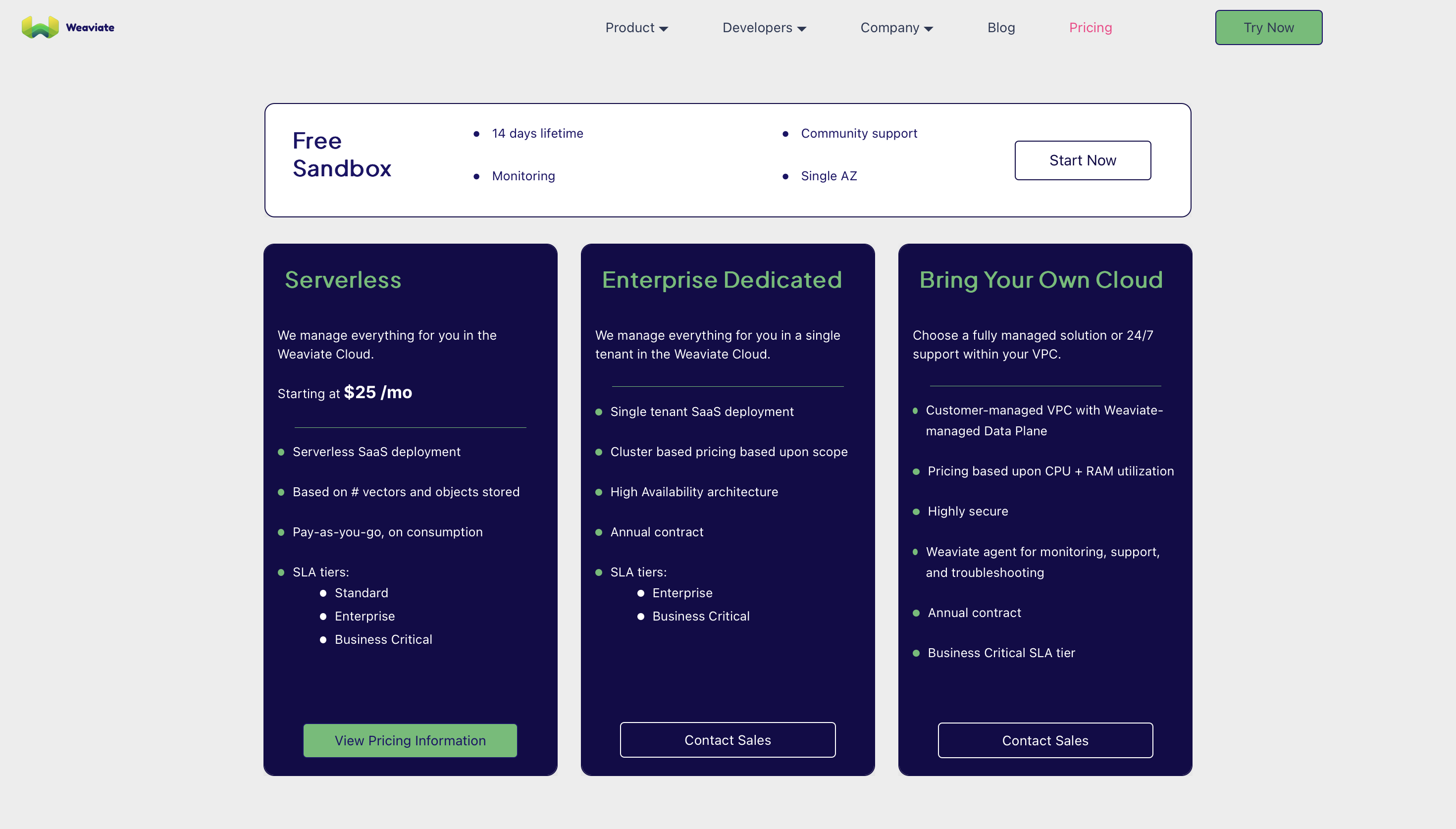

Pricing

De premium prizen fan it platfoarm begjint fan $ 25 / moanne foar serverless.

5. Chroma

Chroma is in foaroansteande fektordatabase dy't as doel hat it opheljen en opslaan fan gegevens te revolúsjonearjen, foaral foar applikaasjes wêrby't masine learen en keunstmjittige yntelliginsje.

Sûnt Chroma wurket mei vectoren ynstee fan skalêre nûmers, yn tsjinstelling ta standert databases, is it tige goed by it behearen fan heechdimensjonale, yngewikkelde gegevens.

Dit is in grutte foarútgong yn technology foar opheljen fan gegevens, om't it mear ferfine sykopdrachten mooglik makket op basis fan 'e semantyske oerienkomst fan it materiaal ynstee fan krekte trefwurdoerienkomsten.

In opmerklik karakteristyk fan Chroma is har fermogen om te wurkjen mei ferskate ûnderlizzende opslachoplossingen, lykas ClickHouse foar skalearre ynstellings en DuckDB foar standalone ynstallaasjes, en garandearje fleksibiliteit en oanpassing oan ferskate gebrûksgefallen.

Chroma is makke mei ienfâld, snelheid en analyse yn gedachten. It is beskikber foar in breed spektrum fan ûntwikkelders mei SDK's foar Python en JavaScript/TypeScript.

Derneist pleatst Chroma in sterke klam op brûkerfreonlikens, wêrtroch ûntwikkelders fluch in permaninte databank kinne ynstelle stipe troch DuckDB as in databank yn it ûnthâld foar testen.

De mooglikheid om te bouwen samling objekten dy't lykje op tabellen yn konvinsjonele databases, dêr't tekst gegevens kinne wurde ynfoege en automatysk omfoarme ta ynbêdings mei help fan modellen lykas all-MiniLM-L6-v2, fierder fergruttet dizze veelzijdigheid.

Tekst en ynbêdingen kinne naadloos yntegreare wurde, wat essensjeel is foar applikaasjes dy't gegevenssemantyk moatte begripe.

De stifting fan Chroma's fektorgelikensmetoade is de wiskundige begripen fan ortogonaliteit en tichtens, dy't essensjeel binne foar it begripen fan 'e fertsjintwurdiging en fergeliking fan gegevens yn databases.

Dizze ideeën kinne Chroma sinfolle en effisjinte sykaksjes op oerienkomst útfiere troch rekken te hâlden mei de semantyske keppelings tusken gegevenseleminten.

Boarnen lykas tutorials en rjochtlinen binne tagonklik foar persoanen dy't Chroma fierder wolle ferkenne. Se omfetsje stap-foar-stap begelieding oer hoe't jo de databank ynstelle, kolleksjes meitsje en sykjen nei oerienkomst útfiere.

Pricing

Jo kinne it fergees begjinne te brûken.

6. Vespa

Vespa is in platfoarm dat de online ôfhanneling fan AI en grutte gegevens transformeart.

It fûnemintele doel fan Vespa is om berekkeningen mei lege latency yn te skeakeljen oer grutte datasets, wêrtroch jo maklik tekst, vector en strukturearre gegevens kinne opslaan, yndeksearje en analysearje.

Vespa wurdt ûnderskieden troch syn fermogen om rappe antwurden op elke skaal te leverjen, nettsjinsteande de aard fan 'e fragen, karren, of masine-learde modelkonklúzjes dy't wurde behannele.

De fleksibiliteit fan Vespa wurdt werjûn yn har folslein funksjonele sykmasjine en fektordatabase, dy't in protte sykopdrachten yn ien inkelde fraach mooglik meitsje, fariearjend fan vector (ANN), leksikale en strukturearre gegevens.

Nettsjinsteande de skaal kinne jo brûkerfreonlike en responsive sykapplikaasjes meitsje mei real-time AI-mooglikheden tanksij dizze yntegraasje fan masine-learde modelkonferinsje mei jo gegevens.

Vespa giet lykwols oer mear dan gewoan sykjen; it giet ek oer it begripen en oanpassen fan moetings.

Top-notch oanpassings- en suggestje-ark jouwe dynamyske, aktuele oanbefellings foar spesifike brûkers of omstannichheden.

Vespa is in spultsje-wikseler foar elkenien dy't ek de konversaasje-AI-romte wil ynfiere, om't it de ynfrastruktuer biedt dy't nedich is om tekst- en fektorgegevens yn realtime op te slaan en te ferkennen, wêrtroch de ûntwikkeling fan mear avansearre en praktyske AI-aginten mooglik is.

Mei wiidweidige tokenisaasje en stemming, sykopdrachten yn folsleine tekst, sykopdrachten neist buorlju, en struktureare gegevensfragen wurde allegear stipe troch de wiidweidige querymooglikheden fan it platfoarm.

It ferskilt yn dat it yngewikkelde fragen effektyf kin omgean troch ferskate sykdimensjes te kombinearjen.

Vespa is in berekkeningskrêft foar AI- en masine-learapplikaasjes, om't syn berekkeningsmotor komplekse wiskundige útdrukkingen oer skalaren en tensors kin omgean.

Yn wurking is Vespa makke om ienfâldich te brûken en útwreidber te wêzen.

It streamlines repetitive prosessen, fariearjend fan systeemkonfiguraasje en applikaasjeûntwikkeling oant gegevens- en knooppuntbehear, wêrtroch feilige en ûnûnderbrutsen produksjeoperaasjes mooglik binne.

De arsjitektuer fan Vespa soarget derfoar dat it útwreidet mei jo gegevens, en behâldt syn betrouberens en prestaasjes.

Pricing

Jo kinne it fergees begjinne te brûken.

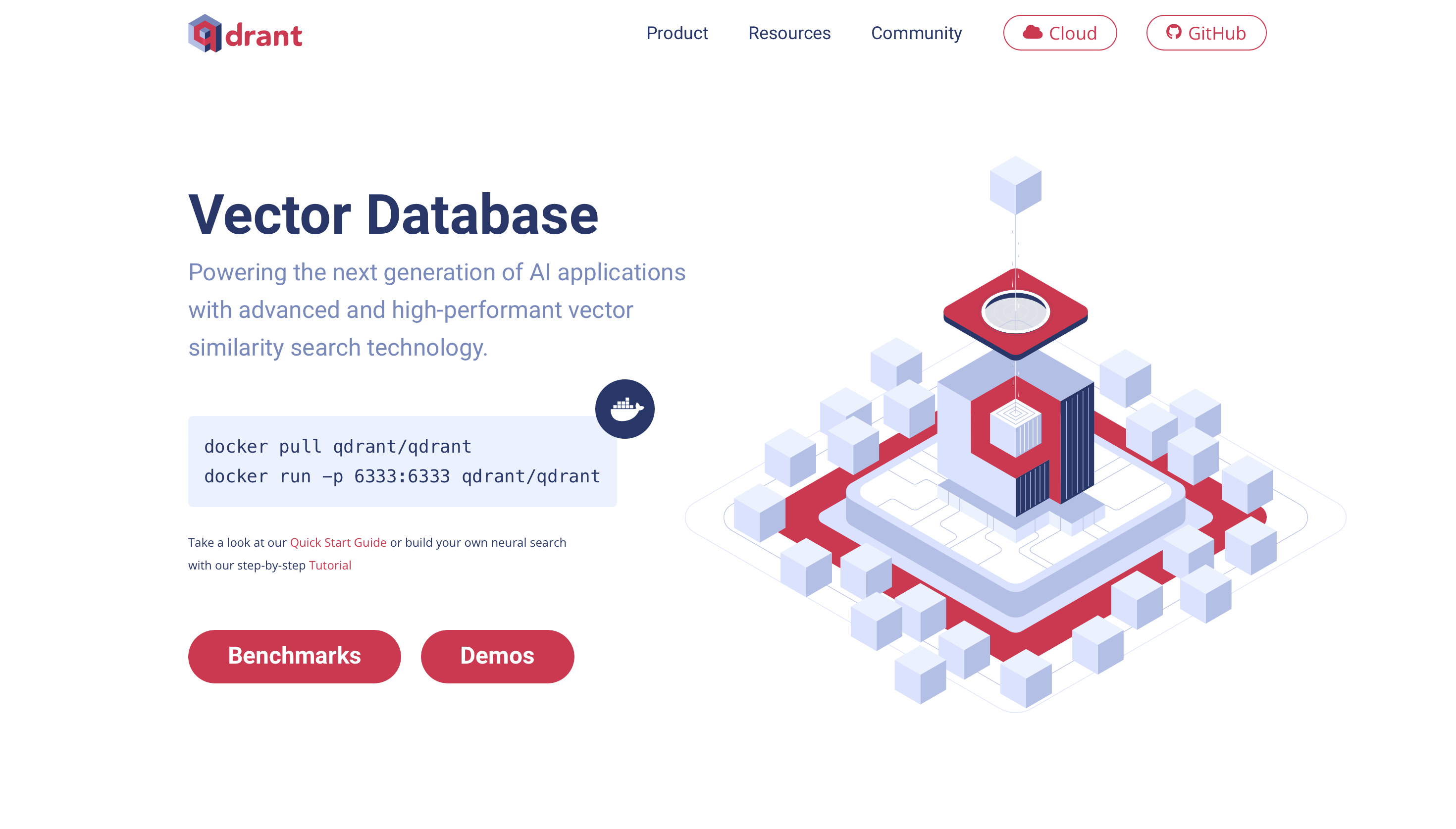

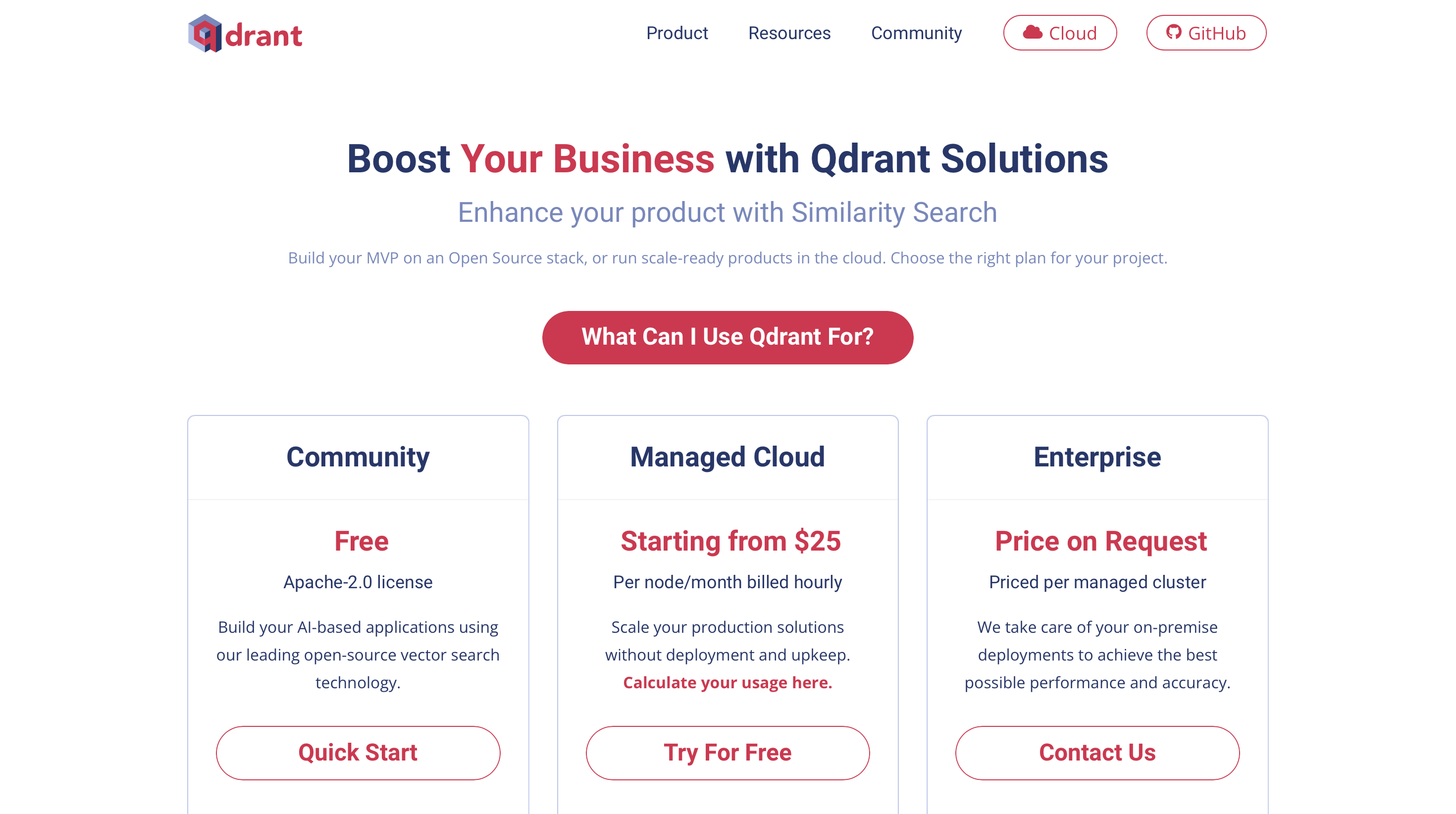

7. Kwadrant

Qdrant is in fleksibel fektordatabaseplatfoarm dat in unike set mooglikheden leveret om te foldwaan oan de groeiende easken fan AI- en masine-learapplikaasjes.

Op syn stifting is Qdrant in sykmasjine foar fektor-oerienkomst dy't in maklik te brûken API leveret foar it opslaan, finen en ûnderhâlden fan fektors lykas payloadgegevens.

Dizze funksje is krúsjaal foar ferskate applikaasjes, lykas semantyske syk- en oanbefellingssystemen, dy't ynterpretaasje fan yngewikkelde gegevensformaten fereaskje.

It platfoarm is boud mei effisjinsje en skalberens yn gedachten, by steat om massive datasets te behanneljen mei miljarden gegevenspunten.

It soarget foar ferskate ôfstânmetriken, ynklusyf Cosine Similarity, Euclidian Distance, and Dot Product, wêrtroch it oanpasber is yn in protte gebrûkssenario's.

It ûntwerp biedt komplekse filtering, lykas tekenrige, berik, en geo-filters, om te foldwaan oan ferskate sykbehoeften.

Qdrant is tagonklik foar ûntwikkelders op ferskate manieren, ynklusyf in Docker-ôfbylding foar rappe lokale opset, in Python-kliïnt foar dyjingen dy't noflik binne mei de taal, en in wolktsjinst foar in robústere, produksje-grade omjouwing.

De oanpassingsfermogen fan Qdrant soarget foar naadleaze yntegraasje mei elke technologyske konfiguraasje of prosesferlet.

Fierder simplifies Qdrant syn brûker-friendly ynterface vector database behear. It platfoarm is bedoeld om ienfâldich te wêzen foar brûkers fan alle feardigensnivo's, fan klusterskepping oant it generearjen fan API-kaaien foar feilige tagong.

De kapasiteit foar bulk-upload en asynchrone API ferbetterje har effisjinsje, wêrtroch it in heul nuttich ark is foar ûntwikkelders dy't omgean mei enoarme hoemannichten gegevens.

Pricing

Jo kinne it fergees begjinne te brûken en premium prizen begjinne fan $ 25 per knooppunt / moanne fakturearre per oere

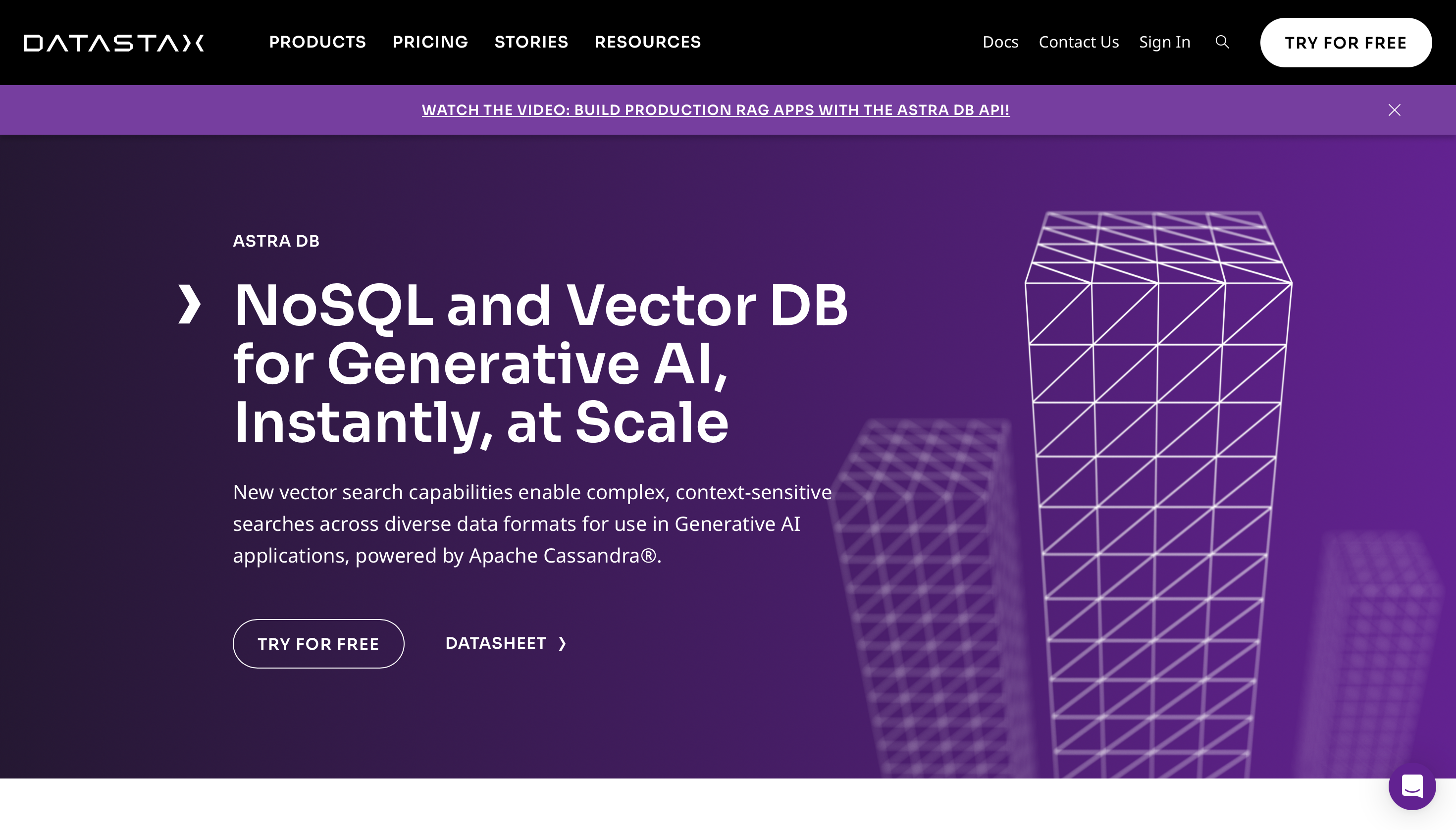

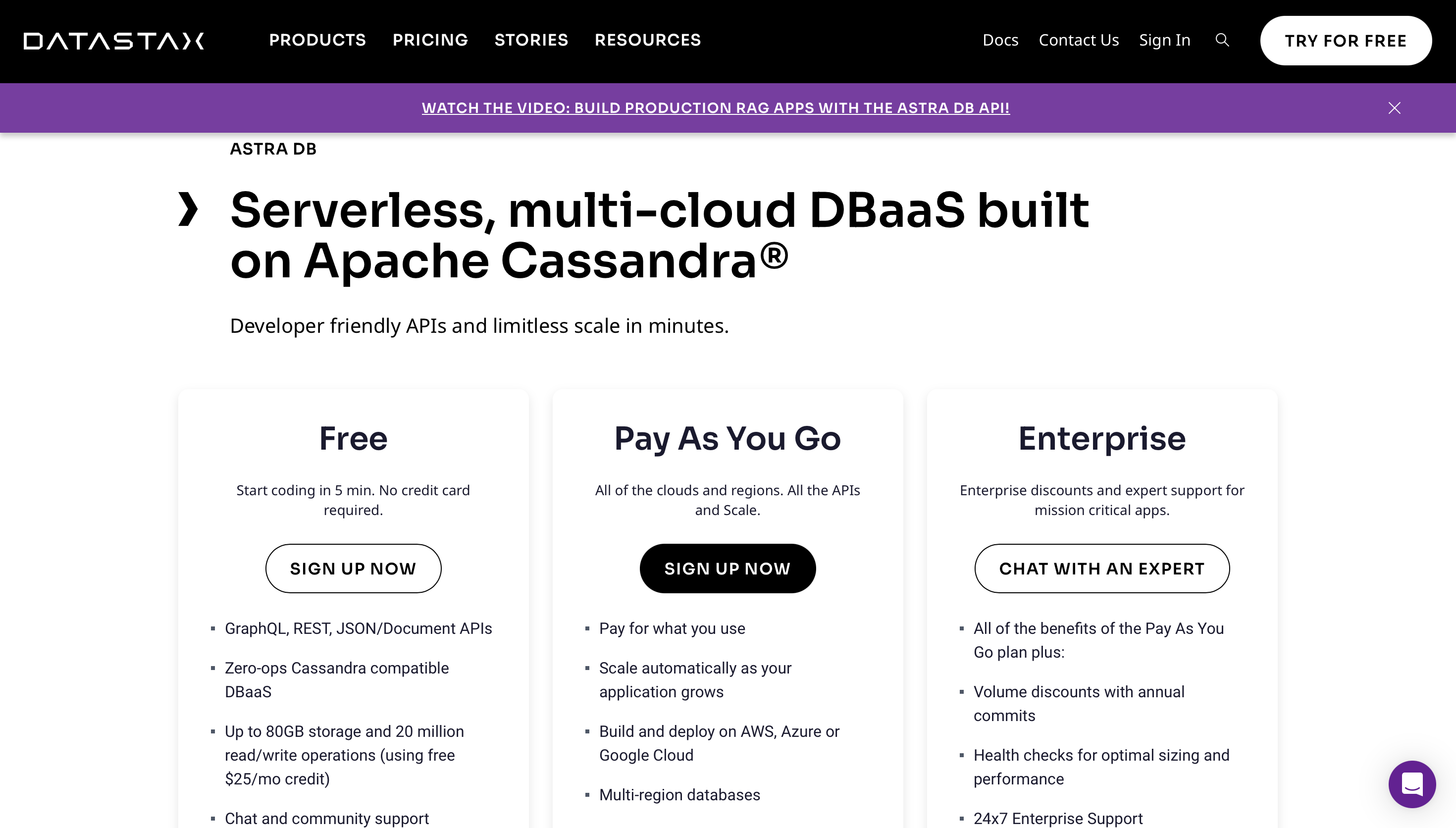

8. Astra

AstraDB's superieure fektorsykfunksjes en serverless arsjitektuer transformearje generative AI-applikaasjes.

AstraDB is in geweldige opsje foar it behearen fan yngewikkelde, kontekstgefoelige sykopdrachten oer in ferskaat oan gegevenstypen, om't it is boud op 'e solide basis fan Apache Cassandra en naadloos kombineart skalberens, stabiliteit en prestaasjes.

De kapasiteit fan AstraDB om heterogene wurkloads te behanneljen, ynklusyf streaming, net-vektor, en fektorgegevens, wylst ekstreem lege latency behâlde foar simultane query- en updateoperaasjes, is ien fan har meast opmerklike foardielen.

Dizze oanpassingsfermogen is essensjeel foar generative AI-applikaasjes, dy't streaming en real-time gegevensferwurking nedich binne om krekte, kontekstbewuste AI-antwurden te leverjen.

De serverless-oplossing fan AstraDB makket ûntwikkeling noch makliker, en makket ûntwikkelders frij om te konsintrearjen op it meitsjen fan ynnovative AI-applikaasjes ynstee fan it behearen fan de backend-ynfrastruktuer.

Fan quickstart-begelieding oant yngeande lessen oer it meitsjen fan chatbots en oanbefellingssystemen, AstraDB stelt ûntwikkelders yn steat om har AI-ideeën fluch te realisearjen fia betroubere API's en soepele ynterfaces mei bekende ark en platfoarms.

Generative AI-systemen fan Enterprise-grade moatte prioriteit jaan oan feiligens en neilibjen, en AstraDB leveret oan beide fronten.

Djippe bedriuwsfeiligensfunksjes en sertifikaasjes foar neilibjen wurde troch it levere, en garandearje dat AI-applikaasjes ûntwikkele op AstraDB har hâlde oan de strangste rjochtlinen foar privacy en gegevensbeskerming.

Pricing

Jo kinne it fergees begjinne te brûken en it biedt in pay-as-you-go-model.

9. OpenSearch

OpenSearch ferskynt as in oansprekkende opsje foar dyjingen dy't fektordatabases ferkenne, benammen foar it ûntwikkeljen fan oanpasbere, skalberbere en takomstbestindige AI-systemen.

OpenSearch is in all-inclusive, iepen-boarne fektordatabase dy't de krêft fan analytyk, ferfine fektorsykjen en konvinsjonele sykopdracht kombineart yn ien gearhingjend systeem.

Troch it brûken fan masine-learen-ynbêde-modellen om de betsjutting en kontekst fan meardere gegevensfoarmen - dokuminten, foto's en audio - te kodearjen yn fektors foar sykaksjes op oerienkomst, is dizze yntegraasje foaral nuttich foar ûntwikkelders dy't sykje om semantysk begryp op te nimmen yn har sykapps.

Hoewol OpenSearch in protte te bieden hat, is it essensjeel om te betinken dat yn ferliking mei Elasticsearch, d'r in protte minder koadeferoarings west hawwe, foaral yn krityske modules lykas skripttalen en prosessoren foar opname pipeline.

Elasticsearch kin mear ferfine mooglikheden hawwe fanwegen ferhege ûntwikkelingspogingen, wat liedt ta ferskillen yn prestaasjes, funksjeset en updates tusken de twa.

OpenSearch kompensearret mei in grutte mienskip folge en in tawijing oan iepen-boarne ideeën, resultearret yn in iepen en oanpasber platfoarm.

It stipet in breed skala oan applikaasjes bûten sykjen en analytyk, lykas observabiliteit en befeiligingsanalytyk, wêrtroch it in fleksibel ark is foar data-yntinsive taken.

De mienskip-oandreaune strategy soarget foar trochgeande ferbetterings en yntegraasjes om it platfoarm aktueel en unyk te hâlden.

Pricing

Jo kinne it fergees begjinne te brûken.

10. Azure AI Search

Azure AI Search is in sterk platfoarm dat sykmooglikheden ferbetteret binnen generative AI-applikaasjes.

It opfalt om't it fektorsykjen stipet, in meganisme foar yndeksearjen, opslaan en opheljen fan fektorynbêdingen binnen in sykyndeks.

Dizze funksje helpt te ûntdekken fergelykbere dokuminten yn fektorromte, wat resulteart yn mear kontekstueel relevante sykresultaten.

Azure AI Search wurdt ûnderskieden troch syn stipe foar hybride situaasjes, wêryn fektor- en trefwurdsykjen tagelyk wurde útfierd, wat resulteart yn in unifoarme resultaatset dy't faaks de effektiviteit fan elke technyk dy't allinich brûkt wurdt better presteart.

De kombinaasje fan fektor- en net-fektormateriaal yn deselde yndeks soarget foar in folsleine en fleksibeler sykûnderfining.

De fektorsykfunksje yn Azure AI Search is breed tagonklik en fergees foar alle Azure AI Search-tiers.

It is ekstreem fleksibel foar in ferskaat oan gebrûksgefallen en ûntwikkelingsfoarkarren fanwegen syn stipe foar ferskate ûntwikkelingsomjouwings, dy't wurdt levere fia de Azure-side, REST API's, en SDK's foar ûnder oaren Python, JavaScript, en.NET.

Mei syn djippe yntegraasje mei it Azure AI-ekosysteem biedt Azure AI Search mear dan gewoan sykjen; it ferbettert ek it potensjeel fan it ekosysteem foar generative AI-applikaasjes.

Azure OpenAI Studio foar model ynbêde en Azure AI Tsjinsten foar foto opheljen binne mar twa foarbylden fan de tsjinsten dy't binne opnaam yn dizze yntegraasje.

Azure AI Search is in fleksibele oplossing foar ûntwikkelders dy't ferfine sykfunksjes yn har applikaasjes wolle opnimme fanwegen syn wiidweidige stipe, dy't in breed oanbod fan applikaasjes mooglik makket, fan sykjen nei oerienkomst en multimodaal sykjen oant hybride sykjen en meartalich sykjen.

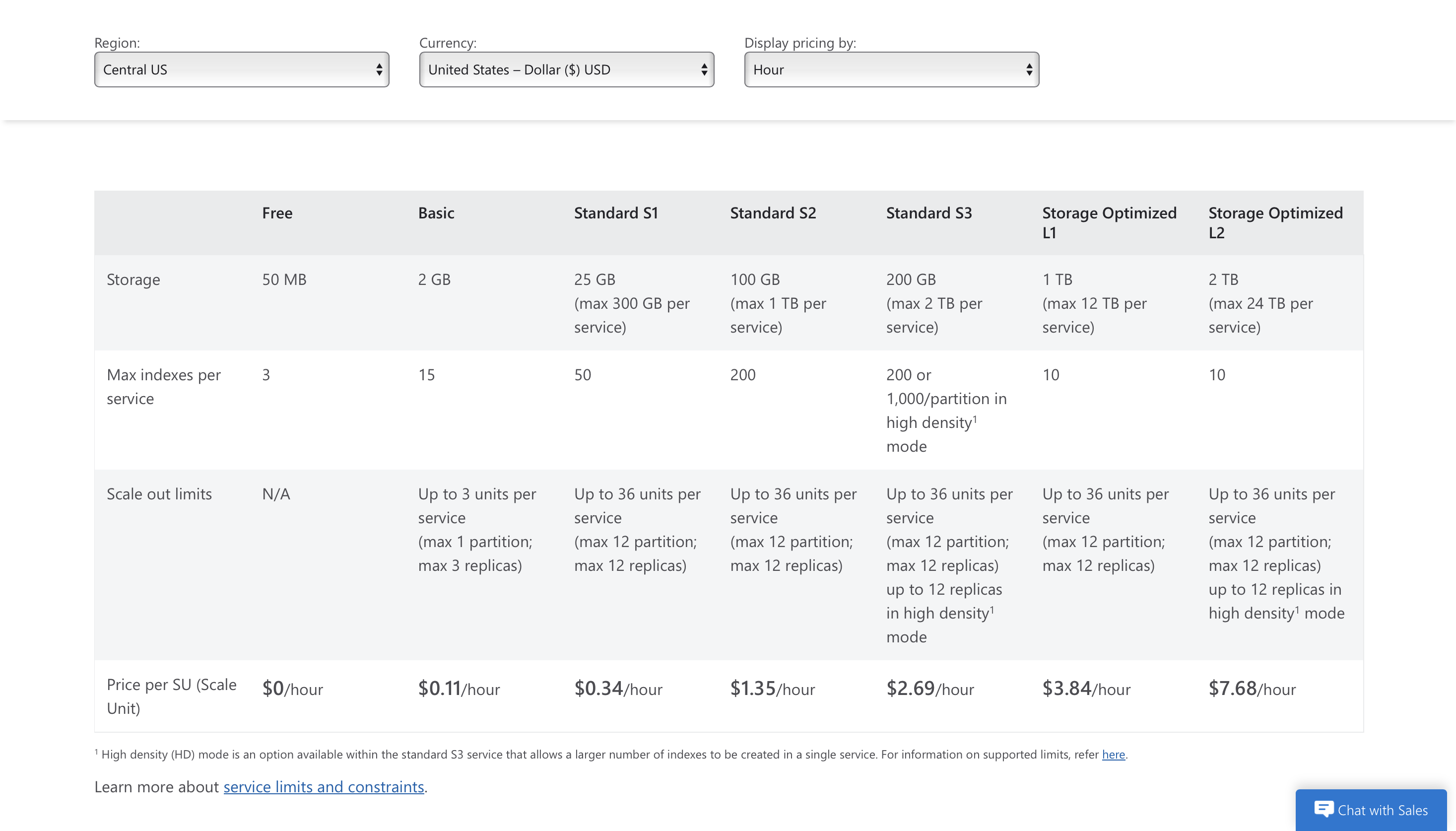

Pricing

Jo kinne it fergees begjinne te brûken en premium prizen begjinne fan $ 0.11 / oere.

Konklúzje

Fektordatabases transformearje gegevensbehear yn AI troch it behearen fan heechdimensjonale fektors, wêrtroch sterke sykopdrachten op oerienkomst en rappe fragen neist buorlju kinne wurde yn applikaasjes lykas oanbefellingssystemen en fraudedeteksje.

Mei it brûken fan ferfine yndeksearjende algoritmen, konvertearje dizze databases yngewikkelde ûnstrukturearre gegevens yn sinfolle fektors, wylst se de snelheid en fleksibiliteit leverje dy't tradisjonele databases net dogge.

Opmerklike platfoarms befetsje Pinecone, dy't skynt yn generative AI-applikaasjes; FAISS, makke troch Facebook AI foar dichte vector clustering; en Milvus, dy't ferneamd is om syn skalberens en wolk-native arsjitektuer.

Weaviate kombineart masine learen mei kontekstbewust sykjen, wylst Vespa en Chroma opmerklik binne foar respektivelik har komputermooglikheden mei lege latency en gebrûksgemak.

Fektordatabases binne essensjele ark foar it ûntwikkeljen fan AI- en masine-leartechnologyen, om't platfoarms lykas Qdrant, AstraDB, OpenSearch, en Azure AI Search in ferskaat oan tsjinsten leverje, fan serverleaze arsjitektuer oant wiidweidige syk- en analytyske mooglikheden.

Leave a Reply