Table des matières[Cacher][Montrer]

Je suis sûr que vous avez entendu parler de l'intelligence artificielle, ainsi que des mots comme l'apprentissage automatique et le traitement du langage naturel (NLP).

Surtout si vous travaillez pour une entreprise qui gère des centaines, voire des milliers, de contacts clients chaque jour.

L'analyse des données des publications sur les réseaux sociaux, des e-mails, des chats, des réponses à des enquêtes ouvertes et d'autres sources n'est pas un processus simple, et elle devient encore plus difficile lorsqu'elle est confiée uniquement à des personnes.

C'est pourquoi de nombreuses personnes sont enthousiasmées par le potentiel de intelligence artificielle pour leur travail quotidien et pour les entreprises .

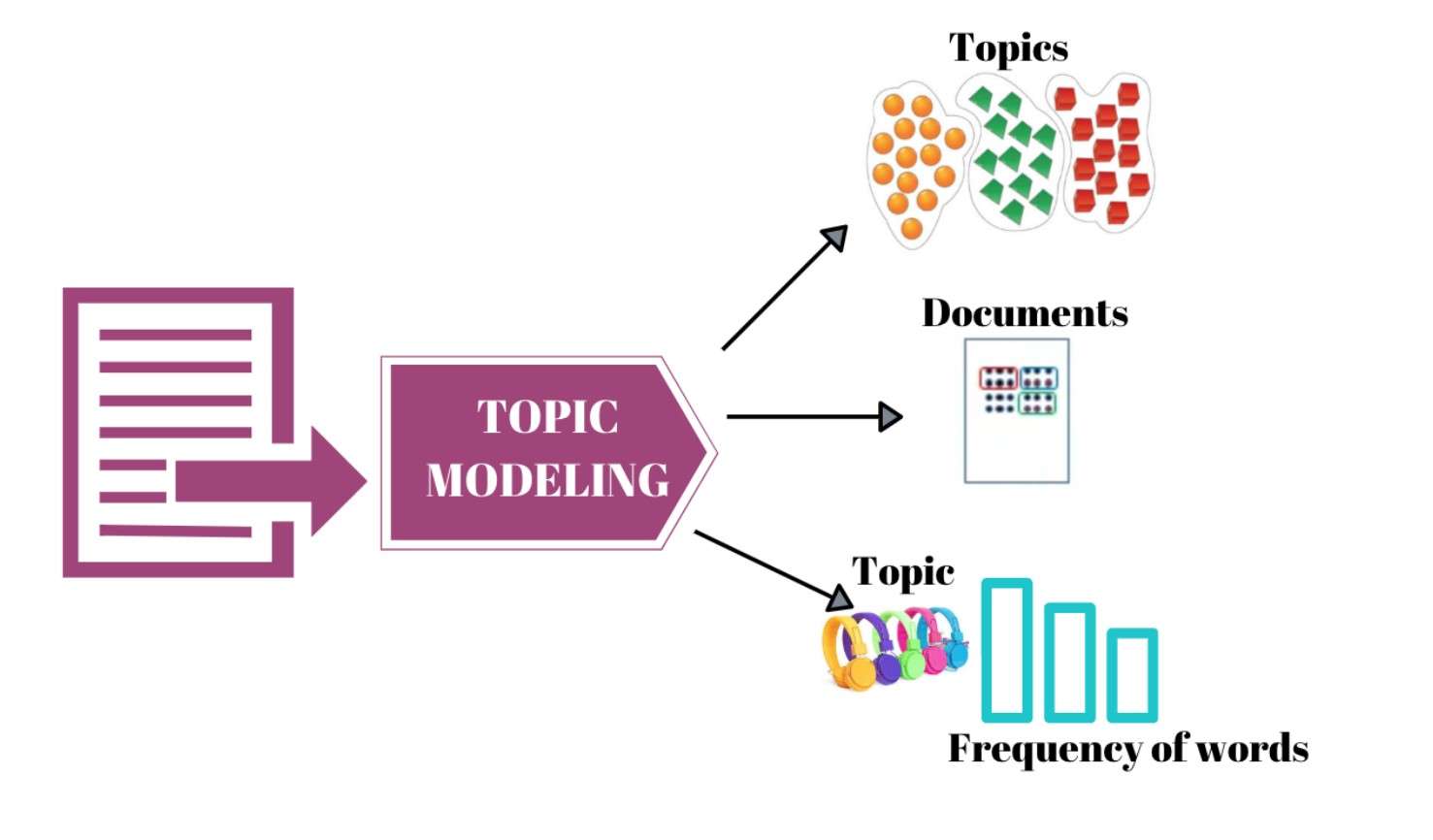

L'analyse de texte alimentée par l'IA utilise un large éventail d'approches ou d'algorithmes pour interpréter le langage de manière organique, dont l'analyse de sujet, qui est utilisée pour découvrir automatiquement des sujets à partir de textes.

Les entreprises peuvent utiliser des modèles d'analyse de sujets pour transférer des tâches faciles sur des machines plutôt que de surcharger les travailleurs avec trop de données.

Considérez le temps que votre équipe pourrait économiser et consacrer à des tâches plus essentielles si un ordinateur pouvait filtrer chaque matin des listes interminables d'enquêtes auprès des clients ou de problèmes d'assistance.

Dans ce guide, nous examinerons la modélisation de sujet, les différentes méthodes de modélisation de sujet et nous en ferons l'expérience pratique.

Qu'est-ce que la modélisation thématique ?

La modélisation thématique est un type d'exploration de texte dans lequel des statistiques non supervisées et supervisées machine learning des techniques sont utilisées pour détecter des tendances dans un corpus ou un volume important de texte non structuré.

Il peut prendre votre énorme collection de documents et utiliser une méthode de similarité pour organiser les mots en groupes de termes et découvrir des sujets.

Cela semble un peu complexe et difficile, alors simplifions la procédure de modélisation du sujet !

Supposons que vous lisez un journal avec un ensemble de surligneurs colorés à la main.

N'est-ce pas démodé ?

Je me rends compte que de nos jours, peu de gens lisent les journaux imprimés ; tout est numérique et les surligneurs appartiennent au passé ! Faites semblant d'être votre père ou votre mère !

Ainsi, lorsque vous lisez le journal, vous mettez en évidence les termes importants.

Une hypothèse de plus !

Vous utilisez une teinte différente pour souligner les mots-clés de divers thèmes. Vous classez les mots-clés en fonction de la couleur et des sujets fournis.

Chaque collection de mots marqués par une certaine couleur est une liste de mots-clés pour un sujet donné. La quantité de différentes couleurs que vous avez choisies indique le nombre de thèmes.

C'est le sujet le plus fondamental de la modélisation. Il facilite la compréhension, l'organisation et la synthèse de grandes collections de textes.

Cependant, gardez à l'esprit que pour être efficaces, les modèles de sujets automatisés nécessitent beaucoup de contenu. Si vous avez un papier court, vous voudrez peut-être aller à l'ancienne et utiliser des surligneurs !

Il est également avantageux de passer du temps à se familiariser avec les données. Cela vous donnera une idée de base de ce que le modèle de sujet devrait trouver.

Par exemple, ce journal peut concerner vos relations actuelles et antérieures. Ainsi, je m'attendrais à ce que mon copain robot d'exploration de texte propose des idées similaires.

Cela peut vous aider à mieux analyser la qualité des sujets que vous avez identifiés et, si nécessaire, à ajuster les ensembles de mots-clés.

Composants de la modélisation thématique

Modèle probabiliste

Des variables aléatoires et des distributions de probabilité sont incorporées dans la représentation d'un événement ou d'un phénomène dans les modèles probabilistes.

Un modèle déterministe fournit une seule conclusion potentielle pour un événement, tandis qu'un modèle probabiliste fournit une distribution de probabilité comme solution.

Ces modèles tiennent compte du fait que nous avons rarement une connaissance complète d'une situation. Il y a presque toujours un élément aléatoire à considérer.

Par exemple, l'assurance-vie est fondée sur la réalité que nous savons que nous allons mourir, mais nous ne savons pas quand. Ces modèles peuvent être partiellement déterministes, partiellement aléatoires ou entièrement aléatoires.

Récupération d'informations

La recherche d'informations (IR) est un logiciel qui organise, stocke, récupère et évalue les informations des référentiels de documents, en particulier les informations textuelles.

La technologie aide les utilisateurs à découvrir les informations dont ils ont besoin, mais elle ne fournit pas clairement les réponses à leurs questions. Il signale la présence et la localisation de papiers susceptibles de fournir les informations nécessaires.

Les documents pertinents sont ceux qui répondent aux besoins de l'utilisateur. Un système IR sans faille renverra uniquement les documents sélectionnés.

Cohérence du sujet

Topic Coherence évalue un seul sujet en calculant le degré de similarité sémantique entre les termes les mieux notés du sujet. Ces métriques aident à faire la distinction entre les sujets sémantiquement interprétables et les sujets qui sont des artefacts d'inférence statistique.

Si un groupe d'affirmations ou de faits se soutient, on dit qu'ils sont cohérents.

Par conséquent, un ensemble cohérent de faits peut être compris dans un contexte qui englobe la totalité ou la majorité des faits. « Le jeu est un sport d'équipe », « le jeu se joue avec un ballon » et « le jeu nécessite un effort physique considérable » sont tous des exemples d'ensembles de faits cohérents.

Différentes méthodes de modélisation de sujet

Cette procédure critique peut être effectuée par une variété d'algorithmes ou de méthodologies. Parmi eux se trouvent :

- Allocation de Dirichlet Latent (LDA)

- Factorisation matricielle non négative (NMF)

- Analyse sémantique latente (LSA)

- Analyse sémantique latente probabiliste (pLSA)

Allocation latente de Dirichlet (LDA)

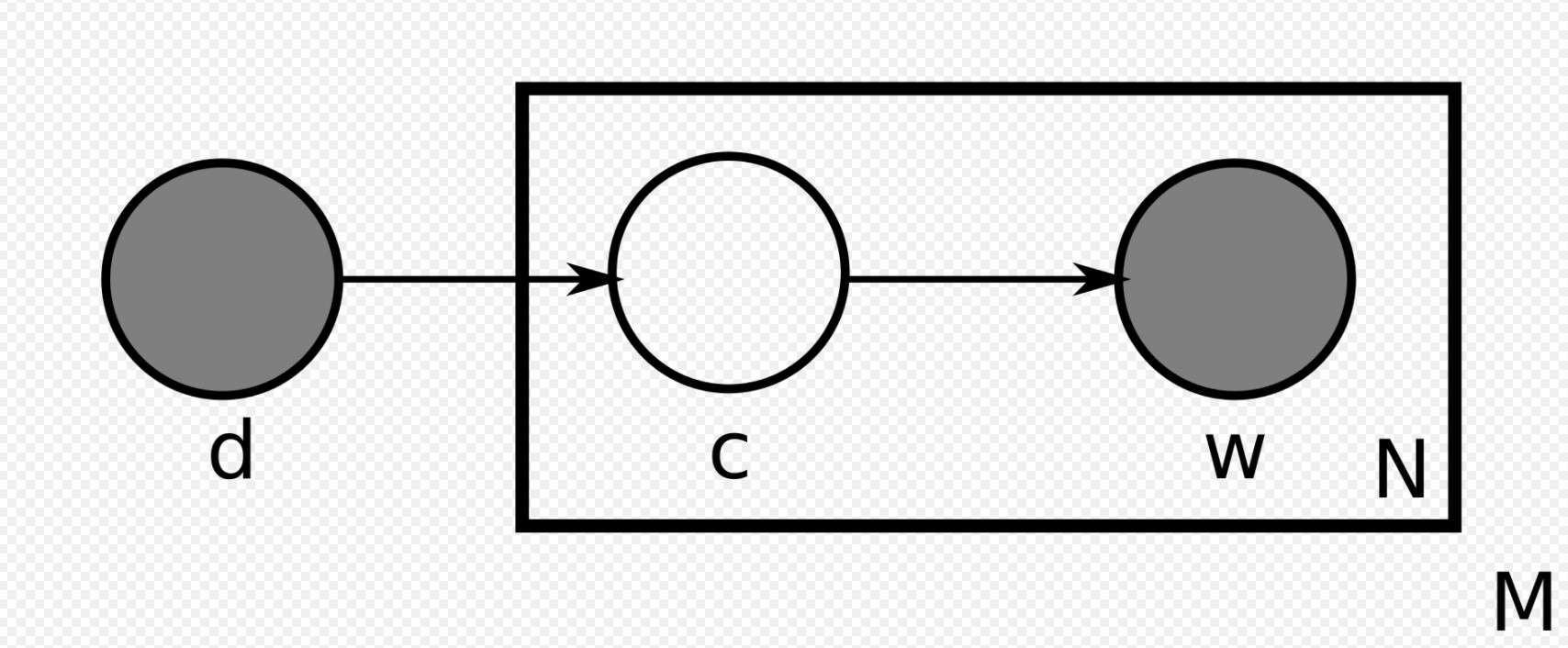

Pour détecter les relations entre plusieurs textes dans un corpus, le concept statistique et graphique d'Allocation Dirichlet Latente est utilisé.

En utilisant l'approche VEM (Variational Exception Maximization), l'estimation de probabilité la plus élevée à partir du corpus complet de texte est obtenue.

Traditionnellement, les premiers mots d'un sac de mots sont choisis.

Cependant, la phrase n'a absolument aucun sens.

Selon cette technique, chaque texte sera représenté par une distribution probabiliste de sujets, et chaque thème par une distribution probabiliste de mots.

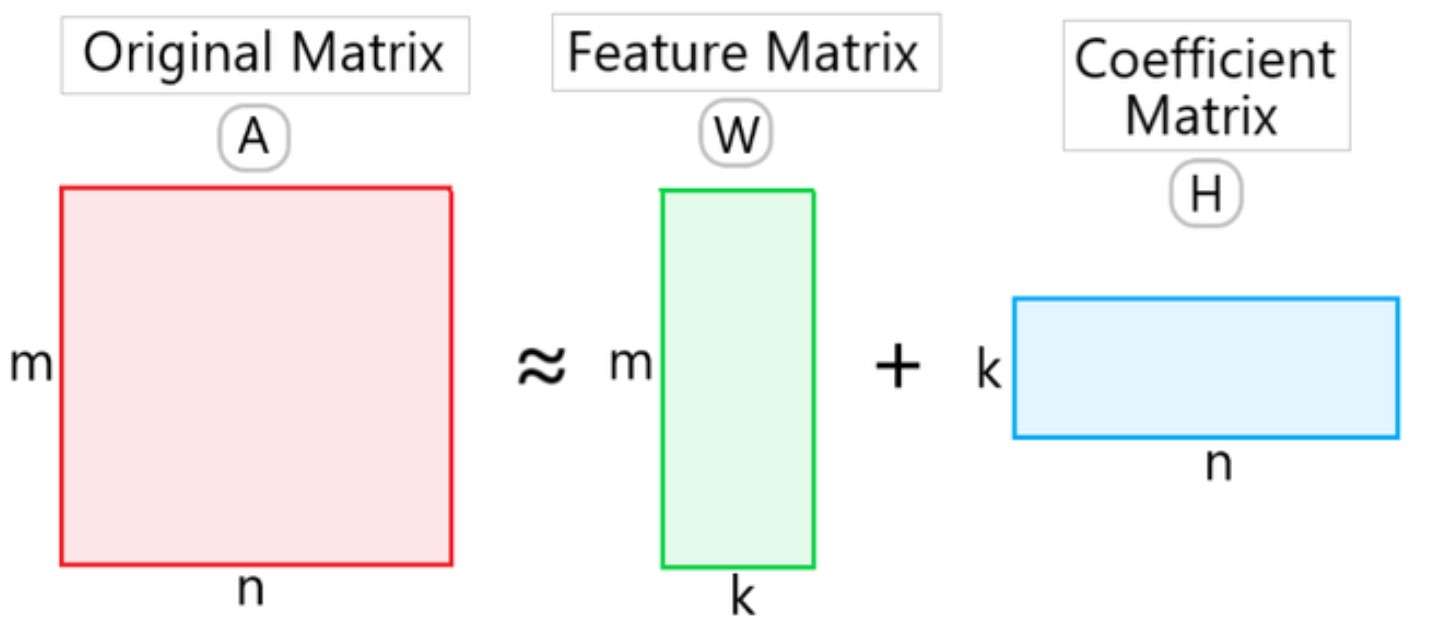

Factorisation matricielle non négative (NMF)

Matrice avec des valeurs non négatives La factorisation est une approche d'extraction de caractéristiques de pointe.

Lorsqu'il existe de nombreuses qualités et que les attributs sont vagues ou peu prévisibles, la NMF est bénéfique. NMF peut générer des modèles, des sujets ou des thèmes significatifs en combinant des caractéristiques.

NMF génère chaque entité comme une combinaison linéaire de l'ensemble d'attributs d'origine.

Chaque entité contient un ensemble de coefficients qui représentent l'importance de chaque attribut sur l'entité. Chaque attribut numérique et chaque valeur de chaque attribut de catégorie a son propre coefficient.

Tous les coefficients sont positifs.

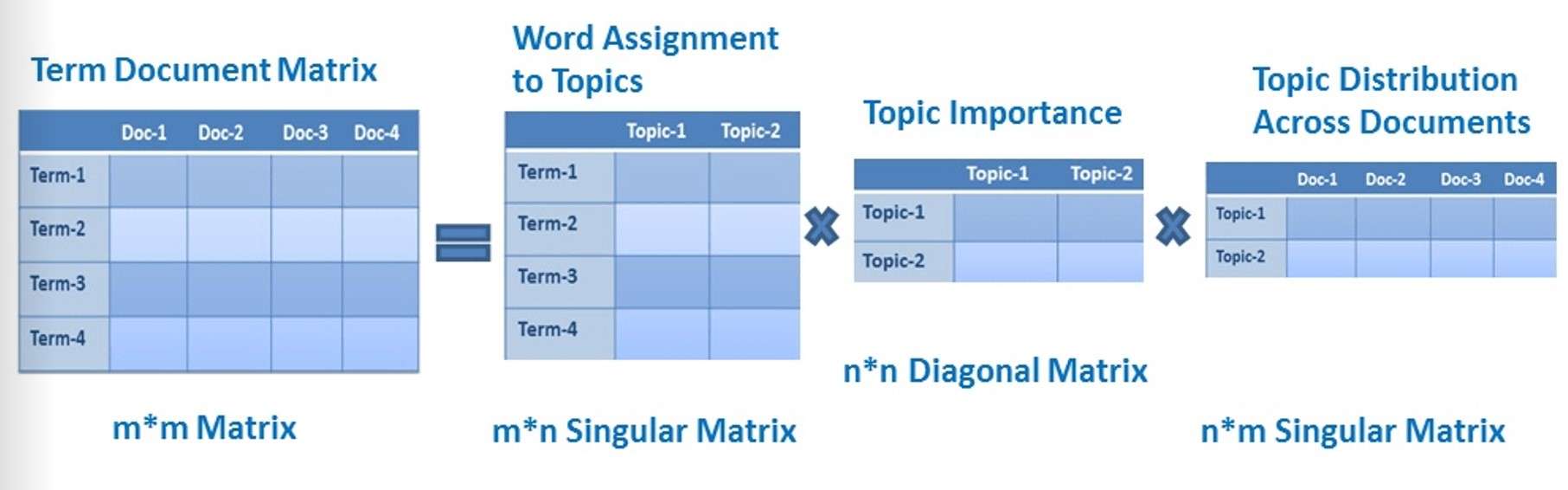

Analyse sémantique latente

Une autre méthode d'apprentissage non supervisé utilisée pour extraire des associations entre des mots dans un ensemble de documents est l'analyse sémantique latente.

Cela nous aide à choisir les bons documents. Sa fonction principale est de réduire la dimensionnalité de l'énorme corpus de données textuelles.

Ces données inutiles servent de bruit de fond pour acquérir les informations nécessaires à partir des données.

Analyse sémantique latente probabiliste (pLSA)

L'analyse sémantique latente probabiliste (PLSA), parfois appelée indexation sémantique latente probabiliste (PLSI, notamment dans les cercles de recherche d'informations), est une approche statistique d'analyse des données bimodales et de cooccurrence.

En fait, à l'instar de l'analyse sémantique latente, à partir de laquelle PLSA a émergé, une représentation à faible dimension des variables observées peut être dérivée en termes de leur affinité avec des variables cachées particulières.

Travaux pratiques avec la modélisation de sujet en Python

Maintenant, je vais vous guider à travers une mission de modélisation de sujet avec Python langage de programmation en utilisant un exemple concret.

Je modéliserai des articles de recherche. L'ensemble de données que j'utiliserai ici provient de kaggle.com. Vous pouvez facilement obtenir tous les fichiers que j'utilise dans ce travail à partir de ce page.

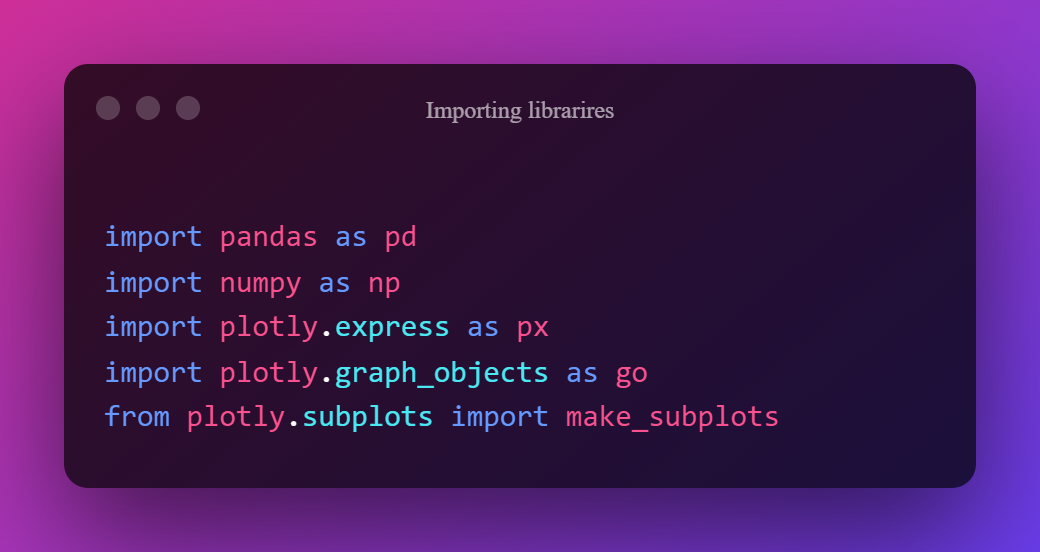

Commençons par Topic Modeling à l'aide de Python en important toutes les bibliothèques essentielles :

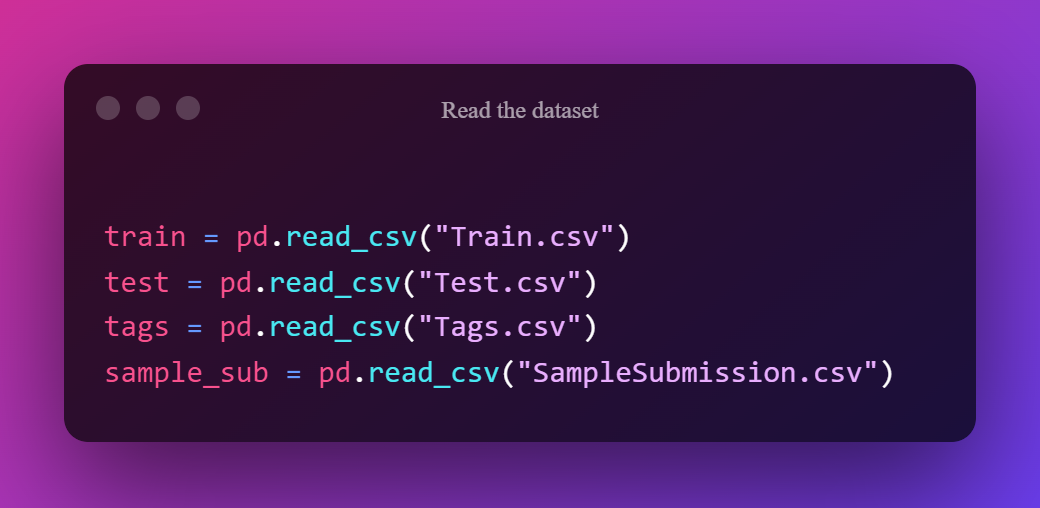

L'étape suivante consiste à lire tous les ensembles de données que je vais utiliser dans cette tâche :

L'analyse exploratoire des données

EDA (Exploratory Data Analysis) est une méthode statistique qui utilise des éléments visuels. Il utilise des résumés statistiques et des représentations graphiques pour découvrir des tendances, des modèles et des hypothèses de test.

Je ferai une analyse exploratoire des données avant de commencer la modélisation des sujets pour voir s'il existe des modèles ou des relations dans les données :

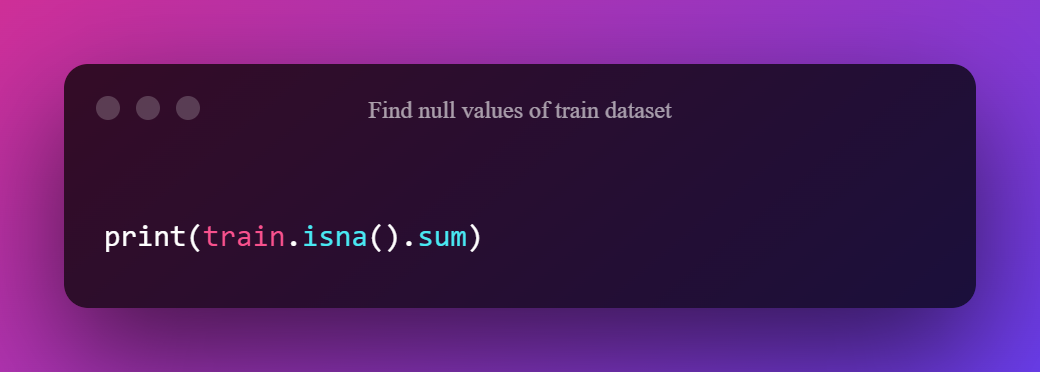

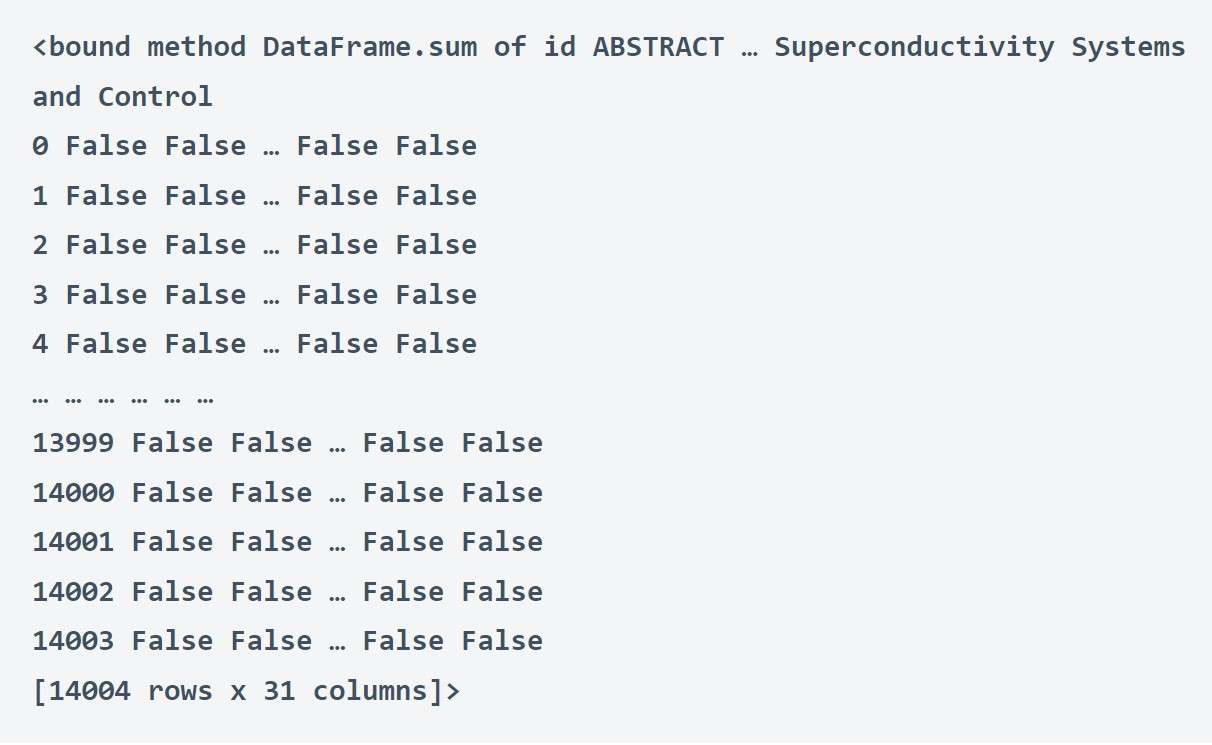

Nous allons maintenant trouver les valeurs nulles du jeu de données de test :

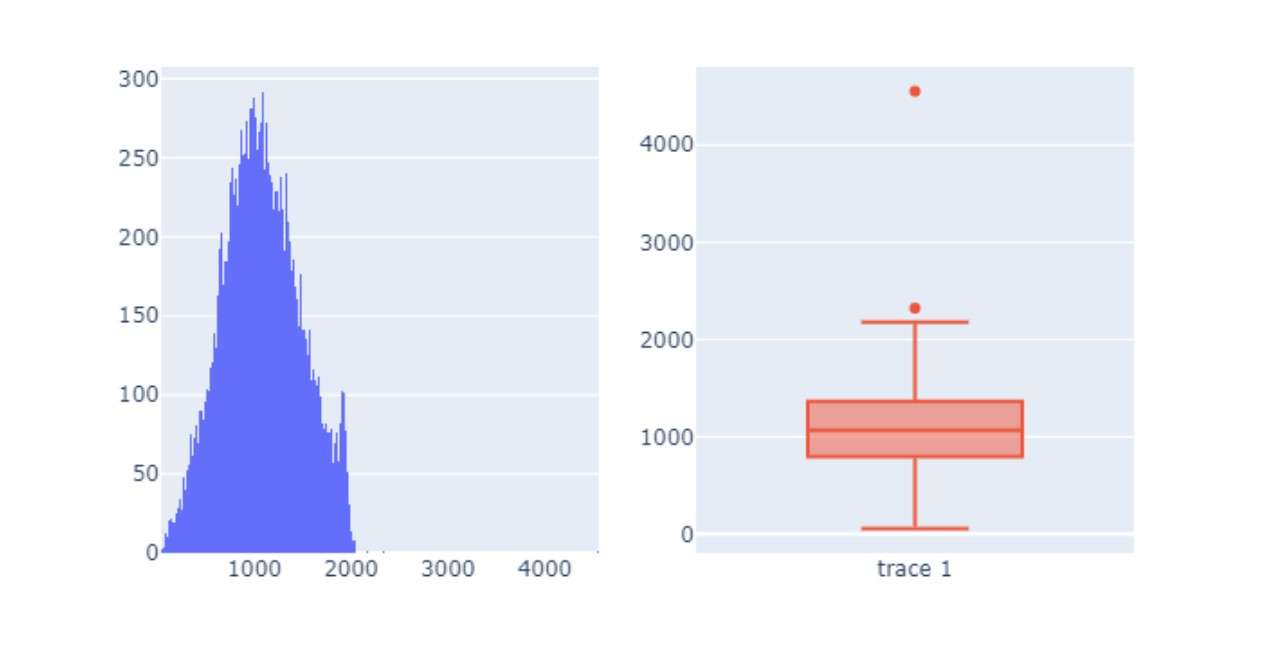

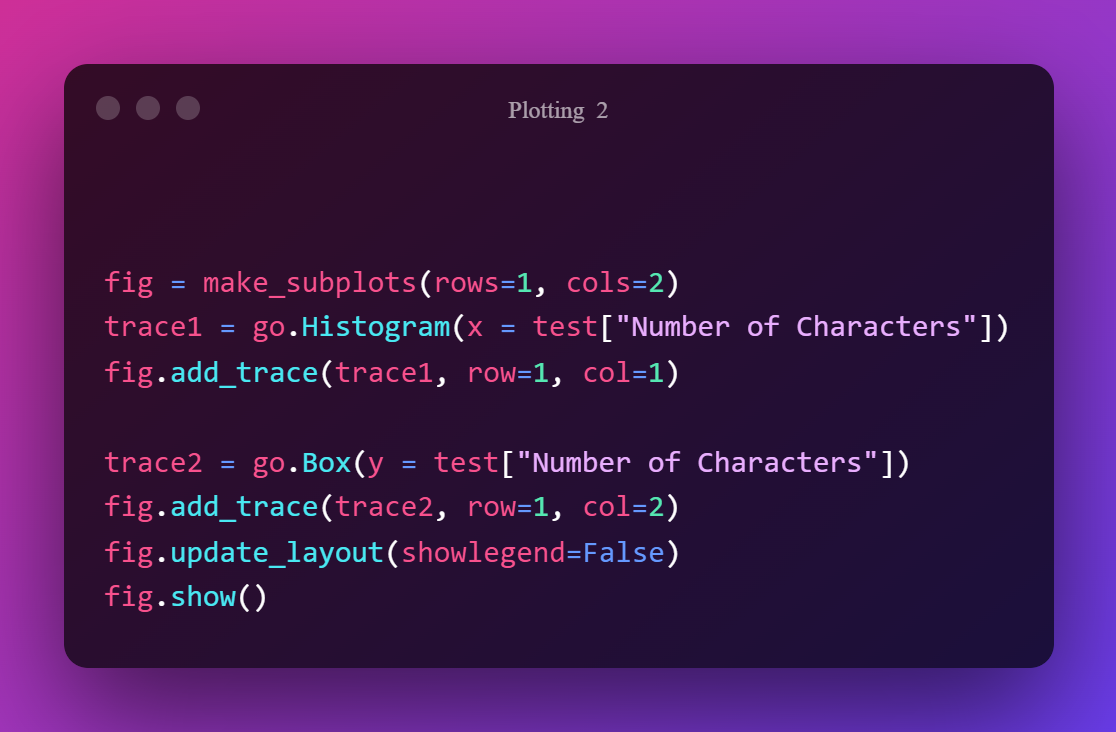

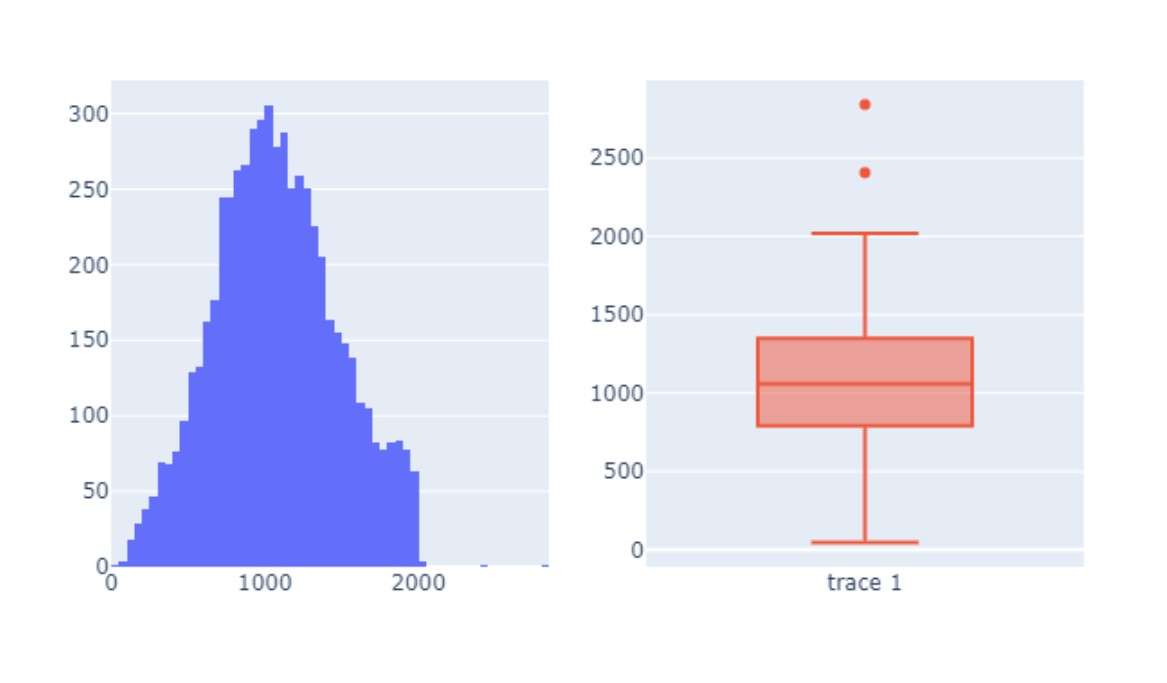

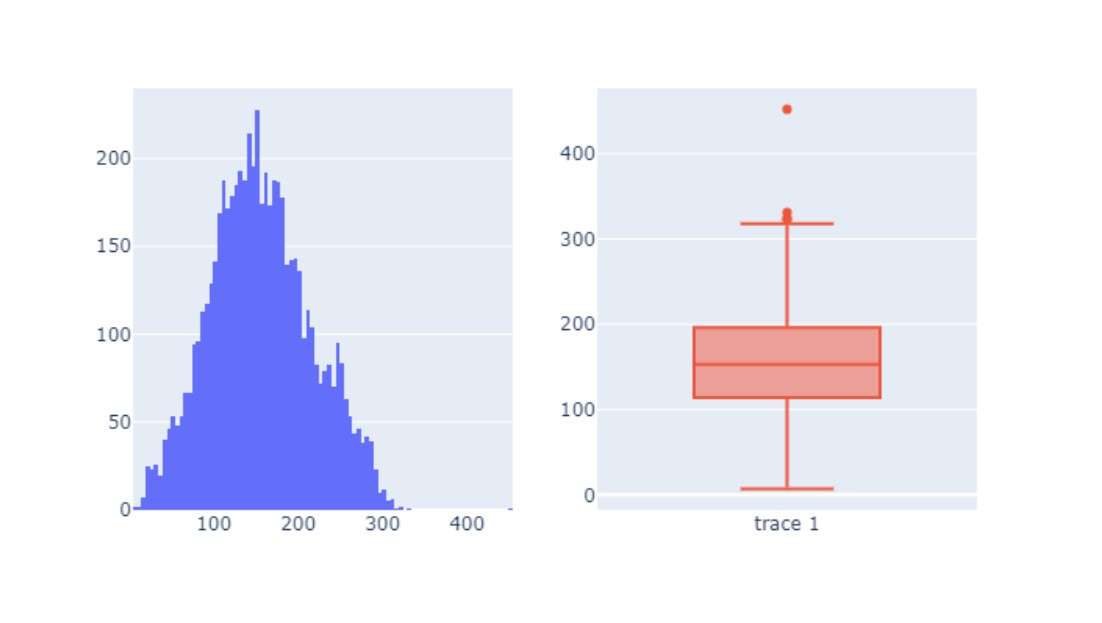

Maintenant, je vais tracer un histogramme et une boîte à moustaches pour vérifier la relation entre les variables.

Le nombre de personnages dans l'ensemble Abstracts of the Train varie considérablement.

Dans le train, nous avons un minimum de 54 et un maximum de 4551 caractères. 1065 est le nombre moyen de caractères.

L'ensemble de test semble être plus intéressant que l'ensemble d'apprentissage puisque l'ensemble de test a 46 caractères tandis que l'ensemble d'apprentissage en a 2841.

En conséquence, l'ensemble de test avait une médiane de 1058 caractères, ce qui est similaire à l'ensemble d'apprentissage.

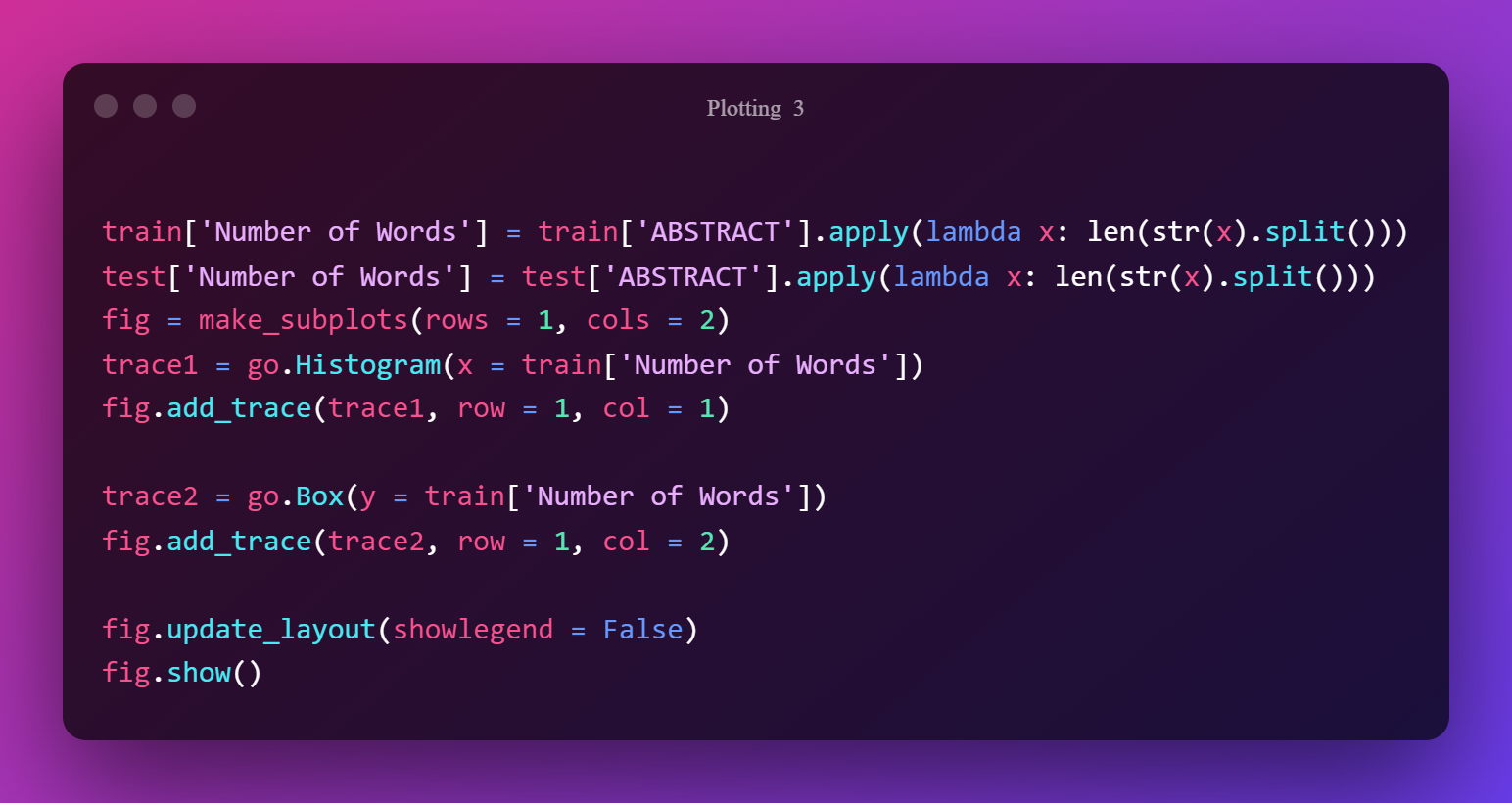

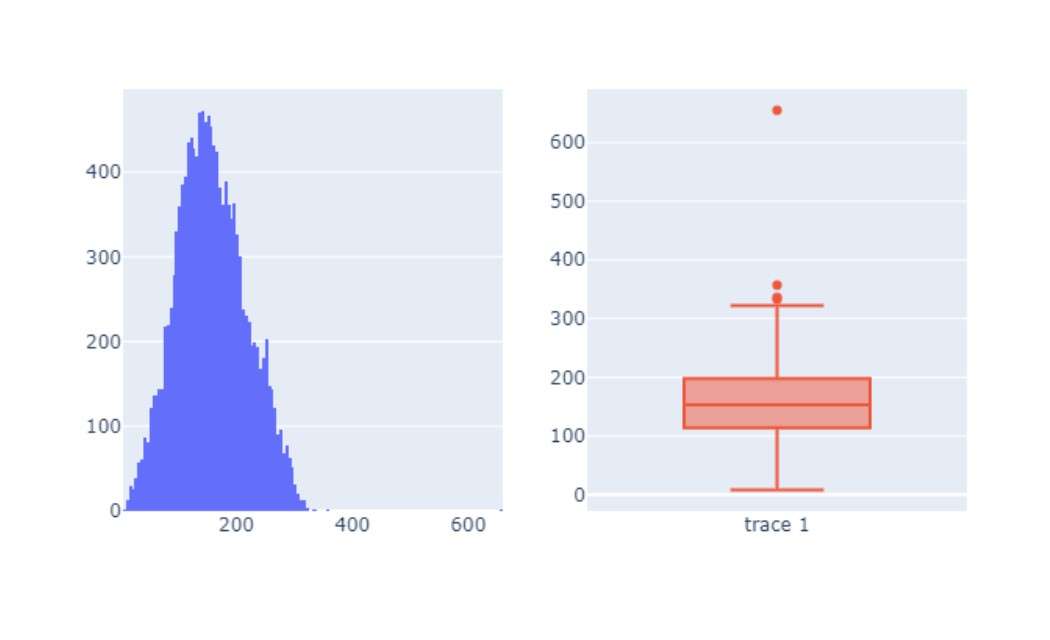

Le nombre de mots dans l'ensemble d'apprentissage suit un schéma similaire au nombre de lettres.

Un minimum de 8 mots et un maximum de 665 mots sont autorisés. En conséquence, le nombre médian de mots est de 153.

Un minimum de sept mots dans un résumé et un maximum de 452 mots dans l'ensemble de test sont requis.

La médiane, dans ce cas, est de 153, ce qui est identique à la médiane de l'ensemble d'apprentissage.

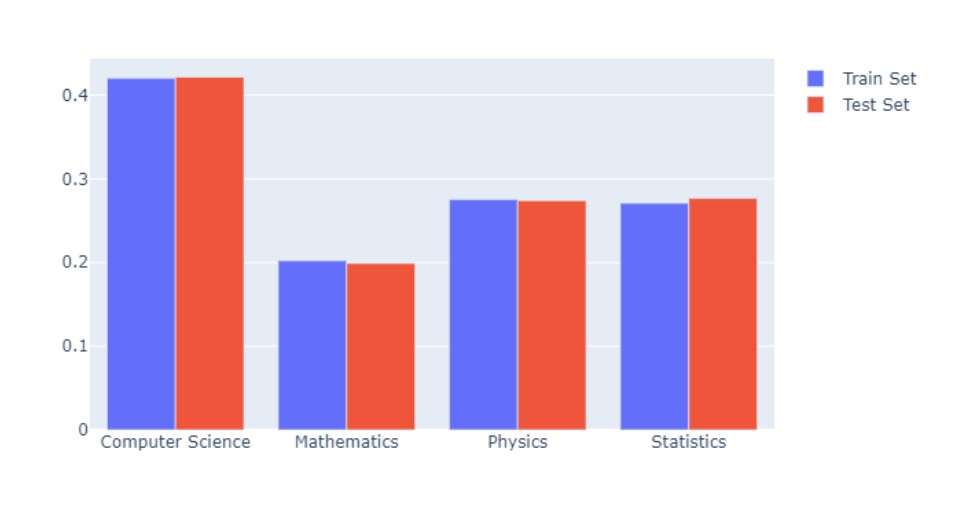

Utilisation de balises pour la modélisation de sujet

Il existe plusieurs stratégies de modélisation thématique. J'utiliserai des balises dans cet exercice ; Voyons comment procéder en examinant les balises :

Applications de la modélisation thématique

- Un résumé de texte peut être utilisé pour discerner le sujet d'un document ou d'un livre.

- Il peut être utilisé pour éliminer les préjugés des candidats dans la notation des examens.

- La modélisation thématique peut être utilisée pour établir des relations sémantiques entre les mots dans des modèles basés sur des graphes.

- Il peut améliorer le service client en détectant et en répondant aux mots-clés dans la demande du client. Les clients vous feront davantage confiance puisque vous leur avez fourni l'assistance dont ils ont besoin au moment opportun et sans leur causer de tracas. En conséquence, la fidélité des clients augmente considérablement et la valeur de l'entreprise augmente.

Conclusion

La modélisation thématique est une sorte de modélisation statistique utilisée pour découvrir des « sujets » abstraits qui existent dans une collection de textes.

C'est une forme du modèle statistique utilisé dans machine learning et le traitement du langage naturel pour découvrir des concepts abstraits qui existent dans un ensemble de textes.

Il s'agit d'une méthode d'exploration de texte largement utilisée pour trouver des modèles sémantiques latents dans le corps du texte.

Soyez sympa! Laissez un commentaire