Table des matières[Cacher][Montrer]

Des capteurs et des logiciels sont combinés dans des véhicules autonomes pour naviguer, diriger et faire fonctionner une variété de véhicules, y compris des motos, des automobiles, des camions et des drones.

Selon la façon dont ils ont été développés ou conçus, ils peuvent nécessiter ou non l'assistance du conducteur.

Les voitures entièrement autonomes peuvent fonctionner en toute sécurité sans conducteur humain. Certains, comme Waymo de Google automobile, ne pouvait même pas avoir de volant.

Un véhicule partiellement autonome, tel qu'un Tesla, peut assumer le contrôle complet du véhicule mais peut avoir besoin d'un conducteur humain pour l'aider en cas de doute sur le système.

Différents degrés d'auto-automatisation sont inclus dans ces voitures, du guidage de voie et de l'aide au freinage aux prototypes entièrement indépendants et autonomes.

L'objectif des automobiles sans conducteur est de réduire le trafic, les émissions et les taux d'accidents.

Cela est possible car les véhicules autonomes sont plus aptes à respecter les règles de circulation que les personnes.

Pour une conduite fluide, certaines informations sont nécessaires, telles que l'emplacement de la voiture ou de tout objet à proximité, le chemin le plus court et le plus sûr vers la destination et la capacité à faire fonctionner le système de conduite.

Il est crucial de comprendre quand et comment effectuer les tâches nécessaires.

Cet article couvrira beaucoup de terrain, y compris le Architecture du système pour les voitures autonomes, les composants requis et les réseaux véhiculaires ad hoc (VANET).

Composants nécessaires requis pour le véhicule autonome

Les véhicules autonomes d'aujourd'hui utilisent une variété de capteurs, y compris des caméras, des GPS, des unités de mesure inertielle (IMU), un sonar, la détection et la portée de l'éclairage laser (lidar), la détection et la télémétrie radio (radar), la navigation et la télémétrie sonores (sonar), et Cartes 3D.

Ensemble, ces capteurs et technologies analysent les données en temps réel pour contrôler la direction, l'accélération et le freinage.

Les capteurs radar aident à suivre les allées et venues des voitures environnantes. Les véhicules sont aidés par des capteurs à ultrasons lors du stationnement.

Une technologie connue sous le nom de lidar a été créée en utilisant les deux types de capteurs. En réfléchissant les impulsions lumineuses de l'environnement autour de l'automobile, les capteurs lidar peuvent détecter les marges des chaussées et identifier les marqueurs de voie.

Ceux-ci avertissent également les conducteurs des obstacles adjacents, tels que les autres véhicules, les piétons et les vélos.

La taille et la distance de tout ce qui se trouve autour de la voiture sont mesurées à l'aide de la technologie lidar, qui crée également une carte 3D qui permet au véhicule de visualiser son environnement et d'identifier les risques.

Quelle que soit l'heure de la journée, qu'elle soit claire ou sombre, il fait un excellent travail d'enregistrement des informations dans différents types de lumière ambiante.

L'automobile utilise des caméras, des radars et des antennes GPS, ainsi que des lidars et des caméras, pour détecter son environnement et identifier son emplacement.

Les caméras vérifient la présence de piétons, de cyclistes, d'automobiles et d'autres obstacles tout en détectant les feux de circulation, en lisant les panneaux de signalisation et les marquages et en surveillant les autres véhicules.

Cependant, ils pourraient avoir du mal dans les zones sombres ou ombragées. Un véhicule autonome peut voir où il va en utilisant un mélange de lidar, de radar, de caméras, d'antennes GPS et de capteurs à ultrasons pour cartographier numériquement la route devant lui.

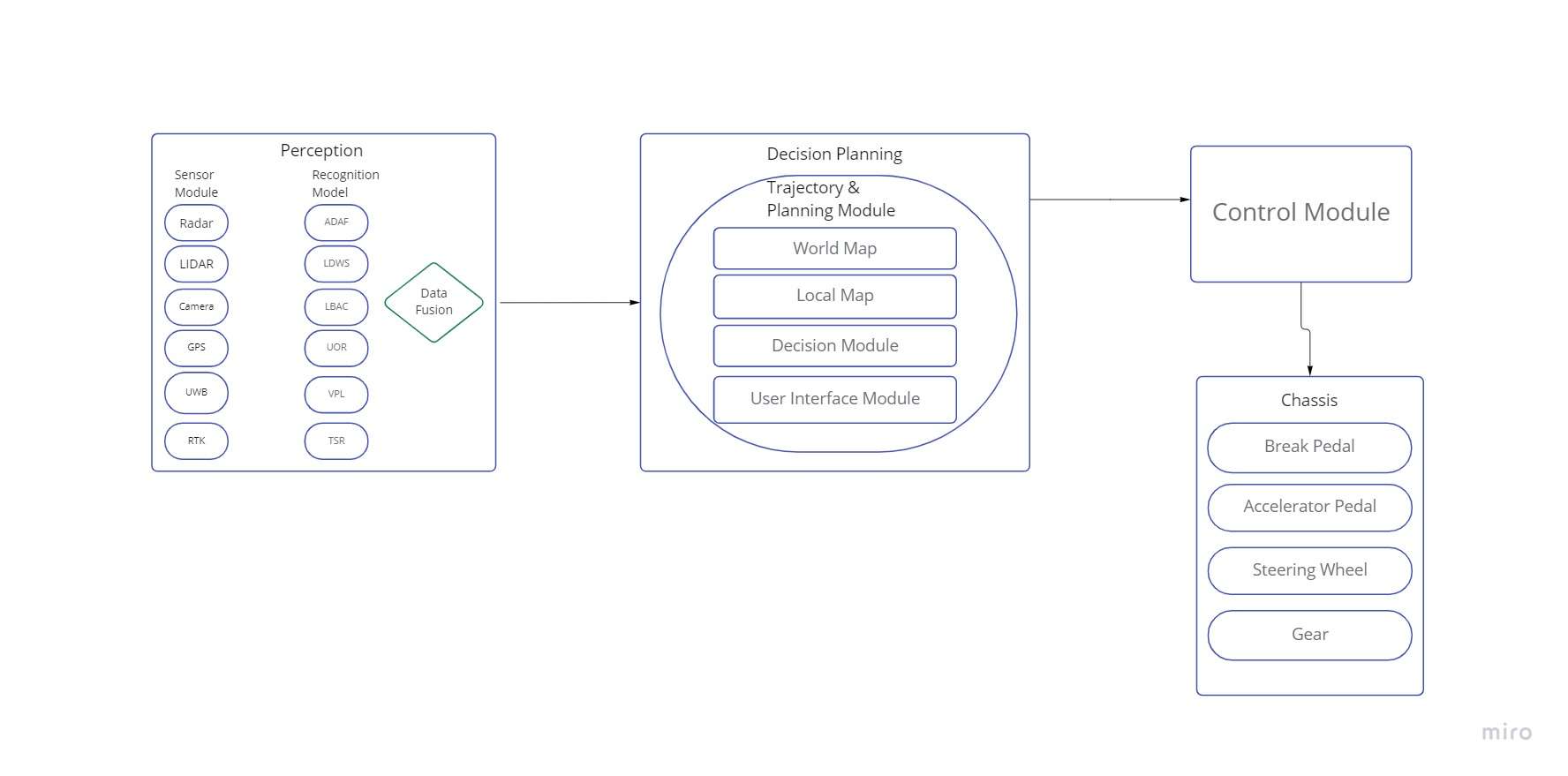

Architecture système de haut niveau

Les capteurs, actionneurs, matériels et logiciels essentiels sont répertoriés dans l'architecture, qui illustre également l'ensemble du mécanisme ou du protocole de communication dans les AV.

Perception

Cette étape comprend l'identification de l'emplacement de l'AV par rapport à l'environnement et la détection de l'environnement autour de l'AV à l'aide d'une variété de capteurs.

L'AV utilise le RADAR, le LIDAR, la caméra, la cinétique en temps réel (RTK) et d'autres capteurs à cette étape. Les modules de reconnaissance reçoivent les données de ces capteurs et les traitent après les avoir transmises.

En général, l'AV se compose d'un système de contrôle, LDWS, TSR, reconnaissance d'obstacles inconnus (UOR), un module de positionnement et de localisation du véhicule (VPL), etc.

Les informations combinées sont transmises au stade de la prise de décision et de la planification après avoir été traitées.

Décision et planification

Les mouvements et le comportement du VA sont décidés, planifiés et contrôlés à cette étape en utilisant les informations reçues pendant le processus de perception.

Cette étape, que le cerveau représenterait, est celle où des choix sont faits sur des choses comme la planification de trajectoire, la prédiction d'action, l'évitement d'obstacles, etc.

Le choix est basé sur les informations qui sont actuellement et historiquement accessibles, y compris les données cartographiques en temps réel, les spécificités du trafic, les tendances, les informations sur les utilisateurs, etc.

Il pourrait y avoir un module de journal de données qui garde une trace des erreurs et des données pour une utilisation ultérieure.

Control

Le module de contrôle exécute des opérations/actions relatives au contrôle physique de l'AV, telles que la direction, le freinage, l'accélération, etc. après avoir reçu des informations du module de décision et de planification.

Châssis

La dernière étape consiste à interagir avec les pièces mécaniques fixées au châssis, telles que le motoréducteur, le moteur du volant, le moteur de la pédale de frein et les moteurs de la pédale d'accélérateur et de frein.

Le module de contrôle signale et gère tous ces composants.

Nous allons maintenant parler de la communication générale d'un AV avant de parler de la conception, du fonctionnement et de l'utilisation des différents capteurs clés.

RADAR

Dans les véhicules audiovisuels, les radars sont utilisés pour balayer l'environnement afin de trouver et de localiser des automobiles et d'autres objets.

Les RADAR sont souvent utilisés à des fins militaires et civiles, telles que les aéroports ou les systèmes météorologiques, et ils fonctionnent dans le spectre des ondes millimétriques (ondes millimétriques).

Différentes bandes de fréquences, dont 24, 60, 77 et 79 GHz, sont utilisées dans les automobiles contemporaines et ont une plage de mesure de 5 à 200 m [10].

En calculant le ToF entre le signal transmis et l'écho renvoyé, la distance entre l'AV et l'objet est déterminée.

Dans les VA, les RADAR utilisent un réseau de micro-antennes qui créent une collection de lobes pour améliorer la résolution de distance et l'identification de cibles multiples. Le RADAR à ondes millimétriques peut évaluer avec précision des objets proches dans n'importe quelle direction en utilisant la variance du décalage Doppler en raison de sa pénétrabilité accrue et de sa bande passante plus large.

Étant donné que les radars à ondes millimétriques ont une longueur d'onde plus longue, ils disposent de capacités anti-blocage et anti-pollution qui leur permettent de fonctionner sous la pluie, la neige, le brouillard et la faible luminosité.

De plus, le décalage Doppler peut être utilisé pour calculer la vitesse relative via des radars à ondes millimétriques. En raison de leurs capacités, les radars à ondes millimétriques sont bien adaptés à une large gamme d'applications audiovisuelles, y compris la détection d'obstacles et la reconnaissance des piétons et des véhicules.

Détecteur à ultrasons

Ces capteurs fonctionnent dans la gamme 20–40 kHz et utilisent des ondes ultrasonores. Une membrane magnéto-résistive utilisée pour mesurer la distance de l'objet produit ces ondes.

En calculant le temps de vol (ToF) de l'onde émise par rapport au signal en écho, la distance est déterminée. La portée typique des capteurs à ultrasons est inférieure à 3 mètres.

La sortie du capteur est actualisée toutes les 20 ms, ce qui l'empêche de se conformer aux exigences rigoureuses de qualité de service de l'ITS. Ces capteurs ont une portée de détection de faisceau relativement petite et sont dirigés.

Ainsi, pour obtenir une vision plein champ, de nombreux capteurs sont nécessaires. Cependant, de nombreux capteurs interagissent et peuvent entraîner des imprécisions de portée importantes.

LiDAR

Les spectres de 905 et 1550 nm sont utilisés en LiDAR. Étant donné que l'œil humain est sensible aux lésions rétiniennes dans la gamme des 905 nm, le LiDAR actuel fonctionne dans la bande des 1550 XNUMX nm pour réduire les lésions rétiniennes.

Jusqu'à 200 mètres est la plage de travail maximale du LiDAR. Les LiDAR à semi-conducteurs, 2D et 3D sont les différentes sous-catégories de LiDAR.

Un seul faisceau laser est dispersé sur un miroir qui tourne rapidement dans un LiDAR 2D. En plaçant plusieurs lasers sur le pod, un LiDAR 3D peut acquérir une image 3D de l'environnement.

Il a été démontré qu'un système LiDAR en bordure de route réduit le nombre de collisions véhicule-piéton (V2P) dans les zones intersectionnelles et non intersectionnelles.

Il utilise un système LiDAR à 16 lignes, en temps réel et efficace sur le plan informatique.

Il est suggéré d'utiliser un auto-encodeur artificiel profond Réseau neuronal (DA-ANN), qui atteint une précision de 95 % sur une portée de 30 m.

Dans, il est démontré comment un algorithme basé sur une machine à vecteurs de support (SVM) combiné à un LiDAR 64D à 3 lignes peut améliorer la reconnaissance des piétons.

Malgré une meilleure précision de mesure et une meilleure vision 3D qu'un radar à ondes millimétriques, le LiDAR fonctionne moins bien par mauvais temps, notamment le brouillard, la neige et la pluie.

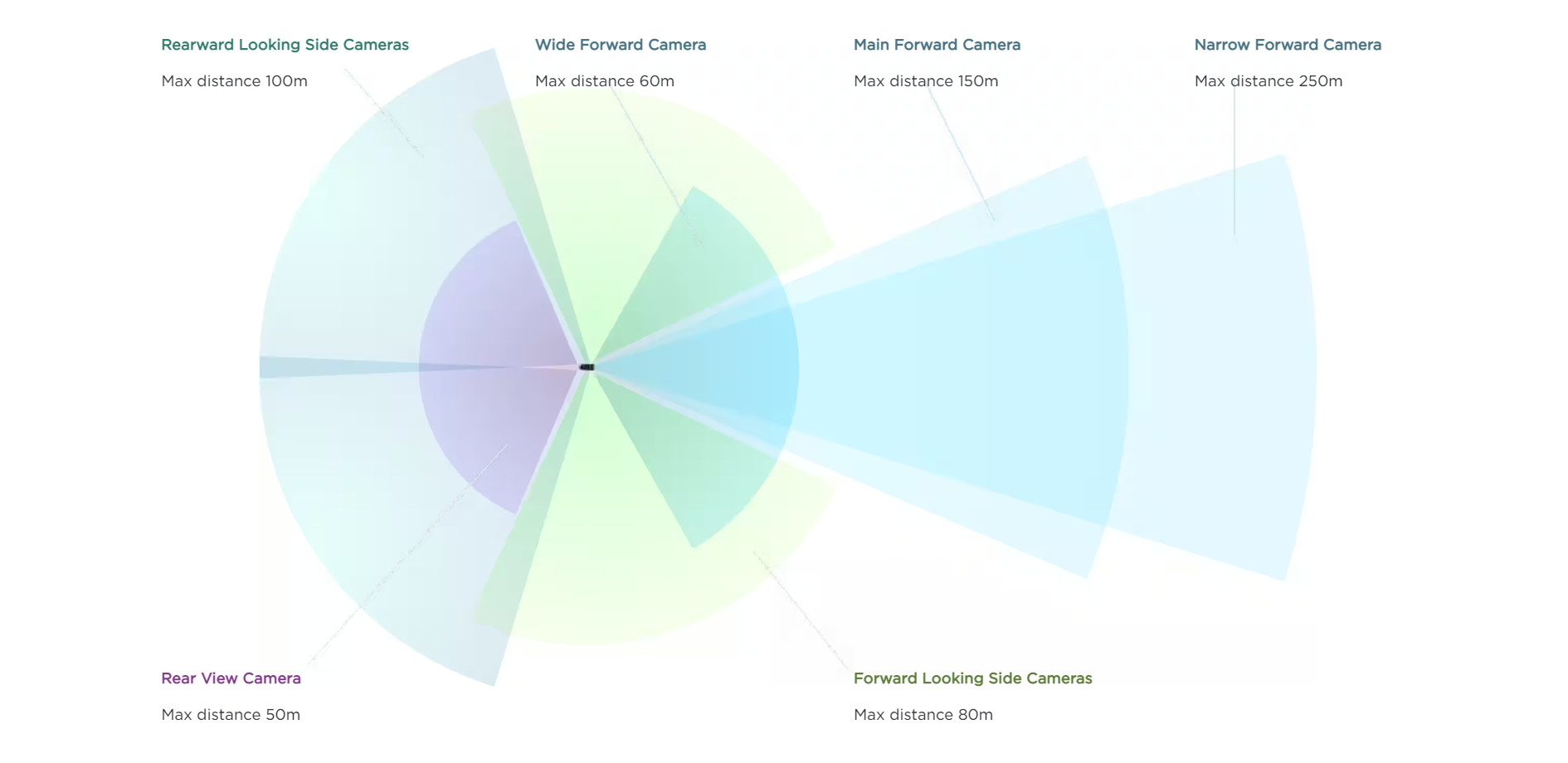

Appareils photos

Selon la longueur d'onde de l'appareil, la caméra des AV peut être basée sur la lumière infrarouge ou visible.

Un dispositif à couplage de charge (CCD) et des capteurs d'image complémentaires métal-oxyde-semi-conducteur (CMOS) sont utilisés dans la caméra (CMOS).

Selon la qualité de l'objectif, la portée maximale de la caméra est d'environ 250 m. Les trois bandes utilisées par les caméras visibles - Rouge, Vert et Bleu - sont séparées par la même longueur d'onde que l'œil humain, soit 400–780 nm (RVB).

Deux caméras VIS sont couplées avec des longueurs focales établies pour créer un nouveau canal qui contient des informations de profondeur (D), permettant la création d'une vision stéréoscopique.

Une vue 3D de la zone entourant le véhicule peut être obtenue grâce à cette capacité via la caméra (RGB-D).

Des capteurs passifs ayant une longueur d'onde comprise entre 780 nm et 1 mm sont utilisés par la caméra infrarouge (IR). Dans les pics d'éclairage, les capteurs infrarouges des AV offrent un contrôle visuel.

Cette caméra aide les AV avec la reconnaissance d'objets, le contrôle de la vue latérale, l'enregistrement des accidents et le BSD. Cependant, par mauvais temps, comme la neige, le brouillard et les conditions d'éclairage changeantes, les performances de la caméra sont altérées.

Les principaux avantages d'une caméra sont sa capacité à recueillir et à enregistrer avec précision la texture, la distribution des couleurs et la forme de l'environnement.

Système mondial de navigation par satellite et système de positionnement global, unité de mesure inertielle

Cette technologie aide l'AV à naviguer en localisant son emplacement précis. Un groupe de satellites en orbite autour de la surface de la planète sont utilisés par le GNSS pour se localiser.

Le système stocke des données sur l'emplacement, la vitesse et l'heure précise de l'AV.

Il fonctionne en déterminant le ToF entre le signal reçu et l'émission du satellite. Les coordonnées du système de positionnement global (GPS) sont souvent utilisées pour obtenir l'emplacement AV.

Les coordonnées extraites par GPS ne sont pas toujours précises et elles ajoutent généralement une erreur de position avec une valeur moyenne de 3 m et une variation standard de 1 m.

Dans les situations métropolitaines, les performances sont encore plus dégradées, avec une erreur de localisation pouvant atteindre 20 m, et dans certaines circonstances sévères, l'erreur de position GPS est d'environ 100 m.

De plus, les véhicules audiovisuels peuvent utiliser le système RTK pour déterminer avec précision la position du véhicule.

Dans les VA, la position et la direction du véhicule peuvent également être déterminées à l'aide de l'estime (DR) et de la position inertielle.

Fusion de capteurs

Pour une gestion et une sécurité adéquates du véhicule, les véhicules audiovisuels doivent obtenir une connaissance précise et en temps réel de l'emplacement, de l'état et d'autres facteurs du véhicule tels que le poids, la stabilité, la vitesse, etc.

Ces informations doivent être recueillies par les VA à l'aide de divers capteurs.

En fusionnant les données acquises à partir de plusieurs capteurs, la technique de fusion de capteurs est utilisée pour produire des informations cohérentes.

La méthode permet la synthèse de données brutes acquises à partir de sources complémentaires.

En conséquence, la fusion de capteurs permet à l'AV de comprendre avec précision son environnement en fusionnant toutes les données utiles recueillies à partir de divers capteurs.

Différents types d'algorithmes, y compris des filtres de Kalman et des filtres bayésiens, sont utilisés pour effectuer le processus de fusion dans les AV.

Parce qu'il est utilisé dans plusieurs applications, y compris le suivi RADAR, les systèmes de navigation par satellite et l'odométrie optique, le filtre de Kalman est considéré comme crucial pour qu'un véhicule fonctionne de manière autonome.

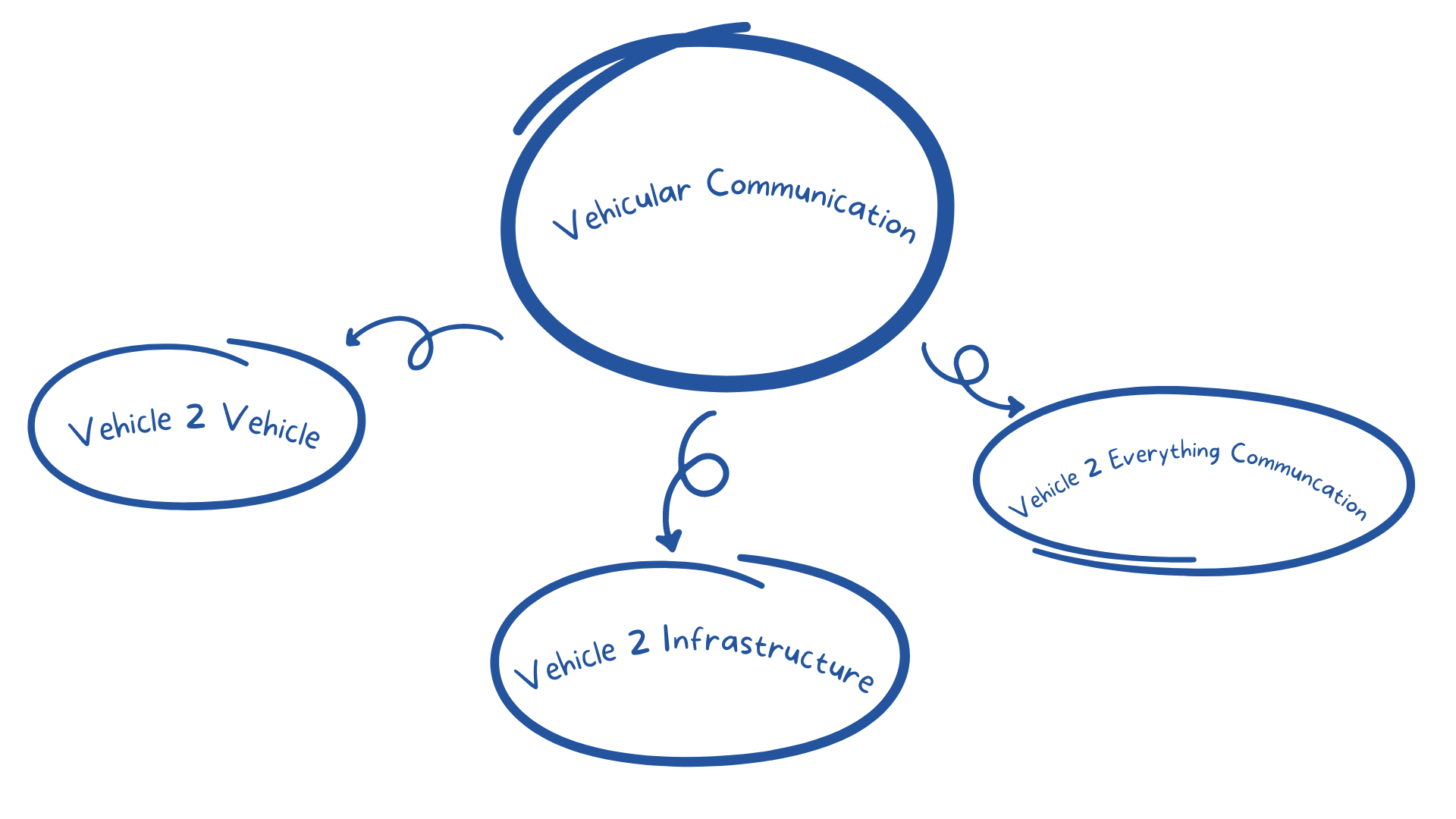

Réseaux ad hoc véhiculaires (VANET)

Les VANET sont une nouvelle sous-classe de réseaux mobiles ad hoc qui peuvent créer spontanément un réseau d'appareils/véhicules mobiles. La communication de véhicule à véhicule (V2V) et de véhicule à infrastructure (V2I) est possible avec les VANET.

L'objectif principal d'une telle technologie est d'augmenter la sécurité routière; par exemple, dans des situations dangereuses telles que des accidents et des embouteillages, les voitures peuvent interagir entre elles et avec le réseau pour relayer des informations cruciales.

Voici les principaux composants de la technologie VANET :

- OBU (unité embarquée) : Il s'agit d'un système de suivi basé sur GPS placé dans chaque véhicule qui leur permet d'interagir entre eux et avec les unités routières (RSU). L'OBU est équipé de plusieurs composants électroniques, y compris un processeur de commande de ressources (RCP), des dispositifs de détection et interfaces utilisateur, pour obtenir des informations essentielles. Son objectif principal est d'utiliser un réseau sans fil pour communiquer entre plusieurs RSU et OBU.

- Unité routière (RSU) : les RSU sont des unités informatiques fixes qui sont positionnées à des points précis dans les rues, les parkings et les carrefours. Son objectif principal est de relier les véhicules autonomes à l'infrastructure, et il aide également à la localisation des véhicules. De plus, il peut être utilisé pour relier un véhicule à d'autres RSU en utilisant divers topologies de réseau. De plus, ils ont fonctionné sur des sources d'énergie ambiantes, y compris l'énergie solaire.

- Autorité de confiance (TA) : il s'agit d'un organisme qui contrôle chaque étape du processus VANET, garantissant que seuls les RSU et les OBU de véhicule légitimes peuvent s'enregistrer et interagir. En confirmant l'ID OBU et en authentifiant le véhicule, il offre une sécurité. De plus, il trouve des communications nuisibles et des comportements étranges.

Les VANET sont utilisés pour la communication véhiculaire, qui comprend la communication V2V, V2I et V2X.

Véhicule 2 Communication avec le véhicule

La capacité des automobiles à se parler et à échanger des informations cruciales concernant les embouteillages, les accidents et les limitations de vitesse est connue sous le nom de communication inter-véhicules (IVC).

La communication V2V peut créer le réseau en joignant différents nœuds (véhicules) à l'aide d'une topologie maillée, partielle ou complète.

Ils sont classés en tant que systèmes à saut unique (SIVC) ou multi-sauts (MIVC) en fonction du nombre de sauts utilisés pour la communication entre véhicules.

Alors que le MIVC peut être utilisé pour la communication à longue portée, comme la surveillance du trafic, le SIVC peut être utilisé pour des applications à courte portée comme la fusion de voies, l'ACC, etc.

De nombreux avantages, notamment BSD, FCWS, freinage d'urgence automatisé (AEB) et LDWS, sont offerts via la communication V2V.

Véhicule 2 Infrastructure Communication

Les automobiles peuvent communiquer avec les RSU par le biais d'un processus connu sous le nom de communication bord de route-véhicule (RVC). Il aide à la détection des parcomètres, des caméras, des marqueurs de voie et des feux de circulation.

Connexion ad hoc, sans fil et bidirectionnelle entre les voitures et l'infrastructure.

Pour l'administration et la supervision du trafic, les données de l'infrastructure sont utilisées. Ils sont utilisés pour ajuster divers paramètres de vitesse qui permettent aux voitures de maximiser l'économie de carburant et de gérer le flux de trafic.

Le système RVC peut être séparé en RVC clairsemé (SRVC) et en RVC ubiquitaire en fonction de l'infrastructure (URVC).

Le système SRVC n'offre des services de communication qu'aux points d'accès, par exemple pour localiser des places de stationnement ouvertes ou des stations-service, tandis que le système URVC offre une couverture tout au long de l'itinéraire, même à grande vitesse.

Afin de garantir la couverture du réseau, le système URVC nécessite un investissement important.

Véhicule 2 Tout Communication

La voiture peut se connecter à d'autres entités via V2X, y compris les piétons, les objets en bord de route, les appareils et le réseau (V2P, V2R et V2D) (V2G).

En utilisant ce type de communication, les conducteurs peuvent éviter de heurter des piétons, des cyclistes et des motocyclistes à risque.

Le système Pedestrian Collision Warning (PCW) peut avertir le conducteur d'un passager sur le bord de la route avant qu'une collision catastrophique ne se produise grâce à la communication V2X.

Afin d'envoyer des messages importants aux piétons, le PCW peut tirer parti du Bluetooth ou de la communication en champ proche (NFC) du smartphone.

Conclusion

Les nombreuses technologies utilisées pour construire des voitures autonomes peuvent avoir un impact important sur leur fonctionnement.

À la base, la voiture développe une carte de son environnement à l'aide d'un ensemble de capteurs qui fournissent des informations sur l'itinéraire qui l'entoure et sur les autres véhicules sur son chemin.

Ces données sont ensuite analysées par un système d'apprentissage automatique complexe, qui génère un ensemble d'actions à exécuter par la voiture. Ces comportements sont régulièrement modifiés et mis à jour au fur et à mesure que le système en apprend davantage sur l'environnement du véhicule.

Malgré tous mes efforts pour vous présenter un aperçu de l'architecture du système de véhicule autonome, il se passe beaucoup plus dans les coulisses.

J'espère sincèrement que vous trouverez ces connaissances précieuses et que vous les utiliserez.

Soyez sympa! Laissez un commentaire