Edukien aurkibidea[Ezkutatu][Erakutsi]

Ez da berria argazki eta bideo faltsuak izatea. Interneten erabilera hedatu zenetik, irudiak eta filmak egon direnetik engainatzeko edo dibertitzeko asmoz egindako faltsuketak sortzen ari dira gizabanakoak.

Hala ere, bada makinaz ekoitzitako faltsu mota berri bat, noizbait errealitatea eta fikzioa bereiztea zaila egingo zaiguna.

Faltsu hauek Photoshop bezalako edizio softwareak edo iraganeko trebetasunez manipulatutako filmetatik sortzen diren irudi manipulazio soiletatik desberdinak dira.

Deepfake-ak "euskarri sintetikoen" adibiderik ezagunena dira: irudiak, soinuak eta bideoak, dirudienez, metodo konbentzionalak erabiliz ekoiztu ziren baina benetan software sofistikatua erabiliz egin ziren.

Deepfake-ak denbora luzez egon dira, eta oraindik haien aplikaziorik ezagunena pertsonaia ospetsuen buruak film pornografikoetako aktoreen gorputzetan jartzea izan den arren, edonork edonon eta edonon egiten duen edonork egiten duen irudi sinesgarriak sortzeko gaitasuna dute.

Argitalpen honetan, Deepfakes, nola funtzionatzen duen, zure kabuz nola sor ditzakezun eta askoz gehiago aztertuko dugu.

Beraz, zer da DeepFake?

Deepfake bat —deep learning eta fake esaldien konbinazioa— zati bat da euskarri sintetikoak bertan, beste pertsona baten antzekotasuna lehendik dagoen argazki edo bideo batean pertsona batena ordezkatzeko erabiltzen da.

Deepfakes-ek ikaskuntza automatikoko eta adimen artifizialaren teknika sofistikatuak erabiltzen ditu engainurako potentzial handia duen ikusizko eta audio-informazioa aldatzeko eta sortzeko.

Deep learning metodoak, esaterako, autokodetzaileak eta sorkuntza-sareak dira deepfake ekoizpenerako (GAN) mekanismo nagusia.

Eredu hauek pertsona baten aurpegiko emozioak eta mugimenduak aztertzeko eta antzeko adierazpenak eta mugimenduak erakusten dituzten beste pertsona batzuen aurpegien irudiak sintetizatzeko erabiltzen dira.

Ospetsuen bideo pornografikoetan, albiste faltsuetan, iruzurrak eta iruzurre finantzarioetan deepfake-ak arreta handia erakarri du. Industriak eta gobernuak erantzun dute haiek aurkitu eta erabilera mugatu nahian.

Lehen Ordenako Mugimenduaren Eredua

Iraganean faltsu sakonak garatzen saiatzean, kontua zen ikuspegi horiek funtzionatzeko ezagutza gehigarriren bat behar dugula, edo aldez aurretikoa.

Ilustrazio gisa, aurpegiko markatzaileak beharrezkoak dira buruaren mugimendua trazatu nahi badugu. Pose estimazioa beharrezkoa zen gorputz osoaren mugimendua mapatu nahi bagenuen.

Hori aldatu zen iaz NeurIPS kongresuan, Torontoko Unibertsitateko ikerketa-taldeak bere lana aurkeztu zuenean, "Irudi-animaziorako lehen ordenako mugimendu eredua".

Ikuspegi honetarako ez da animazioaren ezagutza gehiago behar. Gainera, eredu hau trebatu ondoren, transferentzia ikaskuntzarako erabil daiteke eta kategoria bereko edozein elementuri aplikatu.

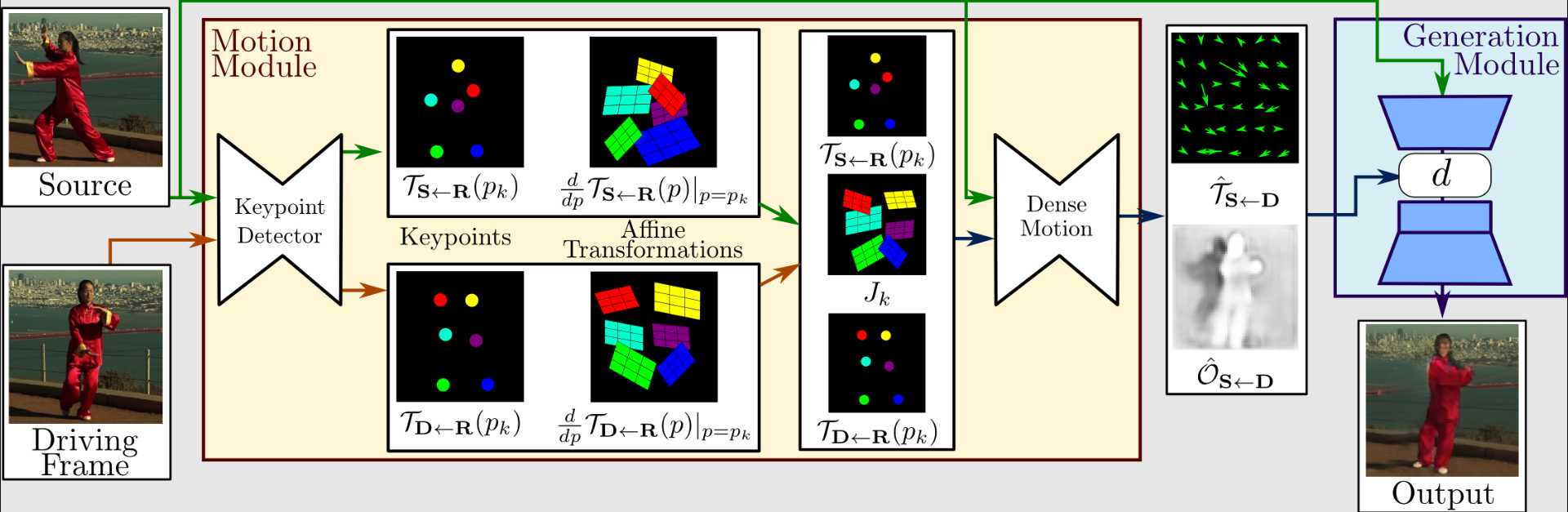

Ikus dezagun metodo honen funtzionamendua pixka bat gehiago. Mugimenduaren erauzketa eta sorkuntza prozesu osoaren lehen erdia osatzen dute. Gidatzeko bideoa eta iturriko irudiak sarrera gisa erabiltzen dira.

Lehen mailako mugimenduaren irudikapena ateratzeko, gako-puntu eskasez eta tokiko eraldaketa afinez osatuta dagoena, mugimendu-erauzgailu batek kodetzaile automatiko bat erabiltzen du puntu nagusiak identifikatzeko.

Mugimendu-sare trinkoarekin fluxu optiko trinkoa eta oklusio-mapa sortzeko, gidatzeko bideoarekin batera erabiltzen dira. Ondoren, sorgailuak xede-irudia errendatzen du mugimendu-sare trinkoaren irteerak eta iturburu-irudia erabiliz.

Oro har, lan honek artearen egoera baino hobeto funtzionatzen du. Beste modelo batzuek ez dituzten ezaugarriak ere baditu. Hainbat argazki motatan funtzionatzen du, beraz, aurpegiaren, gorputzaren, marrazki bizidunen eta abarren irudiei aplika diezaiekezu, eta hori oso bikaina da.

Horrek aukera berri asko sortzen ditu. Gure estrategiaren beste alderdi berritzaile bat da orain kalitate handiko Deepfake-ak ekoizteko aukera ematen dizula xede-objektuaren irudi bakarra erabiliz, guk egiten dugunaren antzera. YOLO objekturako errekonozimendua.

Deepfake eredua sortzeko prozesua

Deepfake-a sortzeko hiru prozesu beharrezkoak dira: erauzketa, prestakuntza eta sorkuntza. Etapa horietako bakoitzaren puntu nagusiak eta prozesu orokorrarekin nola erlazionatzen diren landuko dira atal honetan.

Erauzketa

Deepfake-ek sare neuronal sakonak erabiltzen dituzte aurpegiak aldatzeko eta datu (irudi) asko behar dituzte behar bezala eta modu sinesgarrian funtzionatzeko. Erauzketa-prozesua bideoklipetako fotograma guztiak ateratzen diren, aurpegiak ezagutzen diren eta aurpegiak lerrokatzen dira errendimendua maximizatzeko.

Prestakuntza

Prestakuntza fasean, du sare neural aurpegi bat beste batean alda dezake. Praktika-multzoaren eta entrenamendu-tresnaren tamainaren arabera, entrenamenduak hainbat ordu edo egun iraun ditzake.

Entrenamendua behin bakarrik amaitu behar da, beste sare neuronaleko prestakuntza gehienak bezala. Entrenatu ondoren, ereduak aurpegia aldatzeko gai izango litzateke A pertsonatik B pertsonara.

Sorkuntza

Eredua trebatu ondoren, deepfake bat sor daiteke. Fotogramak bideo batetik ateratzen dira eta gero aurpegi guztietara lerrokatzen dira. Ondoren, trebatutako neurona-sarea erabiltzen da fotograma bakoitza eraldatzeko.

Eraldatutako aurpegia jatorrizko markoarekin batu behar da azken urrats gisa.

Deepfake detektatzeko eredua eraikitzea

GitHub Repo muntatzea eta klonatzea

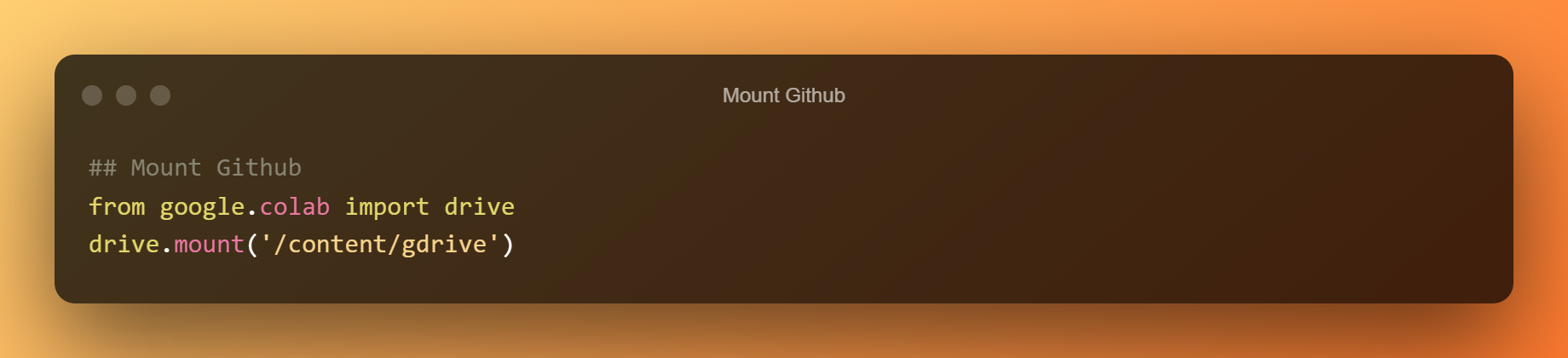

Colab-en lan egiten duzun bitartean Google-ren GPUak doan erabili ahal izatea onuragarria da ikaskuntza sakona. Abantaila gehigarri bat Google Drive hodeiko makina birtualean (VM) batean muntatzeko gaitasuna da.

Bere gauza guztietarako sarbide errazarekin, erabiltzailea gaituta dago. Google Drive hodeiko makina birtualean muntatzeko behar den programa atal honetan aurkituko dugu.

Moduluak inportatzea

Orain, beharrezko modulu guztiak inportatuko ditugu.

Eredua gauzatzea

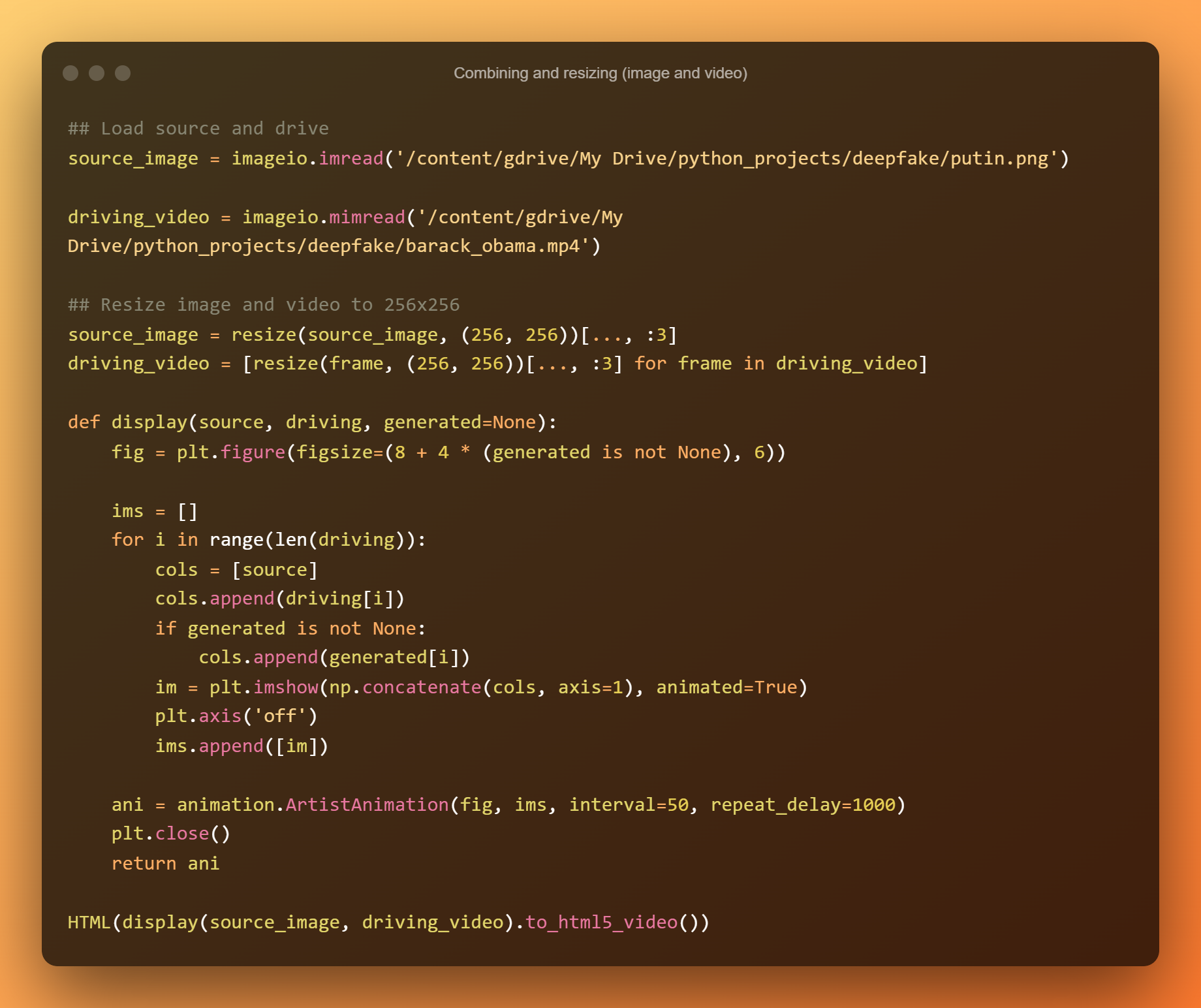

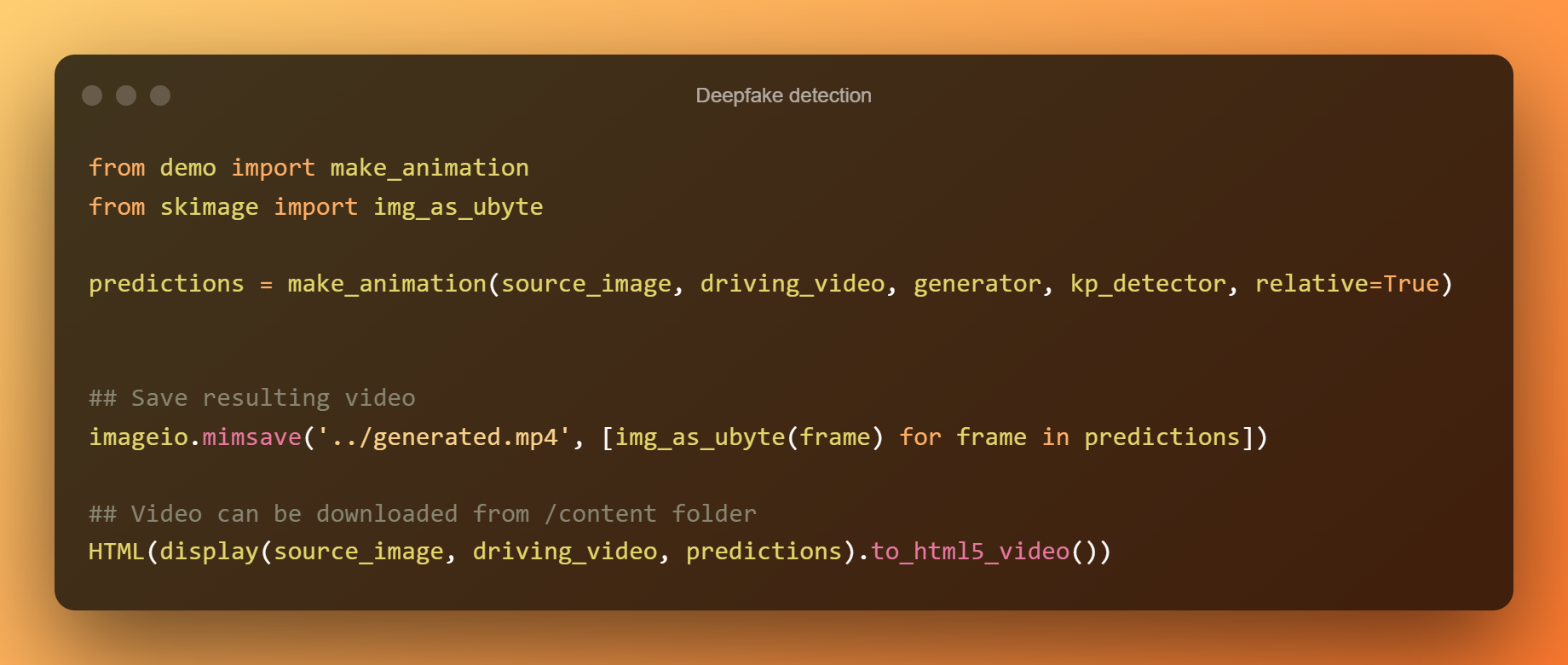

Putinen argazki finko bat (iturburuko argazkia) Obamaren bideo batekin konbinatzen duen adibide bat erabiliko dugu. Emaitza Putinek gidatzen zuen bitartean Obamak erabiltzen zituen aurpegi-adierazpen berdinekin hitz egiten eta keinu egiten duen bideoa da.

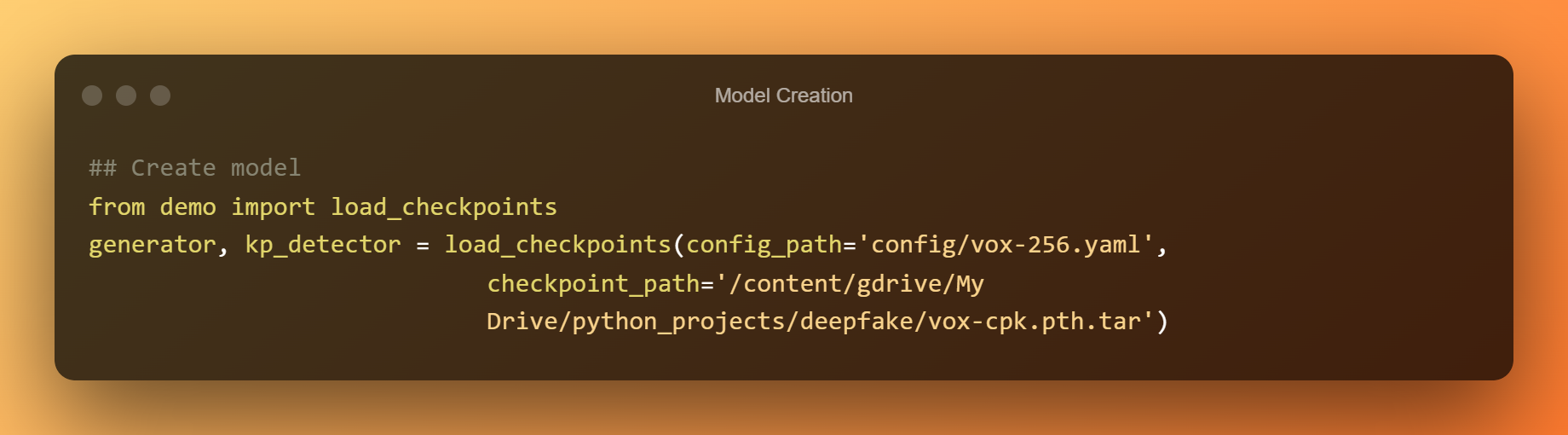

Ereduaren emaitza bistaratu aurretik, euskarria kargatuko da eta funtzioak deklaratuko dira. Ondoren, kontrol-puntuak kargatuko dira eta eredua eraikiko da. Faltsu sakona sortu ondoren, bi animazio estilo ezberdin bistaratuko dira.

Putinek Obamaren mugimenduek animatzen dute gako-puntuen desplazamendu erlatiboa erabiliz. Harrigarria da Obamaren aurpegiko emozioak eta gorputz-lengoaia ederki eta argi eta garbi azaltzen dituen modua Putinentzat bere bideoetan.

Akats mikroskopiko batzuk daude, batez ere Obamak bekainak altxatu eta begiak keinu egiten dituenean. Adierazpen horiek ez dira zehatz-mehatz errepikatzen Putinen markoetan.

Atzealde faltsurik gabe, Putinen filma nahiko sinesgarria eta benetakoa izango litzateke telebistan edo ikusiko balitz. social media.

Ereduen sorrera

Orain, aurrez prestatutako kontrol-puntuak erabiliko ditugu eredu oso bat sortzeko.

Deepfake detekzioa

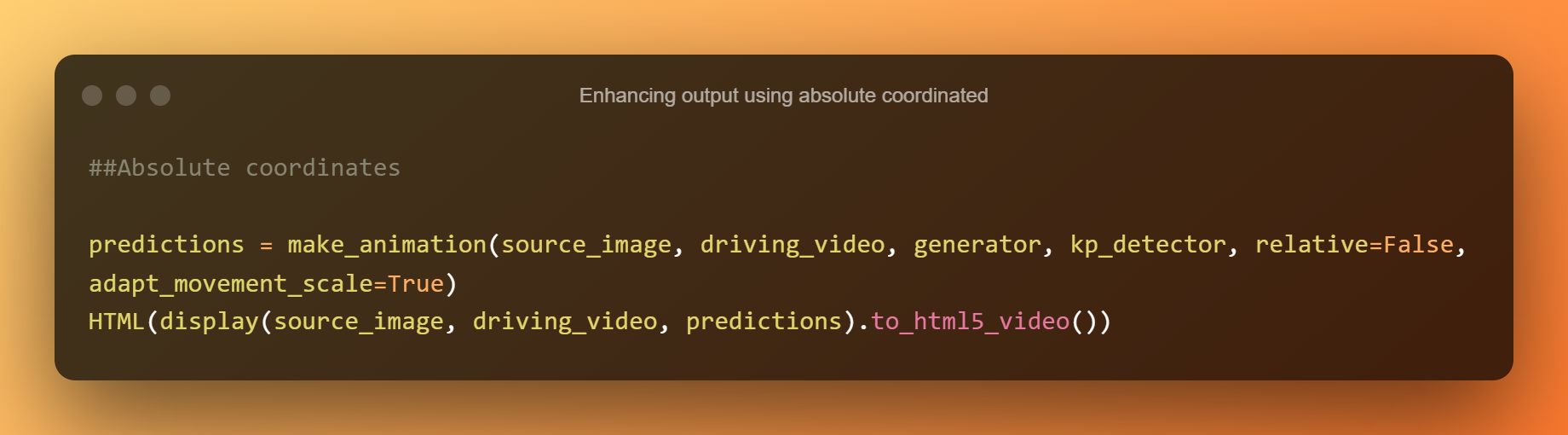

Gako-puntuaren desplazamendu erlatiboa beheko gelaxkako elementuak animatzeko erabiltzen da. Hurrengo gelaxkak koordenatu absolutuak erabiltzen ditu ordez, baina elementuen proportzio guztiak gidatzeko bideotik aterako dira era honetan.

Irteera hobetzea koordenatu absolutuak erabiliz

Modu honetan deepfake detekzio bat garatu ahal izango duzu.

Zeintzuk dira Deepfake teknologiaren arriskuak?

Deepfake bideoak erakargarriak eta entretenigarriak dira orain euren berritasuna dela eta. Hala ere, itxuraz dibertigarria den teknologia honen gainazalean kontroletik kanpo gelditzeko arriskua dago.

Zalantzarik gabe, zaila izango da bideo faltsuak eta benetakoak bereiztea deepfake teknologia aurrera jarraitzen du. Pertsonaia eta ospetsu ospetsuentzat, bereziki, horrek ondorio larriak izan ditzake. Nahita gaiztoak diren deepfakeek karrerak eta bizitzak guztiz kaltetzeko aukera dute.

Asmo gaiztoa duen norbaitek erabil ditzake hauek beste batzuentzat pasatzeko eta bere lagunak, senideak eta lankideak aprobetxatzeko. Mundu osoko polemikak eta baita gerrak ere pizteko gai dira atzerriko buruzagien film faltsuak erabiliz.

Ondorioa

Laburbilduz, garai bitxi eta ezohiko ingurune batean gaude. Inoiz baino erraza da albiste eta film faltsuak sortzea eta zabaltzea. Egia zer den eta zer ez ulertzea gero eta zailagoa da.

Gaur egun, dirudienez, ezin gara gehiago fidatu gure zentzumenetan.

Bideo-detektagailu faltsuak garatu diren arren, denbora kontua da informazio-hutsunea hain estua izan arte, non detektagailu faltsurik onenetakoek ere ezin izango dute zehaztu bideoa benetakoa den ala ez.

Utzi erantzun bat