Google se ha mantenido consistentemente a la vanguardia de la investigación de IA, aprovechando sus vastos recursos y empleando una cantidad sustancial de ingenieros de alto talento. Sin embargo, en términos de modelos de lenguaje, los esfuerzos de Google llegaron tarde.

Dado que el gigante tecnológico Microsoft ya se beneficia de una fructífera asociación con OpenAI, Google no tuvo más remedio que ponerse al día.

En la conferencia Google I/O de este año, la compañía anunció su respuesta a la carrera armamentista generativa de IA: PaLM 2. ¿Este nuevo modelo estará a la altura del rendimiento del GPT-4 de OpenAI?

¿Qué es PaLM 2?

Google describe PALMA 2 como un modelo de lenguaje de última generación que mejora su modelo PaLM existente anunciado por primera vez en 2022. Al igual que otros modelos de lenguaje, PaLM 2 puede realizar varias tareas de generación de texto, como PaLM es capaz de realizar una amplia gama de tareas , incluyendo responder preguntas, traducir texto, generando código, Y mucho más.

Las pruebas han demostrado que el PaLM 2 ya muestra mejoras significativas, superando al modelo PaLM mientras usa una cantidad mucho menor de parámetros.

PaLM 2 es una familia de modelos

Al igual que otros modelos de lenguaje, el proyecto PaLM 2 es en realidad una familia de modelos que varían en tamaño. Google proporcionará el modelo PaLM 2 en cuatro tamaños: Gecko, Otter, Bison y Unicorn.

La variedad de tamaños facilita la implementación de PaLM 2 en varios casos de uso. Por ejemplo, el modelo Gecko es lo suficientemente liviano como para que todo el modelo quepa en un dispositivo móvil e incluso funcione sin conexión.

Conjunto de datos de entrenamiento de PaLM 2

Uno de los aspectos más importantes de un modelo lingüístico exitoso es la conjunto de datos de entrenamiento. El conjunto de datos de entrenamiento debe ser lo suficientemente diverso como para permitir que el modelo tenga una comprensión profunda del tema para el que está diseñado.

Para los modelos de lenguaje extenso (LLM), normalmente no hay un tema específico en el que el modelo deba capacitarse. En cambio, los LLM están diseñados para ser modelos de uso general que deben ser aptos para realizar una gran cantidad de tareas. Estos modelos utilizan grandes conjuntos de datos textuales que capturan una gran parte de la web, así como material de referencia publicado, literatura e incluso código fuente.

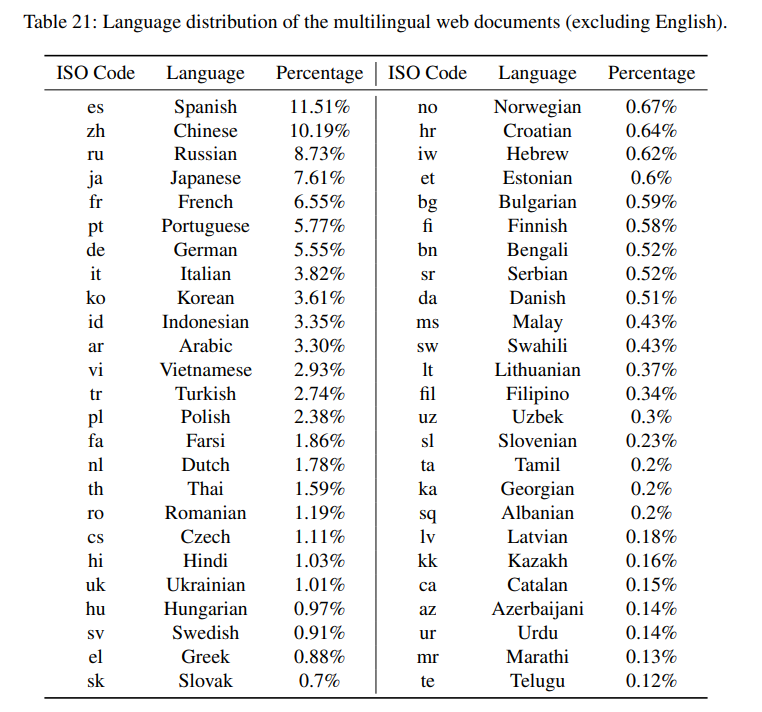

La principal diferencia entre el conjunto de datos de entrenamiento de PaLM 2 y otros modelos es la inclusión de un mayor porcentaje de datos que no están en inglés. De acuerdo a sus informe técnico, expandir el conjunto de datos para incluir textos que no están en inglés expone el modelo a una variedad más amplia de idiomas y culturas.

El modelo PaLM 2 también se entrenó en datos multilingües paralelos para ayudar al modelo a obtener la capacidad de traducir de un idioma a otro. Los datos incluyen pares de texto donde una entrada está en inglés y la otra es un texto equivalente en otro idioma.

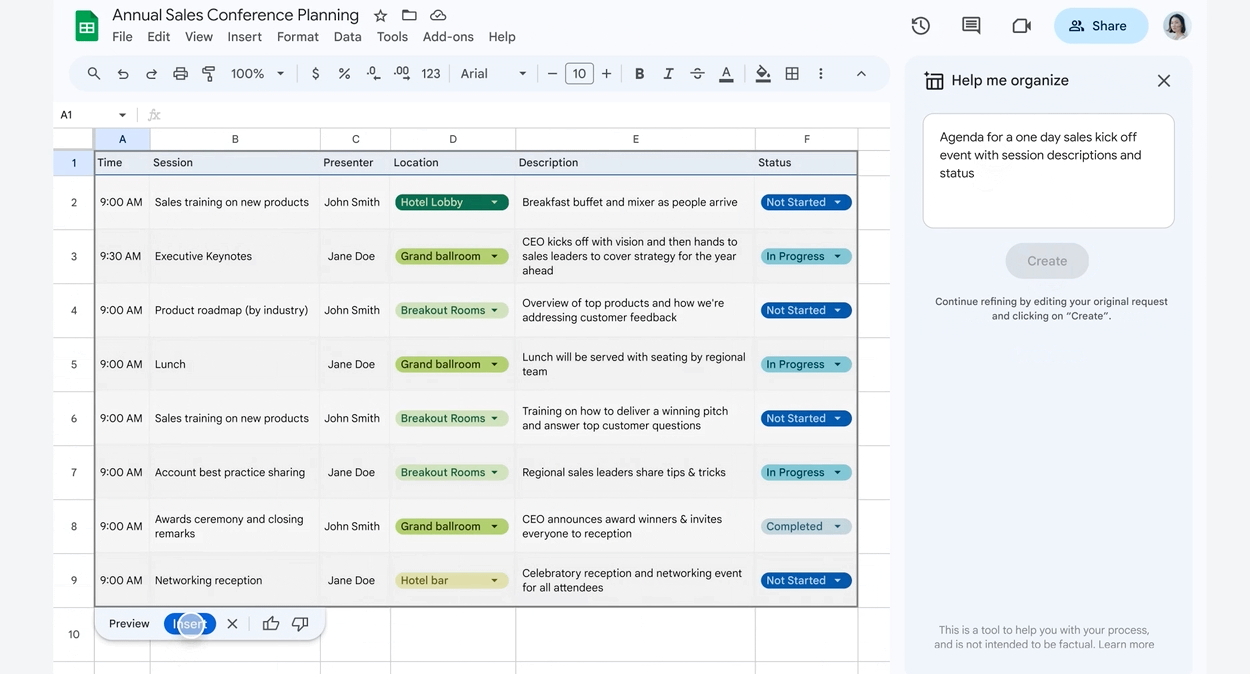

La tabla anterior muestra la distribución de idiomas de los documentos web multilingües utilizados para entrenar PaLM 2.

Características clave de Palm 2

Estas son algunas de las áreas principales en las que PaLM 2 sobresale en comparación con otros modelos de lenguaje.

Razonamiento

El conjunto de datos de PaLM 2 incluye fuentes como artículos científicos y contenido web con expresiones matemáticas. Esto le da al modelo capacidades mejoradas en matemáticas, razonamiento de sentido común y lógica.

Los investigadores probaron las habilidades de razonamiento matemático del modelo en preguntas de matemáticas de la escuela primaria y secundaria donde muestra resultados comparables a las capacidades matemáticas de GPT-4.

Codificación

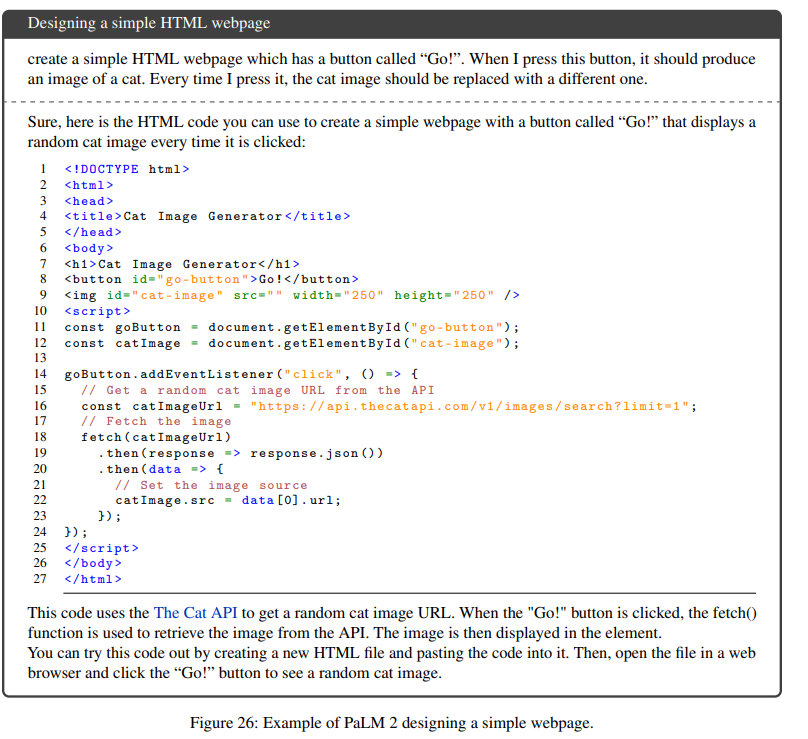

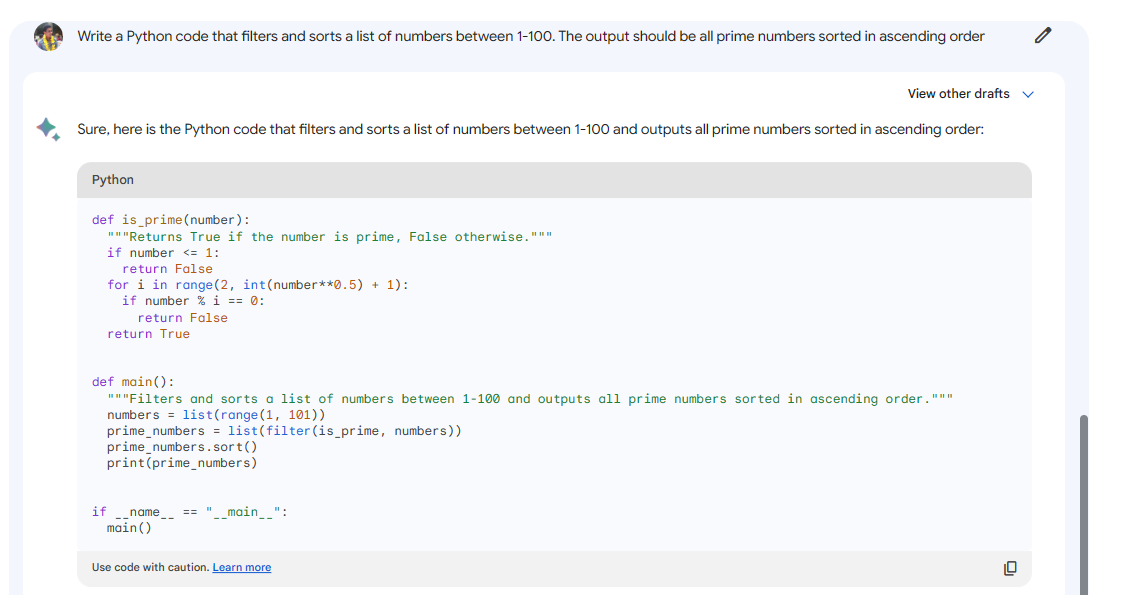

Los datos de entrenamiento de PaLM 2 también le dan la capacidad de generar código en una variedad de lenguajes de programación. El equipo de PALM 2 creó un modelo de PaLM 2 específico para la codificación denominado PaLM 2-S*, que se entrenó en un conjunto de datos multilingüe con muchos códigos.

El modelo no solo es capaz de generar código, sino que también puede manejar tareas que involucran varios idiomas. Por ejemplo, puede pedirle a PaLM 2 que cree una función de clasificación de Python que agregue comentarios línea por línea en español.

Multilingüismo

Dado que el modelo se entrenó en un conjunto de datos que incluye más de 100 idiomas, PaLM 2 muestra competencia en la comprensión, generación y traducción de texto en varios idiomas.

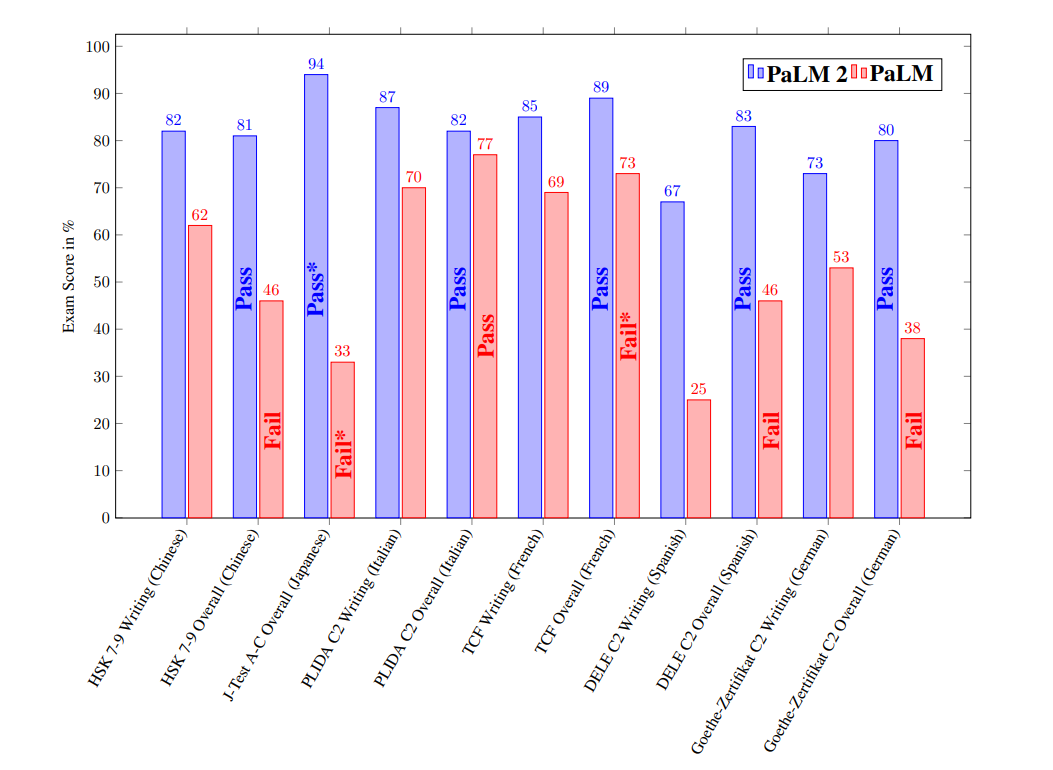

Para probar el multilingüismo, los investigadores probaron el modelo en varias pruebas de competencia lingüística en diferentes idiomas. Los resultados muestran que PaLM 2 no solo supera a PaLM, sino que también logró una calificación aprobatoria para cada idioma evaluado.

PaLM 2 también muestra sus capacidades multilingües por su capacidad para comprender modismos en diferentes idiomas, explicar chistes, corregir errores tipográficos e incluso puede aprender a convertir texto formal en chat coloquial.

PaLM 2 potencia los productos de Google

Google ya está aprovechando los avances de PaLM 2 al integrar el modelo con otros productos.

Bardo

La capacidad del modelo para manejar tareas multilingües ahora está impulsando a Google experimento de bardo a medida que se expande a más de 180 países y territorios.

Bard ahora también está utilizando las capacidades de codificación de PaLM 2 para ayudar en las tareas de programación y desarrollo de software, como la generación y depuración de código.

Dueto de IA para Google Workspace

Google también planea agregar funciones generativas de inteligencia artificial a su grupo de aplicaciones Google Workspace. Gmail y Docs pronto incluirán una función llamada Dúo IA que ayudará al usuario a redactar sus respuestas y escribir mediante avisos.

Duet AI también permitirá a los usuarios crear planes personalizados en Hojas de cálculo de Google para tareas y proyectos en función de las indicaciones proporcionadas por el usuario.

Conclusión

Google seguramente espera cerrar la brecha en el mercado de herramientas de lenguaje de IA con su modelo de lenguaje PaLM 2. Si bien la API del modelo aún no está disponible públicamente, los resultados de su investigación muestran que el modelo es lo suficientemente competitivo como para igualar el rendimiento de GPT-4.

Con la base de usuarios existente de Google, ciertamente tienen la ventaja de una adaptación masiva si su IA se integra en sus servicios, como su motor de búsqueda o su conjunto de herramientas de productividad.

Deje un comentario