Índice del contenido[Esconder][Espectáculo]

Es posible que haya oído hablar de lo poderosos que se han vuelto los modelos de IA de texto a imagen en los últimos años. Pero, ¿sabías que la misma tecnología podría ayudar a dar el salto de 2D a 3D?

Los modelos 3D generados por IA tienen un amplio caso de uso en el panorama digital actual. Videojuegos y el cine se basan en artistas 3D expertos y software de modelado como Blender para crear activos 3D para poblar escenas generadas por computadora.

Sin embargo, ¿es posible que la industria pueda utilizar el aprendizaje automático para crear activos 3D con menos esfuerzo, de forma similar a cómo los artistas 2D de hoy están empezando a adoptar tecnologías como DALL-E y a mitad de camino?

Este artículo explorará un algoritmo novedoso que intenta crear un modelo efectivo de texto a 3D utilizando modelos de difusión.

Que es Fusión de sueños?

Un problema importante con la creación de un modelo de difusión que genera activos 3D directamente es que simplemente no hay muchos datos 3D disponibles. Los modelos de difusión 2D se han vuelto tan poderosos debido al vasto conjunto de datos de imágenes que se encuentran en Internet. No se puede decir lo mismo de los activos 3D.

Algunas técnicas generativas 3D solucionan esta falta de datos aprovechando esta abundancia de datos 2D.

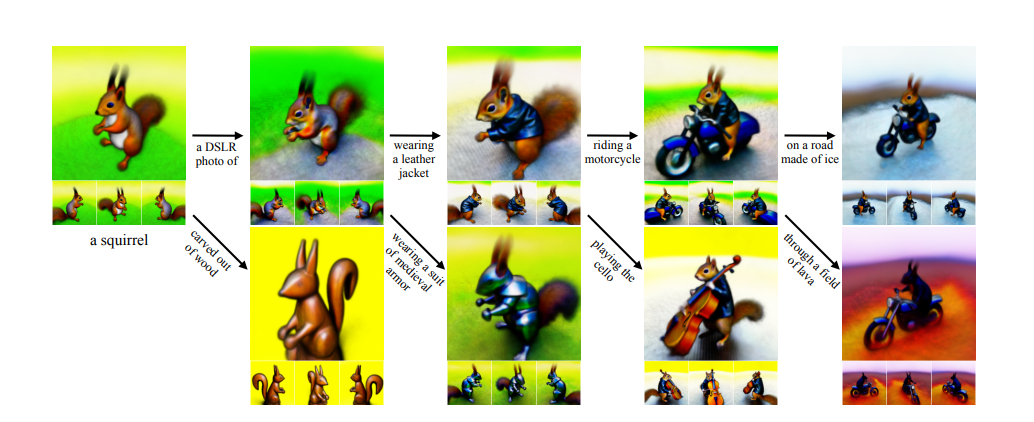

SueñoFusión es un modelo generativo que puede crear modelos 3D basados en una descripción de texto proporcionada. El modelo DreamFusion utiliza un modelo de difusión de texto a imagen preentrenado para generar modelos tridimensionales realistas a partir de indicaciones de texto.

A pesar de no tener datos de entrenamiento 3D, este enfoque ha generado activos 3D coherentes con apariencia y profundidad de alta fidelidad.

¿Cómo Funciona?

El algoritmo DreamFusion consta de dos modelos principales: un modelo de difusión 2D y un red neural que puede convertir imágenes 2D en una escena 3D cohesiva.

Modelo de imagen de texto a imagen de Google

La primera parte del algoritmo es el modelo de difusión. Este modelo se encarga de convertir texto en imágenes.

Imagen es un modelo de difusión que puede generar una gran muestra de variaciones de imagen de un objeto en particular. En este caso, nuestras variaciones de imagen deben cubrir todos los ángulos posibles del objeto proporcionado. Por ejemplo, si quisiéramos generar un modelo 3D de un caballo, querríamos imágenes 2D del caballo desde todos los ángulos posibles. El objetivo es usar Imagen para proporcionar la mayor cantidad de información posible (colores, reflejos, densidad) para el próximo modelo en nuestro algoritmo.

Creación de modelos 3D con NeRF

A continuación, Dreamfusion utiliza un modelo conocido como Campo de radiación neuronal o NeRF para crear realmente el modelo 3D a partir del conjunto de imágenes generado. Los NeRF pueden crear escenas 3D complejas a partir de un conjunto de datos de imágenes 2D.

Tratemos de entender cómo funciona un NeRF.

El modelo tiene como objetivo crear una función de escena volumétrica continua optimizada a partir del conjunto de datos proporcionado de imágenes 2D.

Si el modelo crea una función, ¿cuáles son la entrada y la salida?

La función de escena toma una ubicación 3D y una dirección de visualización 2D como entrada. Luego, la función genera un color (en forma de RGB) y una densidad de volumen específica.

Para generar una imagen 2D desde un punto de vista específico, el modelo generará un conjunto de puntos 3D y ejecutará esos puntos a través de la función de escena para devolver un conjunto de valores de densidad de volumen y color. Las técnicas de renderizado de volumen luego convertirán esos valores en una salida de imagen 2D.

Uso de NeRF y modelos de difusión 2D juntos

Ahora que sabemos cómo funciona un NeRF, veamos cómo este modelo puede generar modelos 3D precisos a partir de nuestras imágenes generadas.

Para cada indicación de texto proporcionada, DreamFusion entrena un NeRF inicializado aleatoriamente desde cero. Cada iteración elige una posición de cámara aleatoria en un conjunto de coordenadas esféricas. Piense en el modelo encerrado en una esfera de vidrio. Cada vez que generamos una nueva imagen de nuestro modelo 3D, elegiremos un punto aleatorio en nuestra esfera como el punto de vista de nuestra salida. DreamFusion también elegirá una posición de luz aleatoria l para usar para renderizar.

Una vez que tengamos una posición de cámara y luz, se renderizará un modelo NeRF. DreamFusion también elegirá aleatoriamente entre una representación en color, una representación sin textura y una representación del albedo sin sombreado.

Hemos mencionado anteriormente que queremos que nuestro modelo de texto a imagen (Imagen) produzca suficientes imágenes para crear una muestra representativa.

¿Cómo logra esto Dreamfusion?

Dreamfusion simplemente modifica ligeramente el indicador de entrada para lograr los ángulos deseados. Por ejemplo, podemos lograr ángulos de elevación elevados agregando "vista aérea" a nuestro indicador. Podemos generar otros ángulos agregando frases como "vista frontal", "vista lateral" y "vista posterior".

Las escenas se representan repetidamente desde posiciones de cámara aleatorias. Estas representaciones luego pasan a través de una función de pérdida de destilación de puntaje. Un enfoque de descenso de gradiente simple mejorará lentamente la Modelo 3D hasta que coincida con la escena descrita por el texto.

Una vez que hemos renderizado el modelo 3D usando NeRF, podemos usar el Algoritmo de cubos de marcha para generar una malla 3D de nuestro modelo. Luego, esta malla se puede importar a renderizadores 3D populares o software de modelado.

Limitaciones

Si bien el resultado de DreamFusion es lo suficientemente impresionante ya que utiliza modelos de difusión de texto a imagen existentes de una manera novedosa, los investigadores han notado algunas limitaciones.

Se ha observado que la función de pérdida de SDS produce resultados sobresaturados y suavizados. Puede observar esto en la coloración antinatural y la falta de detalles precisos que se encuentran en los resultados.

El algoritmo DreamFusion también está limitado por la resolución de la salida del modelo Imagen, que es de 64 x 64 píxeles. Esto lleva a que los modelos sintetizados carezcan de detalles más finos.

Por último, los investigadores han notado que existe un desafío inherente en la síntesis de modelos 3D a partir de datos 2D. Hay muchos modelos 3D posibles que podemos generar a partir de un conjunto de imágenes 2D, lo que hace que la optimización sea bastante difícil e incluso ambigua.

Conclusión

Las representaciones 3D de DreamFusion funcionan muy bien gracias a la capacidad de los modelos de difusión de texto a imagen para crear cualquier objeto o escena. Es impresionante cómo una red neuronal puede comprender una escena en el espacio 3D sin ningún dato de entrenamiento 3D. recomiendo leer el papel entero para obtener más información sobre los detalles técnicos del algoritmo DreamFusion.

Con suerte, esta tecnología mejorará para eventualmente crear modelos 3D fotorrealistas. Imagine videojuegos completos o simulaciones que utilicen entornos generados por IA. ¡Podría reducir la barrera de entrada para que los desarrolladores de videojuegos creen mundos 3D inmersivos!

¿Qué papel cree que desempeñarán los modelos de texto a 3D en el futuro?

Deje un comentario