Por kolekti informojn de retejoj por analizo, esplorado aŭ merkatado de celoj, retejo-skrapado estas decida tekniko. Bonŝance ekzistas multaj iloj, kiuj subtenas ambaŭ senkapajn kaj kapplenajn retumiloj, kiuj ambaŭ estas utilaj por interreta skrapado.

Kapaj retumiloj venas kun grafika uzantinterfaco (GUI), dum senkapaj retumiloj ne havas. Ĉi tiuj teknologioj povas ambaŭ mane kaj aŭtomate ĉerpi datumojn de retpaĝoj, kio faras ilin tre utilaj.

Kiam vi manipulas multajn datumojn, senkapaj retumiloj estas la plej bona elekto. Por aŭtomatigi vian eltiran procezon de datumoj, vi bezonos ĉi tiujn ilojn, kiuj ŝparos al vi multon da tempo kaj laboro.

Aldone, ili helpas vin plibonigi la precizecon kaj efikecon de via datuma eltiro, kio povus rezultigi pli fruktodonajn rezultojn entute.

Ĉi tiuj iloj ankaŭ povas helpi malpliigi la eblecon de eraroj aperantaj dum mane kopiado kaj algluado de datumoj ĉar ili havas la kapablon ĉerpi datumojn en organizita maniero.

Simple dirite, estas neeble labori sen iloj, kiuj subtenas ambaŭ senkapajn kaj kapplenajn retumiloj, se vi okupiĝas pri retskrapado.

En ĉi tiu artikolo, ni rigardos la suprajn senkapajn kaj kapplenajn retumiloj por retskrapado.

1. Brilaj Datumoj

Brilaj Datumoj estas interreta skrapprogramo, kiu provizas elektojn por datumkolektado por entreprenoj kaj individuoj. Male al pli fruaj interretaj skrapsistemoj, Bright Data venas antaŭŝarĝita kun kelkaj retumiloj sed funkcias kiel senkapa retumilo.

Kvankam ĝi funkcias kiel senkapa retumilo sur la malantaŭo, ĉi tio montras al la fakto, ke uzantoj povas interagi kun ĝi per grafika uzantinterfaco (GUI), igante ĝin pli alirebla kaj amika.

Ĉi tiu funkcio estos speciale utila por tiuj, kiuj ne scias multon pri kodigo aŭ volas pli simplan aliron al retskrapado. Uzantoj povas rapide navigi kompleksajn retejojn kun homsimilaj interagoj pro la kapa retumilo de Bright Data.

Por teni vin anonima kaj nemalkovrita, ĝi ankaŭ provizas avangardajn kapablojn kiel IP-rotacio, retumila fingrospurado kaj uzanta agento falsado. Kun la uzo de AI, Scraping Browser povos preterpasi eĉ la plej altnivelajn bot-detektajn protektojn.

Fakte, la Scraping-Retumilo estas tiel kompleksa, ke ĝi eĉ povas simuli la agojn de la retumilo de aŭtenta uzanto, provizante al vi pli sukcesajn rezultojn kaj precizajn datumojn.

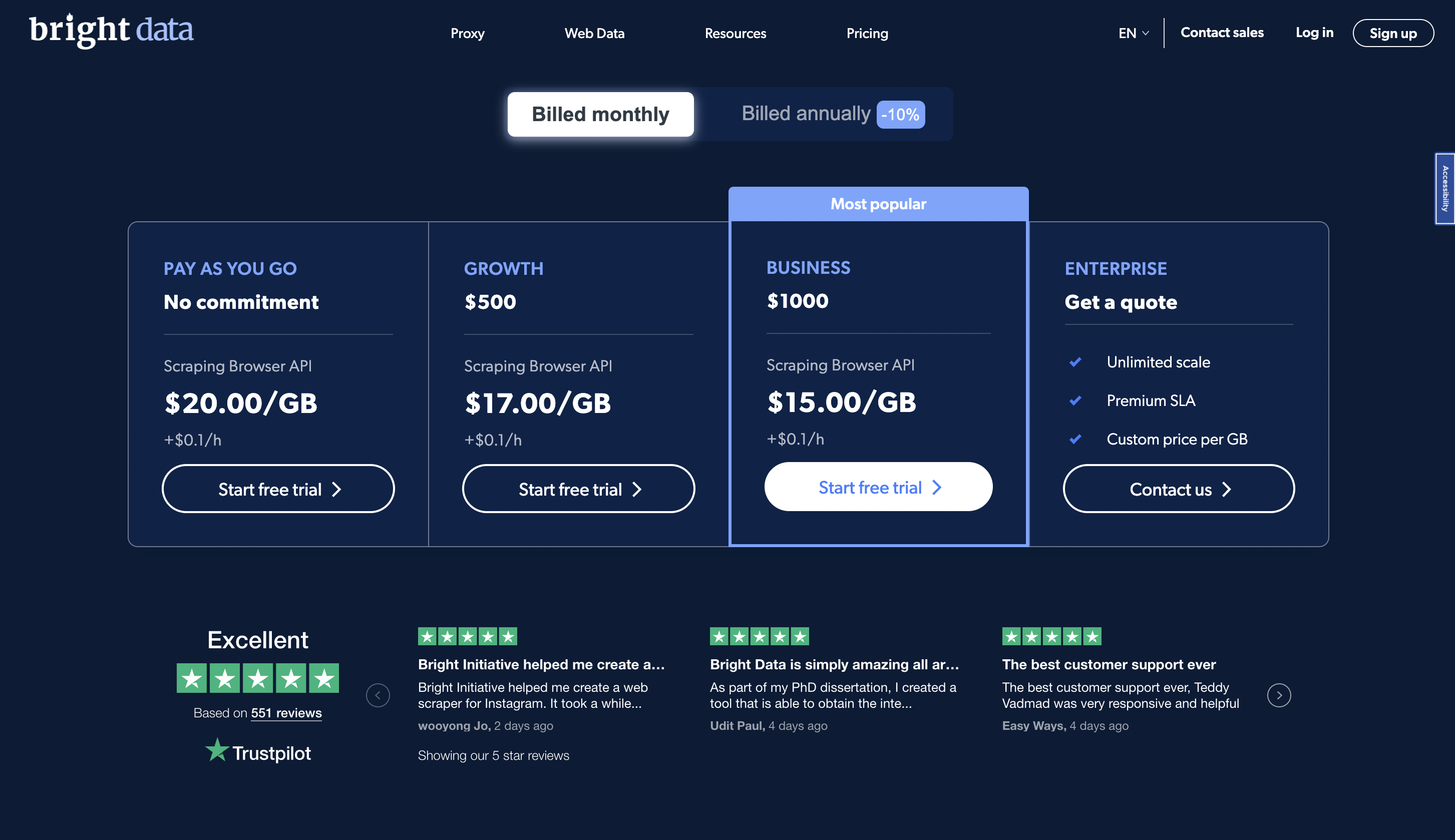

prezoj

Vi povas provi la platformon senpage kaj superaj prezoj komenciĝas de $ 20/GB en plano de pago.

2. Zyte

Kiel provizanto de interretaj skrapiloj, Zyte - antaŭe konata kiel Scrapinghub - permesas al kompanioj kapti kaj analizi interretajn datumojn je skalo.

La interreta skrapplatformo de Zyte estas konstruita por manipuli eĉ la plej komplikajn kaj dinamikajn retejojn, kaj ĝi inkluzivas diversajn avangardajn funkciojn kiel aŭtomata IP-rotacio, retumila fingrospurado kaj uzant-agenta falsigo por garantii, ke viaj skrapantaj operacioj restas privataj kaj nerimarkitaj.

La fakto, ke la interreta skrapplatformo de Zyte subtenas ambaŭ senkapajn kaj kapplenajn surfajn reĝimojn estas unu el ĝiaj karakterizaj avantaĝoj. La retumilo funkcias en senkapa reĝimo en la fono sen grafika uzantinterfaco, kiu pliigas sian efikecon por ampleksaj skrapoperacioj.

Tamen, la retumilo funkcias per GUI en kapa reĝimo, kio povus esti avantaĝa kiam vi bezonas ĉerpi datumojn de retejoj kun komplikaj uzantinterfacoj.

Aldone, ĉar la platformo de Zyte baziĝas sur la senpaga kaj malfermfonta Scrapy-fondaĵo, ĝi povas esti adaptita por plenumi viajn specifajn bezonojn kaj estas ege agordebla. Vi povas rapide kaj simple reakiri la datumojn, kiujn vi volas uzante Zyte, provizante al vi konkurencivan avantaĝon en via komerco.

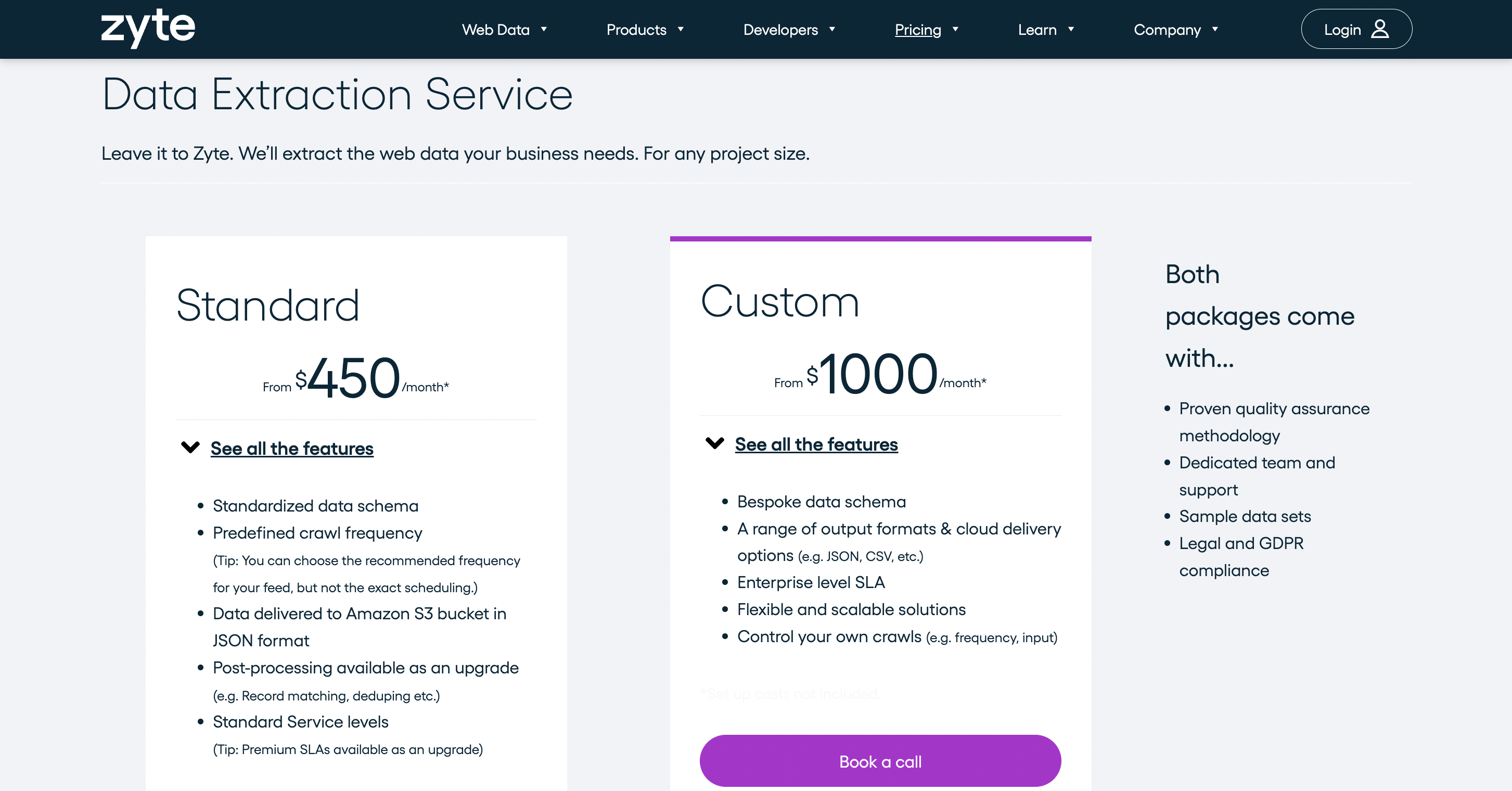

prezoj

Ĝi ofertas plurajn prezajn planojn, kaj ĝi pagas $ 450/monate por datuma eltira servo.

3. Octoparse

Vi povas kolekti datumojn de retpaĝoj sen skribi ajnan kodon per Octoparse, nubo-bazita retejo-skrap-aplikaĵo. Ĉiu, kiu deziras skrapi tekston, fotojn aŭ filmetojn, povas elekti ilin facile danke al la amika interfaco.

Octoparse estas fleksebla ilo, kiu subtenas kaj senkapan kaj kapplenan foliumadon, ĝi estas la plej bona elekto por projektoj de skrapado de retejoj de ajna grandeco kaj komplekseco. Povi skrapi dinamikajn kaj interagajn retpaĝojn, kiuj povas esti malfacilaj por multaj aliaj retskrapantaj programoj, estas unu el ĝiaj plej fortaj trajtoj.

Vi povas krei kompleksajn skrapajn procezojn kun multaj fazoj, kondiĉaj deklaroj kaj bukloj, pliigante la flekseblecon kaj agordeblecon de skrapado. Excel, CSV kaj SQL estas nur kelkaj el la eksportaj formatoj, kiujn Octoparse provizas, faciligante uzi la ĉerpitajn datumojn en aliaj programoj.

Aldone, Octoparse havas integran prokurilon, kiu certigas anoniman skrapadon kaj helpas eviti IP-malpermeson.

prezoj

Vi povas komenci uzi ĝin senpage kaj superaj prezoj komenciĝas de $ 89/monate.

4. Apify

Apify estas interreta skrapado kaj aŭtomatigo tute-en-unu platformo kiu ofertas diversajn potencajn funkciojn. Ĝi subtenas ambaŭ senkapajn kaj kapplenajn foliumilojn kaj havas intuician uzantinterfacon, kiu simpligas eĉ por ne-teknikaj uzantoj krei skrapajn taskojn.

La kapablo de Apify pritrakti malfacilajn skrapajn laborojn, subteno por pluraj lingvoj kaj pligrandigo por trakti grandskalajn skrapajn projektojn estas kelkaj el ĝiaj plej bonaj trajtoj.

Aldone, Apify provizas aliron al vasta merkato de pretaj skrapiloj, kiuj povas esti rapide personecigitaj por plenumi viajn unikajn postulojn.

Kun ĝia subteno por senkapaj retumiloj, Apify povas navigi malfacilajn uzantinterfacojn kaj skrapi datumojn de dinamikaj retejoj dum rapide kaj efike ĉerpas informojn el amasaj volumoj da datumoj.

Apify estas utila ilo por diversaj interretaj skrapaj aplikoj, inkluzive de plumbogenerado, konkurenciva analizo, merkata esploro kaj enhavo-agregado.

Apify pliigas precizecon kaj efikecon ŝparante tempon kaj penadon aŭtomatigante la procezon de eltiro de datumoj. Ĝi estas forta ilo por ambaŭ teknikaj kaj ne-teknikaj uzantoj pro sia funkcieco kaj uzant-amika dezajno.

prezoj

Vi povas komenci uzi ĝin senpage kaj superaj prezoj komenciĝas de $ 49/monate.

5. ScrapingBee

La elstara interreta skrap-aplikaĵo ScrapingBee faciligas aŭtomatigi la procezon de eltiro de datumoj de retejoj.

Ĝiaj kapabloj, kiel ekzemple tiuj por pritrakti JavaScript-bildigon, CAPTCHA-rezolucion, kaj uzant-agentan rotacion, ebligas kontraŭ-skrapajn defendojn de retejoj esti preterpasitaj. tial ĝi faras bonegan eblon por taskoj pri retskrapado.

Uzantoj havas grandan gradon de libereco kun ĉi tiu ilo ĉar ĝi funkcias kun ambaŭ senkapaj kaj kapplenaj retumiloj. Gravas atentigi, ke ScrapingBee uzas defaŭlte senkapajn retumiloj, kio estas perfekta por aŭtomate reakiri enormajn volumojn da datumoj.

Por okupiĝi pri retejoj, kiuj havas kompleksan interfacon, uzantoj povus ŝanĝi al kapplenaj retumiloj. Por certigi efikan eltiron de datumoj, ScrapingBee ankaŭ konservas aron da geolokigitaj prokuriloj, kiuj estas regule kontrolitaj kaj ŝanĝitaj.

Uzantoj povas redukti tempon kaj penadon dum interreta skrapado uzante ScrapingBee kiel senkapan aŭ kapplenan retumilon dum ĝi ankoraŭ garantias la ĝustecon kaj kompletecon de la prenitaj datumoj. Ĝi ankaŭ havas multajn helpajn funkciojn, kiel datumformatado, prokura rotacio kaj API-konektebleco, igante ĝin oportuna ilo por kaj kompanioj kaj studentoj.

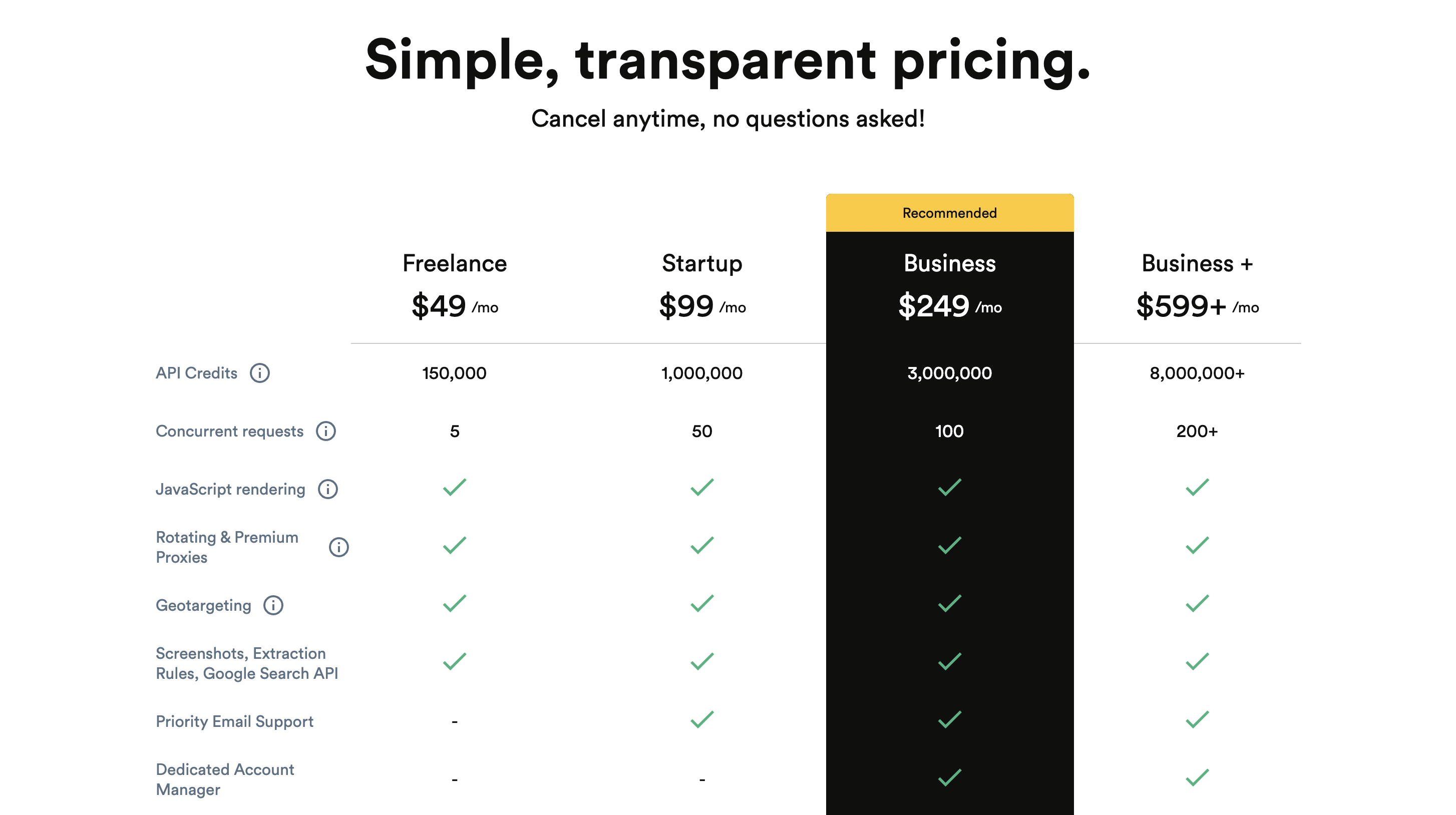

prezoj

La altvalora prezo komenciĝas de $ 49/monate.

6. ParseHub

Sen la bezono de teknika kompetenteco, uzantoj povas kolekti datumojn de retejoj uzante la retejon skrapanta aplikaĵo ParseHub. Unu el ĝiaj plej grandaj karakterizaĵoj estas kiom facile ĝi estas uzi; uzantoj povas elekti la datumojn, kiujn ili volas skrapi, simple alklakante la erojn.

Ankaŭ, ĝi havas la kapablon rekoni paĝigon aŭtomate, faciligante por uzantoj skrapi informojn de pluraj paĝoj. Por skrapi datumojn de retejoj kun bazaj aŭ komplikaj uzantinterfacoj, ParseHub subtenas ambaŭ senkapajn kaj kapplenajn retumiloj.

Aldone, ĝi disponigas aŭtomatan IP-rotacion, igante ĝin pli malfacila por retejoj identigi kaj malpermesi skrapadon. ParseHub garantias, ke datumoj estas ĉerpitaj en organizita maniero kun la helpo de siaj ampleksaj datumaj formatadkapabloj, igante ĝin pli simpla por analizo kaj sistema integriĝo.

Aldone, ParseHub havas inteligentan reĝimon, kiu aŭtomate rekonas kaj kolektas informojn de similaj retejoj. ParseHub povas rekoni kaj kolekti datumojn de retejoj kun similaj strukturoj, kiel retkomercaj retejoj, uzante artefarita inteligento (AI). Ĉi tiu funkcio pliigas precizecon kaj produktivecon postulante malpli da penado kaj ŝparante tempon.

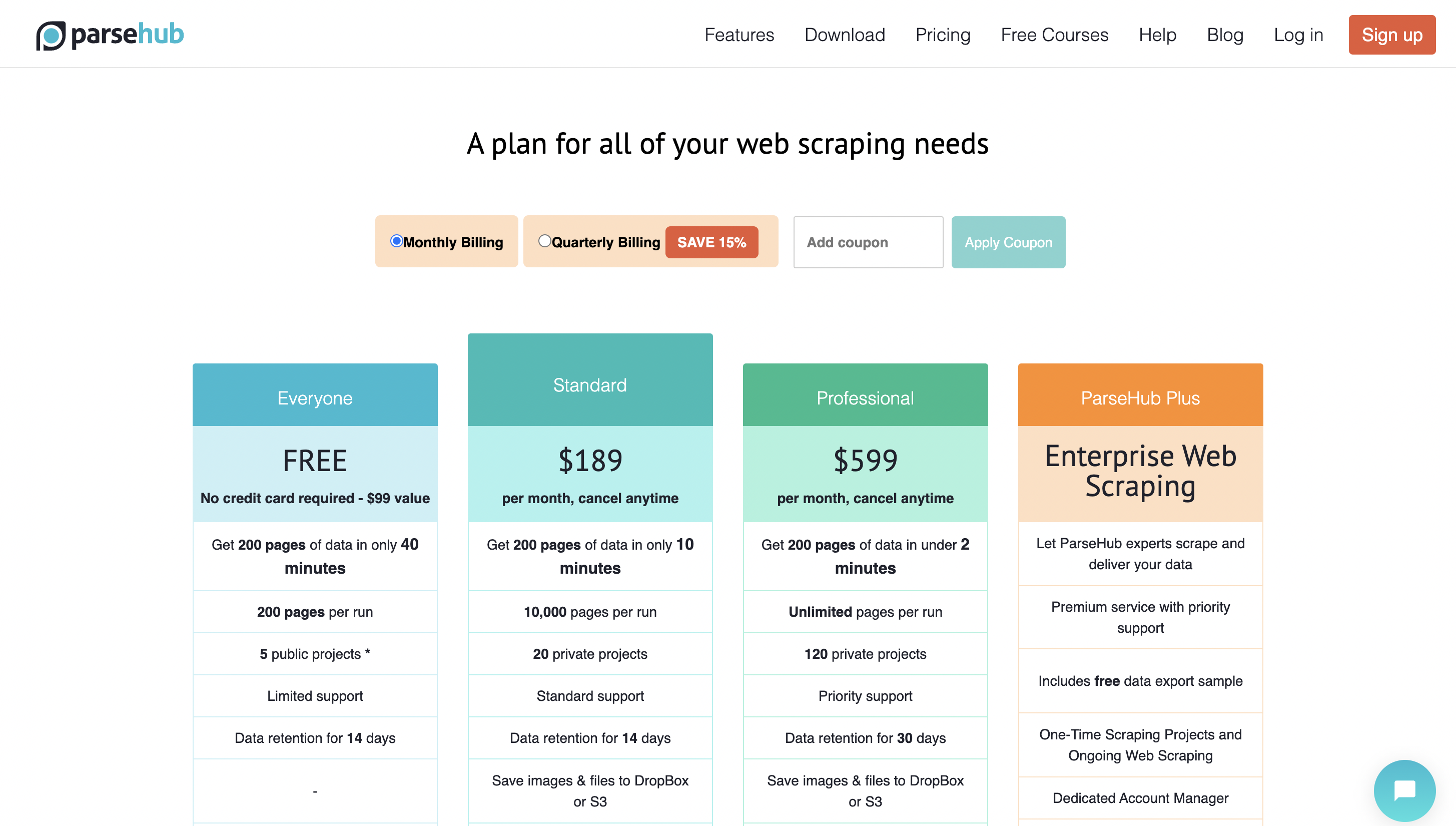

prezoj

Vi povas komenci uzi ĝin senpage kaj superaj prezoj komenciĝas de $ 189/monate.

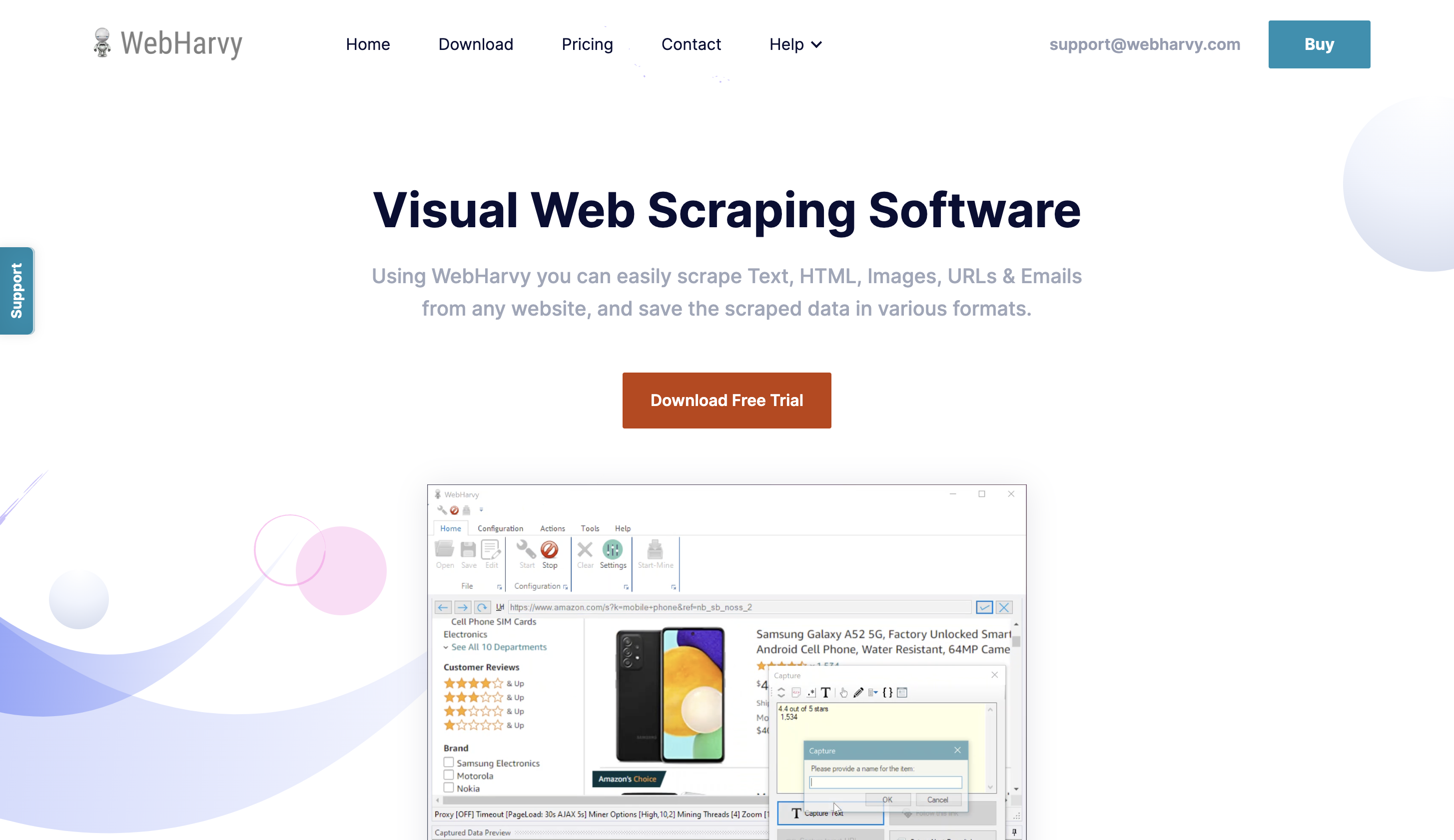

7. WebHarvy

WebHarvy estas potenca interreta skrapilo, kiu ebligas al organizoj rapide, precize kaj efike skrapi datumojn de retejoj. Ĝi estas farita por skrapi informojn de multaj retejoj, inkluzive de serĉiloj, sociaj amaskomunikiloj, retkomercaj retejoj kaj adresaroj.

Sen ajna antaŭa koda sperto, uzantoj povas senpene esplori kaj krei skrapajn laborpostenojn pro ĝia amika interfaco. Unu el la plej grandaj karakterizaĵoj de WebHarvy estas ĝia kapablo preni datumojn de retpaĝoj funkciigitaj de JavaScript kaj AJAX, ke aliaj skrapiloj eble ne povos aliri ĝin.

Aldone, ĝi ofertas Punktu kaj Klaku-Interfacon, kiu faciligas elekti la informojn el retpaĝo, kiun vi volas skrapi. WebHarvy havas senkapajn kaj kapplenajn foliumreĝimojn. Por pli rapida kaj pli efika datuma skrapado, ĝi povas funkcii en senkapa reĝimo.

Kapa reĝimo estas helpema kiam vi laboras kun komplikaj retejoj, kiuj postulas uzantan enigon. Ĝi ankaŭ povas navigi inter multaj paĝoj kaj plenigi formularojn, kio estas utila kiam oni ĉerpas datumojn de retejoj kun pluraj paĝoj.

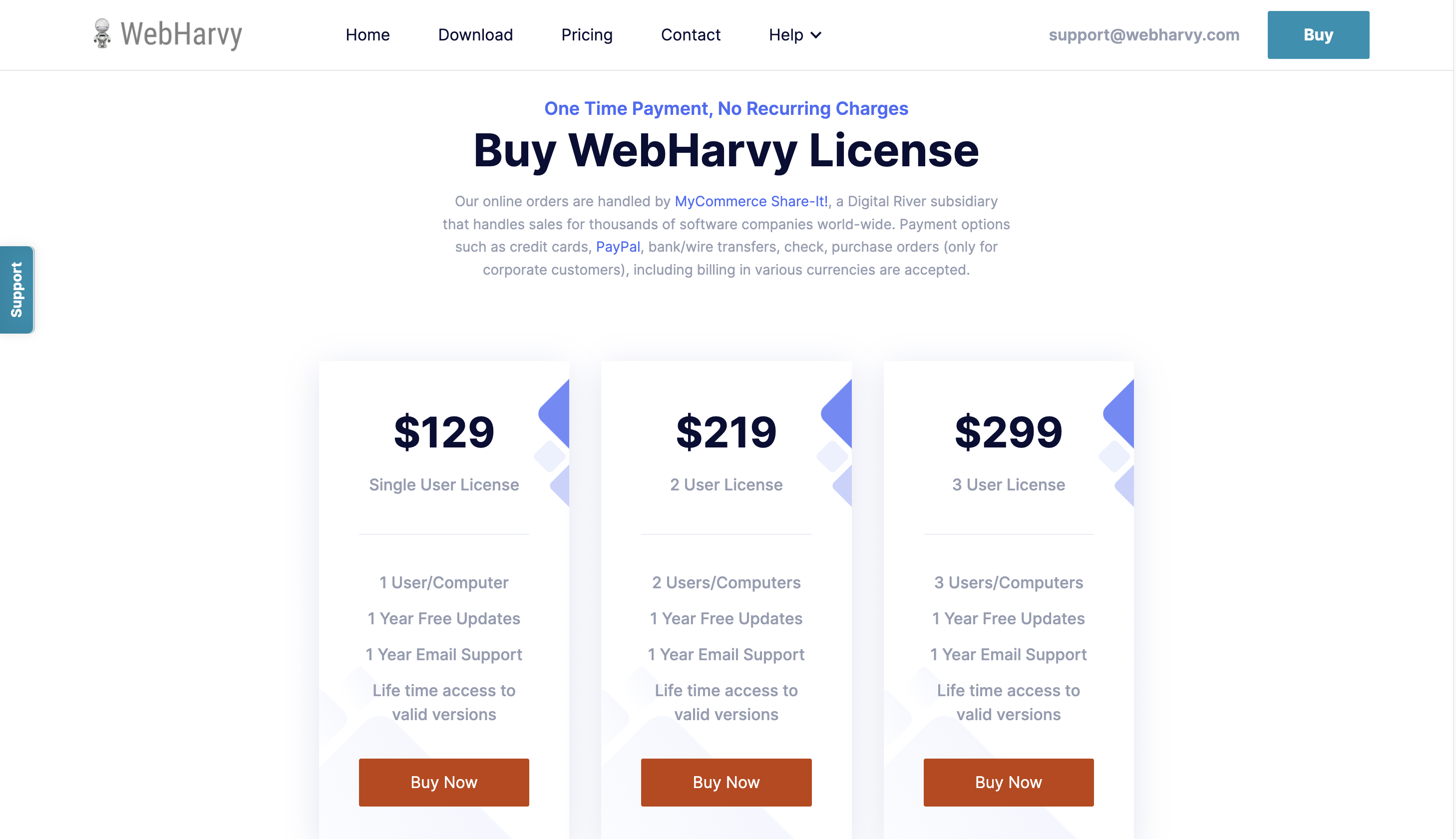

prezoj

La altvalora prezo komenciĝas de $ 129 por unuuza permesilo.

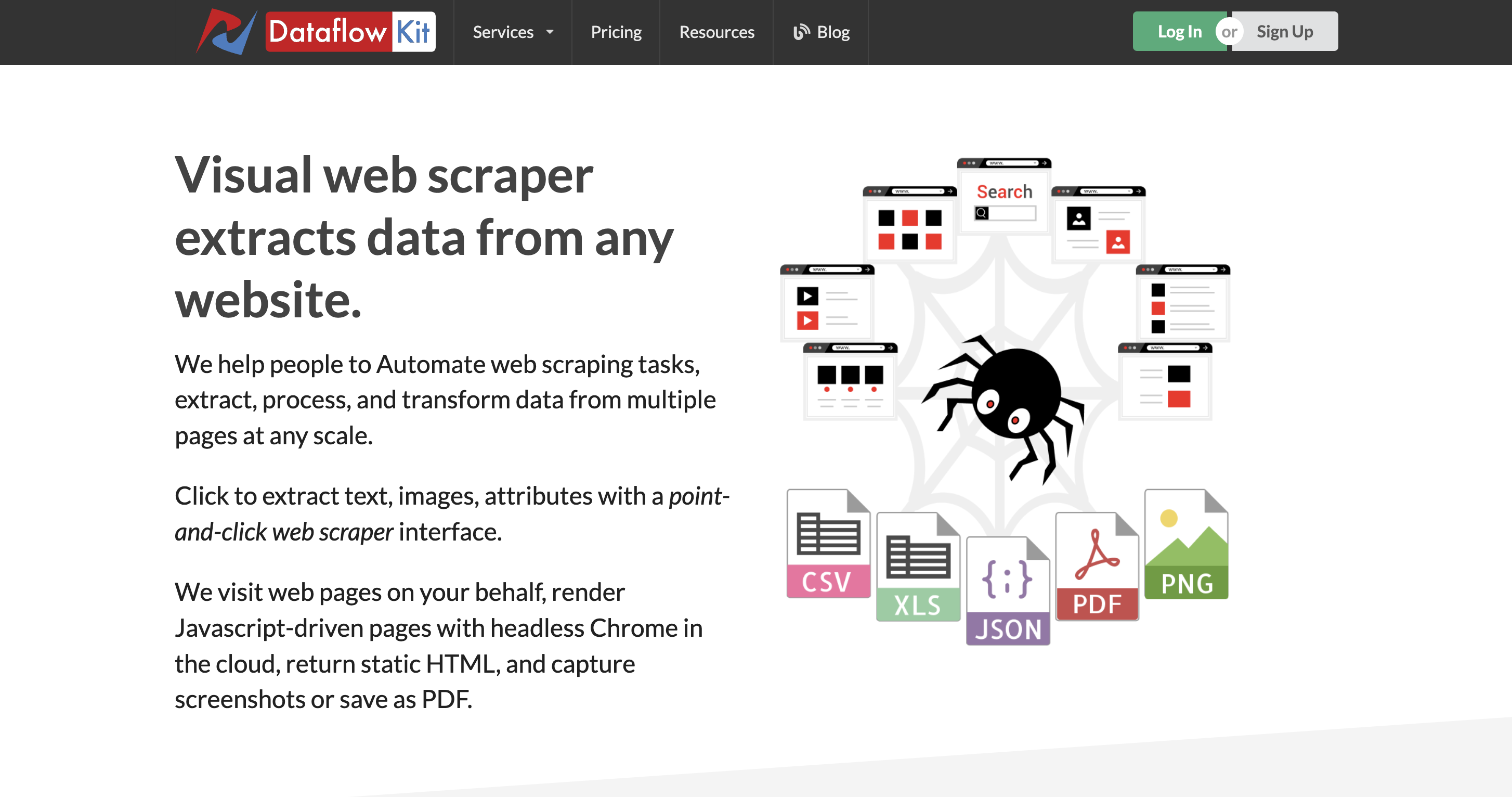

8. Datumflua Ilaro

Uzante Dataflow Kit, fortika interreta skrapilo, datumoj povas esti kolektitaj kaj analizitaj de diversaj retejoj, inkluzive de sociaj retoj retejoj, serĉiloj, retkomercaj retejoj kaj novaĵretejoj. Unu el ĝiaj plej bonaj trajtoj estas ĝia kapablo rapide kaj efike kolekti datumojn de komplikaj, dinamikaj retejoj.

Ĝi estas ideala por skrapi retejojn, kiuj malfacilas aliri uzante aliajn metodojn, ĉar ĝi estas tiel simpla uzi. Senkapa retumilo kaj kapplena retumilo estas ambaŭ funkciaj kun Dataflow Kit. Altnivelaj funkcioj kiel prokura kaj uzant-agenta rotacio, IP-bloka evitado kaj kontraŭ-bot-detekto estas provizitaj por certigi efikan skrapadon.

Aldone, ĝi ofertas uzant-amikan interfacon, kiu ebligas al klientoj krei, plani kaj administri siajn skrapajn agadojn sen iu ajn programa sperto. Por grandskalaj retskrapaj aplikoj, ĝia efika skrapmotoro estas mirinda solvo ĉar ĝi estas optimumigita por manipuli datumojn rapide kaj efike.

La skrapitaj datumoj povas esti simple eksportitaj al diversaj formatoj, inkluzive de CSV, JSON kaj XML, permesante al vi analizi kaj uzi ĝin kiel ajn vi konvenas. Krome, Dataflow Kit provizas diversajn interfacajn opciojn, inkluzive de API kaj Zapier, por helpi vin plifaciligi vian laborfluon kaj aŭtomatigi vian eltiran procezon de datumoj.

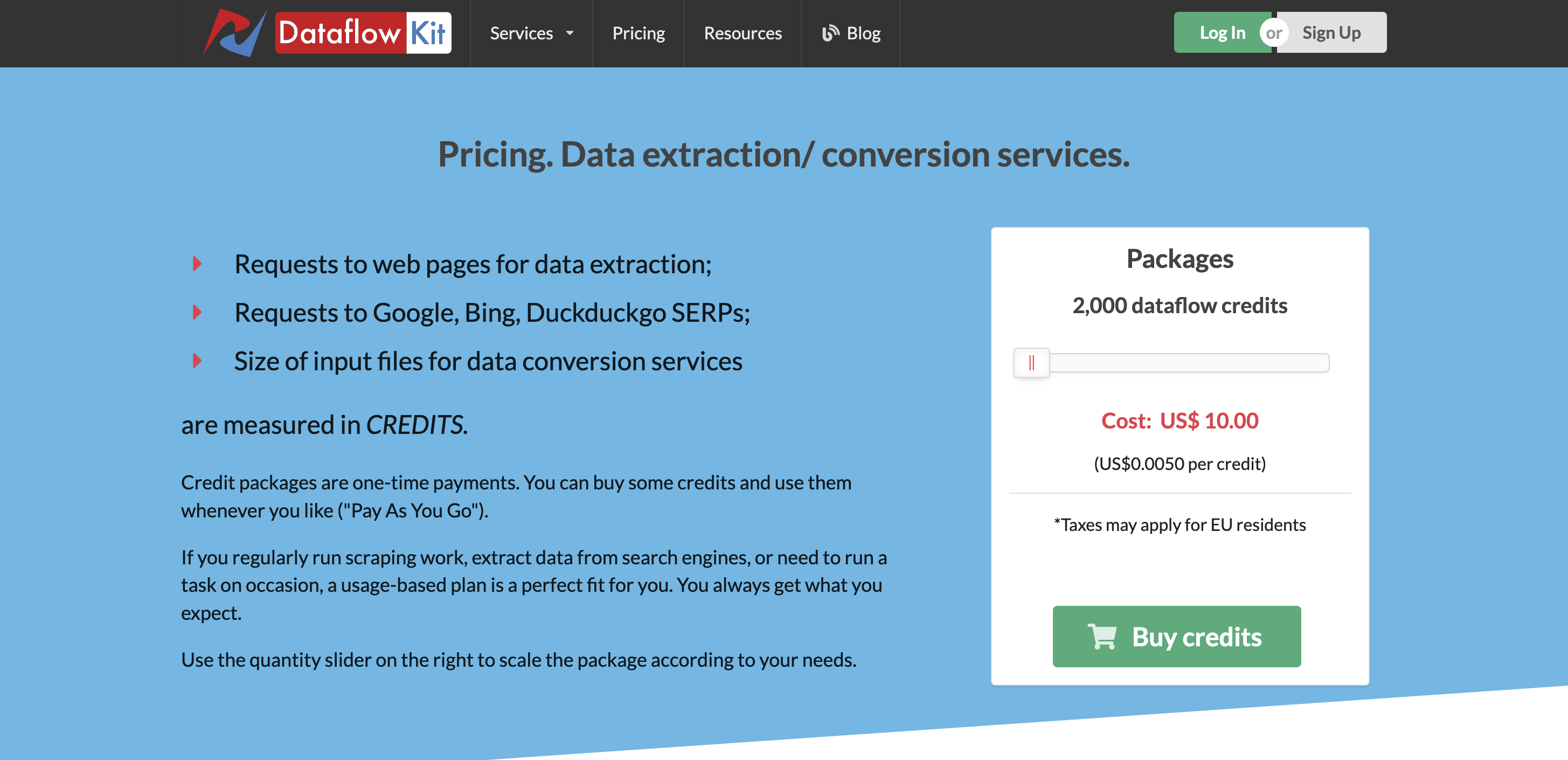

prezoj

La altvalora prezo komenciĝas de $10 por 2000 datumfluaj kreditoj, kiujn vi povas uzi laŭ viaj bezonoj.

9. import.io

Kun la helpo de la nub-bazita interreta skrapilo Import.io, uzantoj povas skrapi datumojn de retejoj sen ajna programada sperto. La simpleco de uzado estas unu el la plej allogaj funkcioj de Import.io; ĉio, kion vi devas fari, estas montri kaj klaki por trovi la datumojn, kiujn vi volas skrapi.

Uzantoj povas taksi ĉerpitajn datumojn en reala tempo pro ĝiaj potencaj bildigaj funkcioj. Import.io estas senkapa retumilo, kiu imitas retumilon kaj konektas al retejoj same kiel homo, sed sen la postulo de grafika uzantinterfaco.

Ĉi tio plibonigas la efikecon de skrapado de retejo kaj permesas al uzantoj skrapi datumojn de dinamikaj retejoj, kiuj postulas uzantan implikiĝon por montri informojn. Ĝia AI-funkciigita Ekstraktilo permesas al uzantoj ĉerpi datumojn per nur kelkaj klakoj. La Ekstraktilo ankaŭ povas identigi datumpadronojn kaj ĉerpi kompareblajn datumojn de multaj fontoj.

Uzantoj povas aŭtomatigi siajn skrapajn klopodojn kaj ricevi oftajn ĝisdatigojn pri la datumoj, kiujn ili volas, kun ĝiaj ampleksaj planaj funkcioj. Import.io faciligas uzi la ĉerpitajn datumojn en aliaj programoj ebligante vin ligi kun popularaj iloj kiel Google Sheets kaj Zapier.

prezoj

Prezoj ne estas listigitaj en la retejo, bonvolu paroli kun spertulo pri ĝi.

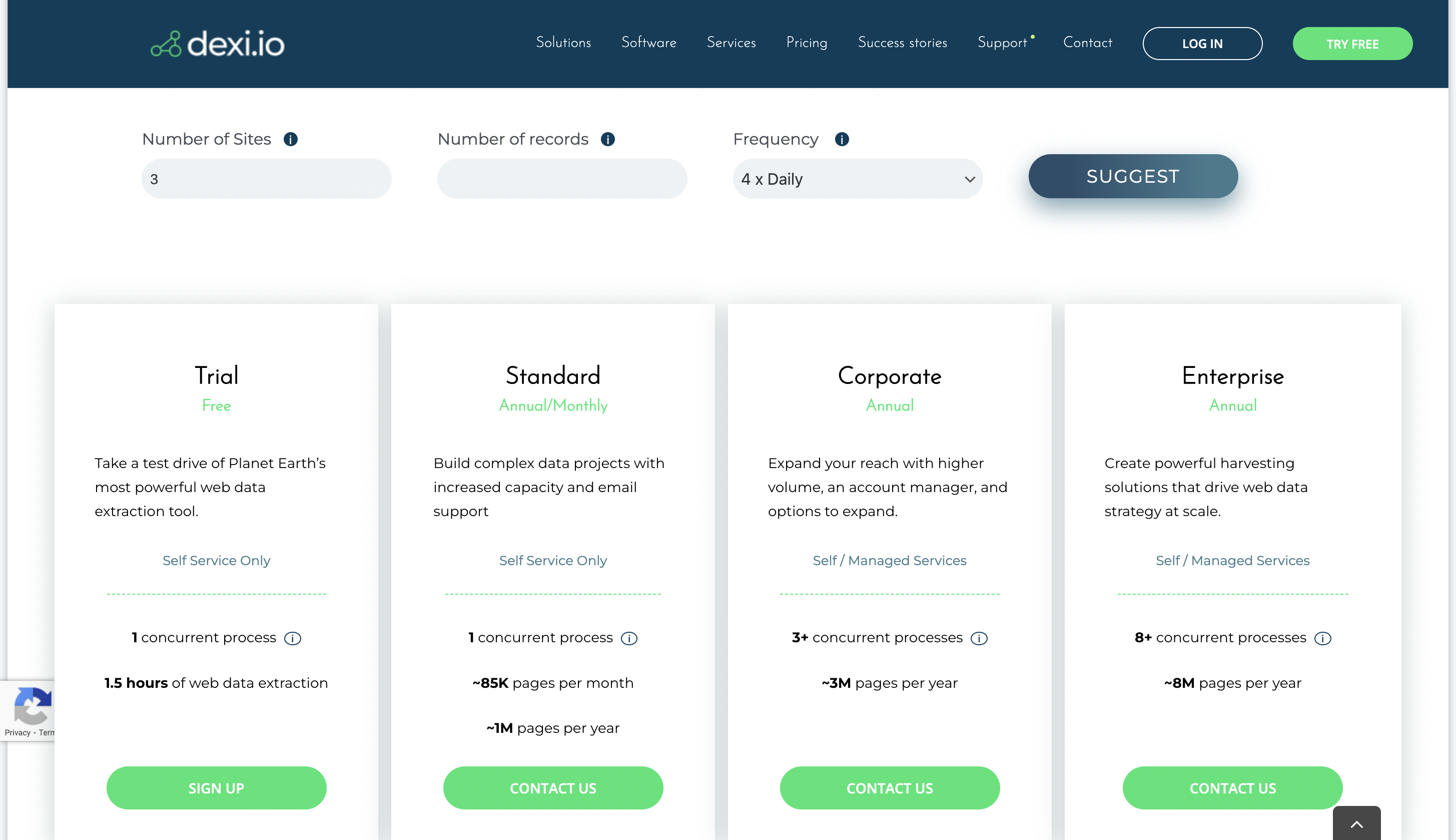

10. Dexi.io

Eltiro de datumoj estas simpla helpe de la fortika interreta skrapilo Dexi.io. Vi povas kolekti datumojn de retejoj uzante ĉi tiun ilon sen ajna koda sperto pro ĝia uzant-amika interfaco kaj aŭtomataj eblecoj.

Unu el ĝiaj plej bonaj trajtoj estas ĝia kapablo skrapi kaj kombini datumojn de multaj fontoj, inkluzive de retpaĝoj, APIoj kaj datumbazoj. Danke al la paralela prilabora kapablo de Dexi.io, vi povas rapide kaj efike skrapi amasajn volumojn da datumoj.

Dexi.io proponas al vi la elekton elekti la plej bonan alternativon por viaj skrapbezonoj ĉar ĝi funkcias kiel senkapa retumilo kaj kapplena retumilo. Dum la kapa retumila opcio permesas vin vidi kaj interagi kun la retejo kvazaŭ vi uzus tipan retumilon, la senkapa retumila opcio permesas vin skrapi datumojn sen montri la paĝon en retumilo.

Ĉi tio faciligas ripari iujn ajn skrapproblemojn kaj ĝustigi la skrapproceduron laŭ viaj preferoj. Vi povas rapide eksporti skrapitajn datumojn de Dexi.io en diversaj formatoj, kiel CSV, JSON kaj Excel, por plia analizo aŭ interagado kun aliaj aplikoj.

Aldone, ĝi provizas fidindan kaj sekuran nuban gastigadon por viaj skrapitaj datumoj, garantiante ĝian sekurecon kaj alireblecon.

prezoj

Vi povas provi la platformon kun ĝia senpaga prova plano kaj kontakti la teamon por ĝia prezo.

konkludo

Konklude, ekzistas pluraj interretaj skrapaj solvoj sur la merkato, ĉiu kun specifaj avantaĝoj kaj kapabloj. Estas multaj datumalternativoj por elekti, kiuj iras de tute-en-unu solvoj kiel Bright Data kaj ScrapingBee ĝis pli specialigitaj iloj kiel Apify kaj ParseHub.

Ĉi tiuj sistemoj ofte havas kapablojn kiel senkapa foliumado, IP-rotacio, uzant-agenta falsado kaj retumila fingrospurado por pliigi la efikecon, fidindecon kaj sekretecon de interreta skrapado.

Retaj skrapaj iloj povas doni al vi rapidan kaj simplan aliron al amaso da informoj, ĉu vi estas malgranda komerca posedanto provanta esplori viajn konkurantojn, esploristo serĉanta datumojn por subteni vian laboron, aŭ datuma analizisto serĉanta informojn pri konsumanta konduto. .

La ebleco de eraroj kaj nekonsekvencoj povas esti malpliigita dum vi povas eble ŝpari tempon kaj monon aŭtomatigante la datuman kolektan procezon.

Lasi Respondon