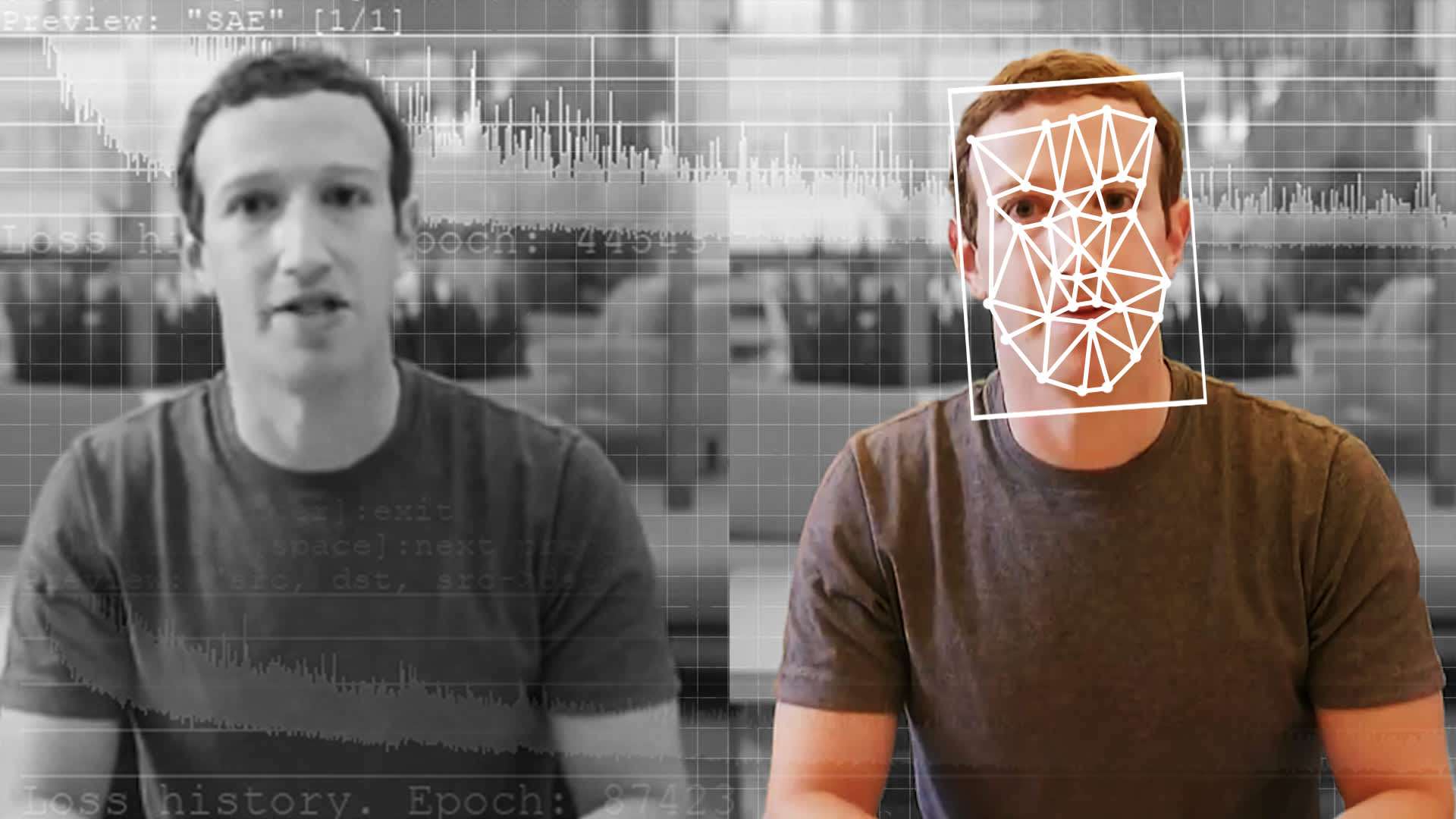

Βίντεο με τον Μαρκ Ζάκερμπεργκ να αναγνωρίζει την κλοπή δεδομένων και τον Μπαράκ Ομπάμα να καταχράται τον Ντόναλντ Τραμπ κυκλοφορούν στο διαδίκτυο εδώ και αρκετό καιρό;

Αυτά τα βίντεο είναι το αποτέλεσμα μιας πολύ προηγμένης και φουτουριστικής τεχνολογίας AI που ονομάζεται Deepfake.

Με απλά λόγια, είναι μια εναλλακτική λύση photoshop για βίντεο. Από τη μία πλευρά, μπορεί να φέρει επανάσταση στα ηλεκτρονικά μέσα εξαλείφοντας την ανάγκη για ένα πραγματικό πρόσωπο.

Από την άλλη πλευρά, απειλεί σοβαρά την ταυτότητα κάποιου καθώς μπορείς να κάνεις οποιονδήποτε να πει οτιδήποτε στο βίντεο.

Χρήση Deepfakes βαθιά μάθηση για τη δημιουργία φωτογραφιών και βίντεο από ψεύτικες εκδηλώσεις, εξ ου και το όνομα deepfake. Δεν μπορεί μόνο να ανταλλάξει πρόσωπα σε υπάρχοντα βίντεο αλλά και να δημιουργήσει νέα καρέ και βίντεο από την αρχή.

The Origin of Deepfakes

Εκτενής ακαδημαϊκή έρευνα έχει ξεπεράσει τα όρια της χειραγώγησης φωτογραφιών και βίντεο τα τελευταία χρόνια. Το Deepfake είναι επίσης το αποτέλεσμα αυτών των ακαδημαϊκών ερευνών.

Η πρώτη περίπτωση χειραγώγησης βίντεο αναφέρθηκε το 1997. Ένα βίντεο ενός ατόμου τροποποιήθηκε για να εκφωνεί τις λέξεις που περιέχονται σε ένα διαφορετικό ηχητικό κομμάτι. Ήταν η πρώτη περίπτωση χρήσης αναζωογόνησης προσώπου μάθηση μηχανής τεχνικές.

Περαιτέρω αξιοσημείωτη πρόοδος έγινε το 2017 όταν ένα βίντεο του πρώην προέδρου των ΗΠΑ Μπαράκ Ομπάμα τροποποιήθηκε ώστε να λέει διαφορετικές λέξεις που ταιριάζουν με ένα διαφορετικό ηχητικό κομμάτι.

Το 2018, ερευνητές στο Πανεπιστήμιο της Καλιφόρνια στο Μπέρκλεϋ παρουσίασαν μια εφαρμογή που θα μπορούσε να δημιουργήσει ένα ψεύτικο βίντεο χορού χρησιμοποιώντας βαθιά μάθηση. Αυτό σηματοδότησε την επέκταση των deepfakes σε ολόκληρο το σώμα καθώς τα προηγούμενα έργα περιορίζονταν σε πρόσωπα.

Πώς δημιουργούνται τα Deepfakes;

Χάρη στις εξελίξεις στον τομέα των υπολογιστών, μπορείτε πλέον να αναπτύξετε deepfakes σχετικά εύκολα και με χαμηλό κόστος. Δύο κύριες μέθοδοι χρησιμοποιούνται για τη δημιουργία deepfakes.

Μέθοδος 1

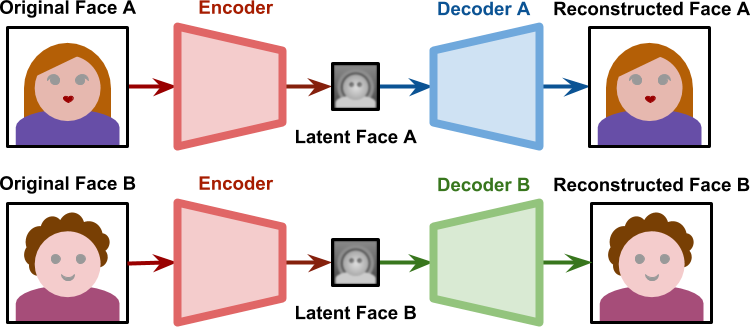

Θα πρέπει να εκπαιδεύσετε α νευρικό σύστημα σε πραγματικό βίντεο του ατόμου. Αυτό θα επιτρέψει την νευρικό σύστημα να κατανοήσουν τα χαρακτηριστικά του προσώπου του θέματος σε διαφορετικές γωνίες και συνθήκες φωτισμού.

Μετά από αυτό, θα επεξεργαστείτε τόσο το αρχικό πρόσωπο όσο και το λανθάνον πρόσωπο μέσω ενός αλγόριθμου AI που ονομάζεται κωδικοποιητής. Θα βρει και θα μάθει τις διαφορές και τις ομοιότητες μεταξύ των δύο προσώπων και τα δύο πρόσωπα περιορίζονται σε μια συμπιεσμένη εικόνα που μοιράζεται τα κοινά χαρακτηριστικά.

Στη συνέχεια έρχεται ο δεύτερος αλγόριθμος AI που ονομάζεται αποκωδικοποιητής, ο οποίος ανακτά πρόσωπα από συμπιεσμένες εικόνες. Και οι δύο όψεις ανακτώνται από δύο διαφορετικούς αποκωδικοποιητές.

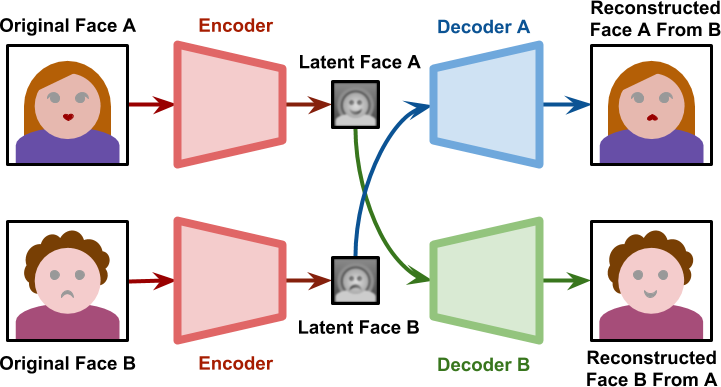

Για να εκτελέσετε την εναλλαγή προσώπου, απλώς τροφοδοτείτε τις κωδικοποιημένες εικόνες στον άλλο αποκωδικοποιητή.

Για παράδειγμα, μια έξοδος κωδικοποιητή του προσώπου Α τροφοδοτείται στον αποκωδικοποιητή που έχει εκπαιδευτεί στο πρόσωπο Β, ο οποίος στη συνέχεια αναδομεί το πρόσωπο Β με τα χαρακτηριστικά του προσώπου Α. Θα πρέπει να το κάνετε αυτό σε κάθε καρέ του βίντεο για μια πειστική έξοδο.

Μέθοδος 2

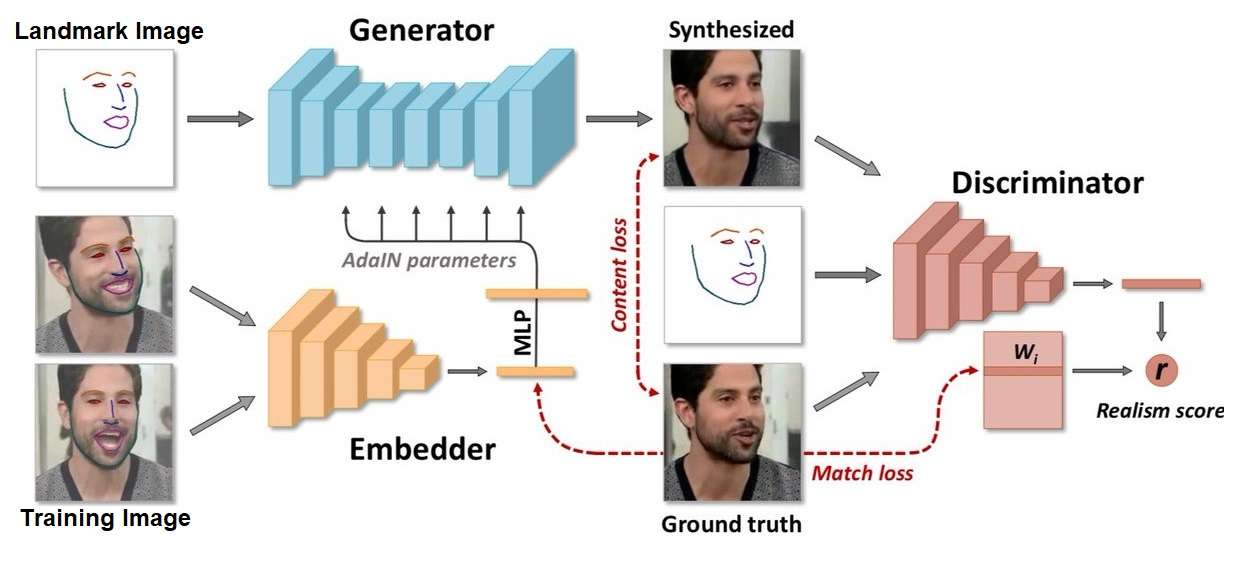

Μια άλλη μέθοδος δημιουργίας deepfakes είναι το Generative Adversarial Network (GAN).

Θα πρέπει να χρησιμοποιήσετε δύο ανταγωνιστικούς αλγόριθμους για να δημιουργήσετε deepfakes. Το πρώτο θα χρησιμοποιήσει τυχαίο θόρυβο για να δημιουργήσει μια εικόνα και ως εκ τούτου ονομάζεται γεννήτρια. Αυτή η συνθετική εικόνα τροφοδοτείται σε μια ροή πραγματικών εικόνων μέσω ενός δεύτερου αλγόριθμου που ονομάζεται διαχωριστής.

Ο διαχωριστής παρέχει ανατροφοδότηση στη γεννήτρια η οποία δημιουργεί μια άλλη εικόνα σύμφωνα με την ανάδραση. Με αυτόν τον τρόπο, και οι δύο αλγόριθμοι δίνουν βελτιωμένα αποτελέσματα με κάθε επανάληψη. Αυτή η διαδικασία επαναλαμβάνεται πολλές φορές μέχρι να επιτευχθεί το απαιτούμενο επίπεδο ακρίβειας.

Το GAN προσφέρει απόλυτα ρεαλιστικά αποτελέσματα, αλλά είναι δύσκολο να το δουλέψεις και απαιτεί τεράστιο όγκο δεδομένων εκπαίδευσης και υπολογιστική ισχύ. Γι' αυτό γενικά προτιμάται για τη δημιουργία εικόνων παρά για βίντεο κλιπ.

Μερικά πειστικά παραδείγματα Deepfakes

Υπάρχουν μερικά πολύ πειστικά deepfakes που περιστρέφονται γύρω από το διαδίκτυο και τα περισσότερα από αυτά είναι διασημοτήτων.

Για παράδειγμα, υπάρχει ένας λογαριασμός TikTok αποκλειστικά αφιερωμένος στα deepfakes του Tom Cruise. Τα βίντεο δείχνουν την κρουαζιέρα να κάνει γκολφ ή να επιδεικνύει ένα μαγικό κόλπο.

@deeptomcruise Ταξίδι! ????

Ένα άλλο εξαιρετικά περίπλοκο deepfake ανέβηκε στο YouTube με τους Tom Cruise, Robert Downey Jr., Jeff Goldblum, George Lucas και Ewan McGregor. Έχει κάποια προφανή ελαττώματα, αλλά η ταυτόχρονη επεξεργασία 3 έως 4 deepfakes σε ένα βίντεο είναι από μόνο του ένα κατόρθωμα.

Ένα άλλο παράδειγμα είναι ένα deepfake βίντεο του πρώην προέδρου Μπαράκ Ομπάμα.

Αυτό είναι εκπληκτικά πειστικό καθώς χρησιμοποιεί τις φωνές και τις χειρονομίες μιμητών ικανών να μιμηθούν τις φωνές και τις χειρονομίες του θέματος.

Βλέπουμε πλέον deepfakes στη σύγχρονη mainstream βιομηχανία ψυχαγωγίας.

Χρησιμοποιήθηκε για τη λήψη σκηνών του Paul Walker στο Fast and Furious 7 μετά τον απροσδόκητο θάνατο του ηθοποιού. Το deepfake χρησιμοποιήθηκε στον αδερφό του με αξιοσημείωτη ακρίβεια.

Τι φέρνουν τα Deepfakes στο τραπέζι;

Τα Deepfakes έχουν αποδειχθεί μια πολύ αξιόπιστη τεχνολογία που φέρνει επανάσταση στα μέσα και την ψυχαγωγία.

Θυμάστε πότε το μουστάκι του Henry Cavill αφαιρέθηκε από το CGI στο "Man of Steel" και έγινε καταστροφή;

Το ίδιο μπορεί να γίνει τώρα σε υπολογιστές μερικών χιλιάδων δολαρίων με πολύ πιο πειστικά αποτελέσματα.

Τώρα μπορείτε να συναντήσετε τους νεκρούς προγόνους και τους αγαπημένους σας. Μπορείτε ακόμη και να παρακολουθήσετε μια διάλεξη Φυσικής από τον ίδιο τον Άλμπερτ Αϊνστάιν.

Εκτός από όλα αυτά, το deepfake δεν έχει χρησιμοποιηθεί εξ ολοκλήρου με τον τρόπο που προοριζόταν να γίνει. Περίπου το 96% των deepfakes στο διαδίκτυο είναι μη συναινετική πορνογραφία.

Ο μεγάλος αριθμός δεδομένων εκπαίδευσης που είναι διαθέσιμος για διασημότητες έχει ως αποτέλεσμα να είναι τα πιο στοχευμένα θύματα των deepfakes.

Μας έδωσε τη δυνατότητα να βάλουμε οποιονδήποτε σε επικίνδυνα ή συμβιβαστικά σενάρια και ως εκ τούτου αποτελεί μεγάλο κίνδυνο για όλους.

Έχει αναφερθεί ότι χρησιμοποιούνται για απάτη εταιρειών. Το 2019, ένας μιμητής χρησιμοποίησε βαθύ ψεύτικο ήχο για να δώσει εντολή σε έναν διευθύνοντα σύμβουλο εταιρείας με έδρα το Ηνωμένο Βασίλειο να μεταφέρει 220,000 ευρώ σε μια ουγγρική τράπεζα, υποδυόμενος το στέλεχος της μητρικής εταιρείας της εταιρείας.

Πώς να αντιμετωπίσετε τα κακόβουλα Deepfakes;

Κανονικά, μπορείτε να εντοπίσετε βαθιά ψεύτικα βίντεο παρατηρώντας προσεκτικά καρέ προς καρέ και αναζητώντας αντικείμενα και παρατυπίες.

Ωστόσο, είναι μια αντίθετη διαισθητική διαδικασία και πολλές εταιρείες εργάζονται σε αλγόριθμους και λογισμικό ανίχνευση deepfakes.

Το Facebook στρατολόγησε ερευνητές από το Μπέρκλεϋ, την Οξφόρδη και άλλα ιδρύματα για να κατασκευάσουν έναν ανιχνευτή ψεύτικο. Ομοίως, το YouTube ανακοίνωσε ότι δεν θα δεχτεί deepfake βίντεο που σχετίζονται με τις εκλογές στις ΗΠΑ, τις διαδικασίες ψηφοφορίας ή την απογραφή του 2020 στις ΗΠΑ.

Μπορείτε επίσης να χρησιμοποιήσετε προγράμματα όπως Υπερασπιστής της πραγματικότητας και Deeptrace για τον εντοπισμό deepfakes.

Οι χώρες είναι επίσης απασχολημένες με τη νομοθεσία σχετικά με τη χρήση των deepfakes γενικά. Οι ΗΠΑ έχουν εφαρμόσει αρκετούς νόμους σχετικά με τα deepfakes τον περασμένο χρόνο.

Τύλιξε

Το Deepfake είναι η ζωντανή ενσάρκωση της εξέλιξης του AI. Θολώνει περαιτέρω τα όρια του μέλλοντος, ωστόσο, αποτελεί πιθανή απειλή για την αξιοπιστία του περιεχομένου βίντεο-γραφικών στο διαδίκτυο.

Θα έρθει μια στιγμή που οι άνθρωποι θα αρχίσουν να αμφιβάλλουν για κάθε βίντεο στο διαδίκτυο και θα οδηγηθούμε σε μια εποχή περαιτέρω αβεβαιότητας.

Αφήστε μια απάντηση