Inhaltsverzeichnis[Ausblenden][Zeigen]

Vektordatenbanken stellen einen bedeutenden Wandel in der Art und Weise dar, wie wir Daten verwalten und interpretieren, insbesondere in den Bereichen künstliche Intelligenz und maschinelles Lernen.

Die grundlegende Funktion dieser Datenbanken besteht darin, hochdimensionale Vektoren effektiv zu verarbeiten, die das Rohmaterial von Modellen für maschinelles Lernen sind und die Umwandlung von Text-, Bild- oder Audioeingaben in numerische Darstellungen im mehrdimensionalen Raum umfassen.

Für Anwendungen wie Empfehlungssysteme, Objekterkennung, Bildabruf und Betrugserkennung ist diese Transformation mehr als nur Speicherung; Es ist ein Tor zu leistungsstarken Funktionen bei der Ähnlichkeitssuche und der Suche nach dem nächsten Nachbarn.

Genauer gesagt liegt die Leistungsfähigkeit von Vektordatenbanken in ihrer Fähigkeit, große Mengen unstrukturierter, komplizierter Daten in Vektoren zu übersetzen, die den Kontext und die Bedeutung des ursprünglichen Inhalts erfassen.

Zu den erweiterten Suchfunktionen, die durch die Einbettung von Modellen in diese Kodierung ermöglicht werden, gehört die Möglichkeit, umgebende Vektoren abzufragen, um verwandte Bilder oder Phrasen zu finden.

Vektordatenbanken sind insofern einzigartig, als sie auf fortschrittlichen Indexierungstechniken wie Inverted File Index (IVF) und Hierarchical Navigable Small World (HNSW) basieren, was ihre Geschwindigkeit und Effizienz verbessert und gleichzeitig die nächsten Nachbarn in N-dimensionalen Räumen lokalisiert.

Es gibt einen klaren Unterschied zwischen Vektor- und klassischen Datenbanken. Herkömmliche Datenbanken eignen sich hervorragend zum Organisieren von Daten in organisierten Mengen, die CRUD-optimiert sind und Mengenschemata einhalten.

Wenn man jedoch mit der dynamischen und komplizierten Natur hochdimensionaler Daten umgeht, wird diese Starrheit allmählich zu einem Hindernis.

Im Gegensatz dazu bieten Vektordatenbanken ein Maß an Flexibilität und Effizienz, das herkömmliche Äquivalente nicht erreichen können, insbesondere für Anwendungen, die stark darauf angewiesen sind Maschinelles Lernen und künstliche Intelligenz. Sie sind nicht nur skalierbar und beherrschen die Ähnlichkeitssuche.

Vektordatenbanken sind besonders nützlich für generative KI-Anwendungen. Um sicherzustellen, dass das erstellte Material seine kontextuelle Integrität behält, sind diese Anwendungen – zu denen die Verarbeitung natürlicher Sprache und die Bilderzeugung gehören – auf das schnelle Abrufen und Vergleichen von Einbettungen angewiesen.

In diesem Artikel werden wir uns die besten Vektordatenbanken für Ihr nächstes Projekt ansehen.

1. Milvus

Milvus ist eine bahnbrechende Open-Source-Vektordatenbank, die hauptsächlich für KI-Anwendungen entwickelt wurde, einschließlich eingebetteter Ähnlichkeitssuchen und leistungsstarker MLOps.

Es unterscheidet sich von herkömmlichen relationalen Datenbanken, die meist Folgendes verarbeiten strukturierte Daten, aufgrund dieser Kapazität, die es ihm ermöglicht, Vektoren in einem beispiellosen Billionenmaßstab zu indizieren.

Das Engagement von Milvus für Skalierbarkeit und Hochverfügbarkeit zeigt sich in der Art und Weise, wie es sich von der ersten Version zum vollständig verteilten, cloudnativen Milvus 2.0 entwickelt hat.

Insbesondere weist Milvus 2.0 ein vollständig Cloud-natives Design auf, das eine erstaunliche Verfügbarkeit von 99.9 % anstrebt und gleichzeitig über Hunderte von Knoten skaliert werden kann.

Für diejenigen, die eine zuverlässige Vektordatenbanklösung suchen, ist diese Edition sehr zu empfehlen, da sie nicht nur anspruchsvolle Funktionen wie eine Multi-Cloud-Verbindung und ein Verwaltungspanel hinzufügt, sondern auch die Datenkonsistenz für eine flexible Anwendungsentwicklung verbessert.

Ein bemerkenswerter Vorteil von Milvus ist sein Community-orientierter Ansatz, der mehrsprachige Unterstützung und eine umfangreiche, auf die Anforderungen von Entwicklern zugeschnittene Toolchain bietet.

Im IT-Sektor ist es aufgrund seiner Cloud-Skalierbarkeit und Zuverlässigkeit sowie seiner leistungsstarken Vektorsuchfunktionen für große Datenmengen eine beliebte Option.

Darüber hinaus steigert es die Effizienz seiner Abläufe durch eine hybride Suchfunktion, die Vektorähnlichkeitssuche mit Skalarfilterung verbindet.

Milvus hat ein Verwaltungsgremium mit einer klaren Kontrolle Benutzerschnittstelle, einen vollständigen Satz an APIs und eine skalierbare und anpassbare Architektur.

Die Kommunikation mit externen Anwendungen wird durch die Zugriffsschicht erleichtert, während Lastausgleich und Datenverwaltung durch den Koordinatordienst koordiniert werden, der als zentraler Befehl dient.

Die Beständigkeit der Datenbank wird durch die Objektspeicherschicht unterstützt, während Worker-Knoten Aktivitäten ausführen, um die Skalierbarkeit sicherzustellen.

AnzeigenPreise

Die Nutzung ist für alle kostenlos.

2. FAISS

Das AI-Forschungsteam von Facebook hat eine hochmoderne Bibliothek namens Facebook AI Similarity Search entwickelt, die darauf ausgelegt ist, dichtes Vektor-Clustering und Ähnlichkeitssuche effektiver zu machen.

Seine Entwicklung wurde durch die Anforderung vorangetrieben, die Ähnlichkeitssuchfunktionen von Facebook AI durch den Einsatz modernster grundlegender Methoden zu verbessern.

Im Vergleich zu CPU-basierten Implementierungen kann die hochmoderne GPU-Implementierung von FAISS die Suchzeiten um das Fünf- bis Zehnfache beschleunigen, was sie zu einem unschätzbar wertvollen Werkzeug für eine Vielzahl von Anwendungen macht, einschließlich Empfehlungssystemen und der Identifizierung ähnlicher Bedeutungen in großen Mengen unstrukturierte Datensätze wie Text, Audio und Video.

FAISS kann eine breite Palette von Ähnlichkeitsmetriken verarbeiten, wie z. B. Kosinusähnlichkeit, inneres Produkt und die häufig verwendete L2-Metrik (euklidische Distanz).

Diese Messungen erleichtern die Durchführung präziser und flexibler Ähnlichkeitssuchen für verschiedene Datenarten. Funktionen wie Stapelverarbeitung, Präzisions-Geschwindigkeits-Kompromisse und die Unterstützung sowohl präziser als auch ungefährer Suchen erhöhen die Flexibilität zusätzlich.

Darüber hinaus bietet FAISS eine skalierbare Methode zur Verarbeitung großer Datenmengen, indem es die Speicherung von Indizes auf der Festplatte ermöglicht.

Die invertierte Datei, die Produktquantisierung (PQ) und die verbesserte PQ sind nur einige der innovativen Techniken, die die Forschungsgrundlage von FAISS bilden und zu seiner Wirksamkeit bei der Indizierung und Suche hochdimensionaler Vektorfelder beitragen.

Diese Strategien werden durch modernste Ansätze wie GPU-beschleunigte K-Auswahlalgorithmen und Vorfilterung von PQ-Abständen verstärkt, was die Fähigkeit von FAISS gewährleistet, selbst in milliardenschweren Datensätzen schnelle und präzise Suchergebnisse zu liefern.

AnzeigenPreise

Die Nutzung ist für alle kostenlos.

3. Tannenzapfen

Pinecone ist ein führender Anbieter von Vektordatenbanken und bietet einen cloudnativen, verwalteten Dienst, der speziell darauf ausgelegt ist, die Leistung leistungsstarker KI-Anwendungen zu verbessern.

Es wurde speziell für die Verarbeitung von Vektoreinbettungen entwickelt, die für generative KI, semantische Suche und Anwendungen mit umfangreichen Sprachmodellen unerlässlich sind.

Dank dieser Einbettungen kann die KI nun semantische Informationen verstehen, die effektiv als Langzeitgedächtnis für komplizierte Aufgaben fungieren.

Pinecone ist insofern einzigartig, als es die Funktionen traditioneller Datenbanken nahtlos mit der verbesserten Leistung von Vektorindizes integriert und so die effiziente und umfangreiche Speicherung und Abfrage von Einbettungen ermöglicht.

Dies macht es zur perfekten Option in Situationen, in denen die Komplexität und das Volumen der beteiligten Daten Standarddatenbanken auf Skalarbasis ungeeignet machen.

Pinecone bietet Entwicklern aufgrund seines Managed-Service-Ansatzes eine problemlose Lösung, die die Integration und Datenerfassung in Echtzeit optimiert.

Es unterstützt zahlreiche Datenoperationen, darunter das Abrufen, Aktualisieren, Löschen, Abfragen und Einfügen von Daten.

Pinecone garantiert außerdem, dass Abfragen, die Echtzeitänderungen wie Upserts und Löschungen darstellen, korrekte Antworten mit geringer Latenz für Indizes mit Milliarden von Vektoren liefern.

In dynamischen Situationen ist diese Funktion wichtig, um die Relevanz und Aktualität der Abfrageergebnisse zu bewahren.

Darüber hinaus erhöht die Partnerschaft von Pinecone mit Airbyte über die Pinecone-Verbindung die Vielseitigkeit und Flexibilität des Unternehmens und ermöglicht eine reibungslose Datenintegration aus verschiedenen Quellen.

Durch diese Beziehung können Kosten und Effizienz optimiert werden, indem sichergestellt wird, dass nur neu erfasste Informationen durch inkrementelle Datensynchronisierung verarbeitet werden.

Das Design des Steckverbinders legt Wert auf Einfachheit, erfordert nur minimale Einrichtungsparameter und ist erweiterbar, sodass zukünftige Verbesserungen möglich sind.

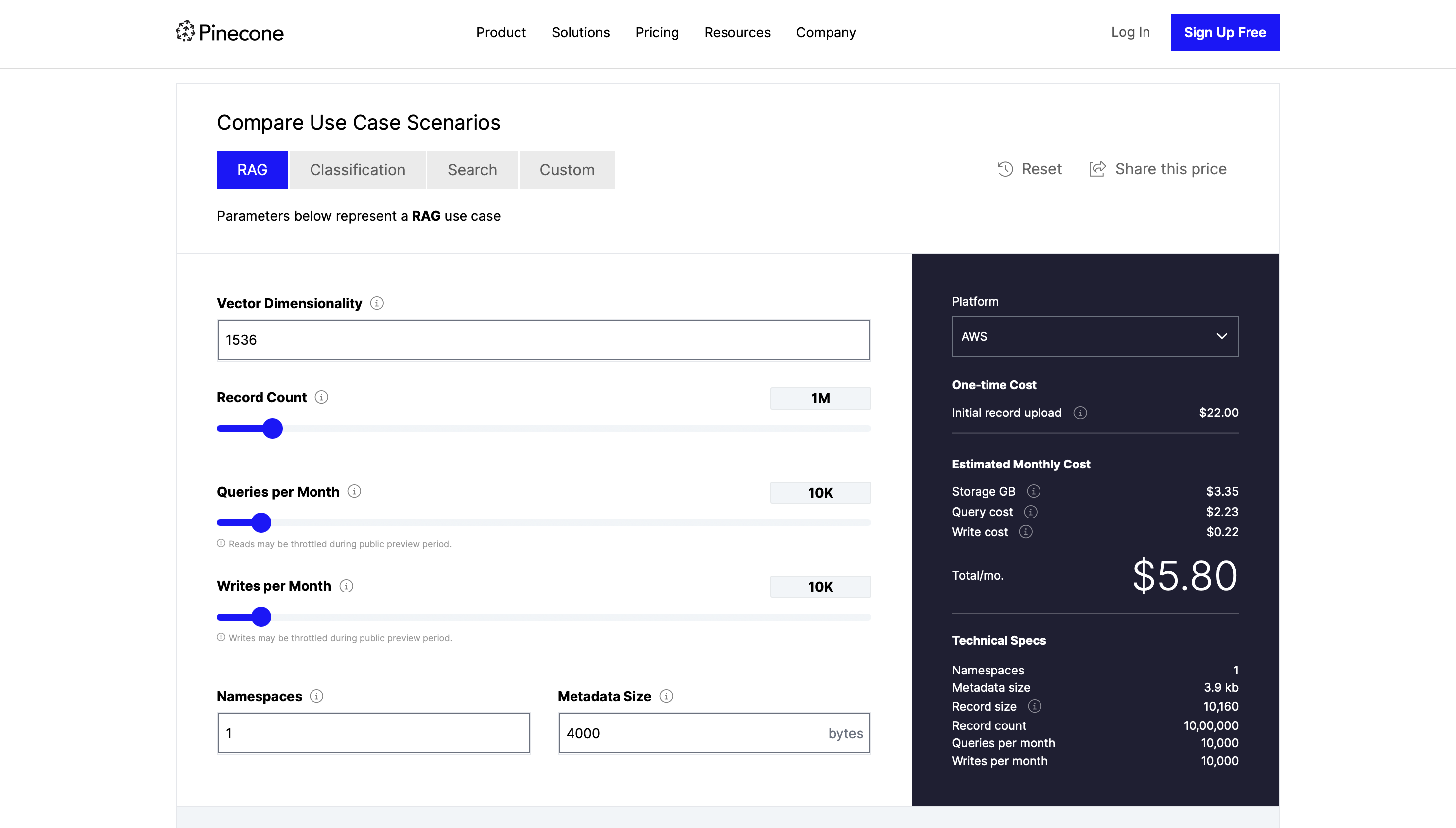

AnzeigenPreise

Der Premium-Preis beginnt bei 5.80 $/Monat für den RAG-Anwendungsfall.

4. Weben

Weaviate ist eine innovative Vektordatenbank, die als Open-Source-Software verfügbar ist und die Art und Weise verändert, wie wir auf Daten zugreifen und sie nutzen.

Weaviate nutzt Vektorsuchfunktionen, die im Gegensatz zu typischen Datenbanken, die auf Skalarwerten und vordefinierten Abfragen basieren, anspruchsvolle, kontextbezogene Suchvorgänge in großen, komplizierten Datensätzen ermöglichen.

Mit dieser Methode können Sie Inhalte anhand ihrer Ähnlichkeit mit anderen Inhalten finden, was die Intuitivität der Suche und die Relevanz der Ergebnisse verbessert.

Die reibungslose Integration in Modelle des maschinellen Lernens ist eines seiner Hauptmerkmale. Dadurch kann es mehr als nur eine Datenspeicherlösung sein. Es ermöglicht auch, Daten mithilfe künstlicher Intelligenz zu verstehen und zu analysieren.

Die Architektur von Weaviate berücksichtigt diese Integration umfassend und ermöglicht die Analyse komplexer Daten ohne den Einsatz zusätzlicher Tools.

Die Unterstützung von Diagrammdatenmodellen bietet außerdem eine andere Sichtweise auf Daten als verknüpfte Einheiten und deckt Muster und Erkenntnisse auf, die in herkömmlichen Datenbankarchitekturen möglicherweise übersehen werden.

Aufgrund der modularen Architektur von Weaviate können Kunden bei Bedarf Funktionen wie Datenvektorisierung und Backup-Erstellung hinzufügen.

Die Grundversion fungiert als Vektordaten-Spezialistendatenbank und kann mit anderen Modulen erweitert werden, um unterschiedlichen Anforderungen gerecht zu werden.

Seine Skalierbarkeit wird durch seinen modularen Aufbau weiter verbessert, der garantiert, dass bei steigenden Datenmengen und Abfrageanforderungen keine Geschwindigkeitseinbußen eintreten.

Durch die Unterstützung der Datenbank sowohl für RESTful- als auch GraphQL-APIs wird eine vielseitige und effektive Methode zur Interaktion mit den gespeicherten Daten ermöglicht.

GraphQL wird insbesondere aufgrund seiner Fähigkeit ausgewählt, komplexe, diagrammbasierte Abfragen schnell durchzuführen und es Benutzern zu ermöglichen, genau die Daten zu erhalten, die sie benötigen, ohne übermäßige oder unzureichende Datenmengen zu erhalten.

Dank seiner flexiblen API ist Weaviate in einer Vielzahl von Client-Bibliotheken und Programmiersprachen benutzerfreundlicher.

Für diejenigen, die Weaviate weiter erkunden möchten, steht eine Fülle von Dokumentationen und Tutorials zur Verfügung, von der Einrichtung und Konfiguration Ihrer Instanz bis hin zu detaillierten Einblicken in ihre Funktionen wie Vektorsuche, Integration maschinellen Lernens und Schemadesign.

Sie können auf dieselbe leistungsstarke Technologie zugreifen, die Informationen dynamisch und umsetzbar macht, unabhängig davon, ob Sie sich für den lokalen Betrieb von Weaviate entscheiden Cloud Computing Umgebung oder über den verwalteten Cloud-Service Weaviate.

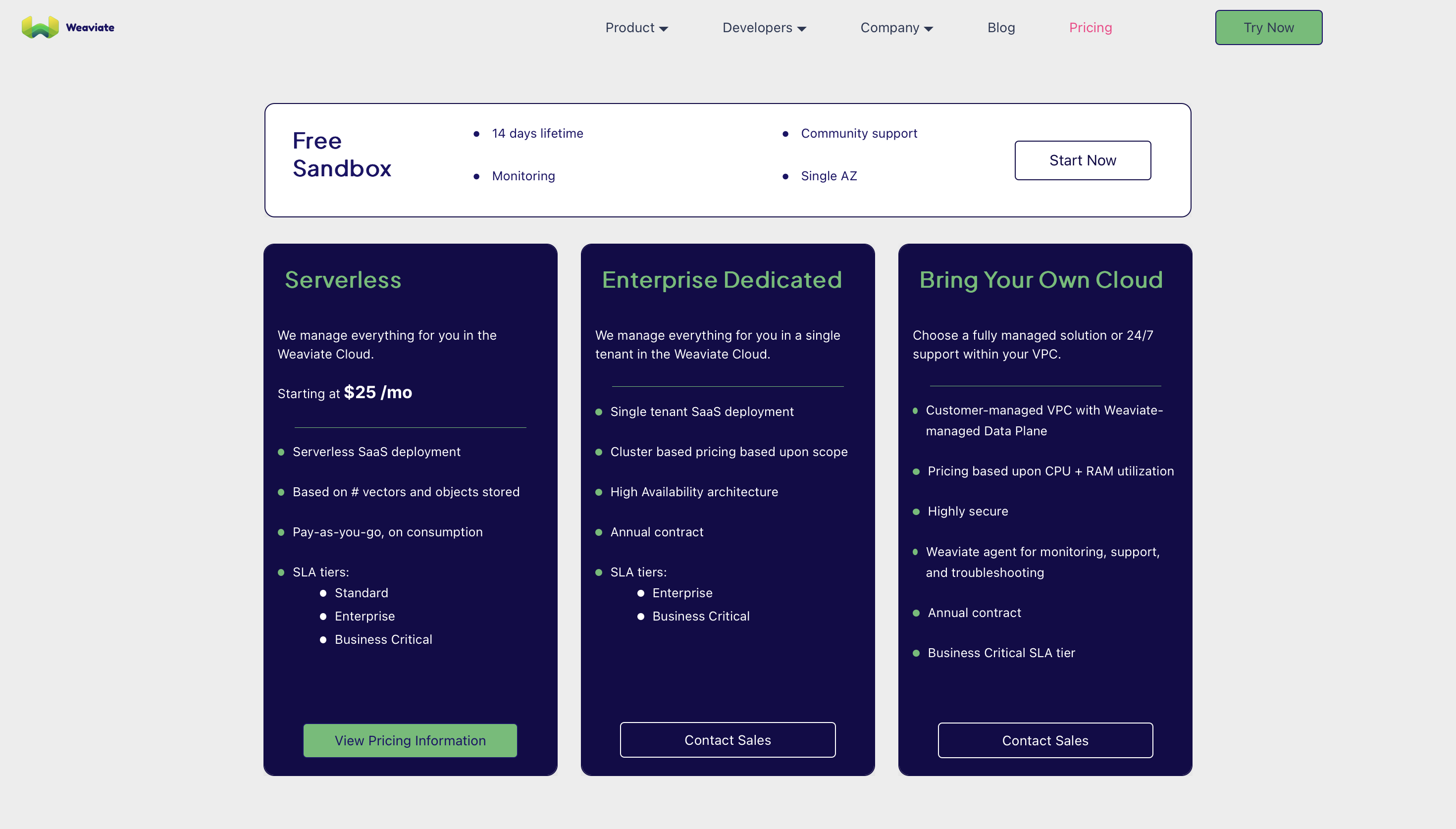

AnzeigenPreise

Der Premium-Preis der Plattform beginnt bei 25 $/Monat für Serverless.

5. Chroma

Chroma ist eine hochmoderne Vektordatenbank, die das Abrufen und Speichern von Daten revolutionieren soll, insbesondere für Anwendungen mit maschinellem Lernen und künstlicher Intelligenz.

Da Chroma im Gegensatz zu Standarddatenbanken mit Vektoren statt mit Skalarzahlen arbeitet, eignet es sich sehr gut für die Verwaltung hochdimensionaler, komplizierter Daten.

Dies ist ein großer Fortschritt in der Datenabruftechnologie, da es anspruchsvollere Suchvorgänge ermöglicht, die auf der semantischen Ähnlichkeit des Materials basieren und nicht auf präzisen Schlüsselwortübereinstimmungen.

Ein bemerkenswertes Merkmal von Chroma ist die Fähigkeit, mit mehreren zugrunde liegenden Speicherlösungen wie ClickHouse für skalierte Einstellungen und DuckDB für eigenständige Installationen zu arbeiten, was Flexibilität und Anpassung an verschiedene Anwendungsfälle garantiert.

Chroma wurde mit Blick auf Einfachheit, Geschwindigkeit und Analyse entwickelt. Es steht einem breiten Spektrum von Entwicklern mit SDKs für Python und JavaScript/TypeScript zur Verfügung.

Darüber hinaus legt Chroma großen Wert auf Benutzerfreundlichkeit, sodass Entwickler schnell eine permanente, von DuckDB unterstützte Datenbank oder eine In-Memory-Datenbank zum Testen einrichten können.

Die Möglichkeit, Sammlungsobjekte zu erstellen, die Tabellen in herkömmlichen Datenbanken ähneln, in die Textdaten eingefügt und mithilfe von Modellen wie All-MiniLM-L6-v2 automatisch in Einbettungen umgewandelt werden können, erhöht diese Vielseitigkeit weiter.

Text und Einbettungen können nahtlos integriert werden, was für Anwendungen, die die Datensemantik verstehen müssen, unerlässlich ist.

Die Grundlage der Vektorähnlichkeitsmethode von Chroma sind die mathematischen Konzepte der Orthogonalität und Dichte, die für das Verständnis der Darstellung und des Vergleichs von Daten in Datenbanken unerlässlich sind.

Diese Ideen ermöglichen es Chroma, sinnvolle und effiziente Ähnlichkeitssuchen durchzuführen, indem die semantischen Verknüpfungen zwischen Datenelementen berücksichtigt werden.

Ressourcen wie Tutorials und Richtlinien stehen Personen zur Verfügung, die Chroma weiter erkunden möchten. Sie enthalten eine Schritt-für-Schritt-Anleitung zum Einrichten der Datenbank, zum Erstellen von Sammlungen und zum Durchführen von Ähnlichkeitssuchen.

AnzeigenPreise

Sie können es kostenlos nutzen.

6. Vespa

Vespa ist eine Plattform, die den Online-Umgang mit KI und großen Datenmengen verändert.

Der grundlegende Zweck von Vespa besteht darin, Berechnungen mit geringer Latenz über große Datensätze hinweg zu ermöglichen, sodass Sie Text-, Vektor- und strukturierte Daten einfach speichern, indizieren und analysieren können.

Vespa zeichnet sich durch seine Fähigkeit aus, schnelle Antworten in jedem Maßstab zu liefern, unabhängig von der Art der zu bearbeitenden Fragen, Auswahlmöglichkeiten oder maschinell erlernten Modellschlussfolgerungen.

Die Flexibilität von Vespa zeigt sich in seiner voll funktionsfähigen Suchmaschine und Vektordatenbank, die viele Suchvorgänge innerhalb einer einzigen Abfrage ermöglichen, die von Vektordaten (ANN) über lexikalische bis hin zu strukturierten Daten reichen.

Unabhängig vom Umfang können Sie dank dieser Integration maschinell erlernter Modellinferenz mit Ihren Daten benutzerfreundliche und reaktionsfähige Such-Apps mit Echtzeit-KI-Funktionen erstellen.

Bei Vespa geht es jedoch um mehr als nur das Suchen; Es geht auch darum, Begegnungen zu verstehen und individuell zu gestalten.

Erstklassige Anpassungs- und Vorschlagstools bieten dynamische, aktuelle Empfehlungen, die auf bestimmte Benutzer oder Umstände zugeschnitten sind.

Vespa ist auch für alle, die in den Bereich der Konversations-KI einsteigen möchten, von entscheidender Bedeutung, da es die erforderliche Infrastruktur zum Speichern und Erkunden von Text- und Vektordaten in Echtzeit bietet und so die Entwicklung fortschrittlicherer und praktischerer KI-Agenten ermöglicht.

Mit umfassender Tokenisierung und Stemming werden Volltextsuchen, Suchen nach nächsten Nachbarn und strukturierte Datenabfragen durch die umfangreichen Abfragefunktionen der Plattform unterstützt.

Der Unterschied besteht darin, dass komplizierte Abfragen durch die Kombination mehrerer Suchdimensionen effektiv bearbeitet werden können.

Vespa ist ein Rechenkraftwerk für KI- und maschinelle Lernanwendungen, da seine Rechenmaschine komplexe mathematische Ausdrücke über Skalare und Tensoren verarbeiten kann.

Im Betrieb ist die Vespa einfach zu bedienen und erweiterbar.

Es rationalisiert sich wiederholende Prozesse, die von der Systemkonfiguration und Anwendungsentwicklung bis hin zur Daten- und Knotenverwaltung reichen, und ermöglicht so einen sicheren und unterbrechungsfreien Produktionsbetrieb.

Die Architektur von Vespa stellt sicher, dass es mit Ihren Daten wächst und gleichzeitig seine Zuverlässigkeit und Leistung beibehält.

AnzeigenPreise

Sie können es kostenlos nutzen.

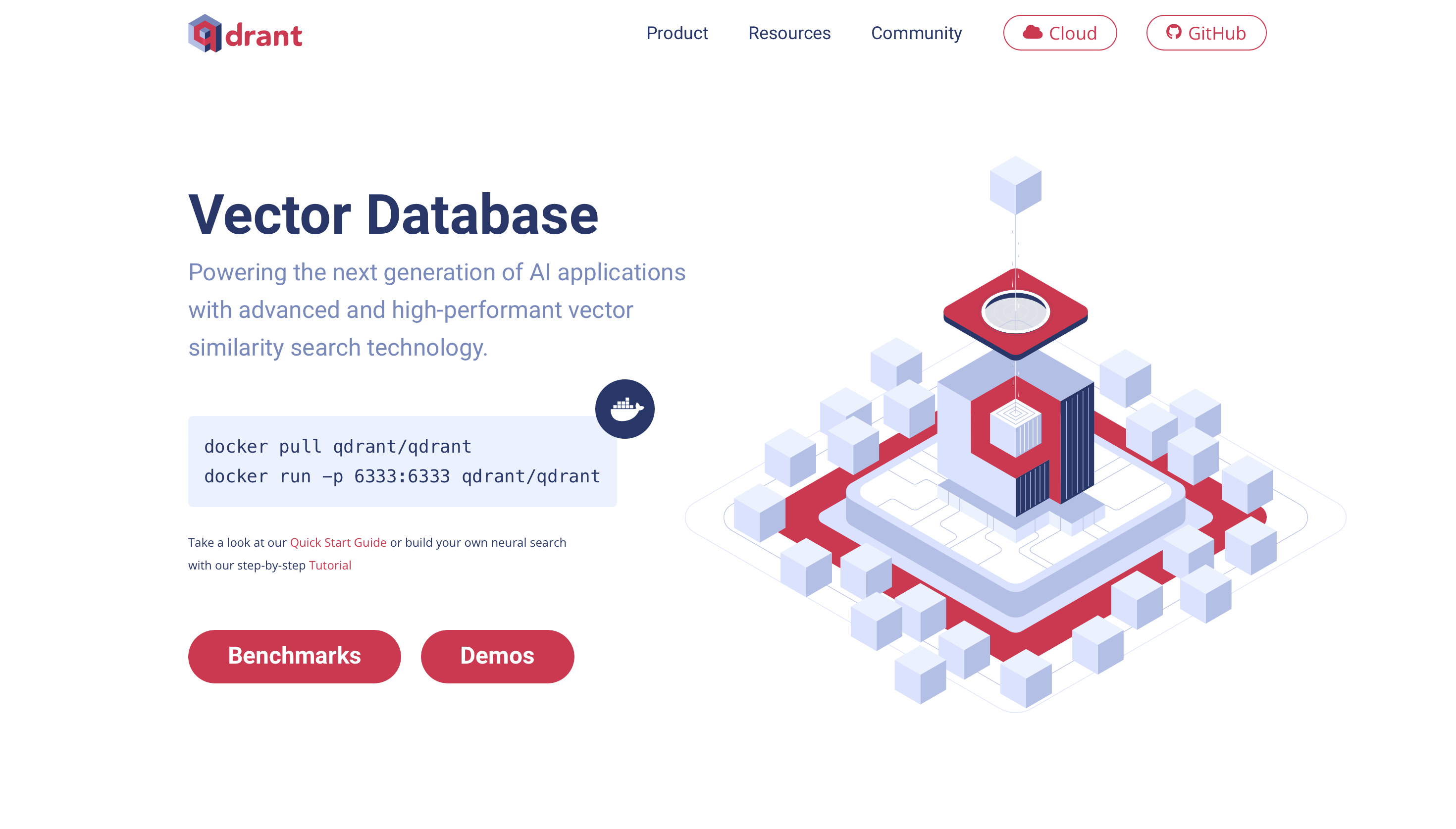

7. Quadrant

Qdrant ist eine flexible Vektordatenbankplattform, die einzigartige Funktionen bietet, um den wachsenden Anforderungen von KI- und maschinellen Lernanwendungen gerecht zu werden.

Im Grunde ist Qdrant eine Vektorähnlichkeitssuchmaschine, die eine benutzerfreundliche API zum Speichern, Suchen und Verwalten von Vektoren sowie Nutzdaten bereitstellt.

Diese Funktion ist für verschiedene Anwendungen von entscheidender Bedeutung, beispielsweise für semantische Such- und Empfehlungssysteme, die die Interpretation komplizierter Datenformate erfordern.

Die Plattform wurde im Hinblick auf Effizienz und Skalierbarkeit entwickelt und ist in der Lage, riesige Datensätze mit Milliarden von Datenpunkten zu verarbeiten.

Es bietet mehrere Distanzmetriken, darunter Kosinusähnlichkeit, euklidische Distanz und Skalarprodukt, wodurch es für viele Anwendungsszenarien anpassbar ist.

Das Design bietet komplexe Filtermöglichkeiten wie String-, Bereichs- und Geofilter, um unterschiedlichen Suchanforderungen gerecht zu werden.

Qdrant ist für Entwickler auf verschiedene Weise zugänglich, darunter ein Docker-Image für schnelle lokale Installationen, ein Python-Client für diejenigen, die mit der Sprache vertraut sind, und ein Cloud-Dienst für eine robustere Umgebung auf Produktionsniveau.

Die Anpassungsfähigkeit von Qdrant ermöglicht eine nahtlose Integration in jede technologische Konfiguration oder jeden Prozessbedarf.

Darüber hinaus vereinfacht die benutzerfreundliche Oberfläche von Qdrant die Verwaltung von Vektordatenbanken. Die Plattform soll für Benutzer aller Erfahrungsstufen unkompliziert sein, von der Clustererstellung bis zur Generierung von API-Schlüsseln für sicheren Zugriff.

Seine Bulk-Upload-Fähigkeit und die asynchrone API verbessern die Effizienz und machen es zu einem sehr nützlichen Tool für Entwickler, die mit riesigen Datenmengen arbeiten.

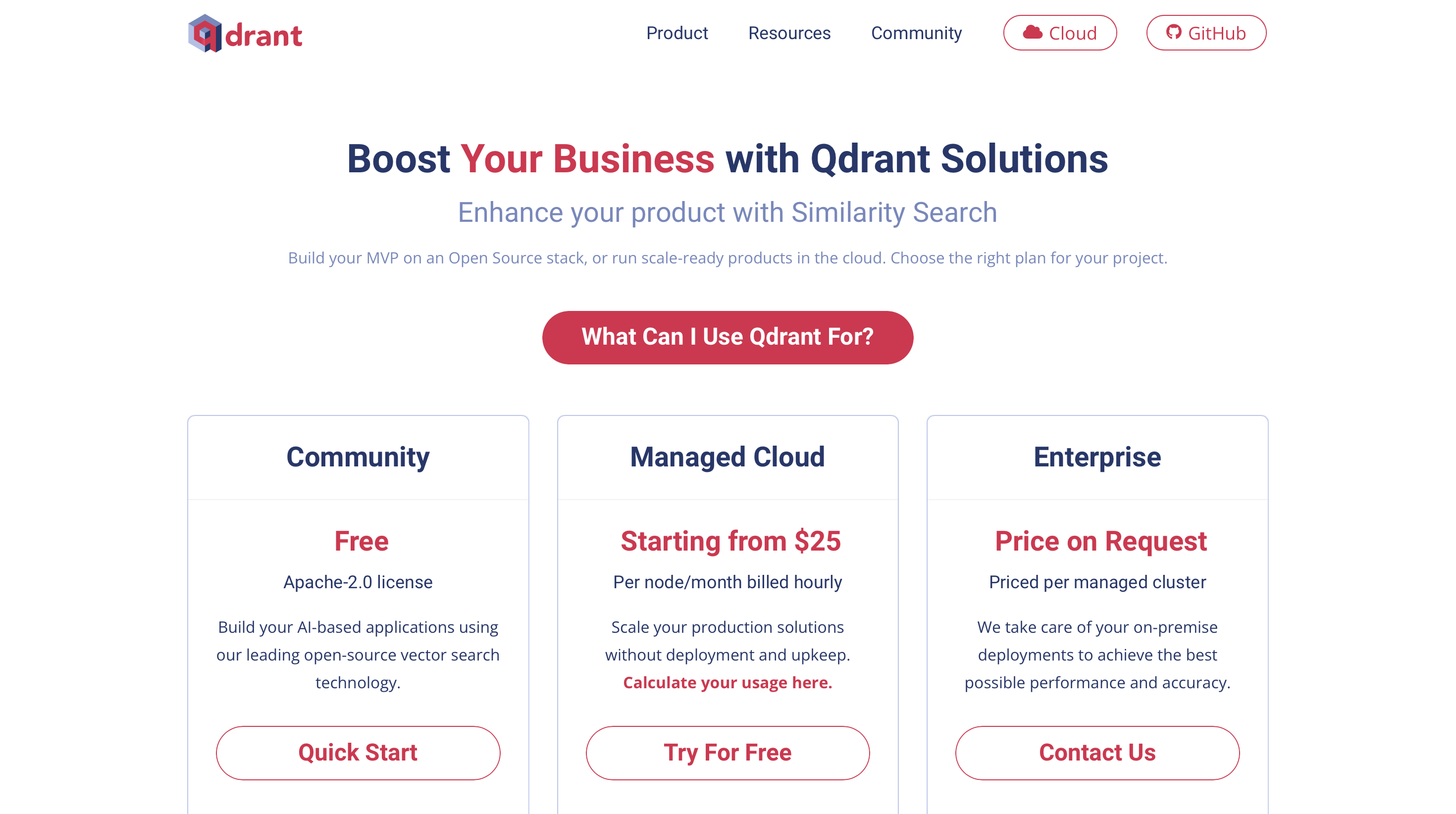

AnzeigenPreise

Sie können es kostenlos nutzen und die Premium-Preise beginnen bei 25 $ pro Knoten/Monat, die stündlich abgerechnet werden

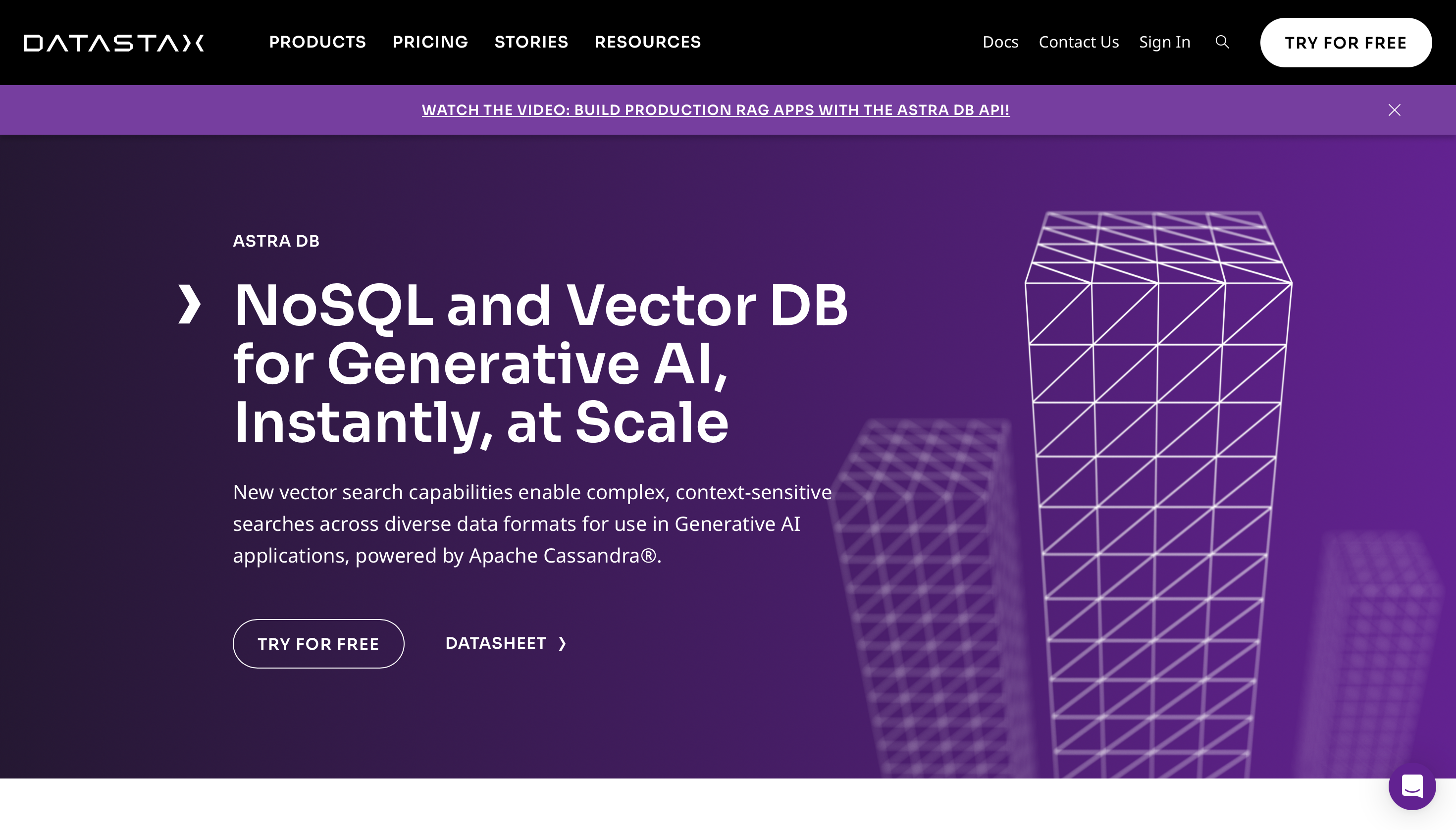

8. Astra

Die überlegenen Vektorsuchfunktionen und die serverlose Architektur von AstraDB verändern generative KI-Anwendungen.

AstraDB ist eine großartige Option für die Verwaltung komplexer, kontextsensitiver Suchvorgänge über eine Vielzahl von Datentypen hinweg, da es auf der soliden Grundlage von Apache Cassandra aufbaut und Skalierbarkeit, Stabilität und Leistung nahtlos kombiniert.

Die Fähigkeit von AstraDB, heterogene Arbeitslasten, einschließlich Streaming-, Nicht-Vektor- und Vektordaten, zu verarbeiten und gleichzeitig eine extrem niedrige Latenz für gleichzeitige Abfrage- und Aktualisierungsvorgänge beizubehalten, ist einer der bemerkenswertesten Vorteile.

Diese Anpassungsfähigkeit ist für generative KI-Anwendungen von entscheidender Bedeutung, die Streaming und Echtzeit-Datenverarbeitung erfordern, um präzise, kontextbezogene KI-Reaktionen bereitzustellen.

Die serverlose Lösung von AstraDB macht die Entwicklung noch einfacher und gibt Entwicklern die Möglichkeit, sich auf die Erstellung innovativer KI-Anwendungen zu konzentrieren, anstatt die Backend-Infrastruktur zu verwalten.

Von Schnellstartanleitungen bis hin zu ausführlichen Lektionen zum Erstellen von Chatbots und Empfehlungssystemen ermöglicht AstraDB Entwicklern die schnelle Umsetzung ihrer KI-Ideen durch zuverlässige APIs und reibungslose Schnittstellen mit bekannten Tools und Plattformen.

Generative KI-Systeme der Enterprise-Klasse müssen Sicherheit und Compliance in den Vordergrund stellen, und AstraDB liefert an beiden Fronten.

Es bietet umfassende Unternehmenssicherheitsfunktionen und Compliance-Zertifizierungen und garantiert, dass auf AstraDB entwickelte KI-Anwendungen den strengsten Datenschutz- und Datenschutzrichtlinien entsprechen.

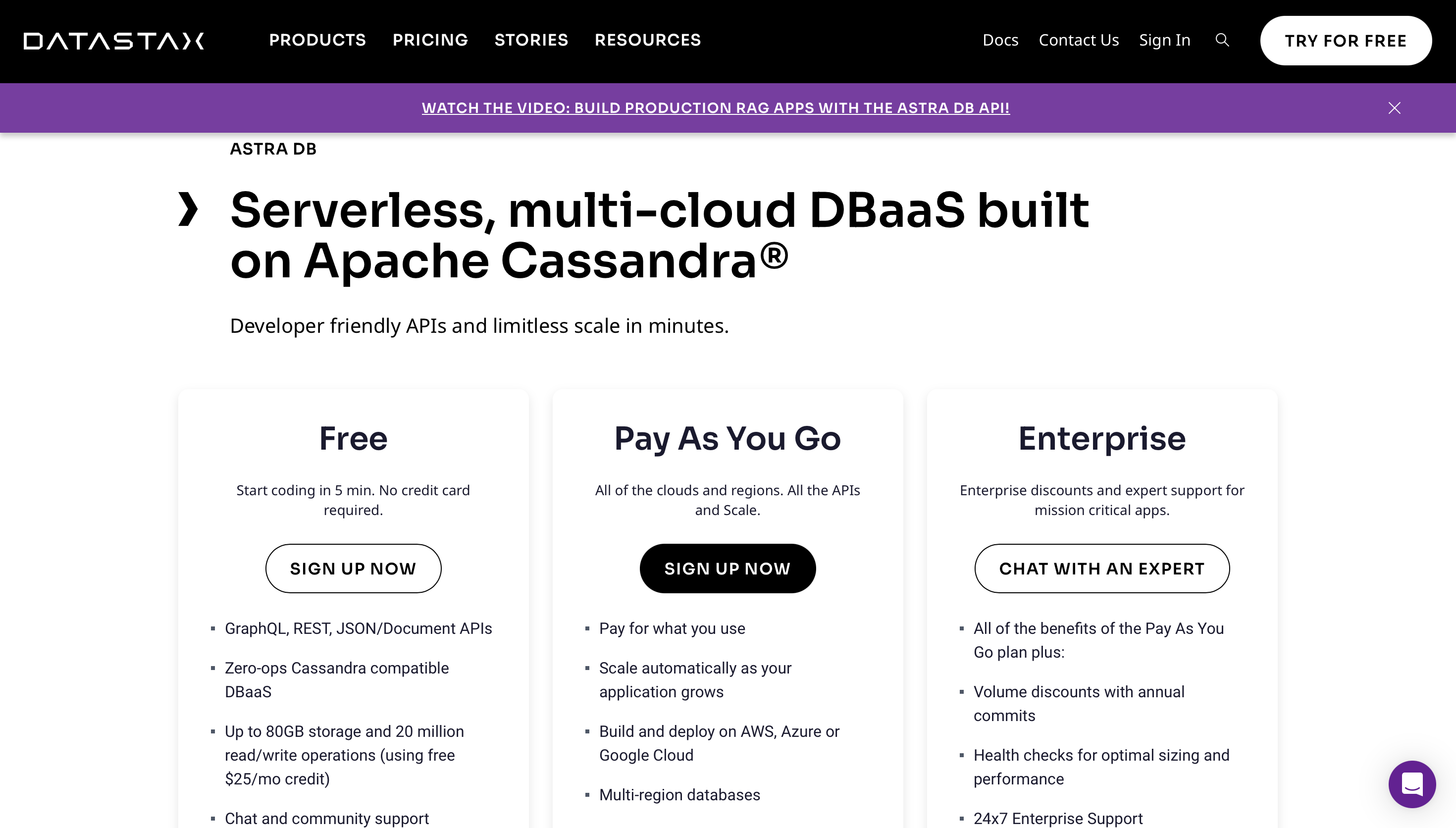

AnzeigenPreise

Sie können es kostenlos nutzen und es bietet ein Pay-as-you-go-Modell.

9. Öffnet die Suche

OpenSearch scheint eine attraktive Option für diejenigen zu sein, die Vektordatenbanken erkunden, insbesondere für die Entwicklung anpassungsfähiger, skalierbarer und zukunftssicherer KI-Systeme.

OpenSearch ist eine umfassende Open-Source-Vektordatenbank, die die Leistungsfähigkeit von Analysen, anspruchsvoller Vektorsuche und konventioneller Suche in einem zusammenhängenden System vereint.

Durch die Verwendung von Einbettungsmodellen für maschinelles Lernen, um die Bedeutung und den Kontext mehrerer Datenformen – Dokumente, Fotos und Audio – in Vektoren für Ähnlichkeitssuchen zu kodieren, ist diese Integration besonders hilfreich für Entwickler, die semantisches Verständnis in ihre Such-Apps integrieren möchten.

Obwohl OpenSearch viel zu bieten hat, ist es wichtig zu bedenken, dass es im Vergleich zu Elasticsearch viel weniger Codeänderungen gab, insbesondere in kritischen Modulen wie Skriptsprachen und Ingestion-Pipeline-Prozessoren.

Elasticsearch kann aufgrund des erhöhten Entwicklungsaufwands über ausgefeiltere Funktionen verfügen, was zu Unterschieden in der Leistung, dem Funktionsumfang und den Aktualisierungen zwischen den beiden führt.

OpenSearch kompensiert dies mit einer großen Community-Fangemeinde und einem Engagement für Open-Source-Ideen, was zu einer offenen und anpassungsfähigen Plattform führt.

Es unterstützt eine breite Palette von Anwendungen über Suche und Analyse hinaus, wie z. B. Observability und Security Analytics, und ist damit ein flexibles Tool für datenintensive Aufgaben.

Die Community-gesteuerte Strategie gewährleistet kontinuierliche Verbesserungen und Integrationen, um die Plattform aktuell und einzigartig zu halten.

AnzeigenPreise

Sie können es kostenlos nutzen.

10 Azure AI-Suche

Azure AI Search ist eine leistungsstarke Plattform, die die Suchfunktionen in generativen KI-Anwendungen verbessert.

Es zeichnet sich dadurch aus, dass es die Vektorsuche unterstützt, einen Mechanismus zum Indizieren, Speichern und Abrufen von Vektoreinbettungen innerhalb eines Suchindex.

Diese Funktion hilft bei der Suche nach vergleichbaren Dokumenten im Vektorraum, was zu kontextbezogeneren Suchergebnissen führt.

Azure AI Search zeichnet sich durch die Unterstützung hybrider Situationen aus, in denen Vektor- und Schlüsselwortsuchen gleichzeitig durchgeführt werden, was zu einem einheitlichen Ergebnissatz führt, der häufig die Wirksamkeit jeder einzeln verwendeten Technik übertrifft.

Die Kombination von Vektor- und Nicht-Vektormaterial im selben Index ermöglicht ein umfassenderes und flexibleres Sucherlebnis.

Die Vektorsuchfunktion in Azure AI Search ist allgemein zugänglich und für alle Azure AI Search-Stufen kostenlos.

Aufgrund der Unterstützung mehrerer Entwicklungsumgebungen, die über die Azure-Site bereitgestellt wird, ist es äußerst flexibel für eine Reihe von Anwendungsfällen und Entwicklungspräferenzen. REST-APIsund SDKs unter anderem für Python, JavaScript und.NET.

Durch die tiefe Integration in das Azure AI-Ökosystem bietet Azure AI Search mehr als nur eine Suche. Es erhöht auch das Potenzial des Ökosystems für generative KI-Anwendungen.

Azure OpenAI Studio für die Modelleinbettung und Azure AI Services für den Bildabruf sind nur zwei Beispiele für die Dienste, die in dieser Integration enthalten sind.

Azure AI Search ist eine flexible Lösung für Entwickler, die anspruchsvolle Suchfunktionen in ihre Anwendungen integrieren möchten, da Azure AI Search eine umfassende Unterstützung bietet, die eine breite Palette von Anwendungen ermöglicht, von der Ähnlichkeitssuche und der multimodalen Suche bis hin zur Hybridsuche und der mehrsprachigen Suche.

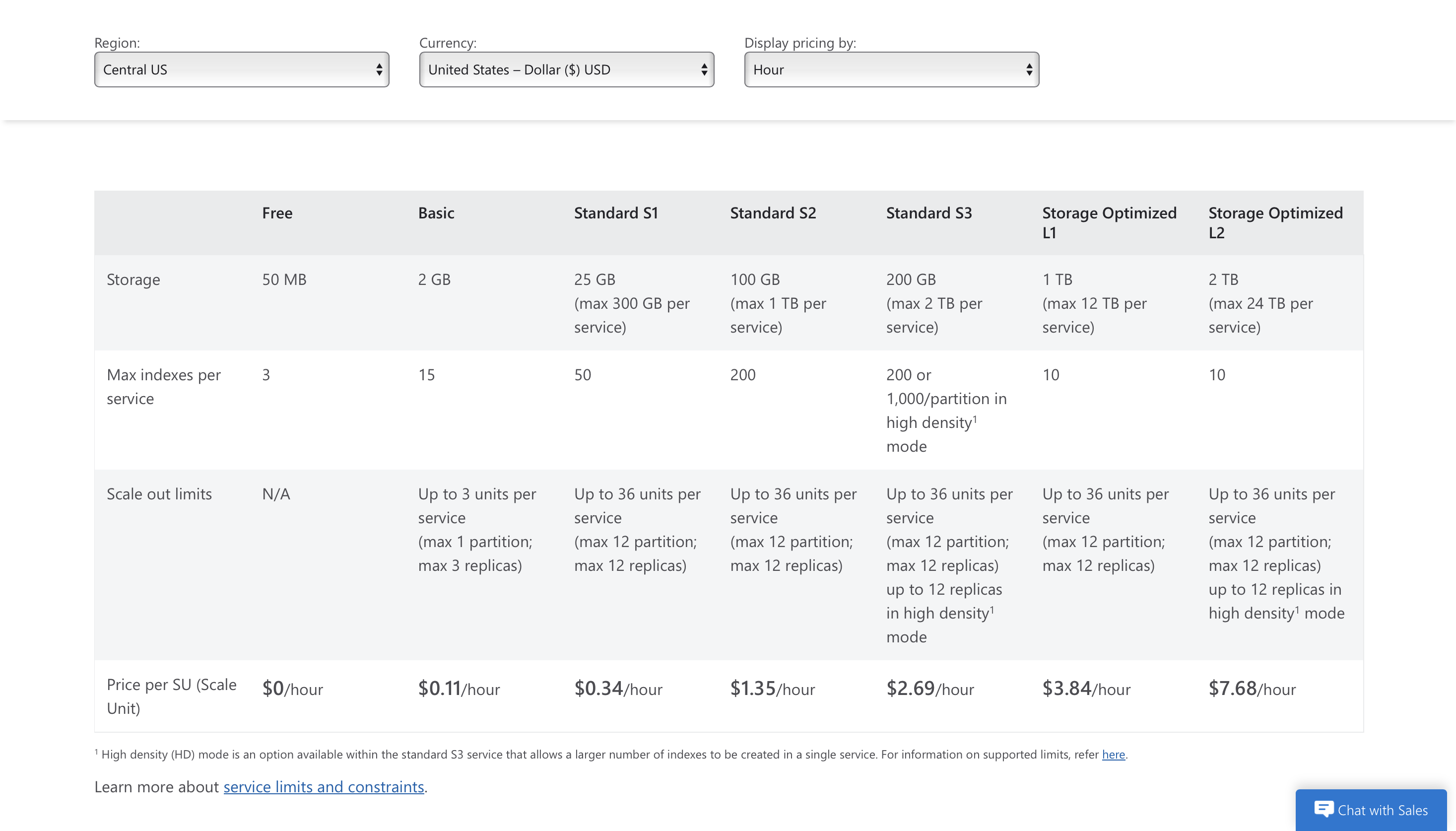

AnzeigenPreise

Sie können es kostenlos nutzen und die Premium-Preise beginnen bei 0.11 $/Stunde.

Zusammenfassung

Vektordatenbanken transformieren das Datenmanagement in der KI, indem sie hochdimensionale Vektoren verwalten und so eine starke Ähnlichkeitssuche und schnelle Abfragen des nächsten Nachbarn in Anwendungen wie Empfehlungssystemen und Betrugserkennung ermöglichen.

Mithilfe ausgefeilter Indexierungsalgorithmen wandeln diese Datenbanken komplizierte unstrukturierte Daten in aussagekräftige Vektoren um und bieten gleichzeitig die Geschwindigkeit und Flexibilität, die herkömmliche Datenbanken nicht bieten.

Zu den bemerkenswerten Plattformen gehören Pinecone, das bei generativen KI-Anwendungen glänzt; FAISS, erstellt von Facebook AI für dichtes Vektor-Clustering; und Milvus, das für seine Skalierbarkeit und Cloud-native Architektur bekannt ist.

Weaviate kombiniert maschinelles Lernen mit kontextsensitiver Suche, während Vespa und Chroma sich durch ihre Rechenfähigkeiten mit geringer Latenz bzw. Benutzerfreundlichkeit auszeichnen.

Vektordatenbanken sind wichtige Werkzeuge für die Entwicklung von KI- und maschinellen Lerntechnologien, da Plattformen wie Qdrant, AstraDB, OpenSearch und Azure AI Search eine Vielzahl von Diensten bereitstellen, von serverlosen Architekturen bis hin zu umfangreichen Such- und Analysefunktionen.

Hinterlassen Sie uns einen Kommentar