Indholdsfortegnelse[Skjule][At vise]

Vektordatabaser repræsenterer et markant skift i, hvordan vi administrerer og fortolker data, især inden for områderne kunstig intelligens og maskinlæring.

Den grundlæggende funktion af disse databaser er effektivt at håndtere højdimensionelle vektorer, som er råmaterialet i maskinlæringsmodeller og inkluderer konvertering af tekst, billede eller lydinput til numeriske repræsentationer i multidimensionelt rum.

Til applikationer som anbefalingssystemer, genkendelse af objekter, billedhentning og svindeldetektion er denne transformation mere end blot opbevaring; det er en døråbning til kraftfulde muligheder i lighedssøgninger og forespørgsler om nærmeste nabo.

Mere dybere ligger kraften ved vektordatabaser i deres evne til at oversætte store mængder ustrukturerede, komplicerede data til vektorer, der fanger konteksten og betydningen af det originale indhold.

De forbedrede søgefunktioner, der er muliggjort ved at indlejre modeller i denne kodning, omfatter muligheden for at forespørge omgivende vektorer for at finde relaterede billeder eller sætninger.

Vektordatabaser er unikke ved, at de er bygget på avancerede indekseringsteknikker såsom Inverted File Index (IVF) og Hierarchical Navigable Small World (HNSW), som forbedrer deres hastighed og effektivitet, mens de lokaliserer nærmeste naboer i N-dimensionelle rum.

Der er en klar forskel mellem vektor- og klassiske databaser. Konventionelle databaser er gode til at organisere data i organiserede sæt, der er CRUD-optimerede og overholder indstillede skemaer.

Men når man beskæftiger sig med den dynamiske og komplicerede karakter af højdimensionelle data, begynder denne stivhed at blive en hindring.

I modsætning hertil tilbyder vektordatabaser en grad af fleksibilitet og effektivitet, som traditionelle ækvivalenter ikke kan sammenlignes med, især for applikationer, der er stærkt afhængige af machine learning og kunstig intelligens. De er ikke kun skalerbare og dygtige til lighedssøgninger.

Vektordatabaser er især nyttige til generative AI-applikationer. For at garantere, at det skabte materiale bevarer kontekstuel integritet, afhænger disse applikationer – som inkluderer naturlig sprogbehandling og billedgenerering – af hurtig hentning og sammenligning af indlejringer.

Så i dette stykke vil vi se på de bedste vektordatabaser til dit næste projekt.

1. Milvus

Milvus er en banebrydende open source vektordatabase designet primært til AI-applikationer, herunder indlejrede lighedssøgninger og kraftfulde MLOps.

Det adskiller sig fra konventionelle relationsdatabaser, som for det meste håndterer strukturerede data, på grund af denne kapacitet, som gør den i stand til at indeksere vektorer på en hidtil uset billion skala.

Milvus' dedikation til skalerbarhed og høj tilgængelighed demonstreres af den måde, den har udviklet sig fra sin første version til den fuldt distribuerede, cloud-native Milvus 2.0.

Specifikt udviser Milvus 2.0 et fuldt cloud-native design, der sigter mod en forbløffende 99.9 % tilgængelighed, mens den skalerer ud over hundredvis af noder.

For dem, der leder efter en pålidelig vektordatabaseløsning, anbefales denne udgave stærkt, da den ikke kun tilføjer sofistikerede funktioner som en multi-cloud-forbindelse og et administrativt panel, men den forbedrer også datakonsistensniveauerne for fleksibel applikationsudvikling.

En bemærkelsesværdig fordel ved Milvus er dens fællesskabsdrevne tilgang, som giver support på flere sprog og en omfattende værktøjskæde, der er skræddersyet til udviklernes krav.

I IT-sektoren gør dens skyskalerbarhed og pålidelighed sammen med dens højtydende vektorsøgningsfunktioner på store datasæt det til en populær mulighed.

Derudover forbedrer den effektiviteten af sine operationer ved hjælp af en hybrid søgefunktion, der blander vektorlighedssøgning med skalær filtrering.

Milvus har et administrativt panel med en klar brugergrænseflade, et komplet sæt API'er og en skalerbar og justerbar arkitektur.

Kommunikation med eksterne applikationer lettes af adgangslaget, mens belastningsbalancering og datastyring koordineres af koordinatortjenesten, der fungerer som den centrale kommando.

Databasens varighed understøttes af objektlagerlaget, mens arbejdsknudepunkter udfører aktiviteter for at sikre skalerbarhed.

Priser

Det er gratis at bruge for alle.

2. FAISS

Facebooks AI Research-team udviklede et banebrydende bibliotek kaldet Facebook AI Similarity Search, der er designet til at gøre tæt vektorklynger og lighedssøgning mere effektiv.

Dets oprettelse var drevet af kravet om at forbedre Facebook AI's lighedssøgningsfunktioner ved at bruge banebrydende fundamentale metoder.

Sammenlignet med CPU-baserede implementeringer kan FAISS's avancerede GPU-implementering fremskynde søgetider med fem til ti gange, hvilket gør det til et uvurderligt værktøj til en række forskellige applikationer, herunder anbefalingssystemer og identifikation af lignende betydninger i betydelige ustrukturerede datasæt som tekst, lyd og video.

FAISS kan håndtere en bred vifte af lighedsmålinger, såsom cosinus-lighed, indre produkt og den almindeligt anvendte L2-metrik (euklidisk afstand).

Disse målinger gør det nemmere at lave nøjagtige og fleksible lighedssøgninger på tværs af forskellige datatyper. Funktioner som batchbehandling, præcisionshastighedsafvejninger og understøttelse af både præcise og omtrentlige søgninger øger dens fleksibilitet yderligere.

Derudover tilbyder FAISS en skalerbar metode til håndtering af massive datasæt ved at tillade, at indekser gemmes på disken.

Den omvendte fil, produktkvantisering (PQ) og forbedret PQ er blot nogle få af de innovative teknikker, der udgør FAISS's forskningsgrundlag og bidrager til dets effektivitet, når det kommer til indeksering og søgning af højdimensionelle vektorfelter.

Disse strategier forstærkes af banebrydende tilgange såsom GPU-accelererede k-selektionsalgoritmer og forfiltrering af PQ-afstande, hvilket garanterer FAISS's kapacitet til at producere hurtige og præcise søgeresultater selv i milliardskala-datasæt.

Priser

Det er gratis at bruge for alle.

3. Grankogle

Pinecone er førende inden for vektordatabaser og leverer en cloud-native, administreret service, der er specielt bygget til at forbedre ydeevnen af højdrevne AI-applikationer.

Den er specielt designet til at håndtere vektorindlejringer, som er essentielle for generativ AI, semantisk søgning og applikationer, der bruger massive sprogmodeller.

AI kan nu forstå semantisk information takket være disse indlejringer, som effektivt fungerer som en langtidshukommelse for komplicerede opgaver.

Pinecone er unik ved, at den problemfrit integrerer funktionerne i traditionelle databaser med den forbedrede ydeevne af vektorindekser, hvilket muliggør effektiv og storstilet lagring og forespørgsel af indlejringer.

Dette gør det til den perfekte mulighed i situationer, hvor kompleksiteten og mængden af involverede data gør standard skalarbaserede databaser utilstrækkelige.

Pinecone tilbyder udviklere en problemfri løsning på grund af dens administrerede servicetilgang, som strømliner integrationen og procedurerne for dataindtag i realtid.

Adskillige datahandlinger understøttes af det, herunder hentning, opdatering, sletning, forespørgsel og upsertering af data.

Pinecone garanterer endvidere, at forespørgsler, der repræsenterer ændringer i realtid, såsom upserts og sletninger, giver korrekte svar med lav latens for indekser med milliarder af vektorer.

I dynamiske situationer er denne funktion afgørende for at bevare forespørgselsresultaternes relevans og friskhed.

Derudover øger Pinecones partnerskab med Airbyte via Pinecone-forbindelsen dens alsidighed og fleksibilitet, hvilket giver mulighed for jævn dataintegration fra en række kilder.

Gennem dette forhold kan omkostninger og effektivitet optimeres ved at sikre, at kun nyerhvervet information håndteres gennem inkrementel datasynkronisering.

Konnektorens design understreger enkelhed, kræver kun et minimum af opsætningsparametre, og det kan udvides, hvilket giver mulighed for fremtidige forbedringer.

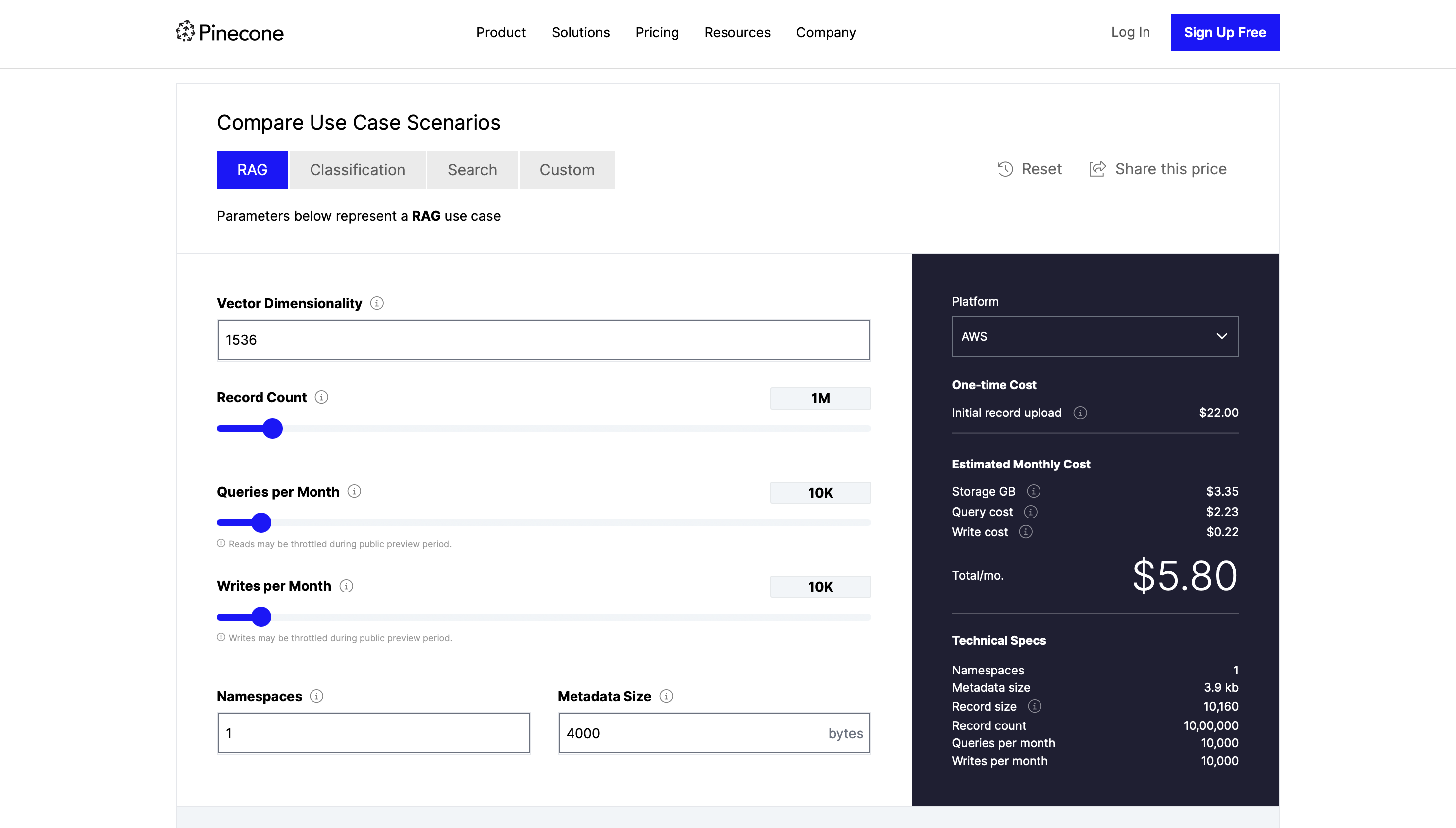

Priser

Præmieprisen starter fra $5.80/måned for RAG-brugssagen.

4. Væv

Weaviate er en innovativ vektordatabase, der er tilgængelig som open source-software, der transformerer den måde, vi får adgang til og bruger data på.

Weaviate gør brug af vektorsøgningsfunktioner, som muliggør sofistikerede, kontekstbevidste søgninger på tværs af store, komplicerede datasæt, i modsætning til typiske databaser, der afhænger af skalære værdier og foruddefinerede forespørgsler.

Med denne metode kan du lokalisere indhold ud fra, hvor meget det ligner andet indhold, hvilket forbedrer søgningernes intuitivitet og resultaternes relevans.

Dens glatte integration med maskinlæringsmodeller er en af dens primære egenskaber; dette gør det muligt at fungere som mere end blot en datalagringsløsning; det gør det også muligt at forstå og analysere data ved hjælp af kunstig intelligens.

Weaviates arkitektur inkorporerer denne integration grundigt, hvilket gør det muligt at analysere komplekse data uden brug af yderligere værktøjer.

Dens understøttelse af grafdatamodeller giver også et andet syn på data som forbundne entiteter, og afslører mønstre og indsigter, der kunne gå glip af i konventionelle databasearkitekturer.

På grund af Weaviates modulære arkitektur kan kunderne tilføje funktioner som datavektorisering og oprettelse af backup efter behov.

Dens grundlæggende version fungerer som en vektordataspecialistdatabase, og den kan udvides med andre moduler for at imødekomme forskellige behov.

Dens skalerbarhed er yderligere forbedret af dens modulære design, som garanterer, at hastigheden ikke vil blive ofret som reaktion på stigende datamængder og forespørgselskrav.

En alsidig og effektiv metode til at interagere med de lagrede data er muliggjort af databasens understøttelse af både RESTful og GraphQL API'er.

Især er GraphQL valgt på grund af dets kapacitet til hurtigt at udføre indviklede, grafbaserede forespørgsler, hvilket gør det muligt for brugerne at opnå præcis de data, de ønsker, uden at få for store eller utilstrækkelige mængder data.

Weaviate er mere brugervenlig på tværs af en række klientbiblioteker og programmeringssprog takket være dens fleksible API.

For dem, der søger at udforske Weaviate yderligere, er der et væld af dokumentation og tutorials tilgængeligt, fra opsætning og konfiguration af din instans til dybt dyk ned i dens muligheder som vektorsøgning, maskinlæringsintegration og skemadesign.

Du kan få adgang til den samme potente teknologi, der gør information dynamisk og handlekraftig, uanset om du beslutter dig for at betjene Weaviate lokalt, i en cloud computing miljø eller gennem den Weaviate-administrerede cloud-tjeneste

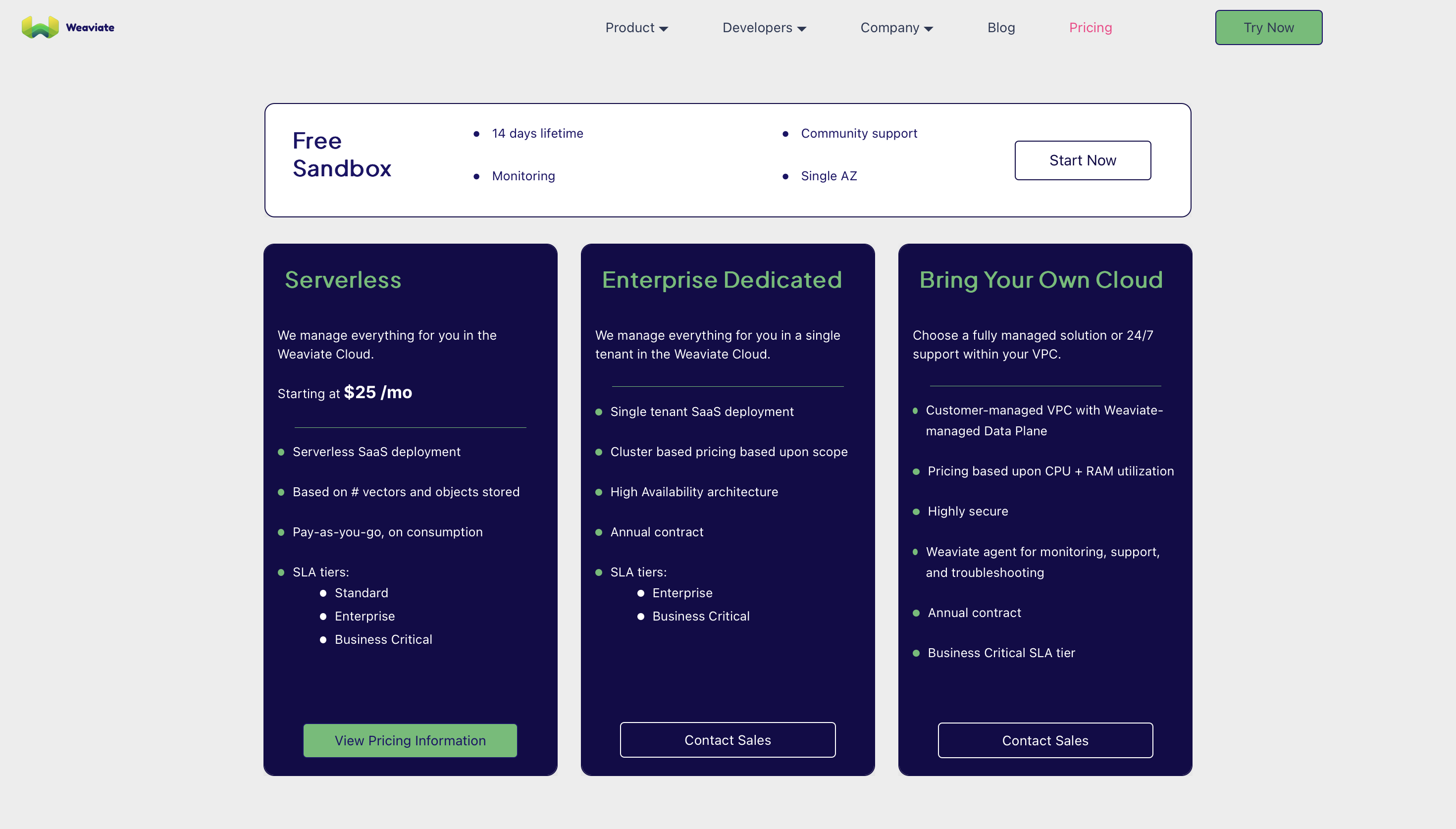

Priser

Premium-priserne for platformen starter fra $25/måned for serverløs.

5. Chroma

Chroma er en banebrydende vektordatabase, der har til formål at revolutionere datahentning og -lagring, især til applikationer, der involverer maskinlæring og kunstig intelligens.

Da Chroma arbejder med vektorer i stedet for skalartal, i modsætning til standarddatabaser, er den meget god til at håndtere højdimensionelle, komplicerede data.

Dette er et stort fremskridt inden for datahentningsteknologi, da det muliggør mere sofistikerede søgninger baseret på materialets semantiske lighed frem for præcise søgeordsmatches.

Et bemærkelsesværdigt kendetegn ved Chroma er dets evne til at arbejde med flere underliggende lagringsløsninger, såsom ClickHouse til skalerede indstillinger og DuckDB til selvstændige installationer, hvilket garanterer fleksibilitet og tilpasning til forskellige use cases.

Chroma er lavet med enkelhed, hastighed og analyse i tankerne. Det er tilgængeligt for et bredt spektrum af udviklere med SDK'er til Python og JavaScript/TypeScript.

Derudover lægger Chroma stor vægt på brugervenlighed, hvilket giver udviklere mulighed for hurtigt at opsætte en permanent database understøttet af DuckDB eller en database i hukommelsen til test.

Muligheden for at bygge samlingsobjekter, der ligner tabeller i konventionelle databaser, hvor tekstdata kan indsættes og automatisk transformeres til indlejringer ved hjælp af modeller såsom all-MiniLM-L6-v2, øger denne alsidighed yderligere.

Tekst og indlejringer kan integreres problemfrit, hvilket er essentielt for applikationer, der skal forstå datasemantik.

Grundlaget for Chromas vektorlighedsmetode er de matematiske begreber ortogonalitet og tæthed, som er afgørende for at forstå repræsentationen og sammenligningen af data i databaser.

Disse ideer giver Chroma mulighed for at udføre meningsfulde og effektive lighedssøgninger ved at tage højde for de semantiske koblinger mellem dataelementer.

Ressourcer såsom selvstudier og retningslinjer er tilgængelige for personer, der ønsker at udforske Chroma yderligere. De inkluderer trin-for-trin vejledning i, hvordan du opsætter databasen, opretter samlinger og kører lighedssøgninger.

Priser

Du kan begynde at bruge det gratis.

6. Vespa

Vespa er en platform, der transformerer online-håndteringen af kunstig intelligens og store data.

Det grundlæggende formål med Vespa er at muliggøre beregninger med lav latens på tværs af store datasæt, så du nemt kan gemme, indeksere og analysere tekst, vektor og strukturerede data.

Vespa er kendetegnet ved sin evne til at give hurtige svar i enhver skala, uanset arten af de forespørgsler, valg eller maskinlærte modelslutninger, der håndteres.

Vespas fleksibilitet er vist i dens fuldt funktionelle søgemaskine og vektordatabase, som muliggør mange søgninger i en enkelt forespørgsel, lige fra vektor (ANN), leksikalske og strukturerede data.

Uanset skala kan du skabe brugervenlige og responsive søgeapps med realtids-AI-egenskaber takket være denne integration af maskinlært modelslutning med dine data.

Vespa handler dog om mere end blot at søge; det handler også om at forstå og tilpasse møder.

Førsteklasses tilpasnings- og forslagsværktøjer giver dynamiske, aktuelle anbefalinger, der henvender sig til specifikke brugere eller omstændigheder.

Vespa er en game-changer for alle, der også ønsker at gå ind i det konverserende AI-rum, da det tilbyder den nødvendige infrastruktur til at gemme og udforske tekst- og vektordata i realtid, hvilket giver mulighed for udvikling af mere avancerede og praktiske AI-agenter.

Med omfattende tokenisering og stemming understøttes fuldtekstsøgninger, nærmeste nabosøgninger og strukturerede dataforespørgsler alle af platformens omfattende forespørgselsmuligheder.

Den adskiller sig ved, at den effektivt kan håndtere komplicerede forespørgsler ved at kombinere flere søgedimensioner.

Vespa er et beregningsmæssigt kraftcenter for AI og maskinlæringsapplikationer, fordi dets beregningsmotor kan håndtere komplekse matematiske udtryk over skalarer og tensorer.

I drift er Vespa lavet til at være enkel at bruge og udvidelig.

Det strømliner gentagne processer, lige fra systemkonfiguration og applikationsudvikling til data- og nodestyring, hvilket muliggør sikker og uafbrudt produktionsdrift.

Vespas arkitektur sørger for, at den udvides med dine data, og holder dens pålidelighed og ydeevne vedlige.

Priser

Du kan begynde at bruge det gratis.

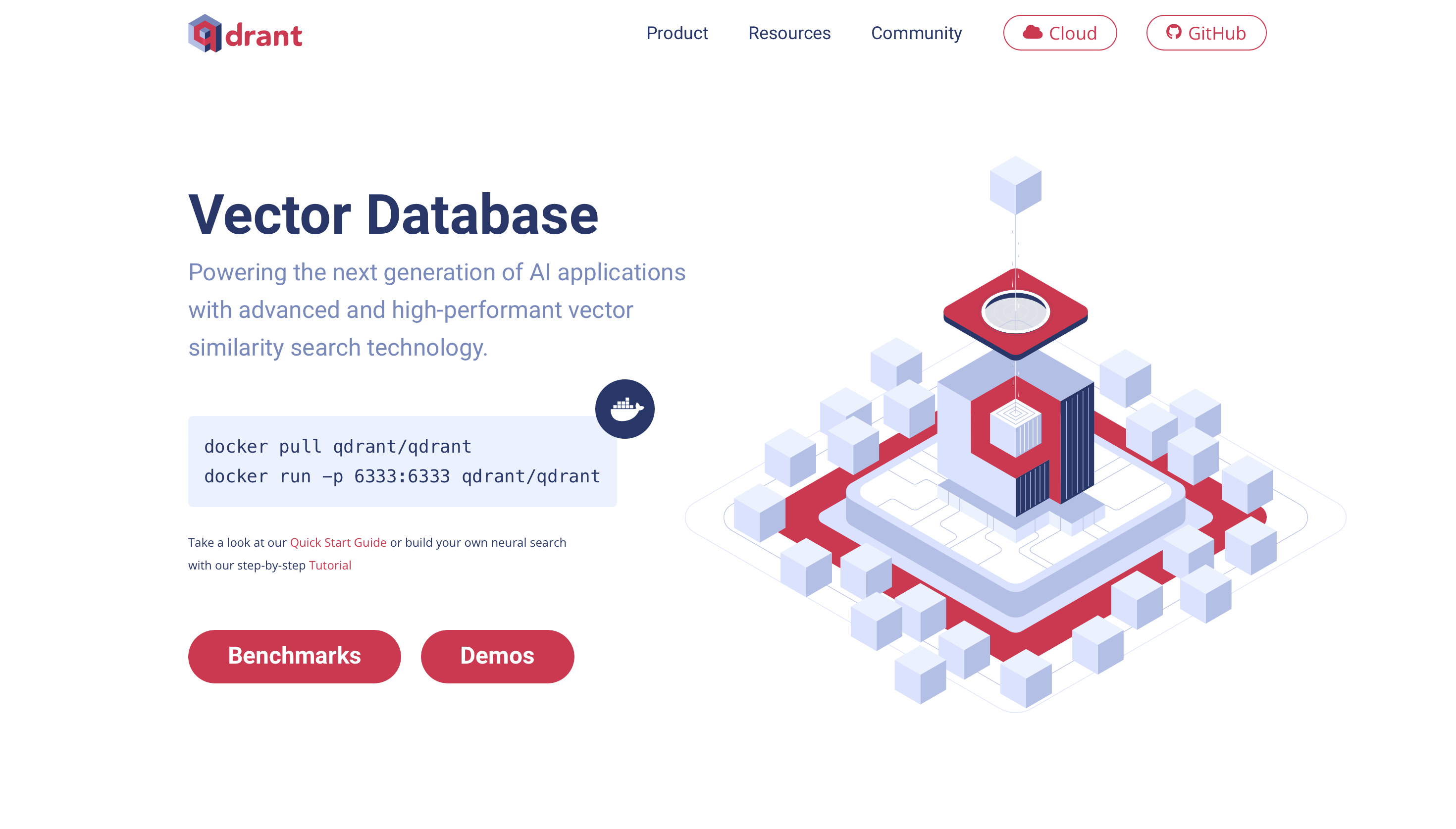

7. Quadrant

Qdrant er en fleksibel vektordatabaseplatform, der giver et unikt sæt funktioner til at imødekomme de voksende krav til AI og maskinlæringsapplikationer.

Ved sit grundlag er Qdrant en vektorlighedssøgemaskine, der giver en brugervenlig API til lagring, søgning og vedligeholdelse af vektorer samt nyttelastdata.

Denne funktion er afgørende for flere applikationer, såsom semantiske søge- og anbefalingssystemer, der kræver fortolkning af komplicerede dataformater.

Platformen er bygget med effektivitet og skalerbarhed i tankerne og er i stand til at håndtere massive datasæt med milliarder af datapunkter.

Det giver mulighed for adskillige afstandsmålinger, herunder Cosinus Similarity, Euclidian Distance og Dot Product, hvilket gør den tilpasselig på tværs af mange brugsscenarier.

Designet tilbyder kompleks filtrering, såsom streng, rækkevidde og geofiltre, for at imødekomme forskellige søgebehov.

Qdrant er tilgængelig for udviklere på en række forskellige måder, herunder et Docker-image til hurtige lokale opsætninger, en Python-klient for dem, der er fortrolige med sproget, og en cloud-tjeneste til et mere robust miljø i produktionskvalitet.

Qdrants tilpasningsevne giver mulighed for problemfri integration med enhver teknologisk konfiguration eller procesbehov.

Ydermere forenkler Qdrants brugervenlige grænseflade administration af vektordatabaser. Platformen er beregnet til at være ligetil for brugere på alle færdighedsniveauer, fra oprettelse af klynge til generering af API-nøgler for sikker adgang.

Dens masseoverførselskapacitet og asynkrone API forbedrer dens effektivitet, hvilket gør det til et meget nyttigt værktøj for udviklere, der håndterer enorme mængder data.

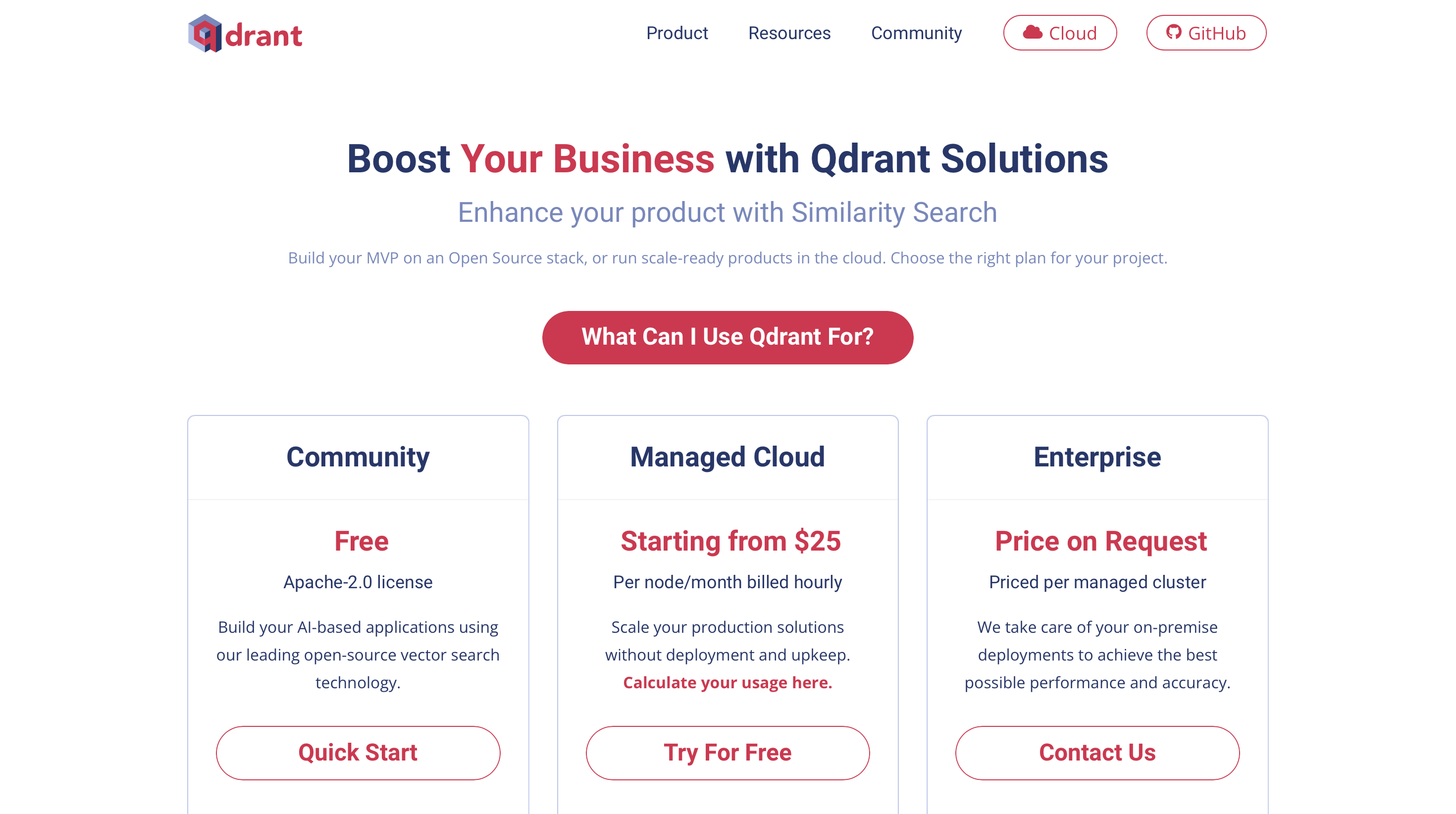

Priser

Du kan begynde at bruge det gratis, og premium-priser starter fra $25 pr. node/måned, der faktureres hver time

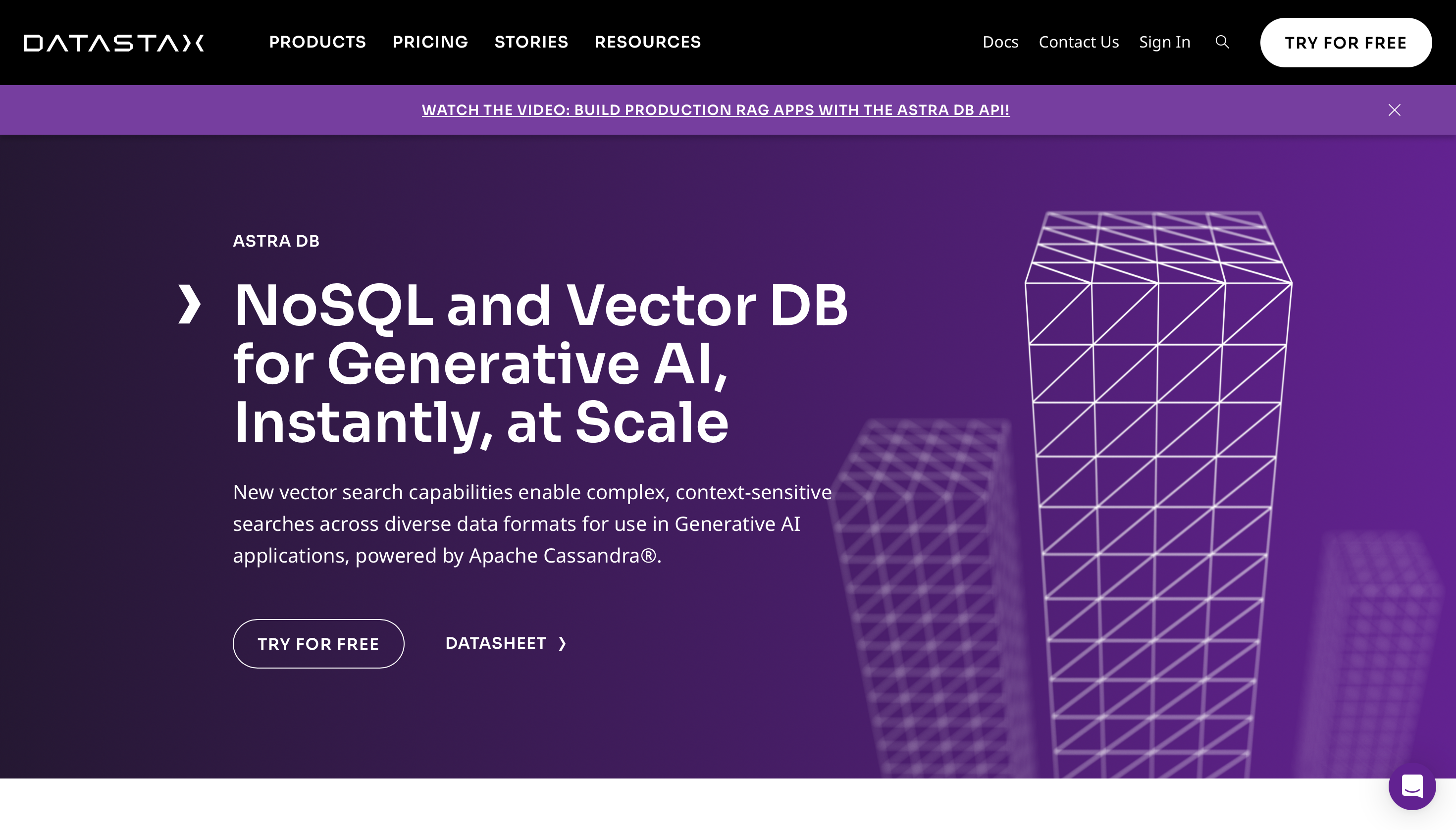

8. Astra

AstraDBs overlegne vektorsøgningsmuligheder og serverløse arkitektur transformerer generative AI-applikationer.

AstraDB er en fantastisk mulighed for at administrere indviklede, kontekstfølsomme søgninger på tværs af en række datatyper, da den er bygget på det solide fundament af Apache Cassandra og problemfrit kombinerer skalerbarhed, stabilitet og ydeevne.

AstraDBs kapacitet til at håndtere heterogene arbejdsbelastninger, inklusive streaming, ikke-vektor- og vektordata, samtidig med at den bevarer ekstremt lav latenstid for samtidige forespørgsler og opdateringsoperationer, er en af dens mest bemærkelsesværdige fordele.

Denne tilpasningsevne er afgørende for generative AI-applikationer, som kræver streaming og databehandling i realtid for at give præcise, kontekstbevidste AI-svar.

Den serverløse løsning fra AstraDB gør udviklingen endnu nemmere og frigør udviklere til at koncentrere sig om at skabe innovative AI-applikationer i stedet for at administrere backend-infrastrukturen.

Fra hurtigstartvejledning til dybdegående lektioner om at skabe chatbots og anbefalingssystemer, giver AstraDB udviklere mulighed for hurtigt at realisere deres AI-ideer gennem pålidelige API'er og glatte grænseflader med velkendte værktøjer og platforme.

Generative AI-systemer i virksomhedsklasse skal prioritere sikkerhed og compliance, og AstraDB leverer på begge fronter.

Dybe virksomhedssikkerhedsfunktioner og overholdelsescertificeringer leveres af den, hvilket garanterer, at AI-applikationer udviklet på AstraDB overholder de strengeste retningslinjer for privatliv og databeskyttelse.

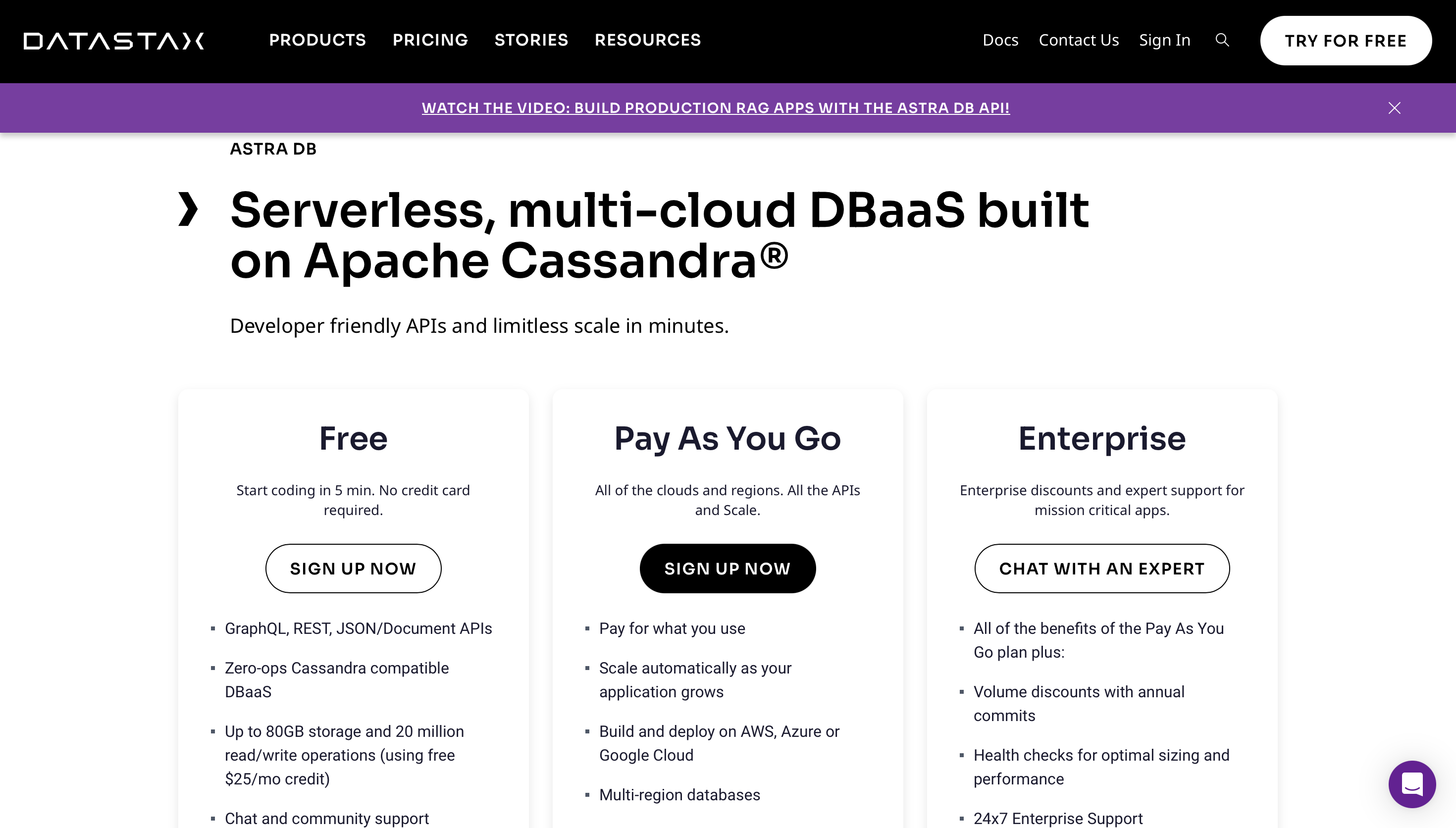

Priser

Du kan begynde at bruge det gratis, og det tilbyder en pay-as-you-go-model.

9. OpenSearch

OpenSearch fremstår som en tiltalende mulighed for dem, der udforsker vektordatabaser, især til udvikling af tilpasningsdygtige, skalerbare og fremtidssikre AI-systemer.

OpenSearch er en altomfattende, open source vektordatabase, der kombinerer kraften ved analyse, sofistikeret vektorsøgning og konventionel søgning i ét sammenhængende system.

Ved at bruge maskinlæringsindlejringsmodeller til at indkode betydningen og konteksten af flere dataformer – dokumenter, fotos og lyd – i vektorer til lighedssøgninger, er denne integration især nyttig for udviklere, der ønsker at inkludere semantisk forståelse i deres søgeapps.

Selvom OpenSearch har meget at tilbyde, er det vigtigt at huske, at sammenlignet med Elasticsearch har der været meget færre kodeændringer, især i kritiske moduler som scriptsprog og indtagelsespipeline-processorer.

Elasticsearch kan have mere sofistikerede muligheder på grund af øget udviklingsindsats, hvilket fører til forskelle i ydeevne, funktionssæt og opdateringer mellem de to.

OpenSearch kompenserer med et stort fællesskabstilhængerskab og en dedikation til open source-ideer, hvilket resulterer i en åben og tilpasningsdygtig platform.

Det understøtter en bred vifte af applikationer ud over søgning og analyse, såsom observerbarhed og sikkerhedsanalyse, hvilket gør det til et fleksibelt værktøj til dataintensive opgaver.

Den fællesskabsdrevne strategi sikrer løbende forbedringer og integrationer for at holde platformen opdateret og unik.

Priser

Du kan begynde at bruge det gratis.

10. Azure AI-søgning

Azure AI Search er en stærk platform, der forbedrer søgemulighederne inden for generative AI-applikationer.

Det skiller sig ud, fordi det understøtter vektorsøgning, en mekanisme til indeksering, lagring og hentning af vektorindlejringer i et søgeindeks.

Denne funktion hjælper med at opdage sammenlignelige dokumenter i vektorrum, hvilket resulterer i mere kontekstuelt relevante søgeresultater.

Azure AI Search udmærker sig ved sin understøttelse af hybride situationer, hvor vektor- og nøgleordssøgninger udføres samtidigt, hvilket resulterer i et samlet resultatsæt, der ofte overgår effektiviteten af hver teknik, der bruges alene.

Kombinationen af vektor- og ikke-vektormateriale i samme indeks giver mulighed for en mere komplet og fleksibel søgeoplevelse.

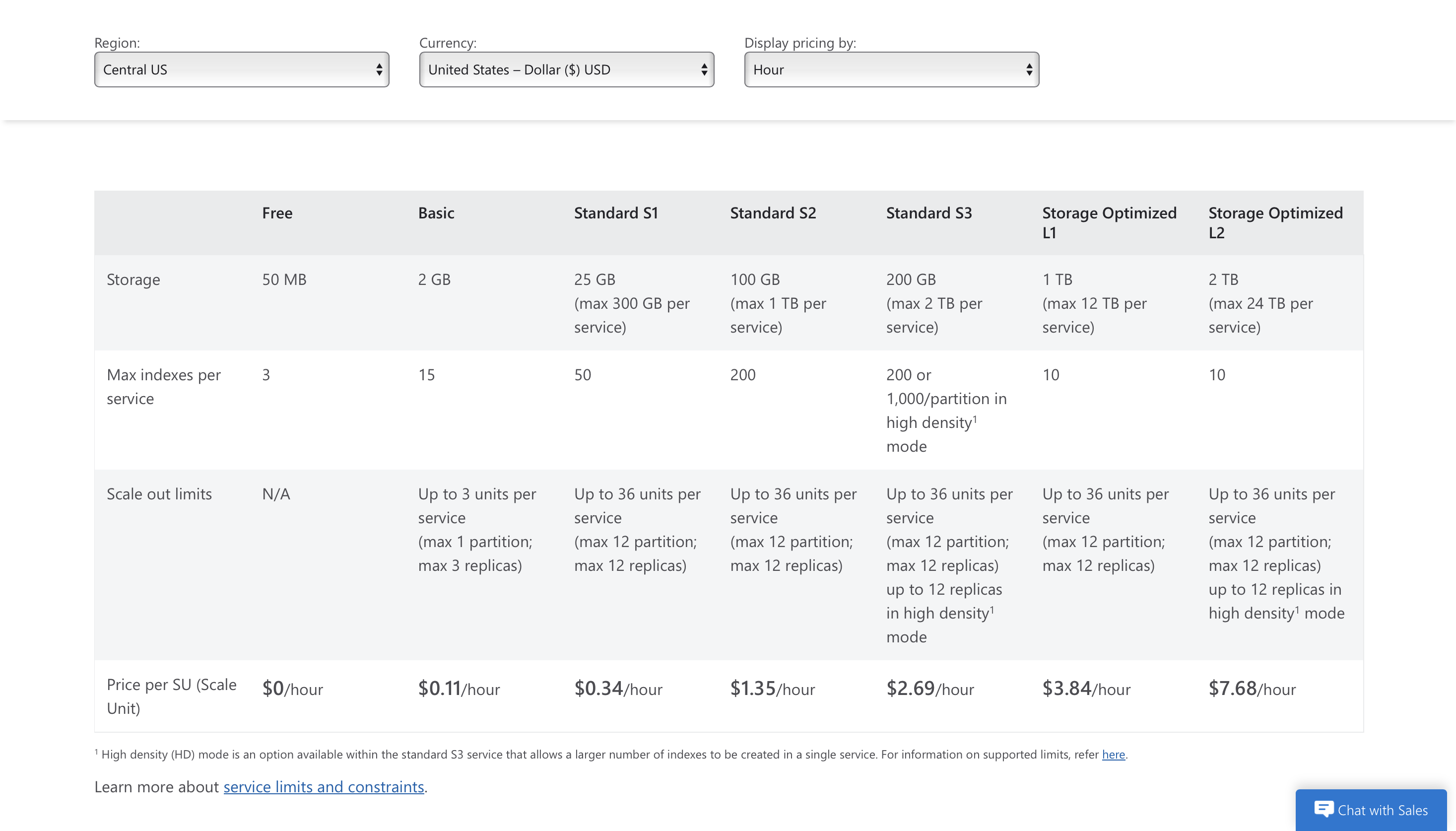

Vektorsøgefunktionen i Azure AI Search er bredt tilgængelig og gratis for alle Azure AI Search-niveauer.

Det er ekstremt fleksibelt til en række brugssager og udviklingspræferencer på grund af dets understøttelse af flere udviklingsmiljøer, som leveres via Azure-webstedet, REST API'er, og SDK'er til blandt andet Python, JavaScript og.NET.

Med sin dybe integration med Azure AI-økosystemet tilbyder Azure AI Search mere end blot søgning; det forbedrer også økosystemets potentiale for generative AI-applikationer.

Azure OpenAI Studio til modelindlejring og Azure AI Services til billedhentning er kun to eksempler på de tjenester, der er inkluderet i denne integration.

Azure AI Search er en fleksibel løsning for udviklere, der ønsker at inkorporere sofistikerede søgefunktioner i deres applikationer på grund af dens omfattende support, som muliggør en lang række applikationer, fra lighedssøgning og multimodal søgning til hybrid søgning og flersproget søgning.

Priser

Du kan begynde at bruge det gratis og premium-priser starter fra $0.11/time.

Konklusion

Vektordatabaser transformerer datastyring i AI ved at administrere højdimensionelle vektorer, hvilket giver mulighed for stærke lighedssøgninger og hurtige forespørgsler om nærmeste nabo i applikationer såsom anbefalingssystemer og svindeldetektion.

Med brug af sofistikerede indekseringsalgoritmer konverterer disse databaser komplicerede ustrukturerede data til meningsfulde vektorer, mens de giver den hastighed og fleksibilitet, som traditionelle databaser ikke gør.

Bemærkelsesværdige platforme inkluderer Pinecone, som skinner i generative AI-applikationer; FAISS, skabt af Facebook AI til tæt vektorklynger; og Milvus, som er kendt for sin skalerbarhed og cloud-native arkitektur.

Weaviate kombinerer maskinlæring med kontekstbevidst søgning, hvorimod Vespa og Chroma er bemærkelsesværdige for henholdsvis deres computeregenskaber med lav latens og brugervenlighed.

Vektordatabaser er vitale værktøjer til at udvikle AI og maskinlæringsteknologier, da platforme som Qdrant, AstraDB, OpenSearch og Azure AI Search leverer en række tjenester fra serverløse arkitekturer til omfattende søge- og analysefunktioner.

Giv en kommentar