Indholdsfortegnelse[Skjule][At vise]

Den nye og forbedrede AI har forbedret evner, forståelse og kapacitet til at producere billeder i højere opløsning. Du er måske for nylig stødt på nogle mærkelige og morsomme billeder, der flyder rundt på internettet.

En Shiba Inu-hund er klædt i en baret og en sort rullekrave. Og en havodder på samme måde som den hollandske maler Vermeers "Pige med en perleørering". Og der er en kop suppe, der ligner et uldent monster.

disse billeder blev ikke skabt af en menneskelig kunstner.

I stedet skabte DALL-E 2, et nyt AI-system, der kan konvertere tekstbeskrivelser til billeder.

Du skal blot skrive ned, hvad du vil se, og AI'en vil skabe det for dig – i levende detaljer, høj kvalitet og i nogle tilfælde ægte opfindsomhed. I dette indlæg vil vi tage et dybt kig på OpenAIs seneste undersøgelse, DALL.E 2, samt hvordan det virker og meget mere. Lad os komme igang.

Så hvad der præcist er DALL.E 2?

DALL-E 2 er en "generativ model", en type maskinlæringsalgoritme, der genererer kompliceret output i stedet for at udføre forudsigelses- eller klassifikationsopgaver på inputdata.

Du giver DALL-E 2 en skriftlig beskrivelse, og den skaber et billede, der svarer til den. Ved at kombinere koncepter, kvaliteter og stilarter kan OpenAI's DALLE 2 producere innovativ, realistisk grafik og kunst ud fra en grundlæggende sproglig beskrivelse.

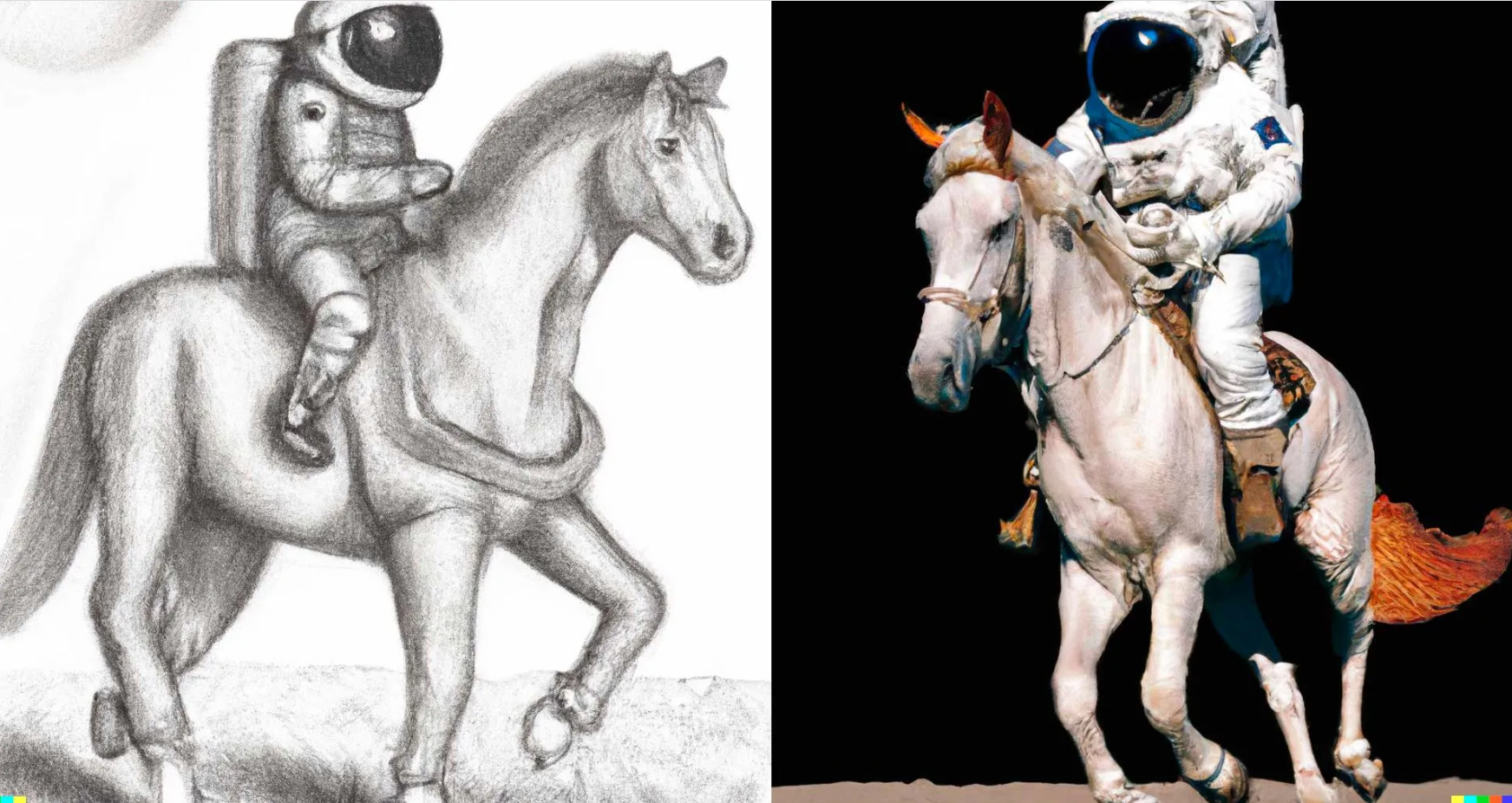

Den seneste version, DALLE 2, siges at være mere alsidig, i stand til at lave billeder fra billedtekster i højere opløsninger og i et bredere spektrum af kreative stilarter. For eksempel er billederne nedenfor (fra DALL-E 2 blogindlægget) skabt af beskrivelsen "En astronaut rider på en hest."

Den ene beskrivelse konkluderer "som en blyantskitse", mens den anden konkluderer "på en fotorealistisk måde."

Det kan også ændre eksisterende fotografier med forbløffende præcision. Så du kan tilføje eller slette elementer, mens du beholder farver, refleksioner og skygger, alt imens det originale billedes udseende bevares.

Hvordan virker det?

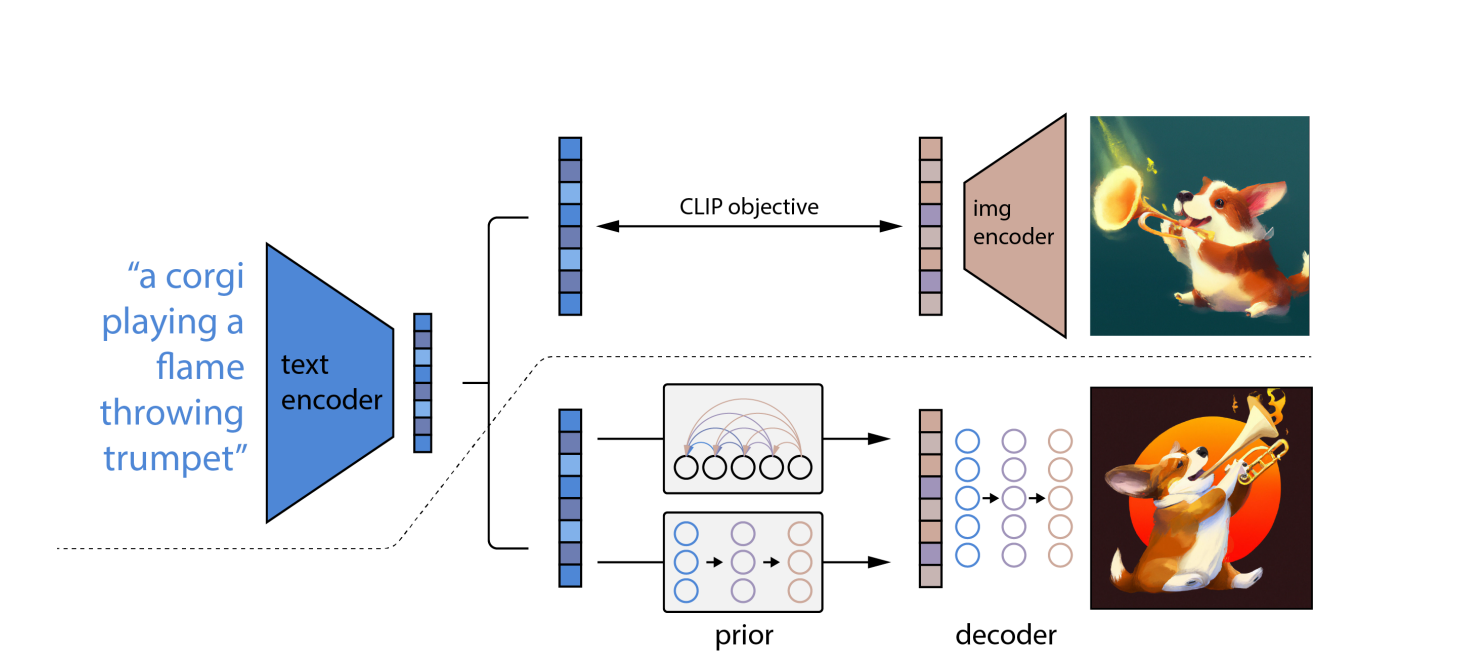

DALL-E 2 gør brug af CLIP og diffusionsmodeller, to sofistikerede dyb læring tilgange udviklet i de senere år. Det er dog baseret på samme forestilling som alle andre dybe neurale netværk: repræsentationslæring. CLIP træner to samtidigt neurale netværk på billeder og billedtekster.

Det ene netværk lærer de visuelle repræsentationer i billedet, mens det andet lærer tekstrepræsentationerne. Under træning forsøger de to netværk at ændre deres parametre, så sammenlignelige billeder og beskrivelser resulterer i lignende indlejringer.

"Diffusion", en type generativ model, der lærer at lave billeder ved gradvist at støje og forringe dens træningsprøver, er den anden maskinlæringstilgang, der anvendes i DALL-E 2. Diffusionsmodeller ligner autoencodere, idet de transformerer inputdata til en indlejringsrepræsentation og brug derefter indlejringsoplysningerne til at genskabe de originale data.

Bruger OpenAI'er sprogmodel CLIP, som kan forbinde tekstlige beskrivelser med fotografier, oversætter først den skriftlige prompt til en mellemform, der inkorporerer de afgørende egenskaber, som et billede skal have for at matche den prompt (ifølge CLIP).

For det andet opretter DALL-E 2 en CLIP-kompatibel billede ved hjælp af en diffusionsmodel, som er et neuralt netværk.

På forvrængede billeder med tilfældige pixels læres diffusionsmodeller. De lærer at gendanne billedernes oprindelige form. Diffusionsmodeller kan producere syntetiske billeder af høj kvalitet, især når de bruges sammen med en vejledende tilgang, der prioriterer nøjagtighed frem for mangfoldighed.

Som en konsekvens heraf diffusionsmodel tager de tilfældige pixels og bruger CLIP til at konvertere dem til et nyt billede, der matcher ordprompten. På grund af diffusionskonceptet kan DALL-E 2 producere billeder i højere opløsning hurtigere end DALL-E.

DALL.E 2 use case

I de sidste tyve år, computersyn teknologien er gået fra en simpel idé til et stort gennembrud. På trods af disse fremskridt står billed- og objektgenkendelsesmodeller stadig over for betydelige forhindringer i hverdagen. Fraværet af datasæt er en af de væsentligste ulemper ved billedgenkendelse og computersyn. Fordi der er datamangel i begge ender, er det næsten svært at træne billedgenkendelsesmodeller til at give 100 procent nøjagtige resultater.

Heldigvis kan OpenAIs nye machine learning-model bygge bro over kløften i teknologien. DALLE 2 er i stand til at generere fantastiske billeder baseret på tekstbeskrivelser. Denne falske billedproduktion kan levere data til billedgenkendelsesmodeller baseret på deres krav. Fraværet af data er en væsentlig anstødssten for objekt- og billedidentifikation.

I den digitale æra er datasæt allestedsnærværende, men vi leder stadig efter genveje til at fodre AI-modellen, så den kan give gode resultater. Det er dog ikke nemt at træne en billedgenkendelsesmodel. Det kræver et stort antal datasæt med små forskelle, som vi måske ikke har været i stand til at hente blot.

Så hvad er svaret: Svaret er DALLE 2. OpenAI-billedgeneratoren kan med sin kapacitet til at producere billeder ud fra tekster og ændre eksisterende, være med til at bygge bro over kløften. Dette vil hjælpe med at generere yderligere træningsdata og samtidig reducere mængden af krævet menneskelig mærkning. På trods af den betydelige fordel, bør du være opmærksom på svigagtige billedproduktioner og billeder, der udelukker inklusion. Dette kan føre til billeddetekteringsmetoder, der giver skæve resultater.

Begrænsninger

DALL.E 2 kan meget vel have en skadelig indflydelse, hvis den falder i de forkerte hænder, ifølge OpenAI. I dagens verden af dybe forfalskninger kunne modellen nemt bruges til at sprede falsk information eller racistiske billeder, hvorfor OpenAI kun tillader udviklere at bruge DALL.2 efter invitation. Modellen skal overholde en streng indholdsbegrænsning for alle forslag, hun får.

For at udelukke potentialet i, at DALL.E 2 skaber fjendtlige eller voldelige billeder, blev datasættet oprettet uden dødbringende våben. Mens OpenAI har udtalt, at det planlægger at omdanne det til et API i fremtiden, er det i tilfælde af DALL.E 2 villig til at fortsætte med forsigtighed.

Konklusion

DALL-E 2 er en anden interessant OpenAI forskningsopdagelse, der åbner døren til nye applikationer.

Et eksempel er at skabe massive datasæt for at imødekomme en af computervisions største flaskehalse – data. Mens den økonomiske sag for mange DALL-E-baserede apps vil blive bestemt af den pris og politikker, som OpenAI etablerer for sine API-brugere, vil de alle uden tvivl fremme billedproduktionen.

Giv en kommentar