Taula de continguts[Amaga][Espectacle]

No és nou tenir fotos i vídeos falsos. Des de l'ús generalitzat d'Internet, les persones han anat creant falsificacions destinades a enganyar o divertir des que hi ha imatges i pel·lícules.

Tanmateix, hi ha un nou tipus de falsificacions produïdes per màquina que algun dia ens pot dificultar distingir la realitat de la ficció.

Aquestes falsificacions difereixen de les simples manipulacions d'imatges generades per programari d'edició com Photoshop o les pel·lícules intel·ligents del passat.

Els deepfakes són l'exemple més conegut de "mitjans sintètics": imatges, sons i vídeos que sembla que s'han produït amb mètodes convencionals, però que realment s'han fet amb un programari sofisticat.

Els deepfakes fa temps que existeixen i, tot i que la seva aplicació més popular fins ara ha estat posar el cap de persones famoses als cossos dels actors de pel·lícules pornogràfiques, tenen la capacitat de produir imatges convincents de qualsevol persona fent qualsevol cosa, en qualsevol lloc.

En aquesta publicació, veurem Deepfakes, com funciona, com podeu generar-los pel vostre compte i molt més.

Aleshores, què és DeepFake?

Un deepfake, una combinació de les frases aprenentatge profund i fals, n'és una part mitjans sintètics en què la semblança d'una altra persona s'utilitza per substituir la d'una persona en una fotografia o vídeo ja existent.

Deepfakes utilitzen tècniques sofisticades d'aprenentatge automàtic i intel·ligència artificial per modificar i crear informació visual i d'àudio que té un alt potencial d'engany.

Els mètodes d'aprenentatge profund com els codificadors automàtics i les xarxes adversàries generatives són el mecanisme principal per a la producció de deepfake (GAN).

Aquests models s'utilitzen per analitzar les emocions i moviments facials d'una persona i sintetitzar imatges facials d'altres persones amb expressions i moviments comparables.

L'ús de deepfakes en vídeos pornogràfics de celebritats, notícies falses, enganys i fraus financers ha cridat una atenció considerable. Tant la indústria com el govern han respost intentant trobar-los i limitar-ne l'ús.

Model de moviment de primer ordre

Quan vam intentar desenvolupar falsificacions profundes en el passat, el problema era que necessitem algun tipus de coneixement addicional, o previs, perquè aquests enfocaments funcionin.

A tall d'il·lustració, es necessiten marcadors facials si volem traçar el moviment del cap. L'estimació de la posició era necessària si volíem mapejar el moviment de tot el cos.

Això va canviar a la conferència NeurIPS l'any passat quan l'equip de recerca de la Universitat de Toronto va presentar el seu treball ",Model de moviment de primer ordre per a animació d'imatges".

No calen més coneixements d'animació per a aquest enfocament. A més, un cop s'ha entrenat aquest model, es pot utilitzar per a l'aprenentatge de transferència i aplicar-se a qualsevol element de la mateixa categoria.

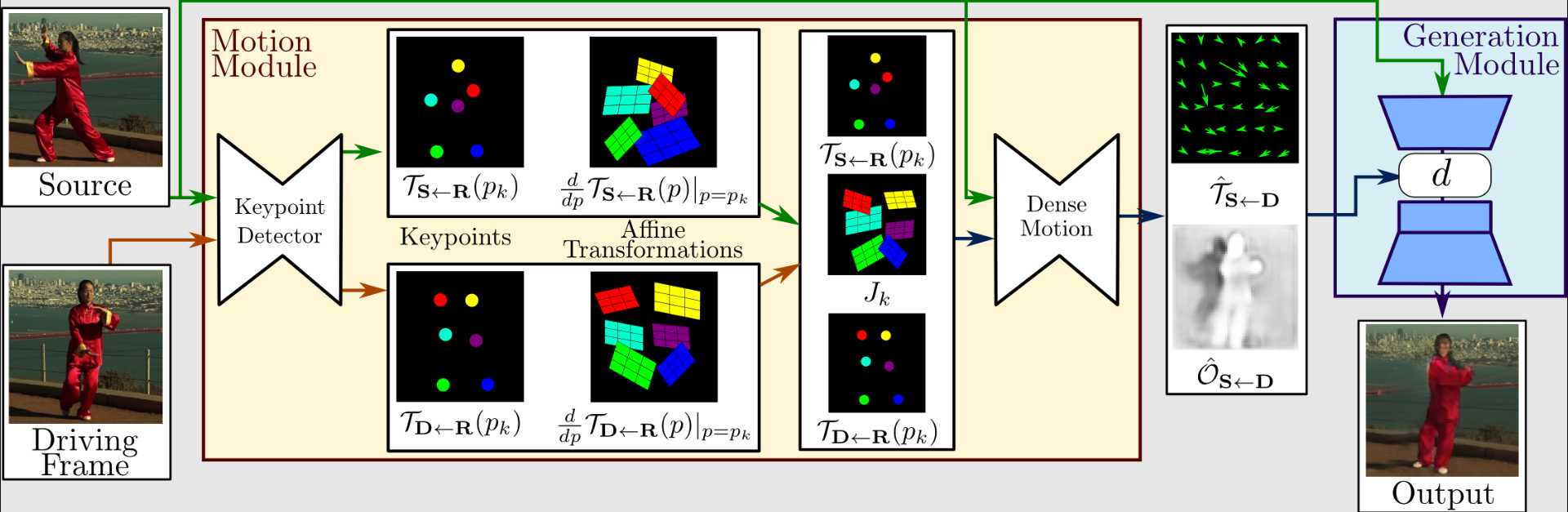

Vegem una mica més el funcionament d'aquest mètode. L'extracció i la generació de moviment constitueixen la primera meitat de tot el procés. El vídeo de conducció i les imatges font s'utilitzen com a entrades.

Per extreure la representació de moviment de primer ordre, que consisteix en punts clau escassos i transformacions afins locals, un extractor de moviment utilitza un codificador automàtic per identificar punts clau.

Per crear un flux òptic dens i un mapa d'oclusió amb la xarxa de moviment dens, s'utilitzen juntament amb el vídeo de conducció. A continuació, el generador representa la imatge objectiu utilitzant les sortides de la xarxa de moviment dens i la imatge d'origen.

En general, aquest treball funciona millor que l'estat de la tècnica. També conté característiques que altres models simplement no tenen. Funciona en diversos tipus d'imatges, de manera que podeu aplicar-la a imatges de la cara, el cos, els dibuixos animats, etc., la qual cosa és molt gran.

Això crea moltes oportunitats noves. Un altre aspecte innovador de la nostra estratègia és que ara us permet produir Deepfakes d'alta qualitat utilitzant només una imatge de l'objecte objectiu, de manera similar a com ho fem amb YOLO per a objecte reconeixement.

Procés de creació del model Deepfake

Són necessaris tres processos per a la generació de deepfake: extracció, formació i creació. En aquesta secció es tractaran els punts principals de cadascuna d'aquestes etapes i com es relacionen amb el procés global.

Extracció

Els deepfakes utilitzen xarxes neuronals profundes per canviar de cares i necessiten moltes dades (imatges) per funcionar correctament i de manera convincent. El procés d'extracció és l'etapa en què s'extreuen tots els fotogrames dels clips de vídeo, es reconeixen les cares i les cares s'alineen per maximitzar el rendiment.

Formació

En la fase de formació, el xarxa neural pot canviar una cara per una altra. Depenent de la mida del conjunt de pràctiques i del gadget d'entrenament, l'entrenament pot durar diverses hores o fins i tot dies.

L'entrenament només s'ha d'acabar una vegada, com la majoria dels altres entrenaments de xarxes neuronals. Després de l'entrenament, el model podria canviar la cara de la persona A a la persona B.

Creació

Després d'haver entrenat el model, es podria produir un deepfake. Els fotogrames es prenen d'un vídeo i després s'alineen a totes les cares. A continuació, s'utilitza la xarxa neuronal entrenada per transformar cada fotograma.

La cara transformada s'ha de combinar amb el marc original com a darrer pas.

Construcció del model de detecció de Deepfake

Muntatge i clonació de GitHub Repo

Poder utilitzar les GPU de Google de forma gratuïta mentre treballa a Colab és avantatjós aprenentatge profund. Un avantatge addicional és la possibilitat de muntar un Google Drive en una màquina virtual (VM) al núvol.

Amb un fàcil accés a totes les seves coses, l'usuari està habilitat. El programa necessari per muntar Google Drive a la màquina virtual al núvol es trobarà en aquesta secció.

Importació de mòduls

Ara importarem tots els mòduls necessaris.

Execució del model

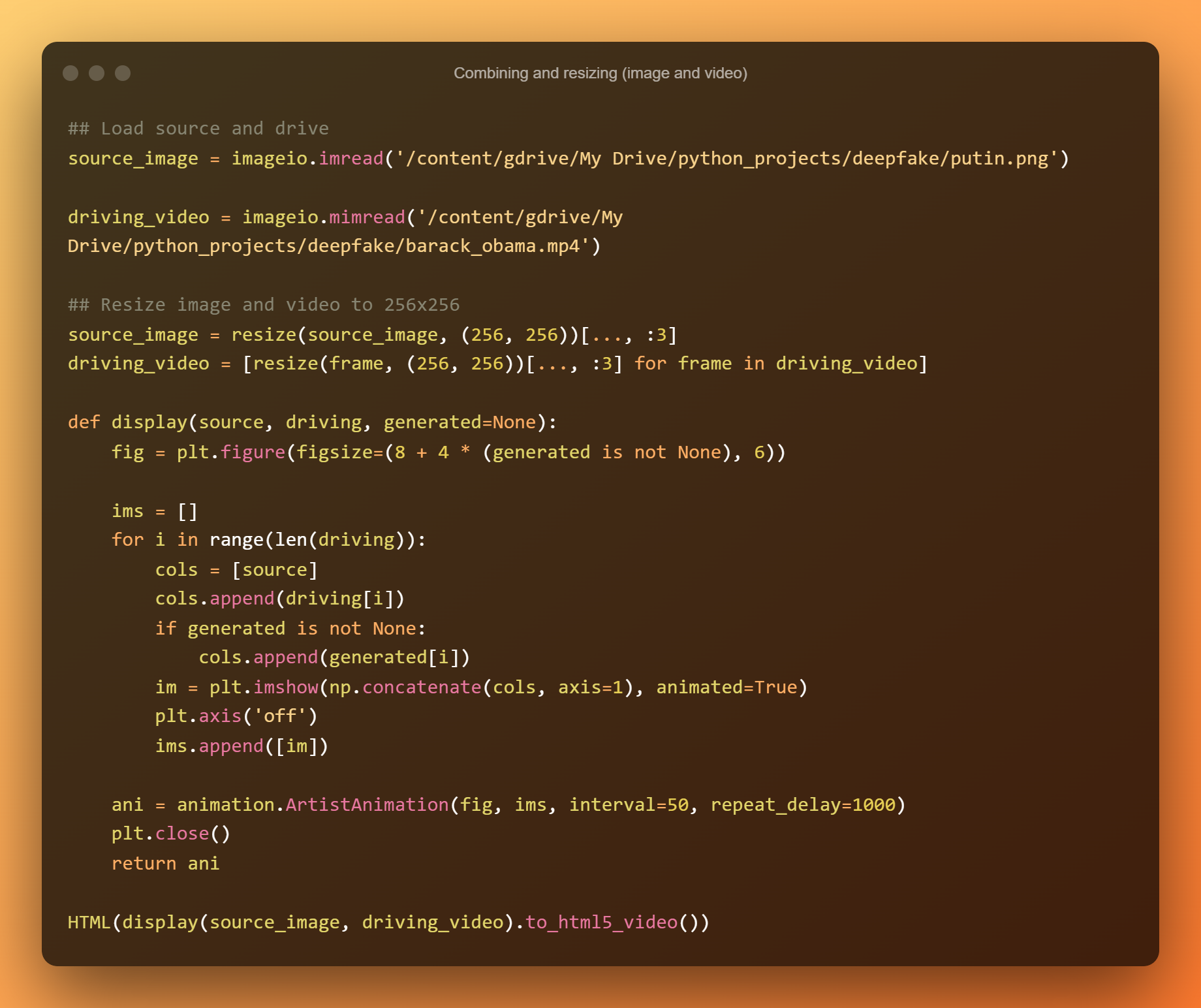

Farem servir un exemple que combina una foto fixa de Putin (imatge font) amb un vídeo d'Obama. El resultat és un vídeo de Putin parlant i gesticulant amb les mateixes expressions facials que Obama va utilitzar mentre conduïa.

Abans de mostrar el resultat del model, es carregarà el suport i es declararan les funcions. Després es carregaran els punts de control i es construirà el model. Després de crear el fals profund, es mostraran dos estils diferents d'animació.

Putin està animat pels moviments d'Obama que utilitzen el desplaçament relatiu de punts clau. La manera com les emocions facials i el llenguatge corporal d'Obama es representen de manera bella i clara per a Putin durant els seus vídeos és sorprenent.

Hi ha alguns errors microscòpics, sobretot quan Obama aixeca les celles i parpelleja els ulls. Aquestes expressions no es reprodueixen exactament en els marcs de Putin.

Sense el teló de fons fals, la pel·lícula de Putin semblaria bastant creïble i autèntica si es veiés a la televisió o mitjans de comunicació social.

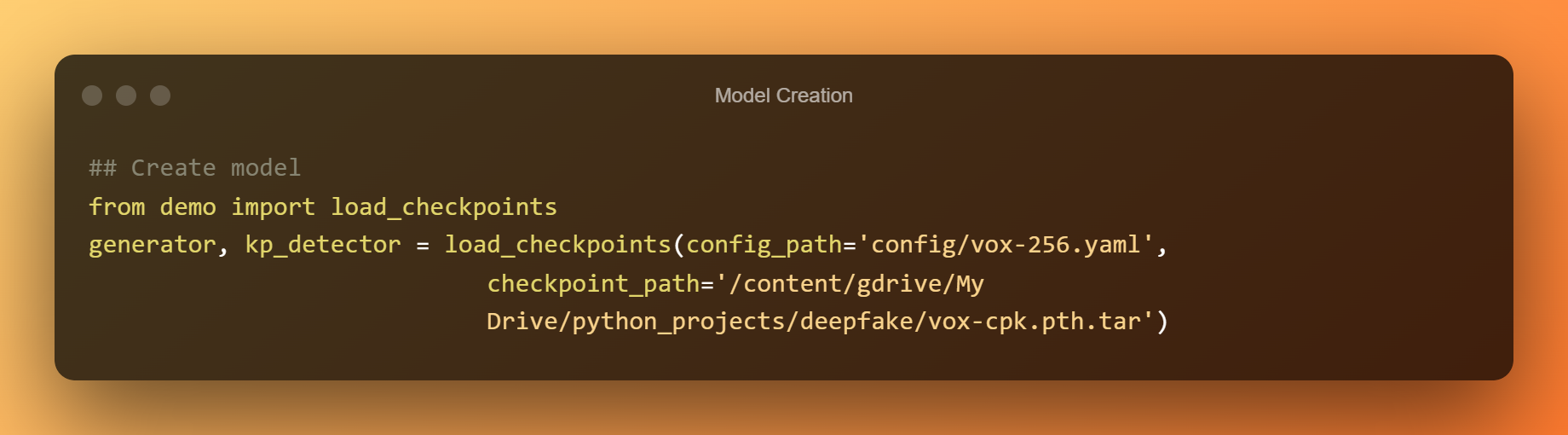

Creació de maquetes

Ara, utilitzarem els punts de control prèviament entrenats per crear un model complet.

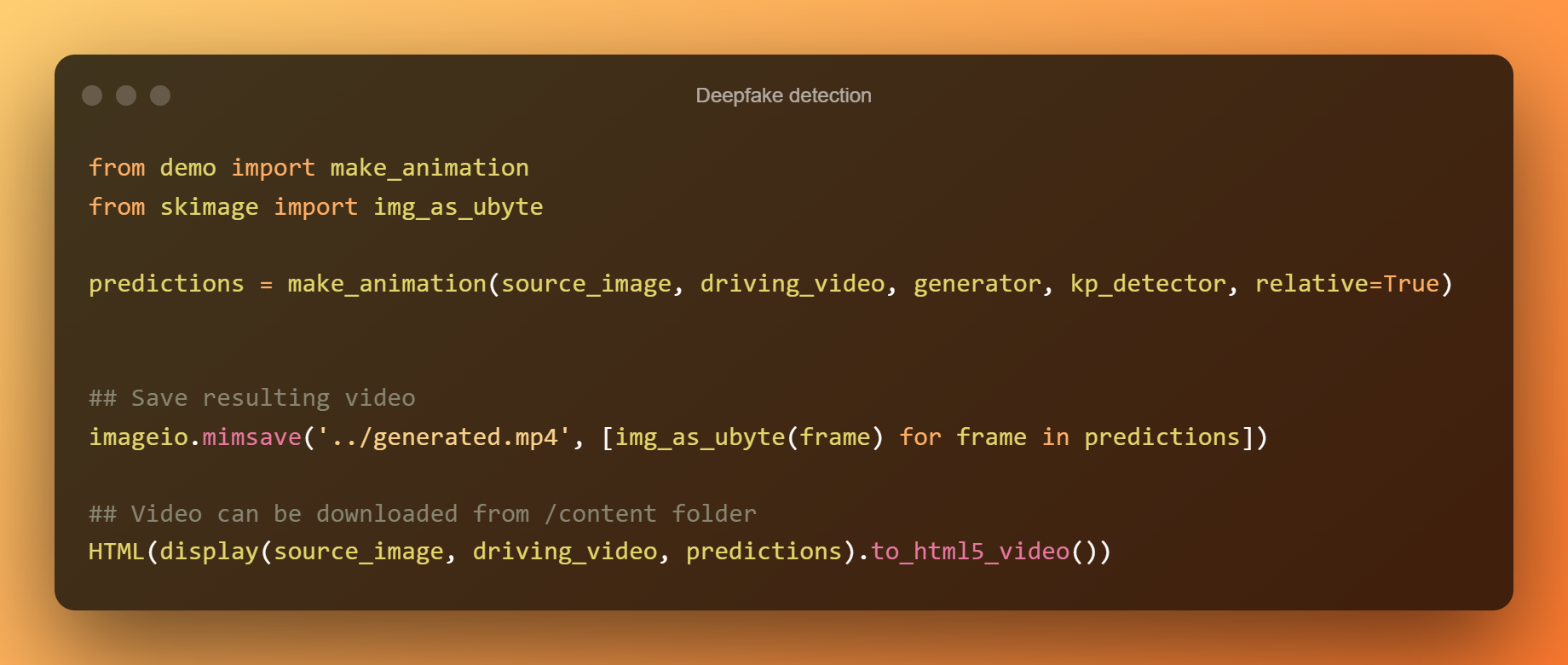

Detecció de deepfake

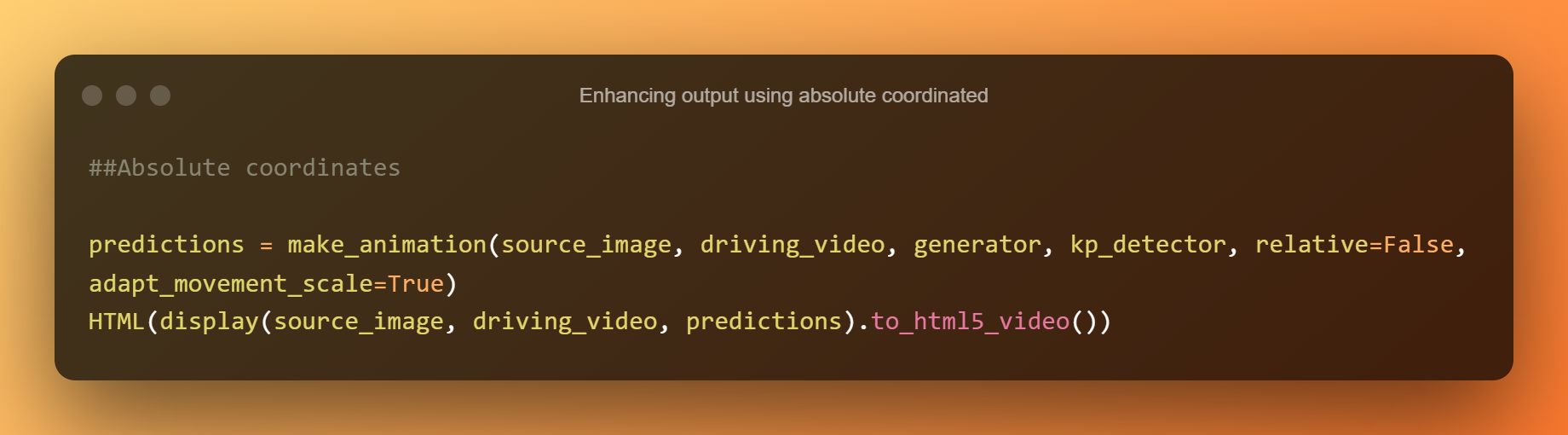

El desplaçament relatiu del punt clau s'utilitza per animar els elements de la cel·la següent. La següent cel·la utilitza coordenades absolutes, però totes les proporcions de l'element es prendran del vídeo de conducció d'aquesta manera.

Millora de la sortida mitjançant coordenades absolutes

Podreu desenvolupar una detecció de deepfake d'aquesta manera.

Quins són els riscos de la tecnologia Deepfake?

Els vídeos deepfake ara són atractius i entretinguts de veure a causa de la seva novetat. Tanmateix, hi ha el risc que es pugui descontrolar sota la superfície d'aquesta tecnologia aparentment divertida.

Sens dubte, serà difícil distingir entre vídeos falsos i reals tecnologia deepfake segueix avançant. Per a personalitats i celebritats destacades, en particular, això pot tenir efectes greus. Els deepfakes que són intencionadament malèvols tenen el potencial de danyar completament les carreres i les vides.

Aquests poden ser utilitzats per algú amb intenció maligna per passar per altres i aprofitar-se dels seus amics, familiars i companys de feina. També són capaços de provocar controvèrsies mundials i fins i tot guerres utilitzant pel·lícules falses de líders estrangers.

Conclusió

En resum, estem en un període estrany i un entorn inusual. Més que mai, és senzill produir notícies i pel·lícules falses i difondre-les. Entendre què és veritat i què no és cada cop més difícil.

Avui, sembla, ja no podem confiar en els nostres propis sentits.

Malgrat que s'han desenvolupat detectors de vídeo falsos, és només qüestió de temps que la bretxa d'informació sigui tan estreta que fins i tot els millors detectors falsos no podran determinar si el vídeo és real o no.

Deixa un comentari