Kako bi se prikupile informacije sa web stranica za analizu, istraživanje ili marketinške ciljeve, web scraping je ključna tehnika. Srećom, postoje brojni alati koji podržavaju i headless i headful pretraživače, koji su oboje korisni za web scraping.

Headful pretraživači dolaze sa grafičkim korisničkim interfejsom (GUI), dok headless pretraživači nemaju. Ove tehnologije mogu i ručno i automatski izdvajati podatke sa web stranica, što ih čini vrlo korisnim.

Kada rukujete velikim brojem podataka, pretraživači bez glave su najbolja opcija. Da biste automatizirali proces ekstrakcije podataka, trebat će vam ovi alati koji će vam uštedjeti tonu vremena i posla.

Osim toga, oni vam pomažu da poboljšate preciznost i učinkovitost ekstrakcije podataka, što bi moglo rezultirati općenito plodnijim rezultatima.

Ovi alati također mogu pomoći u smanjenju mogućnosti pojave grešaka pri ručnom kopiranju i lijepljenju podataka jer imaju kapacitet izdvajanja podataka na organiziran način.

Jednostavno rečeno, nemoguće je raditi bez alata koji podržavaju i headless i headful pretraživače ako se bavite web scrapingom.

U ovom članku ćemo pogledati vrhunske pretraživače bez glave i glave za web scraping.

1. Bright Data

Bright Data je program za scraping weba koji pruža mogućnosti za prikupljanje podataka za preduzeća i pojedince. Za razliku od ranijih sistema za grebanje na mreži, Bright Data dolazi sa predučitanim brojnim pretraživačima, ali funkcioniše kao pretraživač bez glave.

Iako radi kao pretraživač bez glave na pozadini, to ukazuje na činjenicu da korisnici mogu komunicirati s njim preko grafičkog korisničkog interfejsa (GUI), što ga čini pristupačnijim i lakšim za upotrebu.

Ova funkcionalnost će biti posebno korisna za one koji ne znaju mnogo o kodiranju ili žele jednostavniji pristup web scrapingu. Korisnici mogu brzo da se kreću po složenim veb lokacijama sa interakcijama nalik ljudima zahvaljujući Bright Data pretraživaču.

Kako biste bili anonimni i neotkriveni, on također pruža vrhunske mogućnosti kao što su rotacija IP-a, otisak prsta u pretraživaču i lažiranje korisničkog agenta. Uz korištenje umjetne inteligencije, Scraping Browser će moći nadmašiti čak i najnaprednije zaštite detekcije botova.

U stvari, Scraping Browser je toliko sofisticiran da čak može simulirati radnje pretraživača pravog korisnika, pružajući vam uspješnije rezultate i preciznije podatke.

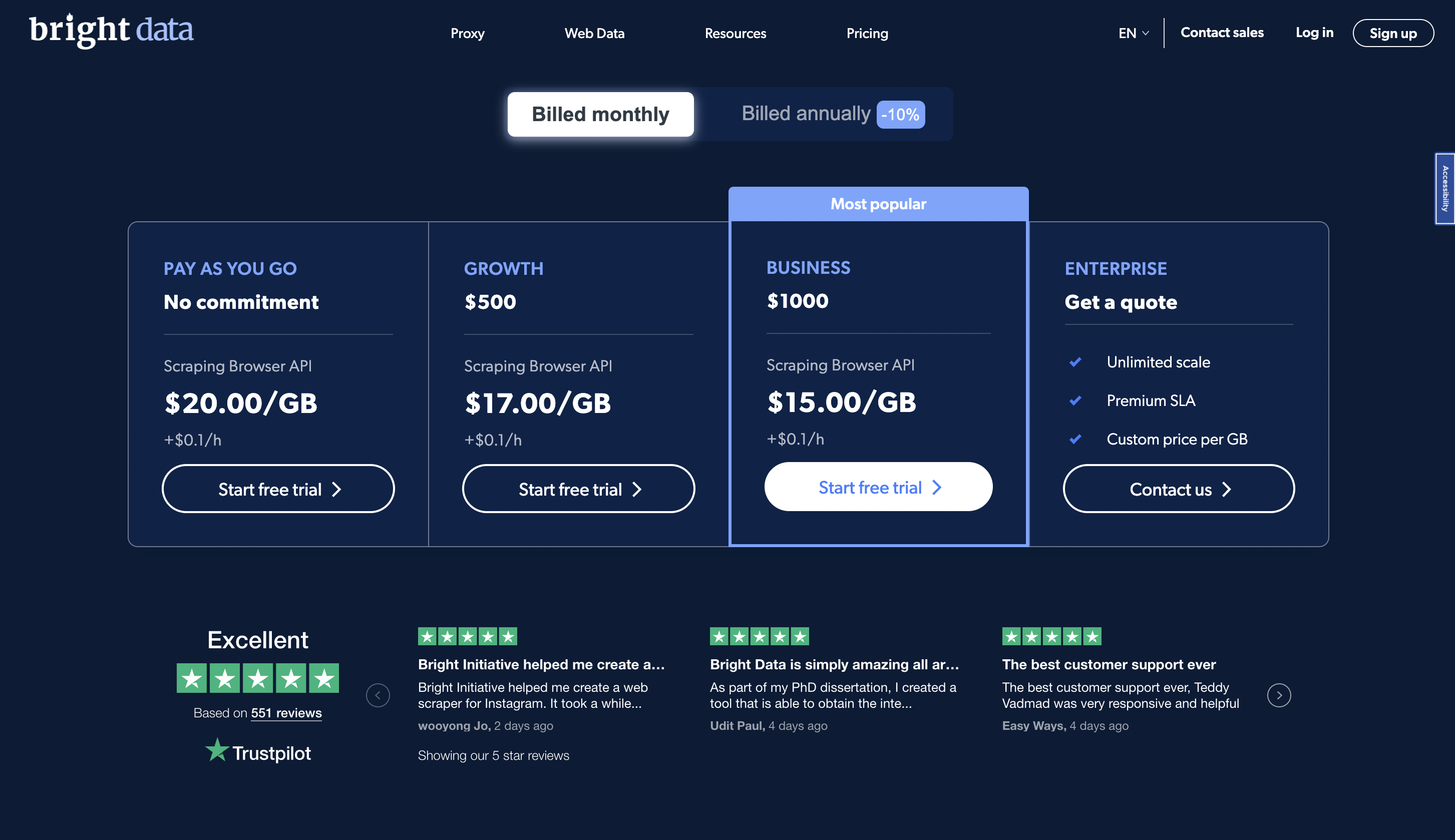

Cijene

Platformu možete isprobati besplatno, a premium cijene počinju od 20 USD/GB u okviru pay-as-you-go plana.

2. Zyte

Kao dobavljač online alata za scraping, Zyte—ranije poznat kao Scrapinghub—dopušta kompanijama da hvataju i analiziraju internet podatke u velikom obimu.

Zyte-ova internetska platforma za scraping napravljena je za rukovanje čak i najkomplikovanijim i najdinamičnijim web stranicama i uključuje niz vrhunskih funkcija kao što su automatska rotacija IP-a, otisak prsta u pretraživaču i lažiranje korisničkog agenta kako bi se jamčilo da vaše operacije scrapinga ostanu privatne i neprimijećene.

Činjenica da Zyte-ova web platforma podržava i bezglavo i bezglavo surfanje jedna je od njegovih karakterističnih prednosti. Pretraživač radi u bezglavom načinu rada u pozadini bez grafičkog korisničkog interfejsa, što povećava njegovu efikasnost za opsežne operacije scraping-a.

Međutim, pretraživač radi sa GUI-om u headful modu, što bi moglo biti korisno kada trebate izvući podatke sa web stranica sa složenim korisničkim sučeljima.

Osim toga, budući da je Zyteova platforma zasnovana na besplatnoj Scrapy osnovi otvorenog koda, može se prilagoditi vašim specifičnim potrebama i izuzetno je konfigurabilna. Možete brzo i jednostavno dohvatiti podatke koje želite koristeći Zyte, pružajući vam konkurentsku prednost u vašem poslovanju.

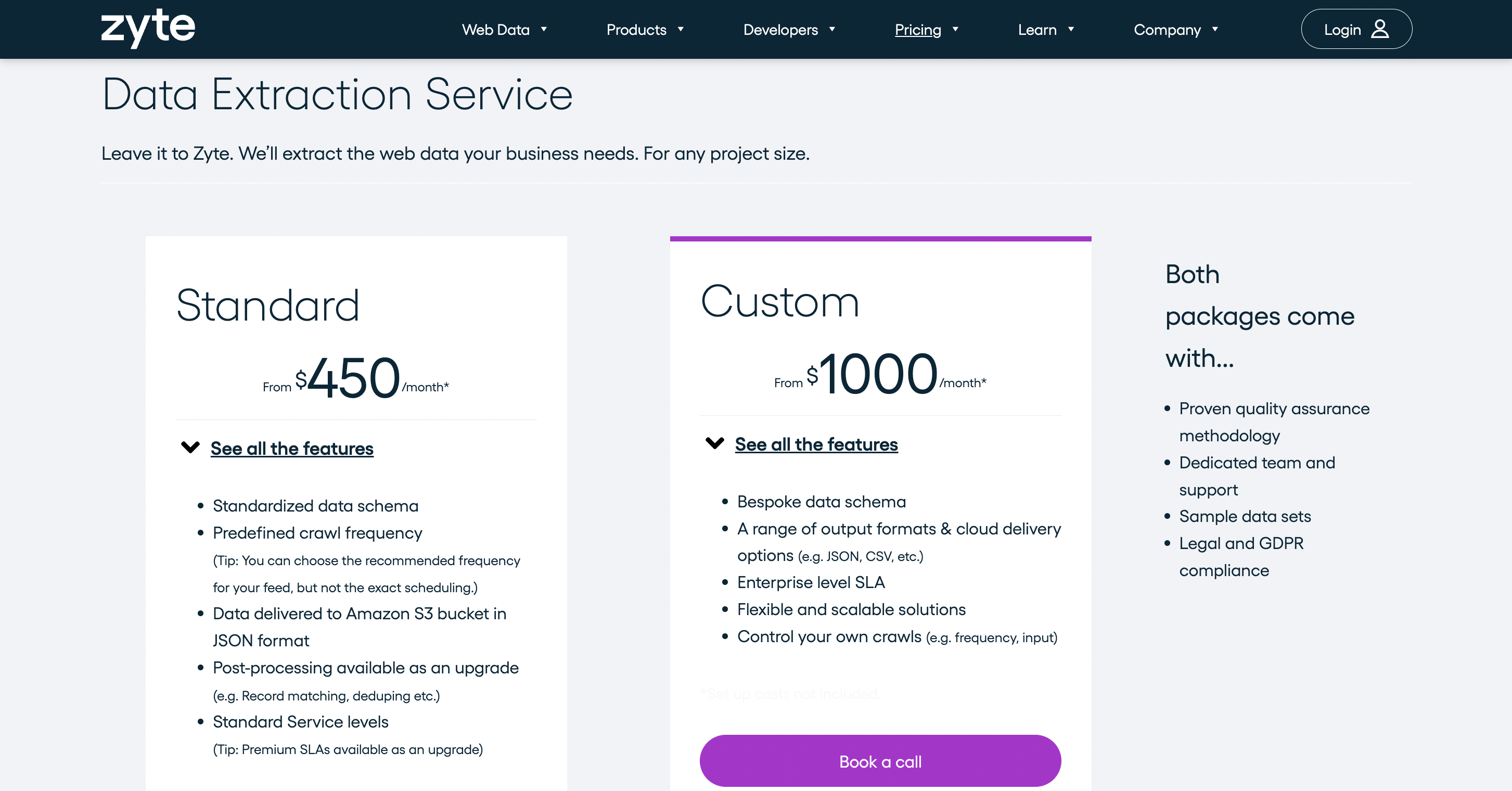

Cijene

Nudi više planova cijena i naplaćuje 450 USD mjesečno za uslugu ekstrakcije podataka.

3. Octoparse

Možete prikupljati podatke sa web stranica bez pisanja bilo kakvog koda pomoću Octoparsea, aplikacije za web scraping baziranu na oblaku. Svako ko želi da izvuče tekst, fotografije ili video zapise može ih lako izabrati zahvaljujući korisničkom interfejsu.

Octoparse je fleksibilan alat koji podržava i bezglavo i bezglavo pregledavanje, najbolja je opcija za web scraping projekte bilo koje veličine i složenosti. Mogućnost grebanja dinamičkih i interaktivnih web stranica, što može biti teško za mnoge druge programe za scraping web stranica, jedna je od njegovih najjačih karakteristika.

Možete kreirati složene procese scraping-a s brojnim fazama, uslovnim izjavama i petljama, povećavajući fleksibilnost i prilagodljivost scraping-a. Excel, CSV i SQL su samo neki od formata za izvoz koje Octoparse pruža, što olakšava korištenje ekstrahiranih podataka u drugim programima.

Osim toga, Octoparse ima integrirani proxy pool koji osigurava anonimno scraping i pomaže u izbjegavanju zabrane IP-a.

Cijene

Možete ga početi koristiti besplatno, a premium cijene počinju od 89 USD mjesečno.

4. Apify

Apify je sve-u-jednom platforma za web skraping i automatizaciju koja nudi niz moćnih funkcija. Podržava i headless i headful pretraživače i ima intuitivno korisničko sučelje koje čak i netehničkim korisnicima olakšava kreiranje zadataka scrapinga.

Sposobnost Apify-a da se nosi s teškim poslovima scrapinga, podrška za nekoliko jezika i skaliranje za rukovanje velikim projektima scrapinga su neke od njegovih najboljih karakteristika.

Osim toga, Apify pruža pristup velikom tržištu gotovih strugača koji se mogu brzo prilagoditi vašim jedinstvenim zahtjevima.

Sa svojom podrškom za pretraživače bez glave, Apify može navigirati kroz izazovna korisnička sučelja i crpiti podatke sa dinamičkih web stranica, dok brzo i efikasno izdvaja informacije iz ogromnih količina podataka.

Apify je koristan alat za razne online aplikacije za scraping, uključujući stvaranje potencijalnih klijenata, analizu konkurencije, istraživanje tržišta i agregaciju sadržaja.

Apify povećava tačnost i efikasnost uz uštedu vremena i truda automatizacijom procesa ekstrakcije podataka. To je snažan alat za tehničke i netehničke korisnike zbog svoje funkcionalnosti i dizajna prilagođenog korisniku.

Cijene

Možete ga početi koristiti besplatno, a premium cijene počinju od 49 USD mjesečno.

5. ScrapingBee

Izvanredna internetska aplikacija za scraping ScrapingBee olakšava automatizaciju procesa ekstrakcije podataka sa web stranica.

Njegove mogućnosti, kao što su one za rukovanje JavaScript renderovanjem, CAPTCHA rezoluciju i rotaciju korisničkog agenta, omogućavaju da se zaobiđe odbrana veb lokacija protiv grebanja. što ga čini odličnom opcijom za zadatke grebanja weba.

Korisnici imaju veliki stepen slobode sa ovim alatom jer radi i sa bezglavim i bezglavim pretraživačima. Važno je istaći da ScrapingBee podrazumevano koristi pretraživače bez glave, što je savršeno za automatsko preuzimanje ogromnih količina podataka.

Za interakciju s web lokacijama koje imaju složeno sučelje, korisnici se mogu prebaciti na potpune pretraživače. Kako bi osigurao efektivnu ekstrakciju podataka, ScrapingBee također održava skup geolociranih proksija koji se redovno provjeravaju i mijenjaju.

Korisnici mogu smanjiti vrijeme i trud tokom web scraping-a korištenjem ScrapingBee-a kao pretraživača bez glave ili bez glave dok i dalje jamči ispravnost i potpunost preuzetih podataka. Takođe ima mnogo korisnih funkcija, kao što su formatiranje podataka, rotacija proxy servera i API povezivanje, što ga čini praktičnim alatom i za kompanije i za studente.

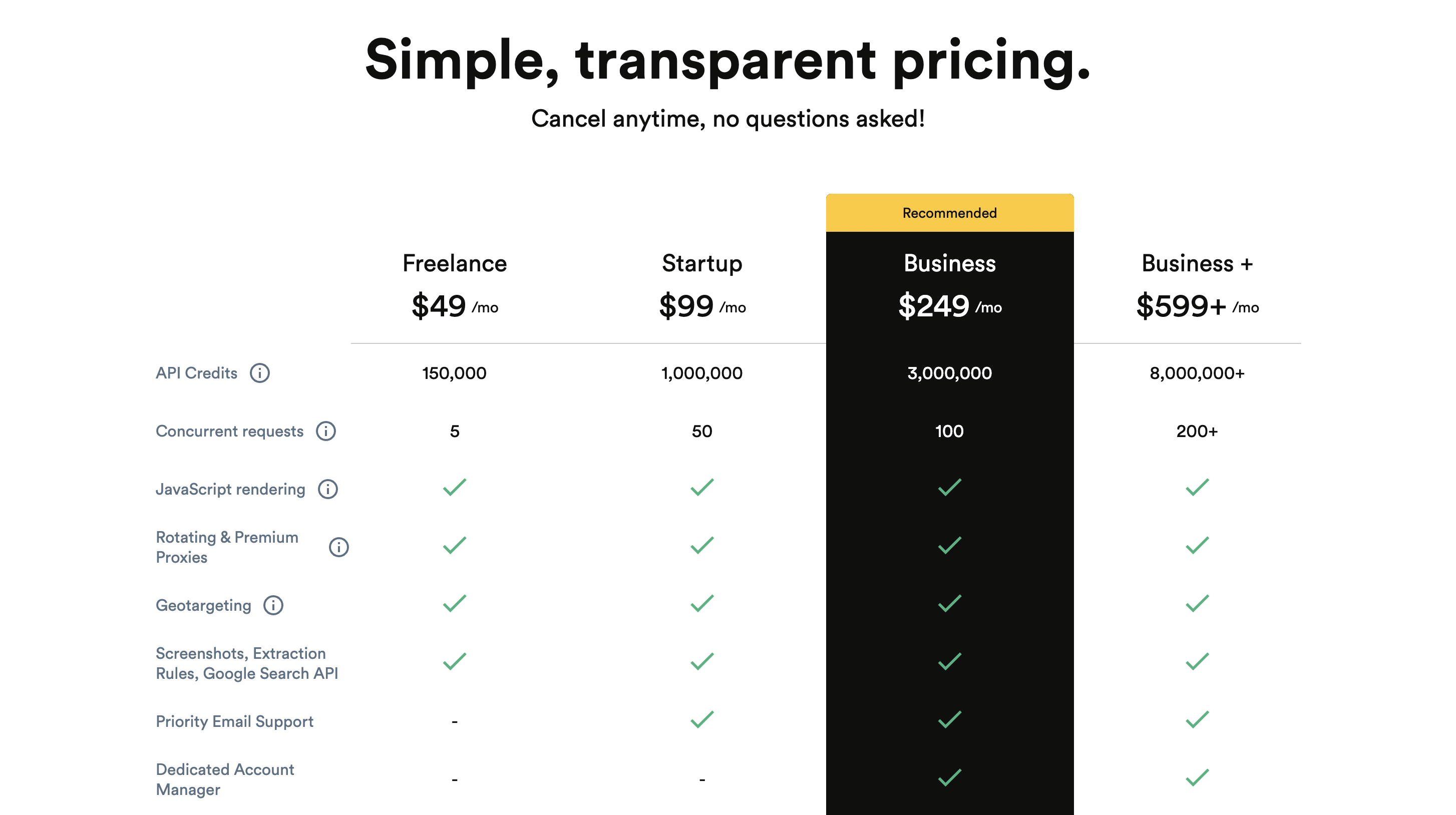

Cijene

Premijum cijene počinju od 49 USD mjesečno.

6. ParseHub

Bez potrebe za tehničkom ekspertizom, korisnici mogu prikupljati podatke sa web stranica pomoću aplikacije ParseHub. Jedna od njegovih najvećih karakteristika je koliko je jednostavan za korištenje; korisnici mogu da izaberu podatke koje žele da izgrebu jednostavnim klikom na stavke.

Takođe, ima mogućnost automatskog prepoznavanja paginacije, što korisnicima olakšava da izvlače informacije sa nekoliko stranica. Kako bi izvukao podatke sa web lokacija sa osnovnim ili komplikovanim korisničkim interfejsom, ParseHub podržava i headless i headful pretraživače.

Osim toga, omogućava automatsku rotaciju IP-a, što otežava web lokacijama da identifikuju i zabrane aktivnost scrapinga. ParseHub garantuje da se podaci ekstrahuju na organizovan način uz pomoć svojih opsežnih mogućnosti formatiranja podataka, što ih čini jednostavnijim za analizu i integraciju sistema.

Uz to, ParseHub ima pametni način rada koji automatski prepoznaje i prikuplja informacije sa sličnih web stranica. ParseHub može prepoznati i prikupiti podatke sa web stranica sa sličnim strukturama, kao što su web stranice e-trgovine, koristeći umjetne inteligencije (AI). Ova funkcija povećava preciznost i produktivnost zahtijevajući manje truda i uštedu vremena.

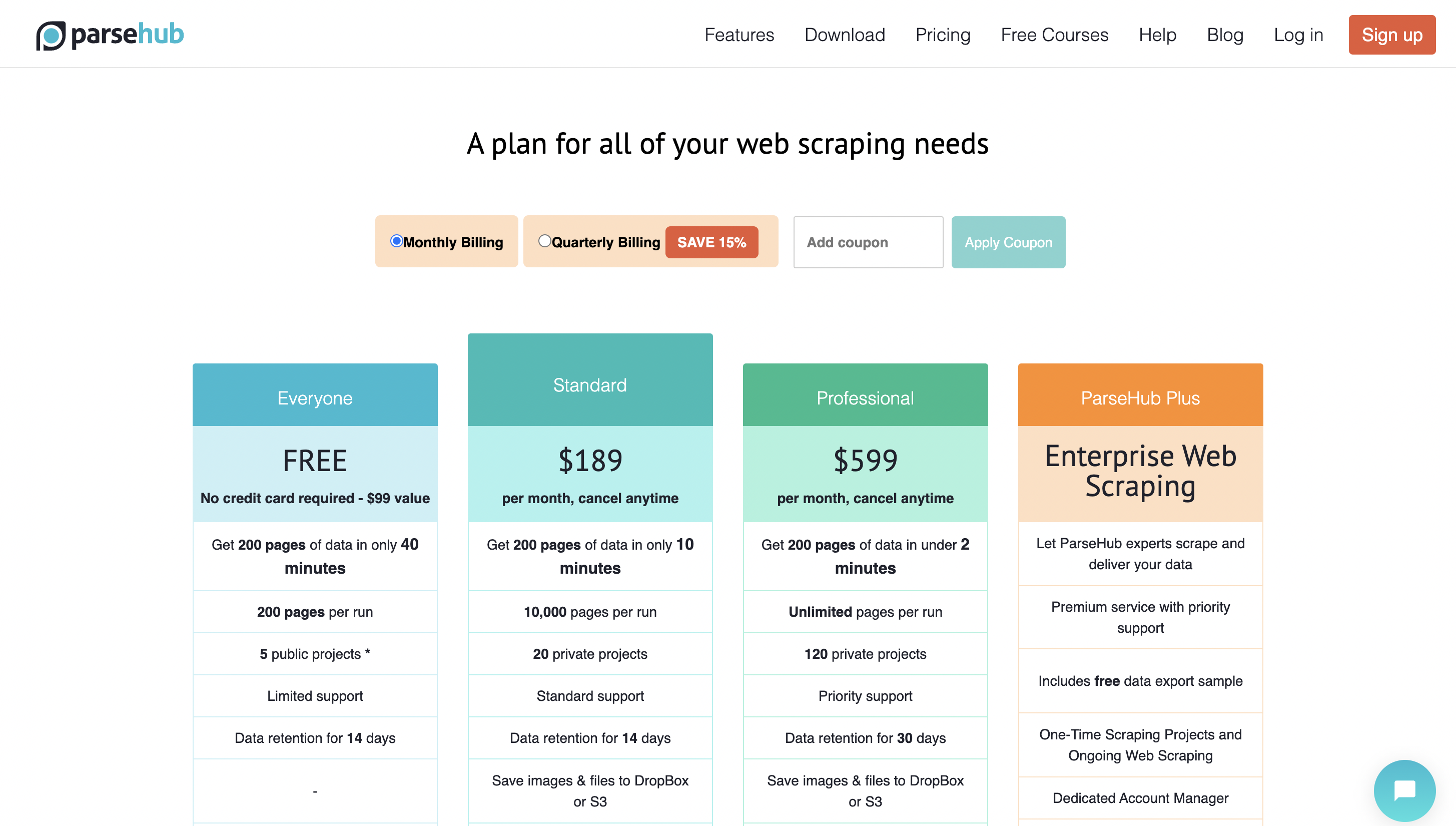

Cijene

Možete ga početi koristiti besplatno, a premium cijene počinju od 189 USD mjesečno.

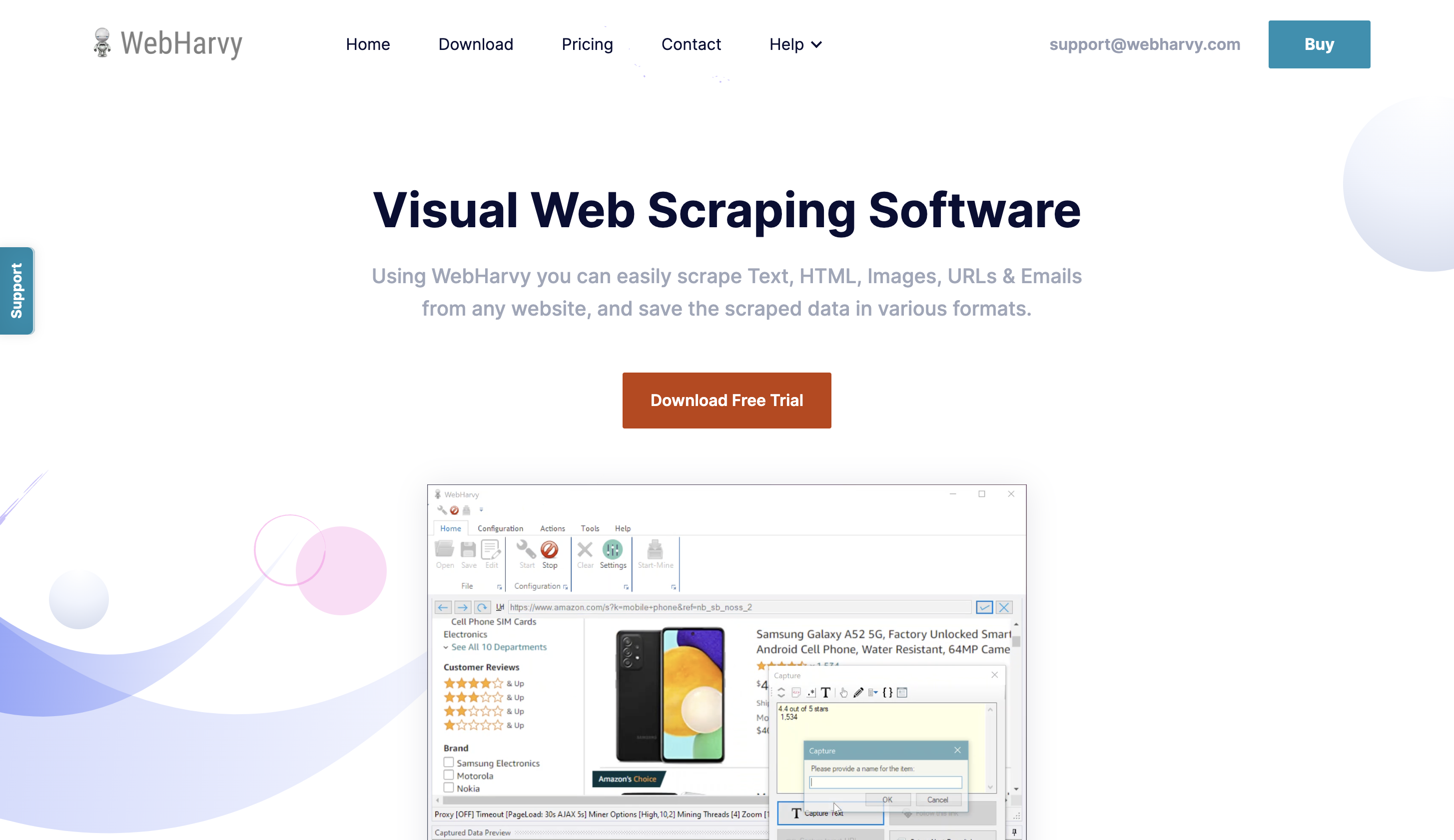

7. WebHarvy

WebHarvy je moćan alat za scraping na mreži koji omogućava organizacijama da brzo, precizno i efikasno skidaju podatke sa web stranica. Napravljen je da izvuče informacije sa mnogih web stranica, uključujući tražilice, društvene mreže, web stranice za e-trgovinu i direktorije.

Bez prethodnog iskustva kodiranja, korisnici mogu bez napora istraživati i kreirati poslove scrapinga zbog korisničkog sučelja. Jedna od najvećih karakteristika WebHarvy-ja je njegova sposobnost preuzimanja podataka sa web stranica koje pokreće JavaScript i AJAX kojima drugi alati za scraping možda neće moći pristupiti.

Osim toga, nudi Point and Click Interface koji olakšava odabir informacija sa web stranice koju želite da skrežete. WebHarvy ima režime pregledavanja bez glave i glave. Za brže i efikasnije scraping podataka, može raditi u bezglavom načinu rada.

Headful mod je koristan kada radite sa komplikovanim web stranicama koje zahtijevaju unos od korisnika. Također se može kretati između brojnih stranica i ispunjavati obrasce, što je korisno kada izvlačite podatke s web stranica s više stranica.

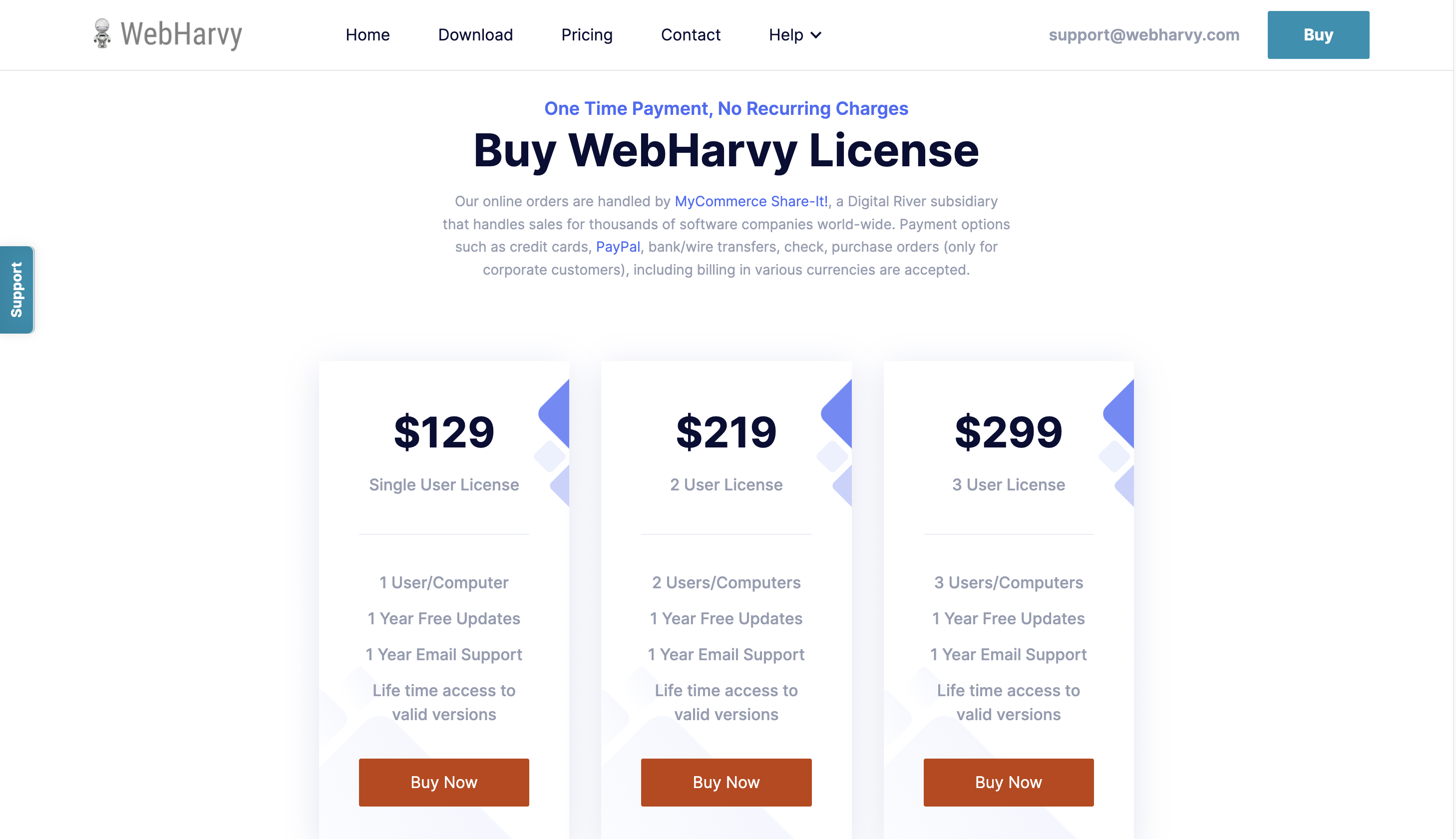

Cijene

Premijum cijena počinje od 129 USD za licencu za jednog korisnika.

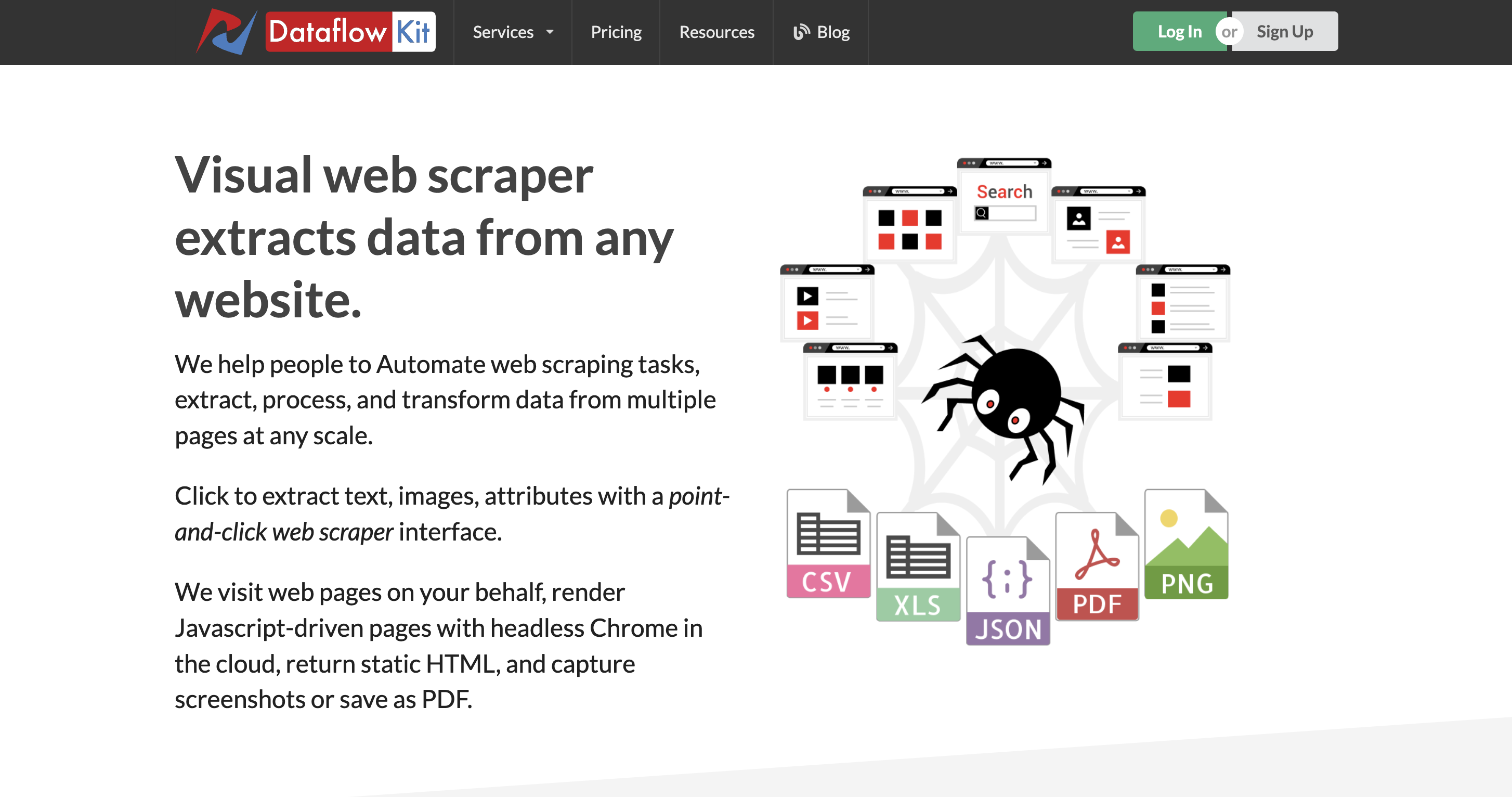

8. Dataflow Kit

Koristeći Dataflow Kit, robustan online alat za scraping, podaci se mogu prikupljati i analizirati sa raznih web stranica, uključujući društvene mreže web stranice, tražilice, web stranice e-trgovine i web stranice s vijestima. Jedna od njegovih najboljih karakteristika je sposobnost brzog i efikasnog prikupljanja podataka sa komplikovanih, dinamičnih web stranica.

Idealan je za scraping web stranice kojima je teško pristupiti drugim metodama jer je tako jednostavan za korištenje. Bezglavi pretraživač i headful pretraživač su funkcionalni sa Dataflow Kit-om. Napredne funkcije kao što su rotacija proxyja i korisničkog agenta, izbjegavanje blokiranja IP-a i detekcija anti-bota su obezbjeđene kako bi se osiguralo efikasno scraping.

Osim toga, nudi korisničko sučelje koje omogućava korisnicima da kreiraju, planiraju i upravljaju svojim aktivnostima scrapinga bez ikakvog iskustva u programiranju. Za aplikacije velikih razmjera web scraping-a, njegov učinkovit mehanizam za struganje je fantastično rješenje jer je optimiziran za brzo i efikasno rukovanje podacima.

Sakupljeni podaci mogu se jednostavno izvesti u različite formate, uključujući CSV, JSON i XML, što vam omogućava da ih analizirate i koristite na bilo koji način koji vam odgovara. Nadalje, Dataflow Kit pruža niz opcija interfejsa, uključujući API i Zapier, kako bi vam pomogao u pojednostavljenju vašeg toka posla i automatizaciji procesa ekstrakcije podataka.

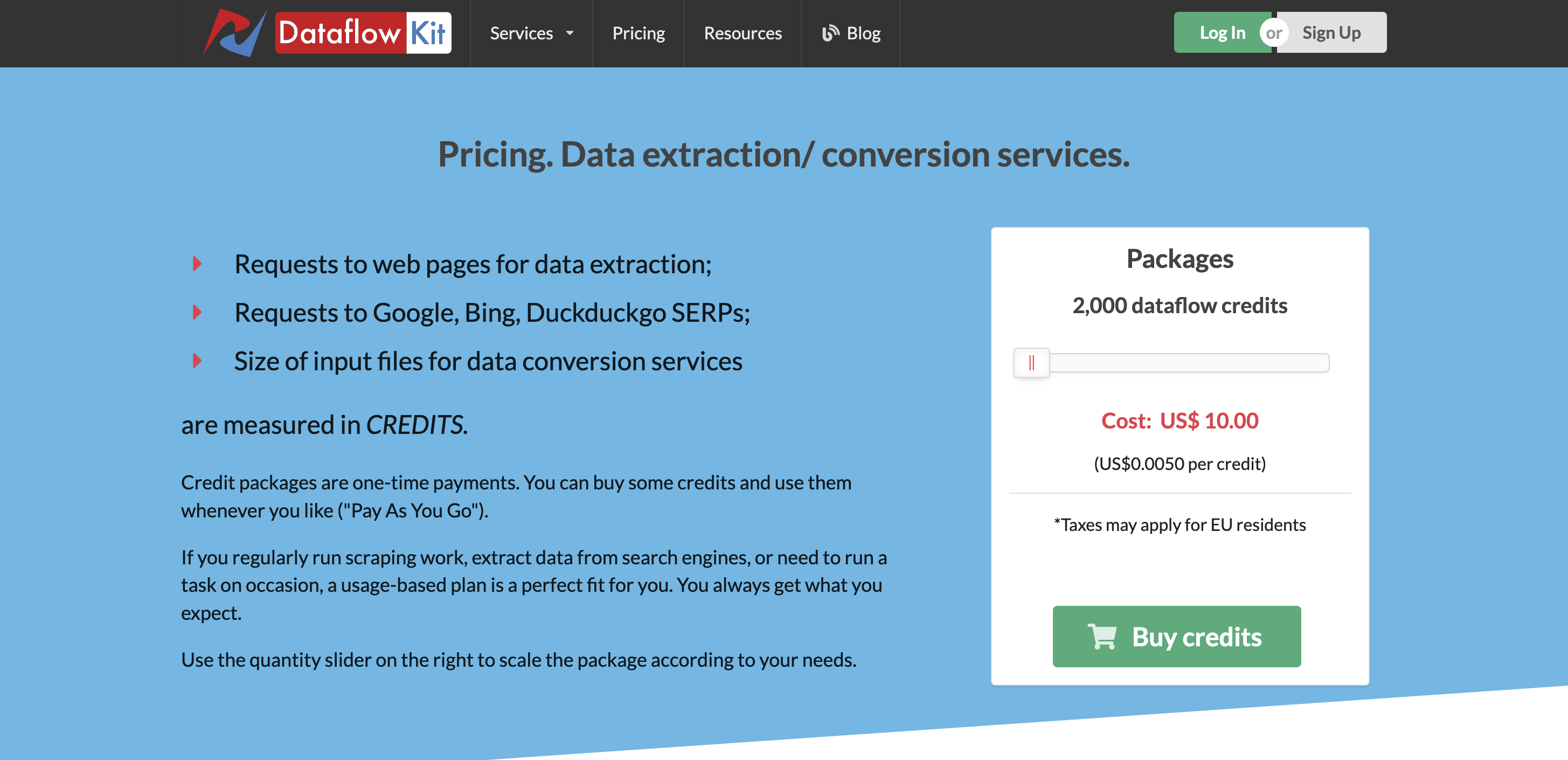

Cijene

Premijum cijene počinju od 10 USD za 2000 kredita protoka podataka, koje možete koristiti prema svojim potrebama.

9. import.io

Uz pomoć alata Import.io za web scraping baziran na oblaku, korisnici mogu skidati podatke s web stranica bez ikakvog iskustva u programiranju. Jednostavnost upotrebe je jedna od najprivlačnijih karakteristika Import.io-a; sve što treba da uradite je da pokažete i kliknete da pronađete podatke koje želite da skrežete.

Korisnici mogu procijeniti ekstrahirane podatke u realnom vremenu zbog njegovih moćnih funkcija vizualizacije. Import.io je pretraživač bez glave koji imitira web pretraživač i povezuje se s web stranicama na isti način kao što bi to učinila osoba, ali bez zahtjeva za grafičkim korisničkim sučeljem.

Ovo poboljšava efikasnost web-scraping-a i omogućava korisnicima da skidaju podatke sa dinamičkih web stranica koje zahtijevaju sudjelovanje korisnika da bi prikazali informacije. Njegov Extractor koji pokreće AI omogućava korisnicima da izvuku podatke sa samo nekoliko klikova. Extractor također može identificirati obrasce podataka i izdvojiti uporedive podatke iz brojnih izvora.

Korisnici mogu automatizirati svoje napore scraping-a i primati česta ažuriranja podataka koje žele uz sveobuhvatne funkcije planiranja. Import.io olakšava korištenje ekstrahiranih podataka u drugim aplikacijama tako što vam omogućava povezivanje s popularnim alatima kao što su Google Sheets i Zapier.

Cijene

Cijene nisu navedene na web stranici, razgovarajte o tome sa stručnjakom.

10. Dexi.io

Ekstrakcija podataka je jednostavna uz pomoć robusnog alata za struganje weba Dexi.io. Pomoću ovog alata možete prikupljati podatke sa web stranica bez iskustva s programiranjem zbog njegovog korisničkog sučelja i automatiziranih mogućnosti.

Jedna od njegovih najboljih karakteristika je sposobnost da izvuče i kombinuje podatke iz mnogih izvora, uključujući web stranice, API-je i baze podataka. Zahvaljujući Dexi.io-ovoj mogućnosti paralelne obrade, možete brzo i efikasno skidati ogromne količine podataka.

Dexi.io vam nudi izbor da odaberete najbolju alternativu za vaše potrebe scrapinga jer funkcionira i kao pretraživač bez glave i kao pretraživač. Dok vam opcija pretraživača bez glave omogućava da vidite web stranicu i komunicirate s njom kao da koristite tipičan pretraživač, opcija pretraživača bez glave omogućava vam da skidate podatke bez prikazivanja stranice u pretraživaču.

Ovo olakšava rješavanje problema sa struganjem i prilagođavanje postupka struganja vašim željama. Možete brzo da izvezete kopirane podatke sa Dexi.io u različitim formatima, kao što su CSV, JSON i Excel, za dodatnu analizu ili interakciju sa drugim aplikacijama.

Osim toga, pruža pouzdan i siguran hosting u oblaku za vaše kopirane podatke, jamčeći njihovu sigurnost i pristupačnost.

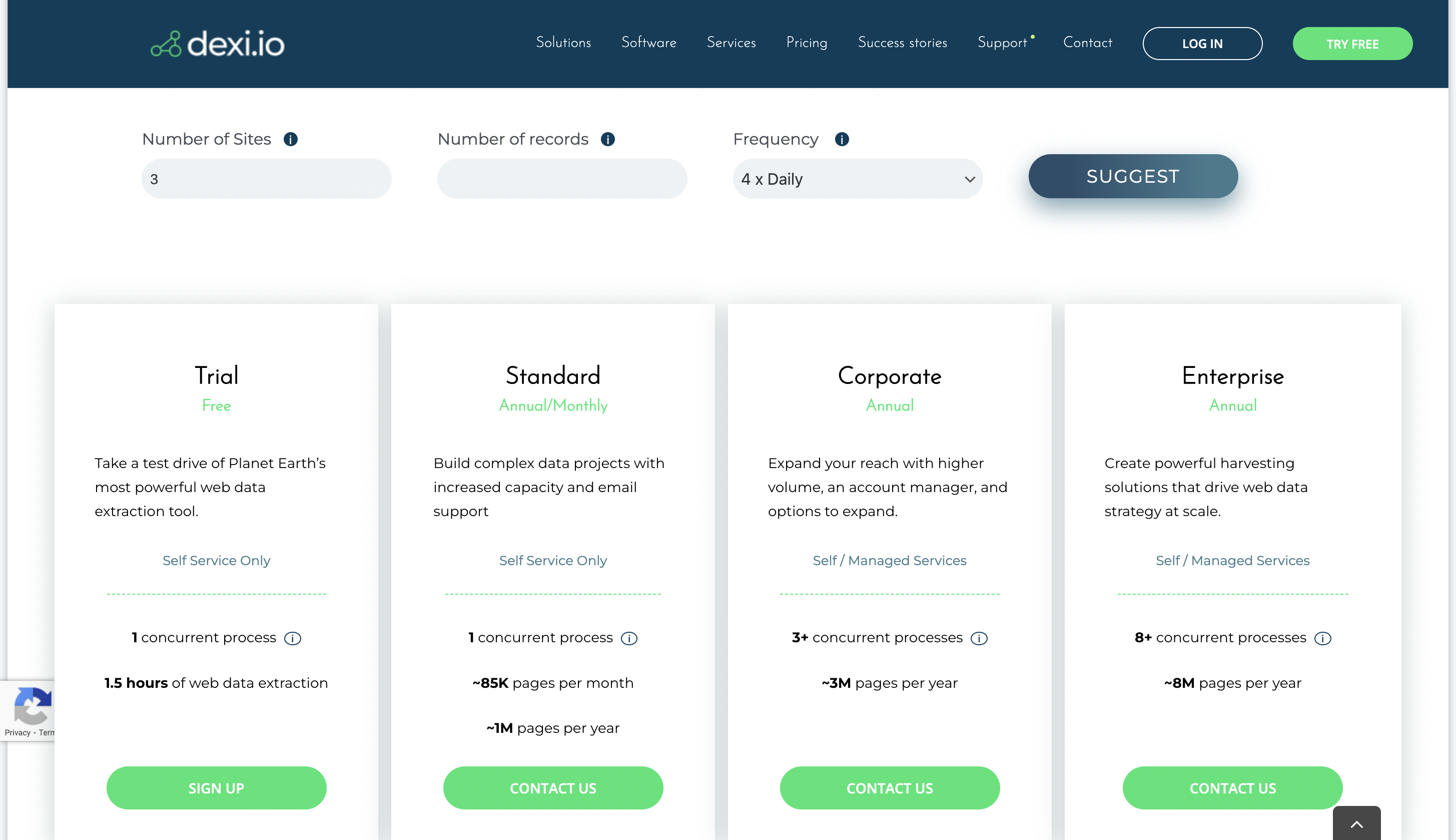

Cijene

Možete isprobati platformu s besplatnim probnim planom i kontaktirati tim za cijenu.

zaključak

U zaključku, postoji nekoliko rješenja za web scraping na tržištu, svako sa specifičnim prednostima i mogućnostima. Postoji mnogo alternativa podataka koje možete izabrati, u rasponu od rješenja sve u jednom kao što su Bright Data i ScrapingBee do specijalizovanijih alata kao što su Apify i ParseHub.

Ovi sistemi često imaju mogućnosti poput pregledavanja bez glave, rotacije IP-a, lažiranja korisničkog agenta i otiska prstiju pretraživača kako bi se povećala efikasnost, pouzdanost i tajnost internetskog skrapinga.

Alati za scraping na webu mogu vam pružiti brz i jednostavan pristup obilju informacija, bilo da ste vlasnik malog poduzeća koji pokušava istražiti svoje konkurente, istraživač koji traži podatke koji podržavaju vaš rad ili analitičar podataka koji traži uvid u ponašanje potrošača .

Mogućnost grešaka i nedosljednosti može se smanjiti, a potencijalno možete uštedjeti vrijeme i novac automatizacijom procesa prikupljanja podataka.

Ostavite odgovor