Sadržaj[Sakrij][Prikaži]

Nije novo imati lažne fotografije i video zapise. Od raširene upotrebe interneta, pojedinci stvaraju krivotvorine namijenjene zavaravanju ili zabavi od kada postoje slike i filmovi.

Međutim, postoji nova vrsta mašinski proizvedenih lažnjaka koji bi nam jednog dana mogli otežati razlikovanje stvarnosti od fikcije.

Ovi lažnjaci se razlikuju od jednostavnih manipulacija slikama koje generira softver za uređivanje poput Photoshopa ili pametno manipuliranih filmova iz prošlosti.

Deepfakes su najpoznatiji primjer "sintetičkih medija" - slike, zvukovi i video zapisi za koje se čini da su proizvedeni konvencionalnim metodama, ali su zaista napravljeni pomoću sofisticiranog softvera.

Deepfakes postoje već neko vrijeme, i dok je njihova najpopularnija primjena do sada bila stavljanje glava poznatih ljudi na tijela glumaca u pornografskim filmovima, oni imaju mogućnost da proizvedu uvjerljive snimke bilo koga ko radi bilo šta, bilo gdje.

U ovom postu ćemo pogledati Deepfakes, kako funkcioniraju, kako ih možete sami generirati i još mnogo toga.

Dakle, šta je DeepFake?

Duboko lažno – kombinacija fraza duboko učenje i lažno – je dio sintetički mediji u kojem se sličnost druge osobe koristi za zamjenu sličnosti osobe na već postojećoj fotografiji ili videu.

Deepfakes koriste sofisticirano mašinsko učenje i tehnike veštačke inteligencije za modifikovanje i kreiranje vizuelnih i audio informacija koje imaju veliki potencijal za prevaru.

Metode dubokog učenja kao što su autoenkoderi i generativne adversarijske mreže su primarni mehanizam za produkciju dubokog lažiranja (GAN).

Ovi modeli se koriste za analizu emocija i pokreta lica osobe i sintetiziraju slike lica drugih ljudi koji pokazuju slične izraze i pokrete.

Upotreba deepfakesa u pornografskim video zapisima poznatih ličnosti, lažnim vijestima, prevarama i finansijskim prijevarama privukla je značajnu pažnju. I industrija i vlada odgovorili su pokušavajući da ih pronađu i ograniče njihovu upotrebu.

Model pokreta prvog reda

Kada smo pokušavali da razvijemo duboke lažne stvari u prošlosti, problem je bio da nam je potrebna neka vrsta dodatnog znanja, ili prethodnog, da bi ovi pristupi funkcionisali.

Kao ilustracija, markeri lica su potrebni ako želimo da pratimo kretanje glave. Procjena poza bila je neophodna ako smo željeli mapirati kretanje cijelog tijela.

To se promijenilo na konferenciji NeurIPS prošle godine kada je istraživački tim sa Univerziteta u Torontu predstavio svoj rad, “Model pokreta prvog reda za animaciju slike. "

Za ovaj pristup nije potrebno dalje poznavanje animacije. Osim toga, nakon što je ovaj model obučen, može se koristiti za transferno učenje i primijeniti na bilo koju stavku koja spada u istu kategoriju.

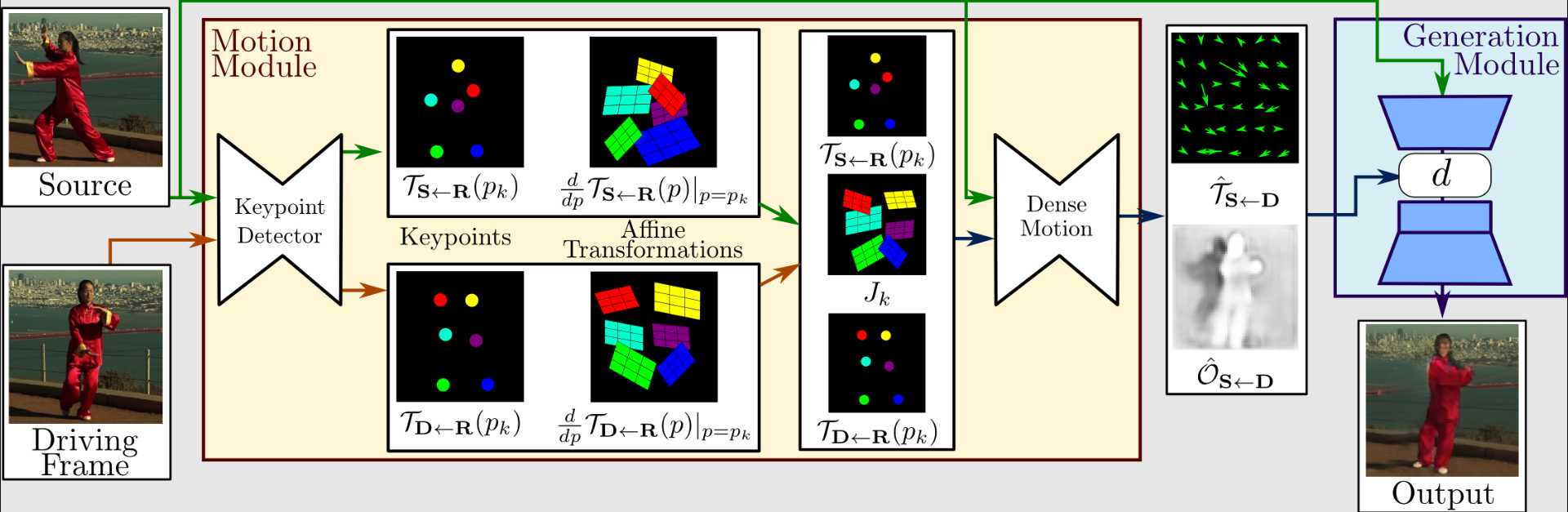

Pogledajmo rad ove metode malo dalje. Ekstrakcija i generisanje pokreta čine prvu polovinu cijelog procesa. Video vožnje i izvorne slike se koriste kao ulazi.

Da bi izdvojio reprezentaciju pokreta prvog reda, koja se sastoji od rijetkih ključnih tačaka i lokalnih afinskih transformacija, ekstraktor pokreta koristi autokoder za identifikaciju ključnih tačaka.

Za kreiranje gustog optičkog toka i mape okluzije s mrežom gustog kretanja, oni se koriste zajedno sa videom za vožnju. Generator zatim prikazuje ciljnu sliku koristeći izlaze iz mreže gustog pokreta i izvornu sliku.

Sve u svemu, ovaj rad ima bolje rezultate od najsavremenije. Takođe sadrži funkcije koje drugi modeli jednostavno nemaju. Radi na nekoliko tipova slika, tako da ga možete primijeniti na slike lica, tijela, crtane filmove itd., što je izuzetno sjajno.

Time se otvaraju mnoge nove mogućnosti. Još jedan revolucionarni aspekt naše strategije je da vam sada omogućava proizvodnju visokokvalitetnih Deepfakesa koristeći samo jednu sliku ciljanog objekta, slično kao što radimo sa YOLO za objekat prepoznavanje.

Proces kreiranja Deepfake modela

Za generisanje deepfake-a neophodna su tri procesa: ekstrakcija, obuka i kreiranje. Glavne tačke svake od ovih faza i kako se one odnose na cjelokupni proces će biti pokrivene u ovom odjeljku.

Ekstrakcija

Deepfakes koriste duboke neuronske mreže za promjenu lica i potrebno im je puno podataka (slika) da bi funkcionirali ispravno i uvjerljivo. Proces ekstrakcije je faza u kojoj se izvlače svi okviri iz video klipova, prepoznaju lica, a lica se zatim poravnavaju kako bi se maksimizirale performanse.

trening

U fazi obuke, neuronska mreža može promijeniti jedno lice u drugo. Ovisno o veličini seta za vježbanje i spravi za vježbanje, trening može trajati nekoliko sati ili čak dana.

Obuka se mora završiti samo jednom, slično kao i većina drugih treninga neuronskih mreža. Nakon treninga, model bi mogao promijeniti lice osobe A u osobu B.

stvaranje

Nakon što je model obučen, može se proizvesti deepfake. Okviri se uzimaju iz video zapisa i zatim poravnavaju sa svim licima. Obučena neuronska mreža se zatim koristi za transformaciju svakog okvira.

Transformirano lice mora biti spojeno s originalnim okvirom kao posljednji korak.

Izgradnja modela Deepfake Detection

Montiranje i kloniranje GitHub repo

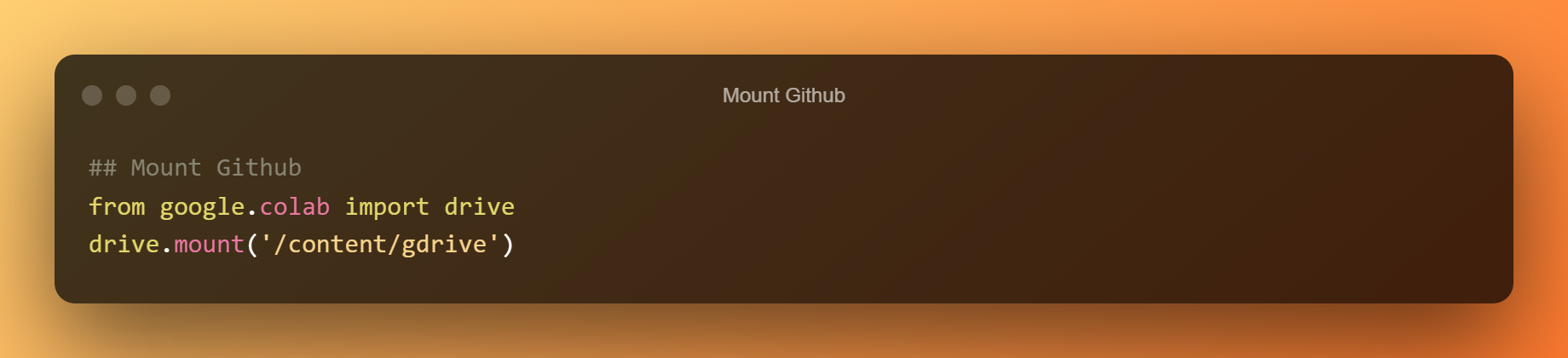

Mogućnost besplatnog korištenja Googleovih GPU-a dok radite u Colab-u je prednost duboko učenje. Dodatna prednost je mogućnost montiranja Google diska na virtuelnu mašinu u oblaku (VM).

Uz lak pristup svim njegovim stvarima, korisnik je omogućen. Program potreban za montiranje Google diska na virtuelnu mašinu u oblaku naći će se u ovom odjeljku.

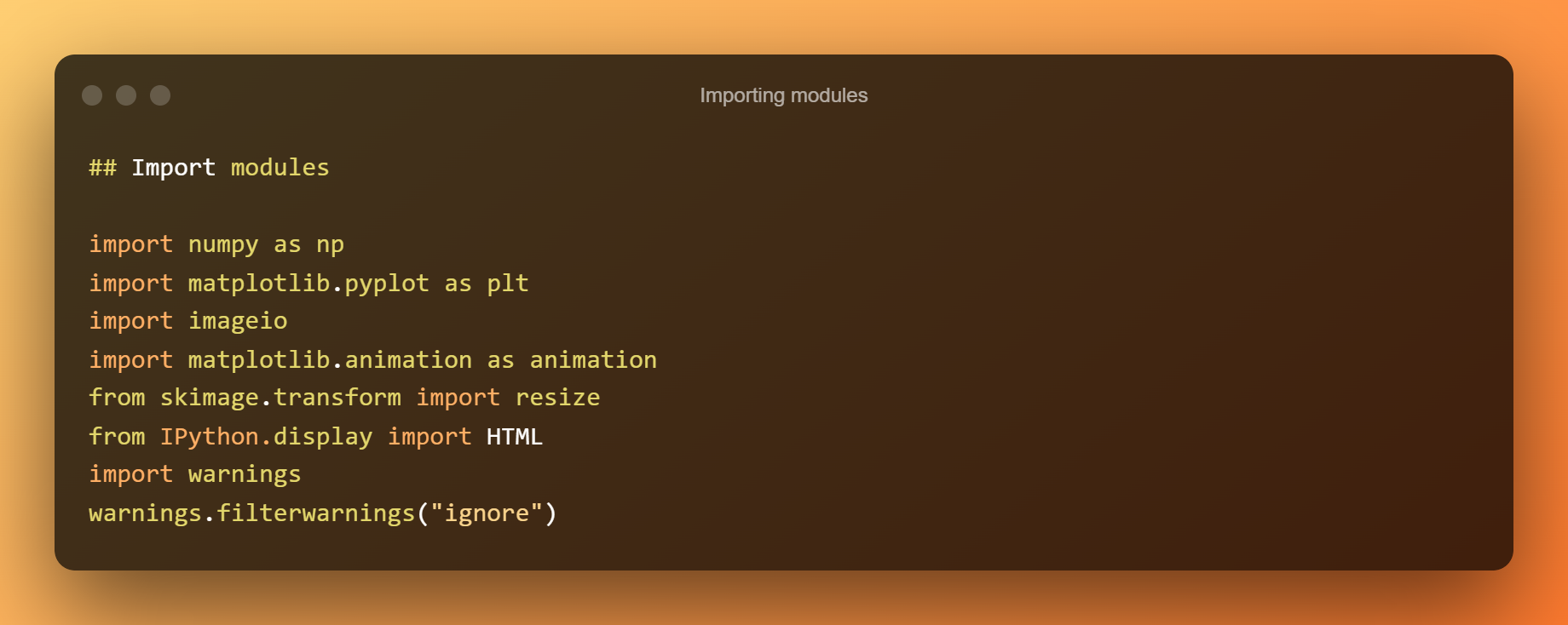

Uvoz modula

Sada ćemo uvesti sve potrebne module.

Izvođenje modela

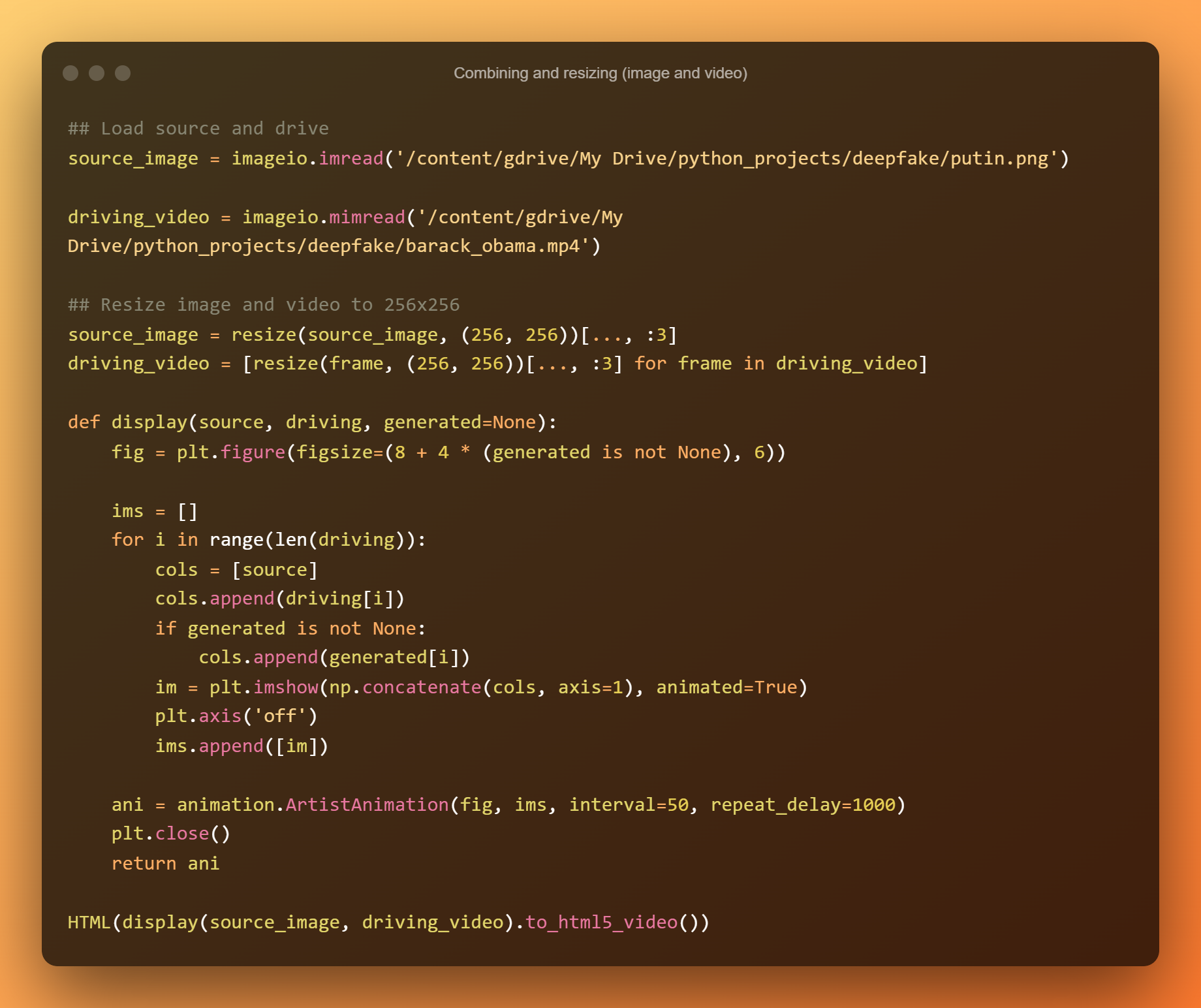

Koristićemo primer koji kombinuje fotografiju Putina (izvorna slika) sa video snimkom Obame. Rezultat je snimak Putina koji govori i gestikulira sa potpuno istim izrazima lica koje je Obama koristio dok je vozio.

Prije prikaza rezultata modela, medij će biti učitan i funkcije će biti deklarirane. Kontrolne tačke će se zatim učitati i model će biti konstruisan. Nakon kreiranja dubokog lažiranja, prikazat će se dva različita stila animacije.

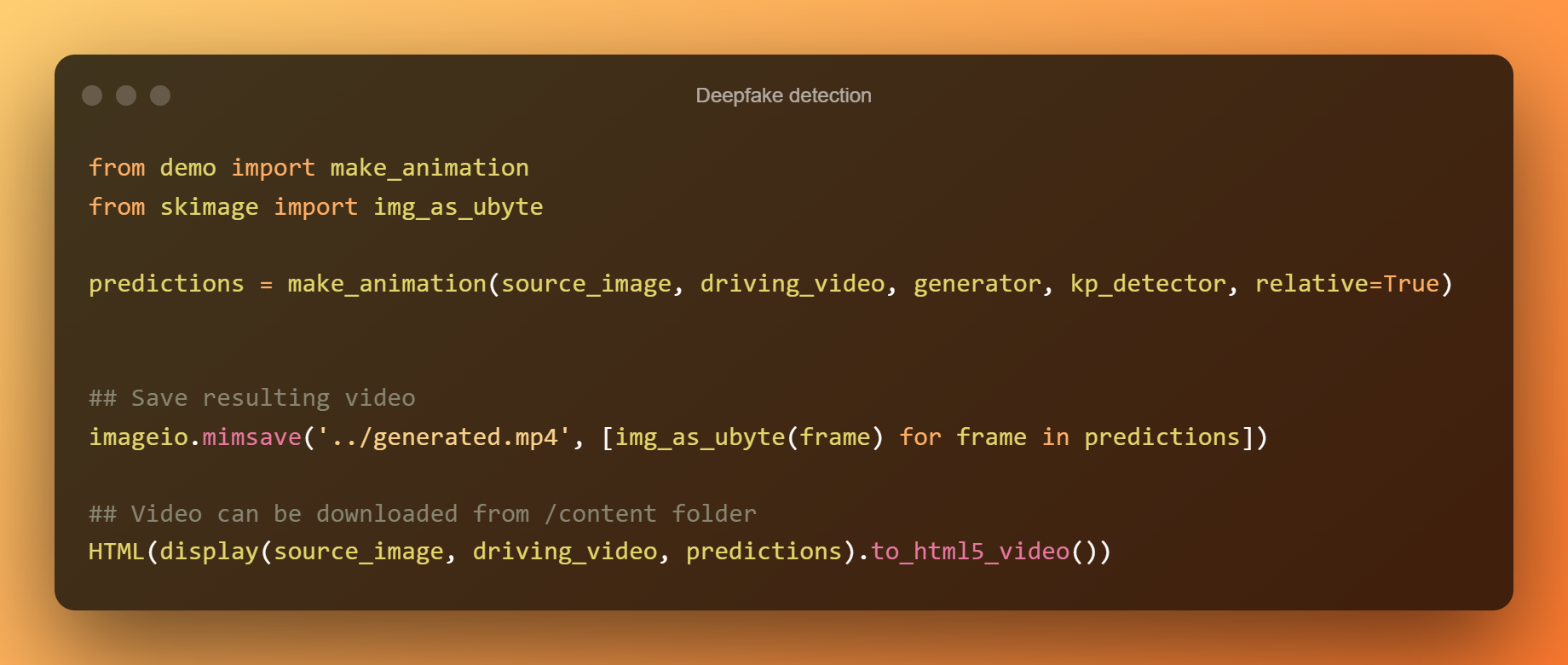

Putina ohrabruju Obamini pokreti koji koriste relativno pomeranje ključnih tačaka. Način na koji su Obamine emocije lica i govor tijela lijepo i jasno prikazani za Putina tokom njegovih videa je zapanjujući.

Postoji nekoliko mikroskopskih grešaka, posebno kada Obama podigne obrve i trepće očima. Ovi izrazi nisu baš preslikani u Putinove okvire.

Bez duboke lažne pozadine, Putinov film bi izgledao prilično vjerodostojan i autentičan ako bi se gledao na TV-u ili društvenih medija.

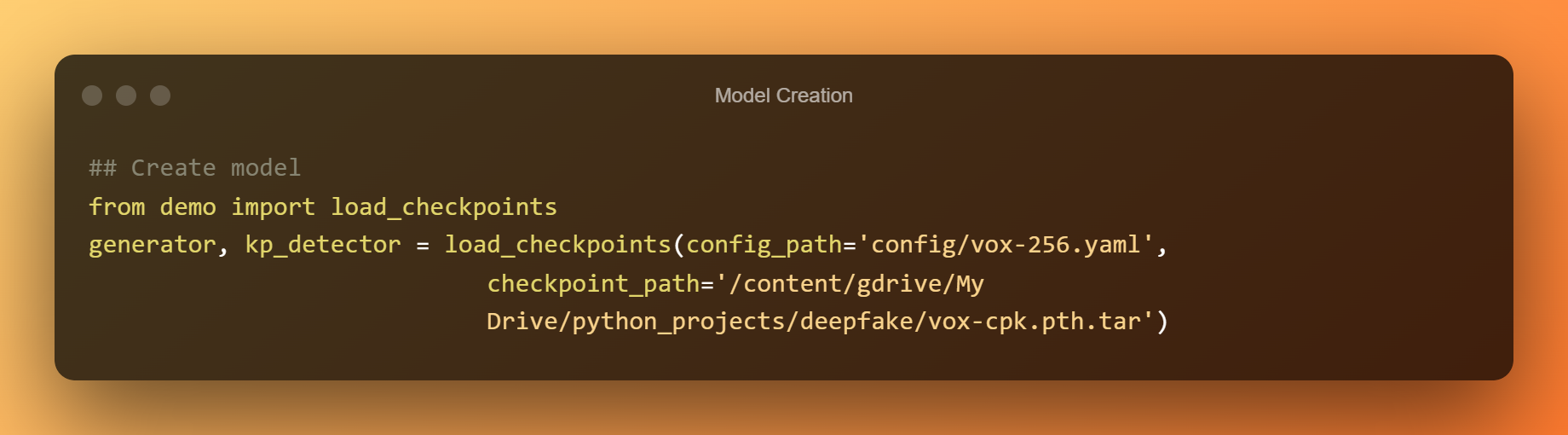

Kreiranje modela

Sada ćemo koristiti unaprijed obučene kontrolne tačke da kreiramo kompletan model.

Deepfake detekcija

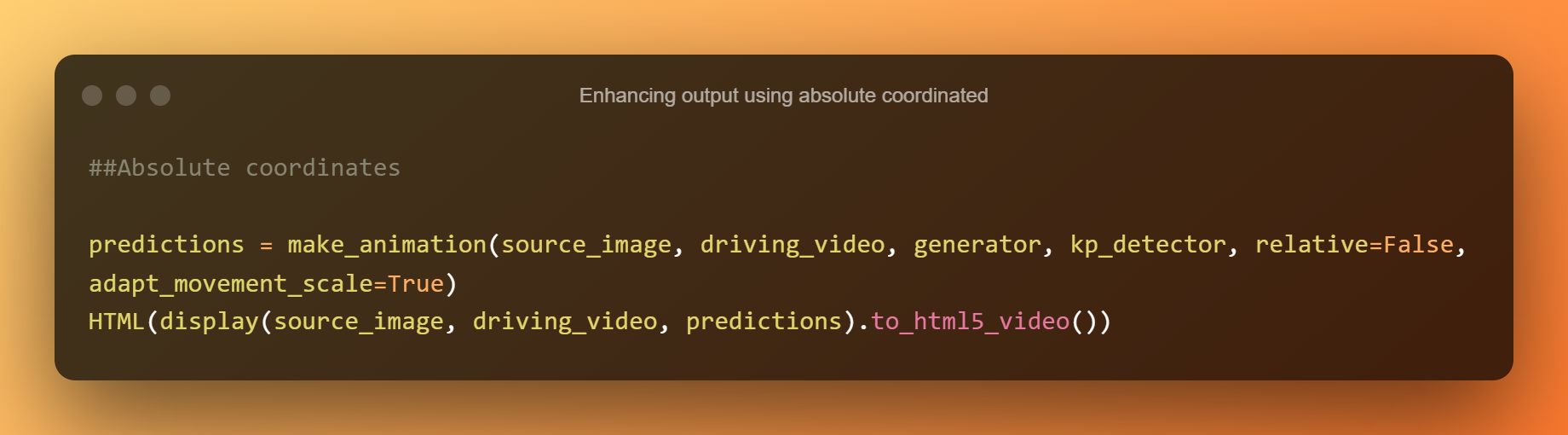

Relativno pomicanje ključne tačke se koristi za animiranje stavki u ćeliji ispod. Sljedeća ćelija umjesto toga koristi apsolutne koordinate, ali će sve proporcije stavki biti preuzete iz videa vožnje na ovaj način.

Poboljšanje izlaza koristeći apsolutne koordinate

Na ovaj način ćete moći razviti detekciju deepfake.

Koji su rizici Deepfake tehnologije?

Deepfake videozapisi sada su zanimljivi i zabavni za gledanje zbog svoje novosti. Međutim, postoji rizik koji bi mogao izmaknuti kontroli leži ispod površine ove naizgled smiješne tehnologije.

Zasigurno će biti izazov razlikovati lažne od stvarnih videa deepfake tehnologija nastavlja da napreduje. Posebno za istaknute ličnosti i poznate ličnosti, ovo bi moglo imati ozbiljne posljedice. Deepfakes koji su namjerno zlonamjerni imaju potencijal da potpuno oštete karijere i živote.

Ovo može koristiti neko sa zlobnom namjerom da pređe za druge i iskoristi prednosti svojih prijatelja, rođaka i kolega. Oni su također sposobni izazvati svjetske kontroverze, pa čak i ratove koristeći lažne filmove stranih lidera.

zaključak

Ukratko, nalazimo se u čudnom periodu i neobičnom okruženju. Više nego ikad, jednostavno je proizvoditi lažne vijesti i filmove i širiti ih. Razumevanje šta je istina, a šta nije postaje sve izazovnije.

Danas se, čini se, više ne možemo osloniti na vlastita čula.

Unatoč činjenici da su razvijeni lažni video detektori, samo je pitanje vremena kada će jaz u informacijama biti toliko uzak da čak ni najfiniji lažni detektori neće moći utvrditi je li video pravi ili ne.

Ostavite odgovor