INHOUDSOPGAWE[Versteek][Wys]

Dit is nie nuut om vals foto's en video's te hê nie. Sedert die wydverspreide gebruik van die internet, het individue vervalsings geskep wat bedoel is om te flous of te vermaak vandat daar beelde en films was.

Daar is egter 'n nuwe soort masjienvervaardigde namaaksels wat dit dalk eendag vir ons moeilik kan maak om werklikheid van fiksie te onderskei.

Hierdie namaaksels verskil van die eenvoudige prentmanipulasies wat gegenereer word deur redigeringsagteware soos Photoshop of die slim gemanipuleerde films van die verlede.

Deepfakes is die bekendste voorbeeld van "sintetiese media"—beelde, klanke en video's wat lyk asof hulle met konvensionele metodes vervaardig is, maar wat werklik met behulp van gesofistikeerde sagteware gemaak is.

Deepfakes bestaan al 'n rukkie, en hoewel hul gewildste toepassing nog was om die koppe van bekende mense op die liggame van akteurs in pornografiese rolprente te plaas, het hulle die vermoë om oortuigende beeldmateriaal te produseer van enigiemand wat enigiets doen, enige plek.

In hierdie pos gaan ons kyk na Deepfakes, hoe dit werk, hoe jy dit op jou eie kan genereer, en nog baie meer.

So, wat is DeepFake?

'n Deepfake - 'n kombinasie van die frases diep leer en vals - is 'n stuk van sintetiese media waarin die ooreenkoms van 'n ander persoon gebruik word om dié van 'n persoon in 'n reeds bestaande foto of video te vervang.

Deepfakes gebruik gesofistikeerde masjienleer en kunsmatige intelligensie-tegnieke om visuele en oudio-inligting te wysig en te skep wat 'n hoë potensiaal vir misleiding het.

Diep leermetodes soos outo-enkodeerders en generatiewe teenstandersnetwerke is die primêre meganisme vir dieepfake-produksie (GAN).

Hierdie modelle word gebruik om 'n persoon se gesigsemosies en -bewegings te ontleed en gesigprente te sintetiseer van ander mense wat vergelykbare uitdrukkings en bewegings vertoon.

Die gebruik van deepfakes in celebrity pornografiese video's, fopnuus, fopnuus en finansiële bedrog het aansienlike aandag getrek. Beide die industrie en die regering het gereageer deur hulle te probeer vind en hul gebruik te beperk.

Eerste Orde Bewegingsmodel

Wanneer ons in die verlede diep vervalsings probeer ontwikkel het, was die probleem dat ons 'n soort ekstra kennis, of voorafkennis, nodig het om hierdie benaderings te laat werk.

Ter illustrasie word gesigmerkers vereis as ons kopbewegings wil naspoor. Posskatting was nodig as ons die hele liggaam beweging wou karteer.

Dit het verlede jaar by die NeurIPS-konferensie verander toe die navorsingspan van die Universiteit van Toronto hul werk aangebied het, "Eerste orde bewegingsmodel vir beeldanimasie. "

Geen verdere kennis van animasie is nodig vir hierdie benadering nie. Daarbenewens, nadat hierdie model opgelei is, kan dit gebruik word vir oordragleer en toegepas word op enige item wat onder dieselfde kategorie val.

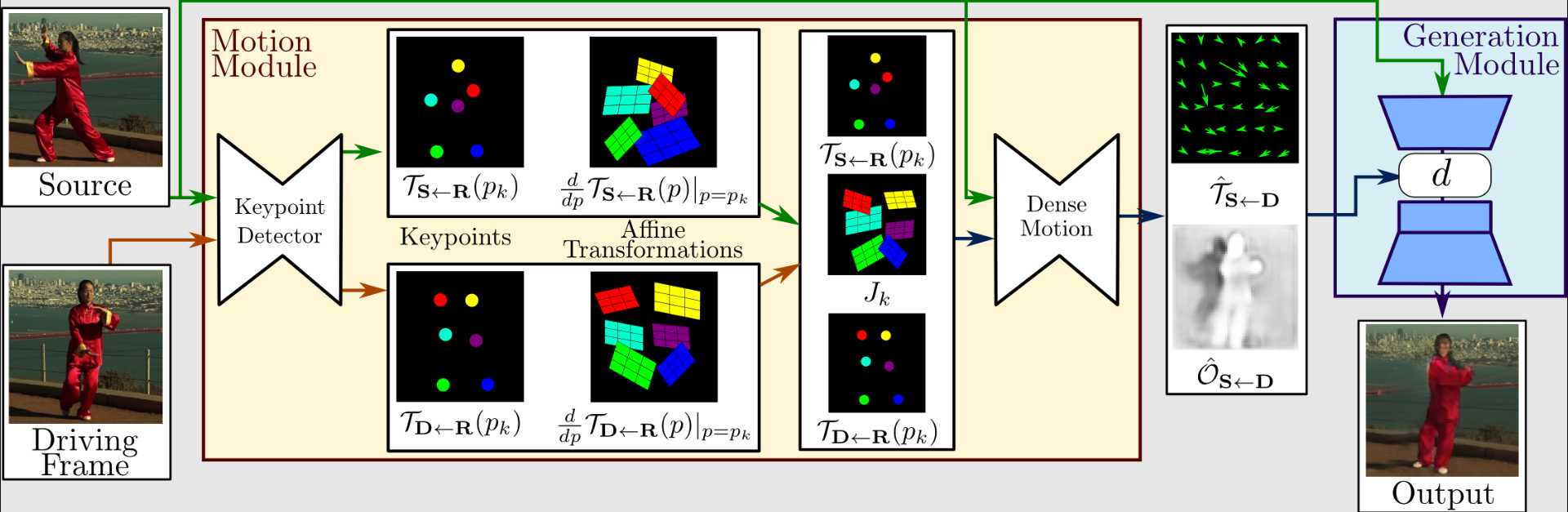

Kom ons kyk bietjie verder na die werking van hierdie metode. Motion Extraction and Generation maak die eerste helfte van die hele proses uit. Die bestuursvideo en bronprente word as insette gebruik.

Om eerste-orde bewegingsvoorstelling te onttrek, wat bestaan uit yl sleutelpunte en plaaslike affiene transformasies, gebruik 'n bewegingsuittrekker 'n outo-enkodeerder om sleutelpunte te identifiseer.

Om 'n digte optiese vloei- en okklusiekaart met die digte bewegingsnetwerk te skep, word dit saam met die bestuur van video gebruik. Die kragopwekker lewer dan die teikenprent deur die uitsette van die digte bewegingsnetwerk en die bronbeeld te gebruik.

Oor die algemeen vaar hierdie werk beter as die moderne kuns. Dit bevat ook kenmerke wat ander modelle net nie het nie. Dit werk op verskeie prenttipes, so jy kan dit toepas op beelde van die gesig, liggaam, spotprente, ens., wat uiters wonderlik is.

Baie nuwe geleenthede word hierdeur geskep. Nog 'n baanbrekende aspek van ons strategie is dat dit jou nou toelaat om hoë kwaliteit Deepfakes te produseer deur net een beeld van die teikenvoorwerp te gebruik, soortgelyk aan hoe ons dit doen met YOLO vir voorwerp erkenning.

Proses om Deepfake-model te skep

Drie prosesse is nodig vir deepfake generasie: onttrekking, opleiding en skepping. Die hoofpunte van elk van hierdie stadiums en hoe dit verband hou met die algehele proses sal in hierdie afdeling behandel word.

Onttrekking

Deepfakes gebruik diep neurale netwerke om gesigte te verander en benodig baie data (prente) om korrek en oortuigend te werk. Die onttrekkingsproses is die stadium waarin alle rame van videogrepe onttrek word, die gesigte herken word en die gesigte dan in lyn gebring word om prestasie te maksimeer.

opleiding

In die opleidingsfase word die neurale netwerk kan een gesig in 'n ander verander. Afhangende van die grootte van die oefenstel en die oefentoestel, kan die opleiding etlike ure of selfs dae neem.

Die opleiding moet net een keer voltooi word, net soos die meeste ander neurale netwerk opleiding. Na opleiding sou die model 'n gesig van persoon A na persoon B kon verander.

Skepping

Nadat die model opgelei is, kan 'n deepfake vervaardig word. Rame word uit 'n video geneem en dan met alle gesigte in lyn gebring. Die opgeleide neurale netwerk word dan gebruik om elke raam te transformeer.

Die getransformeerde gesig moet saamgevoeg word met die oorspronklike raam as die laaste stap.

Bou Deepfake Detection Model

Monteer en kloon GitHub Repo

Dit is voordelig om Google se GPU's gratis te kan gebruik terwyl jy by Colab werk diep leer. 'n Bykomende voordeel is die vermoë om 'n Google Drive op 'n virtuele wolkmasjien (VM) te monteer.

Met maklike toegang tot al sy goed, is die gebruiker geaktiveer. Die program wat nodig is om Google Drive op die virtuele masjien in die wolk te monteer, sal in hierdie afdeling gevind word.

Die invoer van modules

Nou sal ons al die nodige modules invoer.

Die uitvoering van die model

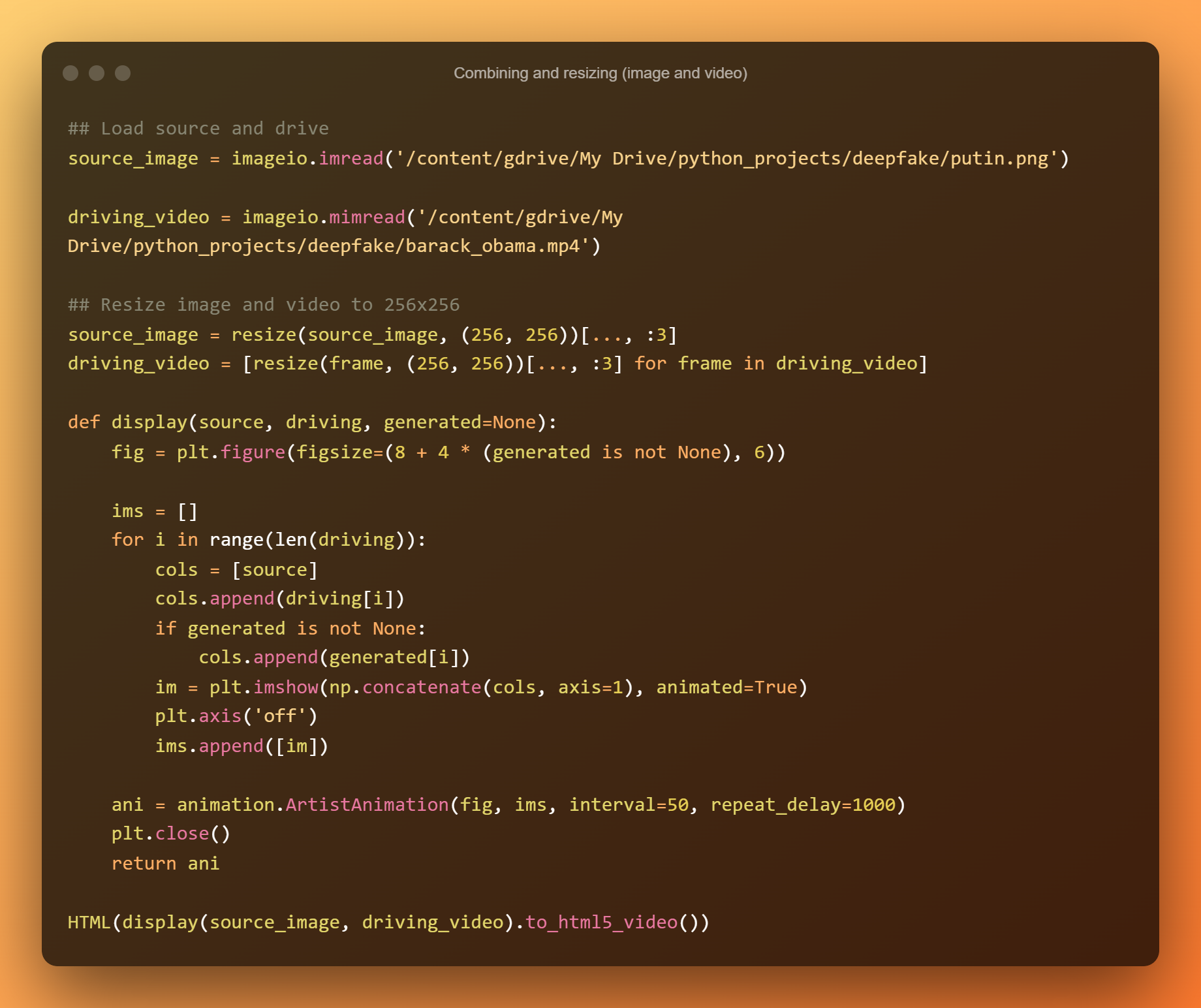

Ons sal 'n voorbeeld gebruik wat 'n stilfoto van Poetin (bronfoto) met 'n video van Obama kombineer. Die resultaat is 'n video van Poetin wat praat en beduie met presies dieselfde gesigsuitdrukkings wat Obama gebruik het terwyl hy bestuur het.

Voordat die resultaat van die model vertoon word, sal die media gelaai word en die funksies sal verklaar word. Kontrolepunte sal dan gelaai word en die model sal gebou word. Na die skep van die diep vals, sal twee verskillende style van animasie vertoon word.

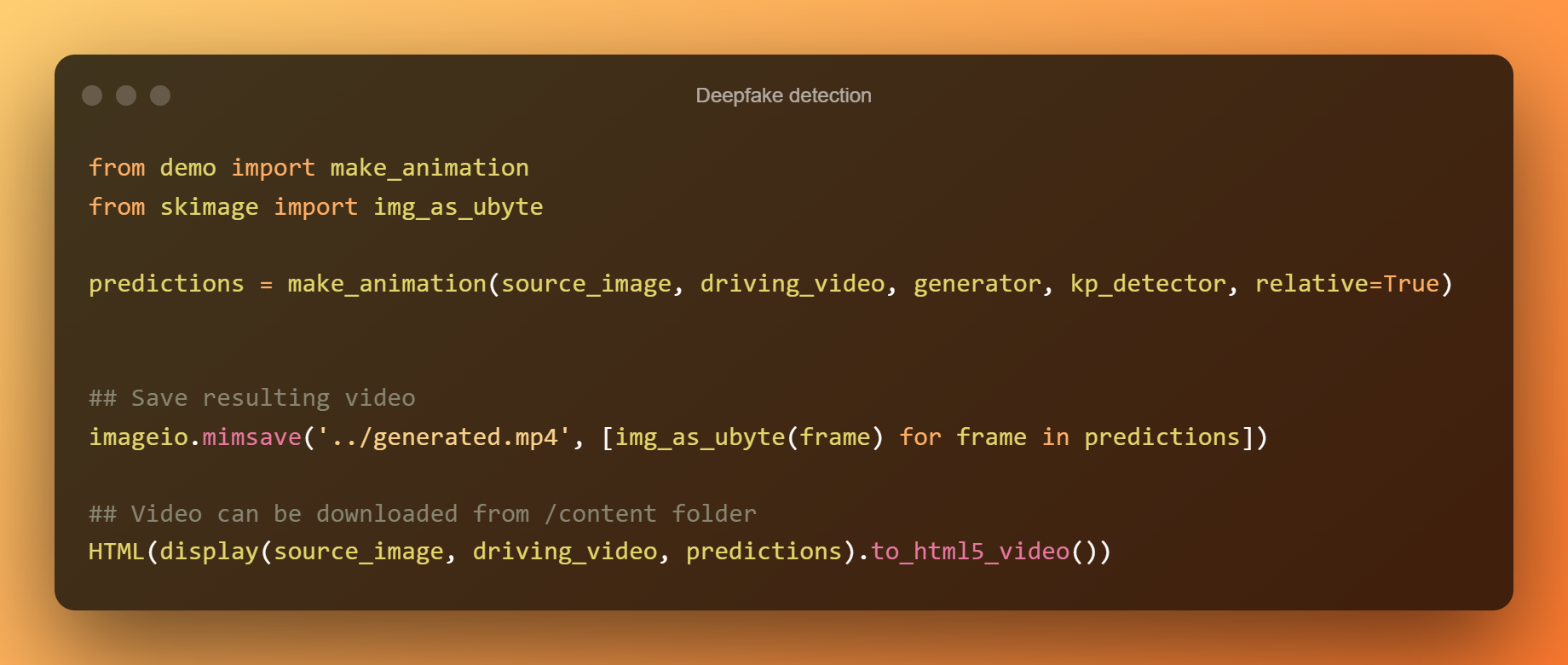

Poetin word geanimeer deur Obama se bewegings wat relatiewe sleutelpuntverplasing gebruik. Die manier waarop Obama se gesigsemosies en lyftaal pragtig en duidelik vir Poetin tydens sy video's uitgebeeld word, is verstommend.

Daar is 'n paar mikroskopiese foute, veral wanneer Obama sy wenkbroue lig en sy oë knip. Hierdie uitdrukkings word nie presies in Poetin se rame gerepliseer nie.

Sonder die diep valse agtergrond sal die Poetin-film redelik geloofwaardig en outentiek voorkom as dit op TV of sosiale media.

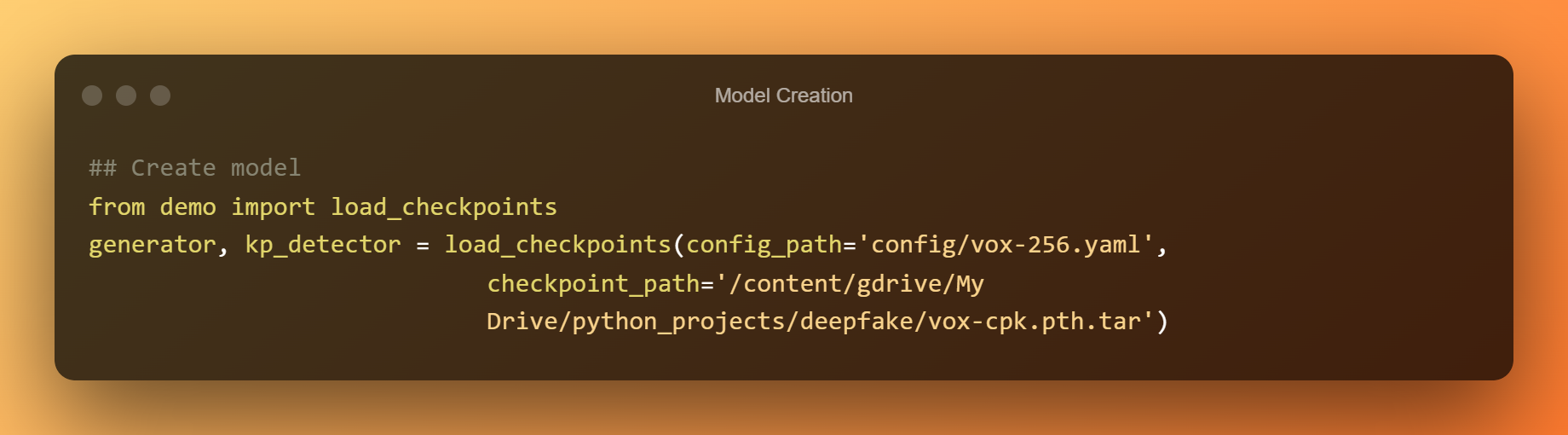

Model skepping

Nou sal ons die vooraf-opgeleide kontrolepunte gebruik om 'n volledige model te skep.

Deepfake opsporing

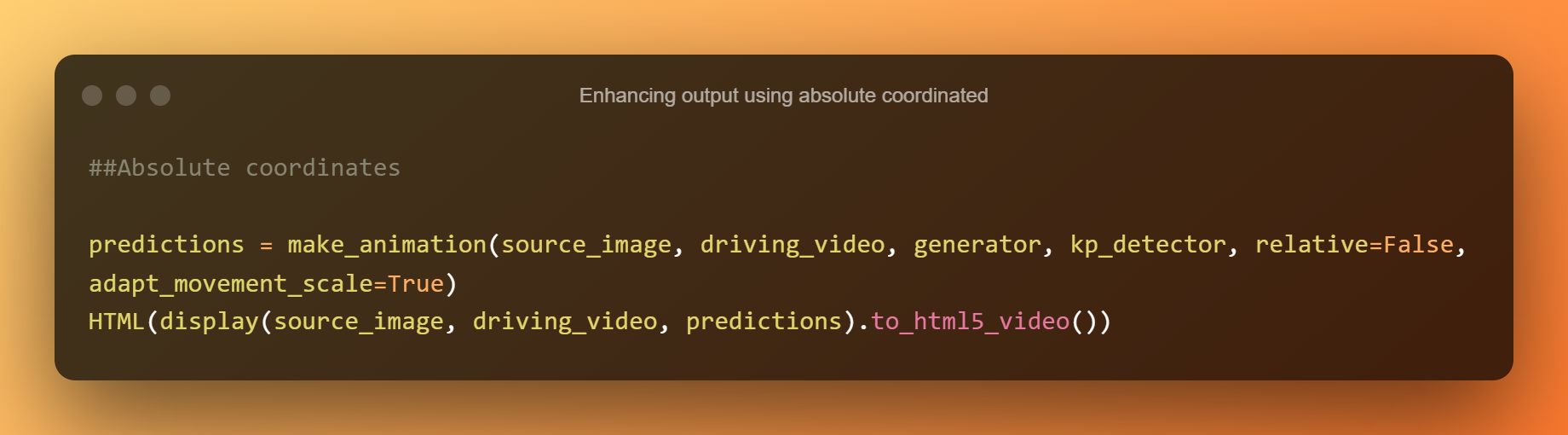

Relatiewe sleutelpuntverplasing word gebruik om die items in die sel hieronder te animeer. Die volgende sel gebruik eerder absolute koördinate, maar alle itemverhoudings sal op hierdie manier uit die ryvideo geneem word.

Verbetering van uitset met behulp van absolute koördinate

Jy sal op hierdie manier 'n diepvalse opsporing kan ontwikkel.

Wat is die risiko's van Deepfake-tegnologie?

Deepfake-video's is nou boeiend en vermaaklik om te kyk as gevolg van hul nuutheid. Daar is egter 'n risiko wat buite beheer kan raak onder die oppervlak van hierdie oënskynlik snaakse tegnologie.

Dit sal beslis uitdagend wees om te onderskei tussen vals en regte video's as diepvervalste tegnologie gaan voort om te vorder. Veral vir prominente persoonlikhede en bekendes kan dit ernstige gevolge hê. Deepfakes wat opsetlik kwaadwillig is, het die potensiaal om loopbane en lewens heeltemal te beskadig.

Dit kan gebruik word deur iemand met kwaadaardige bedoelings om vir ander te slaag en voordeel te trek uit hul vriende, familie en kollegas. Hulle is ook in staat om wêreldwye kontroversies en selfs oorloë aan te wakker met behulp van valse films van buitelandse leiers.

Gevolgtrekking

Kortom, ons is in 'n vreemde tydperk en ongewone omgewing. Meer as ooit is dit eenvoudig om vals nuus en films te vervaardig en dit te versprei. Om te verstaan wat waar is en wat nie is nie, word al hoe meer uitdagend.

Vandag, blyk dit, kan ons nie meer op ons eie sintuie staatmaak nie.

Ten spyte van die feit dat vals video-verklikkers ontwikkel is, is dit net 'n kwessie van tyd voordat die inligtinggaping so nou is dat selfs die fynste vals-verklikkers nie sal kan bepaal of die video eg is of nie.

Lewer Kommentaar