传感器和软件结合在自动驾驶汽车中,以导航、驾驶和操作各种车辆,包括摩托车、汽车、卡车和无人机。

根据它们的开发或设计方式,它们可能需要也可能不需要驾驶员辅助。

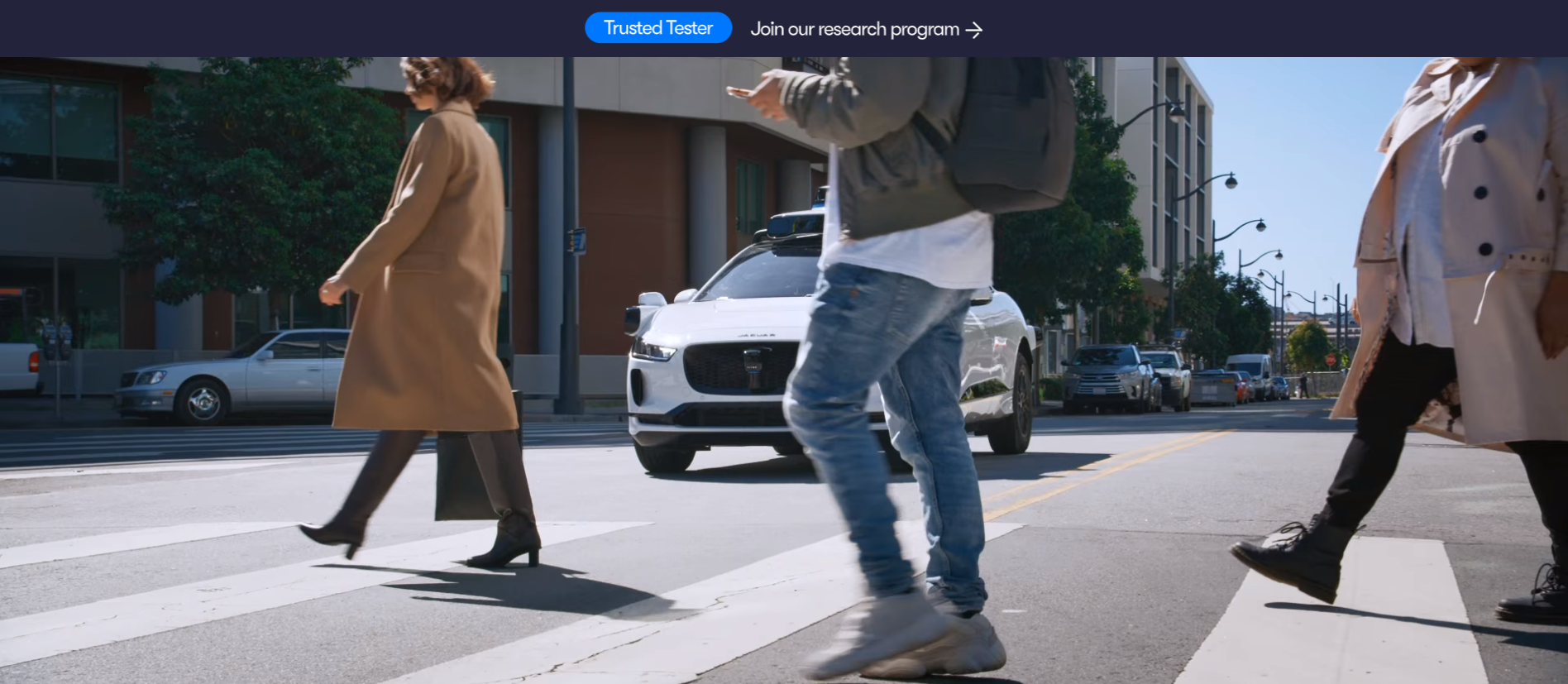

全自动驾驶汽车可以在没有人类驾驶员的情况下安全运行。 有些,比如 谷歌的 Waymo 汽车,连方向盘都没有。

部分自动驾驶汽车,例如 特斯拉,可以完全控制车辆,但如果系统遇到疑问,可能需要人类驾驶员协助。

这些汽车包括不同程度的自动驾驶,从车道引导和制动帮助到完全独立的自动驾驶原型。

无人驾驶汽车的目标是降低交通量、排放和事故率。

这是可能的,因为自动驾驶汽车比人类更善于遵守交通规则。

为了平稳驾驶,某些信息是必要的,例如汽车或任何附近物体的位置、到目的地的最短和最安全的路径以及驾驶系统的运行能力。

了解何时以及如何执行必要的任务至关重要。

本文将涵盖很多内容,包括 系统架构 用于自动驾驶汽车、所需组件和车载自组织网络 (VANET)。

自动驾驶汽车所需的必要组件

当今的自动驾驶汽车采用各种传感器,包括摄像头、GPS、惯性测量单元 (IMU)、声纳、激光照明探测和测距(激光雷达)、无线电探测和测距(雷达)、声音导航和测距(声纳),以及3D 地图。

这些传感器和技术一起实时分析数据以控制转向、加速和制动。

雷达传感器有助于跟踪周围汽车的下落。 车辆在停车时可通过超声波传感器获得帮助。

通过使用这两种类型的传感器创建了一种称为激光雷达的技术。 通过从汽车周围环境反射光脉冲,激光雷达传感器可以检测道路边缘并识别车道标记。

这些还警告驾驶员注意附近的障碍物,例如其他车辆、行人和自行车。

使用激光雷达技术测量汽车周围所有物体的大小和距离,该技术还创建了一个 3D 地图,允许车辆查看周围环境并识别任何风险。

无论一天中的什么时候,无论是明亮还是阴暗,它都能出色地记录不同类型环境光下的信息。

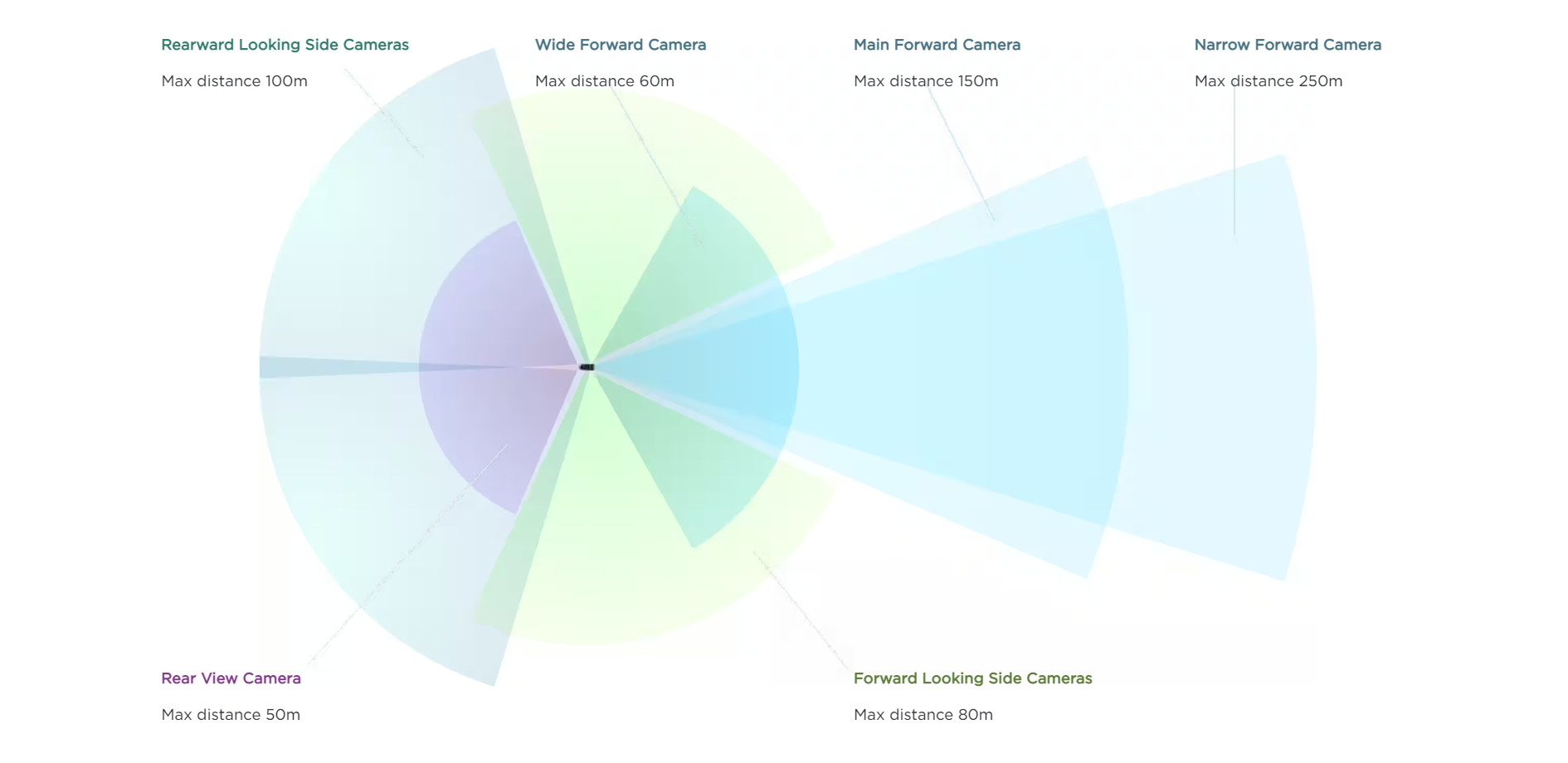

汽车使用摄像头、雷达和 GPS 天线以及激光雷达和摄像头来检测周围环境并确定其位置。

摄像头检查行人、骑自行车的人、汽车和其他障碍物,同时还检测交通信号、读取道路标志和标记,并跟踪其他车辆。

然而,他们在昏暗或阴暗的地方可能会遇到困难。 自动驾驶汽车可以通过混合使用激光雷达、雷达、摄像头、GPS 天线和超声波传感器来以数字方式绘制前方道路,从而了解自己的行驶方向。

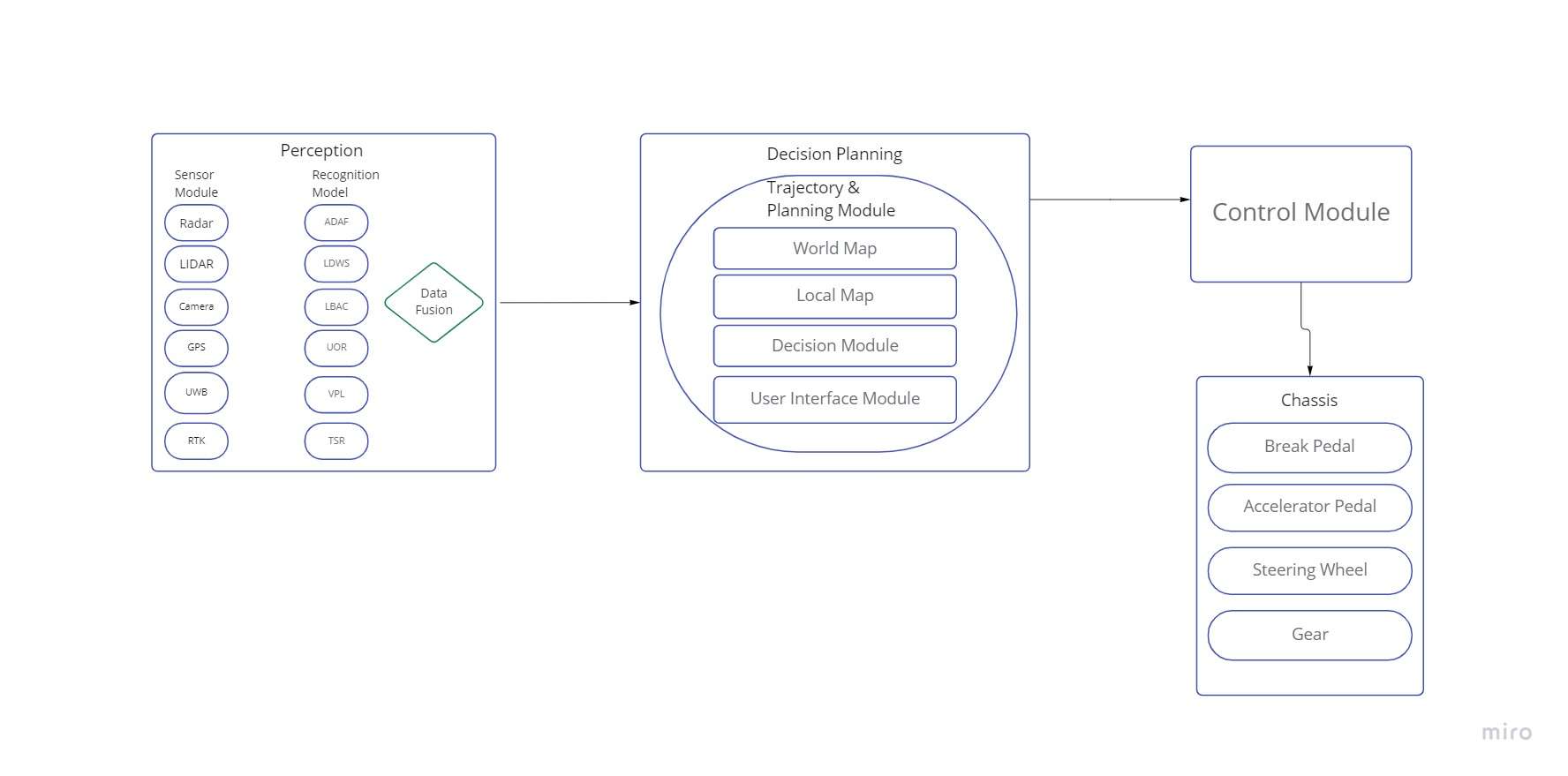

高级系统架构

架构中列出了基本的传感器、执行器、硬件和软件,这也展示了 AV 中的整个通信机制或协议。

知觉

此阶段包括识别 AV 相对于环境的位置,并使用各种传感器感知 AV 周围的环境。

AV 在这一步使用雷达、激光雷达、摄像头、实时动力学 (RTK) 和其他传感器。 识别模块从这些传感器接收数据并在传递后对其进行处理。

一般来说,自动驾驶汽车由控制系统、LDWS、TSR、未知障碍物识别(UOR)、车辆定位和定位(VPL)模块等组成。

综合信息经过处理后进入决策和规划阶段。

决策与规划

在此步骤中,使用感知过程中接收到的信息来决定、计划和控制 AV 的运动和行为。

大脑所代表的这个阶段是在路径规划、动作预测、避障等方面做出选择的地方。

选择基于现在和历史可访问的信息,包括实时地图数据、交通细节、趋势、用户信息等。

可能有一个数据日志模块来跟踪错误和数据以供以后使用。

系统

控制模块在接收到来自决策和规划模块的信息后,执行与 AV 的物理控制相关的操作/动作,例如转向、制动、加速等。

底座

最后一步涉及与固定在底盘上的机械部件进行交互,例如齿轮电机、方向盘电机、制动踏板电机以及加速器和制动器的踏板电机。

控制模块发出信号并管理所有这些组件。

在讨论各种关键传感器的设计、操作和使用之前,我们先谈谈 AV 的一般通信。

雷达

在 AV 中,雷达用于扫描环境以查找和定位汽车和其他物体。

雷达通常用于军事和民用目的,例如机场或气象系统,它们在毫米波 (mm-Wave) 频谱中运行。

现代汽车使用不同的频段,包括 24、60、77 和 79 GHz,测量范围为 5 到 200 m [10]。

通过计算发射信号和返回回波之间的 ToF,确定 AV 和物体之间的距离。

在 AV 中,RADAR 使用一组微天线,这些天线创建一组波瓣,以提高距离分辨率和多目标识别。 毫米波雷达可以利用多普勒频移的变化来精确评估任何方向的近距离物体,因为它具有更高的穿透性和更大的带宽。

由于毫米波雷达具有更长的波长,因此它们具有防阻挡和防污染能力,使其能够在雨、雪、雾和弱光条件下发挥作用。

此外,多普勒频移可用于通过毫米波雷达计算相对速度。 由于其功能强大,毫米波雷达非常适合广泛的 AV 应用,包括障碍物检测以及行人和车辆识别。

超声波传感器

这些传感器在 20–40 kHz 范围内工作并使用超声波。 用于测量物体距离的磁阻膜会产生这些波。

通过计算发射波到回波信号的飞行时间 (ToF),可以确定距离。 超声波传感器的典型范围小于 3 米。

传感器输出每 20 毫秒刷新一次,这使其无法符合 ITS 严格的 QoS 要求。 这些传感器具有相对较小的光束检测范围并且是定向的。

因此,为了获得全视野,需要大量传感器。 然而,许多传感器会相互作用,并可能导致明显的范围不准确。

激光雷达

905 和 1550 nm 的光谱用于 LiDAR。 由于人眼在 905 nm 范围内容易受到视网膜损伤,因此当前的 LiDAR 工作在 1550 nm 波段以减少视网膜损伤。

高达 200 米是 LiDAR 的最大工作范围。 固态、2D 和 3D 激光雷达是激光雷达的不同子类别。

单个激光束分散在 2D LiDAR 中快速旋转的镜子上。 通过在吊舱上放置多个激光器,3D LiDAR 可以获取周围环境的 3D 图片。

已经证明,路边 LiDAR 系统可以降低交叉路口和非交叉路口区域的车辆与行人 (V2P) 碰撞次数。

它采用 16 线、实时、计算有效的 LiDAR 系统。

建议使用人工深度自动编码器 神经网络 (DA-ANN),在 95 m 范围内实现了 30% 的准确度。

其中,演示了基于支持向量机 (SVM) 的算法与 64 线 3D LiDAR 相结合如何增强行人识别。

尽管激光雷达比毫米波雷达具有更好的测量精度和 3D 视觉,但在雾、雪和雨等恶劣天气下的表现较差。

相机

根据设备的波长,自动驾驶汽车中的摄像头可以是基于红外线或可见光的。

相机 (CMOS) 中使用电荷耦合器件 (CCD) 和互补金属氧化物半导体 (CMOS) 图像传感器。

根据镜头质量,相机的最大范围约为 250 m。 可见相机使用的三个波段——红色、绿色和蓝色——由与人眼相同的波长或 400-780 nm (RGB) 分开。

两个 VIS 相机与已建立的焦距相结合,以创建一个包含深度 (D) 信息的新通道,从而可以创建立体视觉。

借助此功能,可以通过摄像头 (RGB-D) 获得车辆周围区域的 3D 视图。

红外 (IR) 相机使用波长在 780 nm 和 1 mm 之间的无源传感器。 在峰值照明下,自动驾驶汽车中的红外传感器提供视觉控制。

该摄像头可帮助 AV 进行物体识别、侧视控制、事故记录和 BSD。 但是,在恶劣的天气下,例如雪、雾和不断变化的光线条件,相机的性能会发生变化。

相机的主要优点是它能够精确地收集和记录环境的纹理、颜色分布和形状。

全球导航卫星系统和全球定位系统,惯性测量单元

该技术通过精确定位其精确位置来帮助 AV 导航。 GNSS 使用一组环绕地球表面的轨道上的卫星进行定位。

该系统存储有关 AV 的位置、速度和精确时间的数据。

它通过计算接收到的信号和卫星发射之间的 ToF 来工作。 全球定位系统 (GPS) 坐标通常用于获取 AV 位置。

GPS 提取的坐标并不总是精确的,它们通常会添加平均值为 3 m 和标准偏差为 1 m 的位置误差。

在大都市情况下,性能进一步恶化,定位误差可达20m,在某些严重的情况下,GPS定位误差约为100m。

此外,自动驾驶汽车可以使用 RTK 系统来精确确定车辆的位置。

在 AV 中,车辆的位置和方向也可以使用航位推算 (DR) 和惯性位置来确定。

传感器融合

为了适当的车辆管理和安全,自动驾驶汽车必须准确、实时地了解位置、状态和其他车辆因素,如重量、稳定性、速度等。

这些信息必须由 AV 使用各种传感器收集。

通过合并从多个传感器获取的数据,传感器融合技术用于产生相干信息。

该方法允许合成从互补源获取的未处理数据。

因此,传感器融合使 AV 能够通过合并从各种传感器收集的所有有用数据来准确理解其周围环境。

不同类型的算法,包括卡尔曼滤波器和贝叶斯滤波器,用于在 AV 中执行融合过程。

由于卡尔曼滤波器用于多种应用,包括雷达跟踪、卫星导航系统和光学里程计,因此卡尔曼滤波器被视为车辆自主运行的关键。

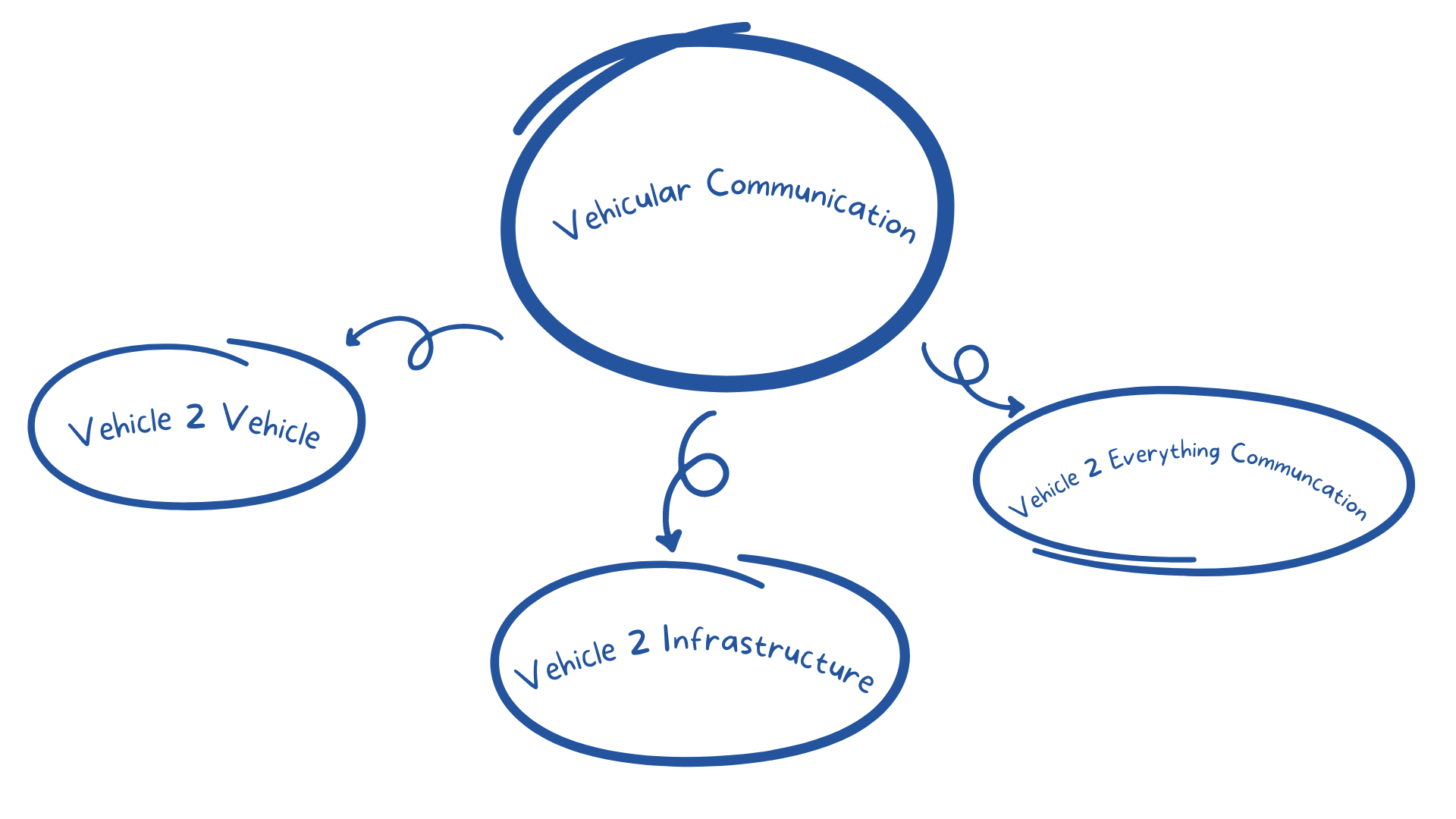

车载自组织网络 (VANET)

VANET 是移动自组织网络的一个新子类,可以自发地创建移动设备/车辆网络。 VANET 可以实现车对车 (V2V) 和车对基础设施 (V2I) 通信。

这种技术的主要目标是提高道路安全; 例如,在事故和交通拥堵等危险情况下,汽车可以相互交互并通过网络传递关键信息。

以下是 VANET 技术的主要组成部分:

- OBU(车载单元):它是一种基于 GPS 的跟踪系统,放置在每辆车中,允许它们相互交互以及与路边单元 (RSU) 交互。 OBU 配备了多个电子组件,包括资源命令处理器 (RCP)、传感器设备和 用户界面, 以获取基本信息。 其主要目的是使用无线网络在多个 RSU 和 OBU 之间进行通信。

- 路边单元 (RSU):RSU 是固定计算机单元,位于街道、停车场和路口的精确位置。 它的主要目标是将自动驾驶汽车与基础设施连接起来,它还有助于车辆定位。 此外,它还可用于将车辆连接到其他 RSU,利用各种 网络拓扑. 此外,它们已经在包括太阳能在内的环境能源上运行。

- 受信任的授权机构 (TA):它是一个控制 VANET 流程每一步的机构,确保只有合法的 RSU 和车辆 OBU 才能注册和交互。 通过确认 OBU ID 并验证车辆,它提供了安全性。 此外,它还会发现有害的通信和奇怪的行为。

VANET 用于车辆通信,包括 V2V、V2I 和 V2X 通信。

车2车通讯

汽车相互交谈并交换有关交通拥堵、事故和限速的关键信息的能力被称为车际通信 (IVC)。

V2V 通信可以通过使用网状拓扑(部分或全部)将各种节点(车辆)连接在一起来创建网络。

根据车辆间通信使用的跳数,它们被分类为单跳 (SIVC) 或多跳 (MIVC) 系统。

虽然 MIVC 可用于远程通信,例如交通监控,但 SIVC 可用于短距离应用,例如车道合并、ACC 等。

V2V 通信提供了众多优势,包括 BSD、FCWS、自动紧急制动 (AEB) 和 LDWS。

车辆 2 基础设施通信

汽车可以通过称为路边到车辆通信 (RVC) 的过程与 RSU 进行通信。 它有助于检测停车计时器、摄像头、车道标记和交通信号灯。

汽车和基础设施之间的 Ad hoc、无线和双向连接。

对于交通的管理和监督,使用了基础设施的数据。 它们用于调整各种速度参数,使汽车能够最大限度地提高燃油经济性并管理交通流量。

RVC系统可以根据基础设施(URVC)分为稀疏RVC(SRVC)和泛在RVC。

SRVC 系统仅在热点提供通信服务,例如定位开放停车位或加油站,而 URVC 系统提供全路线覆盖,即使在高速时也是如此。

为了保证网络覆盖,URVC系统需要大量投资。

车辆2一切通讯

汽车可以通过 V2X 与其他实体连接,包括行人、路边物体、设备和网格(V2P、V2R 和 V2D)(V2G)。

使用这种通信方式,驾驶员可以避免撞到危险的行人、骑自行车的人和摩托车手。

由于 V2X 通信,行人碰撞警告 (PCW) 系统可以在发生灾难性碰撞之前警告路边乘客的驾驶员。

为了向行人发送重要信息,PCW 可以利用智能手机的蓝牙或近场通信 (NFC)。

结论

用于构建自动驾驶汽车的许多技术会对它们的运行方式产生重大影响。

在最基本的情况下,汽车使用一系列传感器开发其周围环境的地图,这些传感器提供有关其周围路线和其路径中的其他车辆的信息。

然后由一个复杂的机器学习系统分析这些数据,该系统会生成一组动作供汽车执行。 随着系统对车辆周围环境的了解更多,这些行为会定期更改和更新。

尽管我尽最大努力向您介绍自动驾驶汽车系统架构的概述,但幕后还有很多事情要做。

我真诚地希望您会发现这些知识很有价值并加以利用。

发表评论