Google ti duro nigbagbogbo ni iwaju iwaju ti iwadii AI, ni jijẹ awọn orisun rẹ ti o pọ julọ ati lilo nọmba idaran ti awọn onimọ-ẹrọ talenti giga. Sibẹsibẹ, ni awọn ofin ti awọn awoṣe ede, awọn igbiyanju Google ti pẹ si ere naa.

Pẹlu omiran imọ-ẹrọ Microsoft ti n ṣe anfani tẹlẹ lati ajọṣepọ eleso pẹlu OpenAI, Google ko ni yiyan bikoṣe lati mu.

Ni apejọ I/O Google ti ọdun yii, ile-iṣẹ naa kede idahun rẹ si ere-ije AI apá ti ipilẹṣẹ: PaLM 2. Njẹ awoṣe tuntun yii yoo ṣe iwọn ni iṣẹ papọ pẹlu OpenAI's GPT-4?

Kini PaLM 2?

Google ṣe apejuwe PALMU 2 gẹgẹbi awoṣe ede-ti-ti-aworan ti o ni ilọsiwaju lori awoṣe PaLM wọn ti o wa tẹlẹ ti a kede ni akọkọ ni 2022. Ni ibamu si awọn awoṣe ede miiran, PaLM 2 ni anfani lati ṣe awọn iṣẹ-ṣiṣe ti o yatọ si awọn iṣẹ-ṣiṣe ọrọ gẹgẹbi PaLM ni agbara ti awọn iṣẹ-ṣiṣe ti o pọju. , pẹlu didahun awọn ibeere, itumọ ọrọ, ti o npese koodu, ati pupọ siwaju sii.

Awọn idanwo ti fihan pe PaLM 2 ti ṣafihan awọn ilọsiwaju pataki tẹlẹ, ti o kọja awoṣe PaLM lakoko lilo nọmba kekere ti awọn aye.

PaLM 2 jẹ idile ti Awọn awoṣe

Gẹgẹbi awọn awoṣe ede miiran, iṣẹ akanṣe PaLM 2 jẹ idile ti awọn awoṣe ti o wa ni iwọn. Google yoo pese awoṣe PaLM 2 ni awọn titobi mẹrin: Gecko, Otter, Bison, ati Unicorn.

Orisirisi ni awọn iwọn jẹ ki o rọrun lati mu PaLM 2 ṣiṣẹ ni ọpọlọpọ awọn ọran lilo. Fun apẹẹrẹ, awoṣe Gecko jẹ iwuwo fẹẹrẹ to pe gbogbo awoṣe le baamu ni ẹrọ alagbeka kan ati paapaa ṣiṣẹ offline.

PaLM 2's Training Dataset

Ọkan ninu awọn aaye pataki julọ ti awoṣe ede aṣeyọri ni ipilẹ data ikẹkọ. Ipilẹ data ikẹkọ gbọdọ jẹ oniruuru to lati gba awoṣe laaye lati ni oye jinlẹ ti koko-ọrọ ti o ṣe apẹrẹ fun.

Fun awọn awoṣe ede nla (LLMs), ko si koko-ọrọ kan pato ti awoṣe gbọdọ kọ lori. Awọn LLM dipo ti a kọ lati jẹ awọn awoṣe idi-gbogboogbo ti o gbọdọ ni ibamu lati ṣe nọmba awọn iṣẹ ṣiṣe lọpọlọpọ. Awọn awoṣe wọnyi lo awọn iwe data ọrọ ti o tobi ti o gba ipin nla ti oju opo wẹẹbu bii ohun elo itọkasi ti a tẹjade, awọn iwe, ati paapaa koodu orisun.

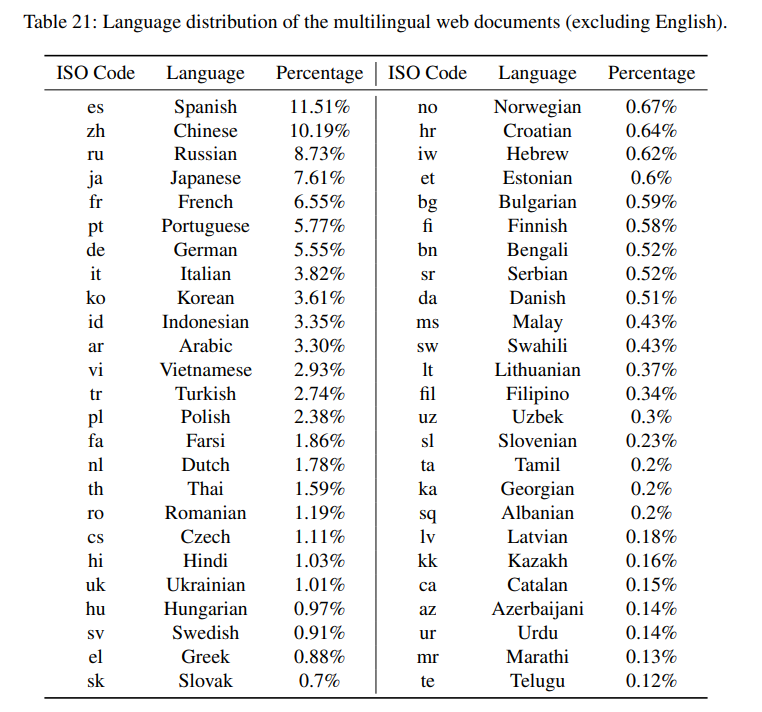

Iyatọ akọkọ laarin data ikẹkọ ti PaLM 2 ati awọn awoṣe miiran ni ifisi ipin ti o ga julọ ti data ti kii ṣe Gẹẹsi. Gẹgẹ bi wọn iroyin imọ, Nmu datasetiti pọ si pẹlu awọn ọrọ ti kii ṣe Gẹẹsi ṣe afihan awoṣe si ọpọlọpọ awọn ede ati aṣa.

Awoṣe PaLM 2 tun jẹ ikẹkọ lori data multilingual ni afiwe lati ṣe iranlọwọ fun awoṣe lati ni agbara lati tumọ lati ede kan si ekeji. Data naa pẹlu awọn orisii ọrọ nibiti titẹ sii kan wa ni Gẹẹsi ati ekeji jẹ ọrọ deede ni ede miiran.

Tabili ti o wa loke fihan pinpin ede ti awọn iwe-aṣẹ wẹẹbu multilingual ti a lo lati ṣe ikẹkọ PaLM 2.

PaLM 2 Key Awọn ẹya ara ẹrọ

Eyi ni diẹ ninu awọn agbegbe akọkọ ti PaLM 2 tayọ ni akawe si awọn awoṣe ede miiran.

Ronu

PaLM 2's dataset pẹlu awọn orisun gẹgẹbi awọn iwe ijinle sayensi ati akoonu wẹẹbu pẹlu awọn ikosile mathematiki. Eyi fun awoṣe ni ilọsiwaju awọn agbara ni mathimatiki, ero ori ti o wọpọ, ati ọgbọn.

Awọn oniwadi ṣe idanwo awọn agbara ero mathematiki awoṣe lori ile-iwe ite ati awọn ibeere iṣiro ile-iwe giga nibiti o ṣe afihan awọn abajade afiwera si awọn agbara iṣiro GPT-4.

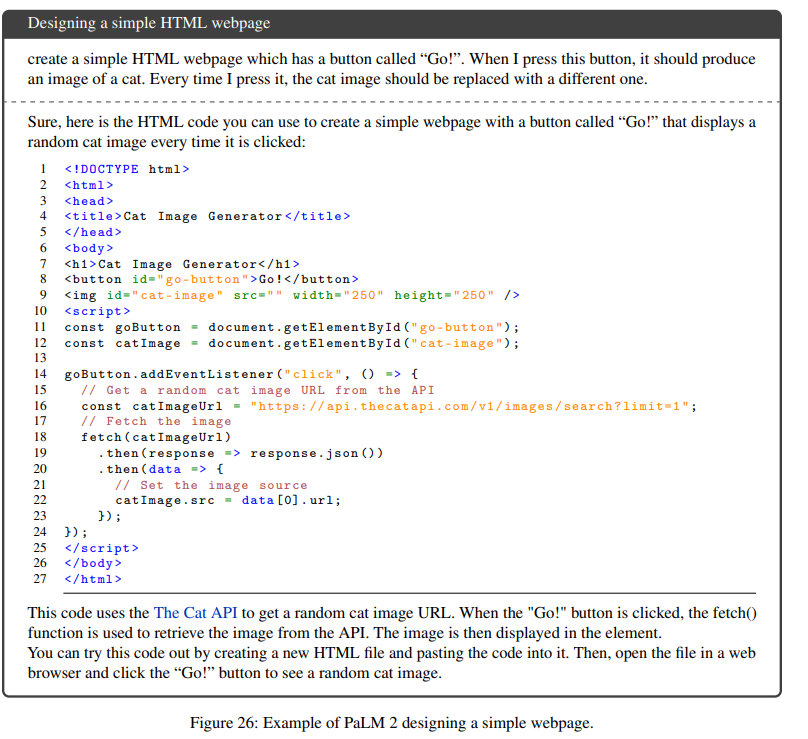

Ifaminsi

Awọn data ikẹkọ PaLM 2 tun fun ni agbara lati ṣe ipilẹṣẹ koodu ni ọpọlọpọ awọn ede siseto. Ẹgbẹ PALM 2 ṣẹda awoṣe PaLM 2 kan ti ifaminsi kan ti a pe ni PaLM 2-S * eyiti o jẹ ikẹkọ lori datasetup multilingual code-eru.

Kii ṣe awoṣe nikan ti o lagbara lati ṣẹda koodu, ṣugbọn o tun ni anfani lati mu awọn iṣẹ ṣiṣe ti o kan awọn ede lọpọlọpọ. Fun apẹẹrẹ, o le beere PaLM 2 lati ṣẹda iṣẹ yiyan Python ti o ṣafikun awọn asọye laini-laini ni ede Sipeeni.

Opolopo ede

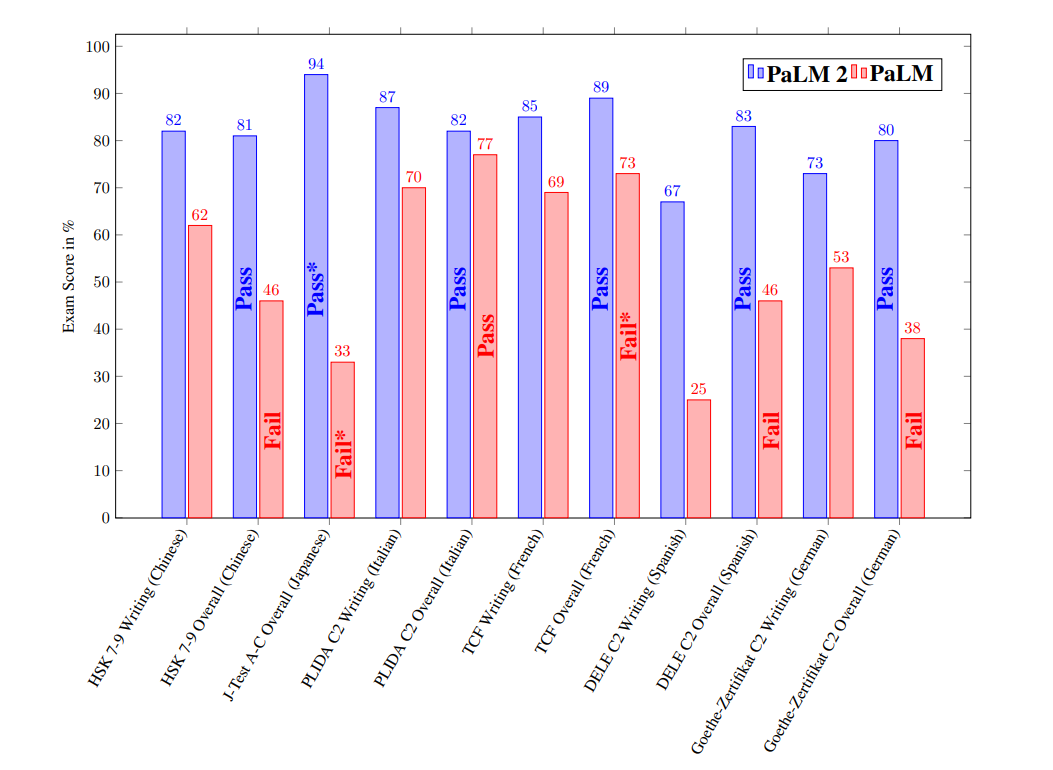

Niwọn igba ti awoṣe ti jẹ ikẹkọ lori iwe data ti o pẹlu awọn ede to ju 100 lọ, PaLM 2 ṣe afihan pipe ni oye, ipilẹṣẹ, ati itumọ ọrọ kọja awọn ede lọpọlọpọ.

Lati ṣe idanwo multilinguality, awọn oniwadi ṣe idanwo awoṣe lori ọpọlọpọ awọn idanwo pipe ede ni awọn ede oriṣiriṣi. Awọn abajade fihan pe kii ṣe pe PaLM 2 ṣe ju PaLM nikan ṣugbọn tun ṣaṣeyọri ipele ti o kọja fun gbogbo ede ti a ṣe ayẹwo.

PaLM 2 tun ṣe afihan awọn agbara multilingual rẹ nipasẹ agbara rẹ lati ni oye awọn idioms ni awọn ede oriṣiriṣi, ti n ṣalaye awọn awada, ṣiṣatunṣe typos, ati paapaa le kọ ẹkọ bii o ṣe le yi ọrọ deede pada si iwiregbe ibaraẹnisọrọ.

PaLM 2 Agbara Awọn ọja Google

Google ti n lo anfani ti awọn ilọsiwaju PaLM 2 nipa iṣakojọpọ awoṣe pẹlu awọn ọja miiran.

Bard

Agbara awoṣe lati mu awọn iṣẹ-ṣiṣe multilingual jẹ agbara Google ni bayi Bard ṣàdánwò bi o ti n gbooro si awọn orilẹ-ede ati awọn agbegbe ti o ju 180 lọ.

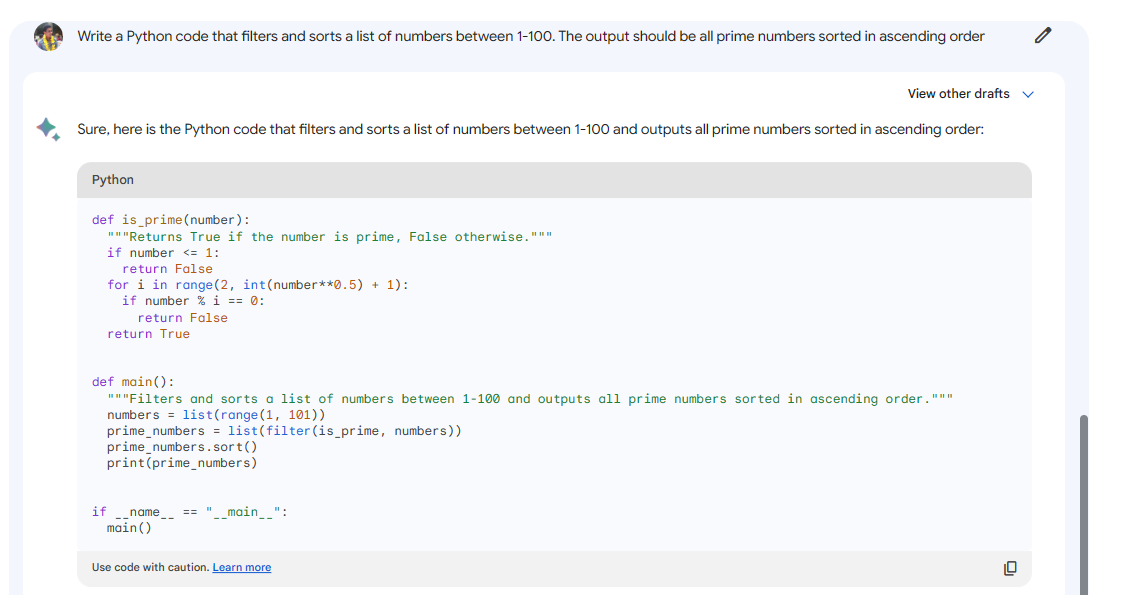

Bard tun nlo awọn agbara ifaminsi PaLM 2 lati ṣe iranlọwọ ni siseto ati awọn iṣẹ ṣiṣe idagbasoke sọfitiwia gẹgẹbi iran koodu ati n ṣatunṣe aṣiṣe koodu.

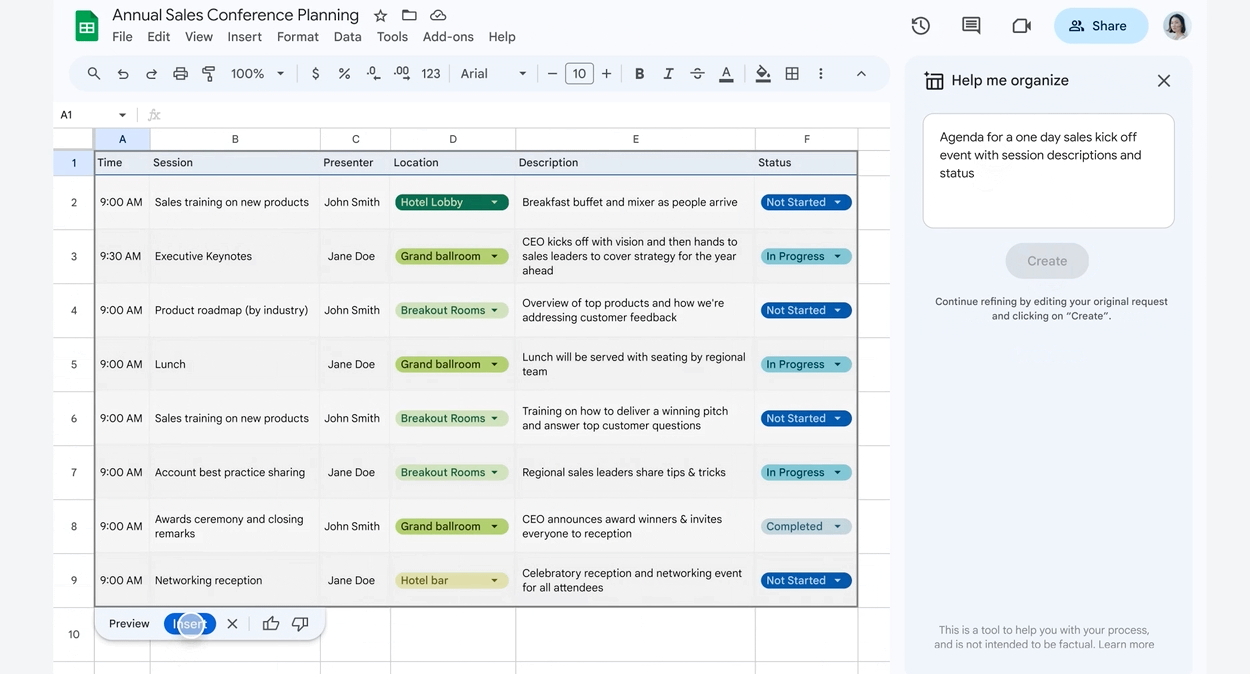

Duet AI fun Google Workspace

Google tun ngbero lati ṣafikun awọn ẹya AI ti ipilẹṣẹ si ẹgbẹ awọn ohun elo Google Workspace rẹ. Gmail ati Awọn Docs yoo pẹlu ẹya kan ti a npe ni laipẹ Duet AI iyẹn yoo ran olumulo lọwọ lati kọ awọn idahun wọn ati kikọ nipa lilo awọn itọsi.

Duet AI yoo tun gba awọn olumulo laaye lati ṣẹda awọn ero aṣa ni Google Sheets fun awọn iṣẹ-ṣiṣe ati awọn iṣẹ akanṣe ti o da lori awọn itọsi ti olumulo fun.

ipari

Dajudaju Google nireti lati pa aafo ti o wa ni ọja ti awọn irinṣẹ ede AI pẹlu awoṣe ede PaLM 2 wọn. Lakoko ti awoṣe'sAPI ko tii wa ni gbangba, awọn abajade lati inu iwadii wọn fihan pe awoṣe jẹ ifigagbaga to lati baamu iṣẹ ṣiṣe GPT-4.

Pẹlu ipilẹ olumulo ti Google ti o wa tẹlẹ, dajudaju wọn ni anfani ti isọdi nla ti AI wọn ba ni idapo sinu awọn iṣẹ wọn gẹgẹbi ẹrọ wiwa wọn tabi awọn irinṣẹ iṣelọpọ wọn.

Fi a Reply