Cơ sở dữ liệu vectơ thể hiện sự thay đổi đáng kể trong cách chúng ta quản lý và diễn giải dữ liệu, đặc biệt là trong lĩnh vực trí tuệ nhân tạo và học máy.

Chức năng cơ bản của các cơ sở dữ liệu này là xử lý hiệu quả các vectơ chiều cao, là nguyên liệu thô của mô hình học máy và bao gồm việc chuyển đổi đầu vào văn bản, hình ảnh hoặc âm thanh thành biểu diễn số trong không gian đa chiều.

Đối với các ứng dụng như hệ thống đề xuất, nhận dạng đối tượng, truy xuất hình ảnh và phát hiện gian lận, quá trình chuyển đổi này không chỉ đơn thuần là lưu trữ; đó là cánh cửa dẫn đến các khả năng mạnh mẽ trong tìm kiếm tương tự và truy vấn lân cận gần nhất.

Sâu xa hơn, sức mạnh của cơ sở dữ liệu vectơ nằm ở khả năng dịch một lượng lớn dữ liệu phức tạp, không có cấu trúc thành các vectơ nắm bắt được bối cảnh và ý nghĩa của nội dung gốc.

Các chức năng tìm kiếm nâng cao có thể thực hiện được bằng cách nhúng các mô hình vào mã hóa này bao gồm khả năng truy vấn các vectơ xung quanh để tìm các hình ảnh hoặc cụm từ liên quan.

Cơ sở dữ liệu vectơ độc đáo ở chỗ chúng được xây dựng trên các kỹ thuật lập chỉ mục nâng cao như Chỉ mục tệp đảo ngược (IVF) và Thế giới nhỏ có thể điều hướng theo cấp bậc (HNSW), giúp cải thiện tốc độ và hiệu quả của chúng trong khi định vị các lân cận gần nhất trong không gian N chiều.

Có sự khác biệt rõ ràng giữa cơ sở dữ liệu vector và cơ sở dữ liệu cổ điển. Cơ sở dữ liệu thông thường rất tốt trong việc tổ chức dữ liệu thành các tập hợp có tổ chức được tối ưu hóa CRUD và tuân thủ các lược đồ tập hợp.

Tuy nhiên, khi xử lý tính chất năng động và phức tạp của dữ liệu nhiều chiều, sự cứng nhắc này bắt đầu trở thành một trở ngại.

Ngược lại, cơ sở dữ liệu vectơ cung cấp mức độ linh hoạt và hiệu quả mà các cơ sở dữ liệu truyền thống không thể sánh bằng, đặc biệt đối với các ứng dụng phụ thuộc nhiều vào học máy và trí tuệ nhân tạo. Họ không chỉ có khả năng mở rộng và thành thạo trong việc tìm kiếm sự tương đồng.

Cơ sở dữ liệu vectơ đặc biệt hữu ích cho các ứng dụng AI tổng hợp. Để đảm bảo rằng tài liệu được tạo vẫn giữ được tính toàn vẹn theo ngữ cảnh, các ứng dụng này—bao gồm xử lý ngôn ngữ tự nhiên và tạo hình ảnh—phụ thuộc vào khả năng truy xuất và so sánh nhanh chóng các phần nhúng.

Vì vậy, trong phần này, chúng ta sẽ xem xét các cơ sở dữ liệu vectơ hàng đầu cho dự án tiếp theo của bạn.

1. Milvus

Milvus là cơ sở dữ liệu vectơ nguồn mở tiên phong được thiết kế chủ yếu cho các ứng dụng AI, bao gồm các tìm kiếm tương tự được nhúng và MLOps mạnh mẽ.

Nó khác với cơ sở dữ liệu quan hệ thông thường, chủ yếu xử lý dữ liệu có cấu trúc, nhờ khả năng này, cho phép nó lập chỉ mục các vectơ ở quy mô nghìn tỷ chưa từng có.

Sự cống hiến của Milvus đối với khả năng mở rộng và tính sẵn sàng cao được thể hiện qua cách nó đã phát triển từ phiên bản đầu tiên đến Milvus 2.0 gốc đám mây được phân phối đầy đủ.

Cụ thể, Milvus 2.0 thể hiện một thiết kế hoàn toàn dựa trên nền tảng đám mây nhằm đạt được độ khả dụng đáng kinh ngạc 99.9% trong khi mở rộng quy mô ra ngoài hàng trăm nút.

Đối với những người đang tìm kiếm giải pháp cơ sở dữ liệu vectơ đáng tin cậy, phiên bản này rất được khuyến khích vì nó không chỉ bổ sung các tính năng phức tạp như kết nối nhiều đám mây và bảng quản trị mà còn cải thiện mức độ nhất quán của dữ liệu để phát triển ứng dụng linh hoạt.

Ưu điểm đáng chú ý của Milvus là cách tiếp cận dựa vào cộng đồng, cung cấp hỗ trợ đa ngôn ngữ và chuỗi công cụ mở rộng phù hợp với nhu cầu của các nhà phát triển.

Trong lĩnh vực CNTT, khả năng mở rộng và độ tin cậy của đám mây, cùng với khả năng tìm kiếm vectơ hiệu suất cao trên các tập dữ liệu lớn, khiến nó trở thành một lựa chọn phổ biến.

Ngoài ra, nó còn nâng cao hiệu quả hoạt động bằng cách sử dụng khả năng tìm kiếm kết hợp kết hợp tìm kiếm tương tự vectơ với lọc vô hướng.

Milvus có một hội đồng quản trị rõ ràng giao diện người dùng, một bộ API đầy đủ cũng như kiến trúc có thể mở rộng và điều chỉnh được.

Giao tiếp với các ứng dụng bên ngoài được hỗ trợ bởi lớp truy cập, trong khi cân bằng tải và quản lý dữ liệu được điều phối bởi dịch vụ điều phối, đóng vai trò là lệnh trung tâm.

Tính lâu dài của cơ sở dữ liệu được hỗ trợ bởi lớp lưu trữ đối tượng, trong khi các nút công nhân thực hiện các hoạt động để đảm bảo khả năng mở rộng.

GIÁ CẢ

Nó là miễn phí để sử dụng cho tất cả mọi người.

2. THẤT BẠI

Nhóm Nghiên cứu AI của Facebook đã phát triển một thư viện tiên tiến có tên là Tìm kiếm tương tự AI của Facebook. Thư viện này được thiết kế để giúp phân cụm vectơ dày đặc và tìm kiếm tương tự hiệu quả hơn.

Việc tạo ra nó được thúc đẩy bởi yêu cầu cải thiện khả năng tìm kiếm điểm tương đồng của AI của Facebook bằng cách sử dụng các phương pháp cơ bản tiên tiến.

So với việc triển khai dựa trên CPU, việc triển khai GPU tiên tiến của FAISS có thể tăng tốc thời gian tìm kiếm từ 5 đến 10 lần, khiến nó trở thành một công cụ vô giá cho nhiều ứng dụng, bao gồm hệ thống đề xuất và xác định ý nghĩa tương tự trong phạm vi lớn. các tập dữ liệu phi cấu trúc như văn bản, âm thanh và video.

FAISS có thể xử lý một loạt các số liệu tương tự, chẳng hạn như độ tương tự cosin, tích bên trong và số liệu L2 thường được sử dụng (khoảng cách Euclide).

Các phép đo này giúp thực hiện tìm kiếm tương tự chính xác và linh hoạt trên nhiều loại dữ liệu khác nhau dễ dàng hơn. Các tính năng như xử lý hàng loạt, cân bằng tốc độ chính xác và hỗ trợ cả tìm kiếm chính xác và gần đúng sẽ làm tăng thêm tính linh hoạt của nó.

Ngoài ra, FAISS còn cung cấp một phương pháp có thể mở rộng để xử lý các tập dữ liệu lớn bằng cách cho phép lưu trữ các chỉ mục trên đĩa.

Tệp đảo ngược, lượng tử hóa sản phẩm (PQ) và PQ cải tiến chỉ là một số kỹ thuật cải tiến tạo nên nền tảng nghiên cứu của FAISS và tăng thêm tính hiệu quả của nó khi lập chỉ mục và tìm kiếm các trường vectơ chiều cao.

Các chiến lược này được củng cố bằng các phương pháp tiên tiến như thuật toán chọn k được tăng tốc GPU và lọc trước khoảng cách PQ, đảm bảo khả năng của FAISS trong việc tạo ra kết quả tìm kiếm nhanh chóng và chính xác ngay cả trong các bộ dữ liệu quy mô hàng tỷ.

GIÁ CẢ

Nó là miễn phí để sử dụng cho tất cả mọi người.

3. trái tùng

Pinecone là công ty dẫn đầu về cơ sở dữ liệu vectơ, cung cấp dịch vụ được quản lý dựa trên đám mây, được xây dựng đặc biệt để cải thiện hiệu suất của các ứng dụng AI công suất cao.

Nó được thiết kế đặc biệt để xử lý việc nhúng vectơ, vốn rất cần thiết cho AI tổng quát, tìm kiếm ngữ nghĩa và các ứng dụng sử dụng mô hình ngôn ngữ lớn.

AI giờ đây có thể hiểu thông tin ngữ nghĩa nhờ các phần nhúng này, hoạt động hiệu quả như bộ nhớ dài hạn cho các tác vụ phức tạp.

Pinecone độc đáo ở chỗ nó tích hợp liền mạch các khả năng của cơ sở dữ liệu truyền thống với hiệu suất nâng cao của các chỉ mục vectơ, cho phép lưu trữ và truy vấn các phần nhúng một cách hiệu quả và quy mô lớn.

Điều này làm cho nó trở thành lựa chọn hoàn hảo trong các tình huống trong đó độ phức tạp và khối lượng dữ liệu liên quan khiến cơ sở dữ liệu dựa trên vô hướng tiêu chuẩn không đủ.

Pinecone cung cấp cho các nhà phát triển một giải pháp đơn giản nhờ cách tiếp cận dịch vụ được quản lý, giúp hợp lý hóa quy trình tích hợp và thu thập dữ liệu theo thời gian thực.

Nhiều hoạt động dữ liệu được nó hỗ trợ, bao gồm tìm nạp, cập nhật, xóa, truy vấn và cập nhật dữ liệu.

Pinecone còn đảm bảo rằng các truy vấn thể hiện các sửa đổi theo thời gian thực như cập nhật và xóa mang lại phản hồi chính xác, độ trễ thấp cho các chỉ mục có hàng tỷ vectơ.

Trong các tình huống động, tính năng này rất cần thiết để duy trì mức độ liên quan và độ mới của kết quả truy vấn.

Ngoài ra, sự hợp tác của Pinecone với Airbyte thông qua kết nối Pinecone làm tăng tính linh hoạt và linh hoạt của nó, cho phép tích hợp dữ liệu trơn tru từ nhiều nguồn khác nhau.

Thông qua mối quan hệ này, chi phí và hiệu quả có thể được tối ưu hóa bằng cách đảm bảo rằng chỉ những thông tin mới thu được mới được xử lý thông qua đồng bộ hóa dữ liệu gia tăng.

Thiết kế của đầu nối nhấn mạnh đến tính đơn giản, chỉ cần các tham số thiết lập tối thiểu và có thể mở rộng, cho phép cải tiến trong tương lai.

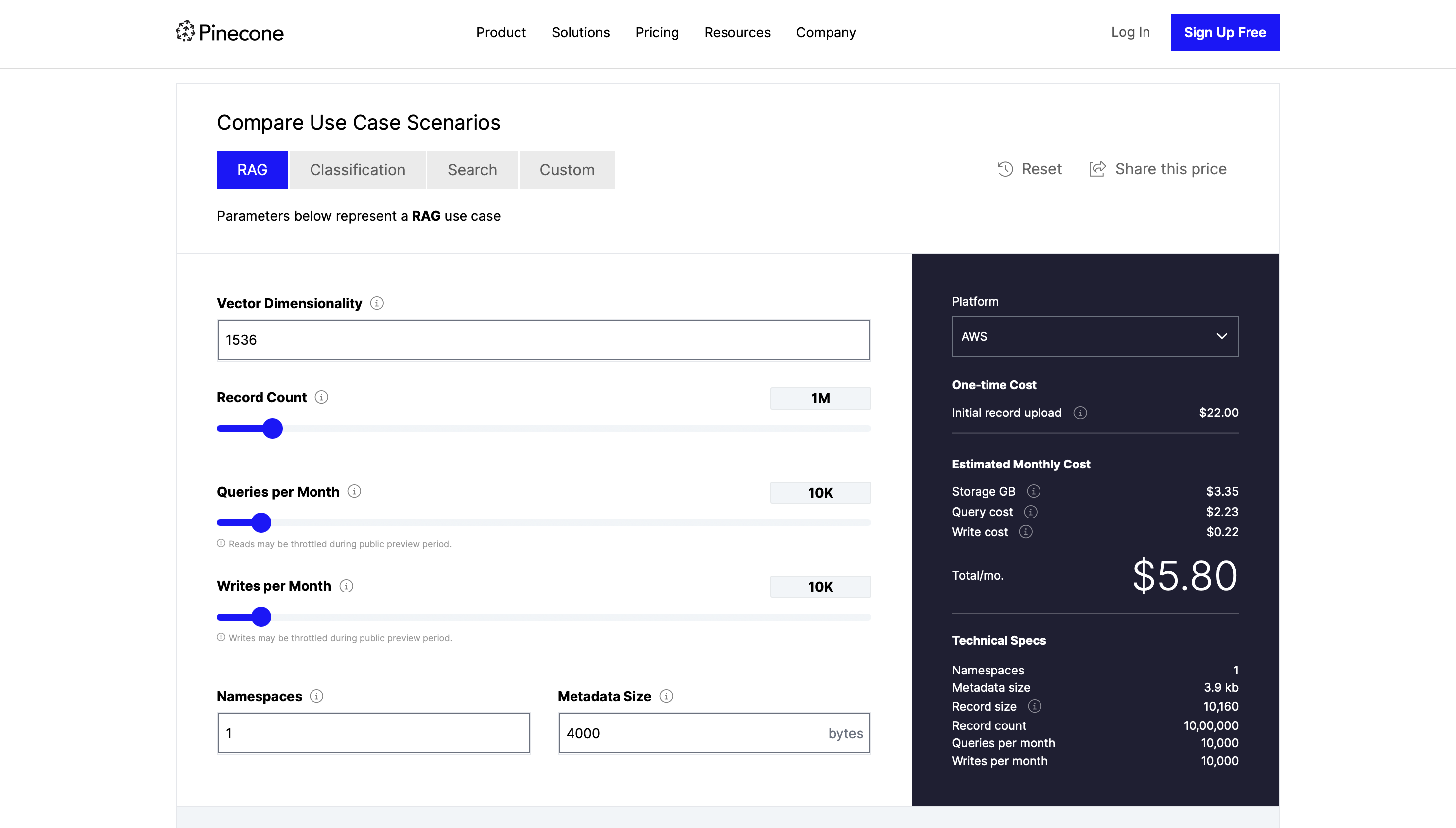

GIÁ CẢ

Giá cao cấp bắt đầu từ $5.80/tháng cho trường hợp sử dụng RAG.

4. Làm suy yếu

Weaviate là cơ sở dữ liệu vectơ cải tiến có sẵn dưới dạng phần mềm nguồn mở giúp thay đổi cách chúng ta truy cập và sử dụng dữ liệu.

Weaviate sử dụng các khả năng tìm kiếm vectơ, cho phép tìm kiếm phức tạp, theo ngữ cảnh trên các tập dữ liệu lớn, phức tạp, trái ngược với các cơ sở dữ liệu thông thường phụ thuộc vào giá trị vô hướng và các truy vấn được xác định trước.

Với phương pháp này, bạn có thể định vị nội dung dựa trên mức độ tương tự của nó với nội dung khác, điều này giúp cải thiện tính trực quan của tìm kiếm và mức độ liên quan của kết quả.

Sự tích hợp mượt mà của nó với các mô hình học máy là một trong những đặc điểm chính của nó; điều này cho phép nó hoạt động không chỉ đơn thuần là một giải pháp lưu trữ dữ liệu; nó cũng cho phép hiểu và phân tích dữ liệu bằng trí tuệ nhân tạo.

Kiến trúc của Weaviate kết hợp triệt để sự tích hợp này, giúp phân tích dữ liệu phức tạp mà không cần sử dụng các công cụ bổ sung.

Sự hỗ trợ của nó dành cho các mô hình dữ liệu biểu đồ cũng cung cấp một góc nhìn khác về dữ liệu dưới dạng các thực thể được liên kết, hiển thị các mẫu và thông tin chi tiết có thể bị bỏ sót trong các kiến trúc cơ sở dữ liệu thông thường.

Nhờ kiến trúc mô-đun của Weaviate, khách hàng có thể bổ sung các khả năng như vectơ hóa dữ liệu và tạo bản sao lưu nếu cần.

Phiên bản cơ bản của nó hoạt động như một cơ sở dữ liệu chuyên về dữ liệu vector và có thể được mở rộng với các mô-đun khác để đáp ứng các nhu cầu khác nhau.

Khả năng mở rộng của nó được tăng cường hơn nữa nhờ thiết kế mô-đun, đảm bảo rằng tốc độ sẽ không bị ảnh hưởng để đáp ứng số lượng dữ liệu và nhu cầu truy vấn ngày càng tăng.

Một phương pháp tương tác linh hoạt và hiệu quả với dữ liệu được lưu trữ có thể thực hiện được nhờ sự hỗ trợ của cơ sở dữ liệu cho cả API RESTful và GraphQL.

Đặc biệt, GraphQL được chọn vì khả năng thực hiện nhanh chóng các truy vấn phức tạp dựa trên biểu đồ, cho phép người dùng lấy chính xác dữ liệu họ muốn mà không cần lấy quá nhiều hoặc không đủ lượng dữ liệu.

Weaviate thân thiện với người dùng hơn trên nhiều thư viện máy khách và ngôn ngữ lập trình nhờ API linh hoạt của nó.

Đối với những người muốn khám phá thêm về Weaviate, có rất nhiều tài liệu và hướng dẫn có sẵn, từ việc thiết lập và định cấu hình phiên bản của bạn cho đến tìm hiểu sâu về các khả năng của nó như tìm kiếm vectơ, tích hợp máy học và thiết kế lược đồ.

Bạn có thể truy cập vào cùng một công nghệ mạnh mẽ giúp thông tin trở nên linh hoạt và có thể thực hiện được cho dù bạn quyết định vận hành Weaviate cục bộ, theo cách điện toán đám mây môi trường hoặc thông qua dịch vụ đám mây do Weaviate quản lý.

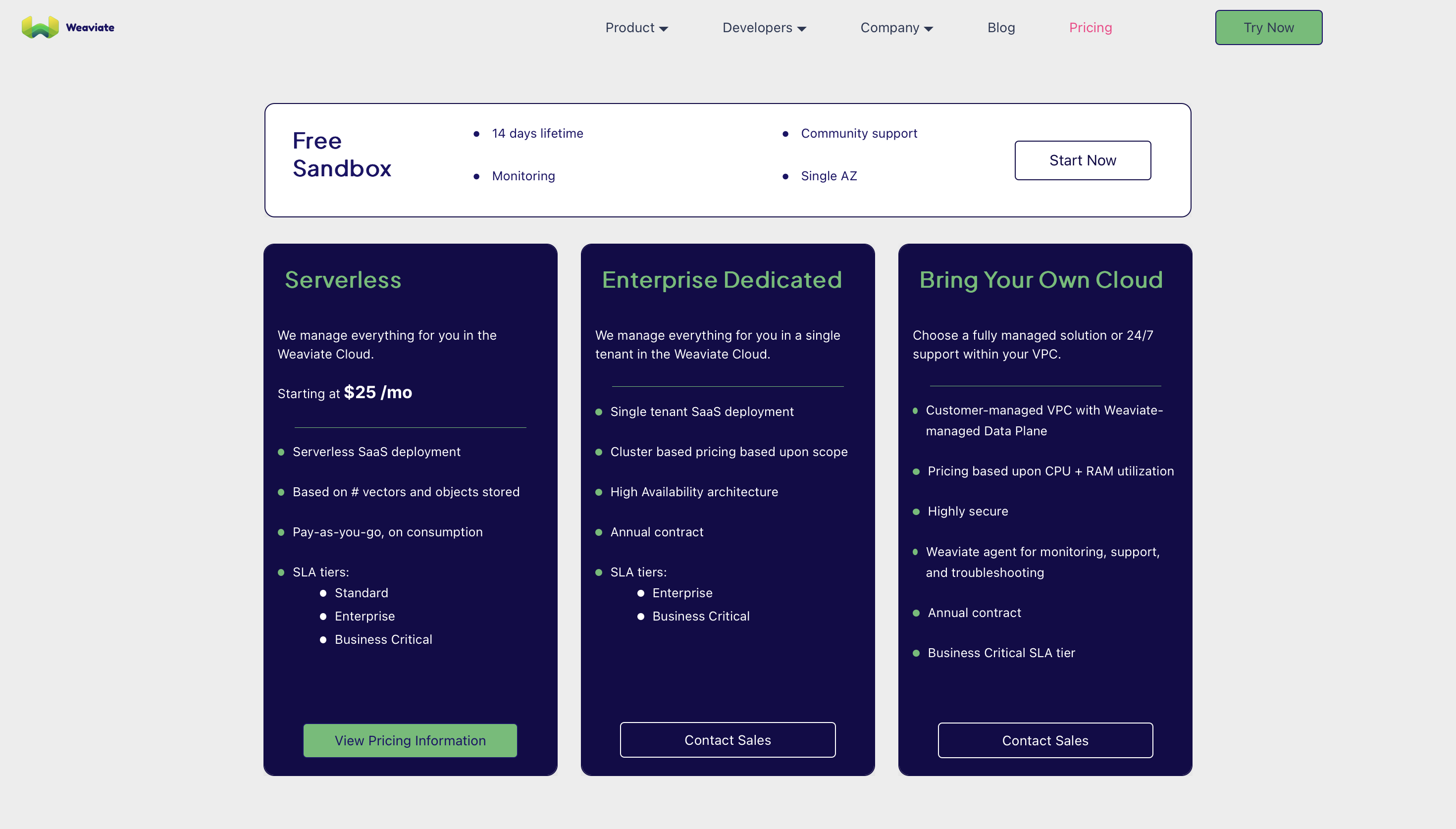

GIÁ CẢ

Giá cao cấp của nền tảng bắt đầu từ $25/tháng cho serverless.

5. Chroma

Chroma là cơ sở dữ liệu vectơ tiên tiến nhằm mục đích cách mạng hóa việc truy xuất và lưu trữ dữ liệu, đặc biệt dành cho các ứng dụng liên quan đến học máy và trí tuệ nhân tạo.

Vì Chroma hoạt động với vectơ thay vì số vô hướng, không giống như cơ sở dữ liệu tiêu chuẩn, nên nó rất tốt trong việc quản lý dữ liệu phức tạp, nhiều chiều.

Đây là một tiến bộ lớn trong công nghệ truy xuất dữ liệu vì nó cho phép tìm kiếm phức tạp hơn dựa trên sự giống nhau về ngữ nghĩa của tài liệu thay vì kết hợp từ khóa chính xác.

Đặc điểm đáng chú ý của Chroma là khả năng hoạt động với một số giải pháp lưu trữ cơ bản, chẳng hạn như ClickHouse để cài đặt theo tỷ lệ và DuckDB để cài đặt độc lập, đảm bảo tính linh hoạt và thích ứng với nhiều trường hợp sử dụng khác nhau.

Chroma được tạo ra với mục tiêu đơn giản, tốc độ và khả năng phân tích. Nó có sẵn cho nhiều nhà phát triển có SDK cho Python và JavaScript/TypeScript.

Ngoài ra, Chroma đặc biệt chú trọng đến tính thân thiện với người dùng, cho phép các nhà phát triển nhanh chóng thiết lập cơ sở dữ liệu cố định được hỗ trợ bởi DuckDB hoặc cơ sở dữ liệu trong bộ nhớ để thử nghiệm.

Khả năng xây dựng các đối tượng bộ sưu tập giống với các bảng trong cơ sở dữ liệu thông thường, nơi dữ liệu văn bản có thể được chèn và tự động chuyển đổi thành các phần nhúng bằng cách sử dụng các mô hình như all-MiniLM-L6-v2, làm tăng thêm tính linh hoạt này.

Văn bản và phần nhúng có thể được tích hợp liền mạch, điều này rất cần thiết cho các ứng dụng cần nắm bắt ngữ nghĩa dữ liệu.

Nền tảng của phương pháp tương tự vectơ của Chroma là các khái niệm toán học về tính trực giao và mật độ, những điều cần thiết để hiểu cách biểu diễn và so sánh dữ liệu trong cơ sở dữ liệu.

Những ý tưởng này cho phép Chroma thực hiện các tìm kiếm tương tự có ý nghĩa và hiệu quả bằng cách tính đến các mối liên kết ngữ nghĩa giữa các thành phần dữ liệu.

Những tài nguyên như hướng dẫn và hướng dẫn có thể truy cập được đối với những cá nhân muốn khám phá thêm về Chroma. Chúng bao gồm hướng dẫn từng bước về cách thiết lập cơ sở dữ liệu, tạo bộ sưu tập và chạy tìm kiếm tương tự.

GIÁ CẢ

Bạn có thể bắt đầu sử dụng nó miễn phí.

6. Vespa

Vespa là nền tảng đang chuyển đổi cách xử lý trực tuyến AI và dữ liệu lớn.

Mục đích cơ bản của Vespa là cho phép tính toán có độ trễ thấp trên các tập dữ liệu lớn, cho phép bạn dễ dàng lưu trữ, lập chỉ mục và phân tích văn bản, vectơ và dữ liệu có cấu trúc.

Vespa nổi bật nhờ khả năng cung cấp câu trả lời nhanh chóng ở mọi quy mô, bất kể bản chất của các truy vấn, lựa chọn hay suy luận mô hình học máy đang được xử lý.

Tính linh hoạt của Vespa được thể hiện trong cơ sở dữ liệu vectơ và công cụ tìm kiếm đầy đủ chức năng, cho phép thực hiện nhiều tìm kiếm trong một truy vấn duy nhất, từ dữ liệu vectơ (ANN), từ vựng và có cấu trúc.

Bất kể quy mô, bạn có thể tạo các ứng dụng tìm kiếm thân thiện với người dùng và phản hồi nhanh với khả năng AI thời gian thực nhờ tích hợp suy luận mô hình học máy với dữ liệu của bạn.

Tuy nhiên, Vespa không chỉ đơn thuần là tìm kiếm; đó còn là việc hiểu và tùy chỉnh các cuộc gặp gỡ.

Các công cụ đề xuất và tùy chỉnh hàng đầu cung cấp các đề xuất năng động, hiện tại dành cho người dùng hoặc hoàn cảnh cụ thể.

Vespa là công cụ thay đổi cuộc chơi cho bất kỳ ai muốn tham gia vào không gian đàm thoại AI, vì nó cung cấp cơ sở hạ tầng cần thiết để lưu trữ và khám phá dữ liệu văn bản và vectơ trong thời gian thực, cho phép phát triển các tác nhân AI thực tế và tiên tiến hơn.

Với mã thông báo toàn diện và gốc, tìm kiếm toàn văn bản, tìm kiếm lân cận gần nhất và truy vấn dữ liệu có cấu trúc đều được hỗ trợ bởi khả năng truy vấn mở rộng của nền tảng.

Nó khác ở chỗ nó có thể xử lý hiệu quả các truy vấn phức tạp bằng cách kết hợp nhiều chiều tìm kiếm.

Vespa là một cỗ máy tính toán mạnh mẽ cho các ứng dụng AI và máy học vì công cụ tính toán của nó có thể xử lý các biểu thức toán học phức tạp trên các đại số vô hướng và tensor.

Trong quá trình vận hành, Vespa được thiết kế để sử dụng đơn giản và có thể mở rộng.

Nó hợp lý hóa các quy trình lặp đi lặp lại, từ cấu hình hệ thống và phát triển ứng dụng đến quản lý dữ liệu và nút, cho phép các hoạt động sản xuất an toàn và không bị gián đoạn.

Kiến trúc của Vespa đảm bảo rằng nó mở rộng cùng với dữ liệu của bạn, duy trì độ tin cậy và hiệu suất.

GIÁ CẢ

Bạn có thể bắt đầu sử dụng nó miễn phí.

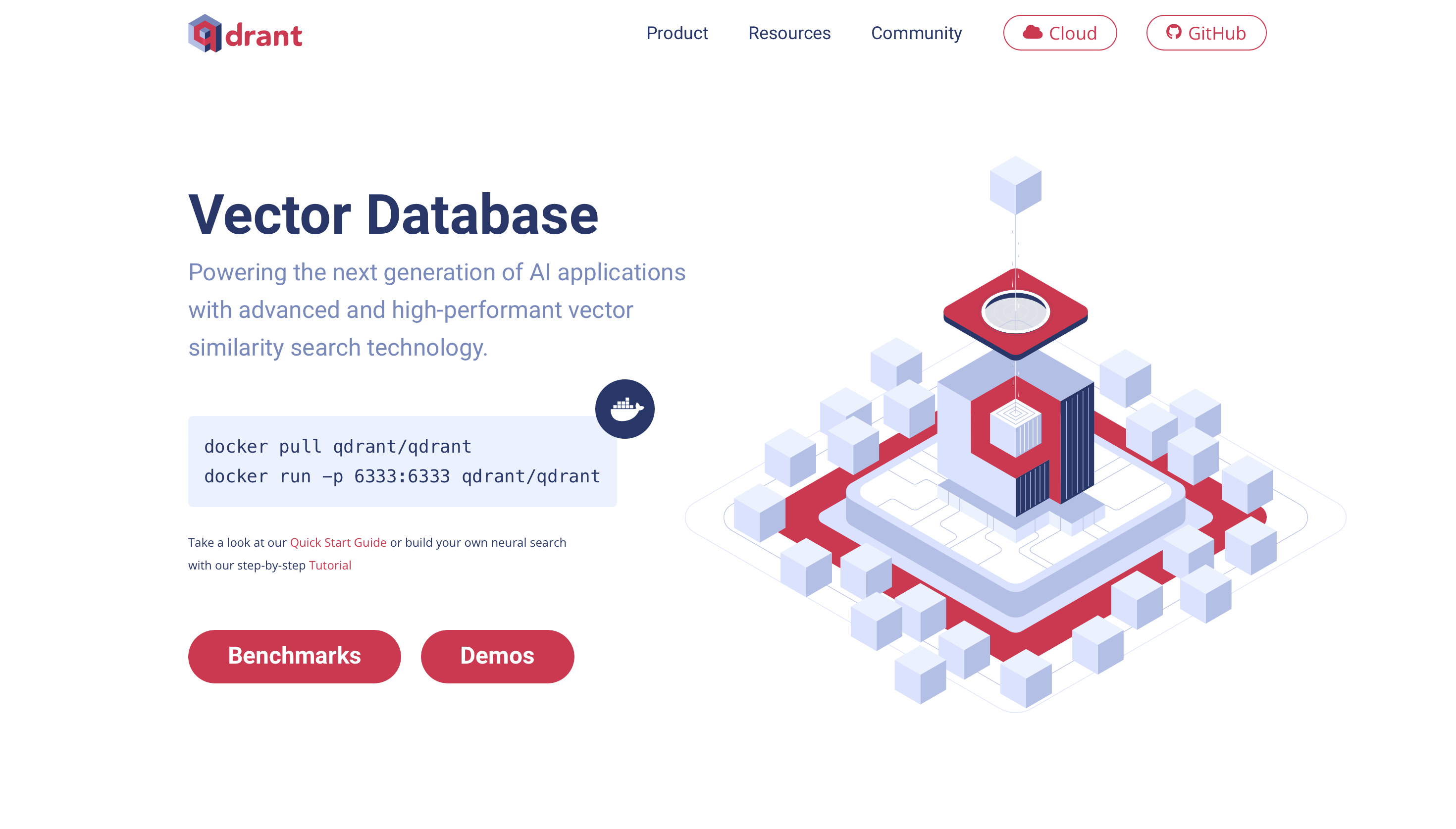

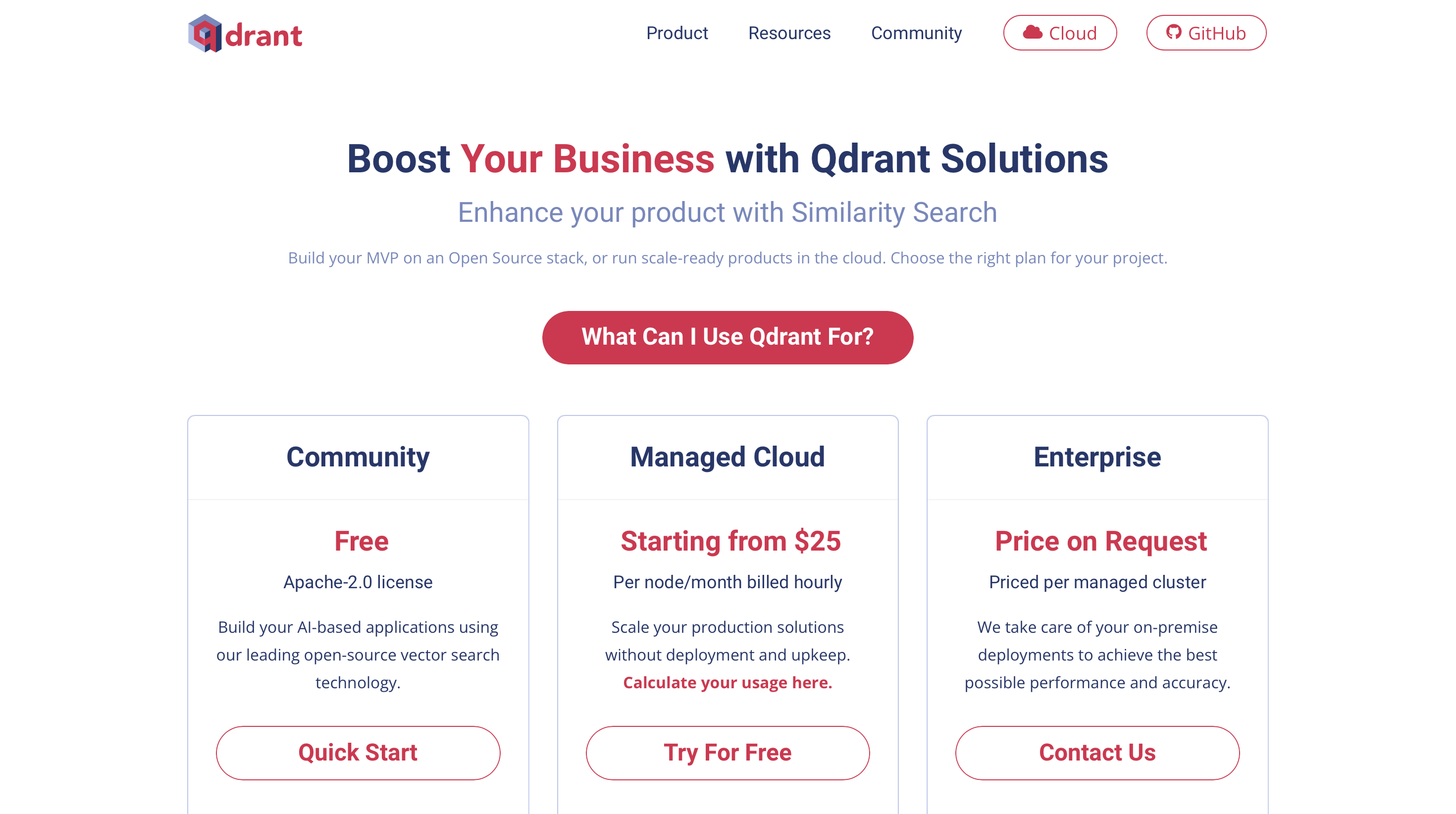

7. Quadrant

Qdrant là nền tảng cơ sở dữ liệu vector linh hoạt, cung cấp một bộ khả năng độc đáo để đáp ứng nhu cầu ngày càng tăng của các ứng dụng AI và máy học.

Về nền tảng, Qdrant là một công cụ tìm kiếm tương tự vectơ cung cấp API dễ sử dụng để lưu trữ, tìm kiếm và duy trì vectơ cũng như dữ liệu tải trọng.

Tính năng này rất quan trọng đối với một số ứng dụng, chẳng hạn như hệ thống đề xuất và tìm kiếm ngữ nghĩa, yêu cầu diễn giải các định dạng dữ liệu phức tạp.

Nền tảng này được xây dựng có tính đến tính hiệu quả và khả năng mở rộng, có khả năng xử lý các tập dữ liệu khổng lồ với hàng tỷ điểm dữ liệu.

Nó cung cấp một số số liệu khoảng cách bao gồm Độ tương tự Cosine, Khoảng cách Euclide và Sản phẩm chấm, giúp nó có thể thích ứng trong nhiều tình huống sử dụng.

Thiết kế này cung cấp tính năng lọc phức tạp, chẳng hạn như chuỗi, phạm vi và bộ lọc địa lý, để đáp ứng nhu cầu tìm kiếm đa dạng.

Qdrant có thể truy cập được đối với các nhà phát triển theo nhiều cách khác nhau, bao gồm hình ảnh Docker để thiết lập cục bộ nhanh chóng, ứng dụng khách Python cho những người thành thạo ngôn ngữ và dịch vụ đám mây cho môi trường cấp sản xuất, mạnh mẽ hơn.

Khả năng thích ứng của Qdrant cho phép tích hợp liền mạch với mọi nhu cầu về cấu hình hoặc quy trình công nghệ.

Hơn nữa, giao diện thân thiện với người dùng của Qdrant giúp đơn giản hóa việc quản lý cơ sở dữ liệu vector. Nền tảng này nhằm mục đích đơn giản cho người dùng ở mọi cấp độ kỹ năng, từ tạo cụm đến tạo khóa API để truy cập an toàn.

Khả năng tải lên hàng loạt và API không đồng bộ của nó cải thiện hiệu quả của nó, khiến nó trở thành một công cụ rất hữu ích cho các nhà phát triển xử lý lượng dữ liệu khổng lồ.

GIÁ CẢ

Bạn có thể bắt đầu sử dụng nó miễn phí và giá cao cấp bắt đầu từ $25 mỗi nút/tháng thanh toán theo giờ

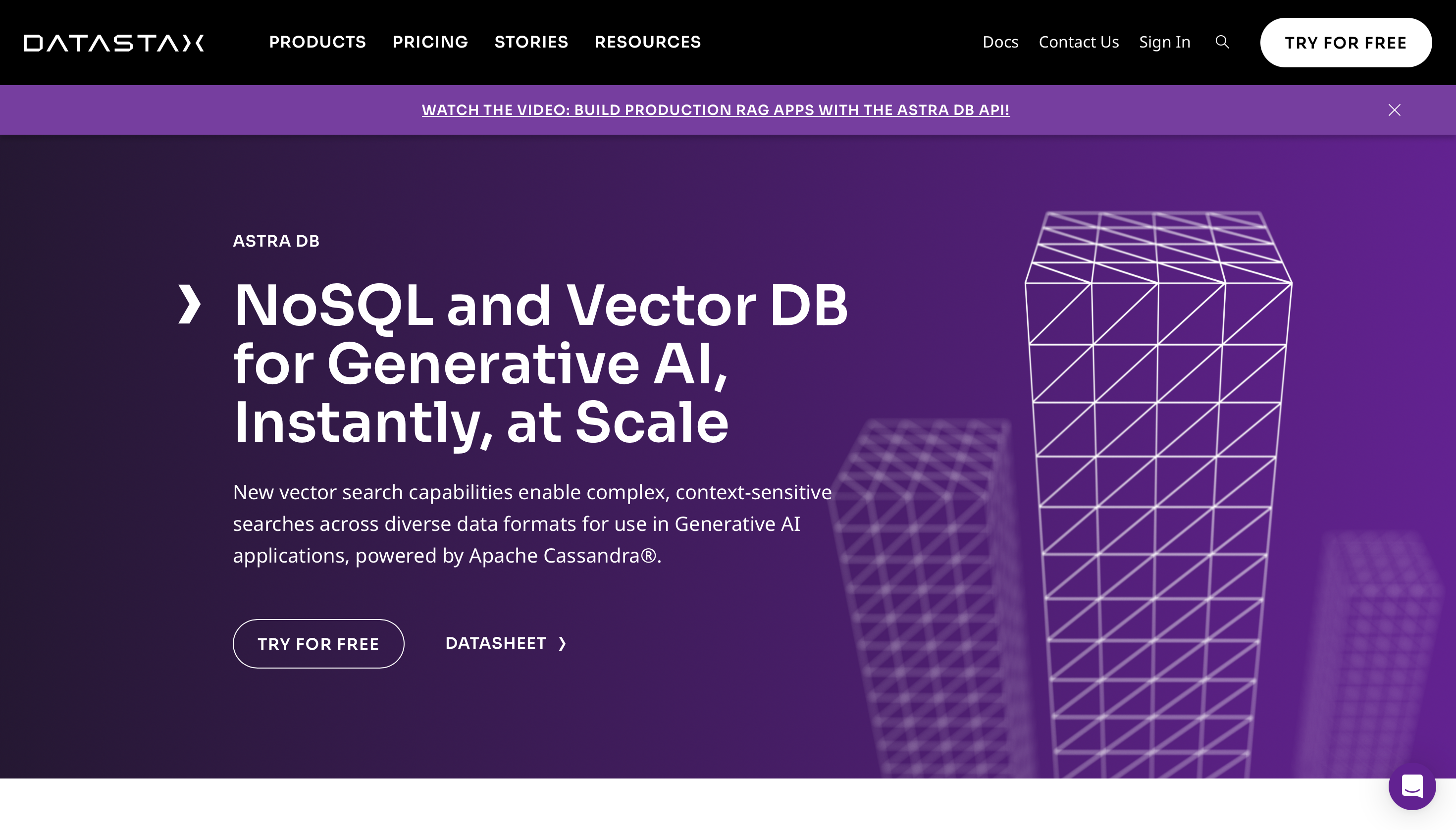

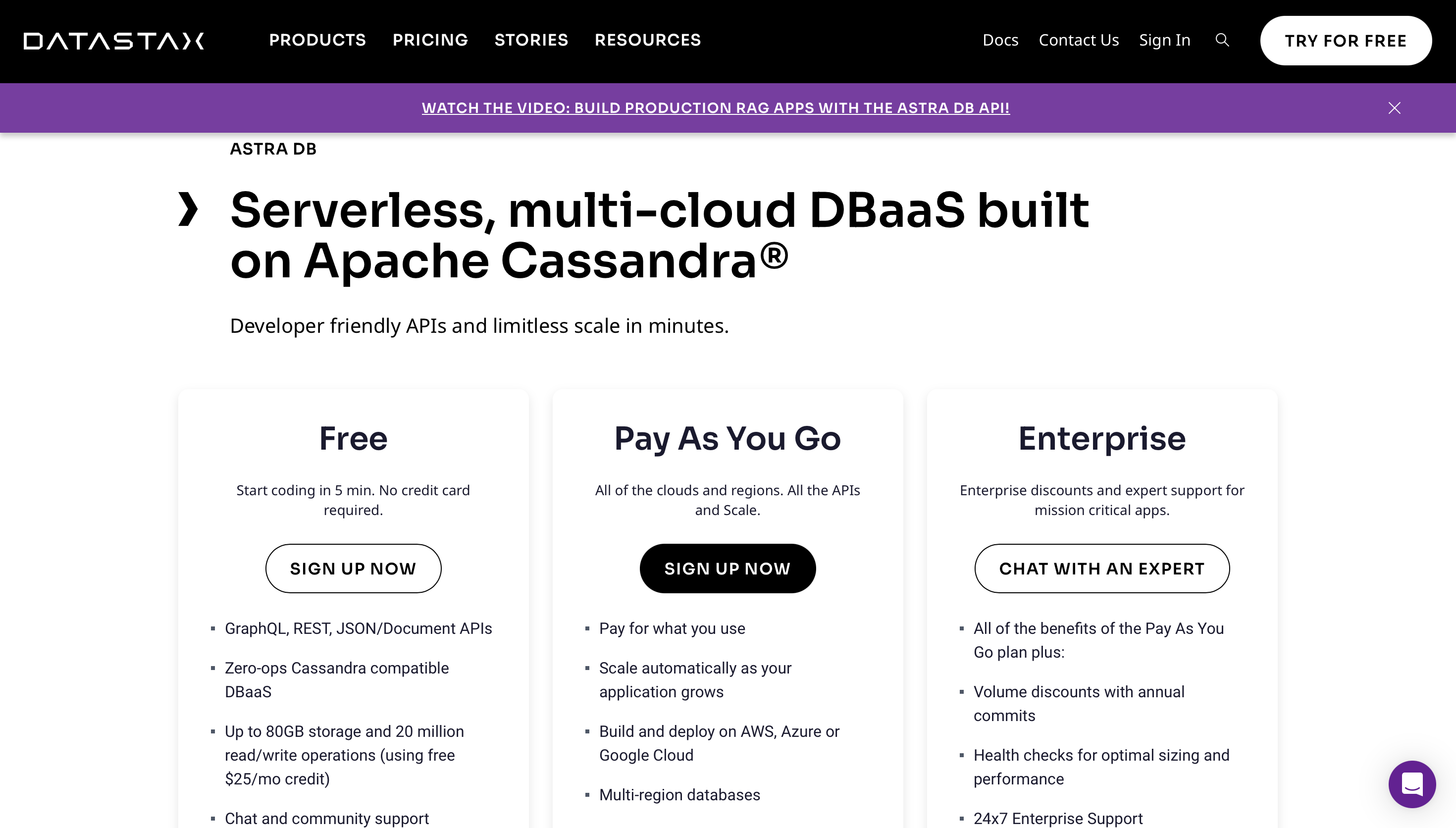

8. Astra DB

Khả năng tìm kiếm vectơ ưu việt và kiến trúc phi máy chủ của AstraDB đang biến đổi các ứng dụng AI tổng hợp.

AstraDB là một lựa chọn tuyệt vời để quản lý các tìm kiếm phức tạp, nhạy cảm với ngữ cảnh trên nhiều loại dữ liệu vì nó được xây dựng trên nền tảng vững chắc của Apache Cassandra và kết hợp liền mạch khả năng mở rộng, tính ổn định và hiệu suất.

Khả năng của AstraDB trong việc xử lý khối lượng công việc không đồng nhất, bao gồm dữ liệu truyền trực tuyến, dữ liệu không phải vectơ và dữ liệu vectơ, trong khi vẫn duy trì độ trễ cực thấp cho các hoạt động truy vấn và cập nhật đồng thời, là một trong những ưu điểm đáng chú ý nhất của nó.

Khả năng thích ứng này rất cần thiết cho các ứng dụng AI tổng quát, đòi hỏi phải xử lý dữ liệu trực tuyến và thời gian thực để cung cấp các phản hồi AI chính xác, nhận biết ngữ cảnh.

Giải pháp serverless từ AstraDB giúp việc phát triển trở nên dễ dàng hơn, giúp các nhà phát triển tập trung vào việc tạo các ứng dụng AI cải tiến thay vì quản lý cơ sở hạ tầng phụ trợ.

Từ hướng dẫn bắt đầu nhanh đến các bài học chuyên sâu về cách tạo chatbot và hệ thống đề xuất, AstraDB cho phép các nhà phát triển nhanh chóng hiện thực hóa ý tưởng AI của họ thông qua các API đáng tin cậy và giao diện mượt mà với các công cụ và nền tảng nổi tiếng.

Các hệ thống AI tổng hợp cấp doanh nghiệp phải ưu tiên bảo mật và tuân thủ, đồng thời AstraDB đáp ứng được cả hai mặt trận.

Các tính năng bảo mật chuyên sâu của công ty và chứng nhận tuân thủ được cung cấp bởi AstraDB, đảm bảo rằng các ứng dụng AI được phát triển trên AstraDB tuân thủ các nguyên tắc bảo vệ dữ liệu và quyền riêng tư nghiêm ngặt nhất.

GIÁ CẢ

Bạn có thể bắt đầu sử dụng nó miễn phí và nó cung cấp mô hình trả tiền khi bạn sử dụng.

9. Tìm kiếm mở

OpenSearch xuất hiện như một lựa chọn hấp dẫn cho những người khám phá cơ sở dữ liệu vectơ, đặc biệt để phát triển các hệ thống AI có khả năng thích ứng, có thể mở rộng và phù hợp với tương lai.

OpenSearch là cơ sở dữ liệu vectơ nguồn mở, trọn gói, kết hợp sức mạnh của phân tích, tìm kiếm vectơ phức tạp và tìm kiếm thông thường vào một hệ thống gắn kết.

Bằng cách sử dụng các mô hình nhúng học máy để mã hóa ý nghĩa và ngữ cảnh của nhiều dạng dữ liệu—tài liệu, ảnh và âm thanh—thành vectơ cho các tìm kiếm tương tự, việc tích hợp này đặc biệt hữu ích cho các nhà phát triển muốn đưa hiểu biết ngữ nghĩa vào ứng dụng tìm kiếm của họ.

Mặc dù OpenSearch có rất nhiều thứ để cung cấp nhưng điều quan trọng cần nhớ là so với Elaticsearch, có ít thay đổi mã hơn rất nhiều, đặc biệt là trong các mô-đun quan trọng như ngôn ngữ tập lệnh và bộ xử lý quy trình nhập.

Elaticsearch có thể có các khả năng phức tạp hơn do nỗ lực phát triển ngày càng tăng, dẫn đến sự khác biệt về hiệu suất, bộ tính năng và cập nhật giữa hai loại.

OpenSearch bù đắp bằng một cộng đồng lớn theo dõi và sự cống hiến cho các ý tưởng nguồn mở, tạo ra một nền tảng mở và có khả năng thích ứng.

Nó hỗ trợ nhiều ứng dụng ngoài tìm kiếm và phân tích, chẳng hạn như khả năng quan sát và phân tích bảo mật, khiến nó trở thành một công cụ linh hoạt cho các nhiệm vụ sử dụng nhiều dữ liệu.

Chiến lược hướng đến cộng đồng đảm bảo cải tiến và tích hợp liên tục để giữ cho nền tảng luôn cập nhật và độc đáo.

GIÁ CẢ

Bạn có thể bắt đầu sử dụng nó miễn phí.

10. Tìm kiếm trí tuệ nhân tạo Azure

Azure AI Search là một nền tảng mạnh mẽ giúp cải thiện khả năng tìm kiếm trong các ứng dụng AI tổng quát.

Nó nổi bật vì nó hỗ trợ tìm kiếm vectơ, một cơ chế lập chỉ mục, lưu trữ và truy xuất các phần nhúng vectơ bên trong chỉ mục tìm kiếm.

Tính năng này giúp khám phá các tài liệu có thể so sánh được trong không gian vectơ, mang lại kết quả tìm kiếm phù hợp hơn theo ngữ cảnh.

Azure AI Search nổi bật nhờ khả năng hỗ trợ cho các tình huống kết hợp, trong đó tìm kiếm vectơ và từ khóa được thực hiện đồng thời, dẫn đến một tập hợp kết quả thống nhất thường vượt trội hơn hiệu quả của từng kỹ thuật được sử dụng riêng lẻ.

Sự kết hợp giữa vật liệu vectơ và không phải vectơ trong cùng một chỉ mục cho phép trải nghiệm tìm kiếm đầy đủ và linh hoạt hơn.

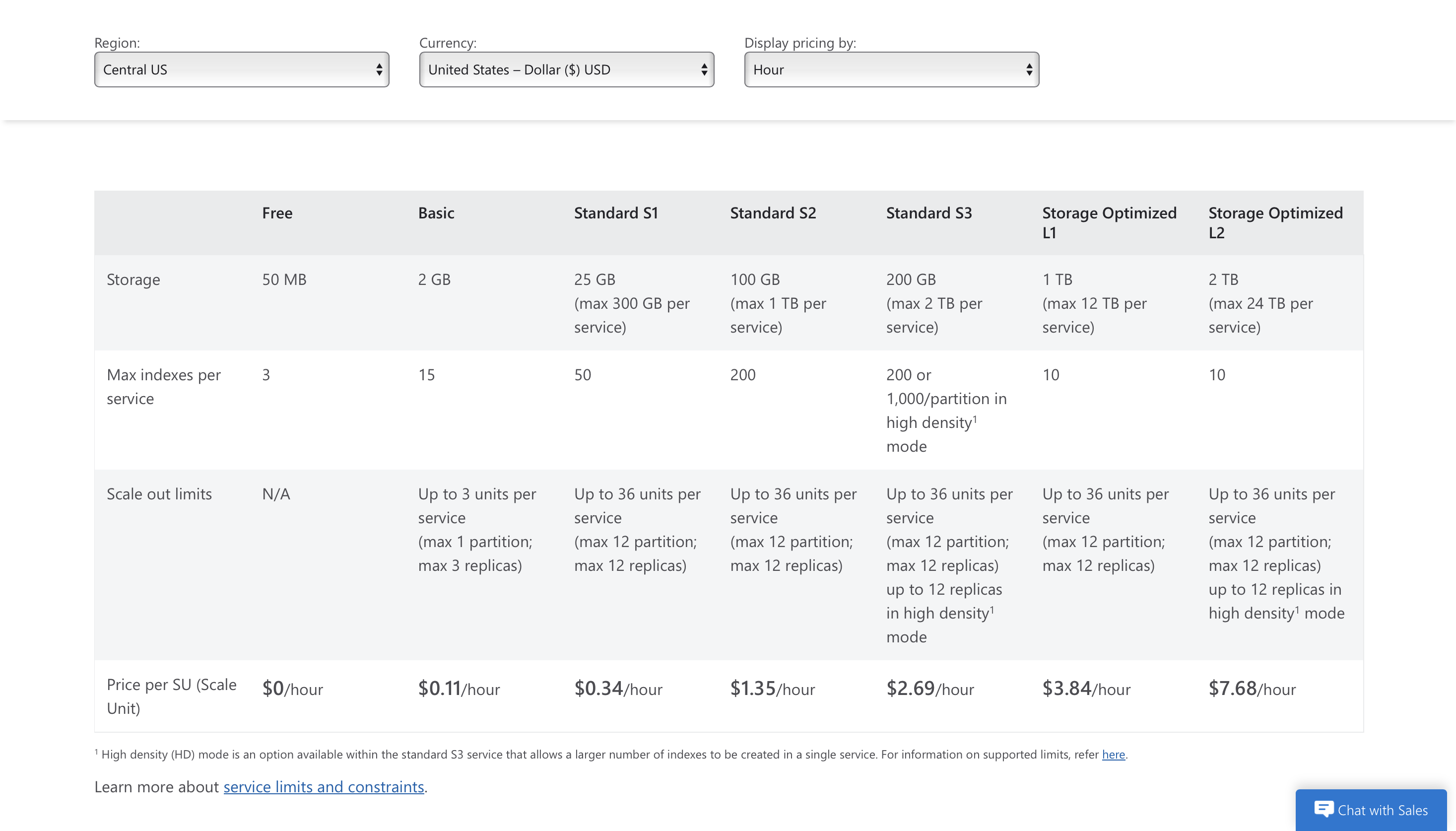

Tính năng tìm kiếm vectơ trong Azure AI Search có thể truy cập rộng rãi và miễn phí cho tất cả các bậc Tìm kiếm Azure AI.

Nó cực kỳ linh hoạt cho nhiều trường hợp sử dụng và tùy chọn phát triển vì nó hỗ trợ một số môi trường phát triển, được cung cấp thông qua trang Azure, API RESTvà SDK cho Python, JavaScript và .NET, cùng với các SDK khác.

Với sự tích hợp sâu với hệ sinh thái Azure AI, Azure AI Search không chỉ cung cấp tìm kiếm đơn thuần; nó cũng nâng cao tiềm năng của hệ sinh thái cho các ứng dụng AI tổng hợp.

Azure OpenAI Studio để nhúng mô hình và Dịch vụ Azure AI để truy xuất hình ảnh chỉ là hai ví dụ về các dịch vụ được đưa vào tích hợp này.

Azure AI Search là một giải pháp linh hoạt dành cho các nhà phát triển muốn kết hợp các chức năng tìm kiếm phức tạp trong ứng dụng của họ nhờ khả năng hỗ trợ mở rộng, cho phép sử dụng nhiều ứng dụng, từ tìm kiếm tương tự và tìm kiếm đa phương thức đến tìm kiếm kết hợp và tìm kiếm đa ngôn ngữ.

GIÁ CẢ

Bạn có thể bắt đầu sử dụng nó miễn phí và giá cao cấp bắt đầu từ 0.11 USD/giờ.

Kết luận

Cơ sở dữ liệu vectơ đang chuyển đổi cách quản lý dữ liệu trong AI bằng cách quản lý các vectơ chiều cao, cho phép tìm kiếm độ tương đồng mạnh mẽ và truy vấn lân cận gần nhất nhanh chóng trong các ứng dụng như hệ thống đề xuất và phát hiện gian lận.

Với việc sử dụng các thuật toán lập chỉ mục phức tạp, các cơ sở dữ liệu này chuyển đổi dữ liệu phi cấu trúc phức tạp thành các vectơ có ý nghĩa đồng thời cung cấp tốc độ và tính linh hoạt mà cơ sở dữ liệu truyền thống không có được.

Các nền tảng đáng chú ý bao gồm Pinecone, nền tảng tỏa sáng trong các ứng dụng AI tổng hợp; FAISS, do Facebook AI tạo ra để phân cụm vectơ dày đặc; và Milvus, nổi tiếng về khả năng mở rộng và kiến trúc dựa trên nền tảng đám mây.

Weaviate kết hợp học máy với tìm kiếm theo ngữ cảnh, trong khi Vespa và Chroma lần lượt nổi bật nhờ khả năng tính toán có độ trễ thấp và tính dễ sử dụng.

Cơ sở dữ liệu vectơ là công cụ quan trọng để phát triển công nghệ AI và máy học vì các nền tảng như Qdrant, AstraDB, OpenSearch và Azure AI Search cung cấp nhiều dịch vụ khác nhau từ kiến trúc không có máy chủ đến khả năng phân tích và tìm kiếm mở rộng.

Bình luận