Mục lục[Ẩn giấu][Chỉ]

Tương lai là đây. Và, trong tương lai này, máy móc hiểu thế giới xung quanh giống như cách con người làm. Máy tính có thể lái ô tô, chẩn đoán bệnh tật và dự báo tương lai một cách chính xác.

Điều này có vẻ giống như khoa học viễn tưởng, nhưng các mô hình học sâu đang biến nó thành hiện thực.

Những thuật toán phức tạp này đang tiết lộ những bí mật của trí tuệ nhân tạo, cho phép máy tính tự học và phát triển. Trong bài đăng này, chúng ta sẽ đi sâu vào lĩnh vực mô hình học sâu.

Và, chúng tôi sẽ điều tra tiềm năng to lớn mà họ có để cách mạng hóa cuộc sống của chúng tôi. Chuẩn bị để tìm hiểu về công nghệ tiên tiến đang thay đổi tương lai của nhân loại.

Chính xác thì các mô hình Deep Learning là gì?

Bạn đã bao giờ chơi một trò chơi trong đó bạn phải xác định sự khác biệt giữa hai hình ảnh chưa?

Đó là niềm vui tuy nhiên nó cũng có thể khó khăn, phải không? Hãy tưởng tượng bạn có thể dạy máy tính chơi trò chơi đó và luôn giành chiến thắng. Các mô hình học sâu hoàn thành được điều đó!

Các mô hình học sâu tương tự như những cỗ máy siêu thông minh có thể kiểm tra một số lượng lớn hình ảnh và xác định điểm chung của chúng. Họ thực hiện điều này bằng cách tháo rời các hình ảnh và nghiên cứu từng hình ảnh riêng lẻ.

Sau đó, họ áp dụng những gì đã học để xác định các mẫu và đưa ra dự đoán về những hình ảnh mới mà họ chưa từng thấy trước đây.

Các mô hình học sâu là các mạng thần kinh nhân tạo có thể học và trích xuất các mẫu và đặc điểm phức tạp từ các bộ dữ liệu lớn. Các mô hình này được tạo thành từ một số lớp nút hoặc nơ-ron được liên kết, giúp phân tích và thay đổi dữ liệu đến để tạo ra đầu ra.

Các mô hình học sâu đặc biệt phù hợp với các công việc đòi hỏi độ chính xác cao, chẳng hạn như nhận dạng hình ảnh, nhận dạng giọng nói, xử lý ngôn ngữ tự nhiên và người máy.

Chúng đã được sử dụng trong mọi thứ, từ ô tô tự lái đến chẩn đoán y tế, hệ thống đề xuất và phân tích tiên đoán.

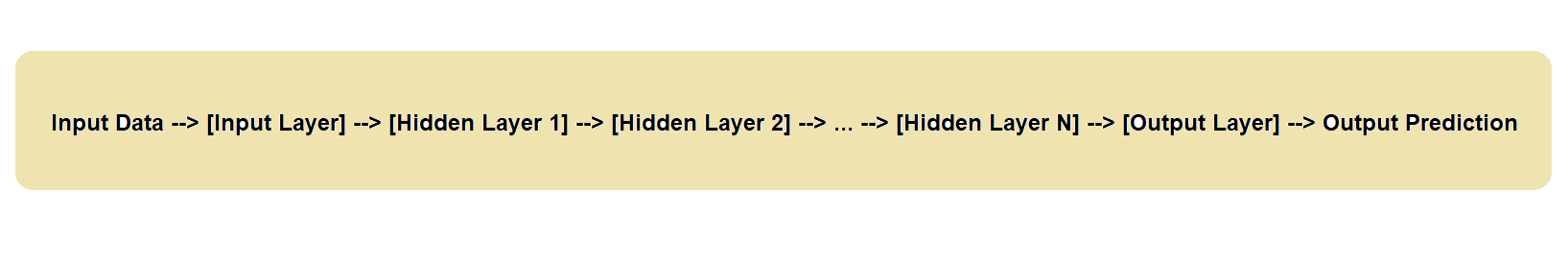

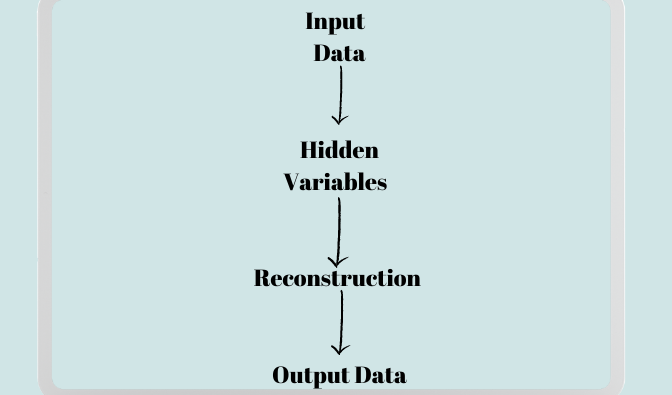

Đây là phiên bản trực quan hóa đơn giản hóa để minh họa luồng dữ liệu trong mô hình học sâu.

Dữ liệu đầu vào chảy vào lớp đầu vào của mô hình, lớp này sau đó chuyển dữ liệu qua một số lớp ẩn trước khi đưa ra dự đoán đầu ra.

Mỗi lớp ẩn thực hiện một loạt các phép toán trên dữ liệu đầu vào trước khi chuyển nó sang lớp tiếp theo, lớp này cung cấp dự đoán cuối cùng.

Bây giờ, hãy xem các mô hình học sâu là gì và chúng ta có thể sử dụng chúng như thế nào trong cuộc sống.

1. Mạng thần kinh tích chập (CNN)

CNN là một mô hình học sâu đã thay đổi lĩnh vực thị giác máy tính. CNN được sử dụng để phân loại hình ảnh, nhận dạng đối tượng và phân đoạn hình ảnh. Cấu trúc và chức năng của vỏ não thị giác của con người đã thông báo cho thiết kế của CNN.

Làm thế nào để họ làm việc?

Một CNN được tạo thành từ một số lớp tích chập, lớp tổng hợp và lớp được liên kết đầy đủ. Đầu vào là một hình ảnh và đầu ra là một dự đoán về nhãn lớp của hình ảnh.

Các lớp tích chập của CNN xây dựng một bản đồ đặc trưng bằng cách thực hiện tích vô hướng giữa ảnh đầu vào và một tập hợp các bộ lọc. Các lớp tổng hợp làm giảm kích thước của bản đồ tính năng bằng cách lấy mẫu xuống.

Cuối cùng, bản đồ đặc trưng được sử dụng bởi các lớp được kết nối đầy đủ để dự đoán nhãn lớp của hình ảnh.

Tại sao CNN lại quan trọng?

CNN rất cần thiết vì chúng có thể học cách phát hiện các mẫu và đặc điểm trong hình ảnh mà mọi người khó nhận thấy. CNN có thể được dạy để nhận biết các đặc điểm như cạnh, góc và kết cấu bằng bộ dữ liệu lớn. Sau khi tìm hiểu các thuộc tính này, CNN có thể sử dụng chúng để xác định các đối tượng trong ảnh mới. CNN đã chứng minh hiệu suất tiên tiến trên nhiều ứng dụng nhận dạng hình ảnh.

Chúng tôi sử dụng CNN ở đâu

Chăm sóc sức khỏe, ngành công nghiệp ô tô và bán lẻ chỉ là một vài lĩnh vực sử dụng CNN. Trong ngành chăm sóc sức khỏe, chúng có thể hữu ích cho việc chẩn đoán bệnh, phát triển thuốc và phân tích hình ảnh y tế.

Trong lĩnh vực ô tô, chúng giúp phát hiện làn đường, phát hiện đối tượngvà lái xe tự động. Chúng cũng được sử dụng rất nhiều trong bán lẻ để tìm kiếm trực quan, đề xuất sản phẩm dựa trên hình ảnh và kiểm soát hàng tồn kho.

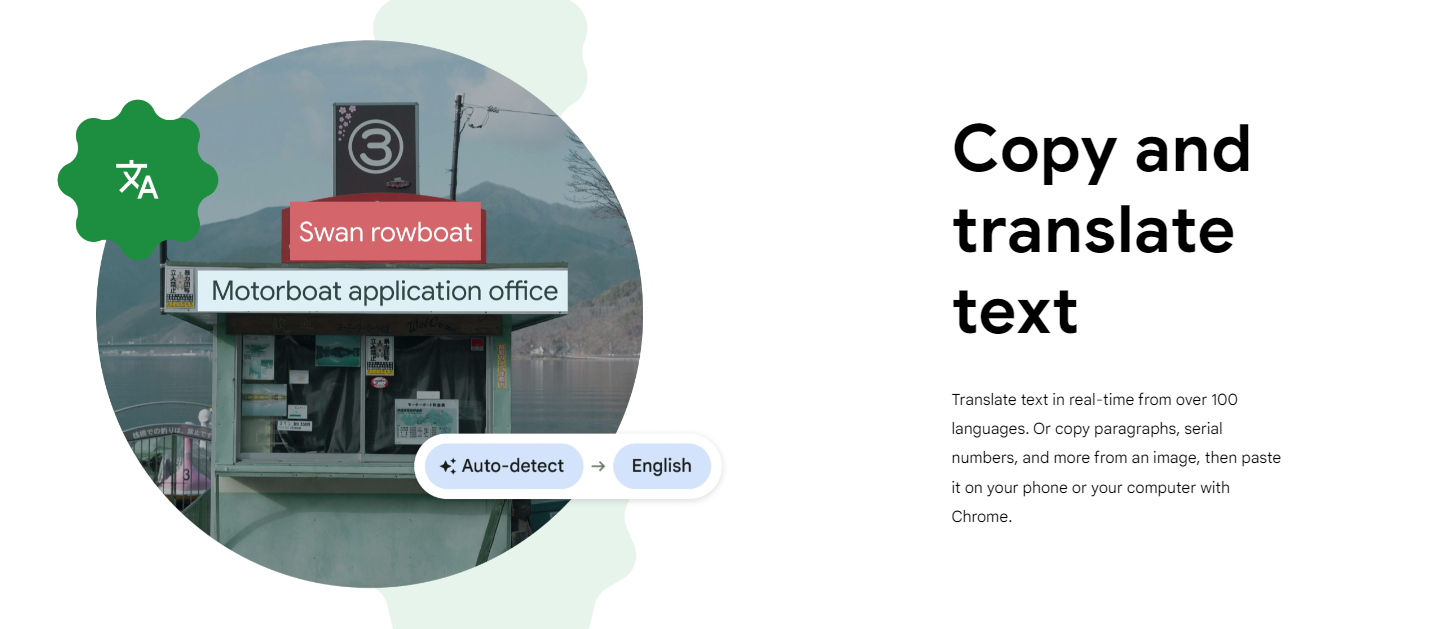

Ví dụ; Google sử dụng CNN trong nhiều ứng dụng, bao gồm Google Lens, một công cụ nhận dạng hình ảnh được ưa chuộng. Chương trình sử dụng CNN để đánh giá các bức ảnh và cung cấp thông tin cho người dùng.

Chẳng hạn, Google Lens có thể nhận dạng mọi thứ trong một hình ảnh và cung cấp thông tin chi tiết về chúng, chẳng hạn như loại hoa.

Nó cũng có thể dịch văn bản được trích xuất từ một hình ảnh sang nhiều ngôn ngữ. Google Lens có thể cung cấp cho người tiêu dùng thông tin hữu ích nhờ sự hỗ trợ của CNN trong việc xác định chính xác các mục và trích xuất các đặc điểm từ ảnh.

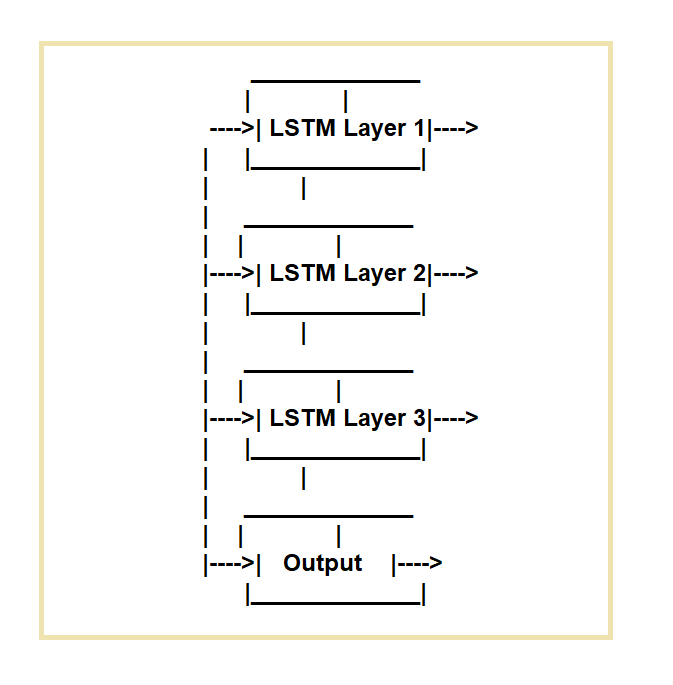

2. Mạng bộ nhớ ngắn hạn dài (LSTM)

Mạng bộ nhớ ngắn hạn dài (LSTM) được tạo ra để giải quyết những thiếu sót của mạng thần kinh tái phát thông thường (RNN). Mạng LSTM lý tưởng cho các tác vụ yêu cầu xử lý chuỗi dữ liệu theo thời gian.

Chúng hoạt động bằng cách sử dụng một ô nhớ cụ thể và ba cơ chế ghép nối.

Chúng điều chỉnh luồng thông tin vào và ra khỏi tế bào. Cổng đầu vào, cổng quên và cổng đầu ra là ba cổng.

Cổng đầu vào điều chỉnh luồng dữ liệu vào ô nhớ, cổng quên điều chỉnh việc xóa dữ liệu khỏi ô và cổng đầu ra điều chỉnh luồng dữ liệu ra khỏi ô.

Ý nghĩa của chúng là gì?

Các mạng LSTM rất hữu ích vì chúng có thể biểu diễn và dự báo thành công các chuỗi dữ liệu có mối quan hệ lâu dài. Họ có thể ghi lại và lưu giữ thông tin về các đầu vào trước đó, cho phép họ đưa ra dự đoán chính xác hơn về các đầu vào trong tương lai.

Nhận dạng giọng nói, nhận dạng chữ viết tay, xử lý ngôn ngữ tự nhiên và chú thích ảnh chỉ là một số ứng dụng đã sử dụng mạng LSTM.

Chúng tôi sử dụng mạng LSTM ở đâu?

Nhiều ứng dụng phần mềm và công nghệ sử dụng mạng LSTM, bao gồm hệ thống nhận dạng giọng nói, công cụ xử lý ngôn ngữ tự nhiên như Phân tích tâm lý, hệ thống dịch máy và hệ thống tạo văn bản và hình ảnh.

Chúng cũng đã được sử dụng trong việc tạo ra ô tô và rô-bốt tự lái, cũng như trong ngành tài chính để phát hiện gian lận và dự đoán thị trường chứng khoán sự di chuyển.

3. Mạng đối thủ sáng tạo (GAN)

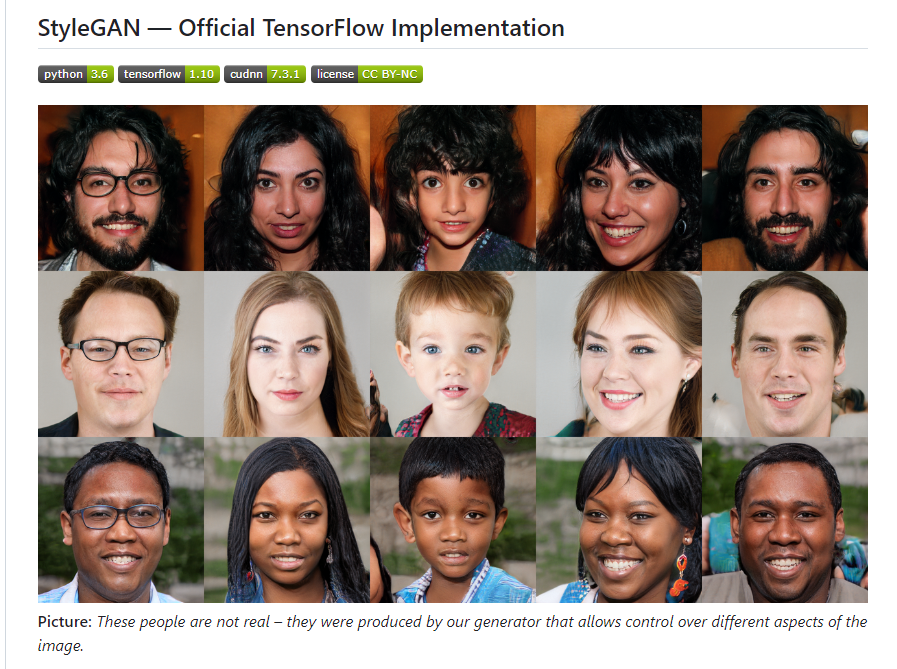

GAN là một học kĩ càng kỹ thuật được sử dụng để tạo các mẫu dữ liệu mới tương tự với một tập dữ liệu nhất định. GAN được tạo thành từ hai mạng thần kinh: một loại học cách tạo ra các mẫu mới và một loại học cách phân biệt giữa các mẫu chính hãng và các mẫu được tạo ra.

Theo cách tiếp cận tương tự, hai mạng này được đào tạo cùng nhau cho đến khi trình tạo có thể tạo ra các mẫu không thể phân biệt được với các mẫu thực tế.

Tại sao chúng ta sử dụng GAN

GAN rất quan trọng vì khả năng sản xuất chất lượng cao dữ liệu tổng hợp có thể được sử dụng cho nhiều ứng dụng khác nhau, bao gồm sản xuất hình ảnh và video, tạo văn bản và thậm chí tạo nhạc.

GAN cũng đã được sử dụng để tăng cường dữ liệu, đó là thế hệ của dữ liệu tổng hợp để bổ sung dữ liệu trong thế giới thực và cải thiện hiệu suất của các mô hình học máy.

Hơn nữa, bằng cách tạo dữ liệu tổng hợp có thể được sử dụng để đào tạo các mô hình và bắt chước các thử nghiệm, GAN có tiềm năng chuyển đổi các lĩnh vực như y học và phát triển thuốc.

Các ứng dụng của GAN

GAN có thể bổ sung cho bộ dữ liệu, tạo ảnh hoặc phim mới và thậm chí tạo dữ liệu tổng hợp cho các mô phỏng khoa học. Hơn nữa, GAN có tiềm năng được sử dụng trong nhiều ứng dụng khác nhau, từ giải trí đến y tế.

lứa tuổi và video. Ví dụ, StyleGAN2 của NVIDIA đã được sử dụng để tạo ra những bức ảnh chất lượng cao về những người nổi tiếng và tác phẩm nghệ thuật.

4. Mạng niềm tin sâu sắc (DBN)

Mạng niềm tin sâu sắc (DBN) là trí tuệ nhân tạo các hệ thống có thể học cách phát hiện các mẫu trong dữ liệu. Họ thực hiện điều này bằng cách phân đoạn dữ liệu thành các phần nhỏ hơn và nhỏ hơn, hiểu rõ hơn về dữ liệu đó ở mỗi cấp độ.

DBN có thể học từ dữ liệu mà không được thông báo nó là gì (điều này được gọi là "học không giám sát"). Điều này làm cho chúng cực kỳ có giá trị để phát hiện các mẫu trong dữ liệu mà một người sẽ khó hoặc không thể phân biệt được.

Điều gì làm cho DBN trở nên quan trọng?

DBN rất quan trọng vì khả năng học các biểu diễn dữ liệu phân cấp của chúng. Các biểu diễn này có thể được sử dụng cho nhiều ứng dụng như phân loại, phát hiện bất thường và giảm kích thước.

Khả năng của DBN để thực hiện đào tạo trước không giám sát, có thể tăng hiệu suất của các mô hình học sâu với dữ liệu được dán nhãn tối thiểu, là một lợi ích đáng kể.

Các ứng dụng của DBN là gì?

Một trong những ứng dụng quan trọng nhất là phát hiện đối tượng, trong đó DBN được sử dụng để nhận dạng một số loại vật như máy bay, chim và con người. Chúng cũng được sử dụng để tạo và phân loại hình ảnh, phát hiện chuyển động trong phim và hiểu ngôn ngữ tự nhiên để xử lý giọng nói.

Hơn nữa, DBN thường được sử dụng trong các bộ dữ liệu để đánh giá tư thế của con người. DBN là một công cụ tuyệt vời cho nhiều ngành công nghiệp, bao gồm chăm sóc sức khỏe, ngân hàng và công nghệ.

5. Mạng học tăng cường sâu (DRL)

Sâu Học tăng cường Mạng (DRL) tích hợp mạng thần kinh sâu với các kỹ thuật học tăng cường để cho phép các tác nhân học trong một môi trường phức tạp thông qua thử và sai.

DRL được sử dụng để hướng dẫn nhân viên cách tối ưu hóa tín hiệu phần thưởng bằng cách tương tác với môi trường xung quanh và học hỏi từ những sai lầm của họ.

Điều gì làm cho họ đáng chú ý?

Chúng đã được sử dụng hiệu quả trong nhiều ứng dụng, bao gồm chơi game, chế tạo người máy và lái xe tự động. DRL rất quan trọng vì chúng có thể học trực tiếp từ đầu vào cảm giác thô, cho phép các tác nhân đưa ra quyết định dựa trên tương tác của chúng với môi trường.

Ứng dụng quan trọng

DRL được sử dụng trong các tình huống thực tế vì chúng có thể xử lý các vấn đề khó khăn.

DRL đã được đưa vào một số nền tảng phần mềm và công nghệ nổi bật, bao gồm OpenAI's Gym, Đại lý ML của Unityvà Phòng thí nghiệm DeepMind của Google. AlphaGo, được xây dựng bởi Google Deepmind, ví dụ: sử dụng DRL để chơi trò chơi cờ vây ở cấp độ nhà vô địch thế giới.

Một ứng dụng khác của DRL là trong chế tạo rô-bốt, nơi nó được sử dụng để điều khiển chuyển động của cánh tay rô-bốt để thực hiện các tác vụ như kẹp chặt đồ vật hoặc xếp chồng các khối. DRL có nhiều công dụng và là một công cụ hữu ích cho đào tạo đại lý để học hỏi và đưa ra quyết định trong bối cảnh phức tạp.

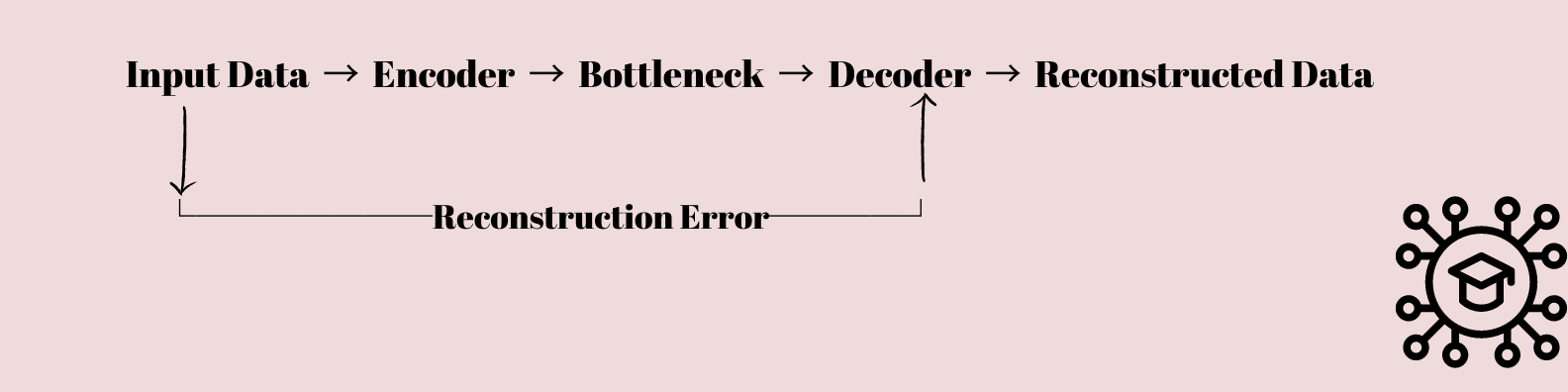

6. Bộ mã hóa tự động

Autoencoders là một loại thú vị của mạng lưới thần kinh đã thu hút sự quan tâm của cả các học giả và nhà khoa học dữ liệu. Về cơ bản, chúng được thiết kế để học cách nén và khôi phục dữ liệu.

Dữ liệu đầu vào được cung cấp thông qua một loạt các lớp làm giảm dần kích thước của dữ liệu cho đến khi nó được nén thành một lớp cổ chai có ít nút hơn so với các lớp đầu vào và đầu ra.

Biểu diễn nén này sau đó được sử dụng để tạo lại dữ liệu đầu vào ban đầu bằng cách sử dụng một chuỗi các lớp nâng dần kích thước của dữ liệu trở lại hình dạng ban đầu.

Tại sao nó lại quan trọng?

Autoencoders là một thành phần quan trọng của học kĩ càng bởi vì chúng có thể trích xuất tính năng và giảm dữ liệu.

Họ có thể xác định các yếu tố chính của dữ liệu đến và dịch chúng thành dạng nén mà sau đó có thể được áp dụng cho các tác vụ khác như phân loại, nhóm hoặc tạo dữ liệu mới.

Chúng tôi sử dụng bộ mã hóa tự động ở đâu?

Phát hiện bất thường, xử lý ngôn ngữ tự nhiên và thị giác máy tính chỉ là một vài trong số các nguyên tắc sử dụng bộ mã hóa tự động. Ví dụ, bộ mã hóa tự động có thể được sử dụng để nén hình ảnh, khử nhiễu hình ảnh và tổng hợp hình ảnh trong thị giác máy tính.

Chúng ta có thể sử dụng Bộ mã hóa tự động trong các tác vụ như tạo văn bản, phân loại văn bản và tóm tắt văn bản trong xử lý ngôn ngữ tự nhiên. Nó có thể xác định hoạt động bất thường trong dữ liệu lệch khỏi tiêu chuẩn trong nhận dạng bất thường.

7. Mạng con nhộng

Capsule Networks là một kiến trúc deep learning mới được phát triển để thay thế cho Convolutional Neural Networks (CNN).

Mạng viên nang dựa trên khái niệm nhóm các đơn vị não được gọi là viên nang chịu trách nhiệm nhận biết sự tồn tại của một mục nhất định trong hình ảnh và mã hóa các thuộc tính của nó, chẳng hạn như hướng và vị trí, thành các vectơ đầu ra của chúng. Do đó, Capsule Networks có thể quản lý các tương tác không gian và biến động phối cảnh tốt hơn CNNs.

Tại sao chúng tôi chọn Capsule Networks thay vì CNN?

Capsule Networks rất hữu ích vì chúng khắc phục được những khó khăn của CNN trong việc nắm bắt các mối quan hệ thứ bậc giữa các mục trong một bức ảnh. CNN có thể nhận ra những thứ có kích thước khác nhau nhưng lại gặp khó khăn trong việc nắm bắt cách những vật phẩm này kết nối với nhau.

Mặt khác, Capsule Networks có thể học cách nhận ra mọi thứ và các phần của chúng, cũng như cách chúng được đặt trong không gian trong một hình ảnh, khiến chúng trở thành ứng cử viên khả thi cho các ứng dụng thị giác máy tính.

Lĩnh vực ứng dụng

Capsule Networks đã chứng minh những kết quả đầy hứa hẹn trong nhiều ứng dụng, bao gồm phân loại hình ảnh, nhận dạng đối tượng và phân đoạn hình ảnh.

Chúng đã được sử dụng để phân biệt mọi thứ trong ảnh y tế, nhận dạng người trong phim và thậm chí tạo mô hình 3D từ hình ảnh 2D.

Để tăng hiệu suất của chúng, Capsule Networks đã được kết hợp với các kiến trúc deep learning khác như Generative Adversarial Networks (GAN) và Variational Autoencoders (VAE). Capsule Networks được dự đoán sẽ đóng một vai trò ngày càng quan trọng trong việc tăng cường công nghệ thị giác máy tính khi khoa học học sâu phát triển.

Ví dụ; Nibabel là một công cụ Python nổi tiếng để đọc và ghi các loại tệp hình ảnh thần kinh. Để phân đoạn hình ảnh, nó sử dụng Capsule Networks.

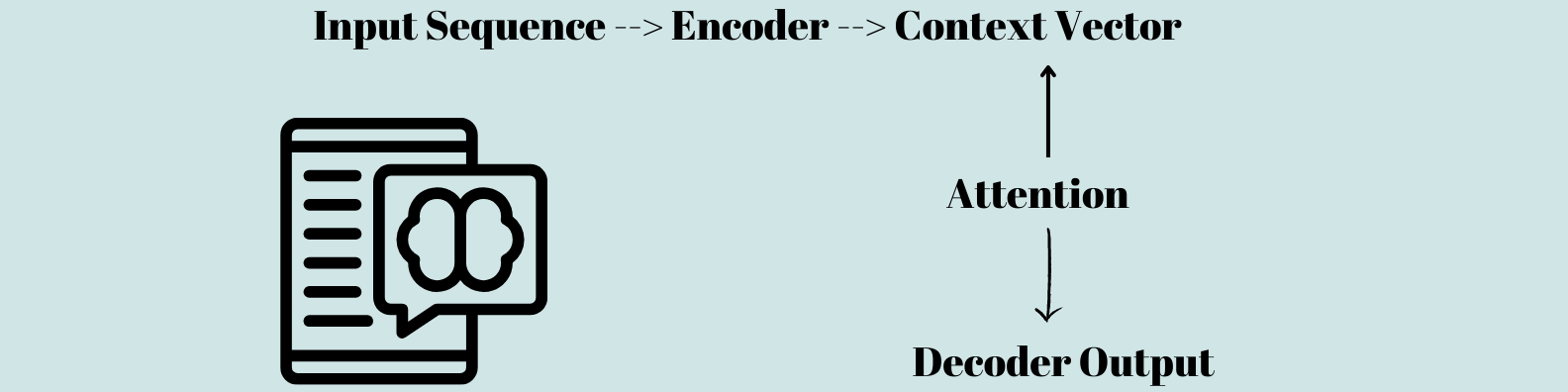

8. Mô hình dựa trên sự chú ý

Các mô hình học sâu được gọi là mô hình dựa trên sự chú ý, còn được gọi là cơ chế chú ý, cố gắng tăng độ chính xác của mô hình học máy. Các mô hình này hoạt động bằng cách tập trung vào các tính năng nhất định của dữ liệu đến, dẫn đến quá trình xử lý hiệu quả và hiệu quả hơn.

Trong các nhiệm vụ xử lý ngôn ngữ tự nhiên như dịch máy và phân tích tình cảm, các phương pháp chú ý tỏ ra khá thành công.

Ý nghĩa của họ là gì?

Các mô hình dựa trên sự chú ý rất hữu ích vì chúng cho phép xử lý dữ liệu phức tạp hiệu quả và hiệu quả hơn.

Mạng lưới thần kinh truyền thống đánh giá tất cả dữ liệu đầu vào là quan trọng như nhau, dẫn đến quá trình xử lý chậm hơn và giảm độ chính xác. Các quy trình chú ý tập trung vào các khía cạnh quan trọng của dữ liệu đầu vào, cho phép dự đoán nhanh hơn và chính xác hơn.

Lĩnh vực sử dụng

Trong lĩnh vực trí tuệ nhân tạo, các cơ chế chú ý có nhiều ứng dụng, bao gồm xử lý ngôn ngữ tự nhiên, nhận dạng hình ảnh và âm thanh, thậm chí cả phương tiện không người lái.

Ví dụ, các phương pháp chú ý có thể được sử dụng để cải thiện dịch máy trong xử lý ngôn ngữ tự nhiên bằng cách cho phép hệ thống tập trung vào một số từ hoặc cụm từ cần thiết cho ngữ cảnh.

Các phương pháp chú ý trong ô tô tự trị có thể được sử dụng để hỗ trợ hệ thống tập trung vào một số vật phẩm hoặc thách thức trong môi trường xung quanh.

9. Mạng máy biến áp

Mạng máy biến áp là các mô hình học sâu kiểm tra và tạo ra các chuỗi dữ liệu. Chúng hoạt động bằng cách xử lý chuỗi đầu vào từng phần tử một và tạo ra chuỗi đầu ra có cùng độ dài hoặc độ dài khác nhau.

Các mạng máy biến áp, không giống như các mô hình trình tự theo trình tự tiêu chuẩn, không xử lý trình tự bằng cách sử dụng mạng thần kinh hồi quy (RNN). Thay vào đó, họ sử dụng các quy trình tự chú ý để tìm hiểu các liên kết giữa các phần của chuỗi.

Tầm quan trọng của mạng máy biến áp là gì?

Mạng biến áp đã trở nên phổ biến trong những năm gần đây do hiệu suất tốt hơn của chúng trong các công việc xử lý ngôn ngữ tự nhiên.

Chúng đặc biệt phù hợp với các tác vụ tạo văn bản như dịch ngôn ngữ, tóm tắt văn bản và tạo hội thoại.

Mạng máy biến áp hiệu quả hơn đáng kể về mặt tính toán so với các mô hình dựa trên RNN, khiến chúng trở thành lựa chọn ưu tiên cho các ứng dụng quy mô lớn.

Bạn có thể tìm mạng máy biến áp ở đâu?

Mạng biến áp được sử dụng rộng rãi trong nhiều ứng dụng, đáng chú ý nhất là xử lý ngôn ngữ tự nhiên.

Sê-ri GPT (Generative Pre-training Transformer) là một mô hình dựa trên máy biến áp nổi bật đã được sử dụng cho các tác vụ như dịch ngôn ngữ, tóm tắt văn bản và tạo chatbot.

BERT (Đại diện bộ mã hóa hai chiều từ Transformers) là một mô hình dựa trên biến áp phổ biến khác đã được sử dụng cho các ứng dụng hiểu ngôn ngữ tự nhiên như trả lời câu hỏi và phân tích tình cảm.

Cả hai GPT và BERT đã được tạo ra với Kim tự tháp, một khung học sâu mã nguồn mở đã phổ biến để phát triển các mô hình dựa trên máy biến áp.

10. Máy Boltzmann bị hạn chế (RBM)

Máy Boltzmann bị hạn chế (RBM) là một loại mạng thần kinh không được giám sát, học theo cách tổng quát. Do khả năng học và trích xuất các đặc điểm thiết yếu từ dữ liệu chiều cao, chúng đã được sử dụng rộng rãi trong các lĩnh vực học máy và học sâu.

RBM được tạo thành từ hai lớp, hiển thị và ẩn, với mỗi lớp bao gồm một nhóm nơ-ron được kết nối bởi các cạnh có trọng số. RBM được thiết kế để tìm hiểu phân phối xác suất mô tả dữ liệu đầu vào.

Máy Boltzmann bị hạn chế là gì?

RBM sử dụng một chiến lược học tập tổng quát. Trong RBM, lớp hiển thị phản ánh dữ liệu đầu vào, trong khi lớp ẩn mã hóa các đặc điểm của dữ liệu đầu vào. Trọng số của các lớp hiển thị và ẩn cho thấy sức mạnh của liên kết của chúng.

RBM điều chỉnh trọng số và độ lệch giữa các lớp trong quá trình đào tạo bằng cách sử dụng một kỹ thuật được gọi là phân kỳ tương phản. Phân kỳ tương phản là một chiến lược học tập không giám sát nhằm tối đa hóa khả năng dự đoán của mô hình.

Tầm quan trọng của Máy Boltzmann bị Hạn chế là gì?

RBM có ý nghĩa quan trọng trong học máy và học sâu vì chúng có thể học và trích xuất các đặc điểm liên quan từ lượng lớn dữ liệu.

Chúng rất hiệu quả để nhận dạng hình ảnh và giọng nói, đồng thời chúng đã được sử dụng trong nhiều ứng dụng như hệ thống đề xuất, phát hiện bất thường và giảm kích thước. RBM có thể tìm thấy các mẫu trong bộ dữ liệu khổng lồ, dẫn đến dự đoán và thông tin chuyên sâu vượt trội.

Máy Boltzmann bị hạn chế có thể được sử dụng ở đâu?

Các ứng dụng cho RBM bao gồm giảm kích thước, phát hiện bất thường và hệ thống đề xuất. RBM đặc biệt hữu ích cho phân tích tình cảm và mô hình chủ đề trong bối cảnh xử lý ngôn ngữ tự nhiên.

Mạng niềm tin sâu sắc, một loại mạng nơ-ron được sử dụng để nhận dạng giọng nói và hình ảnh, cũng sử dụng RBM. Hộp công cụ mạng niềm tin sâu sắc, TensorFlowvà Theano là một số ví dụ cụ thể về phần mềm hoặc công nghệ sử dụng RBM.

Tổng kết

Các mô hình Deep Learning ngày càng trở nên quan trọng trong nhiều ngành công nghiệp, bao gồm nhận dạng giọng nói, xử lý ngôn ngữ tự nhiên và thị giác máy tính.

Mạng thần kinh chuyển đổi (CNN) và Mạng thần kinh tái phát (RNN) đã cho thấy nhiều hứa hẹn nhất và được sử dụng rộng rãi trong nhiều ứng dụng, tuy nhiên, tất cả các mô hình Deep Learning đều có ưu điểm và nhược điểm.

Tuy nhiên, các nhà nghiên cứu vẫn đang xem xét Máy Boltzmann bị hạn chế (RBM) và các loại mô hình Deep Learning khác vì chúng cũng có những lợi thế đặc biệt.

Các mô hình mới và sáng tạo được dự đoán sẽ được tạo ra khi lĩnh vực học sâu tiếp tục phát triển để xử lý các vấn đề khó hơn

Bình luận