کی میز کے مندرجات[چھپائیں][دکھائیں]

کسی بھی قسم کی کارپوریٹ سرگرمی کے لیے بنیادی معیار میں سے ایک معلومات کا موثر استعمال ہے۔ کسی وقت، ڈیٹا کا حجم بنیادی پروسیسنگ کی گنجائش سے زیادہ ہو جاتا ہے۔

یہی وہ جگہ ہے جہاں مشین لرننگ الگورتھم کام میں آتے ہیں۔ تاہم، اس سے پہلے کہ اس میں سے کوئی بھی واقع ہو، معلومات کا مطالعہ اور تشریح کی جانی چاہیے۔ مختصراً، یہ وہی ہے جس کے لیے غیر زیر نگرانی مشین لرننگ استعمال کی جاتی ہے۔

اس آرٹیکل میں، ہم اس کے الگورتھم، استعمال کے کیسز، اور بہت کچھ سمیت غیر زیر نگرانی مشین لرننگ کا گہرائی سے جائزہ لیں گے۔

غیر زیر نگرانی مشین لرننگ کیا ہے؟

غیر زیر نگرانی مشین لرننگ الگورتھم ڈیٹاسیٹ میں ایسے نمونوں کی نشاندہی کرتے ہیں جن کا کوئی معلوم یا لیبل شدہ نتیجہ نہیں ہوتا ہے۔ زیر نگرانی مشین لرننگ الگورتھم ایک لیبل شدہ آؤٹ پٹ ہے.

اس فرق کو جاننے سے آپ کو یہ سمجھنے میں مدد ملتی ہے کہ کیوں غیر زیر نگرانی مشین لرننگ کے طریقے رجعت یا درجہ بندی کے مسائل کو حل کرنے کے لیے استعمال نہیں کیے جا سکتے، کیونکہ آپ نہیں جانتے کہ آؤٹ پٹ ڈیٹا کی قدر/جواب کیا ہو سکتا ہے۔ اگر آپ قدر/جواب نہیں جانتے ہیں تو آپ عام طور پر الگورتھم کو تربیت نہیں دے سکتے۔

مزید برآں، ڈیٹا کے بنیادی ڈھانچے کی شناخت کے لیے غیر زیر نگرانی سیکھنے کا استعمال کیا جا سکتا ہے۔ یہ الگورتھم انسانی تعامل کی ضرورت کے بغیر پوشیدہ نمونوں یا ڈیٹا گروپنگ کا پتہ لگاتے ہیں۔

معلومات میں مماثلتوں اور تضادات کا پتہ لگانے کی اس کی صلاحیت اسے ڈیٹا کے تجزیے، کراس سیلنگ تکنیک، صارفین کی تقسیم، اور تصویر کی شناخت کے لیے بہترین انتخاب بناتی ہے۔

مندرجہ ذیل منظر نامے پر غور کریں: آپ گروسری کی دکان پر ہیں اور ایک نامعلوم پھل دیکھتے ہیں جو آپ نے پہلے کبھی نہیں دیکھا ہوگا۔ آپ آسانی سے اس کی شکل، سائز یا رنگ کے اپنے مشاہدات کی بنیاد پر دوسرے پھلوں سے مختلف نامعلوم پھلوں میں فرق کر سکتے ہیں۔

غیر زیر نگرانی مشین لرننگ الگورتھم

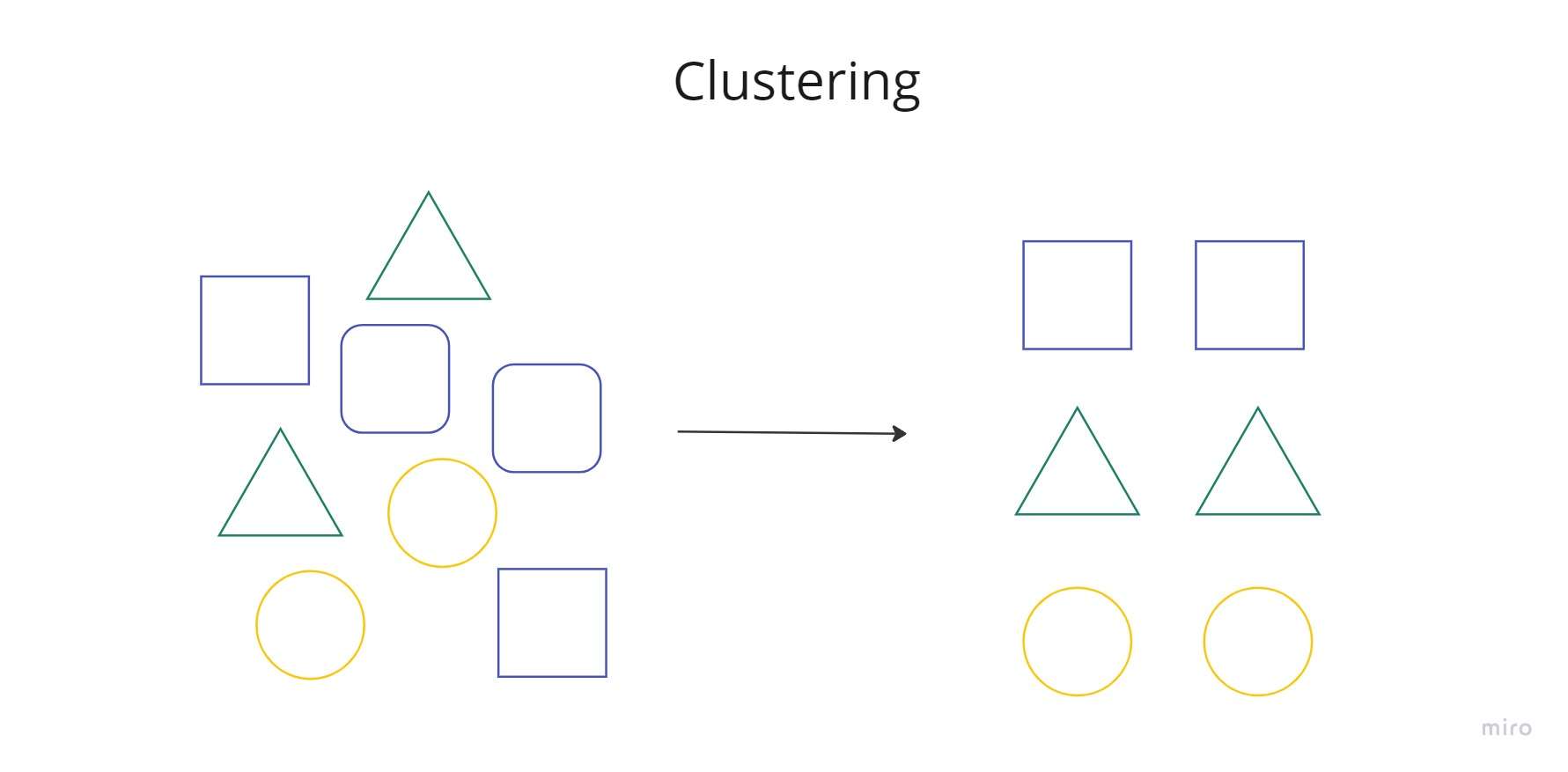

کلسٹرنگ

کلسٹرنگ بلا شبہ سب سے زیادہ استعمال شدہ غیر زیر نگرانی سیکھنے کا طریقہ ہے۔ یہ نقطہ نظر متعلقہ ڈیٹا آئٹمز کو تصادفی طور پر تیار کردہ کلسٹرز میں رکھتا ہے۔

بذات خود، ایک ML ماڈل کسی بھی پیٹرن، مماثلت، اور/یا غیر درجہ بند ڈیٹا ڈھانچے میں فرق کو دریافت کرتا ہے۔ ایک ماڈل ڈیٹا میں کسی بھی قدرتی گروپ بندی یا کلاس کو دریافت کرنے کے قابل ہو گا۔

م

کلسٹرنگ کی کئی شکلیں ہیں جو استعمال کی جا سکتی ہیں۔ آئیے پہلے سب سے اہم کو دیکھتے ہیں۔

- خصوصی کلسٹرنگ، جسے بعض اوقات "ہارڈ" کلسٹرنگ کے نام سے جانا جاتا ہے، گروپ بندی کی ایک قسم ہے جس میں ڈیٹا کا ایک حصہ صرف ایک کلسٹر سے تعلق رکھتا ہے۔

- اوور لیپنگ کلسٹرنگ، جسے اکثر "نرم" کلسٹرنگ کے نام سے جانا جاتا ہے، ڈیٹا آبجیکٹ کو مختلف ڈگریوں سے ایک سے زیادہ کلسٹر سے تعلق رکھنے کی اجازت دیتا ہے۔ مزید برآں، احتمالی کلسٹرنگ کا استعمال "نرم" کلسٹرنگ یا کثافت کے تخمینہ کے مسائل سے نمٹنے کے لیے کیا جا سکتا ہے، ساتھ ہی ساتھ بعض کلسٹرز سے تعلق رکھنے والے ڈیٹا پوائنٹس کے امکان یا امکان کا اندازہ لگانے کے لیے بھی۔

- گروپ شدہ ڈیٹا آئٹمز کا درجہ بندی بنانا درجہ بندی کے جھرمٹ کا مقصد ہے، جیسا کہ نام سے ظاہر ہوتا ہے۔ کلسٹرز بنانے کے لیے درجہ بندی کی بنیاد پر ڈیٹا آئٹمز کو ڈی کنسٹرکٹ یا ملایا جاتا ہے۔

مقدمات استعمال کریں:

- بے ضابطگی کا پتہ لگانا:

کلسٹرنگ کا استعمال کرتے ہوئے ڈیٹا میں کسی بھی قسم کے آؤٹ لیئر کا پتہ لگایا جا سکتا ہے۔ نقل و حمل اور لاجسٹکس کی کمپنیاں، مثال کے طور پر، لاجسٹک رکاوٹوں کو دریافت کرنے یا خراب میکینیکل حصوں (پیش گوئی کی بحالی) کو ظاہر کرنے کے لیے بے ضابطگی کا پتہ لگانے کا استعمال کر سکتی ہیں۔

مالیاتی ادارے اس ٹیکنالوجی کا استعمال کرتے ہوئے دھوکہ دہی والے لین دین کا پتہ لگا سکتے ہیں اور فوری جواب دے سکتے ہیں، ممکنہ طور پر بہت زیادہ رقم کی بچت ہوتی ہے۔ ہماری ویڈیو دیکھ کر اسامانیتاوں اور دھوکہ دہی کے بارے میں مزید جانیں۔

- گاہکوں اور بازاروں کی تقسیم:

کلسٹرنگ الگورتھم ان لوگوں کو گروپ کرنے میں مدد کر سکتے ہیں جو ایک جیسی خصوصیات رکھتے ہیں اور زیادہ موثر مارکیٹنگ اور ٹارگٹڈ اقدامات کے لیے صارفین کی شخصیتیں تیار کر سکتے ہیں۔

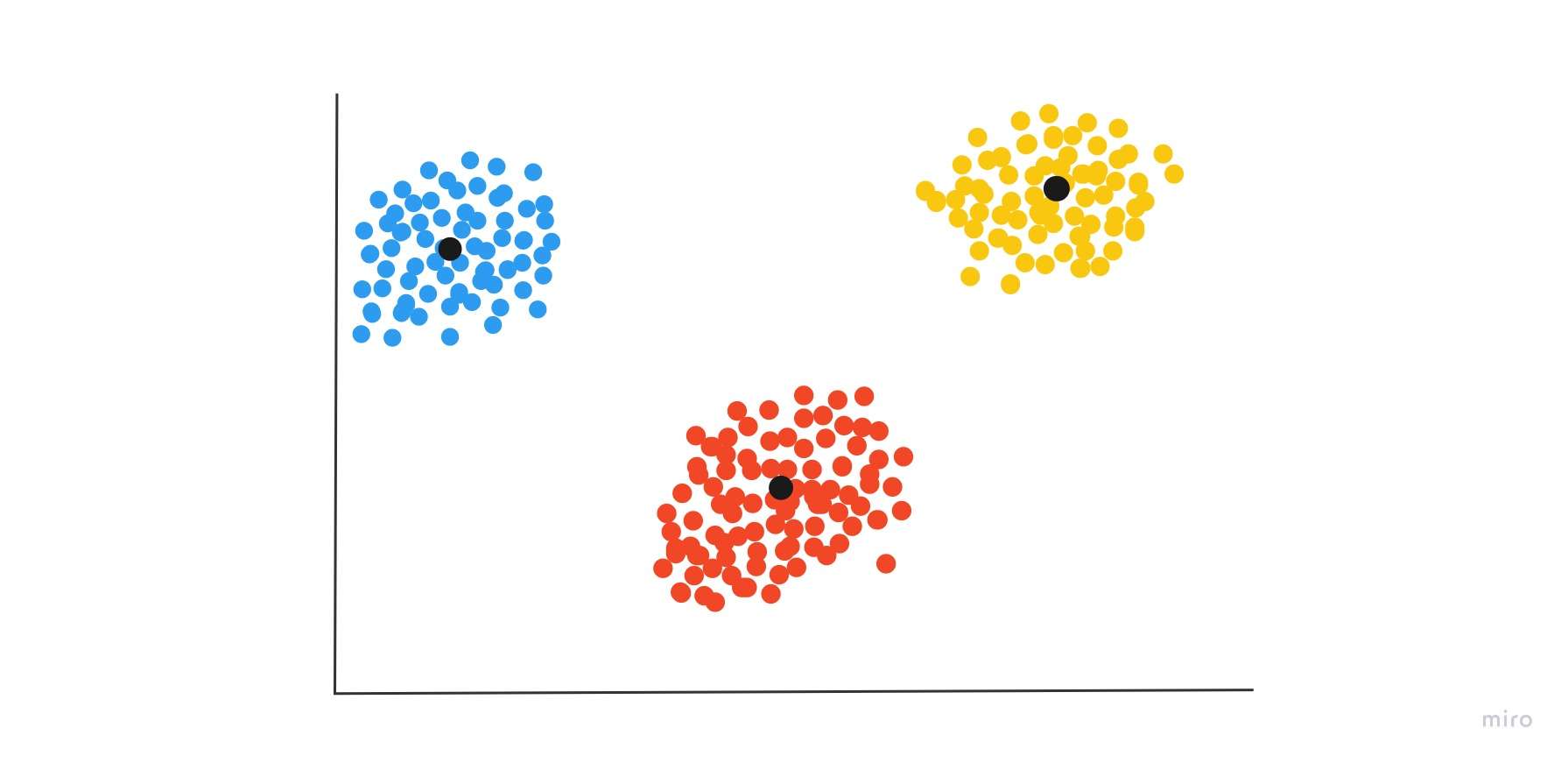

K- کا مطلب ہے۔

K- کا مطلب ایک کلسٹرنگ طریقہ ہے جسے پارٹیشننگ یا سیگمنٹیشن بھی کہا جاتا ہے۔ یہ ڈیٹا پوائنٹس کو پہلے سے طے شدہ کلسٹرز میں تقسیم کرتا ہے جسے K کے نام سے جانا جاتا ہے۔

K- مطلب طریقہ میں، K ان پٹ ہے کیونکہ آپ کمپیوٹر کو بتاتے ہیں کہ آپ اپنے ڈیٹا میں کتنے کلسٹرز کی شناخت کرنا چاہتے ہیں۔ ہر ڈیٹا آئٹم کو بعد میں قریب ترین کلسٹر سینٹر کو تفویض کیا جاتا ہے، جسے سینٹروڈ (تصویر میں سیاہ نقطے) کہا جاتا ہے۔

مؤخر الذکر ڈیٹا اسٹوریج کی جگہوں کے طور پر کام کرتے ہیں۔ کلسٹرنگ تکنیک کو متعدد بار کیا جا سکتا ہے جب تک کہ کلسٹرز کی اچھی طرح وضاحت نہ ہو جائے۔

فزی K کا مطلب ہے۔

Fuzzy K-means K-means تکنیک کی توسیع ہے، جو اوور لیپنگ کلسٹرنگ کے لیے استعمال ہوتی ہے۔ K-میانز تکنیک کے برعکس، فجی K-مینز اس بات کی نشاندہی کرتے ہیں کہ ڈیٹا پوائنٹس بہت سے کلسٹرز سے تعلق رکھتے ہیں جن میں ہر ایک کی قربت کی مختلف ڈگری ہوتی ہے۔

ڈیٹا پوائنٹس اور کلسٹر کے سینٹروڈ کے درمیان فاصلہ قربت کا حساب لگانے کے لیے استعمال کیا جاتا ہے۔ نتیجے کے طور پر، ایسے مواقع ہوسکتے ہیں جب مختلف کلسٹر اوورلیپ ہوتے ہیں۔

گاوسی مکسچر ماڈلز

Gaussian Mixture Models (GMMs) ممکنہ کلسٹرنگ میں استعمال ہونے والا ایک طریقہ ہے۔ چونکہ وسط اور تغیر نامعلوم ہیں، ماڈل فرض کرتے ہیں کہ Gaussian تقسیم کی ایک مقررہ تعداد ہے، ہر ایک ایک الگ کلسٹر کی نمائندگی کرتا ہے۔

اس بات کا تعین کرنے کے لیے کہ ایک مخصوص ڈیٹا پوائنٹ کس کلسٹر سے تعلق رکھتا ہے، طریقہ بنیادی طور پر استعمال کیا جاتا ہے۔

درجہ بندی کلسٹرنگ

درجہ بندی کی کلسٹرنگ کی حکمت عملی مختلف کلسٹر کو تفویض کردہ ہر ڈیٹا پوائنٹ کے ساتھ شروع ہوسکتی ہے۔ دو کلسٹر جو ایک دوسرے کے قریب ترین ہیں پھر ایک ہی کلسٹر میں ملا دیے جاتے ہیں۔ تکراری انضمام جاری رہتا ہے جب تک کہ صرف ایک کلسٹر سب سے اوپر باقی نہ رہے۔

یہ طریقہ نیچے سے اوپر یا جمع کے طور پر جانا جاتا ہے۔ اگر آپ ایک ہی کلسٹر سے جڑے تمام ڈیٹا آئٹمز کے ساتھ شروع کرتے ہیں اور پھر اس وقت تک تقسیم کرتے ہیں جب تک کہ ہر ڈیٹا آئٹم کو علیحدہ کلسٹر کے طور پر تفویض نہیں کیا جاتا ہے، تو اس طریقہ کو اوپر سے نیچے یا تقسیم کرنے والے درجہ بندی کے کلسٹرنگ کے نام سے جانا جاتا ہے۔

Apriori الگورتھم

مارکیٹ کی ٹوکری کے تجزیے نے apriori الگورتھم کو مقبول بنایا، جس کے نتیجے میں میوزک پلیٹ فارمز اور آن لائن اسٹورز کے لیے مختلف سفارشی انجن نکلے۔

ان کا استعمال لین دین کے ڈیٹاسیٹس میں متواتر آئٹم سیٹس، یا آئٹمز کی گروپ بندیوں کو تلاش کرنے کے لیے کیا جاتا ہے، تاکہ ایک پروڈکٹ کے استعمال کے امکان کا اندازہ لگایا جا سکے۔

مثال کے طور پر، اگر میں Spotify پر OneRepublic کا ریڈیو "Counting Stars" کے ساتھ چلانا شروع کرتا ہوں، تو اس چینل کے دیگر گانوں میں سے ایک یقینی طور پر امیجن ڈریگن گانا ہوگا، جیسے کہ "Bad Liar"۔

یہ میری سننے کی سابقہ عادات کے ساتھ ساتھ دوسروں کے سننے کے انداز پر مبنی ہے۔ Apriori طریقے ہیش ٹری کا استعمال کرتے ہوئے آئٹمز کی گنتی کرتے ہیں، ڈیٹا سیٹ کی چوڑائی سے پہلے۔

طول و عرض میں کمی

جہت میں کمی ایک غیر زیر نگرانی سیکھنے کی ایک قسم ہے جو ڈیٹا سیٹ میں خصوصیات کی تعداد - یا ابعاد - کو کم سے کم کرنے کے لیے حکمت عملیوں کے مجموعے کا استعمال کرتی ہے۔ ہمیں واضح کرنے کی اجازت دیں۔

آپ کی تخلیق کرتے وقت زیادہ سے زیادہ ڈیٹا شامل کرنا پرکشش ہوسکتا ہے۔ مشین لرننگ کے لیے ڈیٹا سیٹ. ہمیں غلط مت سمجھیں: یہ حکمت عملی اچھی طرح سے کام کرتی ہے کیونکہ زیادہ ڈیٹا عام طور پر زیادہ درست نتائج برآمد کرتا ہے۔

فرض کریں کہ ڈیٹا N-dimensional space میں محفوظ ہے، جس میں ہر ایک خصوصیت مختلف جہت کی نمائندگی کرتی ہے۔ اگر بہت زیادہ ڈیٹا ہو تو سینکڑوں جہتیں ہو سکتی ہیں۔

ایکسل سپریڈ شیٹس پر غور کریں، کالم خصوصیات کی نمائندگی کرنے والے اور قطاریں جو ڈیٹا آئٹمز کی نمائندگی کرتی ہیں۔ جب بہت زیادہ جہتیں ہوں تو، ML الگورتھم خراب کارکردگی کا مظاہرہ کر سکتے ہیں۔ اعداد و شمار کی تصور مشکل ہو سکتا ہے.

لہذا یہ خصوصیات یا طول و عرض کو محدود کرنا، اور صرف متعلقہ معلومات پہنچانا منطقی بناتا ہے۔ جہتی کمی صرف اتنا ہے۔ یہ ڈیٹا سیٹ کی سالمیت پر سمجھوتہ کیے بغیر ڈیٹا ان پٹ کی قابل انتظام مقدار کی اجازت دیتا ہے۔

پرنسپل اجزاء کا تجزیہ (پی سی اے)

بنیادی جزو کا تجزیہ جہتی کمی کا نقطہ نظر ہے۔ اس کا استعمال بڑے ڈیٹا سیٹس میں فیچرز کی تعداد کو کم کرنے کے لیے کیا جاتا ہے، جس کے نتیجے میں درستگی کی قربانی کے بغیر ڈیٹا کی زیادہ سادگی ہوتی ہے۔

ڈیٹا سیٹ کمپریشن کو فیچر نکالنے کے نام سے جانا جاتا ایک طریقہ سے مکمل کیا جاتا ہے۔ یہ اشارہ کرتا ہے کہ اصل سیٹ کے عناصر کو ایک نئے، چھوٹے میں ملایا گیا ہے۔ یہ نئی خصوصیات بنیادی اجزاء کے طور پر جانا جاتا ہے.

بلاشبہ، اضافی الگورتھم ہیں جو آپ اپنی غیر زیر نگرانی سیکھنے کی ایپلی کیشنز میں استعمال کر سکتے ہیں۔ اوپر درج کردہ صرف سب سے زیادہ مروجہ ہیں، اسی لیے ان پر مزید تفصیل سے بات کی گئی ہے۔

غیر زیر نگرانی سیکھنے کا اطلاق

- غیر زیر نگرانی سیکھنے کے طریقے بصری ادراک کے کاموں جیسے آبجیکٹ کی شناخت کے لیے استعمال کیے جاتے ہیں۔

- غیر زیر نگرانی مشین لرننگ طبی امیجنگ سسٹمز کو اہم پہلو فراہم کرتی ہے، جیسے کہ تصویر کی شناخت، درجہ بندی، اور سیگمنٹیشن، جن کا استعمال ریڈیولوجی اور پیتھالوجی میں مریضوں کی تیزی اور قابل اعتماد تشخیص کے لیے کیا جاتا ہے۔

- غیر زیر نگرانی سیکھنے سے ڈیٹا کے رجحانات کی نشاندہی کرنے میں مدد مل سکتی ہے جو صارفین کے رویے پر ماضی کے ڈیٹا کو استعمال کرتے ہوئے زیادہ مؤثر کراس سیلنگ حکمت عملی بنانے کے لیے استعمال کیے جا سکتے ہیں۔ چیک آؤٹ کے عمل کے دوران، اس کا استعمال آن لائن کاروبار کلائنٹس کو صحیح ایڈ آن تجویز کرنے کے لیے کرتے ہیں۔

- غیر زیر نگرانی سیکھنے کے طریقے آؤٹ لیرز کو تلاش کرنے کے لیے بہت زیادہ ڈیٹا کو چھان سکتے ہیں۔ یہ غیر معمولی چیزیں خرابی کے آلات، انسانی غلطی، یا سیکورٹی کی خلاف ورزیوں کے نوٹس کو بڑھا سکتی ہیں۔

غیر زیر نگرانی سیکھنے کے مسائل

غیر زیر نگرانی سیکھنا مختلف طریقوں سے پرکشش ہے، اس میں اہم بصیرت تلاش کرنے کی صلاحیت سے مہنگے ڈیٹا لیبلنگ سے بچنے کے لیے ڈیٹا آپریشنز تاہم، تربیت کے لیے اس حکمت عملی کو استعمال کرنے میں کئی خرابیاں ہیں۔ مشین سیکھنے کے ماڈل جس سے آپ کو آگاہ ہونا چاہیے۔ یہاں کچھ مثالیں ہیں.

- چونکہ ان پٹ ڈیٹا میں لیبلز کا فقدان ہے جو رسپانس کیز کے طور پر کام کرتے ہیں، غیر زیر نگرانی سیکھنے کے ماڈلز کے نتائج کم درست ہو سکتے ہیں۔

- غیر زیر نگرانی سیکھنا اکثر بڑے ڈیٹا سیٹس کے ساتھ کام کرتا ہے، جو کمپیوٹیشنل پیچیدگی کو بڑھا سکتا ہے۔

- اس نقطہ نظر کے لیے انسانوں کی طرف سے آؤٹ پٹ کی تصدیق کی ضرورت ہوتی ہے، یا تو انکوائری کے موضوع میں اندرونی یا بیرونی ماہرین۔

- الگورتھم کو تربیت کے پورے مرحلے کے دوران ہر ممکنہ منظر نامے کی جانچ پڑتال اور گنتی کرنی چاہیے، جس میں کچھ وقت لگتا ہے۔

نتیجہ

ڈیٹا کا موثر استعمال کسی خاص مارکیٹ میں مسابقتی برتری قائم کرنے کی کلید ہے۔

آپ اپنے ہدف کے سامعین کی ترجیحات کو جانچنے کے لیے یا یہ تعین کرنے کے لیے کہ کوئی مخصوص انفیکشن کسی خاص علاج کے لیے کس طرح کا ردعمل ظاہر کرتا ہے، غیر زیر نگرانی مشین لرننگ الگورتھم کا استعمال کرتے ہوئے ڈیٹا کو تقسیم کر سکتے ہیں۔

کئی عملی ایپلی کیشنز ہیں، اور ڈیٹا سائنسدانوں، انجینئرز، اور آرکیٹیکٹس آپ کے اہداف کا تعین کرنے اور آپ کی کمپنی کے لیے منفرد ML حل تیار کرنے میں آپ کی مدد کر سکتے ہیں۔

جواب دیجئے