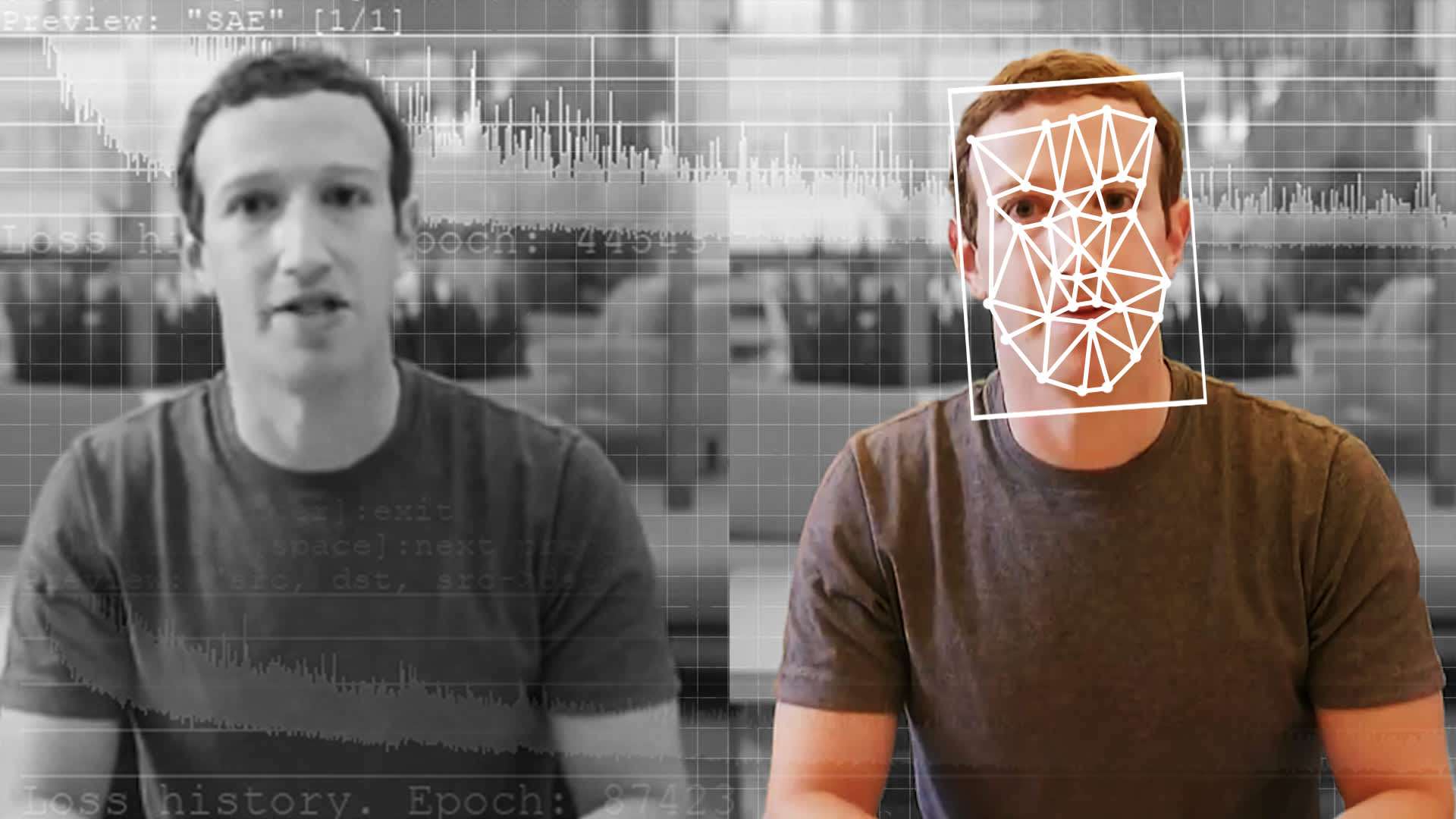

Відео Марка Цукерберга, який визнає крадіжку даних, і Барака Обами, який зловживає Дональдом Трампом, поширюються в Інтернеті вже досить довго?

Ці відео є результатом дуже просунутої та футуристичної технології штучного інтелекту під назвою Deepfake.

Простіше кажучи, це альтернатива фотошопу для відео. З одного боку, це може зробити революцію в електронних медіа, усунувши потребу в реальній людині.

З іншого боку, це серйозно загрожує особистості, оскільки на відео можна змусити будь-кого сказати будь-що.

Використання Deepfakes глибоке навчання для створення фотографій і відео фейкових подій, звідси й назва deepfake. Він може не тільки міняти обличчя на наявних відео, а й створювати нові кадри та відео з нуля.

Походження Deepfakes

Великий наукові дослідження за останні кілька років розширила межі фото- та відеоманіпуляції. Deepfake також є результатом цих академічних досліджень.

Перший випадок маніпуляцій з відео було зареєстровано в 1997 році. Відео людини було модифіковано, щоб вимовити слова, що містяться в іншій звуковій доріжці. Це був перший випадок використання реанімації обличчя навчання за допомогою машини методи.

Подальший помітний прогрес був досягнутий у 2017 році, коли відео колишнього президента США Барака Обами було модифіковано, щоб він вимовляв різні слова, що відповідали іншій звуковій доріжці.

У 2018 році дослідники з Каліфорнійського університету в Берклі представили додаток, який може створювати підроблені танцювальні відео з використанням глибокого навчання. Це ознаменувало поширення дипфейків на все тіло, оскільки попередні роботи обмежувалися лише обличчями.

Як створюються Deepfakes?

Завдяки досягненням у обчислювальній техніці, тепер ви можете відносно легко та за низькою ціною розробляти глибокі фейки. Для створення глибоких фейків використовуються два основні методи.

Метод 1

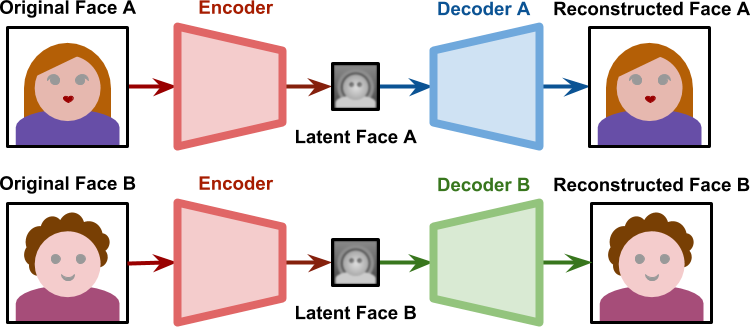

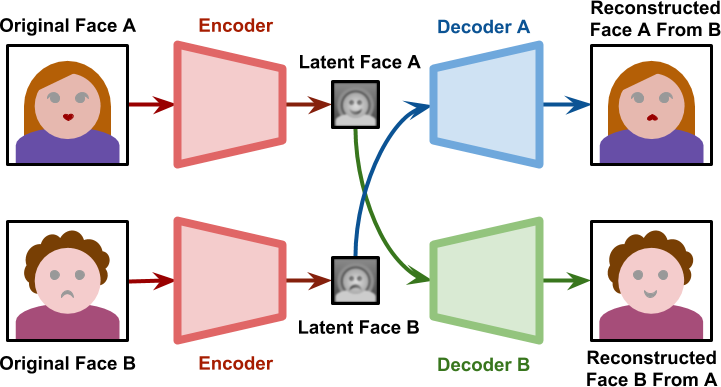

Вам доведеться тренувати а нейронної мережі на реальних відеозаписах людини. Це дозволить нейронної мережі зрозуміти риси обличчя об’єкта під різними кутами та умовами освітлення.

Після цього ви обробите як оригінальне, так і приховане обличчя за допомогою алгоритму ШІ, який називається кодером. Він знайде та дізнається відмінності та подібності між двома обличчями, і обидва обличчя будуть зведені до стислого зображення, яке має спільні риси.

Потім з’являється другий алгоритм ШІ, який називається декодером, який відновлює обличчя зі стиснутих зображень. Обидва обличчя відновлюються двома різними декодерами.

Щоб виконати заміну обличчя, ви просто подаєте закодовані зображення в інший декодер.

Наприклад, вихідні дані кодера обличчя A надходять у декодер, натренований на обличчі B, який потім відновлює обличчя B з рисами обличчя A. Вам доведеться робити це на кожному кадрі відео, щоб отримати переконливий результат.

Метод 2

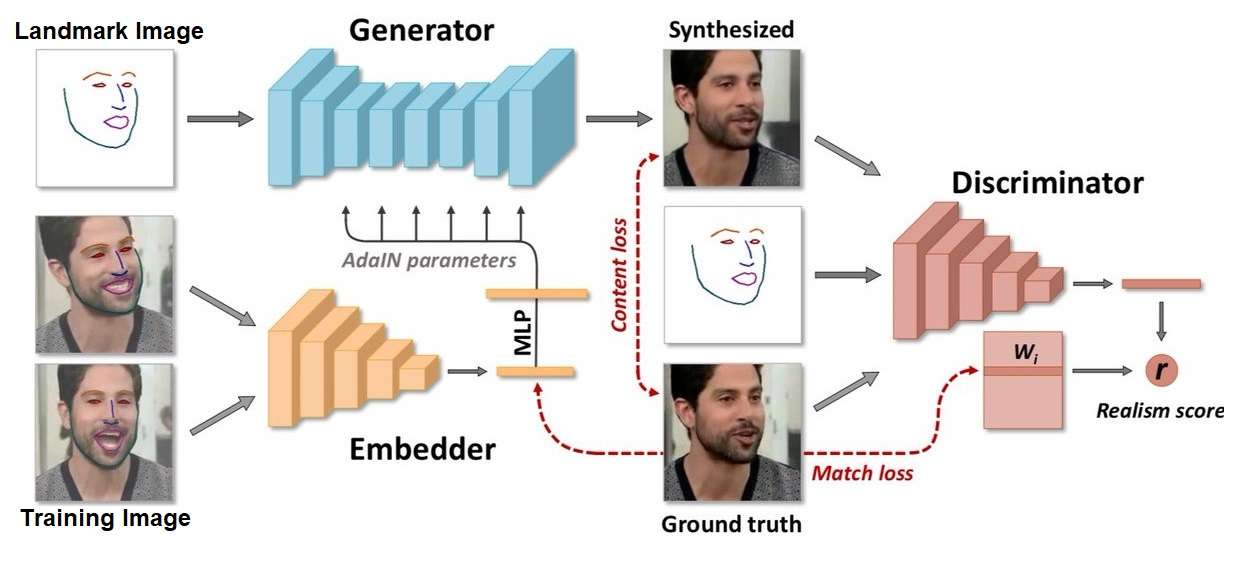

Інший метод створення дипфейків - це генеративна змагальна мережа (GAN).

Вам доведеться використовувати два конкуруючих алгоритми для створення глибоких фейків. Перший буде використовувати випадковий шум для створення зображення, тому його називають генератором. Це синтетичне зображення подається в потік реальних зображень за допомогою другого алгоритму, який називається дискримінатором.

Дискримінатор забезпечує зворотний зв'язок генератору, який генерує інше зображення відповідно до зворотного зв'язку. Таким чином, обидва алгоритми дають покращені результати з кожною ітерацією. Цей процес повторюється багато разів, поки не буде досягнуто необхідного рівня точності.

GAN дає цілком реалістичні результати, але з ним важко працювати, він вимагає величезної кількості навчальних даних і обчислювальної потужності. Ось чому він, як правило, є кращим для створення зображень, а не відеокліпів.

Деякі переконливі приклади Deepfakes

В Інтернеті крутиться кілька дуже переконливих дипфейків, і більшість із них — знаменитості.

Наприклад, є обліковий запис TikTok, присвячений виключно дипфейкам Тома Круза. На відео показано, як круїз грає в гольф або демонструє фокус.

@deeptomcruise Подорожуйте! ????

Ще один надзвичайно складний дипфейк був завантажений на YouTube із Томом Крузом, Робертом Дауні-молодшим, Джеффом Голдблюмом, Джорджем Лукасом та Юаном Макгрегором. У нього є деякі очевидні недоліки, але одночасно обробляти від 3 до 4 дипфейків у відео – це вже само по собі.

Інший приклад – глибоке фейкове відео колишнього президента Барака Обами.

Цей приголомшливо переконливий, оскільки використовує голоси та жести імітаторів, здатних імітувати голоси та жести суб’єкта.

Зараз ми бачимо глибокі фейки в сучасній індустрії розваг.

Його використовували для зйомок Пола Уокера у «Форсажі 7» після несподіваної смерті актора. Дипфейк був використаний на його браті з надзвичайною точністю.

Що приносять Deepfakes на стіл?

Deepfakes виявилися дуже надійною технологією для революції в медіа та розвагах.

Чи можете ви пригадати, коли в «Людина зі сталі» вуса Генрі Кавілла видалили CGI, і це була катастрофа?

Те ж саме зараз можна зробити на комп’ютерах вартістю в кілька тисяч доларів з набагато більш переконливими результатами.

Тепер ви можете зустріти своїх померлих предків і близьких. Ви навіть можете відвідати лекцію з фізики від самого Альберта Ейнштейна.

Крім усього цього, deepfake був використаний не зовсім так, як планувалося. Близько 96% глибоких фейків в Інтернеті є порнографією без згоди.

Велика кількість навчальних даних, доступних для знаменитостей, призвела до того, що вони стали найбільш цільовими жертвами дипфейків.

Це дозволило нам поставити будь-кого в небезпечні або компромісні сценарії, а отже, це становить великий ризик для всіх.

Повідомляється, що аудіо-підробки використовуються для шахрайства корпорацій. У 2019 році імітатор використав глибоке підроблене аудіо, щоб доручити генеральному директору британської фірми перевести 220,000 XNUMX євро в угорський банк, видаючи себе за керівника материнської компанії.

Як протидіяти шкідливим Deepfakes?

Зазвичай ви можете виявити глибокі фейкові відео, уважно спостерігаючи за кадром і шукаючи артефакти та нерівності.

Однак це суперечить інтуїції, і багато компаній працюють над алгоритмами та програмним забезпеченням виявляти дипфейки.

Facebook найняв дослідників з Берклі, Оксфорда та інших установ для створення детектора глибоких фейків. Аналогічно, YouTube оголосив, що не прийматиме фейкові відео, пов’язані з виборами в США, процедурами голосування чи переписом населення США 2020 року.

Ви також можете використовувати такі програми, як Захисник реальності і Deeptrace для виявлення глибоких фейків.

Країни також зайняті в законотворчості щодо використання дипфейків загалом. За останній рік США впровадили кілька законів щодо дипфейків.

Обернути

Deepfake є живим втіленням розвитку ШІ. Це ще більше розмиває межі майбутнього, однак є потенційною загрозою для довіри до відео-графічного вмісту в Інтернеті.

Настане час, коли люди почнуть сумніватися в кожному відео в Інтернеті, і ми потрапимо в еру подальшої невизначеності.

залишити коментар