Ang mga vector database ay kumakatawan sa isang makabuluhang pagbabago sa kung paano namin pinamamahalaan at binibigyang-kahulugan ang data, lalo na sa mga larangan ng artificial intelligence at machine learning.

Ang pangunahing pag-andar ng mga database na ito ay ang epektibong pangasiwaan ang mga high-dimensional na vector, na siyang hilaw na materyal ng mga modelo ng machine learning at kasama ang pag-convert ng text, larawan, o audio input sa mga numerical na representasyon sa multidimensional na espasyo.

Para sa mga application tulad ng mga system ng rekomendasyon, pagkilala sa bagay, pagkuha ng larawan, at pagtuklas ng panloloko, ang pagbabagong ito ay higit pa sa storage; isa itong pintuan patungo sa makapangyarihang mga kakayahan sa paghahanap ng pagkakatulad at mga query sa pinakamalapit na kapitbahay.

Higit na malalim, ang kapangyarihan ng mga vector database ay nasa kanilang kapasidad na magsalin ng malalaking halaga ng hindi nakaayos, kumplikadong data sa mga vector na kumukuha ng konteksto at kahulugan ng orihinal na nilalaman.

Ang pinahusay na mga function sa paghahanap na ginawang posible sa pamamagitan ng pag-embed ng mga modelo sa encoding na ito ay kinabibilangan ng kakayahang mag-query ng mga nakapalibot na vectors upang makahanap ng mga kaugnay na larawan o parirala.

Ang mga database ng vector ay natatangi dahil ang mga ito ay binuo sa mga advanced na diskarte sa pag-index tulad ng Inverted File Index (IVF) at Hierarchical Navigable Small World (HNSW), na nagpapahusay sa kanilang bilis at kahusayan habang hinahanap ang mga pinakamalapit na kapitbahay sa mga N-dimensional na espasyo.

May malinaw na pagkakaiba sa pagitan ng vector at classic na mga database. Ang mga maginoo na database ay mahusay sa pag-aayos ng data sa mga organisadong set na CRUD-optimized at sumusunod sa mga set schema.

Gayunpaman, kapag nakikitungo sa pabago-bago at kumplikadong katangian ng high-dimensional na data, ang katigasan na ito ay nagsisimulang maging isang hadlang.

Sa kabaligtaran, ang mga database ng vector ay nag-aalok ng antas ng kakayahang umangkop at kahusayan na hindi maaaring pantayan ng mga tradisyonal na katumbas, lalo na para sa mga application na lubos na umaasa sa machine learning at artificial intelligence. Hindi lang sila nasusukat at bihasa sa mga paghahanap ng pagkakatulad.

Ang mga vector database ay partikular na kapaki-pakinabang para sa mga generative AI application. Upang matiyak na ang ginawang materyal ay nagpapanatili ng integridad sa konteksto, ang mga application na ito—na kinabibilangan ng natural na pagpoproseso ng wika at pagbuo ng larawan—ay nakadepende sa mabilis na pagkuha at paghahambing ng mga pag-embed.

Kaya sa bahaging ito, titingnan namin ang nangungunang mga database ng vector para sa iyong susunod na proyekto.

1. Milvus

Ang Milvus ay isang pangunguna sa open-source vector database na pangunahing idinisenyo para sa mga AI application, kabilang ang mga naka-embed na paghahanap ng pagkakatulad at makapangyarihang MLOps.

Ito ay naiiba sa maginoo na relational database, na kadalasang humahawak nakaayos na data, dahil sa kapasidad na ito, na nagbibigay-daan dito na mag-index ng mga vector sa hindi pa naganap na trilyong sukat.

Ang dedikasyon ng Milvus sa scalability at mataas na kakayahang magamit ay ipinakita sa paraan ng pagbuo nito mula sa unang bersyon nito hanggang sa ganap na ipinamahagi, cloud-native na Milvus 2.0.

Sa partikular, ang Milvus 2.0 ay nagpapakita ng ganap na cloud-native na disenyo na naglalayong magkaroon ng kahanga-hangang 99.9% availability habang lumalampas sa daan-daang node.

Para sa mga naghahanap ng maaasahang solusyon sa database ng vector, lubos na inirerekomenda ang edisyong ito dahil hindi lamang ito nagdadagdag ng mga sopistikadong feature tulad ng multi-cloud na koneksyon at administrative panel, ngunit pinapabuti din nito ang mga antas ng pagkakapare-pareho ng data para sa flexible na pagbuo ng application.

Ang isang kapansin-pansing bentahe ng Milvus ay ang community-driven na diskarte nito, na nagbibigay ng multi-language na suporta at malawak na toolchain na iniayon sa mga hinihingi ng mga developer.

Sa sektor ng IT, ang cloud scalability at reliability nito, kasama ang high-performance na mga kakayahan sa paghahanap ng vector sa malalaking dataset, ay ginagawa itong popular na opsyon.

Bukod pa rito, pinapahusay nito ang kahusayan ng mga operasyon nito gamit ang isang hybrid na kakayahan sa paghahanap na pinagsasama ang paghahanap ng pagkakatulad ng vector sa scalar filtering.

Ang Milvus ay may administrative panel na may malinaw user interface, isang buong hanay ng mga API, at isang nasusukat at naaayos na arkitektura.

Ang komunikasyon sa mga panlabas na application ay pinadali ng layer ng pag-access, habang ang pagbabalanse ng pag-load at pamamahala ng data ay pinag-ugnay ng serbisyo ng coordinator, na nagsisilbing sentral na utos.

Ang pagiging permanente ng database ay sinusuportahan ng layer ng imbakan ng bagay, habang ang mga worker node ay nagsasagawa ng mga aktibidad upang matiyak ang scalability.

pagpepresyo

Ito ay libre gamitin para sa lahat.

2. FAISS

Ang AI Research team ng Facebook ay bumuo ng isang cutting-edge library na tinatawag na Facebook AI Similarity Search na idinisenyo upang gawing mas epektibo ang siksik na vector clustering at paghahanap ng pagkakatulad.

Ang paglikha nito ay hinihimok ng pangangailangan upang mapabuti ang mga kakayahan sa paghahanap ng pagkakatulad ng Facebook AI sa pamamagitan ng paggamit ng mga makabagong pangunahing pamamaraan.

Kung ikukumpara sa mga pagpapatupad na nakabatay sa CPU, ang makabagong pagpapatupad ng GPU ng FAISS ay maaaring pabilisin ang mga oras ng paghahanap ng lima hanggang sampung beses, na ginagawa itong isang napakahalagang tool para sa iba't ibang mga application, kabilang ang mga sistema ng rekomendasyon at ang pagkakakilanlan ng mga katulad na kahulugan sa malaking halaga. mga hindi nakaayos na dataset tulad ng text, audio, at video.

Kakayanin ng FAISS ang malawak na hanay ng mga sukatan ng pagkakatulad, gaya ng pagkakatulad ng cosine, panloob na produkto, at ang karaniwang ginagamit na sukatan ng L2 (Euclidean distance).

Pinapadali ng mga sukat na ito ang paggawa ng tumpak at naiaangkop na mga paghahanap ng pagkakatulad sa iba't ibang uri ng data. Ang mga feature tulad ng batch processing, precision-speed trade-offs, at suporta para sa parehong tumpak at tinatayang mga paghahanap ay lalong nagpapataas sa flexibility nito.

Bukod pa rito, nag-aalok ang FAISS ng isang scalable na paraan para sa paghawak ng napakalaking dataset sa pamamagitan ng pagpayag sa mga index na maimbak sa disk.

Ang inverted file, product quantization (PQ), at pinahusay na PQ ay ilan lamang sa mga makabagong diskarte na bumubuo sa research foundation ng FAISS at nagdaragdag sa pagiging epektibo nito pagdating sa pag-index at paghahanap ng mga high-dimensional na vector field.

Ang mga diskarteng ito ay pinalalakas ng mga makabagong diskarte tulad ng GPU-accelerated k-selection algorithm at paunang pag-filter ng PQ distances, na ginagarantiyahan ang kapasidad ng FAISS na makagawa ng mabilis at tumpak na mga resulta ng paghahanap kahit na sa bilyon-bilyong dataset.

pagpepresyo

Ito ay libre gamitin para sa lahat.

3. pine cone

Ang Pinecone ay isang nangunguna sa mga database ng vector, na nagbibigay ng cloud-native, pinamamahalaang serbisyo na partikular na binuo upang mapabuti ang pagganap ng mga high-powered AI application.

Partikular itong idinisenyo upang pangasiwaan ang mga vector embeddings, na mahalaga para sa generative AI, semantic search, at mga application gamit ang malalaking modelo ng wika.

Naiintindihan na ngayon ng AI ang semantic na impormasyon salamat sa mga pag-embed na ito, na epektibong nagsisilbing pangmatagalang memorya para sa mga kumplikadong gawain.

Ang Pinecone ay natatangi dahil walang putol nitong isinasama ang mga kakayahan ng mga tradisyonal na database sa pinahusay na pagganap ng mga vector index, na nagbibigay-daan sa mahusay at malakihang pag-iimbak at pagtatanong ng mga pag-embed.

Ginagawa nitong perpektong opsyon sa mga sitwasyon kung saan hindi sapat ang pagiging kumplikado at dami ng data na kasama sa karaniwang mga database na nakabatay sa scalar.

Nag-aalok ang Pinecone sa mga developer ng walang problemang solusyon dahil sa pinamamahalaang diskarte nito sa serbisyo, na nag-streamline sa integration at real-time na mga pamamaraan sa paggamit ng data.

Maraming operasyon ng data ang sinusuportahan nito, kabilang ang pagkuha, pag-update, pagtanggal, pag-query, at pag-upsert ng data.

Tinitiyak pa ng Pinecone na ang mga query na kumakatawan sa mga real-time na pagbabago gaya ng mga upsert at pagtanggal ay nagbubunga ng tama, mababang latency na mga tugon para sa mga index na may bilyun-bilyong vectors.

Sa mga dynamic na sitwasyon, ang tampok na ito ay mahalaga para sa pagpapanatili ng kaugnayan at pagiging bago ng mga resulta ng query.

Bukod pa rito, pinapataas ng pakikipagtulungan ng Pinecone sa Airbyte sa pamamagitan ng koneksyon ng Pinecone ang versatility at flexibility nito, na nagbibigay-daan para sa maayos na pagsasama ng data mula sa hanay ng mga source.

Sa pamamagitan ng kaugnayang ito, ang mga gastos at kahusayan ay maaaring ma-optimize sa pamamagitan ng pagtiyak na ang bagong nakuhang impormasyon lamang ang pinangangasiwaan sa pamamagitan ng incremental na pag-synchronize ng data.

Ang disenyo ng connector ay nagbibigay-diin sa pagiging simple, nangangailangan lamang ng pinakamababang mga parameter ng pag-setup, at ito ay napapalawig, na nagbibigay-daan para sa mga pagpapabuti sa hinaharap.

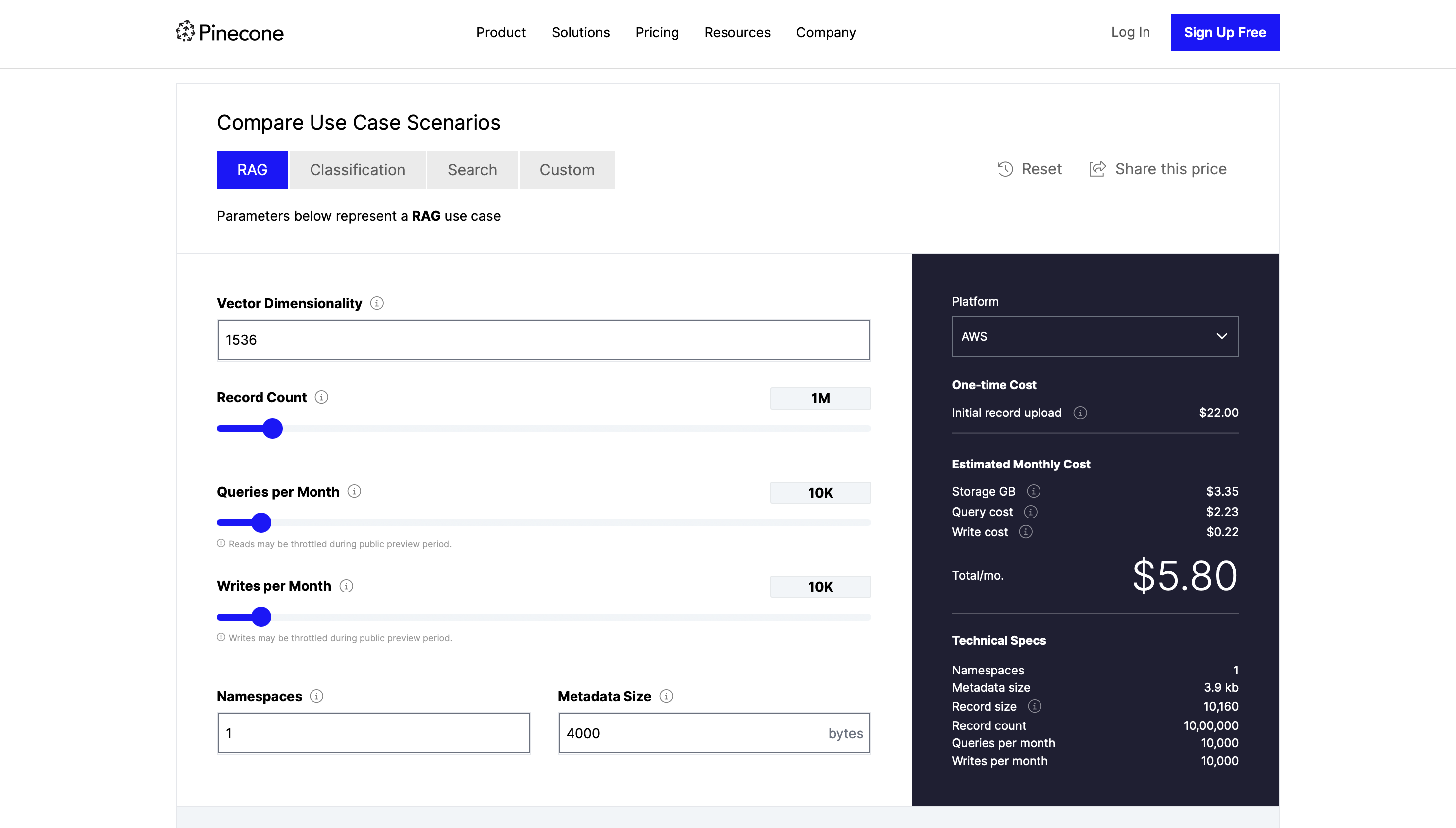

pagpepresyo

Ang premium na pagpepresyo ay nagsisimula sa $5.80/buwan para sa RAG use case.

4. Nagpapahirap

Ang Weaviate ay isang makabagong vector database na available bilang open-source software na nagbabago sa paraan ng pag-access at paggamit ng data.

Gumagamit ang Weaviate ng mga kakayahan sa paghahanap ng vector, na nagbibigay-daan sa mga sopistikadong paghahanap na may kamalayan sa konteksto sa malalaking, kumplikadong mga dataset, kabaligtaran sa mga tipikal na database na nakadepende sa mga scalar value at paunang natukoy na mga query.

Sa pamamaraang ito, mahahanap mo ang nilalaman batay sa kung gaano ito kapareho sa ibang nilalaman, na nagpapahusay sa pagiging intuitive ng mga paghahanap at ang kaugnayan ng mga resulta.

Ang maayos na pagsasama nito sa mga modelo ng machine learning ay isa sa mga pangunahing katangian nito; pinahihintulutan itong gumana bilang higit pa sa isang solusyon sa pag-iimbak ng data; pinapayagan din nito ang data na maunawaan at masuri gamit ang artificial intelligence.

Ang arkitektura ng Weaviate ay lubusang isinasama ang pagsasamang ito, na ginagawang posible na pag-aralan ang kumplikadong data nang hindi gumagamit ng mga karagdagang tool.

Ang suporta nito para sa mga modelo ng data ng graph ay nagbibigay din ng ibang viewpoint sa data bilang mga naka-link na entity, paglalantad ng mga pattern at insight na maaaring makaligtaan sa mga kumbensyonal na arkitektura ng database.

Dahil sa modular na arkitektura ng Weaviate, ang mga customer ay maaaring magdagdag ng mga kakayahan tulad ng data vectorization at backup na paggawa kung kinakailangan.

Ang pangunahing bersyon nito ay gumagana bilang isang database ng espesyalista sa data ng vector, at maaari itong palawakin kasama ng iba pang mga module upang matugunan ang iba't ibang pangangailangan.

Ang scalability nito ay higit na pinahusay ng modular na disenyo nito, na ginagarantiyahan na ang bilis ay hindi isasakripisyo bilang tugon sa pagtaas ng dami ng data at mga kahilingan sa query.

Ang isang maraming nalalaman at epektibong paraan ng pakikipag-ugnayan sa nakaimbak na data ay naging posible sa pamamagitan ng suporta ng database para sa parehong RESTful at GraphQL API.

Sa partikular, ang GraphQL ay napili dahil sa kapasidad nitong mabilis na magsagawa ng masalimuot, graph-based na mga query, na nagbibigay-daan sa mga user na makuha ang eksaktong data na gusto nila nang hindi nakakakuha ng sobra o hindi sapat na dami ng data.

Ang Weaviate ay mas madaling gamitin sa iba't ibang mga library ng kliyente at programming language salamat sa flexible na API nito.

Para sa mga nagnanais na galugarin ang Weaviate, mayroong napakaraming dokumentasyon at mga tutorial na magagamit, mula sa pag-set up at pag-configure ng iyong instance hanggang sa malalim na pagsisid sa mga kakayahan nito tulad ng paghahanap ng vector, pagsasama ng machine learning, at disenyo ng schema.

Maa-access mo ang parehong makapangyarihang teknolohiya na ginagawang pabago-bago at naaaksyunan ang impormasyon kung magpasya kang magpatakbo ng Weaviate nang lokal, sa isang cloud computing kapaligiran, o sa pamamagitan ng Weaviate na pinamamahalaang cloud service.

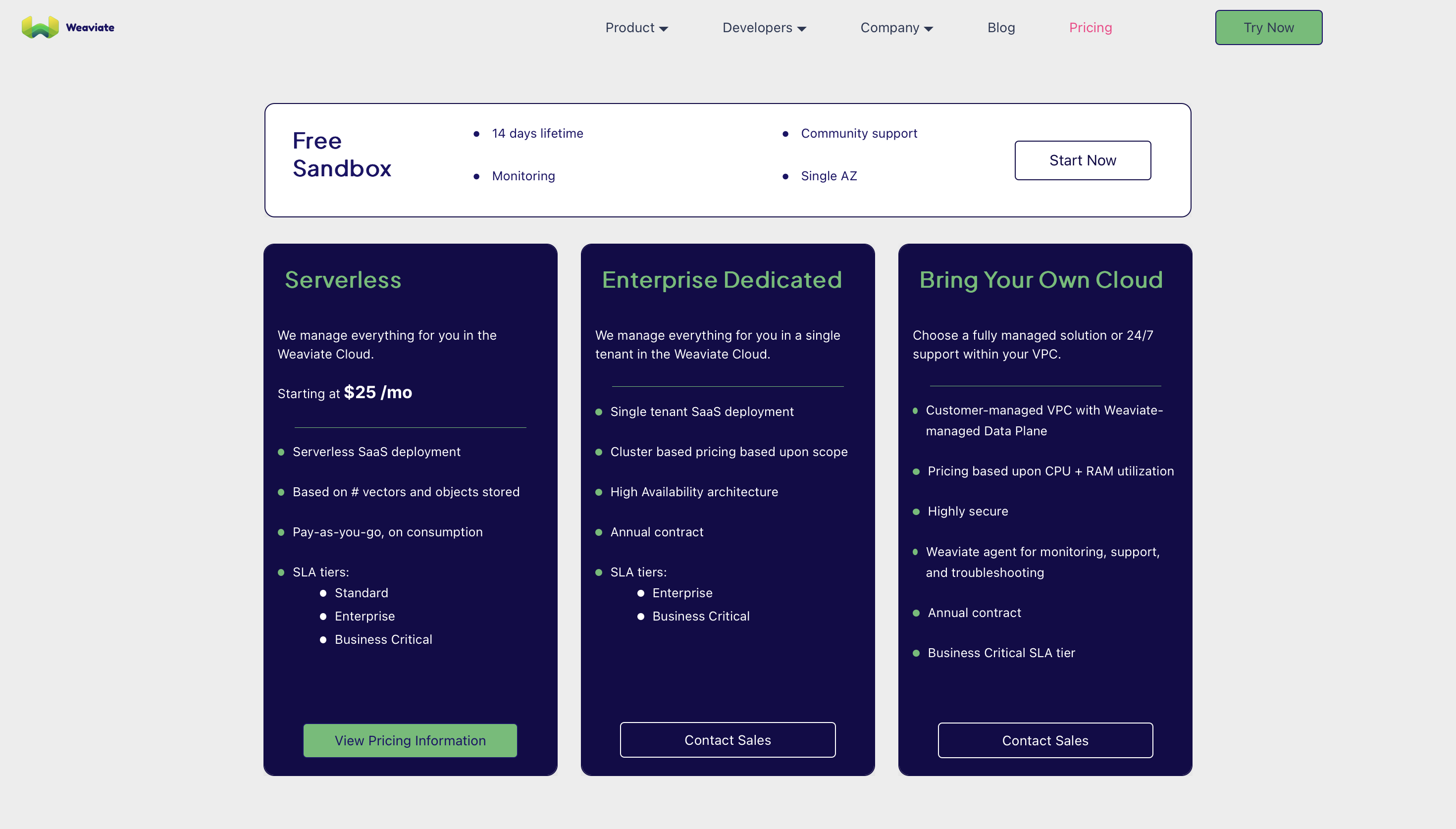

pagpepresyo

Ang premium na pagpepresyo ng platform ay nagsisimula sa $25/buwan para sa walang server.

5. Chroma

Ang Chroma ay isang cutting-edge vector database na naglalayong baguhin nang lubusan ang data retrieval at storage, partikular na para sa mga application na kinasasangkutan ng machine learning at artificial intelligence.

Dahil gumagana ang Chroma sa mga vector sa halip na mga scalar na numero, hindi tulad ng mga karaniwang database, napakahusay nito sa pamamahala ng high-dimensional, kumplikadong data.

Ito ay isang malaking pagsulong sa teknolohiya sa pagkuha ng data dahil ito ay nagbibigay-daan sa mas sopistikadong mga paghahanap batay sa pagkakapareho ng semantiko ng materyal sa halip na tumpak na mga tugma ng keyword.

Ang isang kapansin-pansing katangian ng Chroma ay ang kakayahang magtrabaho kasama ang ilang pinagbabatayan na mga solusyon sa imbakan, tulad ng ClickHouse para sa mga naka-scale na setting at DuckDB para sa mga standalone na pag-install, na ginagarantiyahan ang kakayahang umangkop at pagbagay sa iba't ibang mga kaso ng paggamit.

Ginawa ang Chroma nang nasa isip ang pagiging simple, bilis, at pagsusuri. Available ito sa malawak na spectrum ng mga developer na may mga SDK para sa Python at JavaScript/TypeScript.

Bukod pa rito, binibigyang-diin ng Chroma ang pagiging kabaitan ng gumagamit, na nagbibigay-daan sa mga developer na mabilis na mag-set up ng permanenteng database na sinusuportahan ng DuckDB o isang in-memory na database para sa pagsubok.

Ang kakayahang bumuo ng mga bagay sa koleksyon na kahawig ng mga talahanayan sa mga kumbensyonal na database, kung saan ang data ng text ay maaaring maipasok at awtomatikong ma-transform sa mga pag-embed gamit ang mga modelo tulad ng all-MiniLM-L6-v2, higit pang nagpapataas sa versatility na ito.

Maaaring isama nang walang putol ang teksto at mga pag-embed, na mahalaga para sa mga application na kailangang maunawaan ang semantics ng data.

Ang pundasyon ng paraan ng pagkakatulad ng vector ng Chroma ay ang mga matematikal na konsepto ng orthogonality at density, na mahalaga sa pag-unawa sa representasyon at paghahambing ng data sa mga database.

Ang mga ideyang ito ay nagbibigay-daan sa Chroma na magsagawa ng makabuluhan at mahusay na mga paghahanap ng pagkakatulad sa pamamagitan ng pagsasaalang-alang sa mga semantikong ugnayan sa pagitan ng mga elemento ng data.

Ang mga mapagkukunan tulad ng mga tutorial at alituntunin ay naa-access para sa mga indibidwal na gustong mag-explore pa ng Chroma. Kasama sa mga ito ang sunud-sunod na gabay sa kung paano i-set up ang database, lumikha ng mga koleksyon, at magpatakbo ng mga paghahanap ng pagkakatulad.

pagpepresyo

Maaari mong simulan ang paggamit nito nang libre.

6. Putakti

Ang Vespa ay isang platform na binabago ang online na paghawak ng AI at malaking data.

Ang pangunahing layunin ng Vespa ay paganahin ang mga mababang-latency na pag-compute sa malalaking dataset, na nagbibigay-daan sa iyong madaling mag-imbak, mag-index, at magsuri ng text, vector, at structured na data.

Ang Vespa ay nakikilala sa pamamagitan ng kakayahang magbigay ng mabilis na mga sagot sa anumang sukat, anuman ang uri ng mga query, pagpipilian, o mga hinuha ng modelong natutunan ng makina na hinahawakan.

Ang flexibility ng Vespa ay ipinapakita sa fully functional na search engine at vector database nito, na nagbibigay-daan sa maraming paghahanap sa loob ng iisang query, mula sa vector (ANN), lexical, at structured na data.

Anuman ang sukat, maaari kang lumikha ng user-friendly at tumutugon na mga app sa paghahanap na may mga real-time na kakayahan sa AI salamat sa pagsasama-samang ito ng hinuha ng modelong natutunan ng machine sa iyong data.

Gayunpaman, ang Vespa ay higit pa sa paghahanap; tungkol din ito sa pag-unawa at pag-customize ng mga engkwentro.

Ang nangungunang mga tool sa pag-customize at pagmumungkahi ay nagbibigay ng mga pabago-bago, kasalukuyang mga rekomendasyon na nakalaan sa mga partikular na user o sitwasyon.

Ang Vespa ay isang game-changer para sa sinumang gustong makapasok din sa conversational AI space, dahil nag-aalok ito ng imprastraktura na kailangan para mag-imbak at mag-explore ng text at vector data sa real-time, na nagbibigay-daan para sa pagbuo ng mas advanced at praktikal na mga ahente ng AI.

Sa pamamagitan ng komprehensibong tokenization at stemming, ang mga full-text na paghahanap, pinakamalapit na kapitbahay na paghahanap, at structured data query ay sinusuportahan lahat ng malawak na kakayahan sa query ng platform.

Naiiba ito dahil epektibo nitong mapangasiwaan ang mga kumplikadong query sa pamamagitan ng pagsasama-sama ng ilang dimensyon ng paghahanap.

Ang Vespa ay isang computational powerhouse para sa AI at machine learning application dahil ang computation engine nito ay kayang humawak ng mga kumplikadong mathematical expression sa mga scalar at tensor.

Sa pagpapatakbo, ang Vespa ay ginawa upang maging simple at napapalawak.

Pina-streamline nito ang mga paulit-ulit na proseso, mula sa configuration ng system at pagbuo ng application hanggang sa pamamahala ng data at node, na nagbibigay-daan sa ligtas at walang patid na mga operasyon sa produksyon.

Tinitiyak ng arkitektura ng Vespa na lumalawak ito kasama ng iyong data, na pinapanatili ang pagiging maaasahan at pagganap nito.

pagpepresyo

Maaari mong simulan ang paggamit nito nang libre.

7. kuwadrante

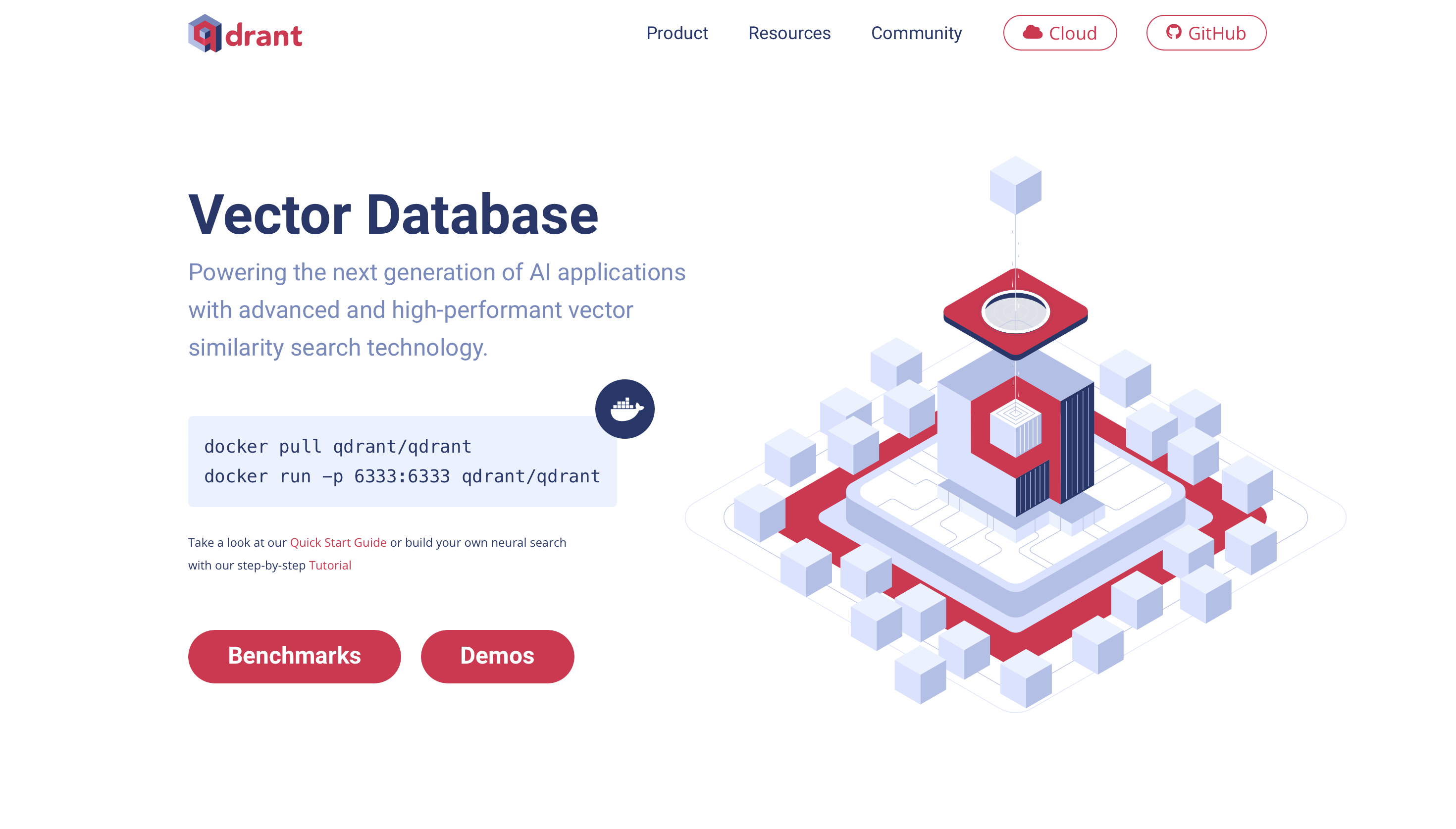

Ang Qdrant ay isang flexible vector database platform na nagbibigay ng natatanging hanay ng mga kakayahan upang matugunan ang lumalaking pangangailangan ng AI at machine learning application.

Sa pundasyon nito, ang Qdrant ay isang vector similarity search engine na nagbibigay ng madaling gamitin na API para sa pag-iimbak, paghahanap, at pagpapanatili ng mga vector pati na rin ang data ng payload.

Ang tampok na ito ay mahalaga para sa ilang mga application, tulad ng semantic na paghahanap at mga sistema ng rekomendasyon, na nangangailangan ng pagbibigay-kahulugan sa mga kumplikadong format ng data.

Ang platform ay binuo na may kahusayan at scalability sa isip, na may kakayahang pangasiwaan ang napakalaking dataset na may bilyun-bilyong data point.

Nagbibigay ito ng ilang sukatan ng distansya kabilang ang Cosine Similarity, Euclidean Distance, at Dot Product, na ginagawa itong madaling ibagay sa maraming sitwasyon ng paggamit.

Nag-aalok ang disenyo ng kumplikadong pag-filter, tulad ng string, range, at geo-filter, upang matugunan ang magkakaibang mga pangangailangan sa paghahanap.

Ang Qdrant ay naa-access ng mga developer sa iba't ibang paraan, kabilang ang isang Docker na imahe para sa mabilis na mga lokal na setup, isang Python client para sa mga komportable sa wika, at isang cloud service para sa isang mas matatag, production-grade na kapaligiran.

Ang kakayahang umangkop ng Qdrant ay nagbibigay-daan para sa tuluy-tuloy na pagsasama sa anumang teknolohikal na pagsasaayos o mga pangangailangan sa proseso.

Higit pa rito, pinapasimple ng user-friendly na interface ng Qdrant ang pamamahala ng database ng vector. Ang platform ay nilalayong maging diretso para sa mga user ng lahat ng antas ng kasanayan, mula sa paggawa ng cluster hanggang sa pagbuo ng mga API key para sa ligtas na pag-access.

Ang kakayahan nitong maramihang pag-upload at asynchronous na API ay nagpapabuti sa kahusayan nito, na ginagawa itong isang napaka-kapaki-pakinabang na tool para sa mga developer na nakikitungo sa napakalaking dami ng data.

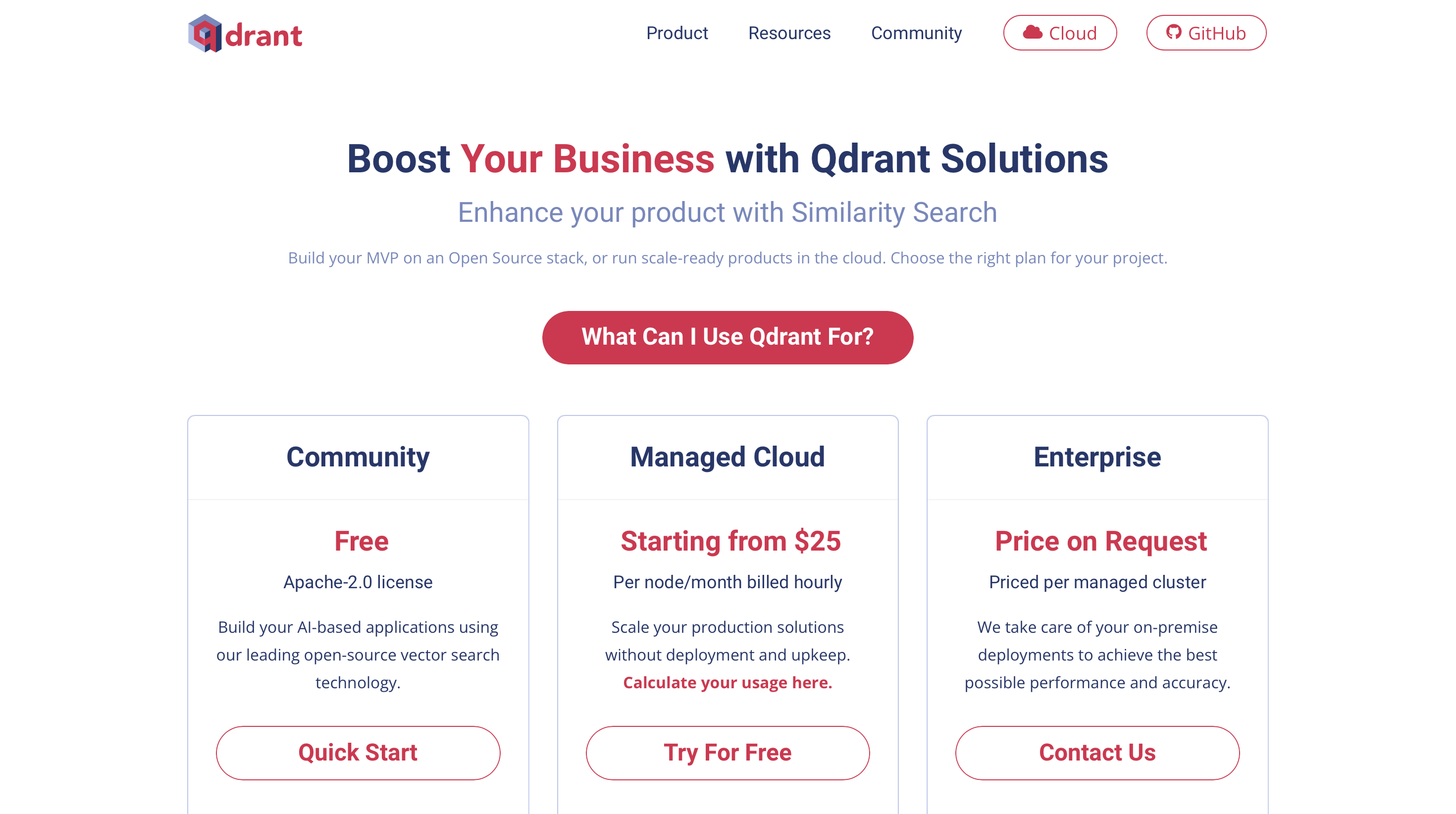

pagpepresyo

Maaari mo itong simulang gamitin nang libre at ang premium na pagpepresyo ay nagsisimula sa $25 bawat node/buwan na sinisingil kada oras

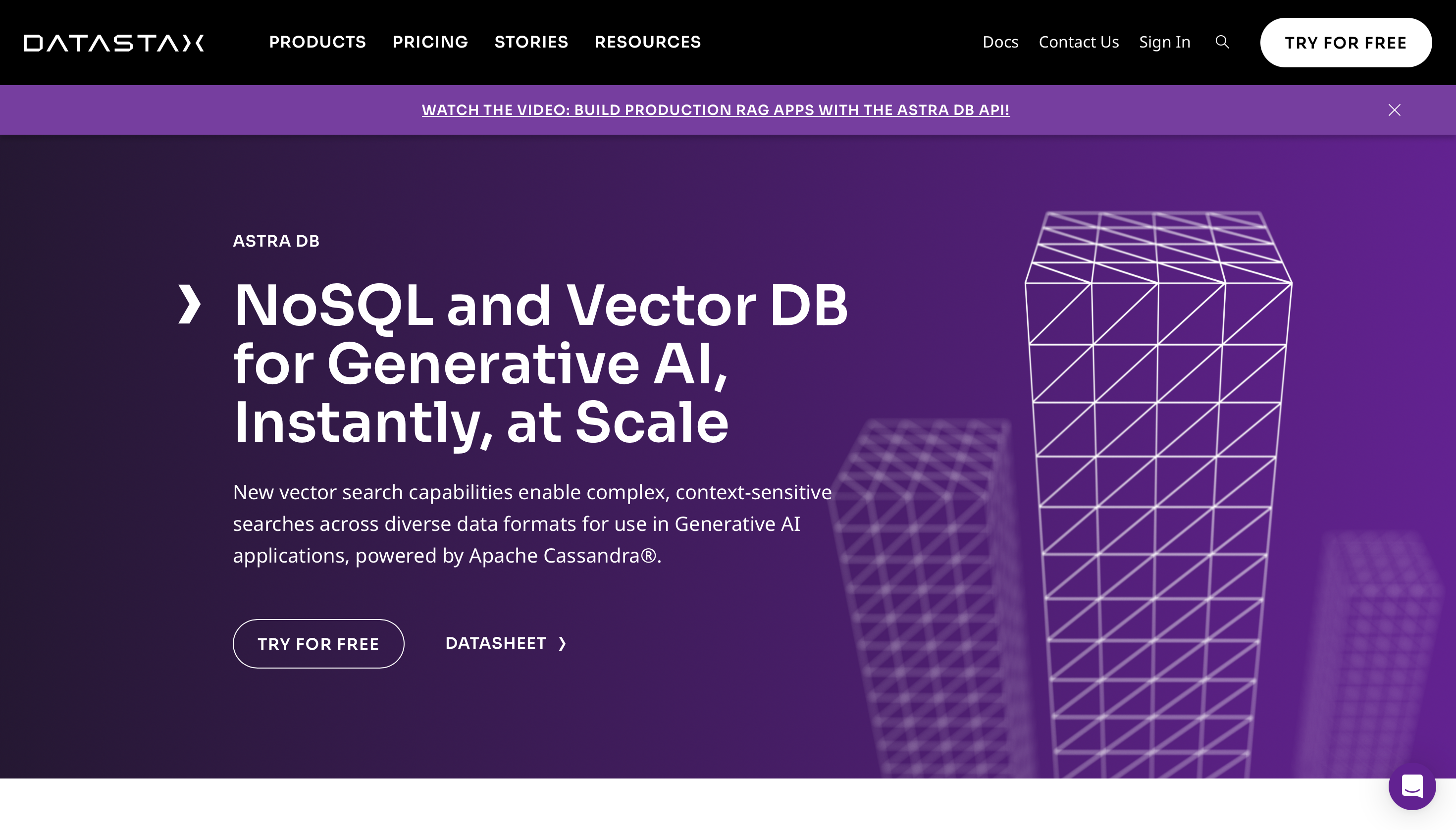

8. Astra

Binabago ng mga superyor na kakayahan sa paghahanap ng vector ng AstraDB at walang server na arkitektura ang mga generative AI application.

Ang AstraDB ay isang mahusay na opsyon para sa pamamahala ng masalimuot, sensitibo sa konteksto na mga paghahanap sa iba't ibang uri ng data dahil ito ay binuo sa matatag na pundasyon ng Apache Cassandra at walang putol na pinagsasama ang scalability, katatagan, at pagganap.

Ang kapasidad ng AstraDB na pangasiwaan ang magkakaibang mga workload, kabilang ang streaming, non-vector, at vector data, habang pinapanatili ang napakababang latency para sa sabay-sabay na query at mga operasyon sa pag-update, ay isa sa mga pinakakilalang bentahe nito.

Ang kakayahang umangkop na ito ay mahalaga para sa mga generative na AI application, na nangangailangan ng streaming at real-time na pagpoproseso ng data upang makapagbigay ng tumpak at konteksto na mga tugon ng AI.

Ang walang server na solusyon mula sa AstraDB ay ginagawang mas madali ang pag-unlad, na nagpapalaya sa mga developer na tumutok sa paglikha ng mga makabagong AI application sa halip na pamahalaan ang backend na imprastraktura.

Mula sa quickstart na gabay hanggang sa malalim na mga aralin sa paglikha ng mga chatbot at mga sistema ng rekomendasyon, binibigyang-daan ng AstraDB ang mga developer na mabilis na maisakatuparan ang kanilang mga ideya sa AI sa pamamagitan ng mga maaasahang API at maayos na interface na may mga kilalang tool at platform.

Dapat unahin ng mga enterprise-grade generative AI system ang seguridad at pagsunod, at ang AstraDB ay naghahatid sa parehong larangan.

Ang malalim na corporate security feature at compliance certification ay ibinibigay nito, na ginagarantiyahan na ang mga AI application na binuo sa AstraDB ay sumusunod sa pinakamahigpit na privacy at mga alituntunin sa proteksyon ng data.

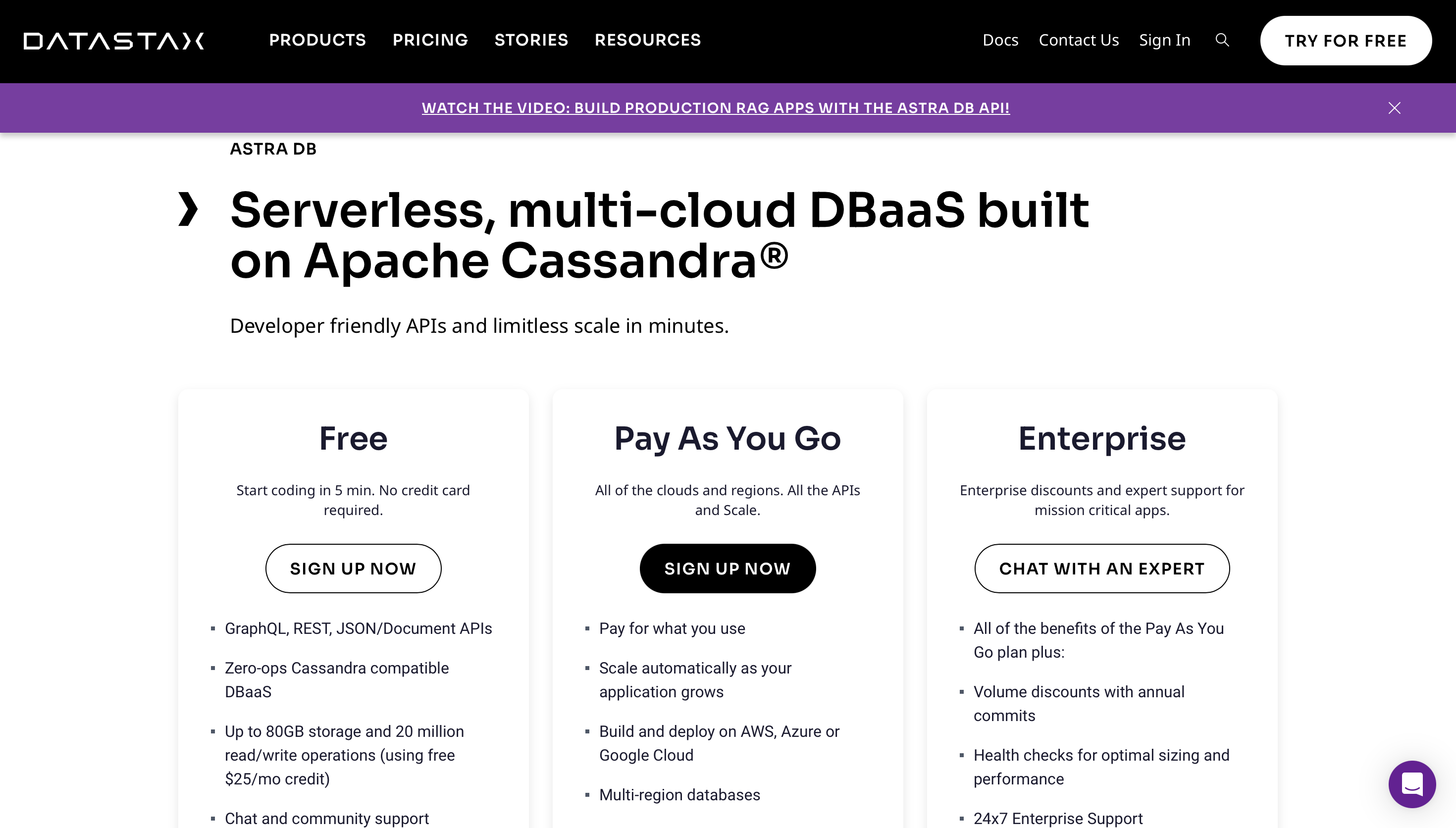

pagpepresyo

Maaari mong simulang gamitin ito nang libre at nag-aalok ito ng modelong pay-as-you-go.

9. Opensearch

Lumilitaw ang OpenSearch bilang isang nakakaakit na opsyon para sa mga nag-e-explore ng mga vector database, partikular para sa pagbuo ng mga adaptable, scalable, at future-proof na AI system.

Ang OpenSearch ay isang all-inclusive, open-source na vector database na pinagsasama ang kapangyarihan ng analytics, sopistikadong vector search, at conventional search sa isang cohesive system.

Sa pamamagitan ng paggamit ng mga modelo ng pag-embed ng machine learning upang i-encode ang kahulugan at konteksto ng maraming form ng data—mga dokumento, larawan, at audio—sa mga vector para sa mga paghahanap ng pagkakatulad, ang pagsasamang ito ay partikular na nakakatulong para sa mga developer na gustong isama ang semantic na pag-unawa sa kanilang mga app sa paghahanap.

Bagama't maraming maiaalok ang OpenSearch, mahalagang tandaan na kumpara sa Elasticsearch, nagkaroon ng mas kaunting mga pagbabago sa code, lalo na sa mga kritikal na module tulad ng mga scripting language at ingestion pipeline processor.

Ang Elasticsearch ay maaaring magkaroon ng mas sopistikadong mga kakayahan dahil sa mas mataas na pagsisikap sa pag-develop, na humahantong sa mga pagkakaiba sa pagganap, hanay ng tampok, at mga update sa pagitan ng dalawa.

Ang OpenSearch ay binabayaran ng isang malaking komunidad na sumusunod at isang dedikasyon sa open-source na mga ideya, na nagreresulta sa isang bukas at madaling ibagay na platform.

Sinusuportahan nito ang isang malawak na hanay ng mga application na lampas sa paghahanap at analytics, tulad ng observability at security analytics, na ginagawa itong isang flexible na tool para sa data-intensive na mga gawain.

Tinitiyak ng diskarte na hinimok ng komunidad ang mga patuloy na pagpapahusay at pagsasama upang mapanatiling napapanahon at kakaiba ang platform.

pagpepresyo

Maaari mong simulan ang paggamit nito nang libre.

10. Azure AI Search

Ang Azure AI Search ay isang malakas na platform na nagpapahusay sa mga kakayahan sa paghahanap sa loob ng mga generative AI application.

Namumukod-tangi ito dahil sinusuportahan nito ang paghahanap ng vector, isang mekanismo para sa pag-index, pag-iimbak, at pagkuha ng mga pag-embed ng vector sa loob ng isang index ng paghahanap.

Nakakatulong ang feature na ito na tumuklas ng mga maihahambing na dokumento sa vector space, na nagreresulta sa mga resulta ng paghahanap na may kaugnayan sa konteksto.

Ang Azure AI Search ay nakikilala sa pamamagitan ng suporta nito para sa mga hybrid na sitwasyon, kung saan ang mga paghahanap sa vector at keyword ay isinasagawa nang sabay-sabay, na nagreresulta sa isang pinag-isang hanay ng resulta na madalas na nangunguna sa kahusayan ng bawat diskarteng ginagamit nang mag-isa.

Ang kumbinasyon ng vector at non-vector na materyal sa parehong index ay nagbibigay-daan para sa isang mas kumpleto at flexible na karanasan sa paghahanap.

Ang feature na vector search sa Azure AI Search ay malawak na naa-access at walang bayad para sa lahat ng Azure AI Search tier.

Ito ay lubos na nababaluktot para sa isang hanay ng mga kaso ng paggamit at mga kagustuhan sa pag-unlad dahil sa suporta nito para sa ilang mga kapaligiran sa pag-unlad, na ibinibigay sa pamamagitan ng Azure site, REST API, at mga SDK para sa Python, JavaScript, at.NET, bukod sa iba pa.

Sa malalim na pagsasama nito sa Azure AI ecosystem, ang Azure AI Search ay nag-aalok ng higit pa sa paghahanap; pinapahusay din nito ang potensyal ng ecosystem para sa mga generative AI application.

Ang Azure OpenAI Studio para sa pag-embed ng modelo at Azure AI Services para sa pagkuha ng larawan ay dalawang halimbawa lamang ng mga serbisyong kasama sa pagsasamang ito.

Ang Azure AI Search ay isang flexible na solusyon para sa mga developer na nagnanais na isama ang mga sopistikadong function ng paghahanap sa kanilang mga application dahil sa malawak na suporta nito, na nagbibigay-daan sa malawak na hanay ng mga application, mula sa paghahanap ng pagkakatulad at paghahanap sa multimodal hanggang sa hybrid na paghahanap at paghahanap sa multilingual.

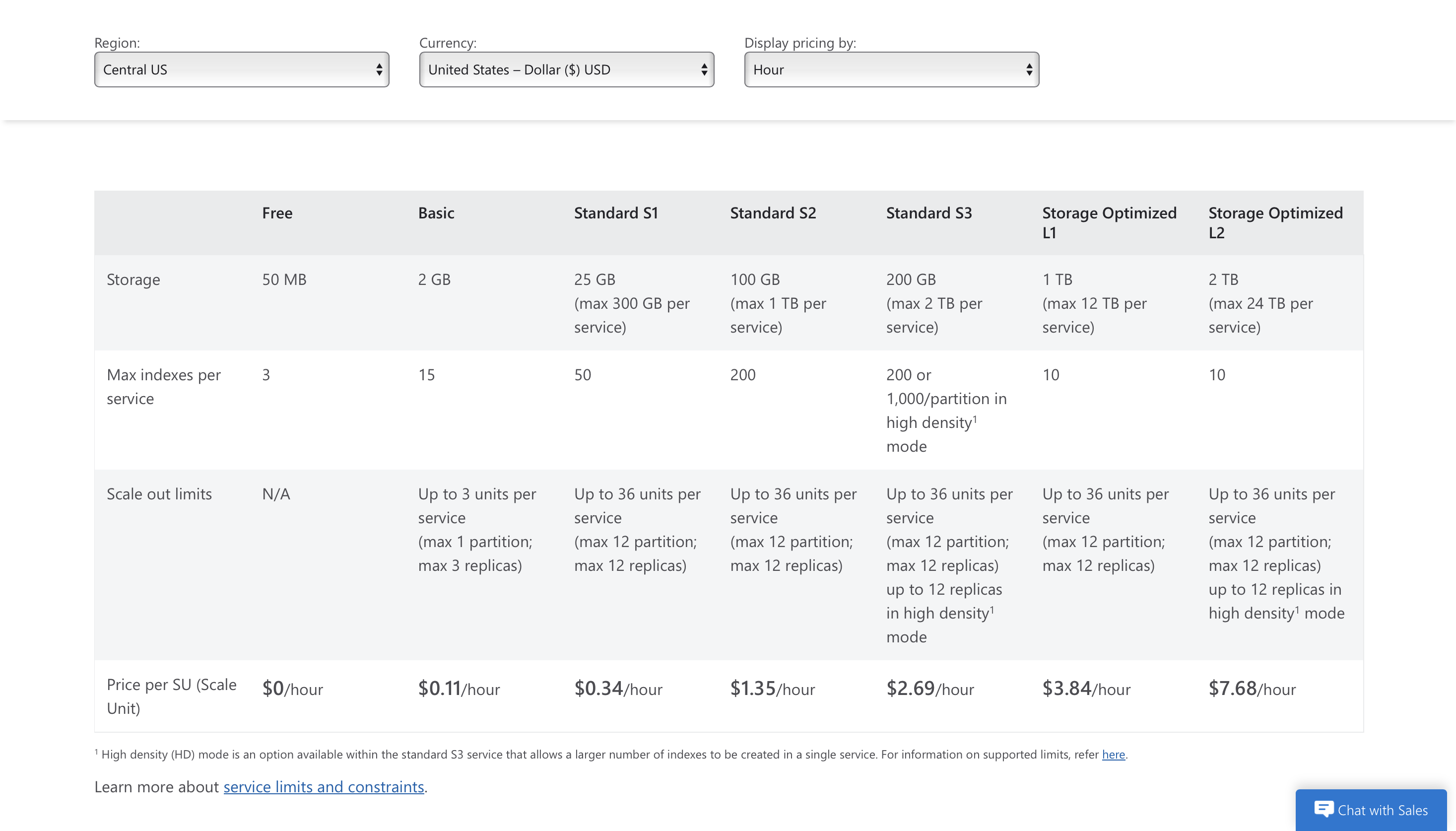

pagpepresyo

Maaari mong simulang gamitin ito nang libre at ang premium na pagpepresyo ay magsisimula sa $0.11/oras.

Konklusyon

Binabago ng mga vector database ang pamamahala ng data sa AI sa pamamagitan ng pamamahala ng mga high-dimensional na vector, na nagbibigay-daan para sa matinding paghahanap ng pagkakatulad at mabilis na mga query sa pinakamalapit na kapitbahay sa mga application gaya ng mga system ng rekomendasyon at pagtuklas ng panloloko.

Sa paggamit ng mga sopistikadong algorithm sa pag-index, ang mga database na ito ay nagko-convert ng kumplikadong hindi nakaayos na data sa mga makabuluhang vector habang nagbibigay ng bilis at kakayahang umangkop na hindi ginagawa ng mga tradisyonal na database.

Kabilang sa mga kapansin-pansing platform ang Pinecone, na kumikinang sa mga generative AI application; FAISS, nilikha ng Facebook AI para sa siksik na vector clustering; at Milvus, na kilala sa scalability at cloud-native na arkitektura nito.

Pinagsasama ng Weaviate ang machine learning sa context-aware na paghahanap, samantalang ang Vespa at Chroma ay kapansin-pansin para sa kanilang mga low-latency na kakayahan sa computing at kadalian ng paggamit, ayon sa pagkakabanggit.

Ang mga database ng vector ay mahahalagang tool para sa pagbuo ng mga teknolohiya ng AI at machine learning dahil ang mga platform tulad ng Qdrant, AstraDB, OpenSearch, at Azure AI Search ay nagbibigay ng iba't ibang serbisyo mula sa mga walang server na arkitektura hanggang sa malawak na kakayahan sa paghahanap at analytics.

Mag-iwan ng Sagot