Gumugugol kami ng maraming oras sa pakikipag-ugnayan sa mga tao online sa pamamagitan ng chat, email, website, at social media.

Ang napakalaking dami ng data ng text na ginagawa namin bawat segundo ay nakakatakas sa aming pansin, ngunit, hindi palaging.

Ang mga aksyon at pagsusuri ng mga customer ay nagbibigay sa mga organisasyon ng hindi mabibiling impormasyon tungkol sa kung ano ang pinahahalagahan at hindi sinasang-ayunan ng mga customer sa mga produkto at serbisyo, pati na rin kung ano ang gusto nila mula sa isang brand.

Gayunpaman, ang karamihan sa mga negosyo ay nahihirapan pa ring matukoy ang pinakaepektibong paraan para sa pagsusuri ng data.

Dahil ang karamihan sa data ay hindi nakaayos, ang mga computer ay nahihirapang unawain ito, at ang manu-manong pag-uuri nito ay magiging lubhang nakakaubos ng oras.

Ang pagpoproseso ng maraming data sa pamamagitan ng kamay ay nagiging matrabaho, monotonous, at simpleng hindi nasusukat habang lumalawak ang isang kumpanya.

Sa kabutihang palad, matutulungan ka ng Natural Language Processing sa paghahanap ng insightful na impormasyon sa hindi nakabalangkas na teksto at paglutas ng isang hanay ng mga isyu sa pagsusuri ng teksto, kabilang ang damdamin pagsusuri, pagkakategorya ng paksa, at higit pa.

Ang gawing naiintindihan ng mga makina ang wika ng tao ay ang layunin ng larangan ng artificial intelligence ng natural language processing (NLP), na gumagamit ng linguistics at computer science.

Binibigyang-daan ng NLP ang mga computer na awtomatikong suriin ang napakalaking dami ng data, na ginagawang posible para sa iyo na mabilis na matukoy ang nauugnay na impormasyon.

Ang hindi nakabalangkas na teksto (o iba pang mga uri ng natural na wika) ay maaaring gamitin sa isang hanay ng mga teknolohiya upang tumuklas ng insightful na impormasyon at matugunan ang ilang mga isyu.

Bagama't hindi komprehensibo, ang listahan ng mga open-source na tool na ipinakita sa ibaba ay isang magandang lugar upang magsimula para sa sinuman o anumang organisasyon na interesado sa paggamit ng natural na pagpoproseso ng wika sa kanilang mga proyekto.

1. NLTK

Maaaring magtaltalan ang isang tao na ang Natural Language Toolkit (NLTK) ay ang pinaka-mayaman sa tampok na tool na tiningnan ko.

Halos lahat ng mga diskarte sa NLP ay ipinatupad, kabilang ang pagkakategorya, tokenization, stemming, pag-tag, pag-parse, at semantic na pangangatwiran.

Maaari mong piliin ang tumpak na algorithm o diskarte na gusto mong gamitin dahil madalas mayroong ilang mga pagpapatupad na magagamit para sa bawat isa.

Maraming wika ang sinusuportahan din. Bagama't ito ay mabuti para sa mga simpleng istruktura, ang katotohanang kinakatawan nito ang lahat ng data bilang mga string ay nagpapahirap sa paglalapat ng ilang mga sopistikadong kakayahan.

Kung ikukumpara sa ibang gamit, medyo matamlay din ang library.

Lahat ng bagay na isinasaalang-alang, ito ay isang mahusay na toolset para sa eksperimento, paggalugad, at mga application na nangangailangan ng isang tiyak na halo ng mga algorithm.

Mga kalamangan

- Ito ang pinakasikat at kumpletong library ng NLP na may ilang ikatlong karagdagan.

- Kung ihahambing sa ibang mga aklatan, sinusuportahan nito ang karamihan sa mga wika.

Kahinaan

- mahirap intindihin at gamitin

- Ito ay mabagal

- walang mga modelo ng neural network

- Hinahati lamang nito ang teksto sa mga pangungusap nang hindi isinasaalang-alang ang semantika

2. spacy

Ang SpaCy ay ang pinaka-malamang na nangungunang karibal ng NLTK. Bagama't mayroon lamang itong isang pagpapatupad para sa bawat bahagi ng NLP, sa pangkalahatan ay mas mabilis ito.

Bilang karagdagan, ang lahat ay kinakatawan bilang isang bagay sa halip na isang string, na nagpapasimple sa interface para sa pagbuo ng mga app.

Ang pagkakaroon ng mas malalim na pagkaunawa sa iyong data ng text ay magbibigay-daan sa iyong makamit ang higit pa.

Ginagawa rin nitong mas madali para dito na kumonekta sa ilang iba pang mga framework at mga tool sa data science. Ngunit kumpara sa NLTK, hindi sinusuportahan ng SpaCy ang maraming wika.

Nagtatampok ito ng maraming neural na modelo para sa iba't ibang aspeto ng pagpoproseso at pagsusuri ng wika, pati na rin ang isang tapat na user interface na may condensed na hanay ng mga opsyon at mahusay na dokumentasyon.

Bilang karagdagan, ang SpaCy ay binuo upang mapaunlakan ang malaking halaga ng data at lubos na naidokumento.

Kasama rin dito ang napakaraming modelo para sa natural na pagpoproseso ng wika na nasanay na, na ginagawang mas madaling matuto, magturo, at gumamit ng natural na pagpoproseso ng wika sa SpaCy.

Sa pangkalahatan, ito ay isang mahusay na tool para sa mga bagong app na hindi nangangailangan ng isang partikular na paraan at kailangang gumanap sa produksyon.

Mga kalamangan

- Kung ikukumpara sa ibang bagay, ito ay mabilis.

- Ang pag-aaral at paggamit nito ay simple.

- ang mga modelo ay sinanay gamit ang mga neural network

Kahinaan

- mas kaunting kakayahang umangkop kumpara sa NLTK

3. Gensim

Ang pinaka-epektibo at madaling paraan upang ipahayag ang mga dokumento bilang mga semantic vector ay nakakamit sa pamamagitan ng paggamit ng espesyal na open-source na Python framework na kilala bilang Gensim.

Ang Gensim ay nilikha ng mga may-akda upang pangasiwaan ang hilaw, hindi nakaayos na plain text gamit ang isang hanay ng machine learning paraan; kaya, isang matalinong ideya na gamitin ang Gensim upang harapin ang mga trabaho tulad ng Pagmomodelo ng Paksa.

Bukod pa rito, epektibong nahahanap ng Gensim ang mga pagkakatulad sa teksto, ini-index ang nilalaman, at nagna-navigate sa pagitan ng mga natatanging teksto.

Ito ay isang highly specialized Python library tumutuon sa mga gawain sa pagmomodelo ng paksa na gumagamit ng Latent Dirichlet Allocation at iba pang LDA) na pamamaraan.

Bilang karagdagan, ito ay lubos na mahusay sa paghahanap ng mga teksto na katulad ng isa't isa, pag-index ng mga teksto, at pag-navigate sa mga papel.

Ang tool na ito ay humahawak ng napakalaking dami ng data nang mahusay at mabilis. Narito ang ilang panimulang tutorial.

Mga kalamangan

- simpleng user interface

- mahusay na paggamit ng mga kilalang algorithm

- Sa isang pangkat ng mga computer, maaari itong gumawa ng latent Dirichlet allocation at latent semantic analysis.

Kahinaan

- Ito ay kadalasang nilayon para sa hindi pinangangasiwaang pagmomodelo ng teksto.

- Wala itong kumpletong pipeline ng NLP at dapat itong gamitin kasama ng iba pang mga library tulad ng Spacy o NLTK.

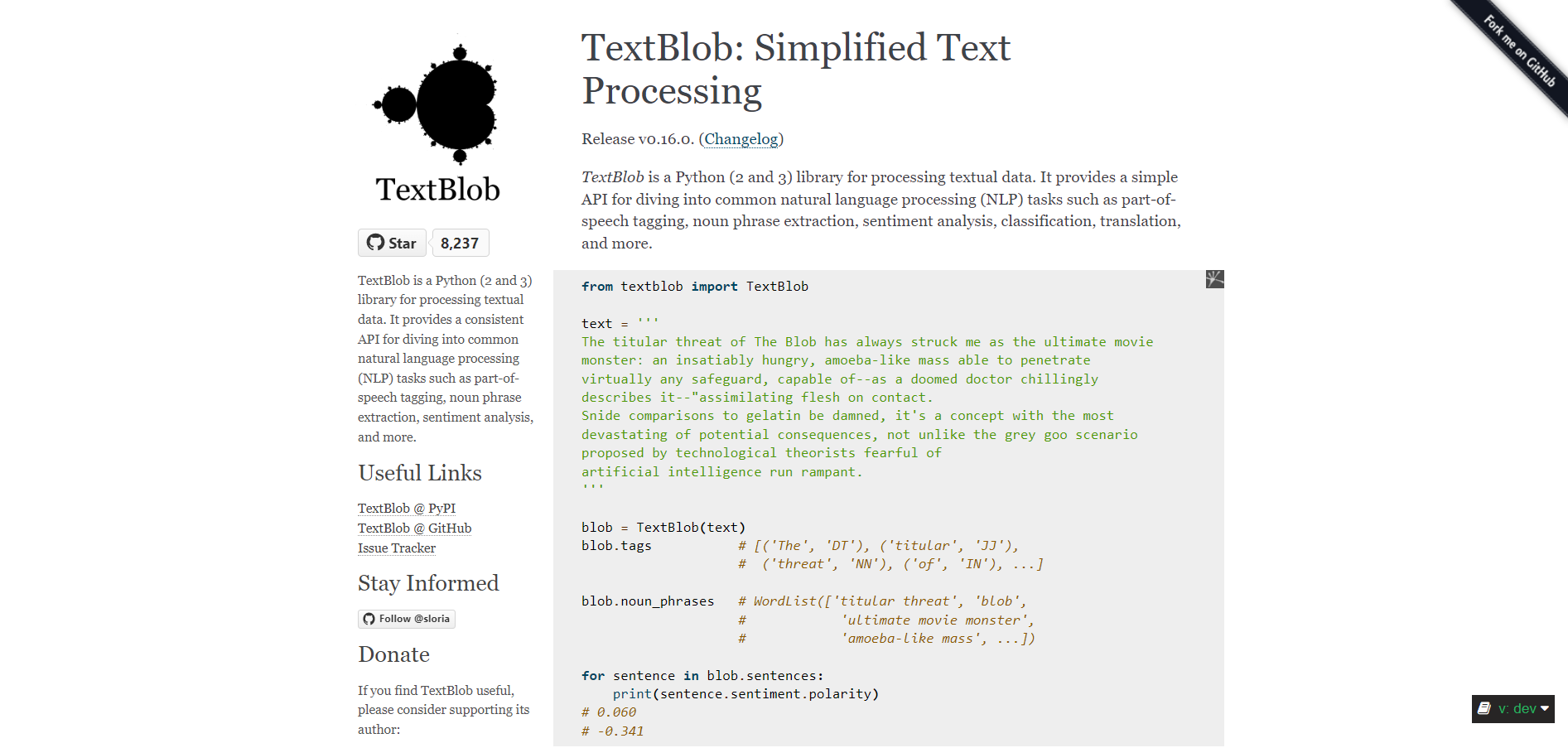

4. TextBlob

Ang TextBlob ay isang uri ng extension ng NLTK.

Sa pamamagitan ng TextBlob, mas madali mong ma-access ang maraming function ng NLTK, at isinasama rin ng TextBlob ang mga kakayahan sa library ng Pattern.

Ito ay maaaring maging isang kapaki-pakinabang na tool na gagamitin habang nag-aaral kung nagsisimula ka pa lang, at maaari itong magamit sa produksyon para sa mga application na hindi nangangailangan ng maraming pagganap.

Nag-aalok ito ng mas madaling gamitin at direktang interface para sa pagsasagawa ng parehong mga function ng NLP.

Ito ay isang mahusay na opsyon para sa mga baguhan na gustong gumawa ng mga gawain sa NLP tulad ng pagsusuri ng damdamin, pagkategorya ng teksto, at part-of-speech tagging dahil mas mababa ang curve ng pagkatuto nito kaysa sa iba pang mga open-source na tool.

Ang TextBlob ay malawakang ginagamit at mahusay para sa mas maliliit na proyekto sa pangkalahatan.

Mga kalamangan

- Simple at malinaw ang user interface ng library.

- Nag-aalok ito ng mga serbisyo sa pagkilala sa wika at pagsasalin gamit ang Google Translate.

Kahinaan

- Kung ikukumpara sa iba, ito ay mabagal.

- Walang mga modelo ng mga neural network

- Walang pinagsamang mga vector ng salita

5. OpenNLP

Ito ay simple upang isama ang OpenNLP sa iba pang mga proyekto ng Apache tulad ng Apache Flink, Apache NiFi, at Apache Spark dahil ito ay hino-host ng Apache Foundation.

Ito ay isang komprehensibong NLP tool na maaaring magamit mula sa command line o bilang isang library sa isang application.

Kabilang dito ang lahat ng mga karaniwang bahagi ng pagproseso ng NLP.

Bukod pa rito, nag-aalok ito ng malawak na suporta sa wika. Kung gumagamit ka ng Java, ang OpenNLP ay isang malakas na tool na may isang tonelada ng mga kakayahan na inihanda para sa mga workload sa produksyon.

Bilang karagdagan sa pagpapagana sa mga pinakakaraniwang gawain ng NLP, tulad ng tokenization, segmentation ng pangungusap, at part-of-speech tagging, maaaring gamitin ang OpenNLP upang lumikha ng mas kumplikadong mga application sa pagpoproseso ng teksto.

Kasama rin ang maximum entropy at perceptron-based machine learning.

Mga kalamangan

- Isang tool sa pagsasanay ng modelo na may ilang mga tampok

- Nakatuon sa mga pangunahing gawain sa NLP at nangunguna sa mga ito, kabilang ang pagkakakilanlan ng entity, pagtuklas ng parirala, at tokenization.

Kahinaan

- walang mga sopistikadong kakayahan; kung gusto mong magpatuloy sa JVM, ang paglipat sa CoreNLP ay ang susunod na natural na hakbang.

6. AllenNLP

Ang AllenNLP ay perpekto para sa mga komersyal na aplikasyon at pagsusuri ng data dahil ito ay binuo sa mga tool at mapagkukunan ng PyTorch.

Ito ay bubuo sa isang malawak na tool para sa pagsusuri ng teksto.

Ginagawa nitong isa sa mga mas sopistikadong tool sa pagproseso ng natural na wika ng listahan. Habang naisasagawa ang iba pang mga gawain, ang AllenNLP ay paunang nagpoproseso ng data gamit ang libreng SpaCy open-source package.

Ang pangunahing selling point ng AllenNLP ay kung gaano kadali itong gamitin.

Pina-streamline ng AllenNLP ang natural na proseso ng pagpoproseso ng wika, kabaligtaran sa iba pang mga NLP program na may kasamang ilang module.

Bilang resulta, ang mga resulta ng output ay hindi kailanman nakalilito. Ito ay isang kamangha-manghang tool para sa mga walang gaanong kaalaman.

Mga kalamangan

- Binuo sa tuktok ng PyTorch

- mahusay para sa paggalugad at pag-eksperimento gamit ang mga makabagong modelo

- Maaari itong magamit kapwa sa komersyo at pang-akademiko

Kahinaan

- Hindi angkop para sa mga malalaking proyekto na kasalukuyang ginagawa.

Konklusyon

Gumagamit ang mga kumpanya ng mga diskarte sa NLP upang kunin ang mga insight mula sa hindi nakaayos na data ng text gaya ng mga email, online na pagsusuri, social media mga pag-post, at higit pa. Ang mga open-source na tool ay walang gastos, madaling ibagay, at nagbibigay sa mga developer ng kumpletong mga opsyon sa pag-customize.

Ano pa ang hinihintay mo? Gamitin ang mga ito kaagad at lumikha ng isang bagay na hindi kapani-paniwala.

Maligayang Coding!

Mag-iwan ng Sagot