Talaan ng nilalaman[Tago][Ipakita]

Malaki ang pangangailangan ng mga Cloud GPU habang lumalabas ang mga bagong teknolohiya tulad ng deep learning, AI, at machine learning.

Ang mga GPU (Graphics Processing Units) ay mga dalubhasang processor na ginawa upang pangasiwaan ang napakalaking set ng data at masalimuot na pag-compute na kailangan para sa mga aktibidad tulad ng computer graphics at gaming. Ang mga ito ay mahalaga ngayon para sa larangan ng artificial intelligence (AI) pati na rin, bagaman, sa huli.

Ang mga tradisyunal na CPU (Central Processing Units) ay hindi nakakatugon sa pangangailangan dahil ang mga modelo ng AI ay nangangailangan ng malaking halaga ng computing power upang sanayin at tumakbo.

Sa kabilang banda, dahil ang mga ito ay binuo upang suportahan ang parallel processing, ang mga GPU ay mas epektibo sa pamamahala sa napakalaking volume ng data at masalimuot na pagkalkula na kailangan para sa mga operasyon ng AI.

Kung ikaw ay nasa tech, malamang na narinig mo na ang tungkol sa mga serbisyo ng cloud GPU. Para sa mga hindi sumunod.

Ang isang cloud-based na serbisyo na nagbibigay sa mga user ng online na access sa makapangyarihang mga mapagkukunan ng GPU ay kilala bilang isang serbisyo ng cloud GPU para sa AI. Sa halip na kailanganing bumili at magpanatili ng kanilang sariling GPU hardware, ang mga serbisyong ito ay nagbibigay-daan sa mga customer na magrenta ng mga mapagkukunan ng GPU kung kinakailangan.

Ginagawa nitong posible para sa mga tao at organisasyon na gamitin ang kapasidad sa pagpoproseso ng mga GPU nang hindi kinakailangang gumawa ng isang malaking paunang pamumuhunan o magbayad ng patuloy na mga bayarin sa pagpapanatili.

Ang karamihan sa mga serbisyo ng cloud GPU para sa AI ay nagbibigay ng malawak na iba't ibang mga opsyon sa GPU, kabilang ang ilang mga modelo at configuration at ang kakayahang umangkop upang i-scale pataas o pababa kung kinakailangan. Maaari mo na ngayong piliin ang perpektong mapagkukunan ng GPU para sa kanilang mga natatanging pangangailangan at proyekto salamat sa serbisyong ito.

Bukod pa rito, ang mga serbisyo ay madalas na may kasamang iba pang mga kakayahan kabilang ang networking, storage, at software tool upang matulungan ang mga customer sa kanilang mga proyekto sa AI. Sa post na ito, titingnan natin ang mga nangungunang serbisyo ng cloud GPU para sa AI.

1. Linode

Nag-aalok ang Linode ng mga GPU on demand para sa mga workload tulad ng pagpoproseso ng video, scientific computing, machine learning, artificial intelligence, at iba pa.

Nagbibigay ito ng GPU-optimized virtual machine (VMs) na tumatakbo sa NVIDIA Quadro RTX 6000, Tensor, at RT cores at gumagamit ng kakayahan ng CUDA na gawin malalim na pag-aaral, ray tracing workload, at kumplikadong mga kalkulasyon.

Sa pamamagitan ng paggawa ng iyong capital expenditure sa isang operating expense, maaari mong gamitin ang kakayahan ng GPU ng Linode GPU at ang tunay na halaga ng cloud.

Bukod pa rito, pinapalaya ka ng Linode mula sa pag-aalala tungkol sa hardware upang makapag-concentrate ka sa iyong pinakamalakas na kakayahan.

Sa mga Linode GPU, posible na ngayong gamitin ang mga ito para sa mga sopistikadong application tulad ng video streaming, artificial intelligence, at machine learning.

Bilang karagdagan, depende sa dami ng kapangyarihan sa pagpoproseso na kinakailangan para sa mga inaasahang workload, maaari kang makatanggap ng hanggang 4 na card para sa bawat pagkakataon.

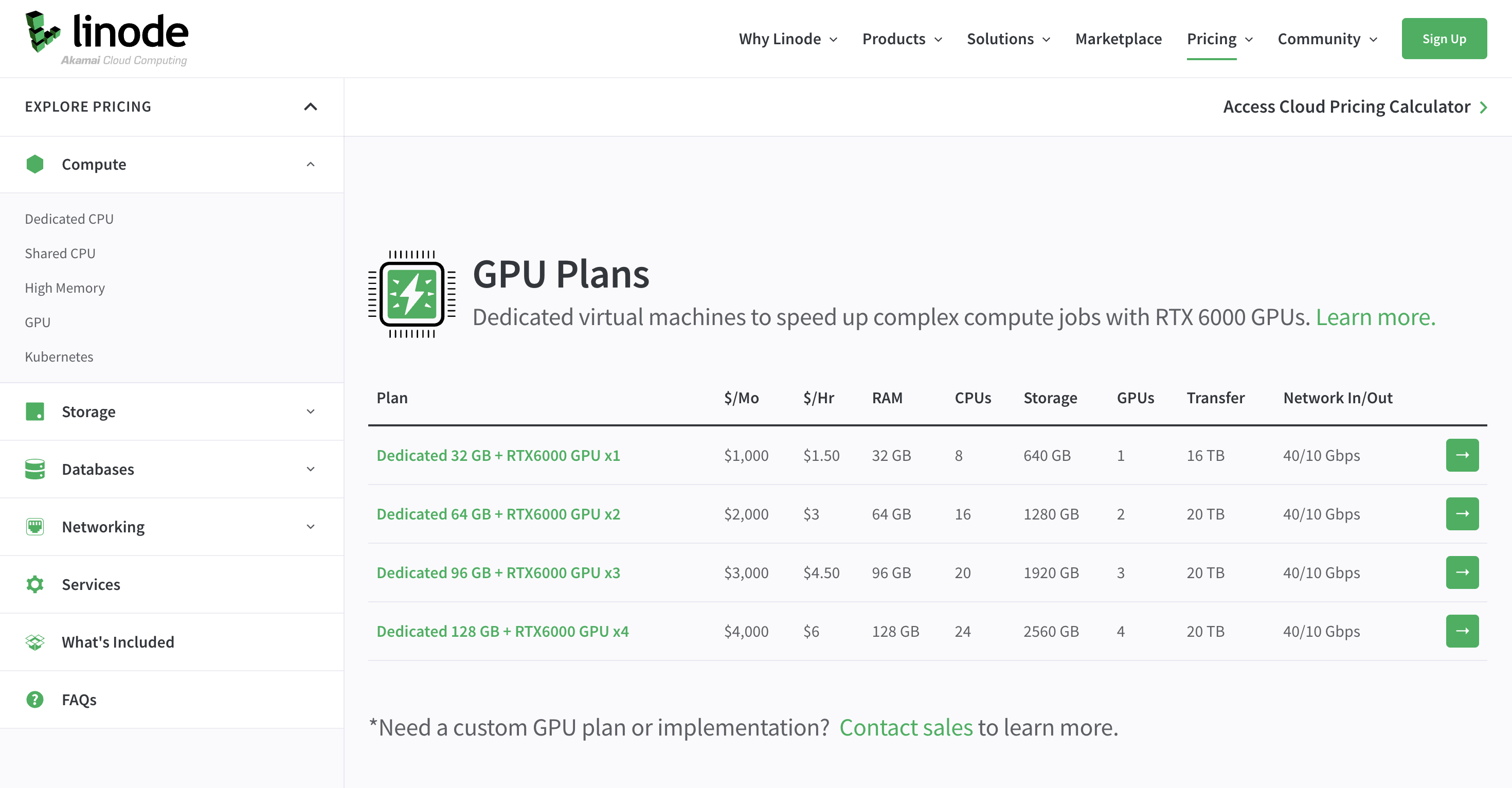

pagpepresyo

Ang pagpepresyo ay nagsisimula sa $1.5/oras para sa nakalaang RTX6000 GPU plan. Magsimula sa Linode nang libre.

2. Malawak na AI

Ang Vast AI ay isang pandaigdigang marketplace kung saan maaaring umarkila ang mga user ng mga murang GPU para magamit sa high-performance computing.

Binabawasan nila ang gastos ng mabibigat na gawain sa pagkalkula sa pamamagitan ng pagpapagana sa mga host na i-lease out ang kanilang GPU hardware, na nagbibigay-daan sa mga user na gamitin ang kanilang online na tool sa paghahanap upang mahanap ang mga pinakamurang presyo para sa pag-compute alinsunod sa kanilang mga pangangailangan at magsagawa ng mga command o maglunsad ng mga koneksyon sa SSH.

Nagbibigay ang mga ito ng mga instance ng SSH, mga instance ng Jupyter na may Jupyter GUI, o mga instance na command-only, at nagtatampok ng diretsong user interface.

Nagbibigay din ng deep learning performance function (DLPerf), na nagtataya ng tinantyang deep learning task performance.

Ang mga system na ginagamit ng Vast AI ay batay sa Ubuntu at hindi nag-aalok ng mga malalayong desktop. Nagpapatakbo din sila ng mga pagkakataon na available on demand para sa isang partikular na bayad na itinatag ng host.

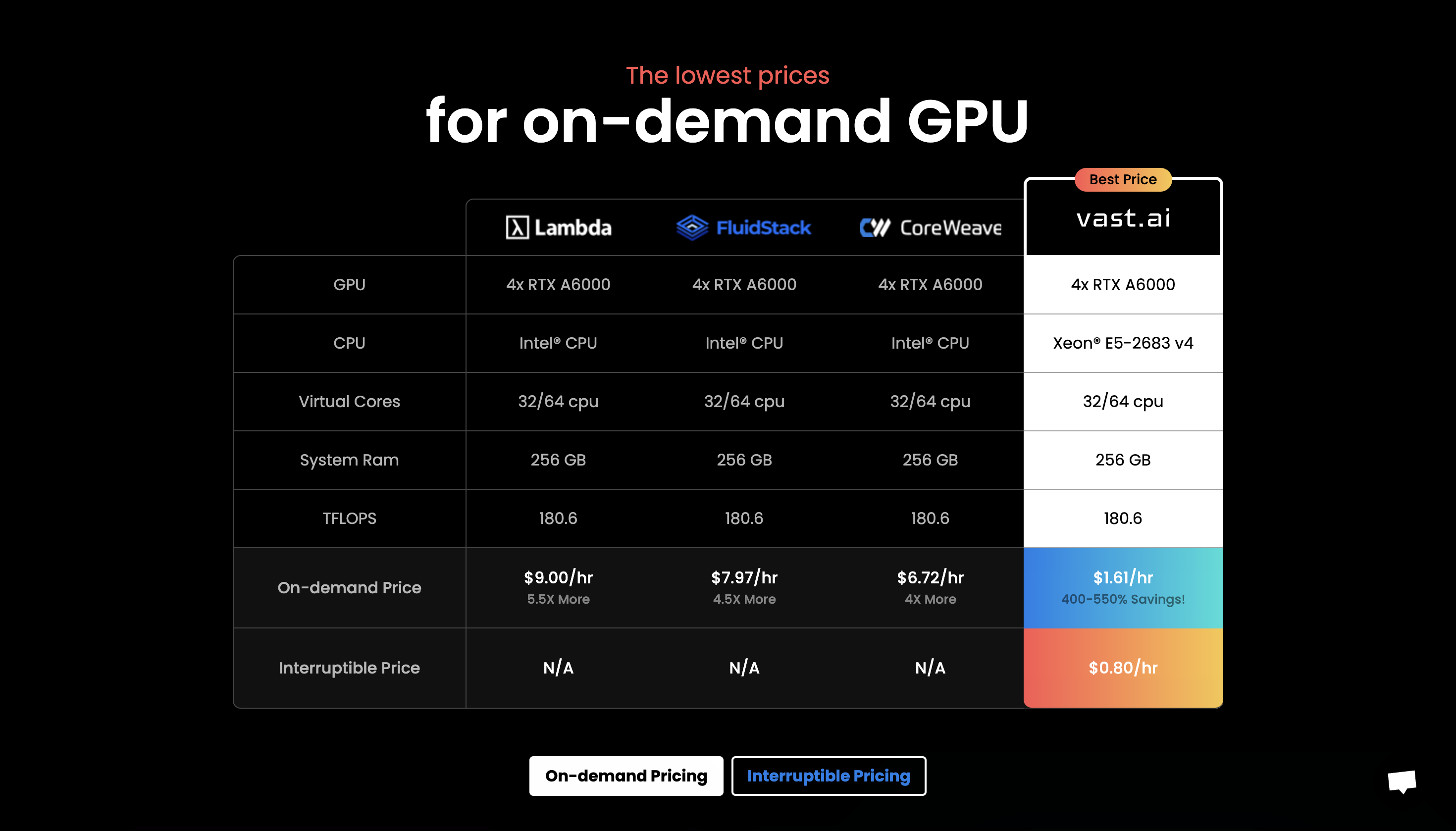

pagpepresyo

Nagsisimula ang pagpepresyo sa $0.80/oras para sa 4x RTX A6000.

3. AWS at NVIDIA

Magkasama, ang AWS at NVIDIA ay patuloy na naghahatid ng mga solusyong nakabatay sa GPU na abot-kaya, madaling ibagay, at makapangyarihan.

Kabilang dito ang mga instance at serbisyo ng Amazon EC2 na pinapagana ng NVIDIA GPU tulad ng AWS IoT Greengrass na nag-i-install gamit ang mga module ng NVIDIA Jetson Nano.

Para sa mga virtual na workstation, machine learning (ML), Internet of Things (IoT) na serbisyo, at high-performance computing, gumagamit ang mga user ng AWS at NVIDIA. Ang scalable na performance ay ibinibigay ng mga NVIDIA GPU na nagpapagana sa mga instance ng Amazon EC2.

Bukod pa rito, gamitin ang AWS IoT Greengrass para ikonekta ang NVIDIA-based edge device sa mga serbisyo ng AWS cloud.

Ang mga instance ng Amazon EC2 P4d ay pinapagana ng NVIDIA A100 Tensor Core GPUs, na nagbibigay ng pinakamababang latency networking at pinakamataas na throughput ng industriya.

Katulad nito, may iba pang iba't ibang pagkakataon na available para sa ilang partikular na sitwasyon, gaya ng Amazon EC2 P3, Amazon EC2 G4, atbp.

pagpepresyo

Maaari kang mag-aplay para sa isang libreng pagsubok at mangyaring makipag-ugnayan sa vendor para sa pagpepresyo nito.

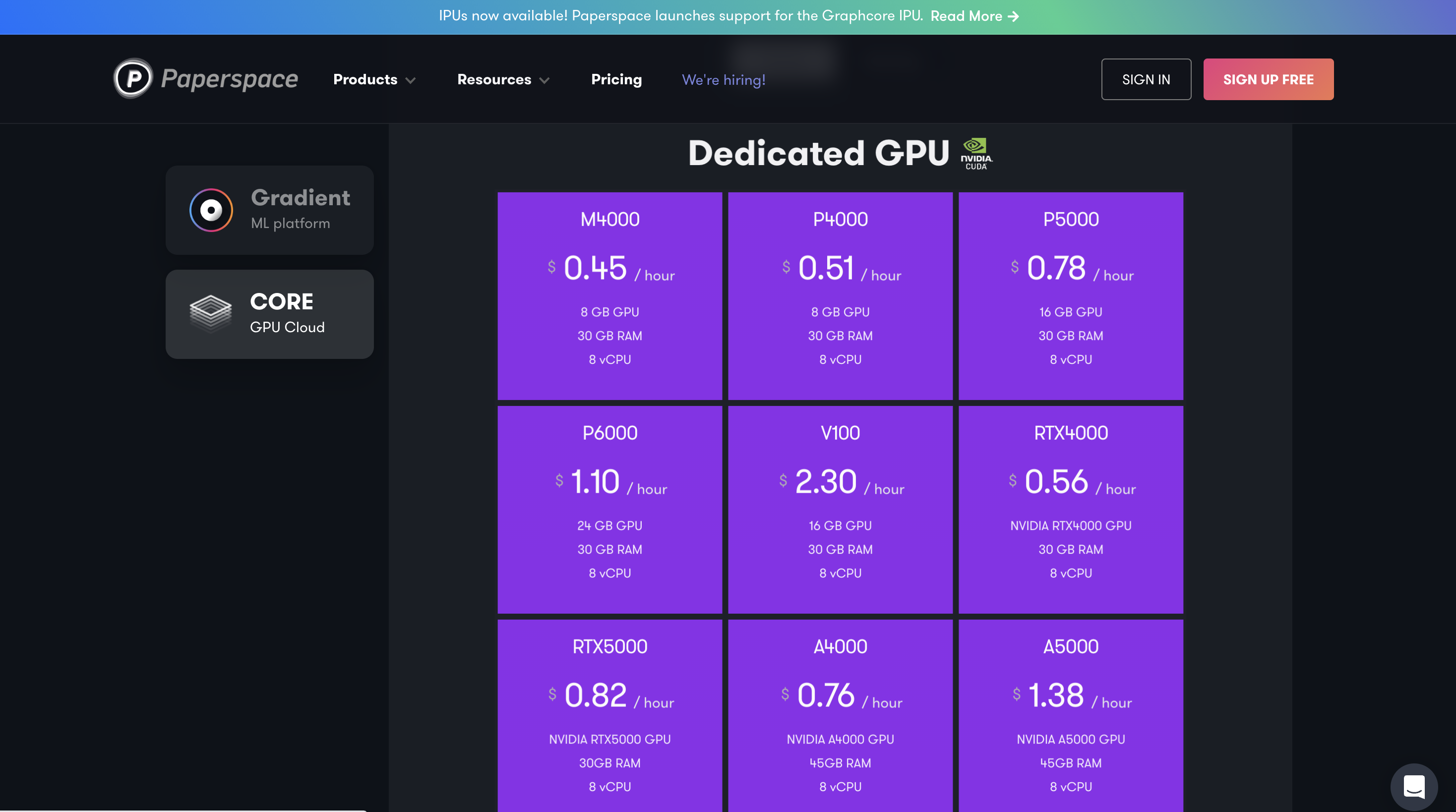

4. Paperspace CORE

Ang CORE ay isang ganap na pinamamahalaang cloud GPU platform na nilikha ng Paperspace na nagbibigay ng diretso, cost-effective, at pinabilis na computing para sa iba't ibang mga application.

Gamitin ang cutting-edge accelerated computing infrastructure na ibinigay ng Paperspace CORE para mapabilis ang mga proseso ng organisasyon. Para sa mabilis na onboarding, mga collaborative na tool, at desktop application para sa Mac, Linux, at Windows, nag-aalok ito ng user-friendly at hindi kumplikadong interface.

Gamitin ito upang magsagawa ng mga hinihinging programa sa isang walang katapusang halaga ng kapangyarihan sa pagpoproseso. Nag-aalok ang CORE ng napakabilis na network, mabilis na provisioning, suporta para sa mga 3D na app, at kumpletong API para sa programmatic na pag-access.

Gamit ang madaling gamitin at madaling gamitin na GUI, kumuha ng komprehensibong larawan ng iyong imprastraktura sa isang lokasyon.

Bukod pa rito, makakuha ng mahusay na kontrol salamat sa interface ng pangangasiwa ng CORE, na nag-aalok ng makapangyarihang mga tool at nagbibigay-daan sa iyong mag-filter, mag-uri-uriin, kumonekta, o lumikha ng mga machine, network, at user.

pagpepresyo

Nagsisimula ang pagpepresyo sa $0.45/oras para sa nakalaang M4000 GPU.

5. Serbisyo ng Alibaba Elastic GPU

Ginagamit ng Alibaba Elastic GPU Service (EGS) ang teknolohiya ng GPU para makapaghatid ng magkakatulad at makapangyarihang mga kakayahan sa pagproseso. Maraming mga application, kabilang ang pagpoproseso ng video, visualization, scientific computing, at malalim na pag-aaral, ay angkop para dito.

Gumagamit ang EGS ng ilang GPU, kabilang ang AMD FirePro S7150, NVIDIA Tesla M40, NVIDIA Tesla V100, NVIDIA Tesla P4, at NVIDIA Tesla P100.

Magkakaroon ka ng access sa mga pakinabang kabilang ang online malalim na pag-aaral ng mga serbisyo ng hinuha at pagsasanay, pagkilala sa content, pagkilala sa larawan at boses, HD media coding, video conferencing, source film restoration, at 4K/8K HD live.

Kumuha ng mga alternatibo tulad ng video rendering, computational finance, climate prediction, collision simulation, genetic engineering, non-linear na pag-edit, malayong mga application sa edukasyon, at disenyo ng engineering, pati na rin.

pagpepresyo

Nag-aalok ito ng libreng trial at pay-as-you-go na plano ng subscription, na nangangahulugang sa iyo lang kung anong mga pagkakataon o GPU ang ginagamit mo.

6. Genesis Cloud

Nag-aalok ang Genesis Cloud ng mataas na cost-effective na cloud GPU platform. Nagtatrabaho sila sa pakikipagtulungan sa ilang epektibong data center sa buong mundo upang magbigay ng malawak na iba't ibang mga application.

Nagbibigay ang Genesis Cloud ng malawak na hanay ng mga kapaki-pakinabang na feature nang walang karagdagang gastos, kabilang ang mga snapshot para sa pag-back up ng iyong trabaho, mga grupo ng seguridad para sa trapiko sa network, dami ng storage para sa malalaking set ng data, FastAI, PyTorch, mga preset na larawan, at pampublikong TensorFlow API.

Pinabilis nila ang pag-compute sa tulong ng mga teknolohiyang NVIDIA GeForce RTX 3090, RTX 3080, RTX 3060 Ti, at GTX 1080 Ti sa kanilang mga instance ng cloud GPU.

Maaari mong gamitin ang kapangyarihan ng GPU computing upang makagawa ng mga animated na pelikula o tren neural network.

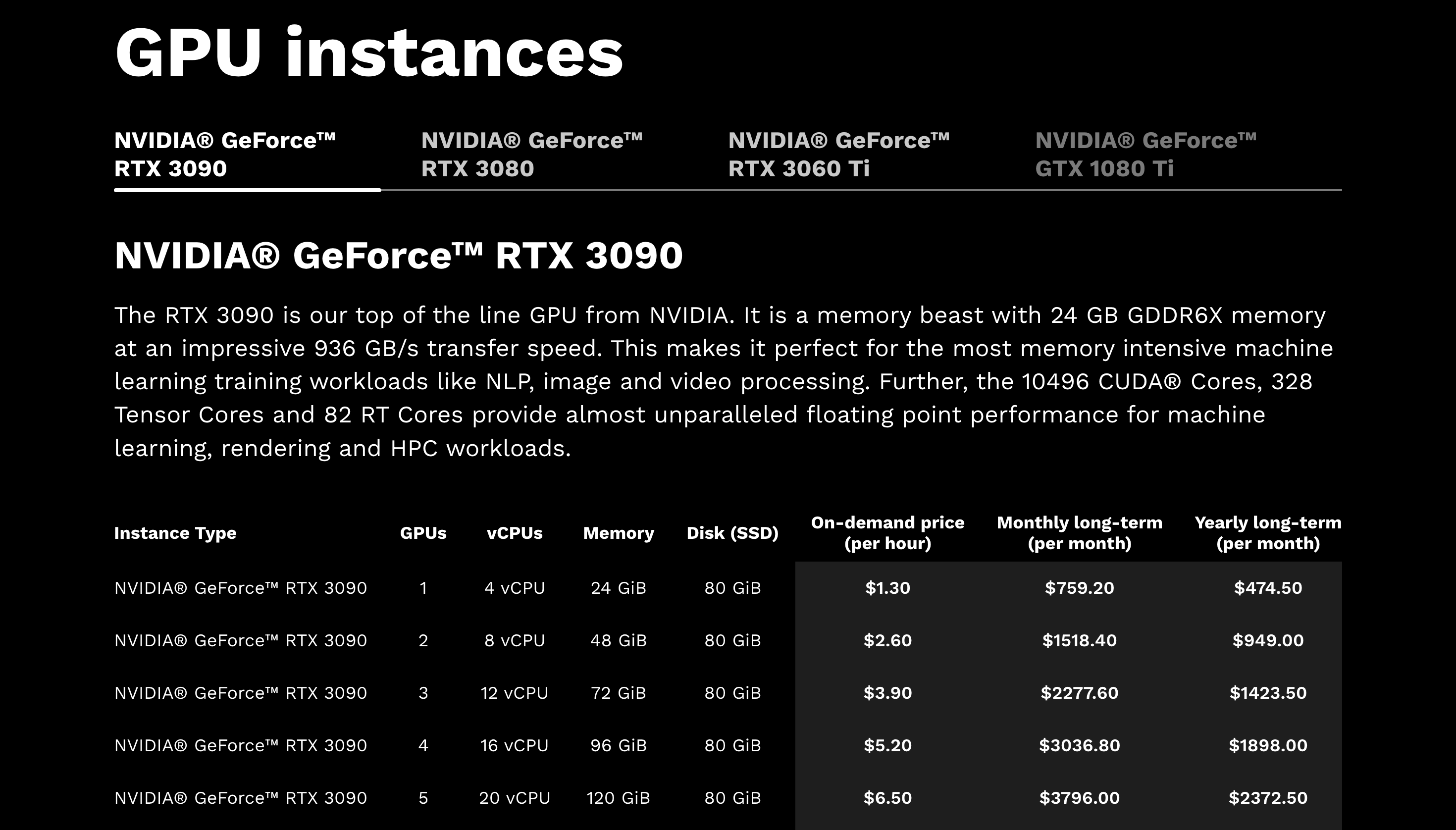

pagpepresyo

Nagsisimula ang pagpepresyo sa $1.30/oras para sa NVIDIA® GeForce™ RTX 3090.

7. Google Cloud GPU

Nag-aalok ang Google Cloud Platform (GCP) ng ilang instance ng GPU na magagamit para mapabilis ang mga proseso tulad ng machine learning, deep learning, at high-performance computing (HPC).

Sa pamamagitan ng mga GPU instance na ito, na sinusuportahan ng NVIDIA, AMD, at Intel GPUs, posibleng ma-access ang CUDA at cuDNN library, na kadalasang ginagamit para sa GPU-accelerated computing.

Dahil sa mga pagbabago sa makina, flexible na pagpepresyo, at malaking hanay ng mga posibilidad ng GPU, maaaring maging mas produktibo ang HPC.

Bukod pa rito, makakatulong ito sa iyo na mapagaan ang iyong trabaho. Kabilang sa mga GPU na ibinibigay nila ay ang NVIDIA K80, P4, V100, A100, T4, at P100. Maliit lang na bilang ng mga zone na nakakalat sa iba't ibang lugar ang may access sa mga GPU.

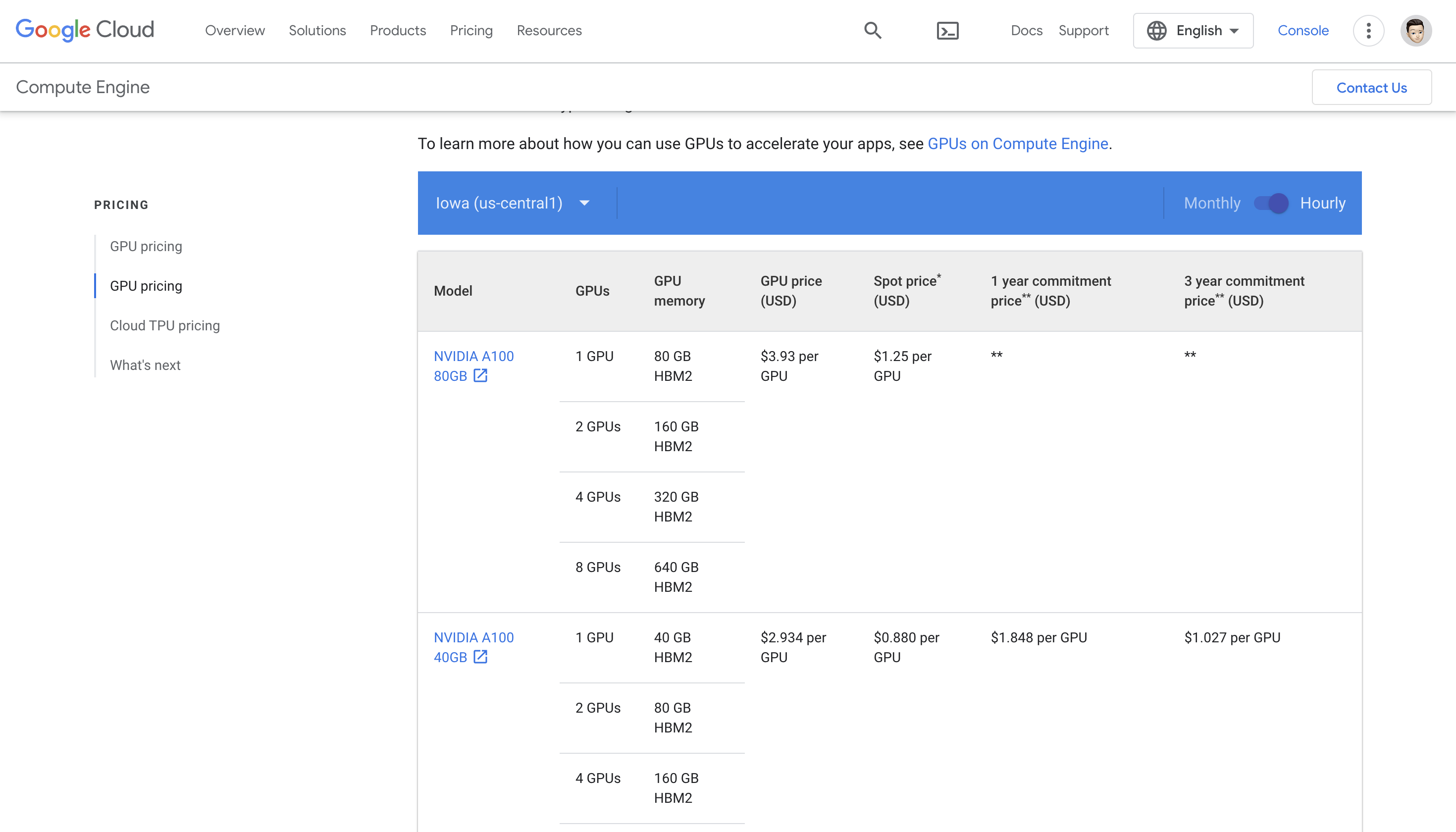

pagpepresyo

Mag-iiba-iba ang gastos batay sa rehiyon, sa GPU na pipiliin mo, at sa uri ng makina. Para sa NVIDIA A100, ang mga presyo ay nagsisimula sa $3.93 bawat GPU.

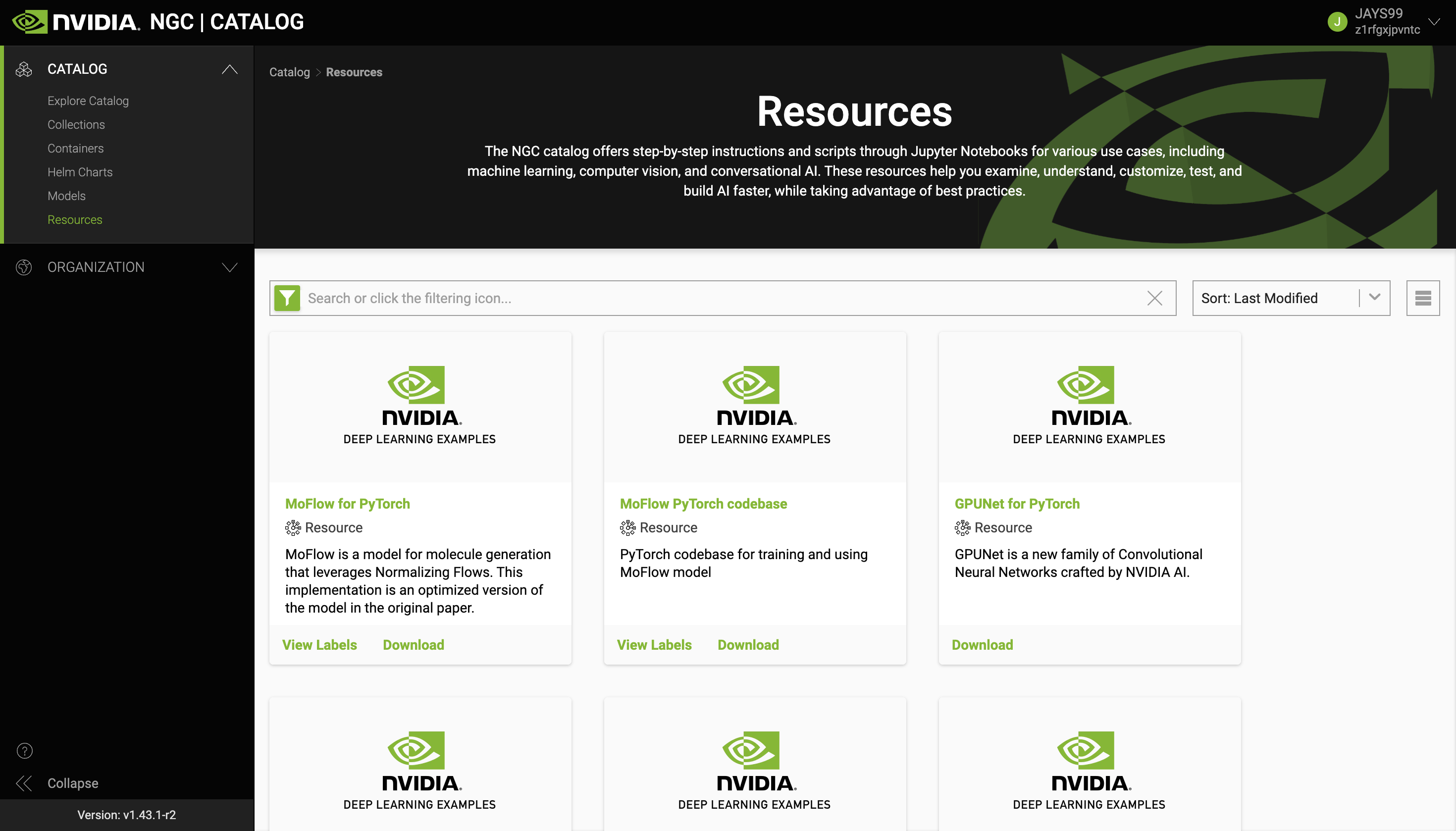

8. NVIDIA GPU Cloud

Ang NVIDIA GPU Cloud (NGC) ay isang cloud-based na platform na nagbibigay sa mga user ng access sa iba't ibang GPU-accelerated software, gaya ng visualization tools, HPC programs, at malalim na pag-aaral mga balangkas

Mga developer, data scientist, at madali na ngayong magagamit ng mga mananaliksik ang computing power ng NVIDIA GPUs sa cloud nang hindi na kailangang mag-alala tungkol sa imprastraktura o pangangalaga na kailangan para mapatakbo ang kanilang mga app salamat sa NGC.

Ang isang library ng mga paunang na-configure na lalagyan ng software ay kasama sa NGC at maaaring mabilis na i-deploy sa ilang mga cloud computing mga imprastraktura, kabilang ang Amazon Web Services, Google Cloud Platform, at Microsoft Azure.

Ang access sa NGC ay nagbibigay din sa mga user ng access sa deep learning platform ng NVIDIA, na kasama ng ilang mga programa at mapagkukunan para sa paglikha at pagpapatupad ng mga deep learning model, kabilang ang TensorRT, cuDNN, at CUDA-X AI.

pagpepresyo

Depende sa mga partikular na serbisyo at mapagkukunang ginagamit mo, nagbabago ang presyo ng NVIDIA GPU Cloud (NGC). Bagama't ang ilang serbisyo ng NGC, tulad ng deep learning software stack, ay malayang gamitin, ang iba, gaya ng mga HPC application container, ay maaaring maningil ng presyo. Mangyaring sumangguni sa katalogo ng NGC.

9. Lambda GPU Cloud

Ang Lambda ay nagbibigay ng cloud GPU instance para sa deep learning model training at scalability mula sa isang pisikal na computer hanggang sa maraming virtual machine.

Mula sa dashboard, agad na i-access ang dalubhasa ng bawat makina Jupiter Notebook kapaligiran sa programming. Para sa direktang pag-access, direktang gamitin ang SSH gamit ang isa sa mga SSH key o kumonekta sa pamamagitan ng Web Terminal sa cloud dashboard.

Ang maximum na 10 Gbps ng inter-node connectivity ay sinusuportahan ng bawat instance, na nagbibigay-daan para sa distributed na pagsasanay gamit ang mga frameworks tulad ng Horovod.

Ang pag-scale ng bilang ng mga GPU sa isa o ilang pagkakataon ay makakatulong na mapabilis ang pag-optimize ng modelo. Sinusuportahan ng platform ang mga instance ng GPU mula sa NVIDIA RTX 6000, Quadro RTX 6000, at Tesla V100s.

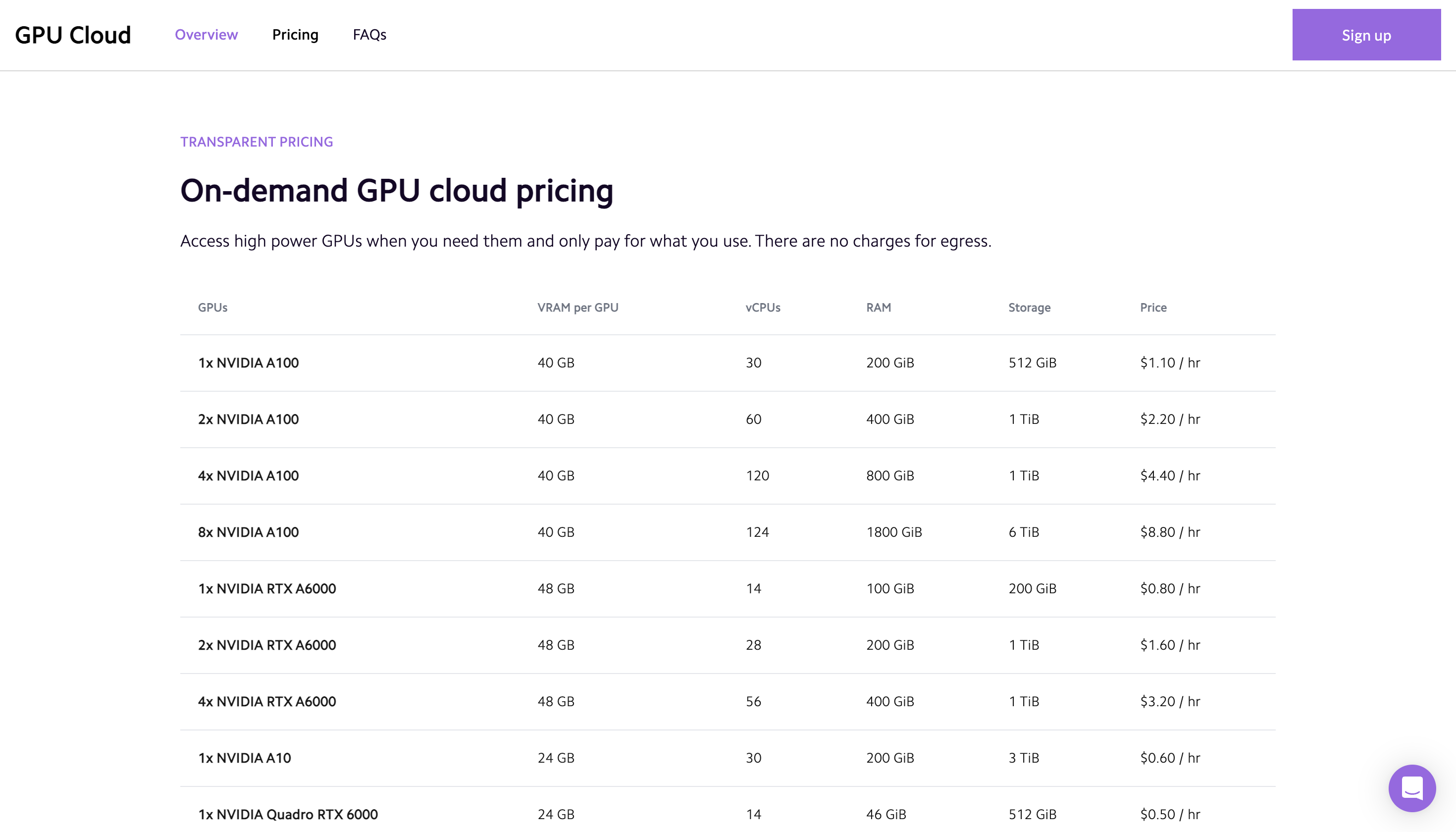

pagpepresyo

Nagsisimula ang pagpepresyo sa $1.10/oras para sa NVIDIA A100.

10. IBM Cloud GPU

Gumagamit ang IBM Cloud GPU ng isang globally dispersed network ng mga data center para mag-alok ng mga flexible na pamamaraan sa pagpili ng server at maayos na koneksyon sa IBM cloud architecture, mga API, at mga application.

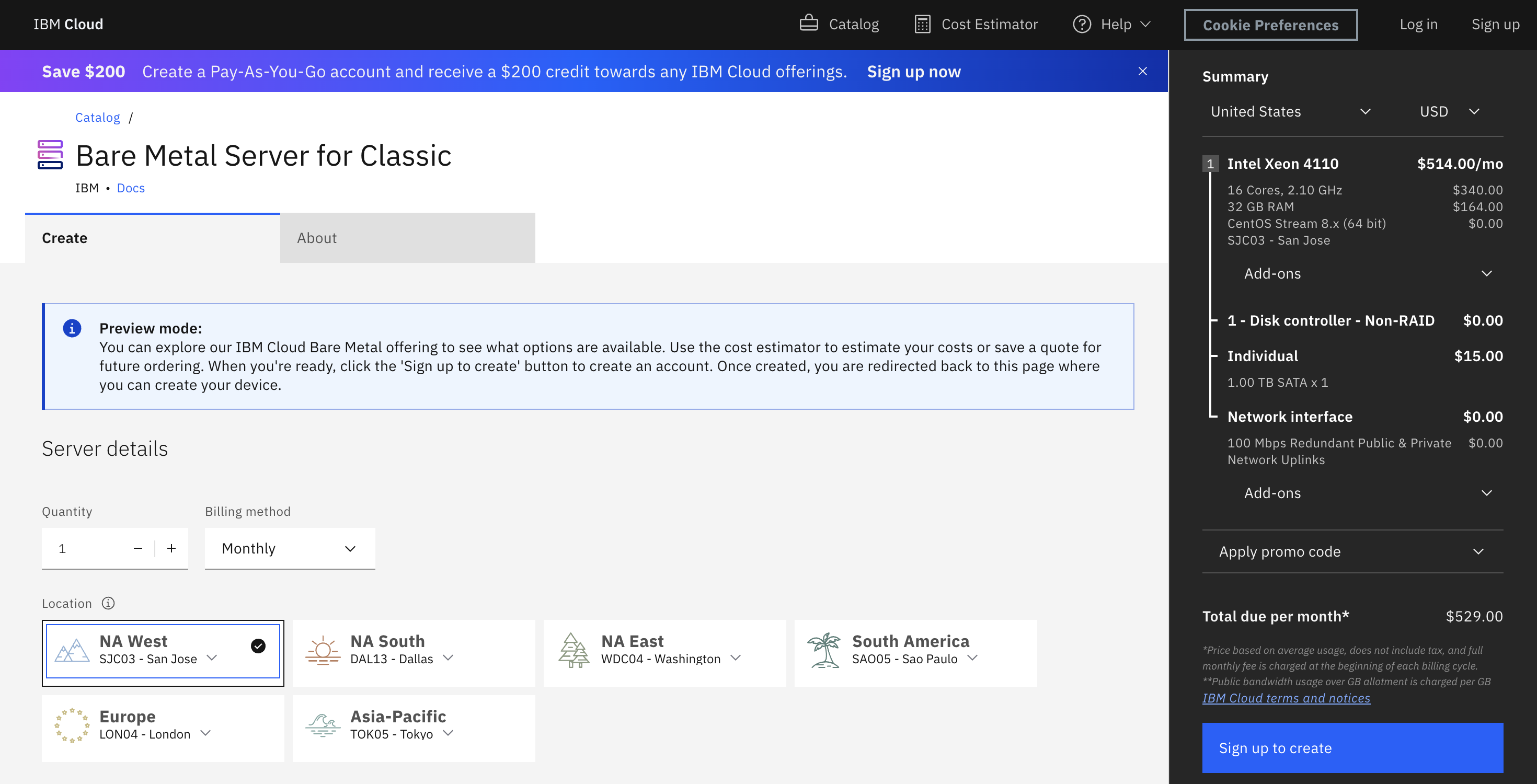

Sa Intel Xeon 4210, Xeon 5218, at Xeon 6248 GPU instance, nag-aalok ito ng bare-metal Server GPU na opsyon.

Maaari kang magsagawa ng mga high-performance, latency-sensitive, espesyalisado, at kumbensyonal na workload nang direkta sa server hardware gamit ang mga bare-metal na instance, tulad ng magagawa nila sa mga on-premise GPU.

Para sa kanilang bare-metal na opsyon sa server, nagbibigay din sila ng mga instance na may mga NVIDIA T4 GPU at Intel Xeon processor na may hanggang 40 core, pati na rin ang mga instance para sa kanilang mga virtual server na alternatibo sa NVIDIA V100 at P100 na mga modelo.

pagpepresyo

Ang pagpepresyo ay nagsisimula sa $514/buwan para sa Intel Xeon4110.

Konklusyon

Panghuli, ang pinakamahusay na mga serbisyo ng cloud GPU para sa AI ay ang mga nag-aalok ng malakas na mapagkukunan ng GPU, naaangkop na mga pagpipilian sa presyo, at simpleng pag-scale.

Ang lahat ng kumpanyang nagbibigay ng GPU instance para sa mga AI workload—AWS, NVIDIA, IBM, at GCP—ay may mahuhusay na linya ng produkto sa mga tuntunin ng performance at functionality.

Ang pinakamahusay na pagpipilian ay sa huli ay tinutukoy ng iyong mga natatanging kinakailangan, mga hadlang sa pananalapi, imprastraktura na nasa lugar na, at mga kagustuhan ng vendor.

Mag-iwan ng Sagot