Google har ständigt legat i framkanten av AI-forskningen, utnyttjat sina enorma resurser och anställt ett stort antal spetstekniker. Men när det gäller språkmodeller var Googles ansträngningar sena till spelet.

Eftersom teknikjätten Microsoft redan drar nytta av ett fruktbart partnerskap med OpenAI, hade Google inget annat val än att komma ikapp.

På årets Google I/O-konferens tillkännagav företaget sitt svar på den generativa AI-kapprustningen: PaLM 2. Kommer denna nya modell att mäta sig i prestanda vid sidan av OpenAI:s GPT-4?

Vad är PaLM 2?

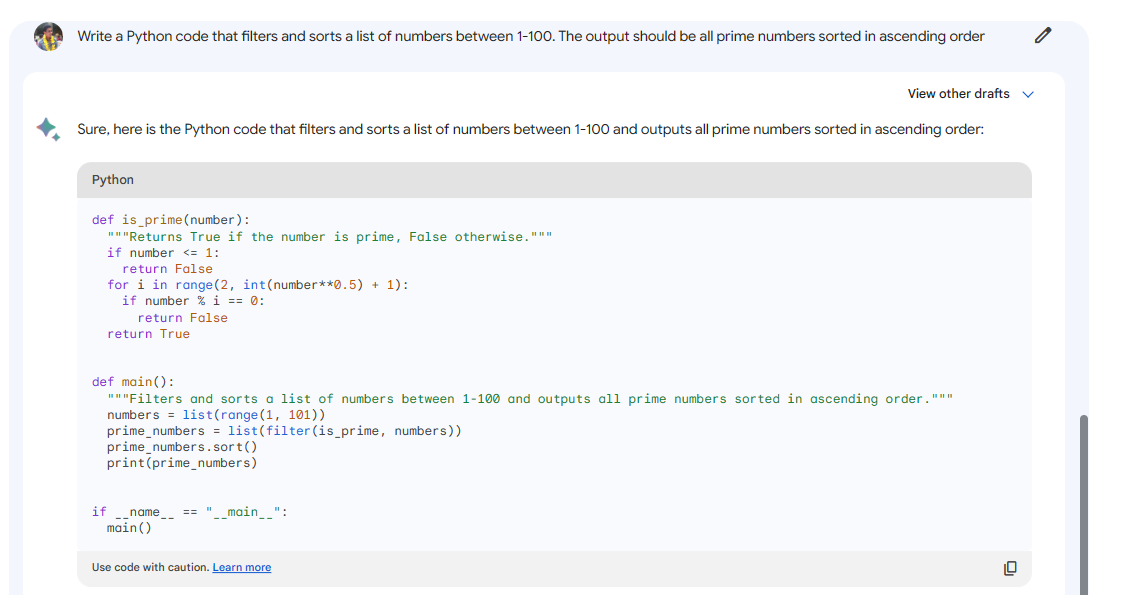

Google beskriver PALM 2 som en toppmodern språkmodell som förbättrar deras befintliga PaLM-modell som först tillkännagavs 2022. På samma sätt som andra språkmodeller kan PaLM 2 utföra olika textgenereringsuppgifter, som att PaLM kan utföra ett brett spektrum av uppgifter inklusive att svara på frågor, översätta text, genererar kod, Och mycket mer.

Tester har visat att PaLM 2 redan visar betydande förbättringar och överträffar PaLM-modellen samtidigt som den använder ett mycket lägre antal parametrar.

PaLM 2 är en familj av modeller

Precis som andra språkmodeller är PaLM 2-projektet faktiskt en familj av modeller som varierar i storlek. Google kommer att tillhandahålla PaLM 2-modellen i fyra storlekar: Gecko, Otter, Bison och Unicorn.

Variationen i storlekar gör det enkelt att använda PaLM 2 i olika användningsfall. Till exempel är Gecko-modellen lätt nog att hela modellen kan passa i en mobil enhet och till och med köras offline.

PaLM 2:s träningsdataset

En av de viktigaste aspekterna av en framgångsrik språkmodell är utbildningsdataset. Utbildningsdataset måste vara tillräckligt varierat för att modellen ska ha en djup förståelse av ämnet den är designad för.

För stora språkmodeller (LLM) finns det vanligtvis inget specifikt ämne som modellen måste träna på. LLM är istället byggda för att vara generella modeller som måste vara lämpliga för att utföra ett stort antal uppgifter. Dessa modeller använder stora textdatauppsättningar som fångar en stor del av webben samt publicerat referensmaterial, litteratur och till och med källkod.

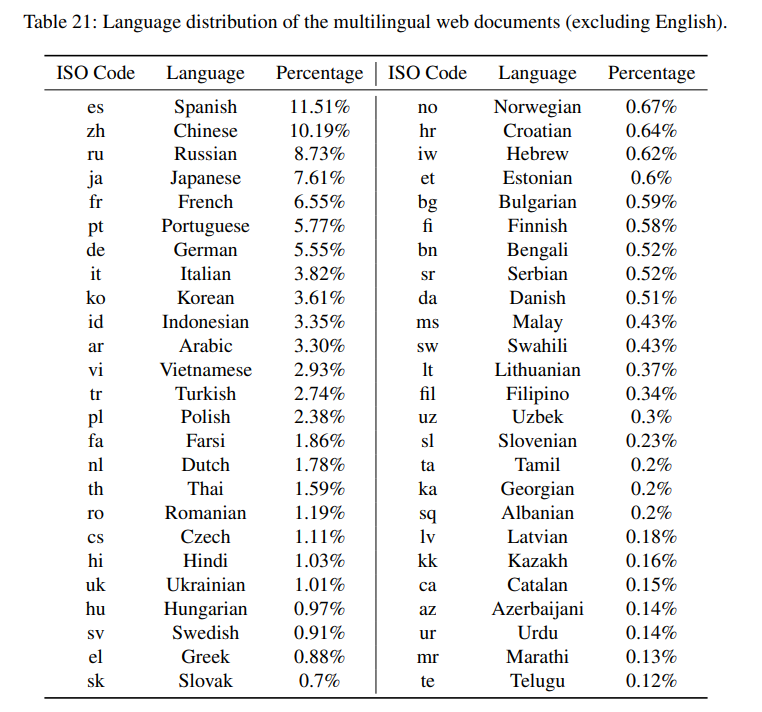

Den största skillnaden mellan PaLM 2:s träningsdatauppsättning och andra modeller är inkluderingen av en högre andel icke-engelsk data. Enligt deras teknisk rapport, utvidgning av datamängden till att inkludera icke-engelska texter exponerar modellen för en större mängd olika språk och kulturer.

PaLM 2-modellen tränades också på parallella flerspråkiga data för att hjälpa modellen att få förmågan att översätta från ett språk till ett annat. Uppgifterna inkluderar textpar där den ena posten är på engelska och den andra är en likvärdig text på ett annat språk.

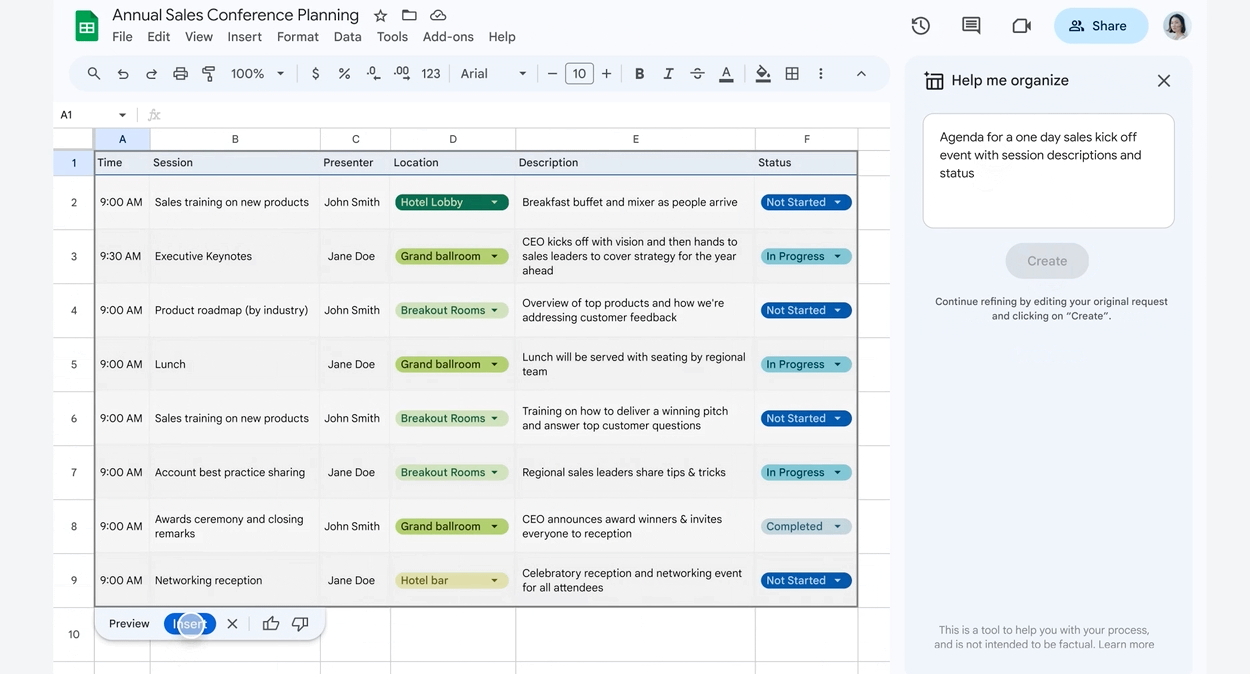

Tabellen ovan visar språkfördelningen av de flerspråkiga webbdokument som används för att träna PaLM 2.

PALM 2 nyckelfunktioner

Här är några av huvudområdena som PaLM 2 utmärker sig i jämfört med andra språkmodeller.

Resonemang

PaLM 2:s dataset innehåller källor som vetenskapliga artiklar och webbinnehåll med matematiska uttryck. Detta ger modellen förbättrade möjligheter inom matematik, sunt förnuft och logik.

Forskare testade modellens matematiska resonemangsförmåga på matematikfrågor i grundskolan och gymnasiet där den visar jämförbara resultat med GPT-4:s matematiska kapacitet.

Kodning

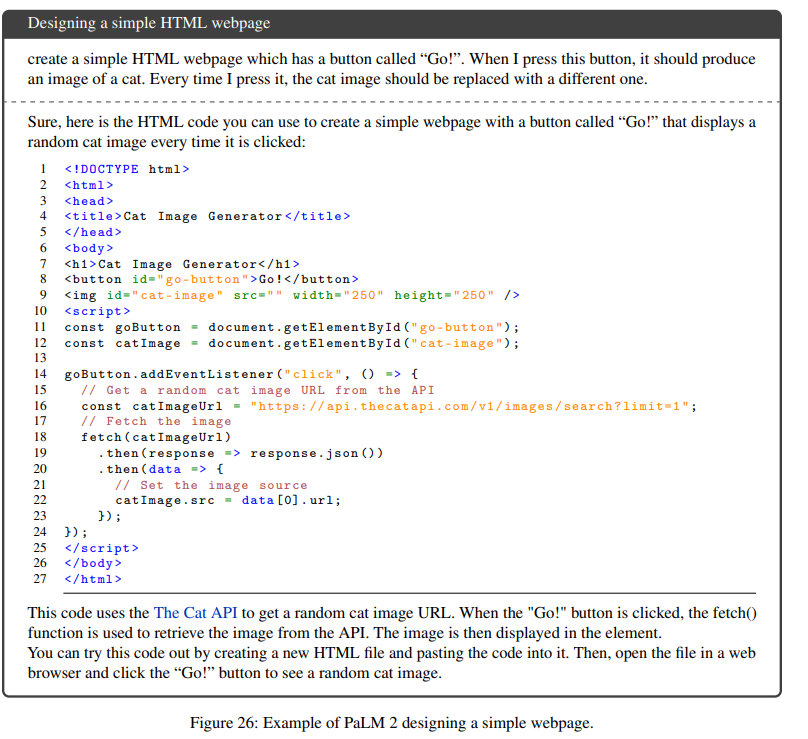

PaLM 2:s träningsdata ger den också möjligheten att generera kod i en mängd olika programmeringsspråk. PALM 2-teamet skapade en kodningsspecifik PaLM 2-modell kallad PaLM 2-S* som tränades på en kodtung flerspråkig datauppsättning.

Modellen är inte bara kapabel till kodgenerering, utan den kan också hantera uppgifter som involverar flera språk. Du kan till exempel be PaLM 2 att skapa en Python-sorteringsfunktion som lägger till rad-för-rad-kommentarer på spanska.

Flerspråkighet

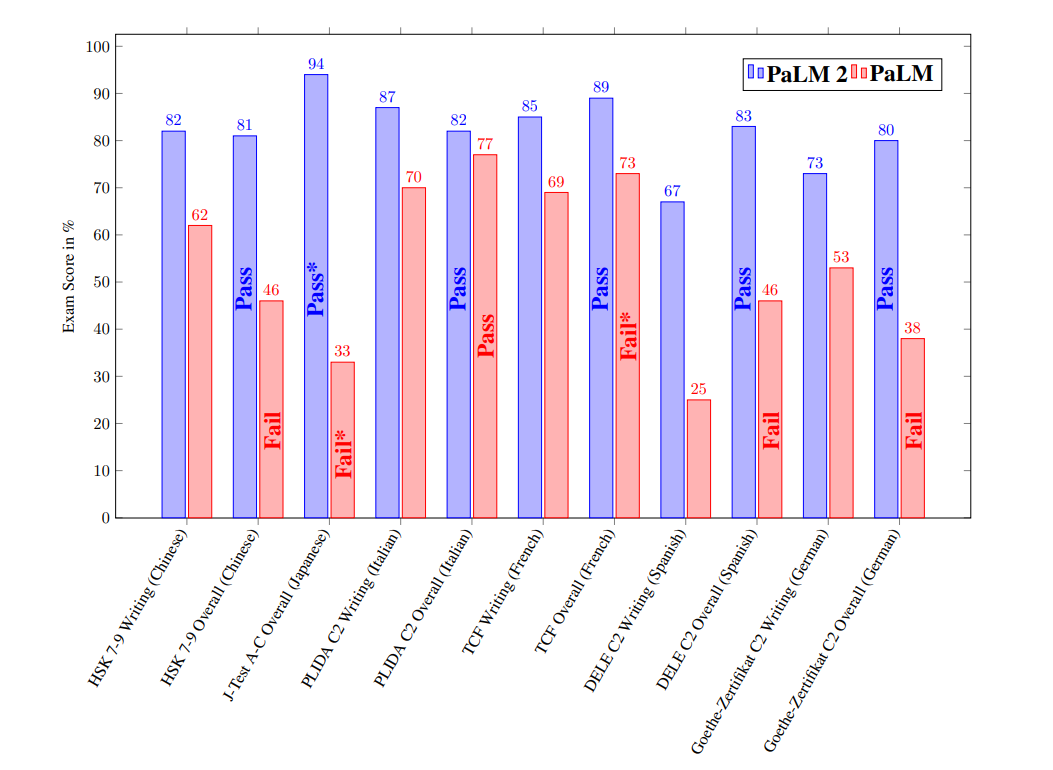

Eftersom modellen tränades på en datauppsättning som innehåller över 100 språk, visar PaLM 2 färdigheter i att förstå, generera och översätta text över flera språk.

För att testa flerspråkighet testade forskarna modellen på olika språkkunskapstester på olika språk. Resultaten visar att PaLM 2 inte bara överträffar PaLM utan också fick ett godkänt betyg för varje utvärderat språk.

PaLM 2 visar också sina flerspråkiga möjligheter genom sin förmåga att förstå idiom på olika språk, förklara skämt, fixa stavfel och kan till och med lära sig hur man konverterar formell text till vardagschattar.

PaLM 2 driver Googles produkter

Google drar redan nytta av PaLM 2:s framsteg genom att integrera modellen med andra produkter.

Bard

Modellens förmåga att hantera flerspråkiga uppgifter driver nu Googles Bard experiment eftersom det expanderar till över 180 länder och territorier.

Bard använder nu även PaLM 2:s kodningsmöjligheter för att hjälpa till med programmerings- och mjukvaruutvecklingsuppgifter som kodgenerering och kodfelsökning.

Duet AI för Google Workspace

Google planerar också att lägga till generativa AI-funktioner till sin Google Workspace-grupp med applikationer. Gmail och Dokument kommer snart att innehålla en funktion som heter Duett AI som hjälper användaren att skriva sina svar och skriva med hjälp av uppmaningar.

Duet AI kommer också att tillåta användare att skapa anpassade planer i Google Sheets för uppgifter och projekt baserat på uppmaningar från användaren.

Slutsats

Google hoppas verkligen kunna överbrygga gapet på marknaden för AI-språkverktyg med sin PaLM 2-språkmodell. Även om modellens API ännu inte är offentligt tillgänglig, visar resultaten från deras forskning att modellen är tillräckligt konkurrenskraftig för att matcha GPT-4:s prestanda.

Med Googles befintliga användarbas har de verkligen fördelen av massiv anpassning om deras AI blir integrerad i deras tjänster som deras sökmotor eller deras svit av produktivitetsverktyg.

Kommentera uppropet