Vi spenderar mycket tid på att kommunicera med människor online via chatt, e-post, webbplatser och sociala medier.

De enorma mängder textdata vi producerar varje sekund undslipper vår uppmärksamhet, men inte alltid.

Kundernas agerande och recensioner ger organisationer ovärderlig information om vad kunder värderar och ogillar i varor och tjänster, samt vad de vill ha av ett varumärke.

Majoriteten av företagen har dock fortfarande svårt att bestämma den mest effektiva metoden för dataanalys.

Eftersom mycket av datan är ostrukturerad har datorer svårt att förstå det, och manuell sortering skulle vara extremt tidskrävande.

Att bearbeta mycket data för hand blir mödosamt, monotont och helt enkelt omöjligt när ett företag expanderar.

Tack och lov kan Natural Language Processing hjälpa dig att hitta insiktsfull information i ostrukturerad text och lösa en rad textanalysfrågor, inklusive känsla analys, ämneskategorisering och mer.

Att göra mänskligt språk förståeligt för maskiner är målet för artificiell intelligens-fältet naturlig språkbehandling (NLP), som använder sig av lingvistik och datavetenskap.

NLP gör det möjligt för datorer att automatiskt utvärdera enorma mängder data, vilket gör det möjligt för dig att snabbt identifiera relevant information.

Ostrukturerad text (eller andra typer av naturligt språk) kan användas med en rad olika tekniker för att avslöja insiktsfull information och ta itu med ett antal problem.

Även om den på intet sätt är heltäckande, är listan över verktyg med öppen källkod som presenteras nedan ett underbart ställe att börja för alla eller någon organisation som är intresserad av att använda naturlig språkbehandling i sina projekt.

1. Nltk

Man skulle kunna hävda att Natural Language Toolkit (NLTK) är det mest funktionsrika verktyg jag har tittat på.

Nästan alla NLP-tekniker är implementerade, inklusive kategorisering, tokenisering, stemming, taggning, parsning och semantiskt resonemang.

Du kan välja den exakta algoritmen eller metoden du vill använda eftersom det ofta finns flera implementeringar tillgängliga för varje.

Många språk stöds också. Även om det är bra för enkla strukturer, gör det faktum att det representerar all data som strängar det utmanande att tillämpa några sofistikerade funktioner.

Jämfört med andra verktyg är biblioteket också lite trögt.

Allt övervägt är detta en utmärkt verktygsuppsättning för experiment, utforskning och applikationer som kräver en viss blandning av algoritmer.

Fördelar

- Det är det mest populära och kompletta NLP-biblioteket med flera tredje tillägg.

- I jämförelse med andra bibliotek stöder den de flesta språk.

Nackdelar

- svåra att förstå och använda

- Det är långsamt

- inga modeller av neurala nätverk

- Den delar bara upp texten i meningar utan att ta hänsyn till semantiken

2. spacy

SpaCy är NLTK:s mest troliga topprival. Även om det bara har en implementering för varje NLP-komponent, är det i allmänhet snabbare.

Dessutom representeras allt som ett objekt snarare än en sträng, vilket förenklar gränssnittet för att utveckla appar.

Att ha ett djupare grepp om din textdata gör att du kan åstadkomma mer.

Detta gör det också lättare för den att ansluta till flera andra ramverk och datavetenskapliga verktyg. Men jämfört med NLTK stöder SpaCy inte lika många språk.

Den har många neurala modeller för olika aspekter av språkbehandling och analys, såväl som ett enkelt användargränssnitt med ett komprimerat utbud av alternativ och utmärkt dokumentation.

Dessutom har SpaCy byggts för att rymma enorma mängder data och är extremt noggrant dokumenterat.

Den innehåller också en uppsjö av modeller för naturlig språkbehandling som redan har tränats, vilket gör det lättare att lära sig, lära ut och använda naturlig språkbehandling med SpaCy.

Sammantaget är detta ett utmärkt verktyg för nya appar som inte behöver en specifik metod och som måste vara presterande i produktionen.

Fördelar

- Jämfört med andra saker går det snabbt.

- Att lära sig och använda det är enkelt.

- modeller tränas med hjälp av neurala nätverk

Nackdelar

- mindre anpassningsförmåga jämfört med NLTK

3. Gensim

De mest effektiva och enkla metoderna för att uttrycka dokument som semantiska vektorer uppnås genom att använda det specialiserade Python-ramverket med öppen källkod som kallas Gensim.

Gensim skapades av författarna för att hantera rå, ostrukturerad vanlig text med hjälp av en rad maskininlärning metoder; därför är det en smart idé att använda Gensim för att ta itu med jobb som ämnesmodellering.

Dessutom hittar Gensim effektivt textlikheter, indexerar innehåll och navigerar mellan distinkta texter.

Det är en mycket specialiserad Python bibliotek fokusera på ämnesmodelleringsuppgifter med hjälp av latent Dirichlet-allokering och andra LDA-metoder.

Dessutom är det ganska bra på att hitta texter som liknar varandra, indexera texter och navigera över tidningar.

Detta verktyg hanterar enorma mängder data effektivt och snabbt. Här är några starthandledningar.

Fördelar

- enkelt användargränssnitt

- effektiv användning av välkända algoritmer

- På en grupp datorer kan den göra latent Dirichlet-allokering och latent semantisk analys.

Nackdelar

- Den är mest avsedd för oövervakad textmodellering.

- Den saknar en komplett NLP-pipeline och bör användas tillsammans med andra bibliotek som Spacy eller NLTK.

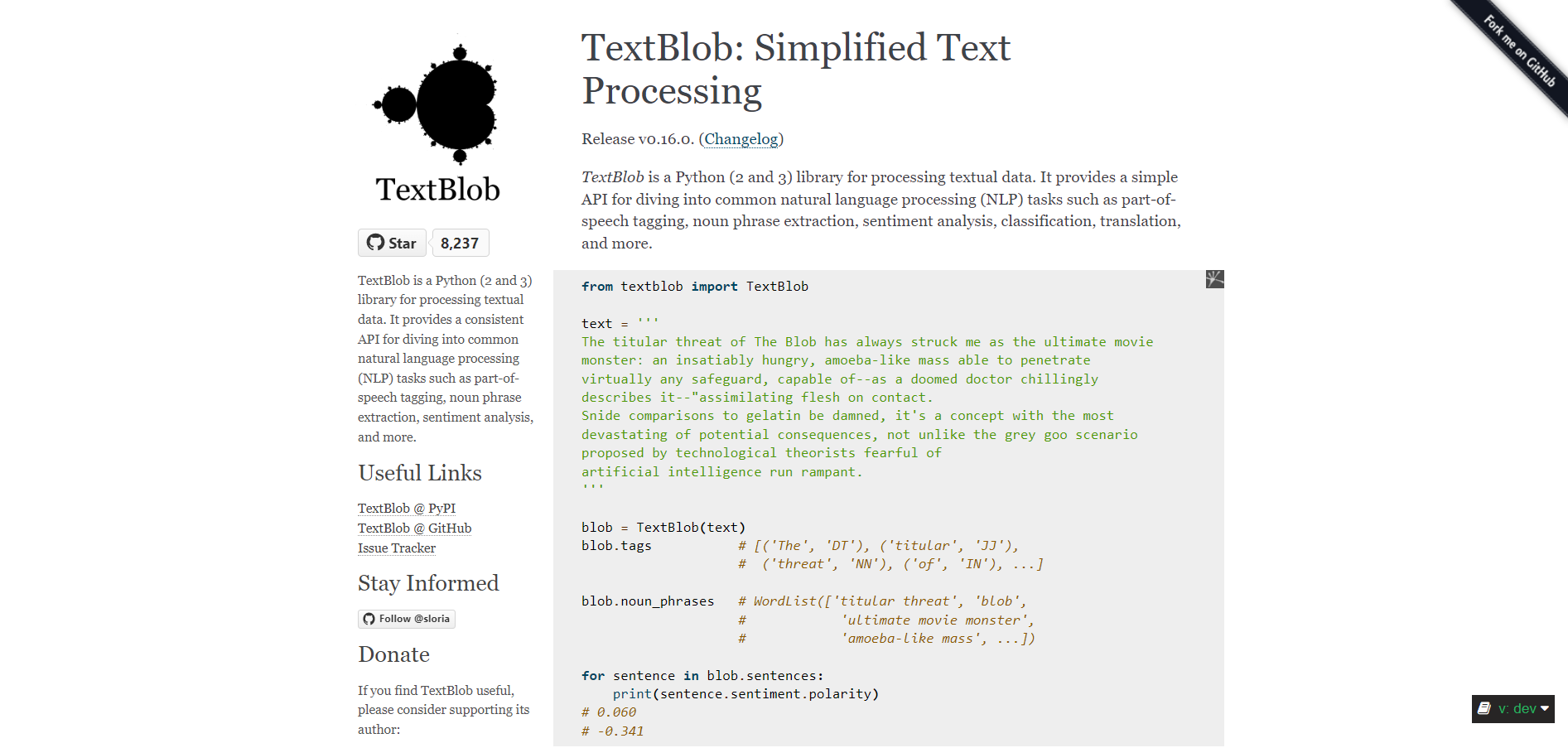

4. TextBlob

TextBlob är en sorts NLTK-förlängning.

Genom TextBlob kan du lättare få åtkomst till många NLTK-funktioner, och TextBlob innehåller också mönsterbiblioteksfunktioner.

Detta kan vara ett användbart verktyg att använda när du lär dig om du precis har börjat, och det kan användas i produktion för applikationer som inte kräver mycket prestanda.

Det erbjuder ett mycket mer användarvänligt och enkelt gränssnitt för att utföra samma NLP-funktioner.

Det är ett utmärkt alternativ för nybörjare som vill ta sig an NLP-uppgifter som sentimentanalys, textkategorisering och ordspråktaggning eftersom dess inlärningskurva är mindre än med andra open source-verktyg.

TextBlob används ofta och är utmärkt för mindre projekt överlag.

Fördelar

- Bibliotekets användargränssnitt är enkelt och tydligt.

- Det erbjuder språkidentifiering och översättningstjänster med hjälp av Google Translate.

Nackdelar

- I jämförelse med andra går det långsamt.

- Inga modeller av neurala nätverk

- Inga ordvektorer integrerade

5. OpenNLP

Det är enkelt att integrera OpenNLP med andra Apache-projekt som Apache Flink, Apache NiFi och Apache Spark eftersom det är värd för Apache Foundation.

Det är ett omfattande NLP-verktyg som kan användas från kommandoraden eller som ett bibliotek i en applikation.

Den inkluderar alla NLP:s vanliga bearbetningskomponenter.

Dessutom erbjuder den omfattande språkstöd. Om du använder Java är OpenNLP ett starkt verktyg med massor av möjligheter som är förberett för produktionsbelastningar.

Förutom att möjliggöra de mest typiska NLP-uppgifterna, såsom tokenisering, meningssegmentering och ordstyrd taggning, kan OpenNLP användas för att skapa mer komplexa textbehandlingsapplikationer.

Maximal entropi och perceptronbaserad maskininlärning ingår också.

Fördelar

- Ett modellträningsverktyg med flera funktioner

- Fokuserar på grundläggande NLP-uppgifter och utmärker sig i dem, inklusive enhetsidentifiering, frasdetektering och tokenisering.

Nackdelar

- saknar sofistikerad kapacitet; om du vill fortsätta med JVM är att flytta till CoreNLP nästa naturliga steg.

6. AllenNLP

AllenNLP är idealisk för kommersiella applikationer och dataanalys eftersom den bygger på PyTorch-verktyg och resurser.

Det utvecklas till ett allomfattande verktyg för textanalys.

Detta gör det till ett av listans mer sofistikerade verktyg för bearbetning av naturligt språk. Medan de andra uppgifterna utförs självständigt förbearbetar AllenNLP data med det kostnadsfria SpaCy open-source-paketet.

AllenNLP:s viktigaste försäljningsargument är hur lätt det är att använda.

AllenNLP effektiviserar den naturliga språkbehandlingsprocessen, i motsats till andra NLP-program som innehåller flera moduler.

Som en konsekvens känns resultatet aldrig förvirrande. Det är ett fantastiskt verktyg för dem utan mycket kunskap.

Fördelar

- Utvecklad ovanpå PyTorch

- utmärkt för att utforska och experimentera med banbrytande modeller

- Den kan användas både kommersiellt och akademiskt

Nackdelar

- Inte lämplig för storskaliga projekt som för närvarande är i produktion.

Slutsats

Företag använder NLP-tekniker för att extrahera insikter från ostrukturerad textdata som e-postmeddelanden, onlinerecensioner, sociala medier inlägg med mera. Verktyg med öppen källkod är kostnadsfria, anpassningsbara och ger utvecklare kompletta anpassningsalternativ.

Vad väntar du på? Använd dem direkt och skapa något otroligt.

Lycklig kodning!

Kommentera uppropet