Innehållsförteckning[Dölj][Visa]

Den nya och förbättrade AI har förbättrad förmåga, förståelse och kapacitet att producera bilder med högre upplösning. Du kanske på sistone har stött på några konstiga och underhållande bilder som svävar runt på internet.

En Shiba Inu-hund är klädd i en basker och en svart turtleneck. Och en havsutter på samma sätt som den holländska målaren Vermeers "Girl with a Pearl Earring". Och det finns en kopp soppa som ser ut som ett ulligt monster.

dessa bilder skapades inte av en mänsklig konstnär.

Istället skapade DALL-E 2, ett nytt AI-system som kan konvertera textbeskrivningar till bilder.

Skriv bara ner vad du vill se, så skapar AI det åt dig – i levande detaljer, bra kvalitet och, i vissa fall, genuin uppfinningsrikedom. I det här inlägget ska vi ta en djup titt på OpenAIs senaste studie, DALL.E 2, samt hur den fungerar och mycket mer. Låt oss börja.

Så vad är exakt DALL.E 2?

DALL-E 2 är en "generativ modell", en typ av maskininlärningsalgoritm som genererar komplicerade utdata snarare än att utföra förutsägelse- eller klassificeringsuppgifter på indata.

Du förser DALL-E 2 med en skriftlig beskrivning, och den skapar en bild som motsvarar den. Genom att kombinera koncept, kvaliteter och stilar kan OpenAIs DALLE 2 producera innovativ, realistisk grafik och konst från en grundläggande språklig beskrivning.

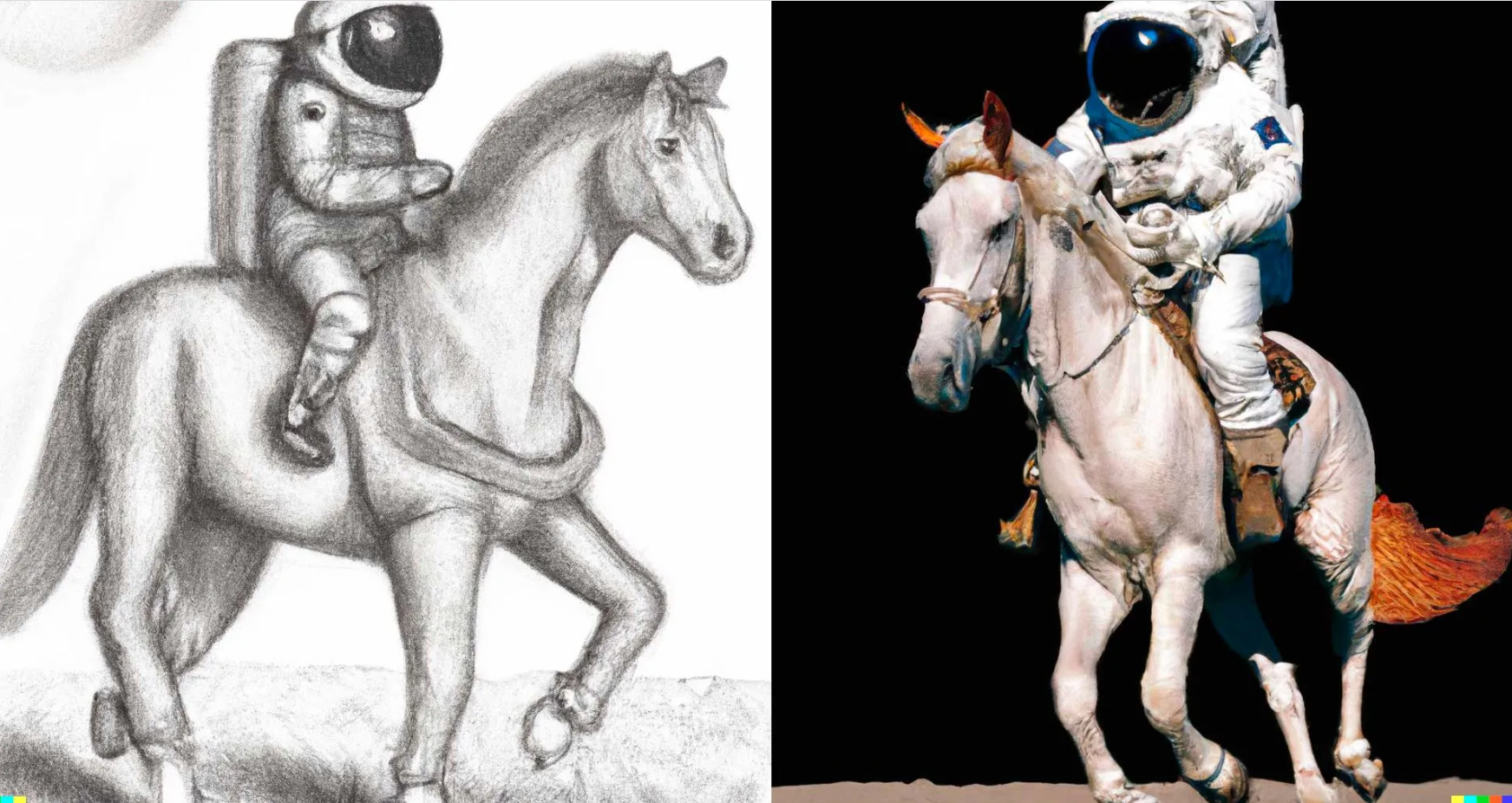

Den senaste versionen, DALLE 2, sägs vara mer mångsidig, kapabel att göra bilder från bildtexter i högre upplösningar och i ett bredare spektrum av kreativa stilar. Till exempel är bilderna nedan (från DALL-E 2-blogginlägget) skapade av beskrivningen "En astronaut som rider på en häst."

En beskrivning avslutas, "som en pennskiss", medan den andra avslutar, "på ett fotorealistiskt sätt."

Det kan också ändra befintliga fotografier med häpnadsväckande precision. Så du kan lägga till eller ta bort element samtidigt som du behåller färger, reflektioner och skuggor, allt samtidigt som originalbildens utseende bibehålls.

Hur fungerar det?

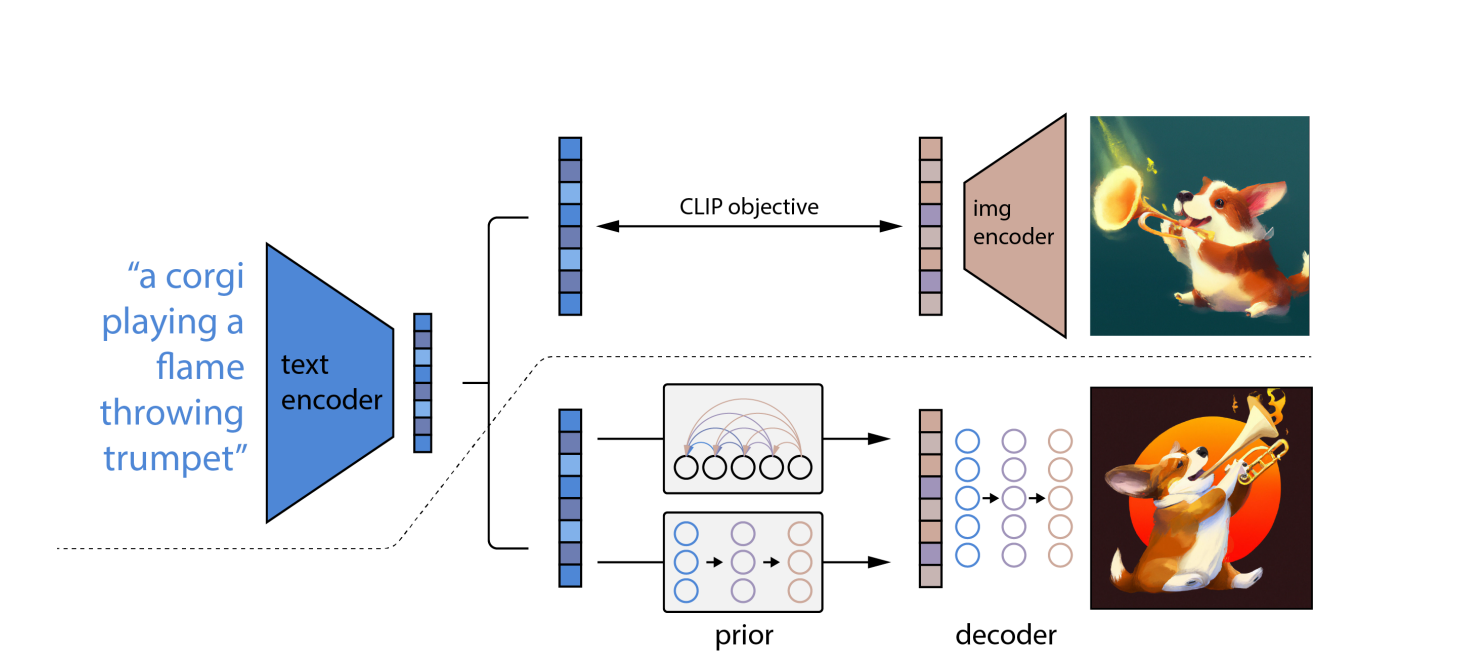

DALL-E 2 använder sig av CLIP och diffusionsmodeller, två sofistikerade djupt lärande metoder som utvecklats under de senaste åren. Den bygger dock på samma föreställning som alla andra djupa neurala nätverk: representationsinlärning. CLIP tränar två samtidigt neurala nätverk på bilder och bildtexter.

Det ena nätverket lär sig de visuella representationerna i bilden, medan det andra lär sig textrepresentationerna. Under utbildningen försöker de två nätverken att modifiera sina parametrar så att jämförbara bilder och beskrivningar resulterar i liknande inbäddningar.

"Diffusion", en typ av generativ modell som lär sig att göra bilder genom att gradvis brusa och försvaga sina träningsprover, är den andra maskininlärningsmetoden som används i DALL-E 2. Diffusionsmodeller liknar autokodare genom att de omvandlar indata till en bädda in representation och använd sedan inbäddningsinformationen för att återskapa originaldata.

Använder OpenAI's språkmodell CLIP, som kan koppla samman textbeskrivningar med fotografier, översätter först den skriftliga uppmaningen till en mellanform som innehåller de avgörande egenskaper som en bild bör ha för att matcha den uppmaningen (enligt CLIP).

För det andra skapar DALL-E 2 en CLIP-kompatibel bild med hjälp av en diffusionsmodell, som är ett neuralt nätverk.

På förvrängda foton med slumpmässiga pixlar lär man sig diffusionsmodeller. De lär sig hur man återställer bildernas ursprungliga form. Diffusionsmodeller kan producera syntetiska bilder av hög kvalitet, särskilt när de används i kombination med ett vägledande tillvägagångssätt som prioriterar noggrannhet framför mångfald.

Som en konsekvens av detta diffusionsmodell tar de slumpmässiga pixlarna och använder CLIP för att konvertera dem till en ny bild som matchar ordprompten. På grund av diffusionskonceptet kan DALL-E 2 producera bilder med högre upplösning snabbare än DALL-E.

DALL.E 2 användningsfall

Under de senaste tjugo åren, dator vision Tekniken har gått från en enkel idé till ett stort genombrott. Trots dessa framsteg möter fortfarande bild- och objektigenkänningsmodeller betydande hinder i vardagen. Frånvaron av datauppsättningar är en av de viktigaste nackdelarna med bildigenkänning och datorseende. Eftersom det råder databrist i båda ändar är det nästan svårt att träna bildigenkänningsmodeller för att ge 100 procent korrekta resultat.

Lyckligtvis kan OpenAI:s nya maskininlärningsmodell överbrygga klyftan i tekniken. DALLE 2 kan generera fantastiska bilder baserat på textbeskrivningar. Denna falska bildproduktion kan ge data till bildigenkänningsmodeller baserat på deras krav. Frånvaron av data är en betydande stötesten för objekt- och bildidentifiering.

I den digitala eran finns datauppsättningar allestädes närvarande, men vi letar fortfarande efter genvägar för att mata AI-modellen, så att den kan ge bra resultat. Det är dock inte enkelt att träna en bildigenkänningsmodell. Det kräver ett stort antal datamängder med små skillnader, som vi kanske inte har kunnat hämta helt enkelt.

Så, vad är svaret: Svaret är DALLE 2. OpenAI-bildgeneratorn, med sin förmåga att producera bilder från texter och ändra befintliga, kan hjälpa till att överbrygga klyftan. Detta kommer att hjälpa till att generera ytterligare utbildningsdata samtidigt som det minskar mängden mänsklig märkning som krävs. Trots den betydande fördelen bör du vara medveten om bedrägliga bildproduktioner och bilder som utesluter inkludering. Detta kan leda till att bilddetekteringsmetoder ger partiska resultat.

Begränsningar

DALL.E 2 kan mycket väl ha en skadlig inverkan om den hamnar i orätta händer, enligt OpenAI. I dagens värld av djupa förfalskningar kan modellen lätt användas för att sprida falsk information eller rasistiska bilder, vilket är anledningen till att OpenAI endast tillåter utvecklare att använda DALL.2 efter inbjudan. Modellen måste följa en rigorös innehållsbegränsning för alla förslag hon får.

För att utesluta potentialen för att DALL.E 2 skapar fientliga eller våldsamma bilder skapades datasetet utan några dödliga vapen. Även om OpenAI har uppgett att de planerar att omvandla det till ett API i framtiden, i fallet med DALL.E 2, är det villig att fortsätta med försiktighet.

Slutsats

DALL-E 2 är en annan intressant OpenAI-forskningsupptäckt som öppnar dörren till nya tillämpningar.

Ett exempel är att skapa massiva datauppsättningar för att möta en av datorvisionens främsta flaskhalsar – data. Även om det ekonomiska fallet för många DALL-E-baserade appar kommer att bestämmas av priset och policyerna som OpenAI upprättar för sina API-användare, kommer de alla utan tvekan att främja bildproduktionen.

Kommentera uppropet