Cloud GPU:er är mycket efterfrågade när nya teknologier som djupinlärning, AI och maskininlärning växer fram.

GPU:er (Graphics Processing Units) är specialiserade processorer som är gjorda för att hantera de enorma datamängder och komplicerade beräkningar som behövs för aktiviteter som datorgrafik och spel. De är nu avgörande för området artificiell intelligens (AI) också, dock på senare tid.

Traditionella CPU:er (Central Processing Units) kan inte möta efterfrågan eftersom AI-modeller kräver en betydande mängd datorkraft för att träna och köra.

Å andra sidan, eftersom de är byggda för att stödja parallell bearbetning, är GPU:er mer effektiva för att hantera de enorma datavolymer och intrikata beräkningar som behövs för AI-operationer.

Om du är inom teknik, måste du ha hört talas om moln GPU-tjänster. För de som inte vill följa med.

En molnbaserad tjänst som ger användare online-åtkomst till potenta GPU-resurser är känd som en moln-GPU-tjänst för AI. Istället för att behöva köpa och underhålla sin egen GPU-hårdvara, gör dessa tjänster det möjligt för kunder att hyra GPU-resurser efter behov.

Detta gör det möjligt för människor och organisationer att använda GPU:ernas bearbetningskapacitet utan att behöva göra en betydande initial investering eller betala fortsatta underhållsavgifter.

Majoriteten av moln-GPU-tjänsterna för AI erbjuder ett brett utbud av GPU-alternativ, inklusive flera modeller och konfigurationer och flexibiliteten att skala upp eller ned efter behov. Du kan nu välja de idealiska GPU-resurserna för deras unika krav och projekt tack vare denna tjänst.

Dessutom kommer tjänsterna ofta med andra funktioner, inklusive nätverk, lagring och mjukvaruverktyg för att hjälpa kunder i deras AI-projekt. I det här inlägget kommer vi att titta på de bästa moln-GPU-tjänsterna för AI.

1. Linode

Linode erbjuder GPU:er på begäran för arbetsbelastningar som videobearbetning, vetenskaplig beräkning, maskininlärning, artificiell intelligens och andra.

Det tillhandahåller GPU-optimerade virtuella maskiner (VM) som körs på NVIDIA Quadro RTX 6000, Tensor och RT-kärnor och använder CUDA-kapacitet för att göra djupt lärande, arbetsbelastningar för strålspårning och komplexa beräkningar.

Genom att förvandla dina kapitalutgifter till en driftskostnad kan du använda Linode GPU:s GPU-kapacitet och molnets verkliga värde.

Dessutom befriar Linode dig från att behöva oroa dig för hårdvaran så att du kan koncentrera dig på dina starkaste färdigheter.

Med Linode GPU:er är det nu möjligt att använda dem för sofistikerade applikationer som videoströmning, artificiell intelligens och maskininlärning.

Dessutom, beroende på mängden processorkraft som krävs för förväntade arbetsbelastningar, kan du få upp till 4 kort för varje instans.

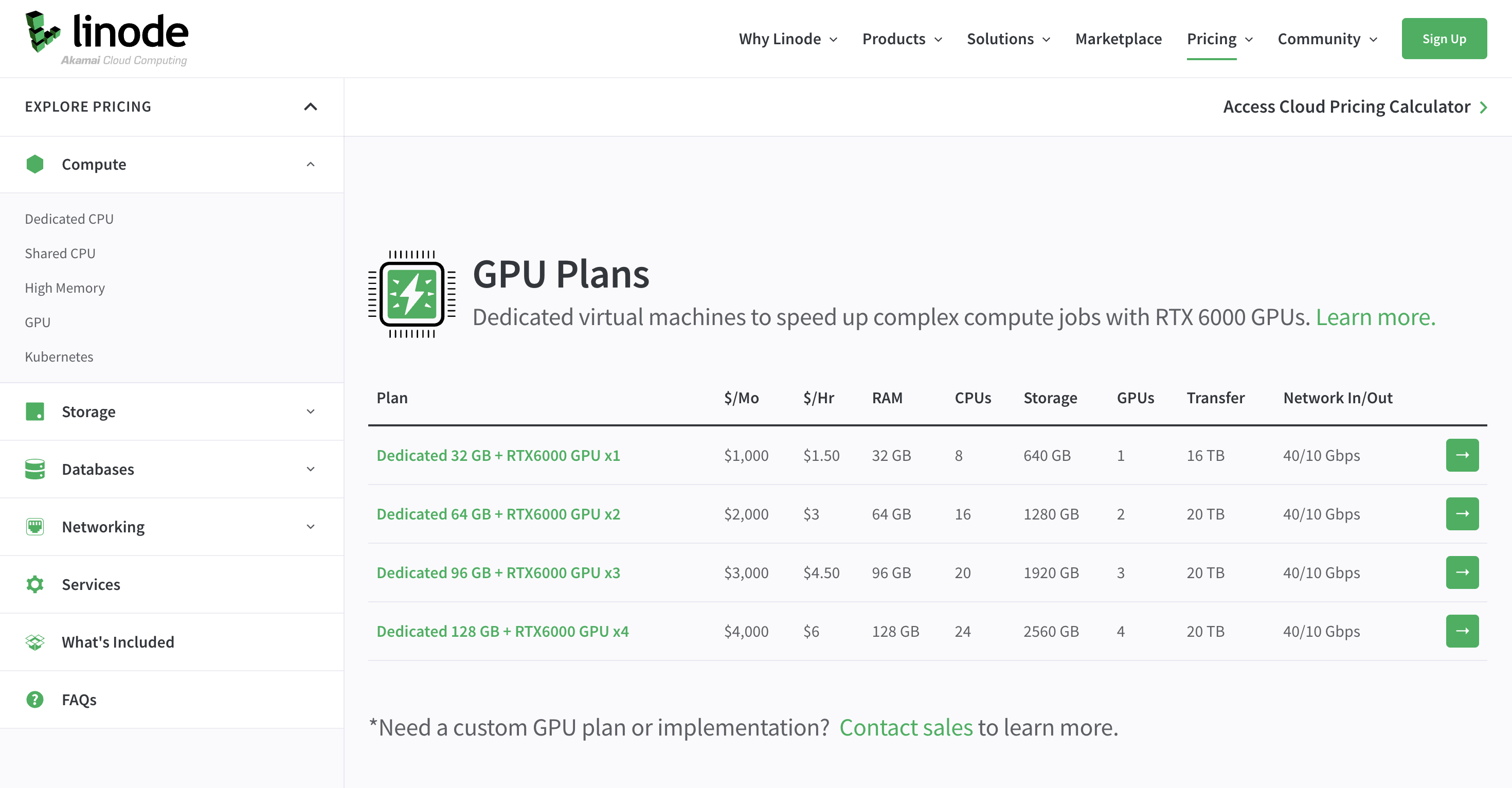

Priser

Priset börjar på $1.5/timme för den dedikerade RTX6000 GPU-planen. Kom igång med Linode gratis.

2. Stor AI

Vast AI är en global marknadsplats där användare kan hyra billiga GPU:er för användning i högpresterande datorer.

De minskar kostnaderna för beräkningstunga uppgifter genom att göra det möjligt för värdar att hyra ut sin GPU-hårdvara, vilket gör det möjligt för användare att använda sitt sökverktyg online för att hitta de billigaste priserna för datoranvändning i enlighet med deras behov och utföra kommandon eller starta SSH-anslutningar.

De tillhandahåller SSH-instanser, Jupyter-instanser med Jupyter GUI, eller endast kommandoinstanser, och har en enkel användargränssnitt.

En funktion för djupinlärning (DLPerf), som förutsäger en uppskattad prestanda för djupinlärning, tillhandahålls också.

Systemen som används av Vast AI är Ubuntu-baserade och erbjuder inte fjärrskrivbord. De driver också instanser som är tillgängliga på begäran för en specifik avgift som fastställts av värden.

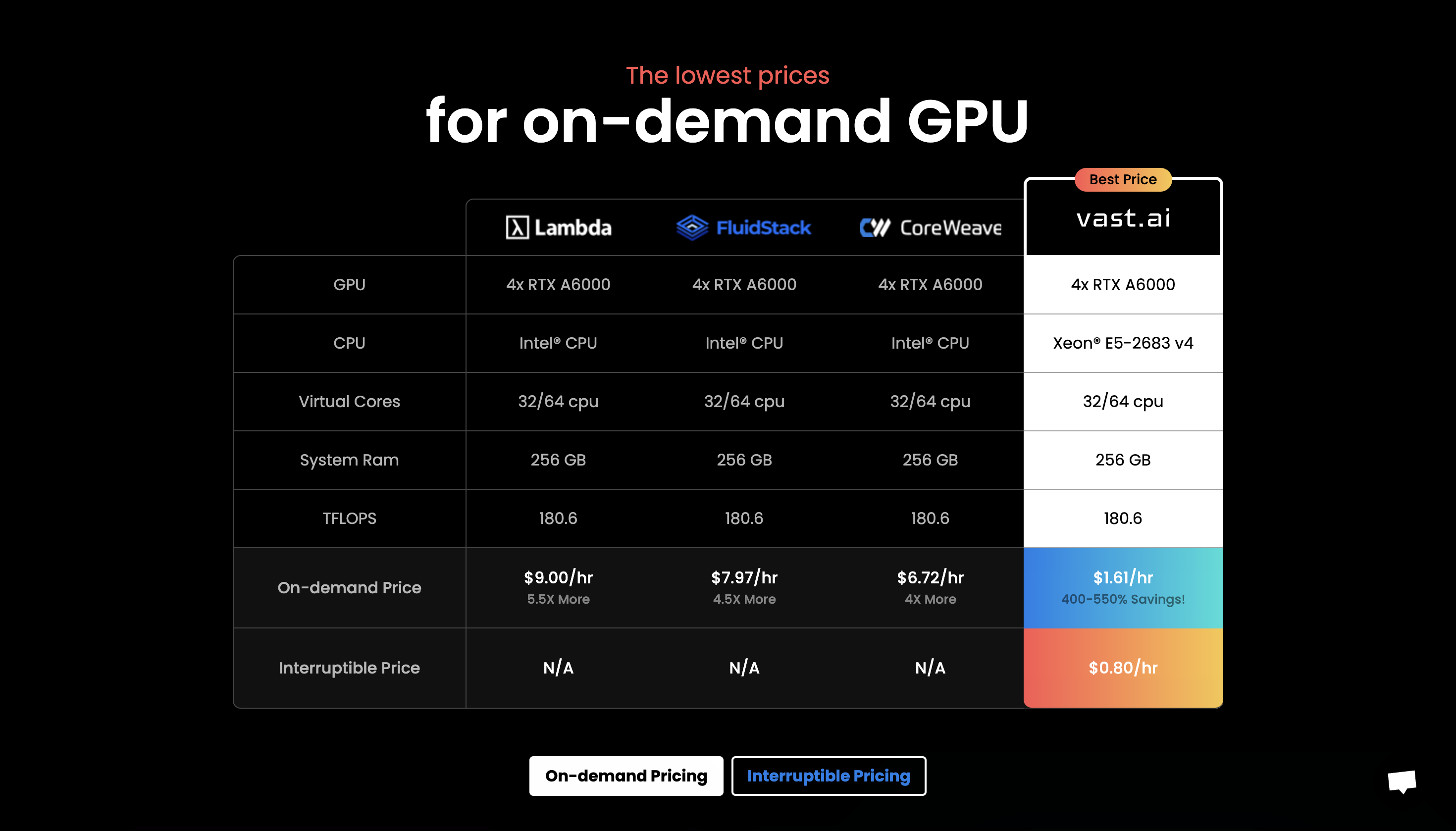

Priser

Priset börjar på $0.80/timme för 4x RTX A6000.

3. AWS & NVIDIA

Tillsammans levererar AWS och NVIDIA konsekvent GPU-baserade lösningar som är prisvärda, anpassningsbara och kraftfulla.

Den inkluderar NVIDIA GPU-drivna Amazon EC2-instanser och tjänster som AWS IoT Greengrass som installeras med NVIDIA Jetson Nano-moduler.

För virtuella arbetsstationer, maskininlärning (ML), Internet of Things (IoT)-tjänster och högpresterande beräkningar använder användarna AWS och NVIDIA. Skalbar prestanda tillhandahålls av NVIDIA GPU:er som driver Amazon EC2-instanser.

Använd dessutom AWS IoT Greengrass för att ansluta NVIDIA-baserade edge-enheter till AWS molntjänster.

Amazon EC2 P4d-instanser drivs av NVIDIA A100 Tensor Core GPU:er, som ger branschens lägsta latensnätverk och högsta genomströmning.

I likhet med detta finns det andra olika instanser tillgängliga för vissa omständigheter, såsom Amazon EC2 P3, Amazon EC2 G4, etc.

Priser

Du kan ansöka om en gratis provperiod och kontakta säljaren för prissättning.

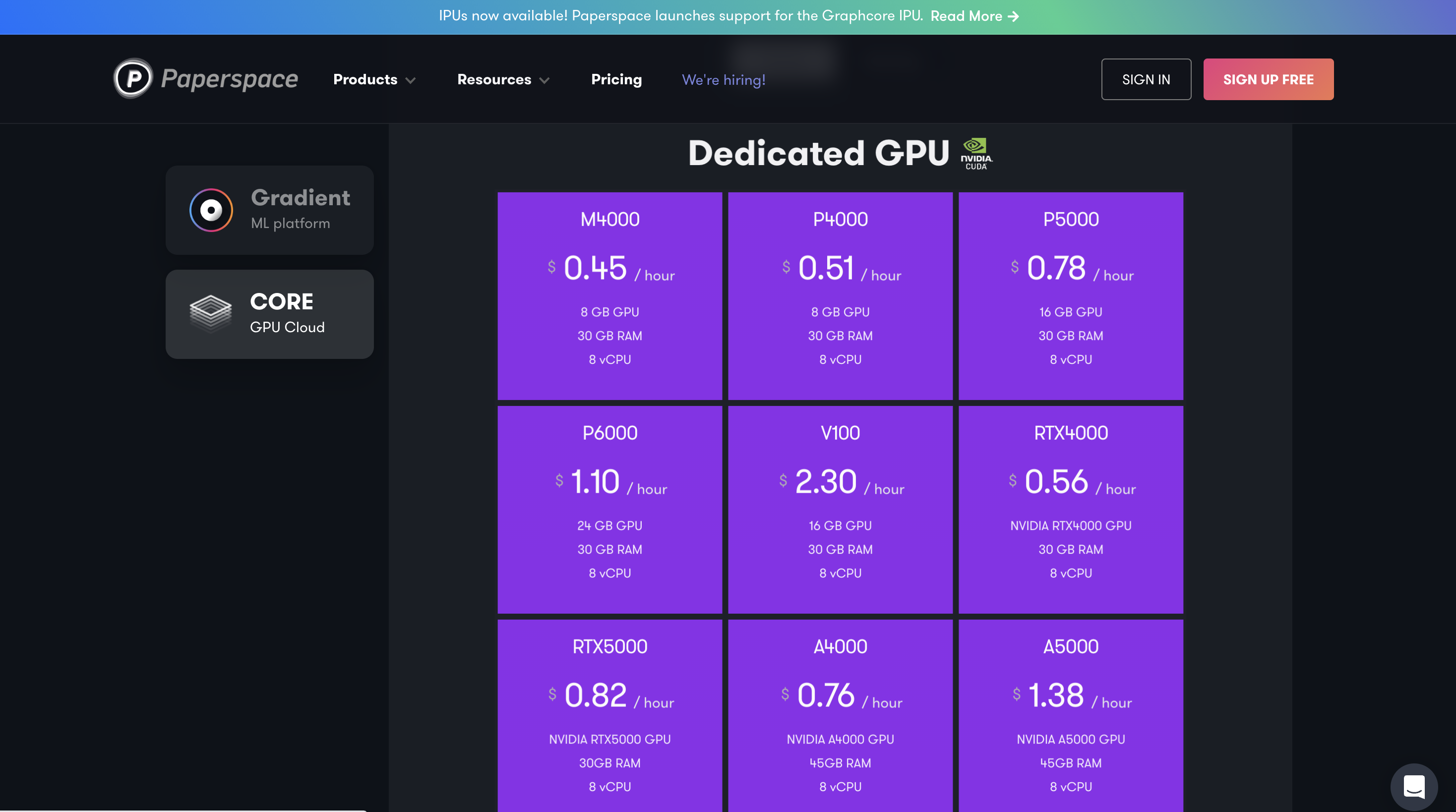

4. Paperspace CORE

A CORE är en helt hanterad moln-GPU-plattform skapad av Paperspace som ger enkel, kostnadseffektiv och accelererad datoranvändning för en mängd olika applikationer.

Använd den avancerade accelererade datorinfrastrukturen som tillhandahålls av Paperspace CORE för att påskynda organisatoriska processer. För snabb introduktion, samarbetsverktyg och stationära applikationer för Mac, Linux och Windows erbjuder den ett användarvänligt och okomplicerat gränssnitt.

Använd den för att köra krävande program med en oändlig mängd processorkraft. CORE erbjuder ett supersnabbt nätverk, snabb provisionering, stöd för 3D-appar och ett komplett API för programmatisk åtkomst.

Med ett lättanvänt och intuitivt GUI får du en heltäckande bild av din infrastruktur på en plats.

Få dessutom utmärkt kontroll tack vare CORE:s administrationsgränssnitt, som erbjuder kraftfulla verktyg och gör att du kan filtrera, sortera, ansluta eller skapa maskiner, nätverk och användare.

Priser

Priset börjar på $0.45/timme för den dedikerade M4000 GPU.

5. Alibaba Elastic GPU Service

Alibaba Elastic GPU Service (EGS) använder GPU-teknik för att leverera parallella och kraftfulla bearbetningsmöjligheter. Många applikationer, inklusive videobehandling, visualisering, vetenskaplig beräkning och djupinlärning, är väl lämpade för det.

EGS använder sig av ett antal grafikprocessorer, inklusive AMD FirePro S7150, NVIDIA Tesla M40, NVIDIA Tesla V100, NVIDIA Tesla P4 och NVIDIA Tesla P100.

Du kommer att ha tillgång till fördelar inklusive online tjänster och utbildning för djupinlärning, innehållsidentifiering, bild- och röstigenkänning, HD-mediakodning, videokonferenser, källfilmsrestaurering och 4K/8K HD live.

Få alternativ som videorendering, beräkningsfinansiering, klimatförutsägelse, kollisionssimulering, genteknik, icke-linjär redigering, distansutbildningsapplikationer och ingenjörsdesign.

Priser

Den erbjuder en gratis provperiod och prenumerationsplan, vilket innebär att du bara använder vilka instanser eller GPU:er du använder.

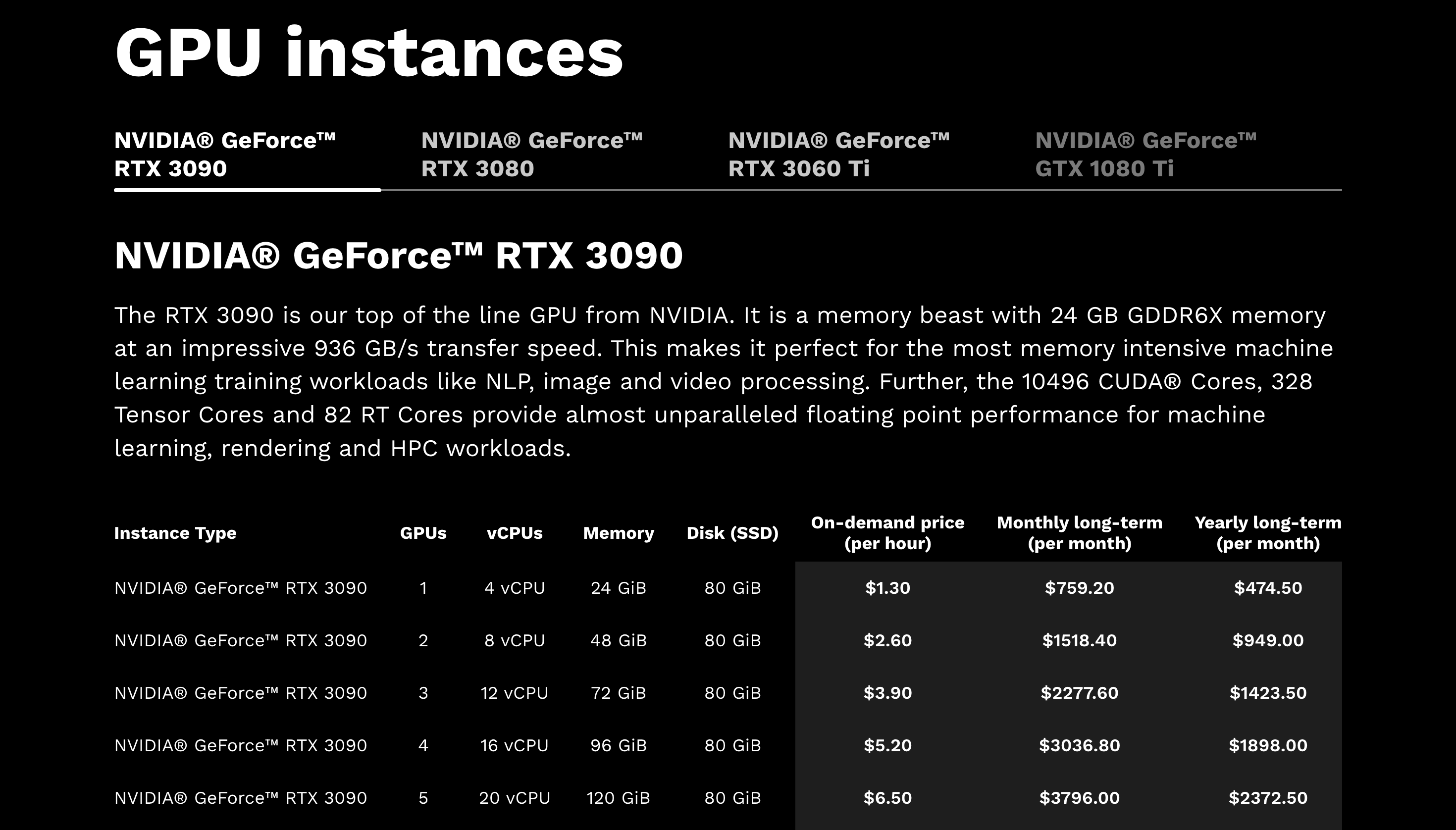

6. Genesis Cloud

Genesis Cloud erbjuder en mycket kostnadseffektiv moln-GPU-plattform. De arbetar i partnerskap med flera effektiva datacenter över hela världen för att tillhandahålla en mängd olika applikationer.

Genesis Cloud tillhandahåller ett brett utbud av användbara funktioner utan extra kostnad, inklusive ögonblicksbilder för säkerhetskopiering av ditt arbete, säkerhetsgrupper för nätverkstrafik, lagringsvolymer för stora datamängder, FastAI, PyTorch, förinställda bilder och ett offentligt TensorFlow API.

De snabbar på beräkningen med hjälp av NVIDIA GeForce RTX 3090, RTX 3080, RTX 3060 Ti och GTX 1080 Ti-tekniker i sina moln GPU-instanser.

Du kan använda kraften hos GPU-datorer för att producera animerade filmer eller träna neurala nätverk.

Priser

Priset börjar på 1.30 USD/timme för NVIDIA® GeForce™ RTX 3090.

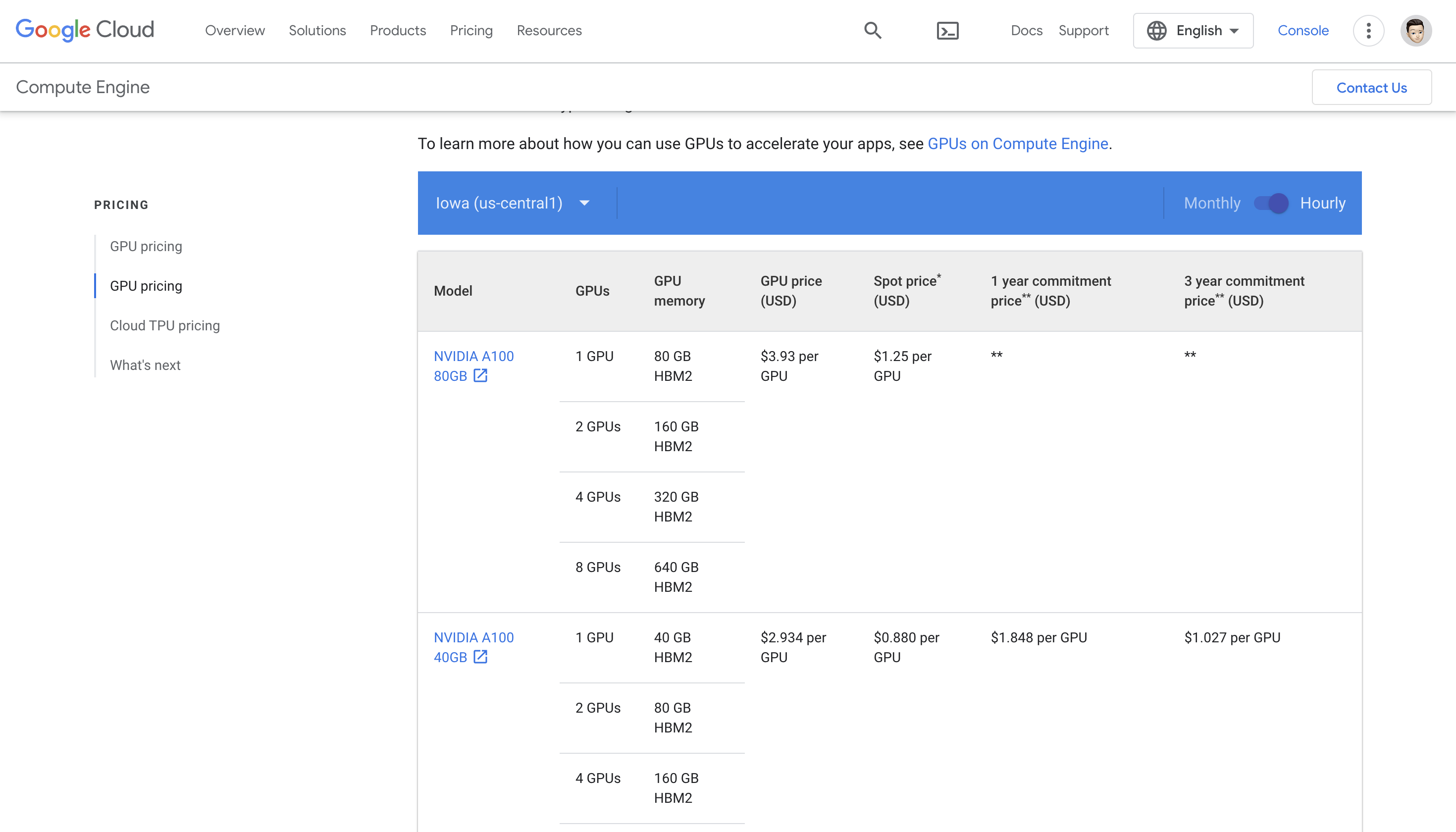

7. Google Cloud GPU

Google Cloud Platform (GCP) erbjuder ett antal GPU-instanser som kan användas för att påskynda processer som maskininlärning, djupinlärning och högpresterande datoranvändning (HPC).

Genom dessa GPU-instanser, som stöds av NVIDIA, AMD och Intel GPU:er, är det möjligt att komma åt CUDA- och cuDNN-biblioteken, som ofta används för GPU-accelererad datoranvändning.

På grund av maskinmodifieringar, flexibel prissättning och ett stort utbud av GPU-möjligheter kan HPC vara mer produktivt.

Dessutom kan det hjälpa dig att minska din arbetsbörda. Bland grafikprocessorerna de tillhandahåller är NVIDIA K80, P4, V100, A100, T4 och P100. Endast ett litet antal zoner utspridda på olika platser har tillgång till GPU:erna.

Priser

Kostnaden kommer att variera beroende på region, den GPU du väljer och maskintypen. För NVIDIA A100 börjar priserna på $3.93 per GPU.

8. NVIDIA GPU Cloud

NVIDIA GPU Cloud (NGC) är en molnbaserad plattform som ger användare tillgång till en mängd olika GPU-accelererade mjukvara, såsom visualiseringsverktyg, HPC-program och djupt lärande ramar.

Utvecklare, datavetare, och forskare kan nu enkelt använda datorkraften hos NVIDIA GPU:er i molnet utan att behöva oroa sig för den infrastruktur eller underhåll som behövs för att driva sina appar tack vare NGC.

Ett bibliotek med förkonfigurerade mjukvarubehållare ingår i NGC och kan snabbt distribueras på ett antal cloud computing infrastrukturer, inklusive Amazon Web Services, Google Cloud Platform och Microsoft Azure.

Tillgång till NGC ger också användare tillgång till NVIDIAs plattform för djupinlärning, som kommer med ett antal program och resurser för att skapa och implementera modeller för djupinlärning, inklusive TensorRT, cuDNN och CUDA-X AI.

Priser

Beroende på de specifika tjänster och resurser du använder ändras NVIDIA GPU Clouds (NGC) pris. Även om vissa NGC-tjänster, som mjukvarustacken för djupinlärning, är gratis att använda, kan andra, såsom HPC-applikationsbehållare, ta ut ett pris. Se NGC-katalogen.

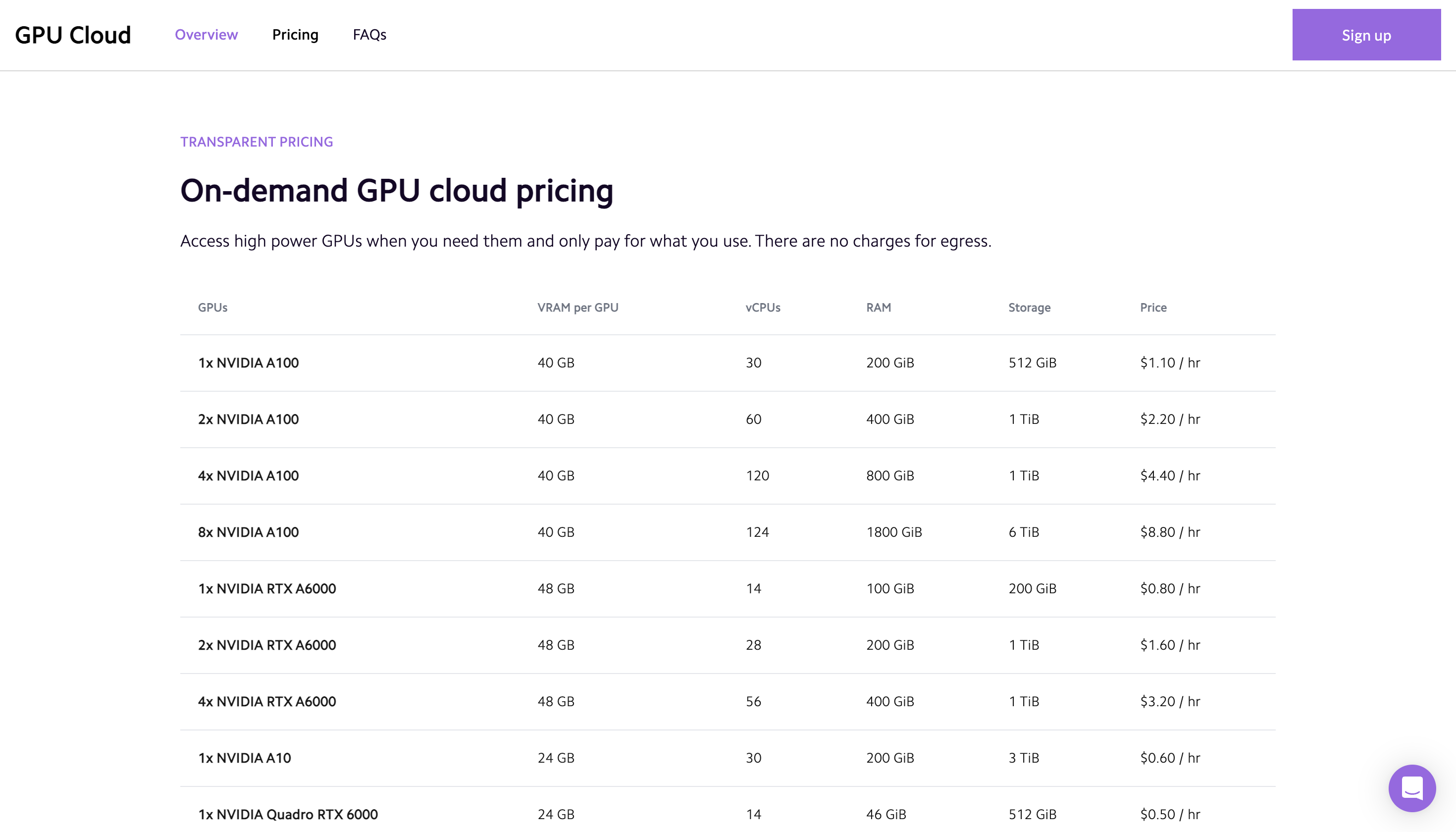

9. Lambda GPU Cloud

Lambda tillhandahåller moln-GPU-instanser för djupinlärningsmodellutbildning och skalbarhet från en enda fysisk dator till många virtuella maskiner.

Från instrumentpanelen får du omedelbart tillgång till varje maskins specialiserade Jupyter Notebook programmeringsmiljö. För direkt åtkomst, använd SSH direkt med en av SSH-nycklarna eller anslut via webbterminalen på molnets instrumentpanel.

Högst 10 Gbps av inter-nod-anslutning stöds av varje instans, vilket möjliggör distribuerad träning med ramverk som Horovod.

Att skala upp antalet GPU:er på en eller flera instanser kan hjälpa till att påskynda modelloptimeringen. Plattformen stöder GPU-instanser från NVIDIA RTX 6000, Quadro RTX 6000 och Tesla V100s.

Priser

Priset börjar på $1.10/timme för NVIDIA A100.

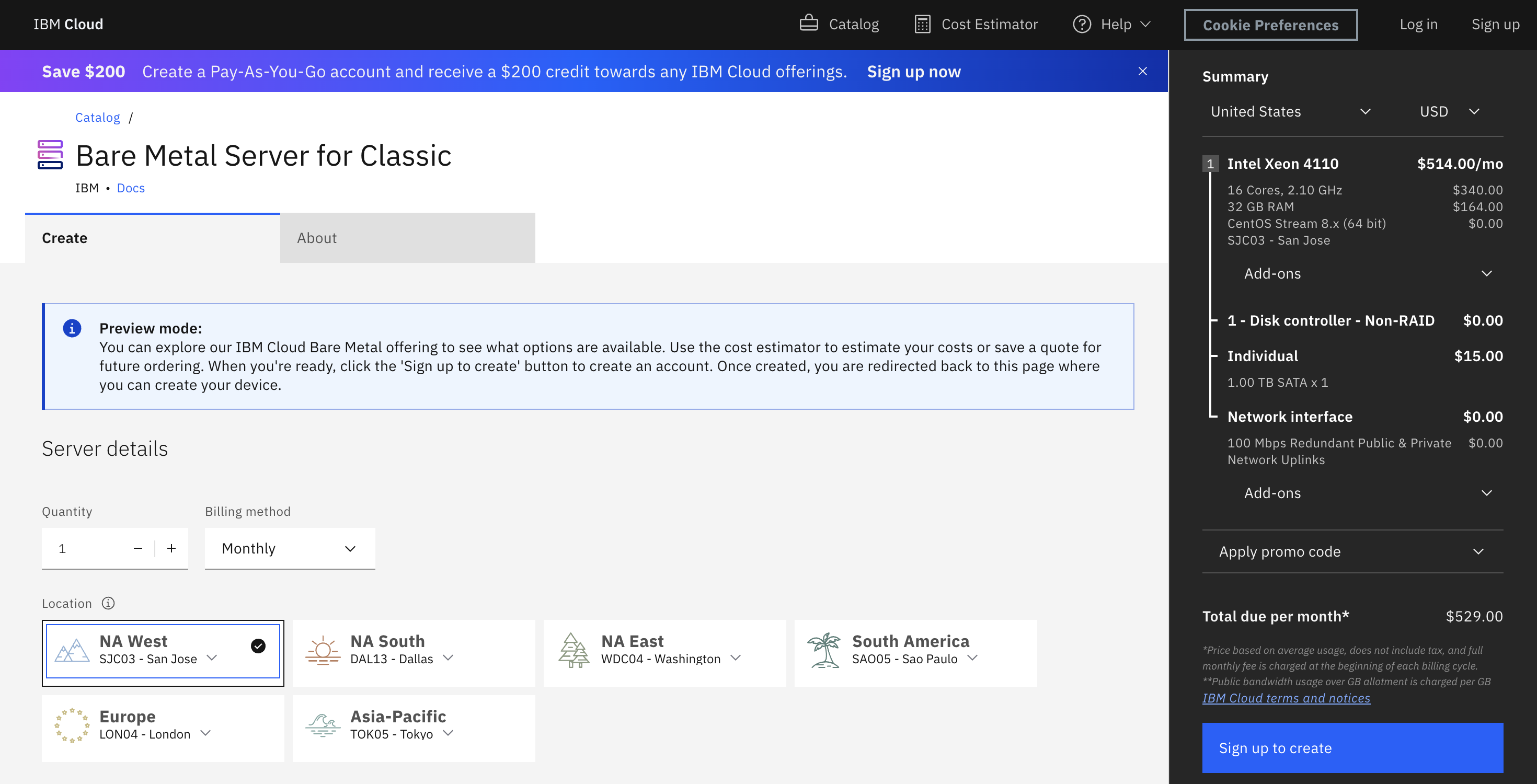

10. IBM Cloud GPU

IBM Cloud GPU använder ett globalt spritt nätverk av datacenter för att erbjuda flexibla servervalsprocedurer och smidig anslutning till IBMs molnarkitektur, API:er och applikationer.

Med Intel Xeon 4210, Xeon 5218 och Xeon 6248 GPU-instanser erbjuder den bara-metal Server GPU-alternativet.

Du kan köra högpresterande, fördröjningskänsliga, specialiserade och konventionella arbetsbelastningar direkt på serverhårdvara med bara-metal-instanser, precis som de kunde med lokala GPU:er.

För deras barmetallserveralternativ tillhandahåller de också instanser med NVIDIA T4 GPU:er och Intel Xeon-processorer med upp till 40 kärnor, samt instanser för deras virtuella serveralternativ med NVIDIA V100 och P100-modeller.

Priser

Priset börjar på $514/månad för Intel Xeon4110.

Slutsats

Slutligen, de bästa moln-GPU-tjänsterna för AI är de som erbjuder starka GPU-resurser, anpassningsbara prisval och enkel skalning.

Alla företag som tillhandahåller GPU-instanser för AI-arbetsbelastningar – AWS, NVIDIA, IBM och GCP – har utmärkta produktlinjer när det gäller prestanda och funktionalitet.

Det bästa alternativet bestäms i slutändan av dina unika krav, ekonomiska begränsningar, infrastruktur som redan finns på plats och leverantörspreferenser.

Kommentera uppropet