Преглед садржаја[Сакрити][Прикажи]

Будућност је ту. И у овој будућности машине схватају свет око себе на исти начин на који то чине људи. Компјутери могу да управљају аутомобилима, дијагностикују болести и прецизно предвиђају будућност.

Ово може изгледати као научна фантастика, али модели дубоког учења то чине стварношћу.

Ови софистицирани алгоритми откривају тајне вештачка интелигенција, омогућавајући рачунарима да самостално уче и развијају се. У овом посту ћемо се упустити у област модела дубоког учења.

И ми ћемо истражити огроман потенцијал који имају за револуцију у нашим животима. Припремите се да научите о најсавременијој технологији која мења будућност човечанства.

Шта су заправо модели дубоког учења?

Да ли сте икада играли игру у којој морате да идентификујете разлике између две слике?

Међутим, забавно је, може бити и тешко, зар не? Замислите да можете да научите рачунар да игра ту игру и сваки пут победи. Модели дубоког учења постижу управо то!

Модели дубоког учења су слични супер-паметним машинама које могу да испитају велики број слика и утврде шта им је заједничко. Они то постижу тако што растављају слике и проучавају сваку појединачно.

Затим примењују оно што су научили да идентификују обрасце и предвиђају нове слике које никада раније нису видели.

Модели дубоког учења су вештачке неуронске мреже које могу научити и извући компликоване обрасце и карактеристике из масивних скупова података. Ови модели се састоје од неколико слојева повезаних чворова, или неурона, који анализирају и мењају долазне податке да би генерисали излаз.

Модели дубоког учења су посебно погодни за послове који захтевају велику тачност и прецизност, као што су идентификација слике, препознавање говора, обрада природног језика и роботика.

Коришћени су у свему, од самовозећих аутомобила до медицинске дијагностике, система за препоруке и предиктивна аналитика.

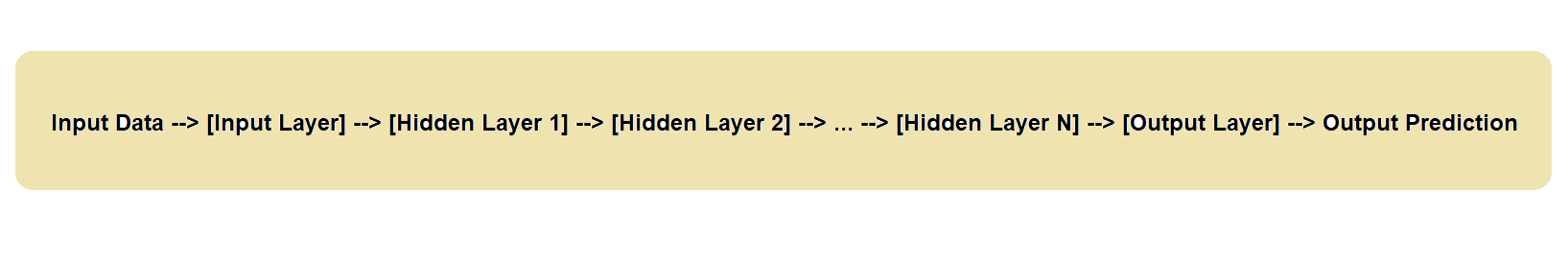

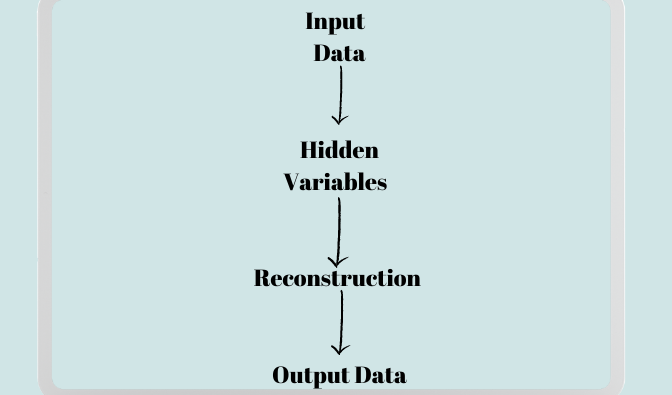

Ево поједностављене верзије визуелизације која илуструје ток података у моделу дубоког учења.

Улазни подаци теку у улазни слој модела, који затим прослеђује податке кроз бројне скривене слојеве пре него што обезбеди излазно предвиђање.

Сваки скривени слој изводи низ математичких операција над улазним подацима пре него што их проследи следећем слоју, који даје коначно предвиђање.

Сада, да видимо шта су модели дубоког учења и како их можемо користити у свом животу.

1. Конволуционе неуронске мреже (ЦНН)

ЦНН су модел дубоког учења који је трансформисао област компјутерског вида. ЦНН се користе за класификацију слика, препознавање објеката и сегментирање слика. Структура и функција људског визуелног кортекса информисали су о дизајну ЦНН-а.

Како раде?

ЦНН се састоји од низа конволуционих слојева, слојева за удруживање и потпуно повезаних слојева. Улаз је слика, а излаз је предвиђање ознаке класе слике.

Конволуцијски слојеви ЦНН-а граде мапу карактеристика тако што изводе тачкасти производ између улазне слике и скупа филтера. Слојеви за обједињавање смањују величину мапе обележја смањивањем узорковања.

Коначно, мапу карактеристика користе потпуно повезани слојеви за предвиђање ознаке класе слике.

Зашто су ЦНН важни?

ЦНН-ови су неопходни јер могу да науче да откривају обрасце и карактеристике на сликама које је људима тешко приметити. ЦНН се могу научити да препознају карактеристике као што су ивице, углови и текстуре користећи велике скупове података. Након што научи ова својства, ЦНН их може користити за идентификацију објеката на свежим фотографијама. ЦНН су демонстрирали врхунске перформансе на разним апликацијама за идентификацију слика.

Где користимо ЦНН

Здравство, аутомобилска индустрија и малопродаја су само неки сектори који запошљавају ЦНН. У здравственој индустрији, они могу бити корисни за дијагнозу болести, развој лекова и анализу медицинске слике.

У аутомобилском сектору помажу у откривању трака, откривање објекта, и аутономна вожња. Такође се у великој мери користе у малопродаји за визуелну претрагу, препоруку производа засновану на сликама и контролу залиха.

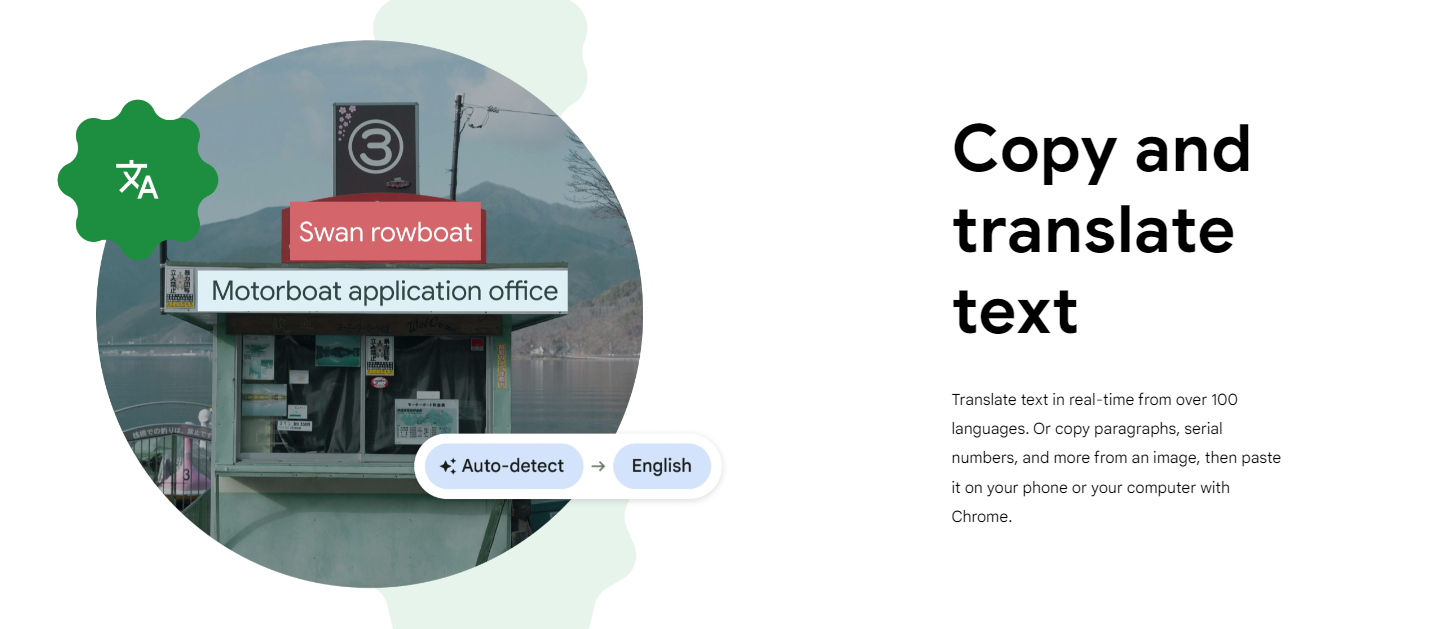

На пример; Гоогле користи ЦНН у разним апликацијама, укључујући Гоогле објектив, популаран алат за идентификацију слика. Програм користи ЦНН за процену фотографија и пружање информација корисницима.

Гоогле објектив, на пример, може да препозна ствари на слици и понуди детаље о њима, као што је врста цвета.

Такође може да преведе текст који је извучен из слике на више језика. Гоогле Ленс је у стању да потрошачима пружи корисне информације због помоћи ЦНН-а у прецизној идентификацији ставки и издвајању карактеристика из фотографија.

2. Мреже дуготрајне краткорочне меморије (ЛСТМ).

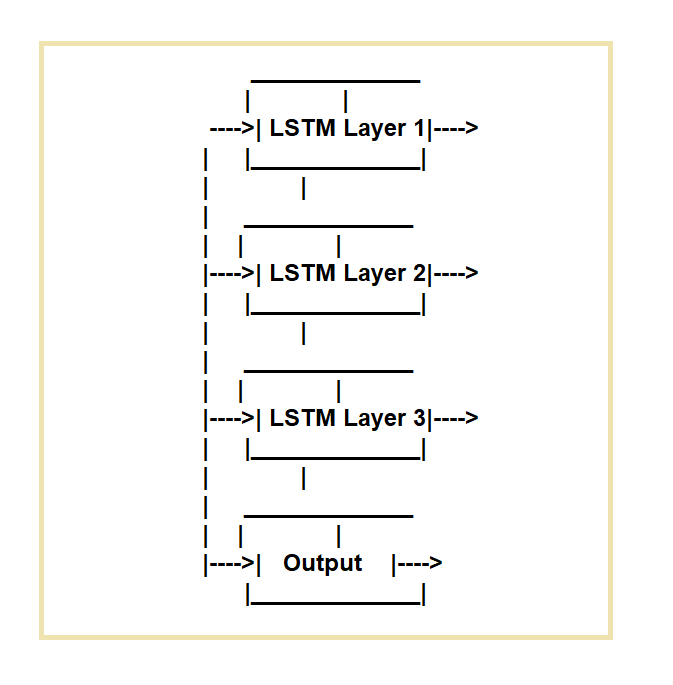

Мреже дуготрајне меморије (ЛСТМ) су креиране да би се позабавиле недостацима редовних рекурентних неуронских мрежа (РНН). ЛСТМ мреже су идеалне за задатке који захтевају обраду низова података током времена.

Они функционишу тако што користе специфичну меморијску ћелију и три механизма гајта.

Они регулишу проток информација у и из ћелије. Улазна капија, капија заборава и излазна капија су три капије.

Улазна капија регулише проток података у меморијску ћелију, капија за заборав регулише брисање података из ћелије, а излазна капија регулише ток података из ћелије.

Какав је њихов значај?

ЛСТМ мреже су корисне јер могу успешно представити и предвидети низове података са дугорочним везама. Они могу да забележе и задрже информације о претходним инпутима, омогућавајући им да праве прецизније предвиђања о будућим инпутима.

Препознавање говора, препознавање рукописа, обрада природног језика и титловање слика су само неке од апликација које су користиле ЛСТМ мреже.

Где користимо ЛСТМ мреже?

Многе софтверске и технолошке апликације користе ЛСТМ мреже, укључујући системе за препознавање говора, алате за обраду природних језика као што су анализа сентимента, системи за машинско превођење и системи за генерисање текста и слика.

Такође су коришћени у стварању аутомобила и робота који се сами возе, као и у финансијској индустрији за откривање преваре и предвиђање берза покрети.

3. Генеративне адверсаријске мреже (ГАН)

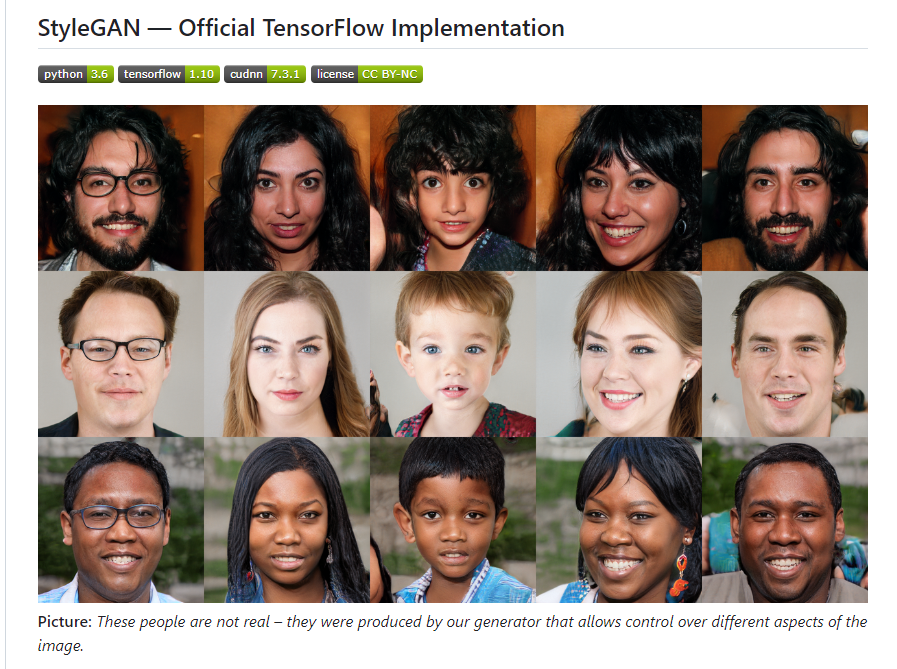

ГАН-ови су а дубоко учење техника која се користи за генерисање нових узорака података који су слични датом скупу података. ГАН се састоје од два неуронске мреже: онај који учи да производи нове узорке и онај који учи да прави разлику између оригиналних и генерисаних узорака.

У сличном приступу, ове две мреже се тренирају заједно све док генератор не може да генерише узорке који се не разликују од стварних.

Зашто користимо ГАН-ове

ГАН-ови су значајни због свог капацитета за производњу високог квалитета синтетички подаци који се могу користити за разне апликације, укључујући продукцију слика и видео записа, генерисање текста, па чак и генерисање музике.

ГАН-ови су такође коришћени за повећање података, што је генерација синтетички подаци да допуни податке из стварног света и побољша перформансе модела машинског учења.

Штавише, стварањем синтетичких података који се могу користити за обуку модела и имитацију испитивања, ГАН-ови имају потенцијал да трансформишу секторе као што су медицина и развој лекова.

Примене ГАН-ова

ГАН могу допунити скупове података, креирати нове слике или филмове, па чак и генерисати синтетичке податке за научне симулације. Штавише, ГАН-ови имају потенцијал да се користе у различитим апликацијама у распону од забаве до медицине.

старости и видео снимци. НВИДИА СтилеГАН2, на пример, коришћен је за креирање висококвалитетних фотографија познатих личности и уметничких дела.

4. Мреже дубоког веровања (ДБН)

Мреже дубоког веровања (ДБН) су вештачка интелигенција системи који могу научити да уоче обрасце у подацима. Они то постижу тако што сегментирају податке у све мање и мање делове, стицање детаљнијег разумевања на сваком нивоу.

ДБН-ови могу да уче из података, а да нису обавештени шта су то (ово се назива „учење без надзора“). То их чини изузетно вредним за откривање образаца у подацима које би некој особи било тешко или немогуће уочити.

Шта чини ДБН-ове значајним?

ДБН-ови су значајни због своје способности да науче хијерархијске репрезентације података. Ове репрезентације се могу користити за различите апликације као што су класификација, детекција аномалија и смањење димензионалности.

Капацитет ДБН-а да предузме неконтролисану прет-обуку, која може повећати перформансе модела дубоког учења са минималним означеним подацима, представља значајну корист.

Које су примене ДБН-а?

Једна од најзначајнијих апликација је откривање објекта, у којој се ДБН-ови користе за препознавање одређених врста ствари као што су авиони, птице и људи. Такође се користе за генерисање и класификацију слика, детекцију покрета у филмовима и разумевање природног језика за обраду гласа.

Штавише, ДБН се обично користе у скуповима података за процену људских положаја. ДБН-ови су одличан алат за различите индустрије, укључујући здравство и банкарство и технологију.

5. Мреже за учење са дубоким појачањем (ДРЛ)

Дубоко Учење ојачања Мреже (ДРЛ) интегришу дубоке неуронске мреже са техникама учења појачања како би омогућиле агентима да уче у компликованом окружењу путем покушаја и грешака.

ДРЛ се користе да науче агенте како да оптимизују сигнал награде интеракцијом са околином и учењем на својим грешкама.

Шта их чини изузетним?

Ефикасно су коришћени у разним апликацијама, укључујући игре, роботику и аутономну вожњу. ДРЛ-ови су важни јер могу да уче директно из сировог сензорног уноса, омогућавајући агентима да доносе одлуке на основу њихове интеракције са окружењем.

Важне апликације

ДРЛ се користе у стварним околностима јер могу да реше тешке проблеме.

ДРЛ-ови су укључени у неколико истакнутих софтверских и технолошких платформи, укључујући ОпенАИ'с Гим, Унити-ови МЛ-агентии Гоогле ДеепМинд Лаб. АлпхаГо, коју је направио Гоогле ДеепМинд, на пример, користи ДРЛ за играње друштвене игре Го на нивоу светског шампиона.

Друга употреба ДРЛ-а је у роботици, где се користи за контролу покрета роботских руку за извршавање задатака као што су хватање ствари или слагање блокова. ДРЛ-ови имају много намена и користан су алат за обуку агената за учење и доносити одлуке у компликованим окружењима.

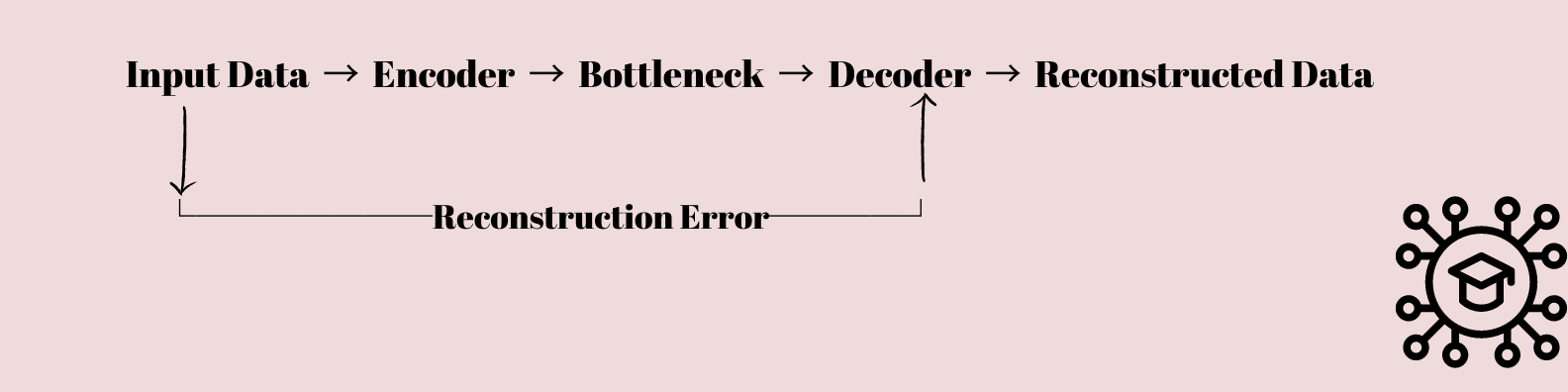

6. Аутоенцодерс

Аутоенкодери су занимљива врста неуронска мрежа то је привукло интересовање и научника и научника података. Они су у основи дизајнирани да науче како да компримују и враћају податке.

Улазни подаци се уносе кроз низ слојева који постепено смањују димензионалност података све док се не компримују у слој са уским грлом са мање чворова од улазног и излазног слоја.

Ова компримована репрезентација се затим користи за поновно креирање оригиналних улазних података коришћењем низа слојева који постепено подижу димензионалност података у првобитни облик.

Зашто је важно?

Аутоенкодери су кључна компонента дубоко учење јер омогућавају екстракцију карактеристика и смањење података.

Они су у стању да идентификују кључне елементе долазних података и преведу их у компримовани облик који се затим може применити на друге задатке као што су класификација, груписање или креирање нових података.

Где користимо аутоматске енкодере?

Откривање аномалија, обрада природног језика и рачунарски вид су само неке од дисциплина у којима се користе аутоенкодери. Аутоенкодери се, на пример, могу користити за компресију слике, смањење шума и синтезу слике у компјутерском виду.

Можемо да користимо аутоматске енкодере у задацима као што су креирање текста, категоризација текста и сумирање текста у обради природног језика. Може да идентификује аномалну активност у подацима који одступају од норме у идентификацији аномалија.

7. Мреже капсула

Цапсуле Нетворкс је нова архитектура дубоког учења која је развијена као замена за конволуционе неуронске мреже (ЦНН).

Мреже капсула су засноване на идеји груписања можданих јединица које се називају капсуле које су одговорне за препознавање постојања одређене ставке на слици и кодирање њених атрибута, као што су оријентација и позиција, у њихове излазне векторе. Цапсуле Нетворкс стога могу боље управљати просторним интеракцијама и флуктуацијама перспективе од ЦНН-а.

Зашто бирамо Цапсуле Нетворкс уместо ЦНН-а?

Мреже капсула су корисне јер превазилазе потешкоће ЦНН-а у хватању хијерархијских односа између ставки на слици. ЦНН могу препознати ствари различитих величина, али се боре да схвате како се ове ставке повезују једна са другом.

Мреже капсула, с друге стране, могу да науче да препознају ствари и њихове делове, као и како су оне просторно смештене на слици, што их чини одрживим кандидатом за апликације компјутерског вида.

Области примене

Мреже капсула су већ показале обећавајуће резултате у различитим апликацијама, укључујући класификацију слика, идентификацију објеката и сегментацију слике.

Коришћени су за разликовање ствари на медицинским фотографијама, препознавање људи у филмовима, па чак и за креирање 3Д модела од 2Д слика.

Да би повећали своје перформансе, Цапсуле Нетворкс су комбиноване са другим архитектурама дубоког учења као што су Генеративне Адверсариал Нетворкс (ГАН) и Вариатион Аутоенцодерс (ВАЕс). Предвиђа се да ће Цапсуле Нетворкс играти све виталнију улогу у унапређењу технологија компјутерског вида како се наука о дубоком учењу развија.

На пример; Нибабел је добро позната Питхон алатка за читање и писање типова датотека неуроимаџинга. За сегментацију слике користи Цапсуле Нетворкс.

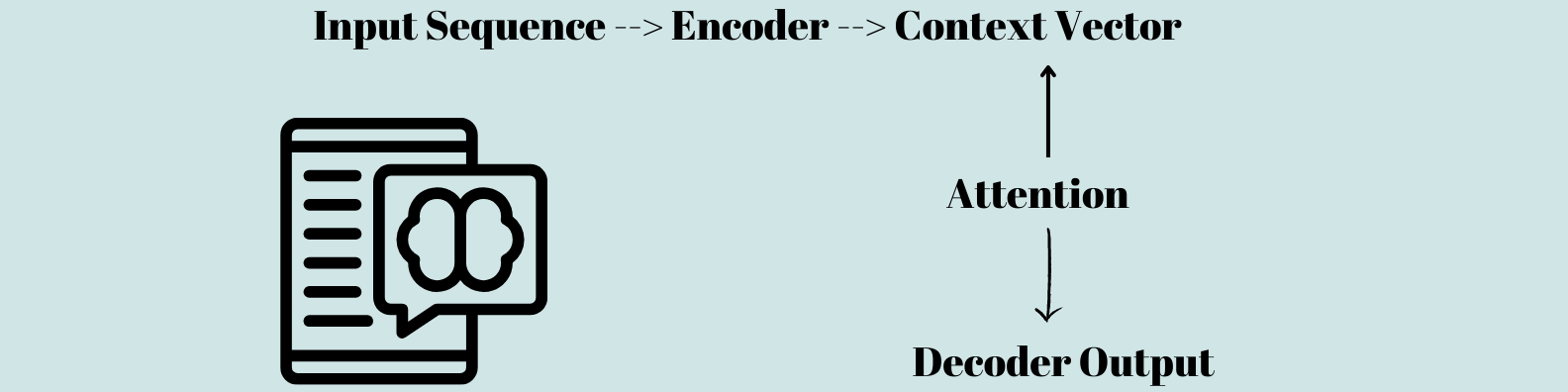

8. Модели засновани на пажњи

Модели дубоког учења познати као модели засновани на пажњи, познати и као механизми пажње, настоје да повећају тачност модели машинског учења. Ови модели раде тако што се концентришу на одређене карактеристике долазних података, што резултира ефикаснијом и ефективнијом обрадом.

У задацима обраде природног језика као што су машинско превођење и анализа осећања, методе пажње су се показале прилично успешним.

Који је њихов значај?

Модели засновани на пажњи су корисни јер омогућавају ефикаснију и ефикаснију обраду компликованих података.

Традиционалне неуронске мреже проценити све улазне податке као подједнако важне, што доводи до спорије обраде и смањене тачности. Процеси пажње се концентришу на кључне аспекте улазних података, омогућавајући брже и прецизније предвиђање.

Области употребе

У области вештачке интелигенције, механизми пажње имају широк спектар примена, укључујући обраду природног језика, препознавање слике и звука, па чак и возила без возача.

Методе пажње, на пример, могу се користити за побољшање машинског превођења у обради природног језика омогућавајући систему да се фокусира на одређене речи или фразе које су кључне за контекст.

Методе пажње у аутономним аутомобилима могу се користити да помогну систему да се фокусира на одређене ствари или изазове у свом окружењу.

9. Трансформаторске мреже

Трансформаторске мреже су модели дубоког учења који испитују и производе низове података. Они функционишу тако што обрађују улазну секвенцу један по елемент и производе излазну секвенцу исте или различите дужине.

Трансформаторске мреже, за разлику од стандардних модела секвенце до секвенце, не обрађују секвенце користећи рекурентне неуронске мреже (РНН). Уместо тога, они користе процесе самопажње како би научили везе између делова секвенце.

Која је важност трансформаторских мрежа?

Мреже трансформатора су постале популарне последњих година као резултат њиховог бољег учинка у пословима обраде природног језика.

Посебно су погодни за задатке креирања текста као што су превод језика, резимирање текста и производња разговора.

Мреже трансформатора су знатно ефикасније у рачунарском смислу од модела заснованих на РНН-у, што их чини пожељним избором за апликације великих размера.

Где можете пронаћи трансформаторске мреже?

Трансформаторске мреже се широко користе у широком спектру апликација, пре свега у обради природног језика.

ГПТ (Генеративе Пре-траинед Трансформер) серија је истакнути модел заснован на трансформатору који је коришћен за задатке као што су превођење језика, сумирање текста и генерисање цхатбот-а.

БЕРТ (Бидирецтионал Енцодер Репресентатионс фром Трансформерс) је још један уобичајен модел заснован на трансформаторима који се користи за апликације разумевања природног језика као што су одговарање на питања и анализа осећања.

Оба ГПТ и БЕРТ су креирани са ПиТорцх, оквир за дубоко учење отвореног кода који је био популаран за развој модела заснованих на трансформаторима.

10. Ограничене Болцманове машине (РБМ)

Ограничене Болцманове машине (РБМ) су врста неуронске мреже без надзора која учи на генеративни начин. Због своје способности да уче и извлаче битне карактеристике из високодимензионалних података, они су нашироко коришћени у областима машинског учења и дубоког учења.

РБМ се састоје од два слоја, видљивог и скривеног, при чему се сваки слој састоји од групе неурона повезаних пондерисаним ивицама. РБМ су дизајнирани да науче дистрибуцију вероватноће која описује улазне податке.

Шта су ограничене Болтзманнове машине?

РБМ користе генеративну стратегију учења. У РБМ-овима, видљиви слој одражава улазне податке, док закопани слој кодира карактеристике улазних података. Тежина видљивог и скривеног слоја показује снагу њихове везе.

РБМ подешавају тежине и предрасуде између слојева током тренинга користећи технику познату као контрастна дивергенција. Контрастивна дивергенција је стратегија учења без надзора која максимизира вероватноћу предвиђања модела.

Какав је значај ограничених Болцманових машина?

РБМ-ови су значајни у Машина учење и дубоко учење јер могу научити и извући релевантне карактеристике из великих количина података.

Веома су ефикасни за препознавање слике и говора и коришћени су у разним апликацијама као што су системи препорука, детекција аномалија и смањење димензионалности. РБМ могу пронаћи обрасце у огромним скуповима података, што резултира супериорним предвиђањима и увидима.

Где се могу користити ограничене Болтзманн машине?

Апликације за РБМ укључују смањење димензионалности, детекцију аномалија и системе препорука. РБМ-ови су посебно корисни за анализу расположења и моделовање тема у контексту обраде природног језика.

Мреже дубоких веровања, нека врста неуронске мреже која се користи за препознавање гласа и слике, такође користе РБМ. Дееп Белиеф Нетворк Тоолбок, ТенсорФлов, и Тхеано су неки конкретни примери софтвера или технологије која користи РБМ-ове.

Упаковати

Модели дубоког учења постају све важнији у разним индустријама, укључујући препознавање говора, обраду природног језика и компјутерски вид.

Конволуционе неуронске мреже (ЦНН) и рекурентне неуронске мреже (РНН) су показале највише обећања и интензивно се користе у многим апликацијама, међутим, сви модели дубоког учења имају своје предности и мане.

Међутим, истраживачи још увек истражују Ограничене Болцманове машине (РБМ) и друге варијанте модела дубоког учења јер и они имају посебне предности.

Очекује се да ће се креирати нови и креативни модели како област дубоког учења наставља да напредује у циљу решавања тежих проблема

Ostavite komentar