Kazalo[Skrij][Pokaži]

Prihodnost je tukaj. In v tej prihodnosti stroji razumejo svet okoli sebe na enak način kot ljudje. Računalniki lahko vozijo avtomobile, diagnosticirajo bolezni in natančno napovedujejo prihodnost.

To se morda zdi znanstvena fantastika, vendar modeli globokega učenja to uresničujejo.

Ti sofisticirani algoritmi razkrivajo skrivnosti Umetna inteligenca, ki računalnikom omogoča samoučenje in razvoj. V tej objavi se bomo poglobili v področje modelov globokega učenja.

In raziskali bomo ogromen potencial, ki ga imajo za revolucijo naših življenj. Pripravite se na spoznavanje vrhunske tehnologije, ki spreminja prihodnost človeštva.

Kaj točno so modeli globokega učenja?

Ste že kdaj igrali igro, v kateri morate prepoznati razlike med dvema slikama?

Je pa zabavno, lahko pa je tudi težko, kajne? Predstavljajte si, da bi lahko naučili računalnik igrati to igro in vsakič zmagati. Modeli globokega učenja dosegajo prav to!

Modeli globokega učenja so podobni superpametnim strojem, ki lahko pregledajo veliko število slik in ugotovijo, kaj imajo skupnega. To dosežejo z razstavljanjem slik in preučevanjem vsake posebej.

Nato uporabijo, kar so se naučili, da prepoznajo vzorce in naredijo napovedi o svežih slikah, ki jih še nikoli niso videli.

Modeli globokega učenja so umetne nevronske mreže, ki se lahko učijo in izločijo zapletene vzorce in značilnosti iz ogromnih naborov podatkov. Ti modeli so sestavljeni iz več plasti povezanih vozlišč ali nevronov, ki analizirajo in spreminjajo dohodne podatke, da ustvarijo izhod.

Modeli globokega učenja so še posebej primerni za delovna mesta, ki zahtevajo veliko točnost in natančnost, kot so identifikacija slik, prepoznavanje govora, obdelava naravnega jezika in robotika.

Uporabljajo se v vsem, od samovozečih avtomobilov do medicinske diagnostike, sistemov za priporočila in napovedna analitika.

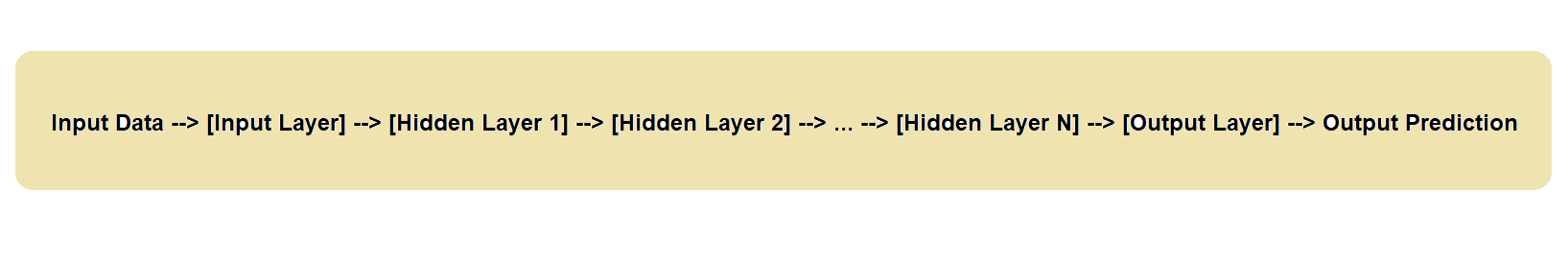

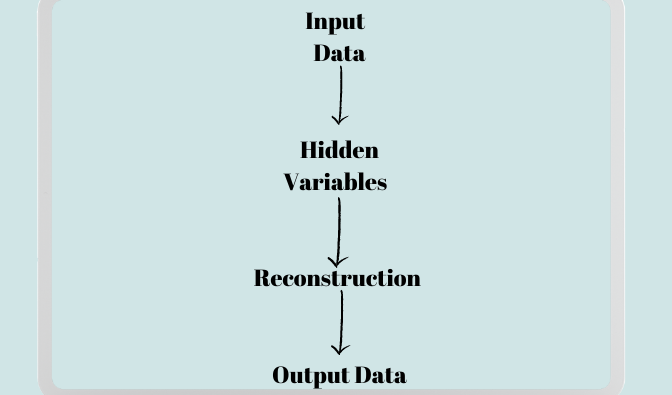

Tukaj je poenostavljena različica vizualizacije za ponazoritev pretoka podatkov v modelu globokega učenja.

Vhodni podatki tečejo v vhodno plast modela, ki nato podatke prenese skozi številne skrite plasti, preden zagotovi izhodno napoved.

Vsaka skrita plast izvede niz matematičnih operacij na vhodnih podatkih, preden jih posreduje naslednji plasti, ki zagotovi končno napoved.

Zdaj pa poglejmo, kaj so modeli globokega učenja in kako jih lahko uporabimo v svojem življenju.

1. Konvolucijske nevronske mreže (CNN)

CNN so model globokega učenja, ki je spremenil področje računalniškega vida. CNN se uporabljajo za razvrščanje slik, prepoznavanje predmetov in segmentiranje slik. Struktura in funkcija človeške vidne skorje sta vplivala na oblikovanje CNN.

Kako delujejo?

CNN je sestavljen iz številnih konvolucijskih plasti, plasti združevanja in popolnoma povezanih plasti. Vhod je slika, izhod pa napoved oznake razreda slike.

CNN-ove konvolucijske plasti izdelajo zemljevid funkcij tako, da izvedejo pikčasti produkt med vhodno sliko in nizom filtrov. Plasti združevanja zmanjšajo velikost zemljevida funkcij tako, da ga zmanjšajo.

Nazadnje, zemljevid funkcij uporabljajo popolnoma povezani sloji za predvidevanje oznake razreda slike.

Zakaj so CNN-ji pomembni?

CNN so bistveni, ker se lahko naučijo odkrivati vzorce in značilnosti v slikah, ki jih ljudje težko opazijo. CNN je mogoče naučiti prepoznavanja značilnosti, kot so robovi, vogali in teksture, z uporabo velikih podatkovnih nizov. Ko se nauči teh lastnosti, jih lahko CNN uporabi za prepoznavanje predmetov na svežih fotografijah. CNN so dokazali vrhunsko zmogljivost pri različnih aplikacijah za identifikacijo slik.

Kje uporabljamo CNN

Zdravstveno varstvo, avtomobilska industrija in maloprodaja so le nekateri sektorji, ki zaposlujejo CNN. V zdravstveni industriji so lahko koristni za diagnozo bolezni, razvoj zdravil in analizo medicinske slike.

V avtomobilskem sektorju pomagajo pri zaznavanju voznega pasu, odkrivanje predmetov, in avtonomna vožnja. Veliko jih uporabljajo tudi v maloprodaji za vizualno iskanje, priporočila izdelkov na podlagi slik in nadzor inventarja.

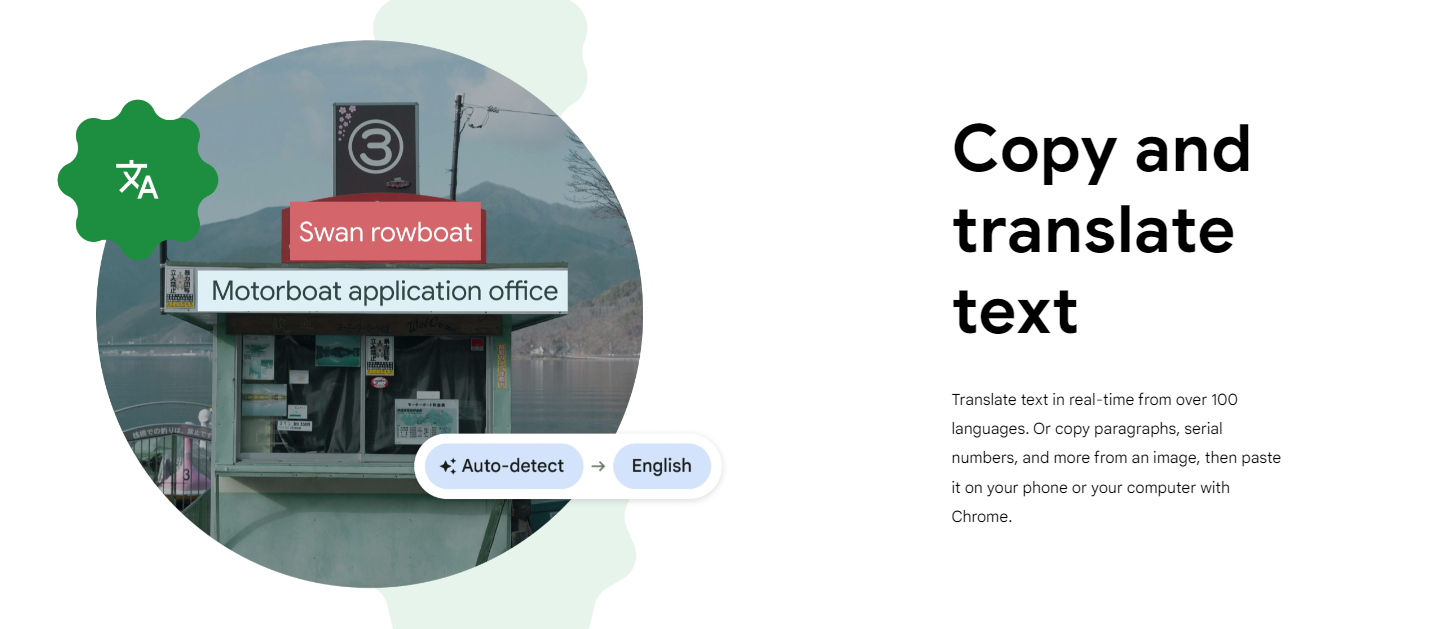

Na primer; Google uporablja CNN v različnih aplikacijah, vključno z Google Lens, zelo priljubljeno orodje za identifikacijo slik. Program uporablja CNN za ocenjevanje fotografij in dajanje informacij uporabnikom.

Google Lens lahko na primer prepozna stvari na sliki in ponudi podrobnosti o njih, na primer vrsto rože.

Prav tako lahko prevede besedilo, ki je izvlečeno iz slike, v več jezikov. Google Lens lahko potrošnikom ponudi uporabne informacije zaradi pomoči CNN pri natančnem prepoznavanju predmetov in pridobivanju značilnosti iz fotografij.

2. Omrežja dolgotrajnega pomnilnika (LSTM).

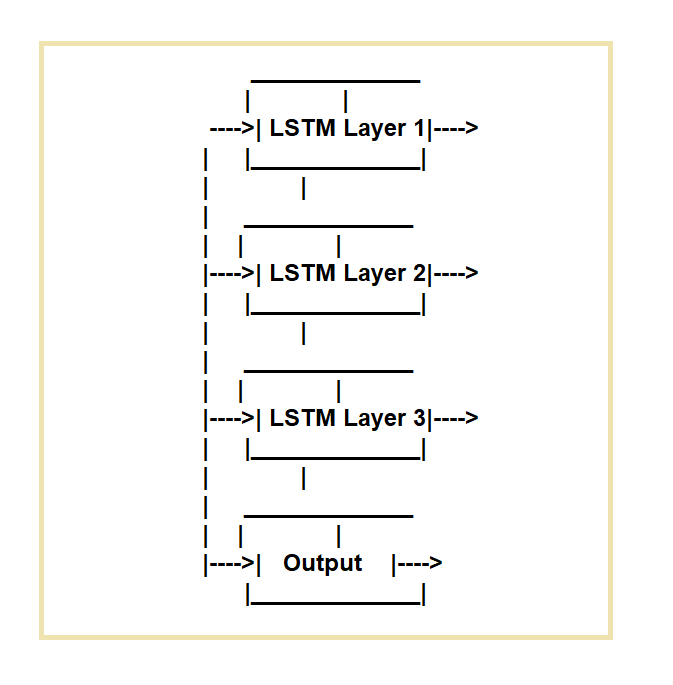

Omrežja dolgotrajnega kratkoročnega spomina (LSTM) so ustvarjena za odpravljanje pomanjkljivosti rednih ponavljajočih se nevronskih mrež (RNN). Omrežja LSTM so idealna za naloge, ki zahtevajo obdelavo zaporedij podatkov skozi čas.

Delujejo tako, da uporabljajo posebno pomnilniško celico in tri zaporne mehanizme.

Uravnavajo pretok informacij v celico in iz nje. Vhodna vrata, pozabljena vrata in izhodna vrata so tri vrata.

Vhodna vrata uravnavajo pretok podatkov v pomnilniško celico, pozabljena vrata uravnavajo brisanje podatkov iz celice, izhodna vrata pa uravnavajo pretok podatkov iz celice.

Kakšen je njihov pomen?

Omrežja LSTM so uporabna, ker lahko uspešno predstavljajo in napovedujejo zaporedja podatkov z dolgoročnimi odnosi. Lahko posnamejo in hranijo informacije o prejšnjih vložkih, kar jim omogoča natančnejše napovedi o prihodnjih vložkih.

Prepoznavanje govora, prepoznavanje rokopisa, obdelava naravnega jezika in podnapisi so le nekatere od aplikacij, ki uporabljajo omrežja LSTM.

Kje uporabljamo omrežja LSTM?

Številne programske in tehnološke aplikacije uporabljajo omrežja LSTM, vključno s sistemi za prepoznavanje govora, orodji za obdelavo naravnih jezikov, kot je npr Analiza klime, sistemi za strojno prevajanje ter sistemi za ustvarjanje besedila in slik.

Uporabili so jih tudi pri ustvarjanju samovozečih avtomobilov in robotov ter v finančni industriji za odkrivanje goljufij in predvidevanje borza gibi.

3. Generativna kontradiktorna omrežja (GAN)

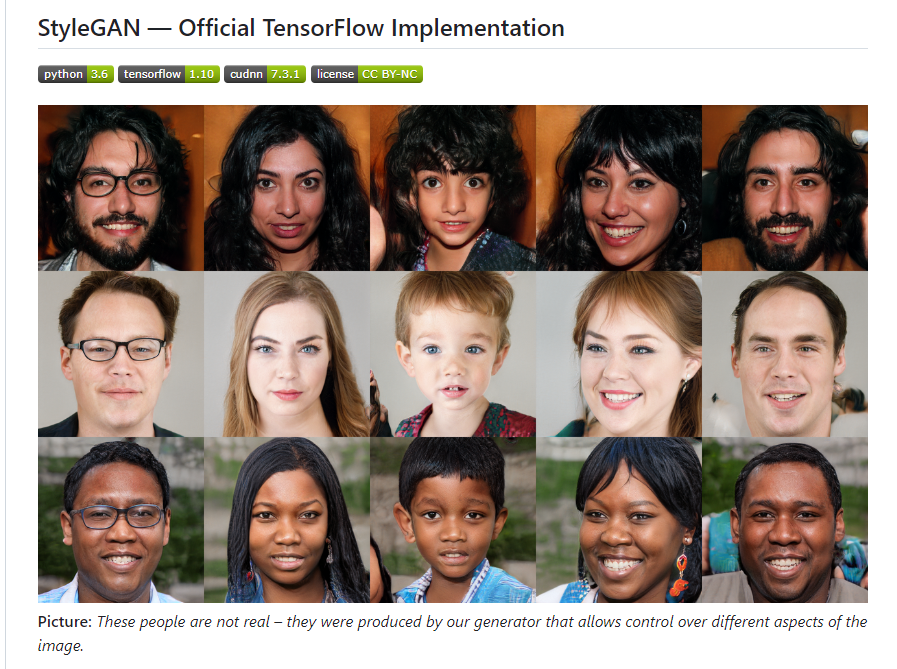

GAN-ji so a globoko učenje tehnika, ki se uporablja za ustvarjanje novih vzorcev podatkov, ki so podobni danemu nizu podatkov. GAN-i so sestavljeni iz dveh nevronske mreže: enega, ki se nauči proizvajati nove vzorce in enega, ki se nauči razlikovati med pristnimi in ustvarjenimi vzorci.

Pri podobnem pristopu se ti dve omrežji usposabljata skupaj, dokler generator ne ustvari vzorcev, ki se ne razlikujejo od dejanskih.

Zakaj uporabljamo GAN

GAN-ji so pomembni zaradi svoje zmožnosti proizvodnje visoke kakovosti sintetični podatki ki se lahko uporablja za različne aplikacije, vključno s produkcijo slik in videa, ustvarjanjem besedila in celo ustvarjanjem glasbe.

GAN-ji so bili uporabljeni tudi za povečanje podatkov, kar je generiranje sintetični podatki za dopolnitev podatkov iz resničnega sveta in izboljšanje učinkovitosti modelov strojnega učenja.

Poleg tega lahko GAN z ustvarjanjem sintetičnih podatkov, ki jih je mogoče uporabiti za usposabljanje modelov in posnemanje poskusov, spremenijo sektorje, kot sta medicina in razvoj zdravil.

Uporaba GAN-jev

GAN lahko dopolnjujejo nabore podatkov, ustvarjajo nove slike ali filme in celo ustvarjajo sintetične podatke za znanstvene simulacije. Poleg tega imajo GAN potencial za uporabo v različnih aplikacijah, od zabave do medicine.

starosti in videi. NVIDIA StyleGAN2 je bil na primer uporabljen za ustvarjanje visokokakovostnih fotografij slavnih in umetniških del.

4. Mreže globokega prepričanja (DBN)

Mreže globokega prepričanja (DBN) so Umetna inteligenca sisteme, ki se lahko naučijo odkrivati vzorce v podatkih. To dosežejo tako, da podatke segmentirajo na vse manjše dele in jih na vsaki ravni bolje razumejo.

DBN se lahko učijo iz podatkov, ne da bi bili obveščeni, kaj so (to se imenuje "nenadzorovano učenje"). Zaradi tega so izjemno dragoceni za odkrivanje vzorcev v podatkih, ki bi jih oseba težko ali nemogoče razbrati.

Zakaj so DBN pomembni?

DBN so pomembni zaradi svoje zmožnosti učenja hierarhičnih predstavitev podatkov. Te predstavitve je mogoče uporabiti za različne aplikacije, kot so klasifikacija, odkrivanje anomalij in zmanjšanje dimenzionalnosti.

Zmogljivost DBN za izvajanje nenadzorovanega predhodnega usposabljanja, ki lahko poveča učinkovitost modelov globokega učenja z minimalno količino označenih podatkov, je pomembna prednost.

Kakšne so aplikacije DBN?

Ena najpomembnejših aplikacij je odkrivanje predmetov, v katerem se DBN uporabljajo za prepoznavanje določenih vrst stvari, kot so letala, ptice in ljudje. Uporabljajo se tudi za ustvarjanje in klasifikacijo slik, zaznavanje gibanja v filmih in razumevanje naravnega jezika za obdelavo glasu.

Poleg tega se DBN običajno uporabljajo v nizih podatkov za ocenjevanje človeških drž. DBN so odlično orodje za različne panoge, vključno z zdravstvom in bančništvom ter tehnologijo.

5. Mreže za globoko krepitev učenja (DRL)

Globoko Okrepitveno učenje Omrežja (DRL) združujejo globoke nevronske mreže s tehnikami okrepljenega učenja, da agentom omogočijo učenje v zapletenem okolju s poskusi in napakami.

DRL se uporabljajo za učenje agentov, kako optimizirati signal za nagrajevanje z interakcijo z okolico in učenjem iz svojih napak.

Kaj jih dela izjemne?

Učinkovito so bili uporabljeni v različnih aplikacijah, vključno z igranjem iger, robotiko in avtonomno vožnjo. DRL-ji so pomembni, ker se lahko učijo neposredno iz neobdelanih senzoričnih vnosov, kar agentom omogoča sprejemanje odločitev na podlagi njihove interakcije z okoljem.

Pomembne aplikacije

DRL-ji se uporabljajo v resničnih okoliščinah, ker lahko obravnavajo težke težave.

DRL so bili vključeni v več uglednih programskih in tehnoloških platform, vključno z OpenAI's Gym, Unity's ML-Agentsin Googlov laboratorij DeepMind. AlphaGo, ki ga je zgradil Google Deepmind, na primer, uporablja DRL za igranje družabne igre Go na ravni svetovnega prvaka.

Druga uporaba DRL je v robotiki, kjer se uporablja za nadzor gibanja robotskih rok za izvajanje nalog, kot je prijemanje stvari ali zlaganje blokov. DRL imajo veliko uporab in so uporabno orodje za usposabljanje agentov za učenje in sprejemati odločitve v zapletenih okoliščinah.

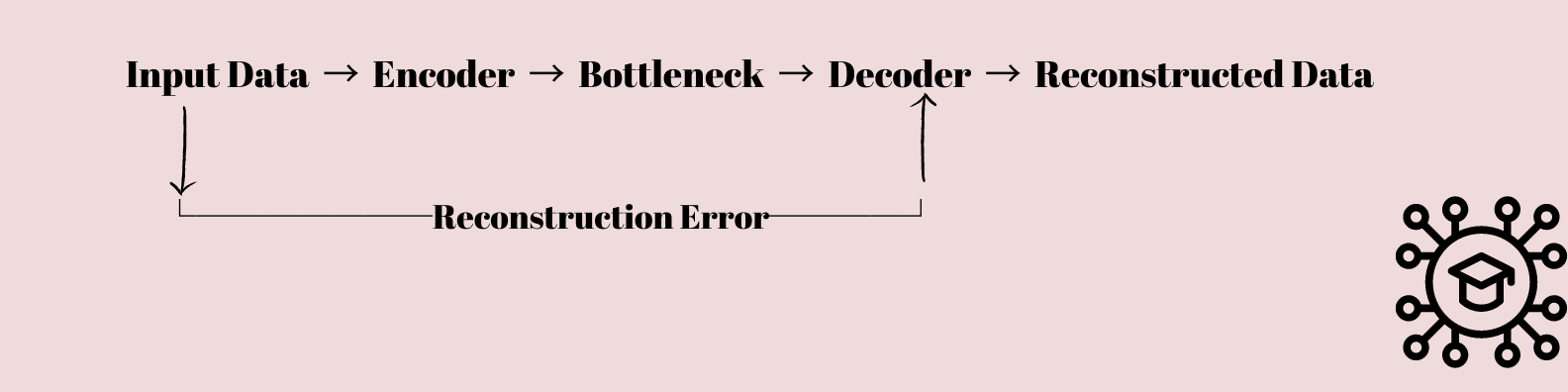

6. Avtokodirniki

Avtokodirniki so zanimiva vrsta nevronska mreža ki je pritegnilo zanimanje tako učenjakov kot podatkovnih znanstvenikov. V osnovi so zasnovani za učenje stiskanja in obnavljanja podatkov.

Vhodni podatki se podajajo skozi zaporedje plasti, ki postopoma znižujejo dimenzionalnost podatkov, dokler niso stisnjeni v plast ozkega grla z manj vozlišči kot vhodna in izhodna plast.

Ta stisnjena predstavitev se nato uporabi za ponovno ustvarjanje izvirnih vhodnih podatkov z uporabo zaporedja plasti, ki postopoma dvigne dimenzionalnost podatkov nazaj v prvotno obliko.

Zakaj je pomembno?

Avtokodirniki so ključna komponenta globoko učenje ker omogočajo pridobivanje funkcij in zmanjšanje podatkov.

Sposobni so prepoznati ključne elemente vhodnih podatkov in jih prevesti v stisnjeno obliko, ki se nato lahko uporabi pri drugih nalogah, kot so razvrščanje, združevanje ali ustvarjanje novih podatkov.

Kje uporabljamo samodejne kodirnike?

Odkrivanje anomalij, obdelava naravnega jezika in računalniški vid je le nekaj disciplin, kjer se uporabljajo samodejni kodirniki. Avtokodirnike je na primer mogoče uporabiti za stiskanje slike, odstranjevanje šumov slike in sintezo slike v računalniškem vidu.

Avtokodirnike lahko uporabljamo pri nalogah, kot so ustvarjanje besedila, kategorizacija besedila in povzemanje besedila pri obdelavi naravnega jezika. Lahko identificira nepravilno aktivnost v podatkih, ki odstopajo od norme pri identifikaciji nepravilnosti.

7. Omrežja kapsul

Capsule Networks je nova arhitektura globokega učenja, ki je bila razvita kot zamenjava za konvolucijske nevronske mreže (CNN).

Mreže kapsul temeljijo na ideji združevanja možganskih enot, imenovanih kapsule, ki so odgovorne za prepoznavanje obstoja določenega elementa na sliki in kodiranje njegovih atributov, kot sta orientacija in položaj, v svoje izhodne vektorje. Capsule Networks lahko torej bolje upravljajo prostorske interakcije in perspektivna nihanja kot CNN.

Zakaj izberemo Capsule Networks namesto CNN?

Kapsulna omrežja so uporabna, ker premagajo težave CNN pri zajemanju hierarhičnih odnosov med elementi na sliki. CNN-ji lahko prepoznajo stvari različnih velikosti, vendar težko dojamejo, kako se ti predmeti povezujejo med seboj.

Po drugi strani pa se lahko Capsule Networks naučijo prepoznavati stvari in njihove dele, pa tudi, kako so prostorsko umeščene v sliko, zaradi česar so uspešen tekmec za aplikacije računalniškega vida.

Področja uporabe

Capsule Networks so že pokazali obetavne rezultate v različnih aplikacijah, vključno s klasifikacijo slik, identifikacijo objektov in segmentacijo slik.

Uporabljali so jih za razlikovanje stvari na medicinskih fotografijah, prepoznavanje ljudi v filmih in celo ustvarjanje 3D modelov iz 2D slik.

Za povečanje njihove učinkovitosti so bila omrežja Capsule Networks združena z drugimi arhitekturami globokega učenja, kot so generativna kontradiktorna omrežja (GAN) in variacijski samodejni kodirniki (VAE). Predvideva se, da bodo imela kapsulna omrežja vse pomembnejšo vlogo pri izboljšanju tehnologij računalniškega vida, ko se bo razvijala znanost o globokem učenju.

Na primer; Nibabel je dobro znano orodje Python za branje in pisanje vrst datotek nevronskih slik. Za segmentacijo slike uporablja Capsule Networks.

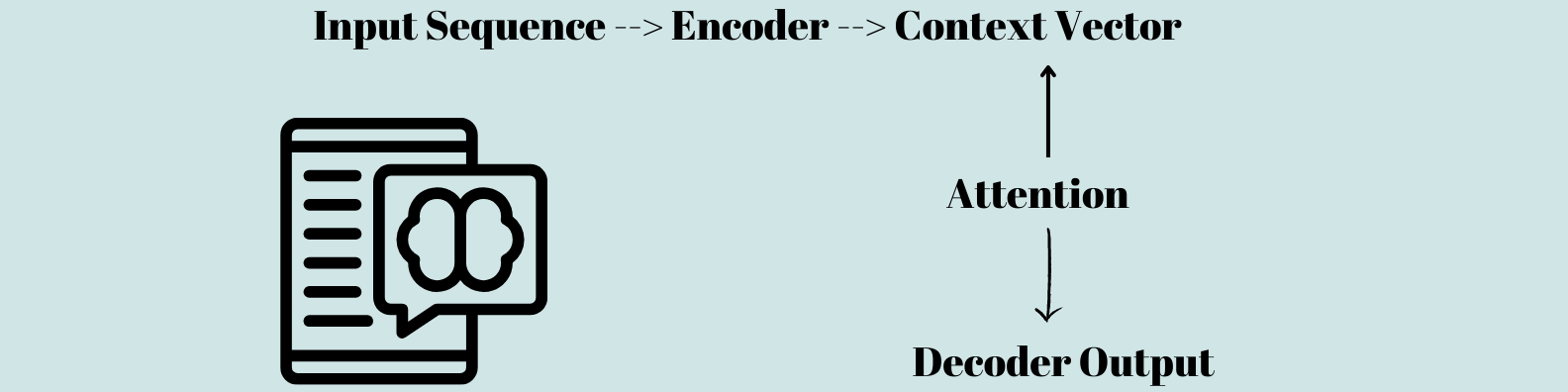

8. Modeli, ki temeljijo na pozornosti

Modeli globokega učenja, znani kot modeli, ki temeljijo na pozornosti, znani tudi kot mehanizmi pozornosti, si prizadevajo povečati natančnost modeli strojnega učenja. Ti modeli delujejo tako, da se osredotočajo na določene značilnosti vhodnih podatkov, kar ima za posledico bolj učinkovito in uspešno obdelavo.

Pri nalogah obdelave naravnega jezika, kot sta strojno prevajanje in analiza razpoloženja, so se metode pozornosti izkazale za zelo uspešne.

Kakšen je njihov pomen?

Modeli, ki temeljijo na pozornosti, so uporabni, ker omogočajo učinkovitejšo in uspešnejšo obdelavo zapletenih podatkov.

Tradicionalne nevronske mreže ovrednoti vse vhodne podatke kot enako pomembne, kar povzroči počasnejšo obdelavo in zmanjšano natančnost. Procesi pozornosti se osredotočajo na ključne vidike vhodnih podatkov, kar omogoča hitrejše in natančnejše napovedi.

Področja uporabe

Na področju umetne inteligence imajo mehanizmi pozornosti široko paleto aplikacij, vključno z obdelavo naravnega jezika, prepoznavanjem slik in zvoka ter celo vozili brez voznika.

Metode pozornosti lahko na primer uporabimo za izboljšanje strojnega prevajanja pri obdelavi naravnega jezika, tako da omogočimo sistemu, da se osredotoči na določene besede ali besedne zveze, ki so bistvene za kontekst.

Metode pozornosti v avtonomnih avtomobilih se lahko uporabijo za pomoč sistemu pri osredotočanju na določene predmete ali izzive v okolici.

9. Transformatorska omrežja

Transformatorska omrežja so modeli globokega učenja, ki pregledujejo in proizvajajo zaporedja podatkov. Delujejo tako, da obdelajo vhodno zaporedje en element naenkrat in ustvarijo izhodno zaporedje enake ali različne dolžine.

Transformatorska omrežja za razliko od standardnih modelov od zaporedja do zaporedja ne obdelujejo zaporedij z uporabo ponavljajočih se nevronskih mrež (RNN). Namesto tega uporabljajo procese samopozornosti, da se naučijo povezav med deli zaporedja.

Kakšen je pomen transformatorskih omrežij?

Transformatorska omrežja so v zadnjih letih postala vse bolj priljubljena zaradi njihove boljše zmogljivosti pri obdelavi naravnega jezika.

Še posebej so primerni za naloge ustvarjanja besedila, kot so jezikovno prevajanje, povzemanje besedila in ustvarjanje pogovorov.

Transformatorska omrežja so računsko bistveno učinkovitejša od modelov, ki temeljijo na RNN, zaradi česar so prednostna izbira za obsežne aplikacije.

Kje lahko najdete transformatorska omrežja?

Transformatorska omrežja se široko uporabljajo v številnih aplikacijah, predvsem pri obdelavi naravnega jezika.

Serija GPT (Generative Pre-trained Transformer) je ugleden model na osnovi transformatorja, ki je bil uporabljen za naloge, kot so prevajanje jezikov, povzemanje besedila in ustvarjanje klepetalnic.

BERT (Bidirectional Encoder Representations from Transformers) je še en pogost model na osnovi transformatorjev, ki je bil uporabljen za aplikacije razumevanja naravnega jezika, kot sta odgovarjanje na vprašanja in analiza občutkov.

oba GPT in BERT sta bila ustvarjena z PyTorch, odprtokodno ogrodje za globoko učenje, ki je bilo priljubljeno za razvoj transformatorskih modelov.

10. Omejeni Boltzmannovi stroji (RBM)

Omejeni Boltzmannovi stroji (RBM) so neke vrste nenadzorovana nevronska mreža, ki se uči na generativen način. Zaradi njihove zmožnosti učenja in pridobivanja bistvenih značilnosti iz visokodimenzionalnih podatkov so bili pogosto uporabljeni na področjih strojnega in globokega učenja.

RBM so sestavljeni iz dveh plasti, vidne in skrite, pri čemer je vsaka plast sestavljena iz skupine nevronov, povezanih z uteženimi robovi. RBM so zasnovani tako, da se naučijo porazdelitve verjetnosti, ki opisuje vhodne podatke.

Kaj so Boltzmannovi stroji z omejitvami?

RBM uporabljajo strategijo generativnega učenja. V RBM-jih vidna plast odraža vhodne podatke, medtem ko skrita plast kodira značilnosti vhodnih podatkov. Teže vidnih in skritih slojev kažejo na trdnost njune povezave.

RBM prilagodijo uteži in pristranskosti med plastmi med treningom z uporabo tehnike, znane kot kontrastna divergenca. Kontrastivna divergenca je strategija nenadzorovanega učenja, ki maksimira verjetnost napovedi modela.

Kakšen je pomen omejenih Boltzmannovih strojev?

RBM so pomembni v strojno učenje in globoko učenje, ker se lahko učijo in iz velikih količin podatkov izvlečejo ustrezne značilnosti.

So zelo učinkoviti za prepoznavanje slike in govora in so bili uporabljeni v različnih aplikacijah, kot so sistemi priporočil, zaznavanje nepravilnosti in zmanjšanje dimenzionalnosti. RBM lahko najdejo vzorce v obsežnih naborih podatkov, kar ima za posledico vrhunske napovedi in vpoglede.

Kje se lahko uporabljajo Boltzmannovi stroji z omejitvami?

Aplikacije za RBM vključujejo zmanjšanje dimenzionalnosti, odkrivanje nepravilnosti in sisteme priporočil. RBM so še posebej koristni za analizo razpoloženja in tematsko modeliranje v kontekstu obdelave naravnega jezika.

Mreže globokih prepričanj, nekakšna nevronska mreža, ki se uporablja za prepoznavanje glasu in slike, prav tako uporabljajo RBM. Orodjarna Deep Belief Network, TensorFlowin Theano je nekaj posebnih primerov programske opreme ali tehnologije, ki uporablja RBM.

Zaviti

Modeli globokega učenja postajajo vse bolj ključni v različnih panogah, vključno s prepoznavanjem govora, obdelavo naravnega jezika in računalniškim vidom.

Konvolucijske nevronske mreže (CNN) in ponavljajoče se nevronske mreže (RNN) so najbolj obetavne in se pogosto uporabljajo v številnih aplikacijah, vendar imajo vsi modeli globokega učenja svoje prednosti in slabosti.

Vendar pa raziskovalci še vedno preučujejo omejene Boltzmannove stroje (RBM) in druge različice modelov globokega učenja, ker imajo tudi ti posebne prednosti.

Pričakuje se, da bodo ustvarjeni novi in ustvarjalni modeli, ko bo področje poglobljenega učenja še naprej napredovalo za reševanje težjih problemov.

Pustite Odgovori