Содержание[Скрывать][Показывать]

Одним из основных критериев любого вида корпоративной деятельности является эффективное использование информации. В какой-то момент объем создаваемых данных превышает возможности базовой обработки.

Вот где в игру вступают алгоритмы машинного обучения. Однако, прежде чем что-либо из этого может произойти, информация должна быть изучена и интерпретирована. В двух словах, это то, для чего используется неконтролируемое машинное обучение.

В этой статье мы подробно рассмотрим неконтролируемое машинное обучение, включая его алгоритмы, варианты использования и многое другое.

Что такое неконтролируемое машинное обучение?

Алгоритмы неконтролируемого машинного обучения выявляют в наборе данных шаблоны, которые не имеют известных или помеченных последствий. Под наблюдением алгоритмы машинного обучения иметь помеченный выход.

Знание этого различия поможет вам понять, почему неконтролируемые методы машинного обучения нельзя использовать для решения проблем регрессии или классификации, поскольку вы не знаете, каким может быть значение/ответ для выходных данных. Вы не можете нормально обучить алгоритм, если не знаете значение/ответ.

Более того, неконтролируемое обучение можно использовать для определения фундаментальной структуры данных. Эти алгоритмы обнаруживают скрытые закономерности или группировки данных без участия человека.

Его способность обнаруживать сходства и различия в информации делает его отличным выбором для исследовательского анализа данных, методов перекрестных продаж, сегментации потребителей и идентификации изображений.

Рассмотрим следующий сценарий: вы находитесь в продуктовом магазине и видите неопознанный фрукт, которого никогда раньше не видели. Вы можете легко отличить неизвестный фрукт от других фруктов, основываясь на своих наблюдениях за его формой, размером или цветом.

Неконтролируемые алгоритмы машинного обучения

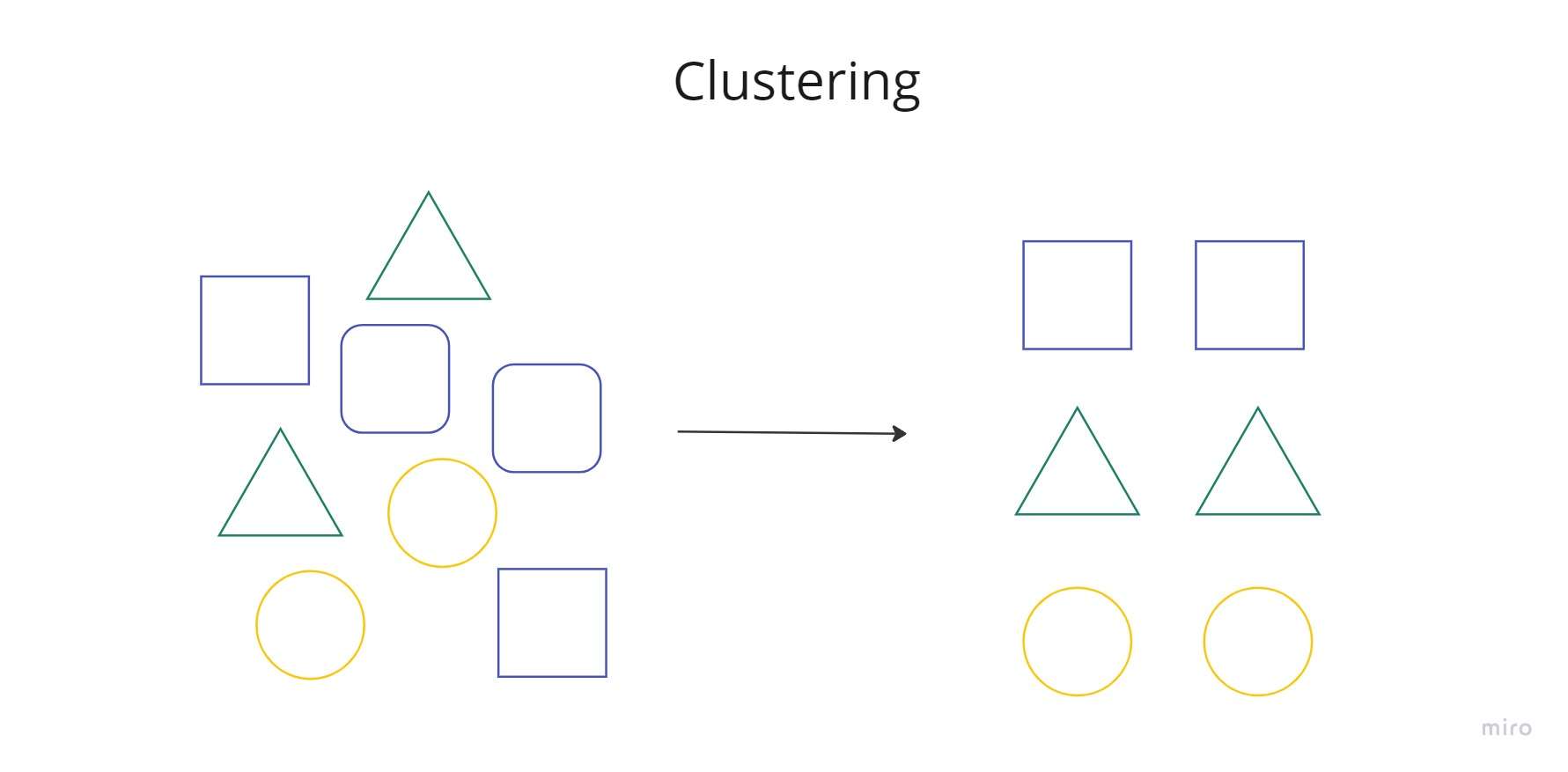

Кластеризация

Кластеризация, без сомнения, является наиболее широко используемым подходом к обучению без учителя. Этот подход помещает связанные элементы данных в случайно сгенерированные кластеры.

Сама по себе модель ML обнаруживает любые закономерности, сходства и/или различия в неклассифицированной структуре данных. Модель сможет обнаруживать любые естественные группировки или классы данных.

Тип

Можно использовать несколько форм кластеризации. Давайте сначала рассмотрим самые важные из них.

- Эксклюзивная кластеризация, иногда называемая «жесткой» кластеризацией, представляет собой тип группировки, при котором один фрагмент данных принадлежит только одному кластеру.

- Перекрывающаяся кластеризация, часто известная как «мягкая» кластеризация, позволяет объектам данных принадлежать более чем одному кластеру в разной степени. Кроме того, вероятностную кластеризацию можно использовать для решения задач «мягкой» кластеризации или оценки плотности, а также для оценки вероятности или вероятности того, что точки данных принадлежат определенным кластерам.

- Создание иерархии сгруппированных элементов данных является целью иерархической кластеризации, как следует из названия. Элементы данных деконструируются или объединяются на основе иерархии для создания кластеров.

Случаи применения:

- Обнаружение аномалии:

Любой тип выбросов в данных может быть обнаружен с помощью кластеризации. Компании, занимающиеся транспортом и логистикой, например, могут использовать обнаружение аномалий для обнаружения логистических препятствий или обнаружения поврежденных механических частей (профилактическое обслуживание).

Финансовые учреждения могут использовать эту технологию для обнаружения мошеннических транзакций и быстрого реагирования, потенциально экономя много денег. Узнайте больше о выявлении аномалий и мошенничества, посмотрев наше видео.

- Сегментация клиентов и рынков:

Алгоритмы кластеризации могут помочь в группировании людей со схожими характеристиками и создании портретов потребителей для более эффективного маркетинга и целенаправленных инициатив.

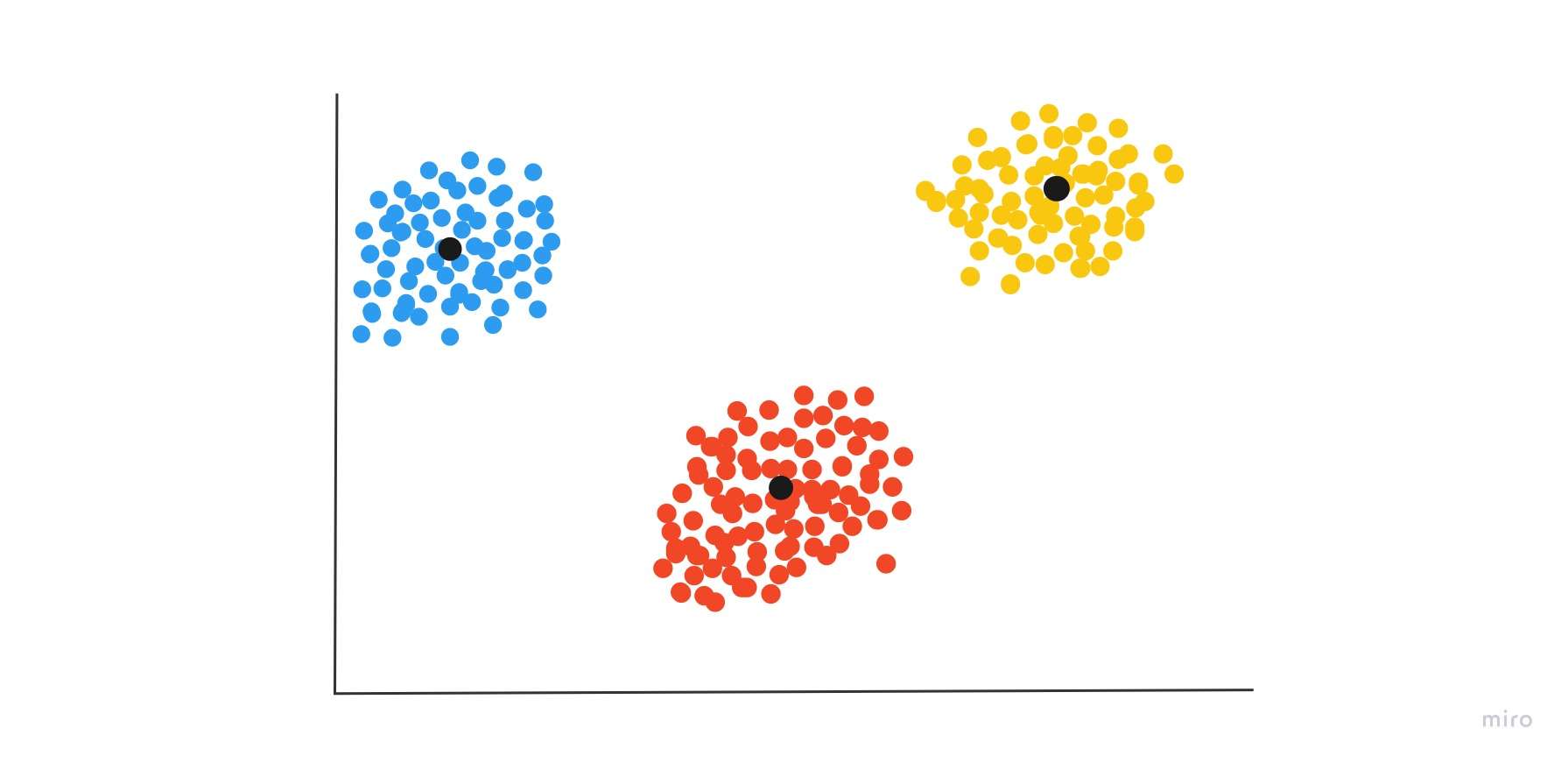

K-средних

K-средние — это метод кластеризации, также известный как разбиение или сегментация. Он делит точки данных на заранее определенное количество кластеров, известных как K.

В методе K-средних K является входом, поскольку вы сообщаете компьютеру, сколько кластеров вы хотите идентифицировать в своих данных. Каждый элемент данных впоследствии назначается ближайшему центру кластера, известному как центроид (черные точки на рисунке).

Последние служат местами для хранения данных. Технику кластеризации можно применять много раз, пока кластеры не будут четко определены.

Нечеткие K-средние

Нечеткие K-средние — это расширение метода K-средних, которое используется для кластеризации с перекрытием. В отличие от метода K-средних, нечеткие K-средние указывают, что точки данных могут принадлежать многим кластерам с разной степенью близости к каждому.

Расстояние между точками данных и центроидом кластера используется для расчета близости. В результате могут быть случаи, когда различные кластеры перекрываются.

Модели гауссовой смеси

Модели гауссовой смеси (GMM) — это метод, используемый в вероятностной кластеризации. Поскольку среднее значение и дисперсия неизвестны, в моделях предполагается, что существует фиксированное количество распределений Гаусса, каждое из которых представляет отдельный кластер.

Чтобы определить, к какому кластеру принадлежит конкретная точка данных, по существу используется метод.

Иерархическая кластеризация

Стратегия иерархической кластеризации может начинаться с того, что каждая точка данных назначается отдельному кластеру. Затем два ближайших друг к другу кластера объединяются в один кластер. Итеративное слияние продолжается до тех пор, пока наверху не останется только один кластер.

Этот метод известен как восходящий или агломеративный. Если вы начинаете со всех элементов данных, привязанных к одному и тому же кластеру, а затем проводите разбиение до тех пор, пока каждый элемент данных не будет назначен в качестве отдельного кластера, этот метод известен как нисходящая или разделительная иерархическая кластеризация.

Алгоритм априори

Анализ рыночной корзины популяризировал априорные алгоритмы, что привело к появлению различных механизмов рекомендаций для музыкальных платформ и интернет-магазинов.

Они используются в транзакционных наборах данных для поиска часто встречающихся наборов элементов или групп элементов, чтобы предсказать вероятность потребления одного продукта на основе потребления другого.

Например, если я начну слушать радио OneRepublic на Spotify с «Counting Stars», одна из других песен на этом канале наверняка будет песней Imagine Dragon, такой как «Bad Liar».

Это основано на моих предыдущих привычках слушания, а также на моделях слушания других людей. Априорные методы подсчитывают наборы элементов с помощью хэш-дерева, обходя набор данных в ширину.

Уменьшение размерности

Снижение размерности — это своего рода неконтролируемое обучение, в котором используется набор стратегий для минимизации количества функций или измерений в наборе данных. Позвольте нам уточнить.

Может возникнуть соблазн включить как можно больше данных при создании набор данных для машинного обучения. Не поймите нас неправильно: эта стратегия работает хорошо, поскольку больше данных обычно дает более точные результаты.

Предположим, что данные хранятся в N-мерном пространстве, где каждый объект представляет свое измерение. Если данных много, могут быть сотни измерений.

Рассмотрим электронные таблицы Excel со столбцами, представляющими характеристики, и строками, представляющими элементы данных. Когда измерений слишком много, алгоритмы машинного обучения могут работать плохо и визуализация данных может стать трудным.

Таким образом, логично ограничить характеристики или размеры и передать только соответствующую информацию. Уменьшение размерности — это как раз то, что нужно. Это позволяет управлять количеством входных данных без ущерба для целостности набора данных.

Анализ главных компонентов (PCA)

Анализ главных компонентов представляет собой метод уменьшения размерности. Он используется для минимизации количества функций в огромных наборах данных, что приводит к большей простоте данных без ущерба для точности.

Сжатие набора данных выполняется с помощью метода, известного как извлечение признаков. Это указывает на то, что элементы из исходного набора смешиваются в новый, меньший по размеру. Эти новые черты известны как первичные компоненты.

Конечно, существуют дополнительные алгоритмы, которые вы можете использовать в своих приложениях для обучения без учителя. Перечисленные выше являются лишь наиболее распространенными, поэтому они рассмотрены более подробно.

Применение неконтролируемого обучения

- Методы обучения без учителя используются для задач визуального восприятия, таких как распознавание объектов.

- Неконтролируемое машинное обучение придает критически важные аспекты системам медицинской визуализации, таким как идентификация, классификация и сегментация изображений, которые используются в радиологии и патологии для быстрой и надежной диагностики пациентов.

- Неконтролируемое обучение может помочь определить тенденции данных, которые можно использовать для создания более эффективных стратегий перекрестных продаж с использованием прошлых данных о поведении потребителей. В процессе оформления заказа это используется онлайн-компаниями, чтобы предлагать клиентам правильные дополнения.

- Неконтролируемые методы обучения могут просеивать огромные объемы данных, чтобы найти выбросы. Эти аномалии могут привлечь внимание к неисправностям оборудования, человеческим ошибкам или нарушениям безопасности.

Проблемы с неконтролируемым обучением

Неконтролируемое обучение привлекательно во многих отношениях: от возможности найти важные идеи до данные во избежание дорогостоящей маркировки данных операции. Однако использование этой стратегии для обучения имеет ряд недостатков. модели машинного обучения о которых вы должны знать. Вот несколько примеров.

- Поскольку во входных данных отсутствуют метки, которые служат ключами ответов, результаты моделей обучения без учителя могут быть менее точными.

- Неконтролируемое обучение часто работает с массивными наборами данных, что может увеличить вычислительную сложность.

- Подход требует подтверждения вывода людьми, внутренними или внешними специалистами по предмету исследования.

- Алгоритмы должны исследовать и вычислять каждый возможный сценарий на протяжении всего этапа обучения, что занимает некоторое время.

Заключение

Эффективное использование данных является ключом к созданию конкурентного преимущества на конкретном рынке.

Вы можете сегментировать данные, используя неконтролируемые алгоритмы машинного обучения, чтобы изучить предпочтения вашей целевой аудитории или определить, как определенная инфекция реагирует на определенное лечение.

Есть несколько практических применений, и ученые-данные, инженеры и архитекторы могут помочь вам в определении ваших целей и разработке уникальных решений машинного обучения для вашей компании.

Оставьте комментарий