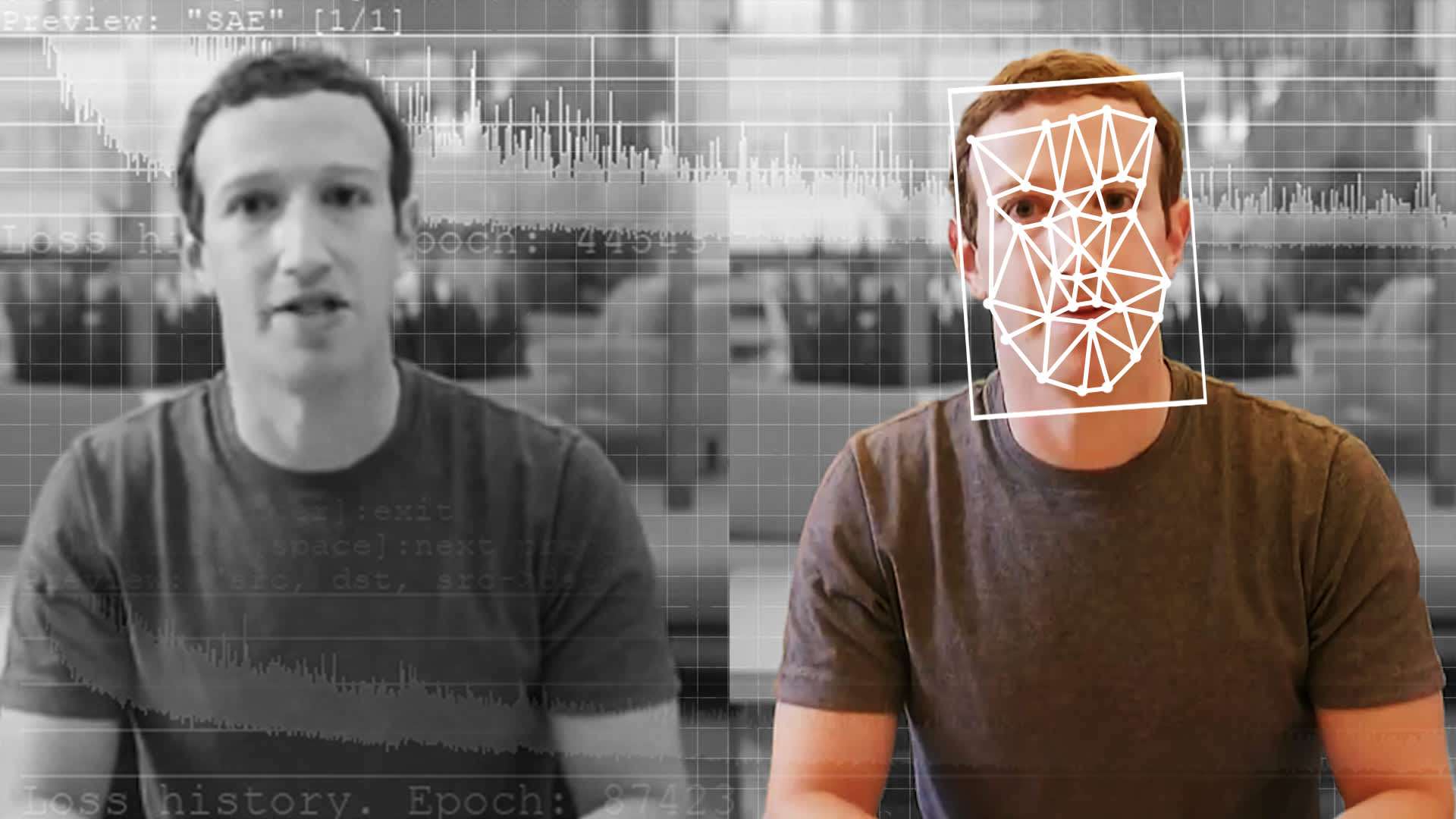

Видео Марка Цукерберга, признающего кражу данных, и Барака Обамы, оскорбляющего Дональда Трампа, циркулируют в Интернете уже довольно давно?

Эти видео являются результатом очень продвинутой и футуристической технологии искусственного интеллекта под названием Deepfake.

Проще говоря, это альтернатива фотошопу для видео. С одной стороны, он может произвести революцию в электронных средствах массовой информации, устранив необходимость в реальном человеке.

С другой стороны, это серьезно угрожает чьей-либо личности, поскольку вы можете заставить кого угодно говорить что угодно на видео.

Использование дипфейков глубокое обучение для создания фото и видео поддельных событий, отсюда и название deepfake. Он может не только менять лица в существующих видео, но и создавать новые кадры и видео с нуля.

Происхождение дипфейков

Обширный научные исследования за последние несколько лет раздвинула границы фото- и видеоманипуляций. Deepfake также является результатом этих академических исследований.

Первый случай видеоманипуляции был зарегистрирован в 1997 году. Видео человека было изменено, чтобы он произносил слова, содержащиеся в другой звуковой дорожке. Это был первый случай реанимации лица с помощью обучение с помощью машины (pin drop).

Дальнейший заметный прогресс был достигнут в 2017 году, когда видео бывшего президента США Барака Обамы было изменено, чтобы произносить разные слова, соответствующие другой звуковой дорожке.

В 2018 году исследователи из Калифорнийского университета в Беркли представили приложение, которое может создавать поддельное танцевальное видео с использованием глубокого обучения. Это ознаменовало распространение дипфейков на все тело, поскольку предыдущие работы ограничивались лицами.

Как создаются дипфейки?

Благодаря достижениям в области вычислительной техники теперь вы можете относительно легко и недорого разрабатывать дипфейки. Для создания дипфейков используются два основных метода.

Метод 1

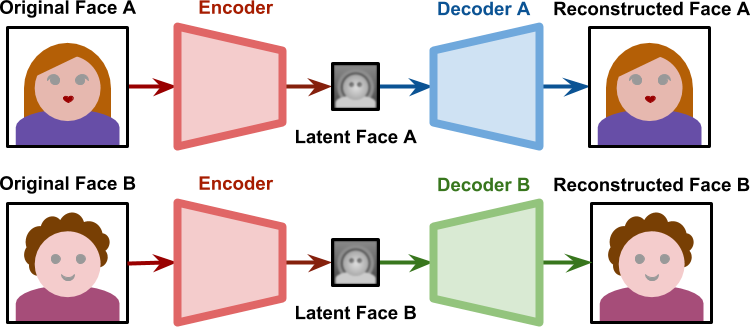

Вам придется тренировать нейронной сети на реальных видеосъемках человека. Это позволит нейронной сети понимать черты лица снимаемого под разными углами и в разных условиях освещения.

После этого вы будете обрабатывать как исходное, так и скрытое лицо с помощью алгоритма ИИ, называемого кодировщиком. Он найдет и изучит различия и сходства между двумя лицами, и оба лица будут сведены к сжатому изображению, имеющему общие черты.

Затем идет второй алгоритм ИИ, называемый декодером, который восстанавливает лица из сжатых изображений. Оба лица восстанавливаются двумя разными декодерами.

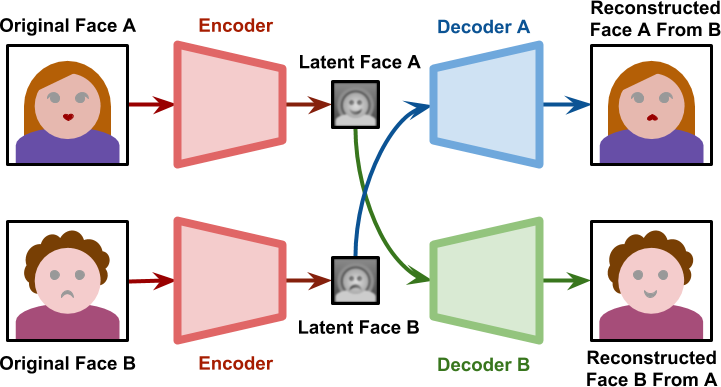

Чтобы выполнить замену лица, вы просто загружаете закодированные изображения в другой декодер.

Например, выходные данные кодировщика лица А подаются в декодер, обученный на лице Б, который затем реконструирует лицо Б с чертами лица А. Вам придется делать это на каждом кадре видео для убедительного вывода.

Метод 2

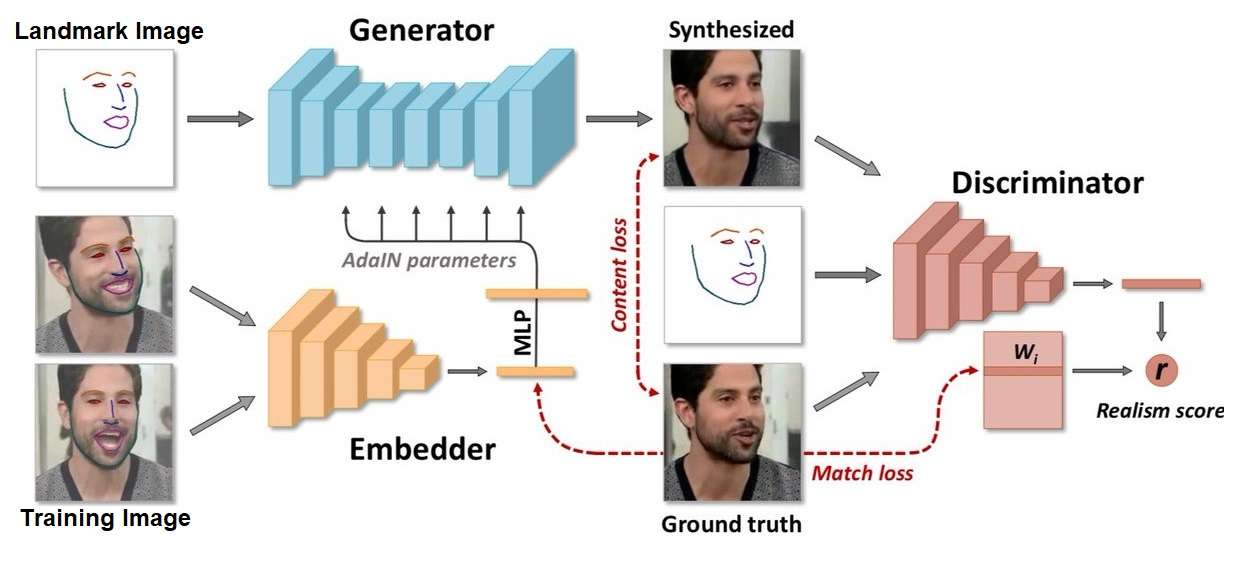

Еще один метод создания дипфейков — генеративно-состязательная сеть (GAN).

Вам придется использовать два конкурирующих алгоритма для создания дипфейков. Первый будет использовать случайный шум для генерации изображения, поэтому он называется генератором. Это синтетическое изображение подается в поток реальных изображений через второй алгоритм, называемый дискриминатором.

Дискриминатор обеспечивает обратную связь с генератором, который генерирует другое изображение в соответствии с обратной связью. Таким образом, оба алгоритма дают улучшенные результаты с каждой итерацией. Этот процесс повторяется много раз, пока не будет достигнут требуемый уровень точности.

GAN дает совершенно реалистичные результаты, но с ним сложно работать, и он требует огромного количества обучающих данных и вычислительной мощности. Вот почему его обычно предпочитают для создания изображений, а не видеоклипов.

Несколько убедительных примеров дипфейков

В Интернете вращается несколько очень убедительных дипфейков, и большинство из них — знаменитости.

Например, есть учетная запись TikTok, посвященная исключительно дипфейкам Тома Круза. Видео показывают, как Круз играет в гольф или демонстрирует фокус.

@deeptomcruise Путешествовать! ????

Еще один очень сложный дипфейк был загружен на YouTube с Томом Крузом, Робертом Дауни-младшим, Джеффом Голдблюмом, Джорджем Лукасом и Юэном МакГрегором. У него есть очевидные недостатки, но обрабатывать 3-4 дипфейка в одном видео одновременно — уже подвиг.

Другой пример — дипфейковое видео бывшего президента Барака Обамы.

Это потрясающе убедительно, поскольку в нем используются голоса и жесты подражателей, способных имитировать голоса и жесты субъекта.

Сейчас мы наблюдаем дипфейки в современной индустрии развлечений.

Его использовали для съемок сцен Пола Уокера в «Форсаже 7» после неожиданной смерти актера. Дипфейк был использован на его брате с поразительной точностью.

Что приносят дипфейки?

Дипфейки оказались очень надежной технологией, которая произвела революцию в медиа и развлечениях.

Вы помните, как компьютерная графика убрала усы Генри Кавилла в «Человеке из стали», и это была катастрофа?

То же самое теперь можно сделать на компьютерах стоимостью в несколько тысяч долларов с гораздо более убедительными результатами.

Теперь вы можете встретить своих умерших предков и близких. Вы даже можете посетить лекцию по физике от самого Альберта Эйнштейна.

Помимо всего этого, дипфейк использовался не совсем так, как предполагалось. Около 96% дипфейков в Интернете — это порнография без согласия.

Большое количество обучающих данных, доступных для знаменитостей, привело к тому, что они стали наиболее целевыми жертвами дипфейков.

Это позволило нам поставить любого в опасные или скомпрометированные сценарии и, следовательно, представляет большой риск для всех.

Сообщается, что аудио дипфейки используются для мошенничества с корпорациями. В 2019 году мошенник использовал фейковое аудио, чтобы дать указание генеральному директору британской фирмы перевести 220,000 XNUMX евро в венгерский банк, выдав себя за руководителя материнской компании фирмы.

Как противостоять вредоносным дипфейкам?

Обычно вы можете обнаружить дипфейковые видео, внимательно наблюдая кадр за кадром и выискивая артефакты и нарушения.

Однако это нелогичный процесс, и многие компании работают над алгоритмами и программным обеспечением, чтобы обнаружить дипфейки.

Facebook нанял исследователей из Беркли, Оксфорда и других учреждений для создания детектора дипфейков. Аналогичным образом YouTube объявил, что не будет принимать фальшивые видео, связанные с выборами в США, процедурами голосования или переписью населения США 2020 года.

Вы также можете использовать такие программы, как Защитник реальности и Deeptrace для обнаружения дипфейков.

Страны также заняты законотворчеством в отношении использования дипфейков в целом. За последний год в США было принято несколько законов, касающихся дипфейков.

Итоги

Deepfake — это живое воплощение прогресса ИИ. Это еще больше стирает границы будущего, однако представляет собой потенциальную угрозу достоверности видеографического контента в Интернете.

Придет время, когда люди начнут сомневаться в каждом видео в Интернете, и нас втолкнет в эпоху дальнейшей неопределенности.

Оставьте комментарий