Cuprins[Ascunde][Spectacol]

Pentru a aduna informații de pe site-uri web pentru analiză, cercetare sau obiective de marketing, web scraping este o tehnică crucială. Din fericire, există numeroase instrumente care acceptă atât browsere headless, cât și headful, ambele utile pentru web scraping.

Browserele headful vin cu o interfață grafică de utilizator (GUI), în timp ce browserele headful nu. Aceste tehnologii pot extrage atât manual, cât și automat date din paginile web, ceea ce le face foarte benefice.

Când manipulează o mulțime de date, browserele fără cap sunt cea mai bună opțiune. Pentru a vă automatiza procesul de extragere a datelor, veți avea nevoie de aceste instrumente, care vă vor economisi o tonă de timp și muncă.

În plus, vă ajută să îmbunătățiți precizia și eficacitatea extragerii datelor, ceea ce ar putea duce la rezultate mai fructuoase în general.

Aceste instrumente pot ajuta, de asemenea, la reducerea posibilității de apariție a erorilor la copierea și lipirea manuală a datelor, deoarece au capacitatea de a extrage datele într-un mod organizat.

Pur și simplu spus, este imposibil să lucrezi fără instrumente care acceptă atât browserele headless, cât și headful, dacă ești angajat în web scraping.

În acest articol, ne vom uita la cele mai bune browsere headless și headful pentru web scraping.

1. Date luminoase

Bright Data este un program de web scraping care oferă opțiuni pentru colectarea datelor pentru companii și persoane fizice. Spre deosebire de sistemele anterioare de scraping online, Bright Data vine preîncărcat cu un număr de browsere, dar funcționează ca un browser fără cap.

Chiar dacă rulează ca un browser fără cap pe backend, acest lucru indică faptul că utilizatorii pot interacționa cu acesta printr-o interfață grafică (GUI), făcându-l mai accesibil și mai ușor de utilizat.

Această funcționalitate va fi utilă în special pentru cei care nu știu prea multe despre codificare sau doresc o abordare mai simplă a web scraping. Utilizatorii pot naviga rapid pe site-uri web complexe, cu interacțiuni asemănătoare oamenilor, datorită browser-ului încărcat al Bright Data.

Pentru a vă păstra anonimatul și nedescoperit, oferă și capabilități de ultimă oră, cum ar fi rotația IP, amprentarea browserului și falsificarea user-agent. Cu ajutorul AI, Scraping Browser va putea depăși chiar și cele mai avansate protecții de detectare a botului.

De fapt, Scraping Browser este atât de sofisticat încât poate chiar simula acțiunile browserului unui utilizator autentic, oferindu-vă rezultate mai de succes și date precise.

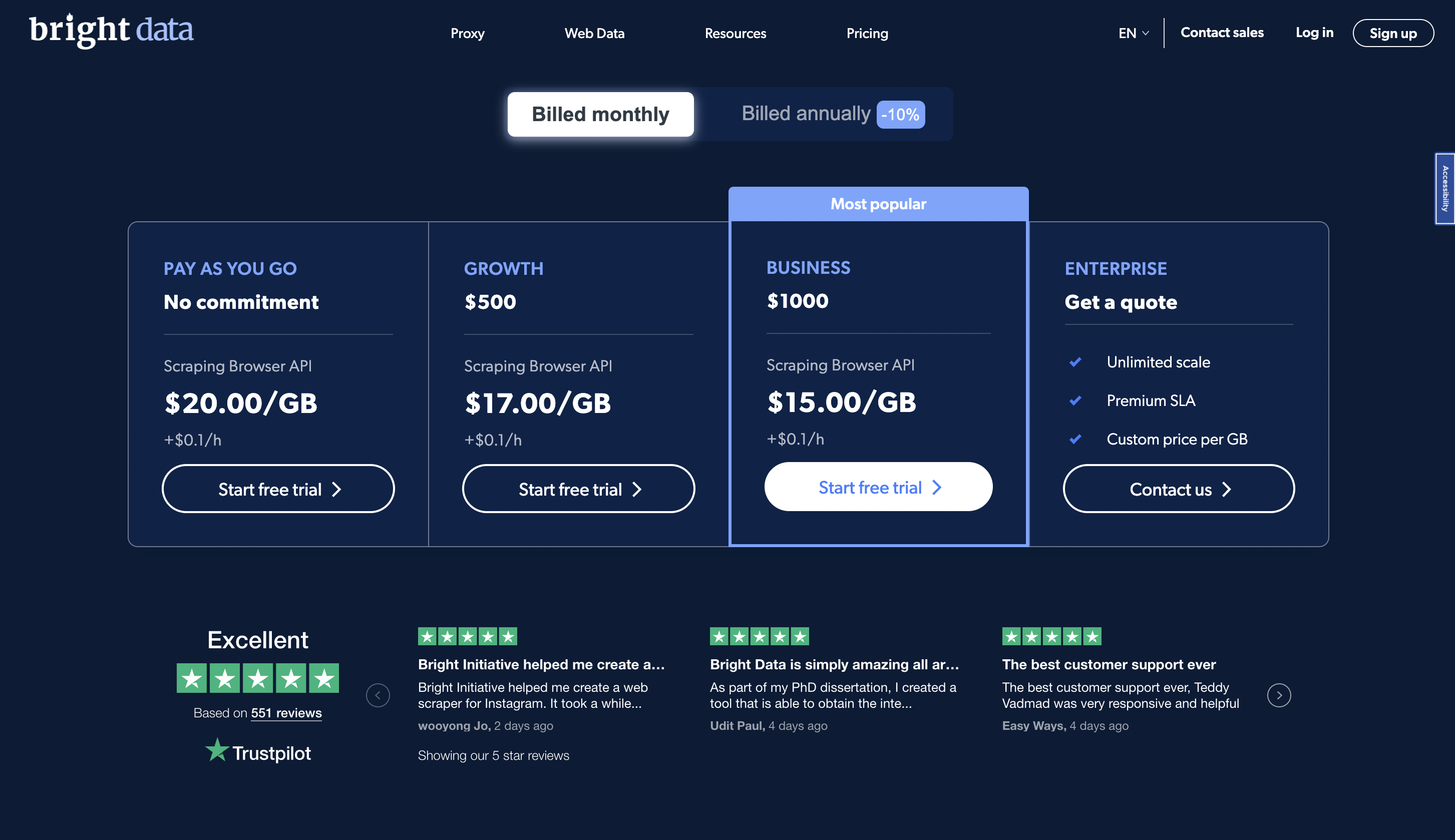

Tarif

Puteți încerca platforma gratuit, iar prețurile premium pornesc de la 20 USD/GB într-un plan cu plata pe măsură.

2. Zyte

În calitate de furnizor de instrumente de scraping online, Zyte, cunoscut anterior sub numele de Scrapinghub, permite companiilor să capteze și să analizeze datele de pe internet la scară.

Platforma de scraping online Zyte este construită pentru a gestiona chiar și cele mai complicate și dinamice site-uri web și include o varietate de funcții de ultimă oră, cum ar fi rotația automată a IP-ului, amprentarea browserului și falsificarea utilizatorului pentru a garanta că operațiunile dvs. de scraping rămân private și neobservate.

Faptul că platforma de scraping web a lui Zyte acceptă atât modurile de navigare fără cap, cât și cu capul, este unul dintre avantajele sale distinctive. Browserul funcționează în modul headless în fundal fără o interfață grafică cu utilizatorul, ceea ce îi crește eficiența pentru operațiuni extinse de scraping.

Cu toate acestea, browserul funcționează cu o interfață grafică în modul headful, ceea ce ar putea fi avantajos atunci când trebuie să extrageți date de pe site-uri web cu interfețe de utilizator complicate.

În plus, deoarece platforma Zyte se bazează pe fundația gratuită și open-source Scrapy, poate fi adaptată pentru a răspunde nevoilor dumneavoastră specifice și este extrem de configurabilă. Puteți recupera rapid și simplu datele pe care le doriți folosind Zyte, oferindu-vă un avantaj competitiv în afacerea dvs.

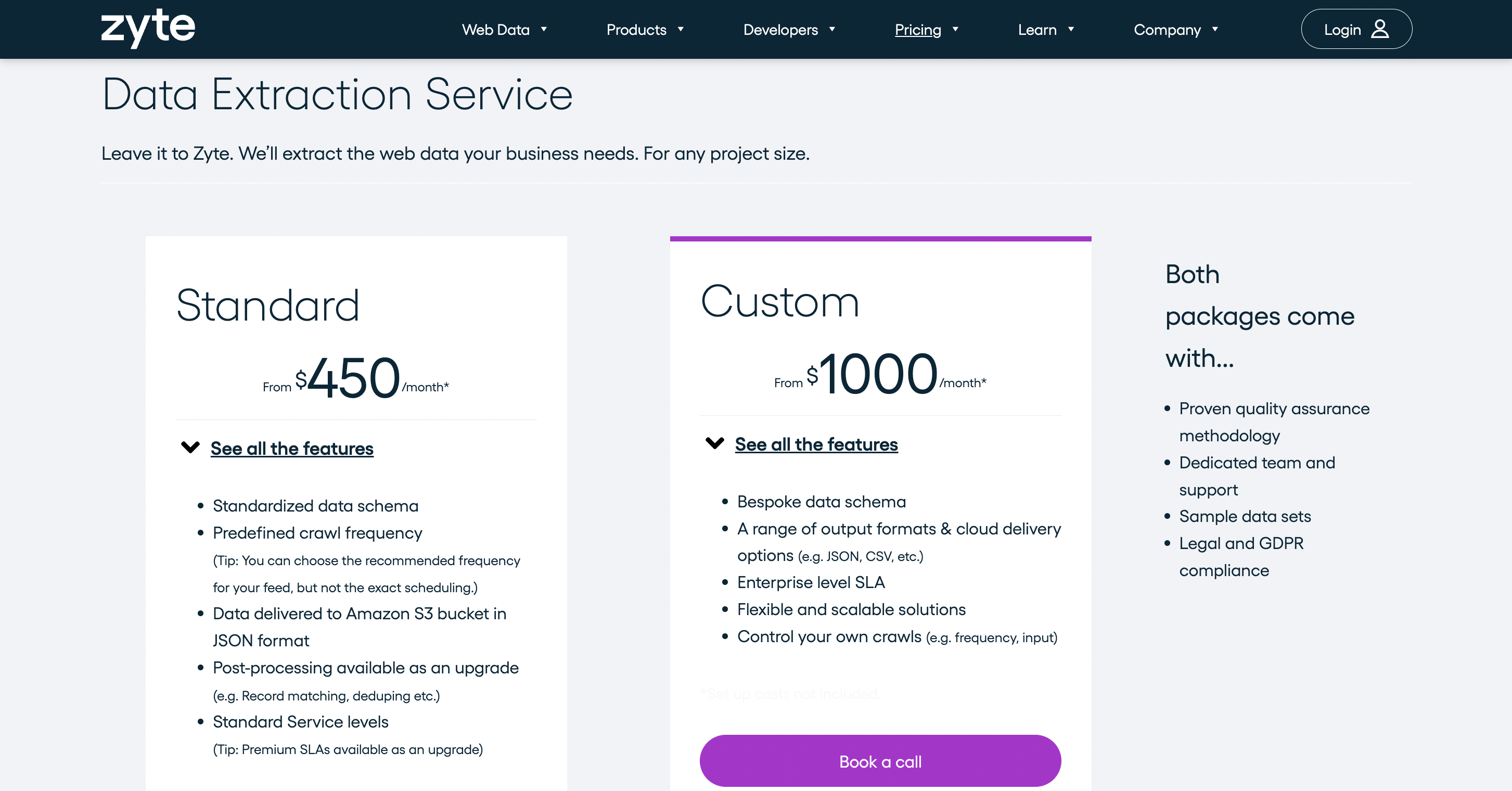

Tarif

Oferă mai multe planuri de preț și percepe 450 USD/lună pentru serviciul de extragere a datelor.

3. Octoparse

Puteți aduna date din pagini web fără a scrie niciun cod cu Octoparse, o aplicație de scraping web bazată pe cloud. Oricine dorește să răzuiască text, fotografii sau videoclipuri le poate alege cu ușurință datorită interfeței ușor de utilizat.

Octoparse este un instrument flexibil care acceptă atât navigarea fără cap, cât și cea mai bună, este cea mai bună opțiune pentru proiectele de web scraping de orice dimensiune și complexitate. Capacitatea de a răzui pagini web dinamice și interactive, ceea ce poate fi dificil pentru multe alte programe de web scraping, este una dintre cele mai puternice caracteristici ale sale.

Puteți crea procese complexe de scraping cu numeroase faze, instrucțiuni condiționate și bucle, crescând flexibilitatea și personalizarea scraping-ului. Excel, CSV și SQL sunt doar câteva dintre formatele de export oferite de Octoparse, ceea ce face simplă utilizarea datelor extrase în alte programe.

În plus, Octoparse are un pool de proxy integrat care asigură scraping anonim și ajută la evitarea interzicerii IP.

Tarif

Puteți începe să îl utilizați gratuit, iar prețul premium începe de la 89 USD/lună.

4. Apify

Apify este o platformă all-in-one de web scraping și automatizare care oferă o varietate de funcții puternice. Acceptă atât browsere headless, cât și headful și are o interfață de utilizator intuitivă care simplifică chiar și utilizatorii netehnici să creeze sarcini de scraping.

Abilitatea Apify de a gestiona lucrări dificile de scraping, suportul pentru mai multe limbi și scalarea pentru a gestiona proiecte de scraping la scară largă sunt unele dintre cele mai bune caracteristici ale sale.

În plus, Apify oferă acces la o piață vastă de raclete gata făcute care pot fi personalizate rapid pentru a răspunde cerințelor dumneavoastră unice.

Cu suportul său pentru browsere fără cap, Apify poate naviga în interfețe de utilizator provocatoare și poate extrage date de pe site-uri web dinamice, în timp ce extrage rapid și eficient informații din volume masive de date.

Apify este un instrument util pentru o varietate de aplicații de scraping online, inclusiv generarea de clienți potențiali, analiza competitivă, cercetarea de piață și agregarea de conținut.

Apify mărește acuratețea și eficiența economisind în același timp timp și efort prin automatizarea procesului de extragere a datelor. Este un instrument puternic atât pentru utilizatorii tehnici, cât și pentru utilizatorii non-tehnici, datorită funcționalității și designului ușor de utilizat.

Tarif

Puteți începe să îl utilizați gratuit, iar prețul premium începe de la 49 USD/lună.

5. ScrapingBee

Aplicația remarcabilă de scraping online ScrapingBee simplifică automatizarea procesului de extragere a datelor de pe site-uri web.

Capacitățile sale, cum ar fi cele pentru gestionarea redării JavaScript, rezoluția CAPTCHA și rotația user-agent, permit ocolirea apărării anti-scraping a site-urilor web. prin urmare, o opțiune excelentă pentru sarcinile de scraping web.

Utilizatorii au un grad mare de libertate cu acest instrument, deoarece funcționează atât cu browsere headless, cât și cu headful. Este important de subliniat că ScrapingBee folosește browsere fără head în mod implicit, ceea ce este perfect pentru recuperarea automată a unor volume enorme de date.

Pentru a interacționa cu site-uri web care au o interfață complexă, utilizatorii pot trece la browsere headful. Pentru a asigura extragerea eficientă a datelor, ScrapingBee menține, de asemenea, un grup de proxy geolocați, care sunt verificați și modificați în mod regulat.

Utilizatorii pot reduce timpul și efortul în timpul web scraping utilizând ScrapingBee ca browser fără cap sau headful, garantând în același timp corectitudinea și caracterul complet al datelor preluate. De asemenea, are o mulțime de funcții utile, cum ar fi formatarea datelor, rotația proxy și conectivitate API, ceea ce îl face un instrument la îndemână atât pentru companii, cât și pentru studenți.

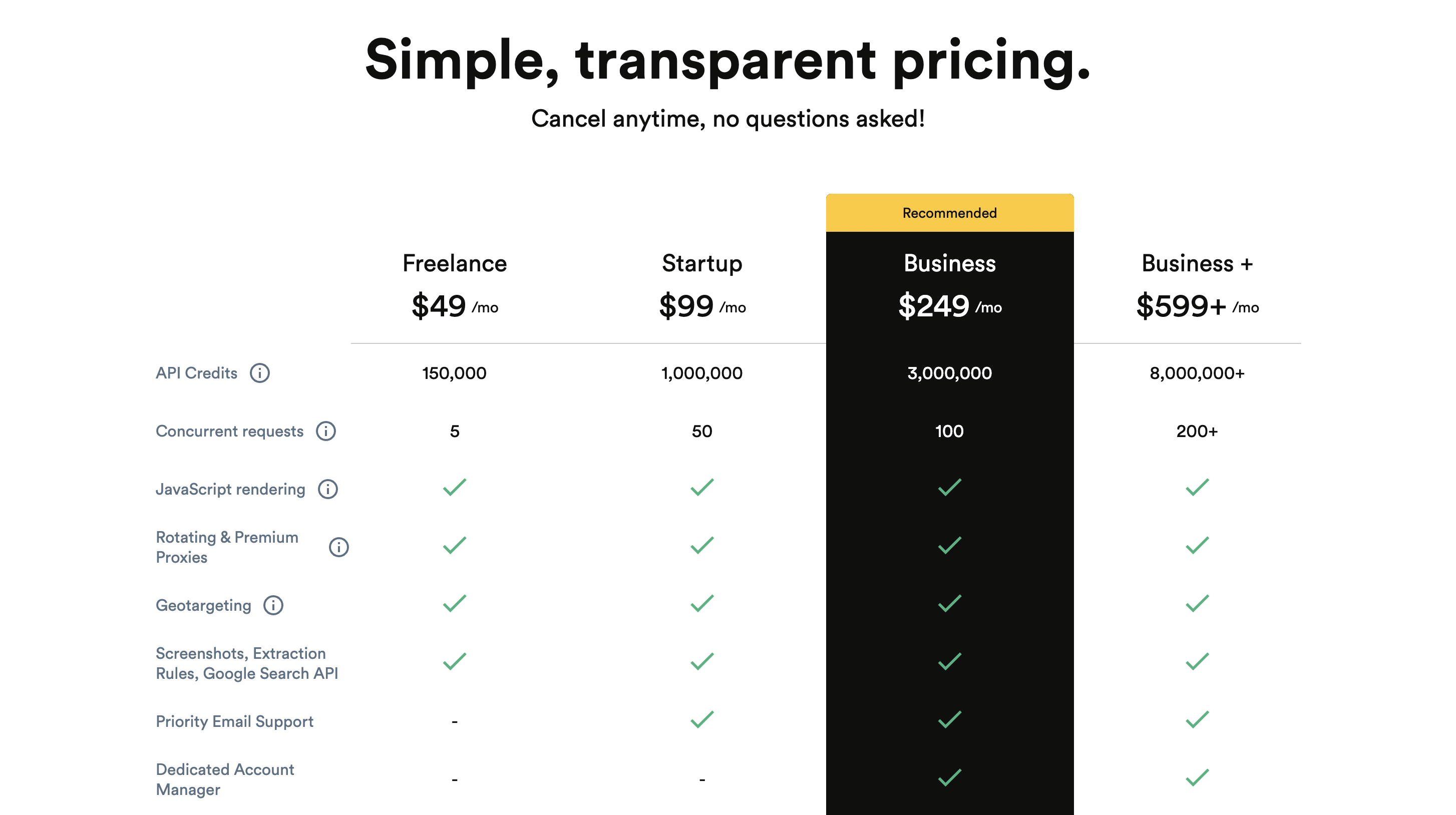

Tarif

Prețul premium începe de la 49 USD/lună.

6. ParseHub

Fără a fi nevoie de expertiză tehnică, utilizatorii pot aduna date de pe site-uri web folosind aplicația de scraping web ParseHub. Una dintre cele mai mari caracteristici ale sale este cât de ușor este de utilizat; utilizatorii pot alege datele pe care doresc să le răzuiască făcând clic pe elemente.

De asemenea, are capacitatea de a recunoaște paginarea automat, făcându-i simplu pentru utilizatori să răzuiască informații din mai multe pagini. Pentru a extrage datele de pe site-uri web cu interfețe de utilizator de bază sau complicate, ParseHub acceptă atât browsere fără cap, cât și browsere headful.

În plus, oferă rotație automată a IP-ului, ceea ce face mai dificil pentru site-uri web să identifice și să interzică activitatea de scraping. ParseHub garantează că datele sunt extrase într-un mod organizat cu ajutorul capabilităților sale extinse de formatare a datelor, simplificând analiza și integrarea sistemului.

În plus, ParseHub are un mod inteligent care recunoaște și adună automat informații de pe site-uri web similare. ParseHub poate recunoaște și aduna date de pe site-uri web cu structuri similare, cum ar fi site-uri de comerț electronic, folosind inteligență artificială (AI). Această caracteristică sporește acuratețea și productivitatea necesitând mai puțin efort și economisind timp.

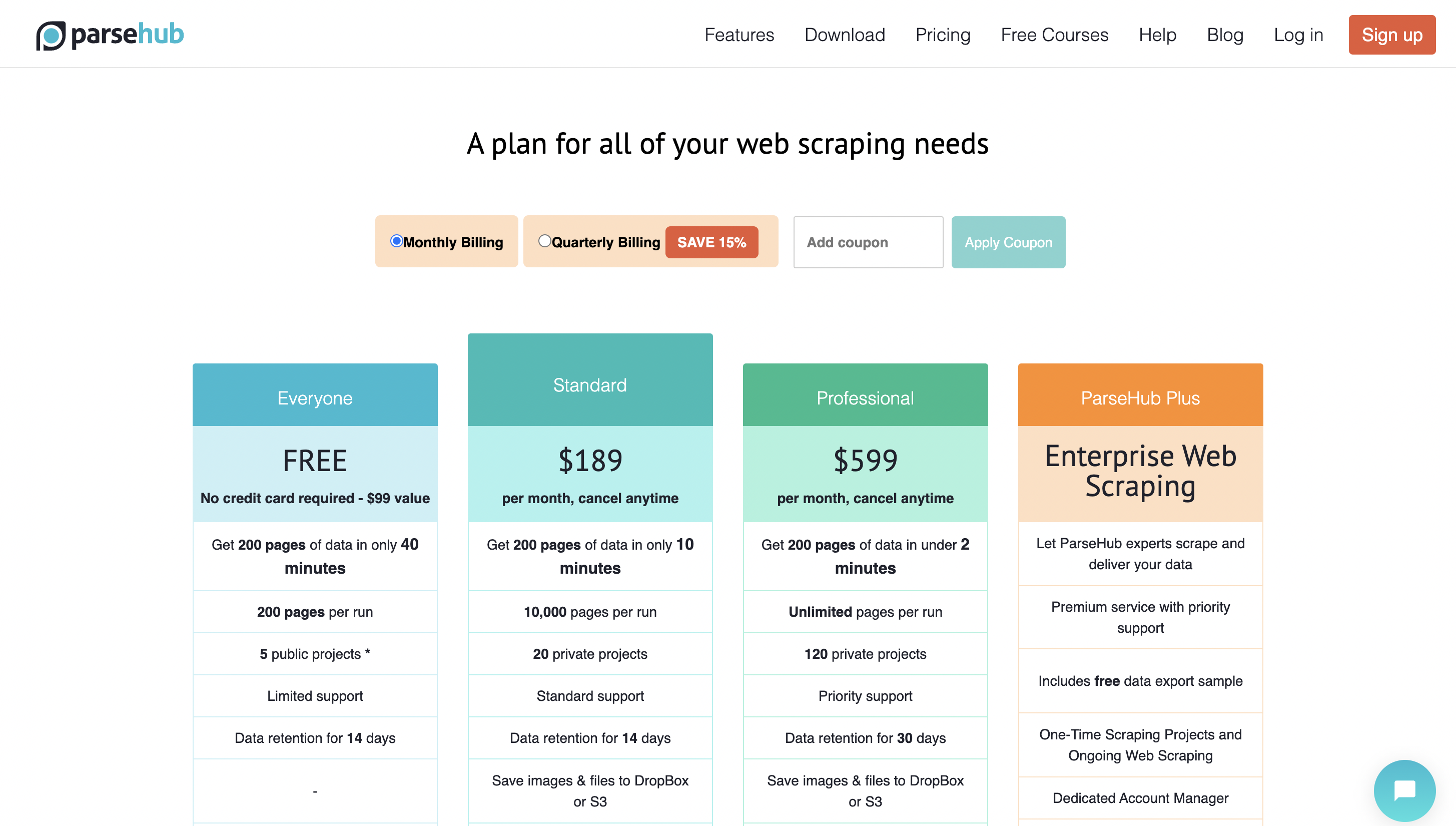

Tarif

Puteți începe să îl utilizați gratuit, iar prețul premium începe de la 189 USD/lună.

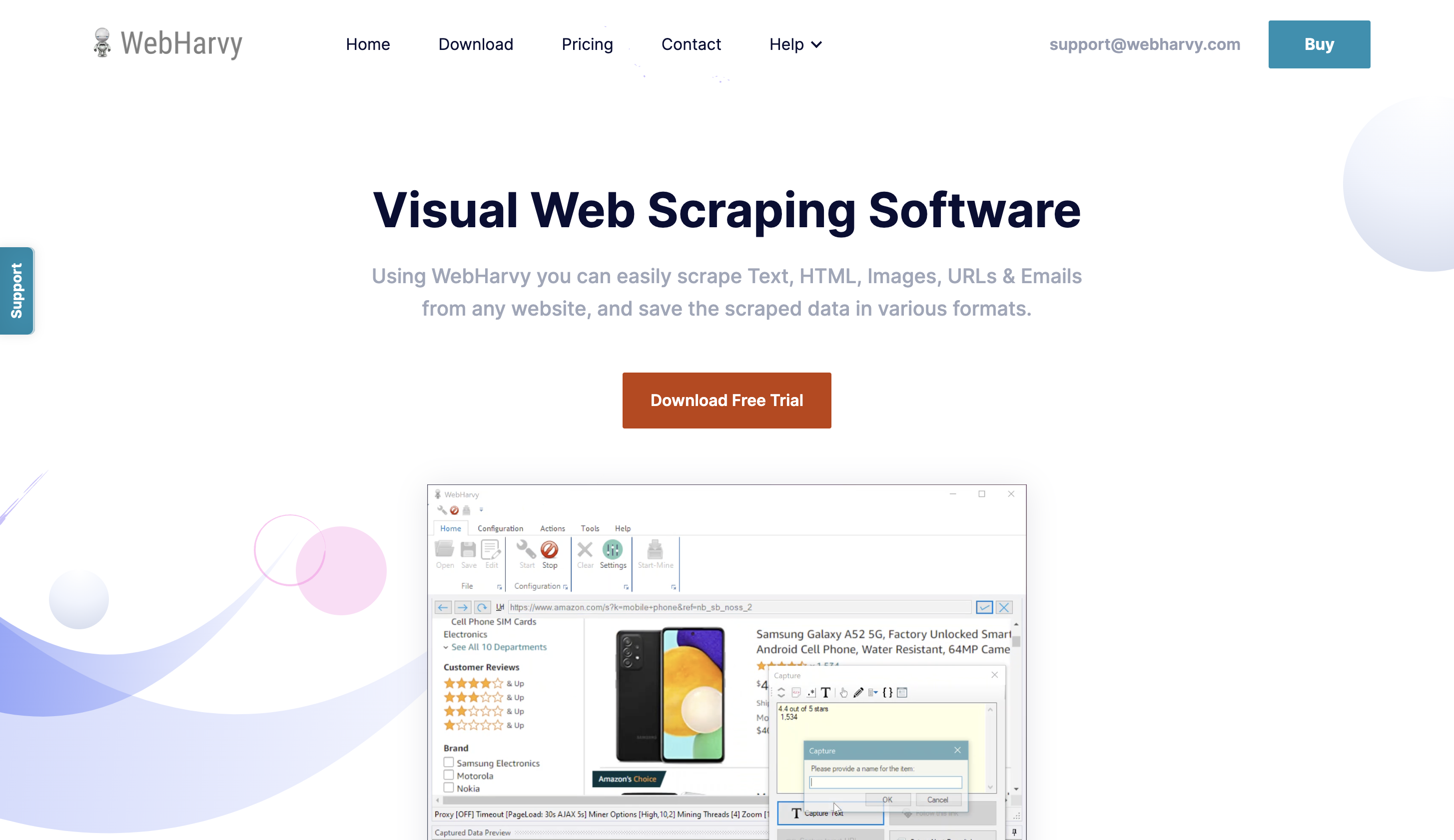

7. WebHarvy

WebHarvy este un instrument puternic de scraping online, care permite organizațiilor să extragă rapid, precis și eficient datele de pe site-uri web. Este conceput pentru a răzui informații de pe multe site-uri web, inclusiv motoarele de căutare, rețelele sociale, site-urile de comerț electronic și directoare.

Fără nicio experiență anterioară de codare, utilizatorii pot explora fără efort și pot crea lucrări de scraping datorită interfeței sale ușor de utilizat. Una dintre cele mai mari caracteristici ale WebHarvy este capacitatea sa de a prelua date de pe pagini web alimentate de JavaScript și AJAX, pe care alte instrumente de scraping ar putea să nu le poată accesa.

În plus, oferă o interfață Point and Click care simplifică alegerea informațiilor dintr-o pagină web pe care doriți să o răzuiți. WebHarvy are moduri de navigare fără cap și fără cap. Pentru o colectare mai rapidă și mai eficientă a datelor, poate funcționa în modul fără cap.

Modul Headful este util atunci când lucrați cu site-uri web complicate care solicită intrarea utilizatorului. De asemenea, poate naviga între numeroase pagini și completa formulare, ceea ce este util atunci când extrageți date de pe site-uri web cu mai multe pagini.

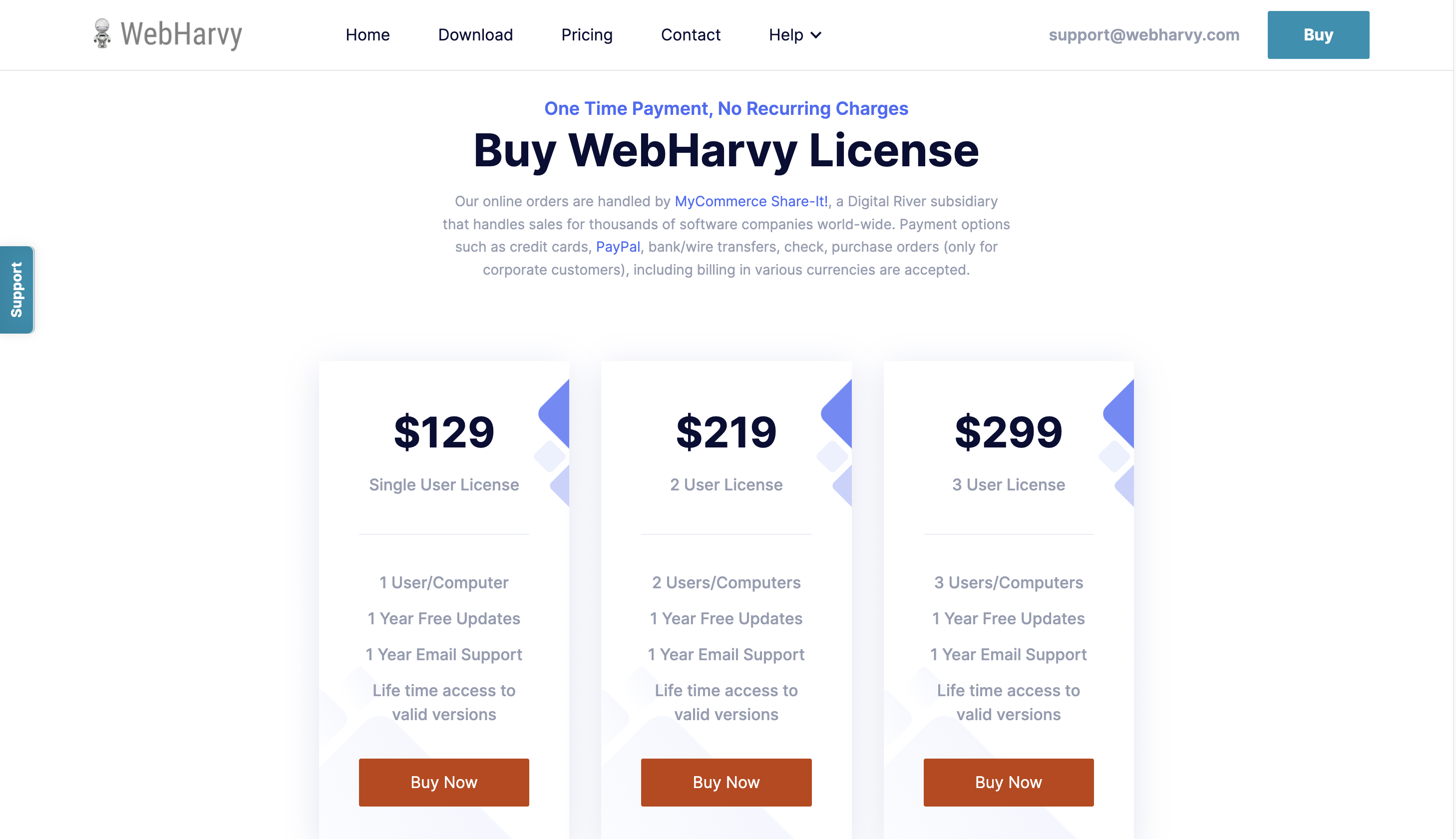

Tarif

Prețul premium începe de la 129 USD pentru o licență pentru un singur utilizator.

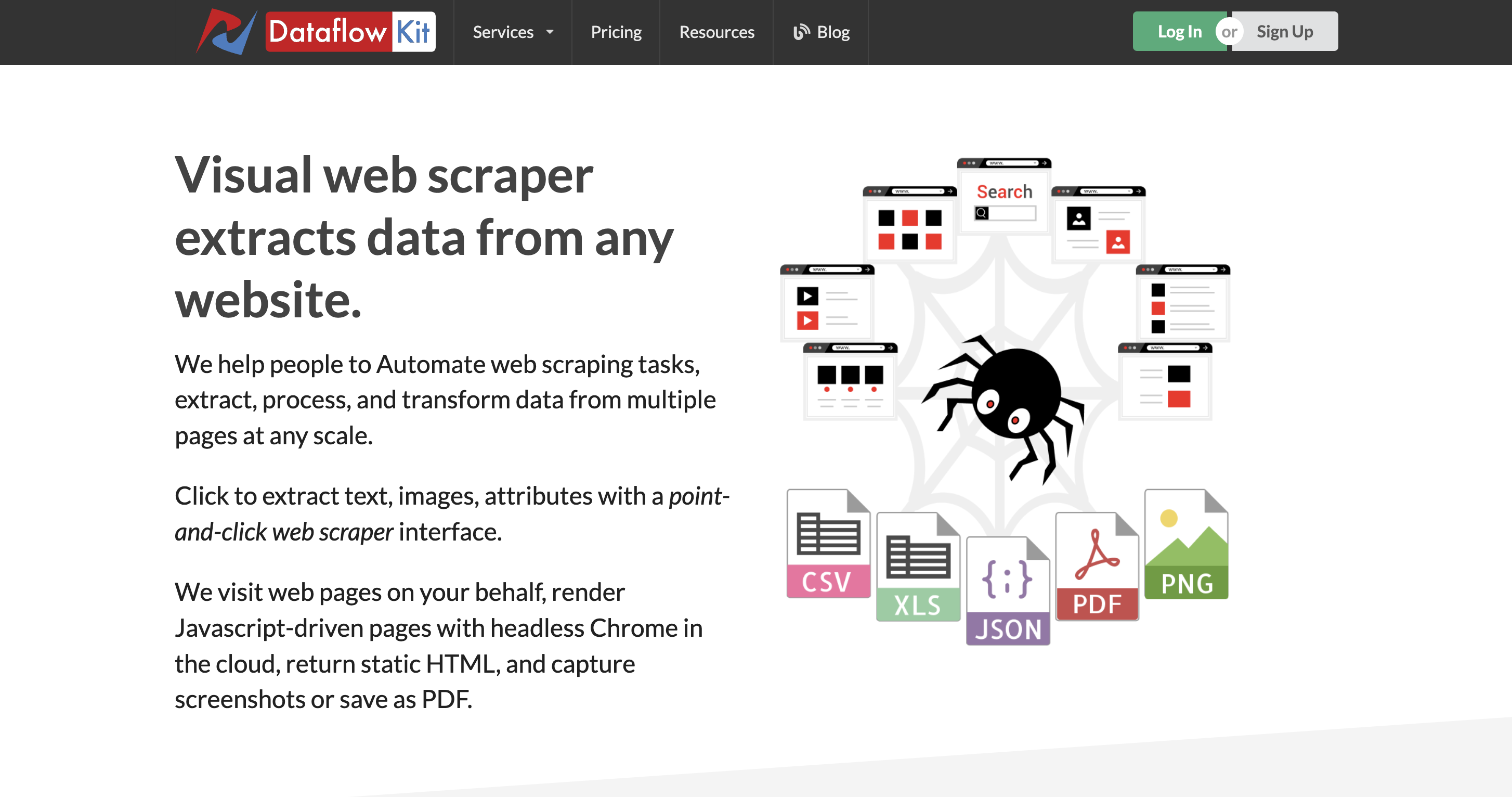

8. Kit de flux de date

Folosind Dataflow Kit, un instrument robust de scraping online, datele pot fi colectate și analizate de pe o varietate de site-uri web, inclusiv reţele sociale site-uri, motoare de căutare, site-uri web de comerț electronic și site-uri web de știri. Una dintre cele mai bune caracteristici ale sale este capacitatea de a colecta rapid și eficient date de pe site-uri web complicate și dinamice.

Este ideal pentru răzuirea site-urilor web care sunt dificil de accesat folosind alte metode, deoarece este atât de simplu de utilizat. Un browser fără cap și un browser cu cap sunt ambele funcționale cu Dataflow Kit. Funcții avansate precum rotația proxy și user-agent, evitarea blocării IP și detectarea anti-bot sunt furnizate pentru a asigura o scraping eficientă.

În plus, oferă o interfață ușor de utilizat, care le permite clienților să creeze, să planifice și să gestioneze activitățile lor de scraping fără nicio experiență de programare. Pentru aplicațiile de scraping web la scară largă, motorul său eficient de scraper este o soluție fantastică, deoarece este optimizat pentru a gestiona datele rapid și eficient.

Datele răzuite pot fi pur și simplu exportate într-o varietate de formate, inclusiv CSV, JSON și XML, permițându-vă să le analizați și să le utilizați în orice mod doriți. În plus, Dataflow Kit oferă o varietate de opțiuni de interfață, inclusiv API și Zapier, pentru a vă ajuta să vă simplificați fluxul de lucru și să vă automatizați procesul de extragere a datelor.

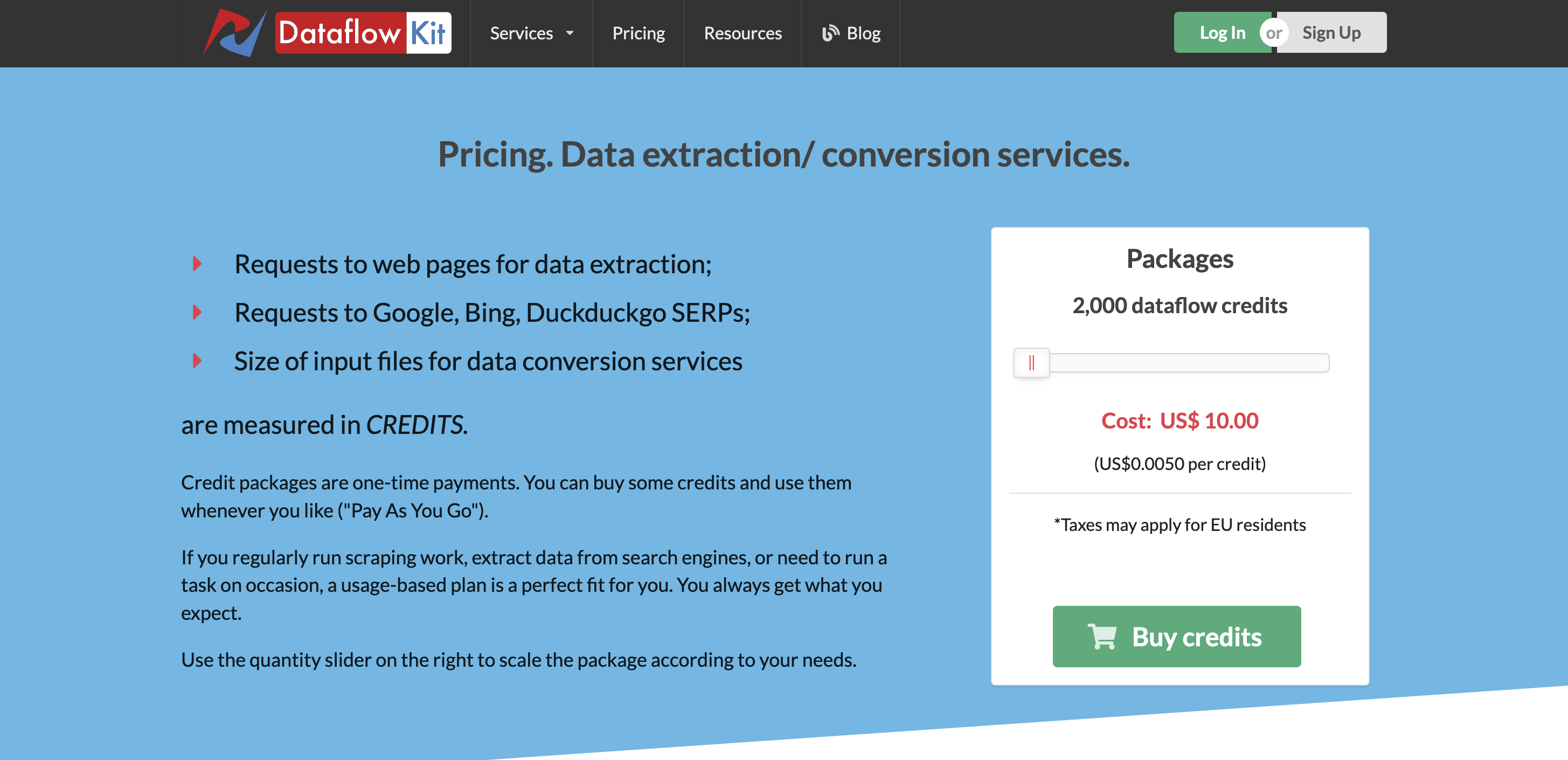

Tarif

Prețul premium începe de la 10 USD pentru 2000 de credite de flux de date, pe care le puteți utiliza în funcție de nevoile dvs.

9. import.io

Cu ajutorul instrumentului de scraping web bazat pe cloud Import.io, utilizatorii pot răzui date de pe site-uri web fără nicio experiență de programare. Simplitatea utilizării este una dintre cele mai atrăgătoare caracteristici ale Import.io; tot ce trebuie să faceți este să indicați și să faceți clic pentru a găsi datele pe care doriți să le răzuiți.

Utilizatorii pot evalua datele extrase în timp real datorită caracteristicilor sale puternice de vizualizare. Import.io este un browser fără cap care imită un browser web și se conectează la site-uri web în același mod ca o persoană, dar fără cerința unei interfețe grafice de utilizator.

Acest lucru îmbunătățește eficiența web scraping și permite utilizatorilor să răzuiască date de pe site-uri web dinamice care necesită implicarea utilizatorului pentru a afișa informații. Extractorul său alimentat de AI permite utilizatorilor să extragă date cu doar câteva clicuri. Extractorul poate identifica, de asemenea, modele de date și poate extrage date comparabile din numeroase surse.

Utilizatorii își pot automatiza eforturile de scraping și pot primi actualizări frecvente cu privire la datele pe care le doresc cu funcțiile sale complete de programare. Import.io simplifică utilizarea datelor extrase în alte aplicații, permițându-vă să vă conectați cu instrumente populare, cum ar fi Google Sheets și Zapier.

Tarif

Prețul nu este afișat pe site, vă rugăm să discutați cu un expert.

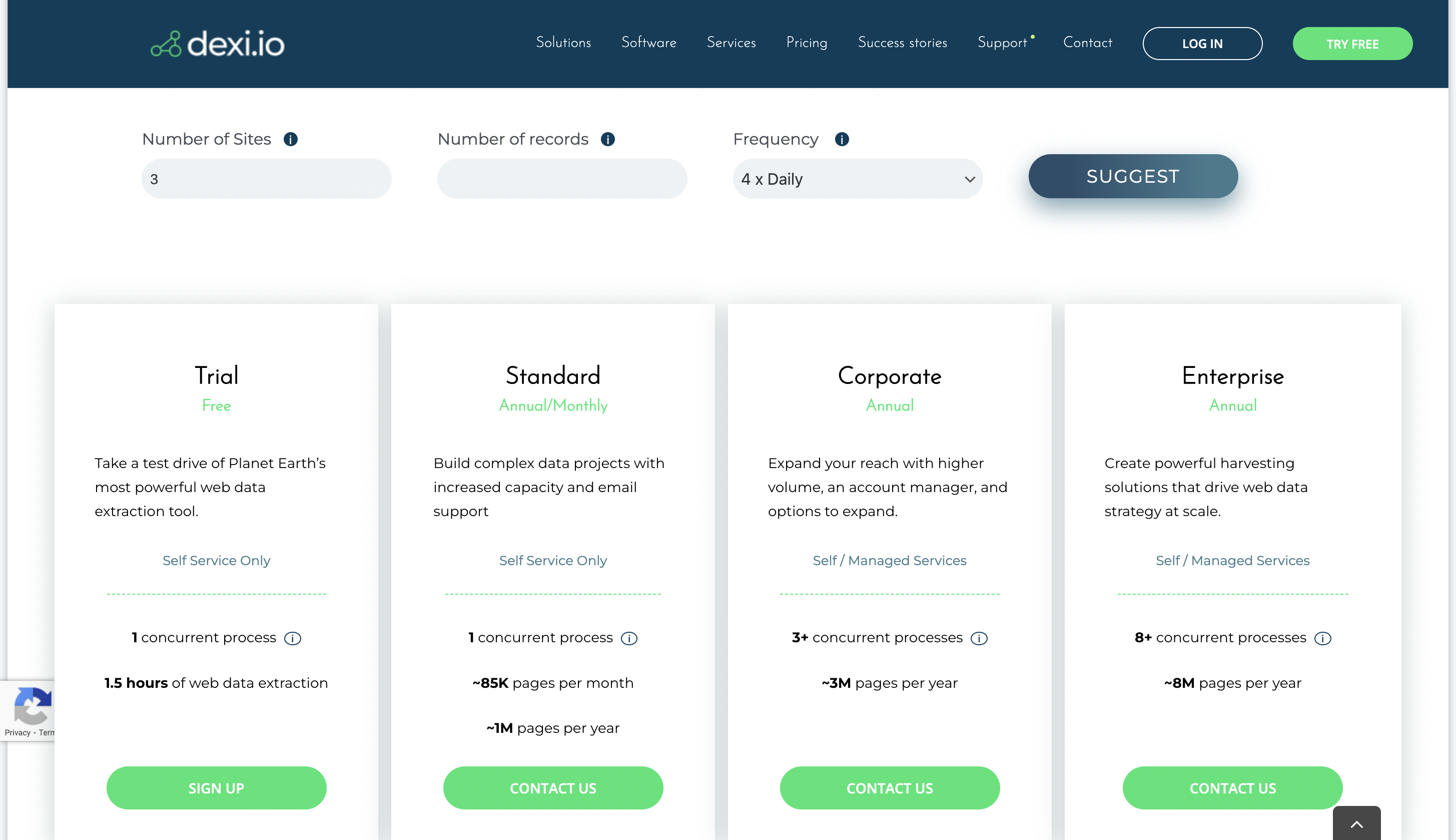

10. Dexi.io

Extragerea datelor este simplă cu ajutorul instrumentului robust de scraping web Dexi.io. Puteți aduna date de pe site-uri web folosind acest instrument fără nicio experiență de codare, datorită interfeței sale ușor de utilizat și posibilităților automate.

Una dintre cele mai bune caracteristici ale sale este capacitatea sa de a răzui și combina date din mai multe surse, inclusiv pagini web, API-uri și baze de date. Datorită capacității de procesare paralelă a Dexi.io, puteți colecta rapid și eficient volume masive de date.

Dexi.io vă oferă posibilitatea de a selecta cea mai bună alternativă pentru nevoile dvs. de scraping, deoarece funcționează atât ca browser fără cap, cât și ca browser headful. În timp ce opțiunea browser headful vă permite să vedeți și să interacționați cu site-ul web ca și cum ați folosi un browser obișnuit, opțiunea browser headful vă permite să răzuiți datele fără a afișa pagina într-un browser.

Acest lucru facilitează remedierea oricăror probleme de răzuire și ajustarea procedurii de răzuire în funcție de preferințele dvs. Puteți exporta rapid date răzuite din Dexi.io într-o varietate de formate, cum ar fi CSV, JSON și Excel, pentru analize suplimentare sau interacțiune cu alte aplicații.

În plus, oferă găzduire cloud fiabilă și sigură pentru datele dvs. răzuite, garantând securitatea și accesibilitatea acestora.

Tarif

Puteți încerca platforma cu planul său de încercare gratuită și puteți contacta echipa pentru prețuri.

Concluzie

În concluzie, pe piață există mai multe soluții de web scraping, fiecare cu avantaje și capabilități specifice. Există multe alternative de date din care să alegeți, de la soluții all-in-one, cum ar fi Bright Data și ScrapingBee, până la instrumente mai specializate precum Apify și ParseHub.

Aceste sisteme au adesea capabilități precum navigarea fără cap, rotația IP, falsificarea agentului utilizator și amprentarea browserului pentru a crește eficacitatea, fiabilitatea și secretul scrapingului online.

Instrumentele web scraping vă pot oferi acces rapid și simplu la o mulțime de informații, fie că sunteți un proprietar de mică afacere care încearcă să investigheze concurenții dvs., un cercetător care caută date pentru a vă sprijini activitatea sau un analist de date care caută informații despre comportamentul consumatorilor. .

Posibilitatea de greșeli și inconsecvențe poate fi redusă, în timp ce puteți economisi timp și bani prin automatizarea procesului de colectare a datelor.

Lasă un comentariu