Conteúdo[Esconder][Mostrar]

Tenho certeza de que você já ouviu falar de inteligência artificial, bem como de palavras como aprendizado de máquina e processamento de linguagem natural (NLP).

Especialmente se você trabalha para uma empresa que lida com centenas, senão milhares, de contatos de clientes todos os dias.

A análise de dados de postagens de mídia social, e-mails, bate-papos, respostas de pesquisas abertas e outras fontes não é um processo simples e se torna ainda mais difícil quando confiado apenas a pessoas.

É por isso que muitas pessoas estão entusiasmadas com o potencial de inteligência artificial para o seu trabalho quotidiano e para as empresas.

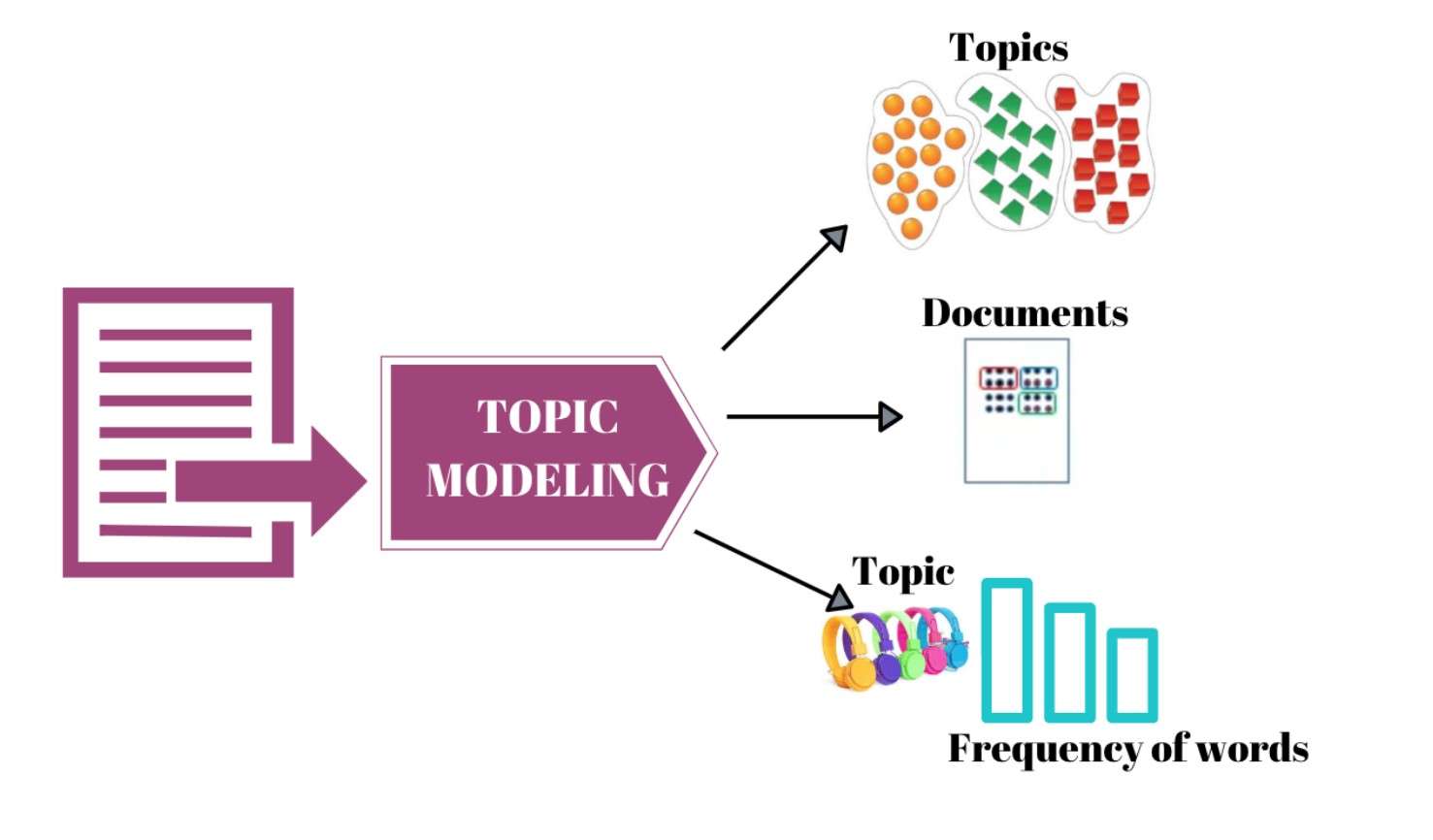

A análise de texto com inteligência artificial emprega uma ampla variedade de abordagens ou algoritmos para interpretar a linguagem organicamente, uma das quais é a análise de tópicos, usada para descobrir automaticamente assuntos de textos.

As empresas podem usar modelos de análise de tópicos para transferir tarefas fáceis para máquinas, em vez de sobrecarregar os trabalhadores com muitos dados.

Considere quanto tempo sua equipe poderia economizar e dedicar a trabalhos mais essenciais se um computador pudesse filtrar listas intermináveis de pesquisas de clientes ou problemas de suporte todas as manhãs.

Neste guia, veremos a modelagem de tópicos, diferentes métodos de modelagem de tópicos e obteremos alguma experiência prática com isso.

O que é Modelagem de Tópicos?

A modelagem de tópicos é um tipo de mineração de texto em que estatísticas não supervisionadas e supervisionadas aprendizado de máquina técnicas são usadas para detectar tendências em um corpus ou um volume significativo de texto não estruturado.

Ele pode pegar sua enorme coleção de documentos e usar um método de similaridade para organizar as palavras em grupos de termos e descobrir assuntos.

Isso parece um pouco complexo e difícil, então vamos simplificar o procedimento de modelagem de assunto!

Suponha que você esteja lendo um jornal com um conjunto de marcadores coloridos na mão.

Isso não é antiquado?

Percebo que hoje em dia poucas pessoas lêem jornais impressos; tudo é digital, e os marcadores são coisa do passado! Finja ser seu pai ou sua mãe!

Então, quando você lê o jornal, você destaca os termos importantes.

Mais uma suposição!

Você usa um tom diferente para enfatizar as palavras-chave de vários temas. Você categoriza as palavras-chave de acordo com a cor e os tópicos fornecidos.

Cada coleção de palavras marcadas por uma determinada cor é uma lista de palavras-chave para um determinado tópico. A quantidade de várias cores que você escolheu mostra o número de temas.

Esta é a modelagem de tópicos mais fundamental. Ele ajuda na compreensão, organização e sumarização de grandes coleções de texto.

No entanto, lembre-se de que, para serem eficazes, os modelos de tópicos automatizados exigem muito conteúdo. Se você tem um papel curto, você pode querer ir à velha escola e usar marcadores!

Também é benéfico passar algum tempo conhecendo os dados. Isso lhe dará uma noção básica do que o modelo de tópico deve encontrar.

Por exemplo, esse diário pode ser sobre seus relacionamentos atuais e anteriores. Assim, eu anteciparia que meu amigo robô de mineração de texto tivesse ideias semelhantes.

Isso pode ajudá-lo a analisar melhor a qualidade dos assuntos que você identificou e, se necessário, ajustar os conjuntos de palavras-chave.

Componentes da Modelagem de Tópicos

Modelo probabilístico

Variáveis aleatórias e distribuições de probabilidade são incorporadas à representação de um evento ou fenômeno em modelos probabilísticos.

Um modelo determinístico fornece uma única conclusão potencial para um evento, enquanto um modelo probabilístico fornece uma distribuição de probabilidade como solução.

Esses modelos consideram a realidade de que raramente temos conhecimento completo de uma situação. Há quase sempre um elemento de aleatoriedade a considerar.

Por exemplo, o seguro de vida baseia-se na realidade de que sabemos que vamos morrer, mas não sabemos quando. Esses modelos podem ser parcialmente determinísticos, parcialmente aleatórios ou totalmente aleatórios.

Recuperação de informações

A recuperação de informações (IR) é um programa de software que organiza, armazena, recupera e avalia informações de repositórios de documentos, particularmente informações textuais.

A tecnologia ajuda os usuários a descobrir as informações de que precisam, mas não fornece respostas claras às suas perguntas. Notifica a presença e localização de documentos que possam fornecer as informações necessárias.

Documentos relevantes são aqueles que atendem às necessidades do usuário. Um sistema de IR sem falhas retornará apenas documentos selecionados.

Coerência do tópico

Topic Coherence pontua um único tópico calculando o grau de similaridade semântica entre os termos de alta pontuação do tópico. Essas métricas ajudam a distinguir entre assuntos que são semanticamente interpretáveis e tópicos que são artefatos de inferência estatística.

Se um grupo de afirmações ou fatos se apoiam mutuamente, dizemos que são coerentes.

Como resultado, um conjunto de fatos coeso pode ser entendido em um contexto que engloba todos ou a maioria dos fatos. “O jogo é um esporte de equipe”, “o jogo é jogado com uma bola” e “o jogo requer um esforço físico tremendo” são exemplos de conjuntos de fatos coesos.

Diferentes métodos de modelagem de tópicos

Este procedimento crítico pode ser realizado por uma variedade de algoritmos ou metodologias. Entre eles estão:

- Alocação Latent Dirichlet (LDA)

- Fatoração de Matriz Não Negativa (NMF)

- Análise Semântica Latente (LSA)

- Análise semântica latente probabilística (pLSA)

Alocação de Dirichlet Latente (LDA)

Para detectar relações entre vários textos em um corpus, utiliza-se o conceito estatístico e gráfico de Alocação de Dirichlet Latente.

Usando a abordagem Variational Exception Maximization (VEM), a maior estimativa de probabilidade do corpus completo de texto é alcançada.

Tradicionalmente, as primeiras palavras de um pacote de palavras são escolhidas.

No entanto, a frase é completamente sem sentido.

De acordo com essa técnica, cada texto será representado por uma distribuição probabilística de assuntos e cada tópico por uma distribuição probabilística de palavras.

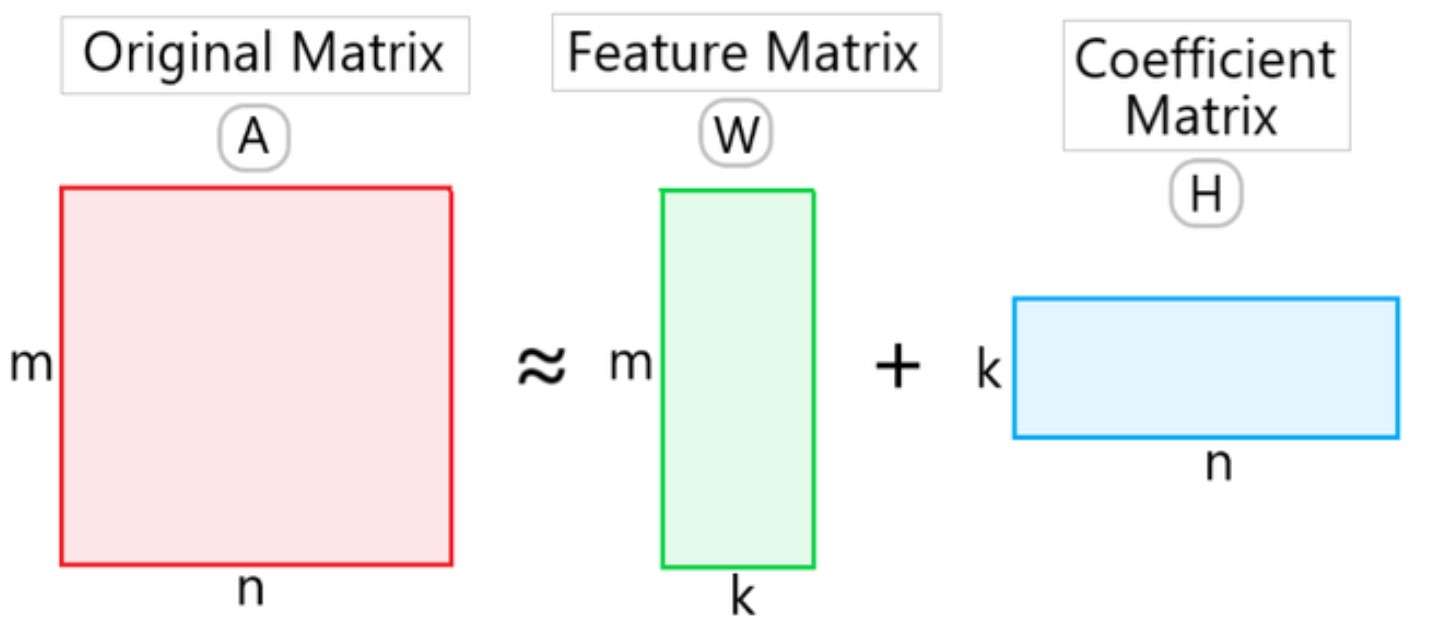

Fatoração de Matriz Não Negativa (NMF)

A fatoração de matriz com valores não negativos é uma abordagem de extração de recursos de ponta.

Quando há muitas qualidades e os atributos são vagos ou têm pouca previsibilidade, o NMF é benéfico. O NMF pode gerar padrões, assuntos ou temas significativos combinando características.

O NMF gera cada recurso como uma combinação linear do conjunto de atributos original.

Cada recurso contém um conjunto de coeficientes que representam a importância de cada atributo no recurso. Cada atributo numérico e cada valor de cada atributo de categoria tem seu próprio coeficiente.

Todos os coeficientes são positivos.

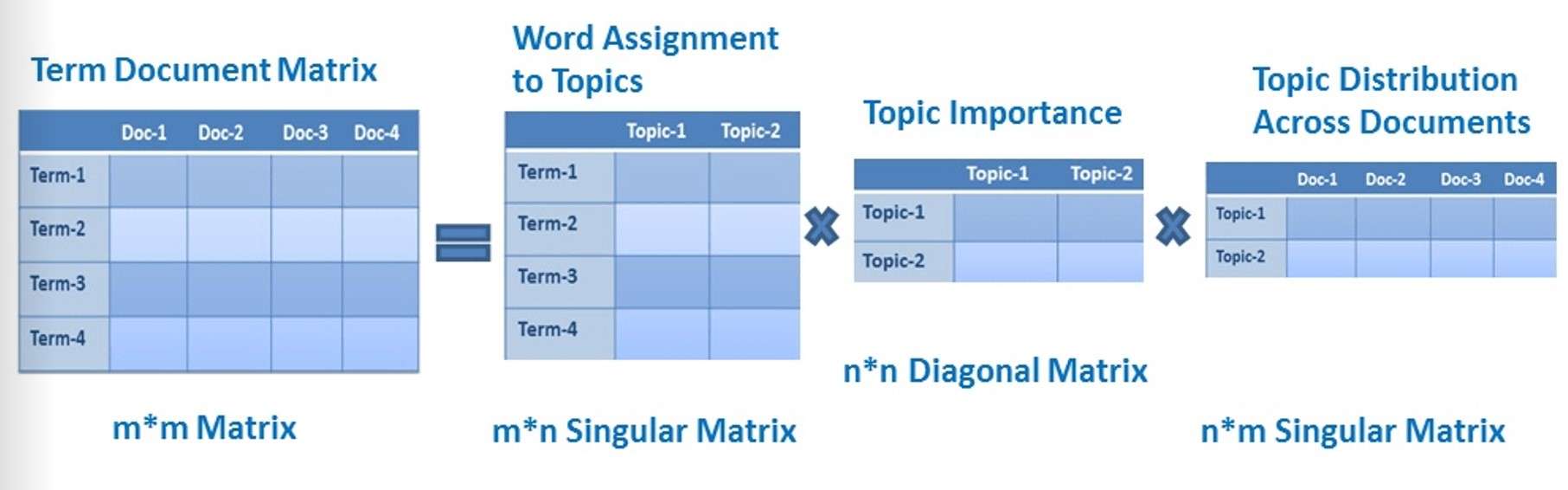

Análise semântica latente

Outro método de aprendizado não supervisionado usado para extrair associações entre palavras em um conjunto de documentos é a análise semântica latente.

Isso nos ajuda a escolher os documentos adequados. Sua principal função é reduzir a dimensionalidade do enorme corpus de dados de texto.

Esses dados desnecessários servem como ruído de fundo na aquisição dos insights necessários dos dados.

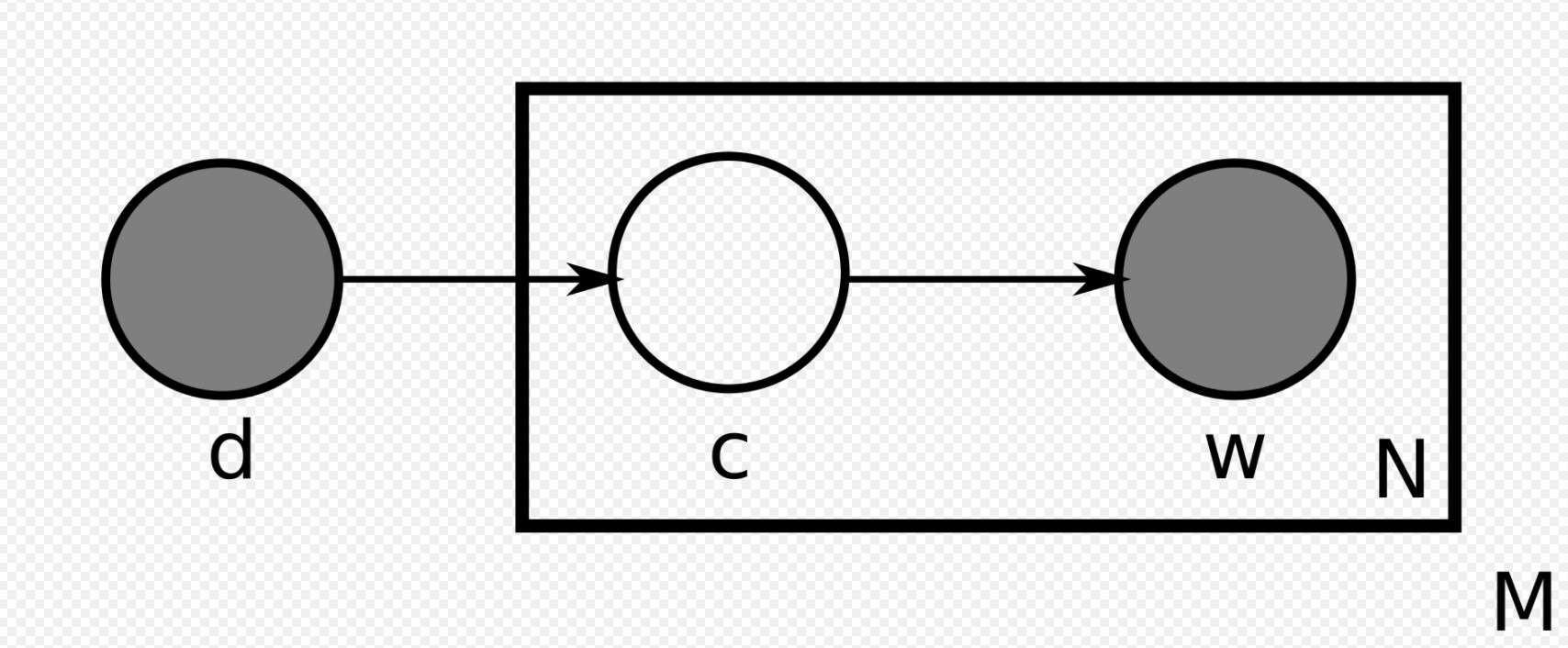

Análise semântica latente probabilística (pLSA)

A análise semântica latente probabilística (PLSA), às vezes conhecida como indexação semântica latente probabilística (PLSI, principalmente em círculos de recuperação de informações), é uma abordagem estatística para analisar dados de dois modos e de co-ocorrência.

De fato, semelhante à análise semântica latente, da qual surgiu o PLSA, uma representação de baixa dimensão das variáveis observadas pode ser derivada em termos de sua afinidade com determinadas variáveis ocultas.

Hands-on com modelagem de tópicos em Python

Agora, vou orientá-lo em uma tarefa de modelagem de assunto com o Python linguagem de programação usando um exemplo do mundo real.

Estarei modelando artigos de pesquisa. O conjunto de dados que usarei aqui vem de kaggle.com. Você pode obter facilmente todos os arquivos que estou usando neste trabalho neste página.

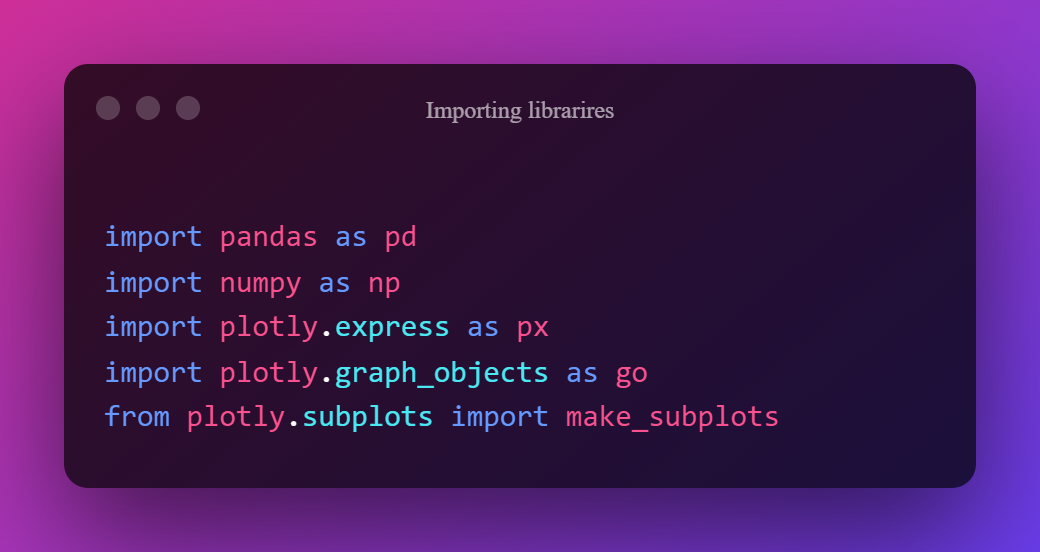

Vamos começar com Topic Modeling usando Python importando todas as bibliotecas essenciais:

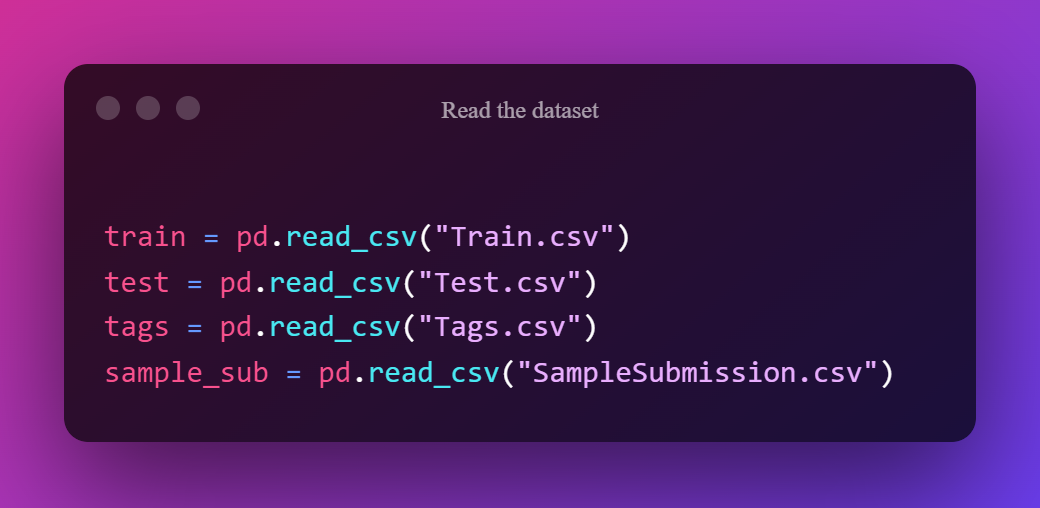

A etapa a seguir é ler todos os conjuntos de dados que usarei nesta tarefa:

Análise exploratória de dados

EDA (Exploratory Data Analysis) é um método estatístico que emprega elementos visuais. Ele usa resumos estatísticos e representações gráficas para descobrir tendências, padrões e testar suposições.

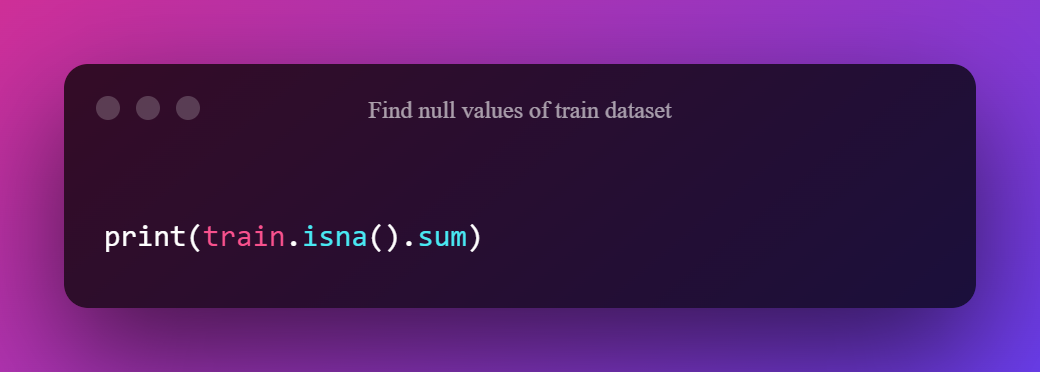

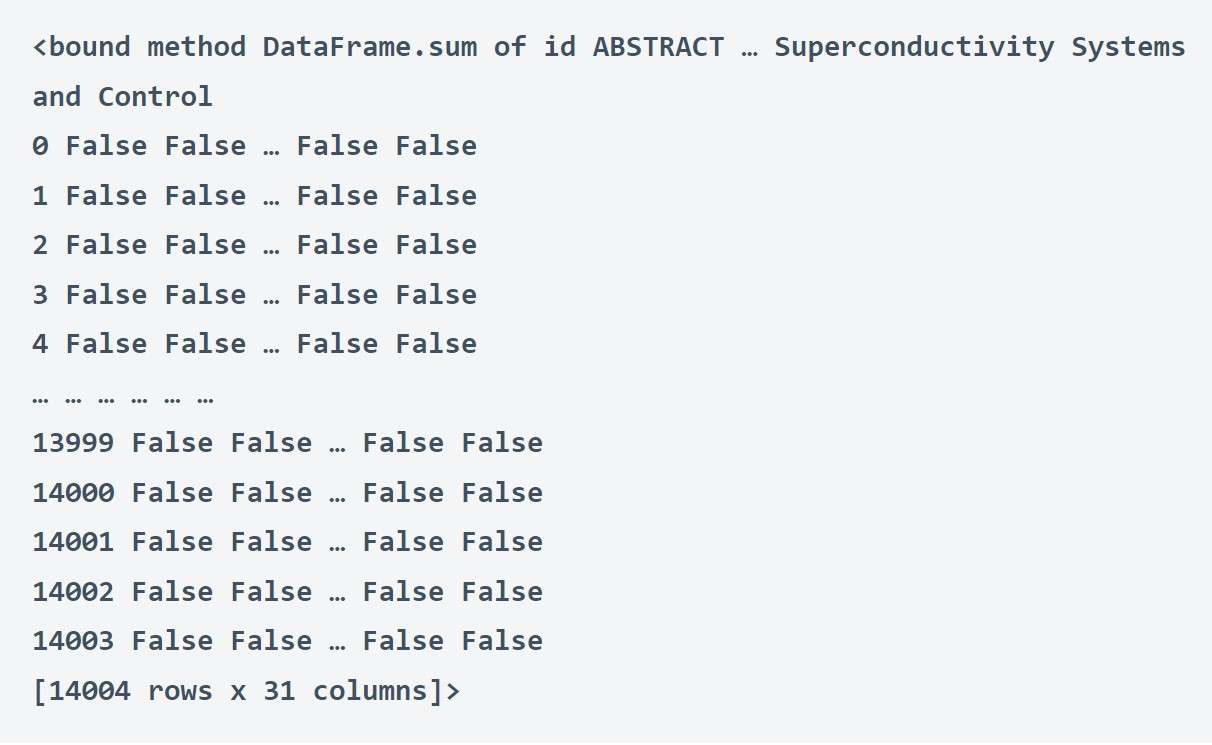

Farei uma análise exploratória de dados antes de iniciar a modelagem de tópicos para ver se há algum padrão ou relacionamento nos dados:

Agora vamos encontrar os valores nulos do conjunto de dados de teste:

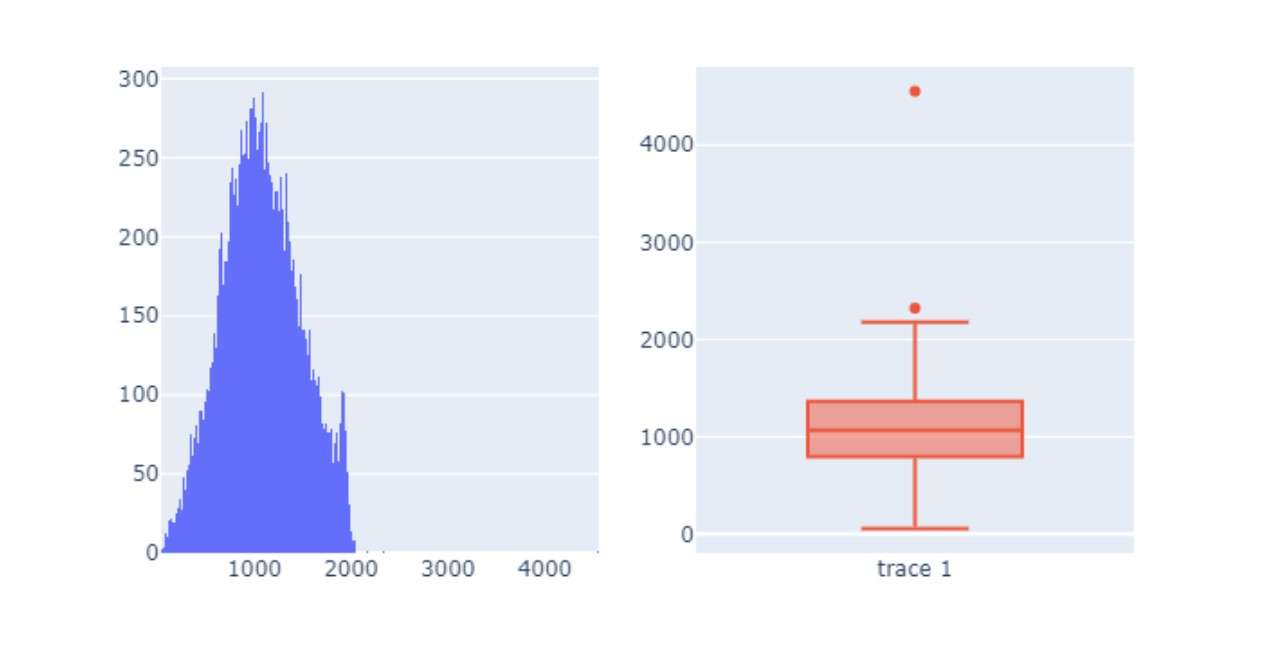

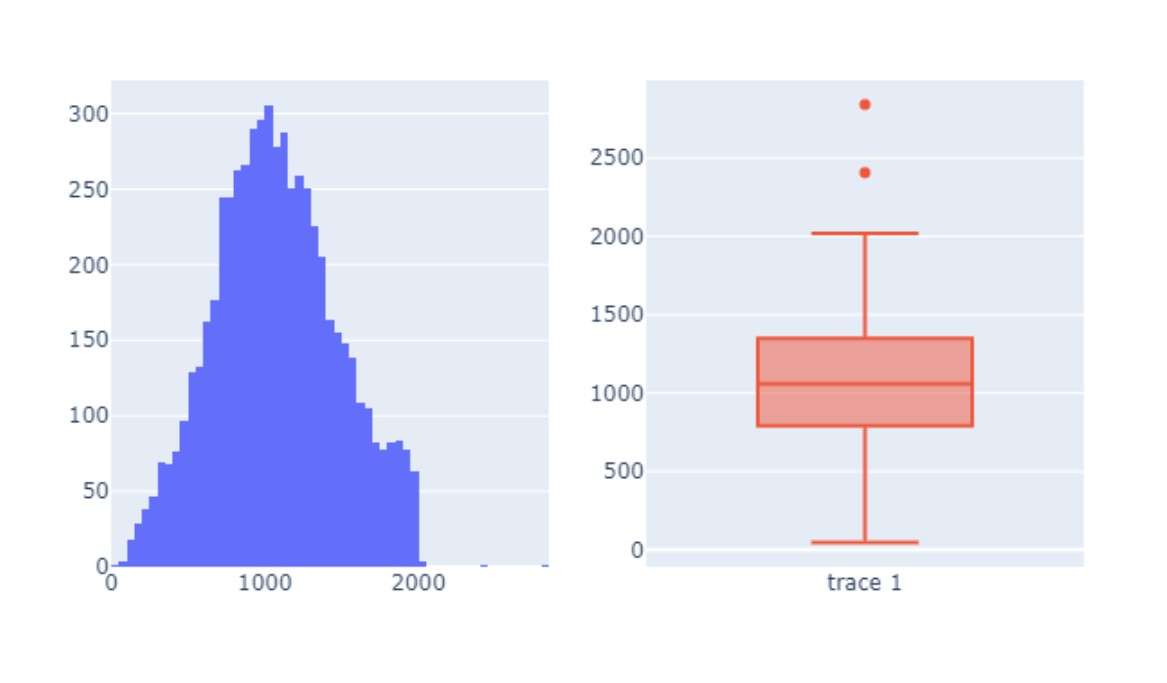

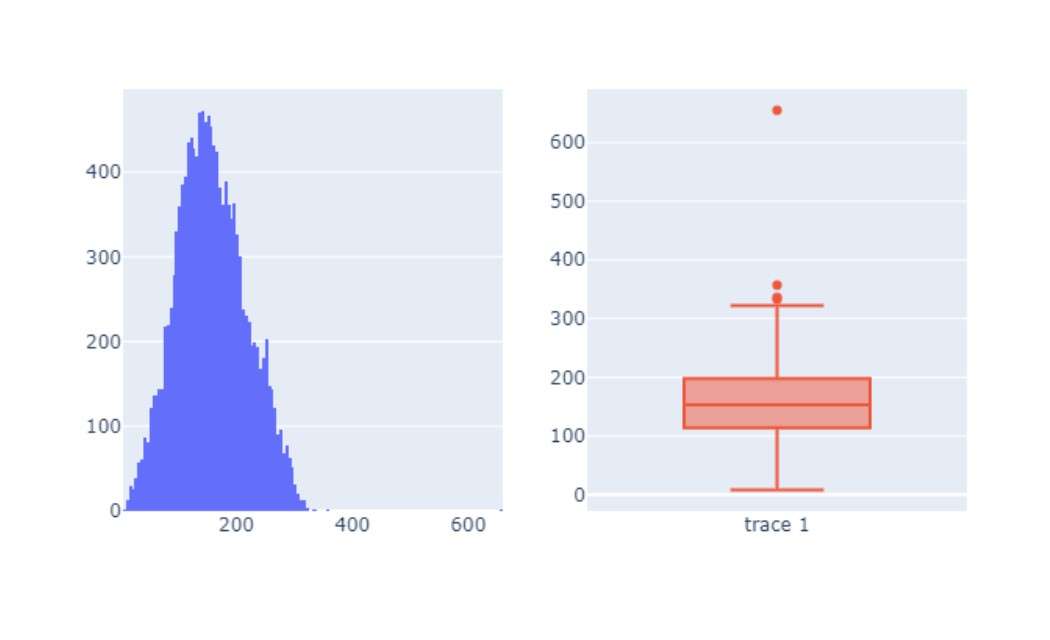

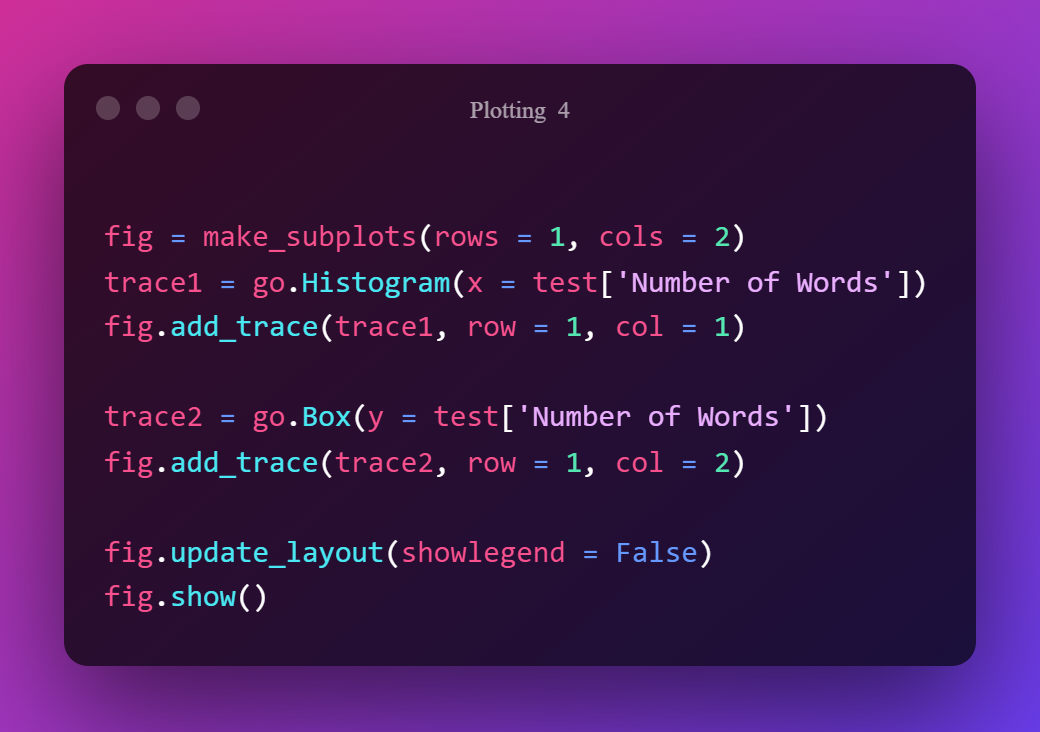

Agora estarei plotando um histograma e um boxplot para verificar a relação entre as variáveis.

A quantidade de caracteres no conjunto Resumos do Trem varia muito.

No trem, temos um mínimo de 54 e um máximo de 4551 caracteres. 1065 é a quantidade média de caracteres.

O conjunto de teste parece ser mais interessante que o conjunto de treinamento, pois o conjunto de teste possui 46 caracteres enquanto o conjunto de treinamento possui 2841.

Como resultado, o conjunto de teste teve uma mediana de 1058 caracteres, o que é semelhante ao conjunto de treinamento.

O número de palavras no conjunto de aprendizagem segue um padrão semelhante ao número de letras.

São permitidos um mínimo de 8 palavras e um máximo de 665 palavras. Como resultado, a contagem mediana de palavras é 153.

Um mínimo de sete palavras em um resumo e um máximo de 452 palavras no conjunto de teste são necessários.

A mediana, neste caso, é 153, que é idêntica à mediana do conjunto de treinamento.

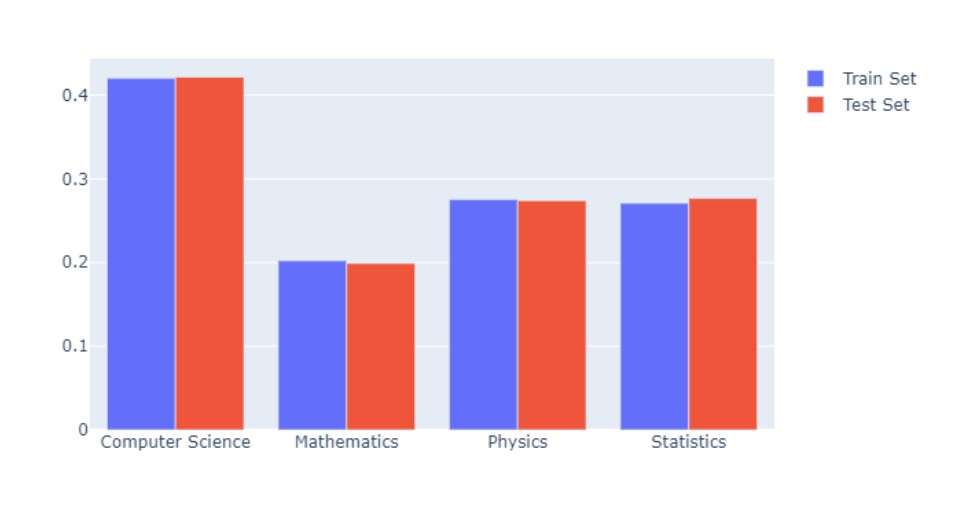

Usando tags para modelagem de tópicos

Existem várias estratégias de modelagem de tópicos. Usarei tags neste exercício; vamos ver como fazer isso examinando as tags:

Aplicações da Modelagem de Tópicos

- Um resumo de texto pode ser usado para discernir o tópico de um documento ou livro.

- Ele pode ser usado para remover o viés do candidato da pontuação do exame.

- A modelagem de tópicos pode ser usada para construir relacionamentos semânticos entre palavras em modelos baseados em gráficos.

- Ele pode melhorar o atendimento ao cliente detectando e respondendo a palavras-chave na consulta do cliente. Os clientes terão mais confiança em você, pois você lhes forneceu a assistência necessária no momento apropriado e sem causar problemas. Como resultado, a fidelidade do cliente aumenta drasticamente e o valor da empresa aumenta.

Conclusão

A modelagem de tópicos é um tipo de modelagem estatística usada para descobrir “assuntos” abstratos que existem em uma coleção de textos.

É uma forma do modelo estatístico usado em aprendizado de máquina e processamento de linguagem natural para descobrir conceitos abstratos que existem em um conjunto de textos.

É um método de mineração de texto amplamente utilizado para encontrar padrões semânticos latentes no corpo do texto.

Deixe um comentário