Być może słyszałeś o tym, jak potężne stały się modele sztucznej inteligencji przetwarzające tekst na obraz w ciągu ostatnich kilku lat. Ale czy wiesz, że ta sama technologia może pomóc w przejściu z 2D do 3D?

Modele 3D generowane przez sztuczną inteligencję mają szerokie zastosowanie w dzisiejszym środowisku cyfrowym. Gier wideo i film opierają się na wykwalifikowanych artystach 3D i oprogramowaniu do modelowania, takim jak Blender, do tworzenia zasobów 3D w celu wypełnienia scen generowanych komputerowo.

Czy jest jednak możliwe, aby branża mogła wykorzystać uczenie maszynowe do tworzenia zasobów 3D przy mniejszym wysiłku, podobnie jak dzisiejsi artyści 2D zaczynają wdrażać technologie takie jak DALL-E i W połowie drogi?

W tym artykule przyjrzymy się nowemu algorytmowi, który próbuje stworzyć skuteczny model zamiany tekstu na 3D przy użyciu istniejących modele dyfuzyjne.

Co to jest Fuzja snów?

Jednym z głównych problemów związanych z tworzeniem modelu rozpowszechniania, który bezpośrednio generuje zasoby 3D, jest to, że po prostu nie ma zbyt wielu dostępnych danych 3D. Modele dyfuzji 2D stały się tak potężne dzięki ogromnemu zbiorowi danych obrazów znalezionych w Internecie. Tego samego nie można powiedzieć o zasobach 3D.

Niektóre techniki generatywne 3D pozwalają obejść ten brak danych, wykorzystując obfitość danych 2D.

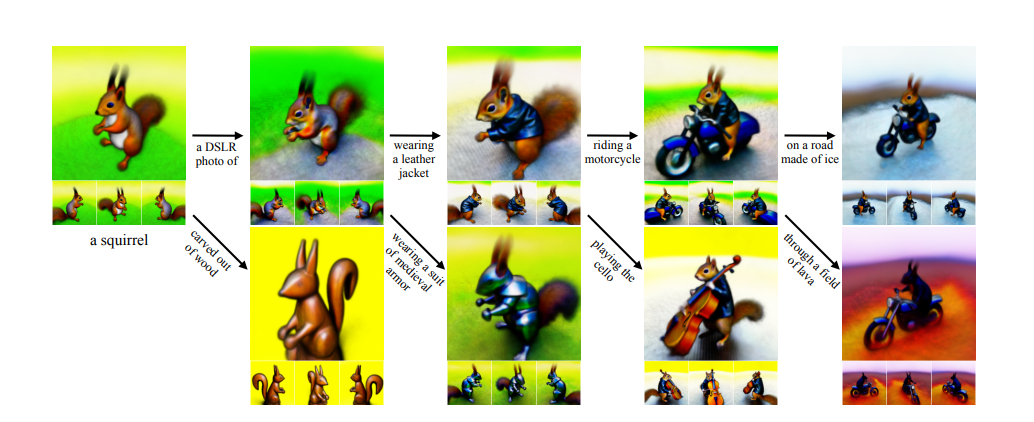

DreamFusion to model generatywny, który może tworzyć modele 3D na podstawie dostarczonego opisu tekstowego. Model DreamFusion wykorzystuje wstępnie wytrenowany model przenikania tekstu do obrazu w celu generowania realistycznych modeli trójwymiarowych na podstawie monitów tekstowych.

Pomimo braku danych treningowych 3D, to podejście wygenerowało spójne zasoby 3D o wysokiej wierności wyglądzie i głębi.

Jak to działa?

Algorytm DreamFusion składa się z dwóch głównych modeli: modelu dyfuzyjnego 2D i modelu a sieci neuronowe które mogą konwertować obrazy 2D w spójną scenę 3D.

Model Imagen zamiany tekstu na obraz firmy Google

Pierwszą częścią algorytmu jest model dyfuzji. Ten model odpowiada za konwersję tekstu na obrazy.

Obraz to model dyfuzji, który może generować dużą próbkę odmian obrazu określonego obiektu. W takim przypadku nasze warianty obrazu powinny obejmować wszystkie możliwe kąty dostarczonego obiektu. Na przykład, gdybyśmy chcieli wygenerować model 3D konia, potrzebowalibyśmy obrazów 2D konia ze wszystkich możliwych kątów. Celem jest wykorzystanie Imagen do dostarczenia jak największej ilości informacji (kolory, odbicia, gęstość) dla kolejnego modelu w naszym algorytmie.

Tworzenie modeli 3D za pomocą NeRF

Następnie Dreamfusion używa modelu znanego jako a Neuronowe pole promieniowania lub NeRF, aby faktycznie utworzyć model 3D z wygenerowanego zestawu obrazów. NeRF są w stanie tworzyć złożone sceny 3D, mając zestaw danych obrazów 2D.

Spróbujmy zrozumieć, jak działa NeRF.

Model ma na celu stworzenie ciągłej wolumetrycznej funkcji sceny zoptymalizowanej na podstawie dostarczonego zestawu danych obrazów 2D.

Jeśli model tworzy funkcję, jakie są dane wejściowe i wyjściowe?

Funkcja sceny pobiera lokalizację 3D i kierunek oglądania 2D jako dane wejściowe. Następnie funkcja wyprowadza kolor (w postaci RGB) i określoną gęstość objętościową.

Aby wygenerować obraz 2D z określonego punktu widzenia, model wygeneruje zestaw punktów 3D i przeprowadzi te punkty przez funkcję sceny, aby zwrócić zestaw wartości gęstości koloru i objętości. Techniki renderowania objętościowego następnie przekonwertują te wartości na wynikowy obraz 2D.

Używanie razem modeli NeRF i 2D Difusion

Teraz, gdy wiemy, jak działa NeRF, zobaczmy, jak ten model może generować dokładne modele 3D z naszych wygenerowanych obrazów.

Dla każdego dostarczonego monitu tekstowego DreamFusion trenuje od podstaw losowo zainicjowany NeRF. Każda iteracja wybiera losową pozycję kamery w zbiorze współrzędnych sferycznych. Pomyśl o modelu zamkniętym w szklanej kuli. Za każdym razem, gdy generujemy nowy obraz naszego modelu 3D, wybieramy losowy punkt w naszej sferze jako punkt obserwacyjny naszego wyniku. DreamFusion wybierze również losową pozycję światła l użyć do renderowania.

Gdy mamy już pozycję kamery i światła, zostanie wyrenderowany model NeRF. DreamFusion będzie również losowo wybierać między kolorowym renderowaniem, renderowaniem bez tekstury i renderowaniem albedo bez żadnego cieniowania.

Wspomnieliśmy wcześniej, że chcemy, aby nasz model zamiany tekstu na obraz (Imagen) generował wystarczającą liczbę obrazów, aby utworzyć reprezentatywną próbkę.

Jak Dreamfusion to osiąga?

Dreamfusion po prostu nieznacznie modyfikuje zachętę do wprowadzania danych, aby uzyskać zamierzone kąty. Na przykład możemy uzyskać wysokie kąty elewacji, dodając „widok z góry” do naszego monitu. Możemy wygenerować inne kąty, dodając zwroty, takie jak „widok z przodu”, „widok z boku” i „widok z tyłu”.

Sceny są wielokrotnie renderowane z losowych pozycji kamery. Te renderingi przechodzą następnie przez funkcję utraty wyniku destylacji. Proste podejście ze spadkiem gradientowym powoli poprawi Model 3D aż dopasuje się do sceny opisanej w tekście.

Po wyrenderowaniu modelu 3D za pomocą NeRF możemy użyć Algorytm Marching Cubes aby wydrukować siatkę 3D naszego modelu. Tę siatkę można następnie zaimportować do popularnych rendererów 3D lub oprogramowania do modelowania.

Ograniczenia

Chociaż wyniki DreamFusion są wystarczająco imponujące, ponieważ w nowy sposób wykorzystują istniejące modele przenikania tekstu do obrazu, naukowcy zauważyli kilka ograniczeń.

Zaobserwowano, że funkcja utraty SDS daje przesycone i nadmiernie wygładzone wyniki. Można to zaobserwować w nienaturalnej kolorystyce i braku precyzyjnych detali na wyjściach.

Algorytm DreamFusion jest również ograniczony rozdzielczością wyjścia modelu Imagen, która wynosi 64 x 64 piksele. Prowadzi to do tego, że w zsyntetyzowanych modelach brakuje drobniejszych szczegółów.

Na koniec naukowcy zauważyli, że synteza modeli 3D z danych 2D wiąże się z nieodłącznym wyzwaniem. Istnieje wiele możliwych modeli 3D, które możemy wygenerować z zestawu obrazów 2D, co sprawia, że optymalizacja jest dość trudna, a nawet niejednoznaczna.

Wnioski

Renderowanie 3D DreamFusion działa tak dobrze ze względu na zdolność modeli dyfuzji tekstu do obrazu do tworzenia dowolnego obiektu lub sceny. To imponujące, jak sieć neuronowa może zrozumieć scenę w przestrzeni 3D bez żadnych danych treningowych 3D. Polecam lekturę cały papier aby dowiedzieć się więcej o szczegółach technicznych algorytmu DreamFusion.

Mamy nadzieję, że ta technologia ulegnie poprawie, aby ostatecznie tworzyć fotorealistyczne modele 3D. Wyobraź sobie całe gry wideo lub symulacje wykorzystujące środowiska generowane przez sztuczną inteligencję. Może obniżyć barierę wejścia dla twórców gier wideo, aby tworzyć wciągające światy 3D!

Jak myślisz, jaką rolę odegrają modele text-to-3D w przyszłości?

Dodaj komentarz