Innholdsfortegnelse[Gjemme seg][Forestilling]

Et av hovedkriteriene for enhver type bedriftsaktivitet er effektiv bruk av informasjon. På et tidspunkt overskrider volumet av data som er opprettet kapasiteten til grunnleggende behandling.

Det er der maskinlæringsalgoritmer kommer inn i bildet. Men før noe av dette kan skje, må informasjonen studeres og tolkes. I et nøtteskall er det det uovervåket maskinlæring brukes til.

I denne artikkelen vil vi undersøke dyptgående uovervåket maskinlæring, inkludert algoritmer, brukstilfeller og mye mer.

Hva er uovervåket maskinlæring?

Uovervåket maskinlæringsalgoritmer identifiserer mønstre i et datasett som ikke har en kjent eller merket konsekvens. Overvåket maskinlæringsalgoritmer ha en merket utgang.

Å kjenne denne forskjellen hjelper deg å forstå hvorfor uovervåkede maskinlæringsmetoder ikke kan brukes til å løse regresjons- eller klassifiseringsproblemer, siden du ikke vet hva verdien/svaret for utdataene kan være. Du kan ikke trene en algoritme normalt hvis du ikke vet verdien/svaret.

Dessuten kan uovervåket læring brukes til å identifisere dataenes grunnleggende struktur. Disse algoritmene oppdager skjulte mønstre eller datagrupperinger uten behov for menneskelig interaksjon.

Dens kapasitet til å oppdage likheter og kontraster i informasjon gjør den til et godt valg for utforskende dataanalyse, krysssalgsteknikker, forbrukersegmentering og bildeidentifikasjon.

Tenk på følgende scenario: du er i en dagligvarebutikk og ser en uidentifisert frukt du aldri har sett før. Du kan lett skille den ukjente frukten forskjellig fra andre frukter rundt basert på dine observasjoner av dens form, størrelse eller farge.

Algoritmer for maskinlæring uten tilsyn

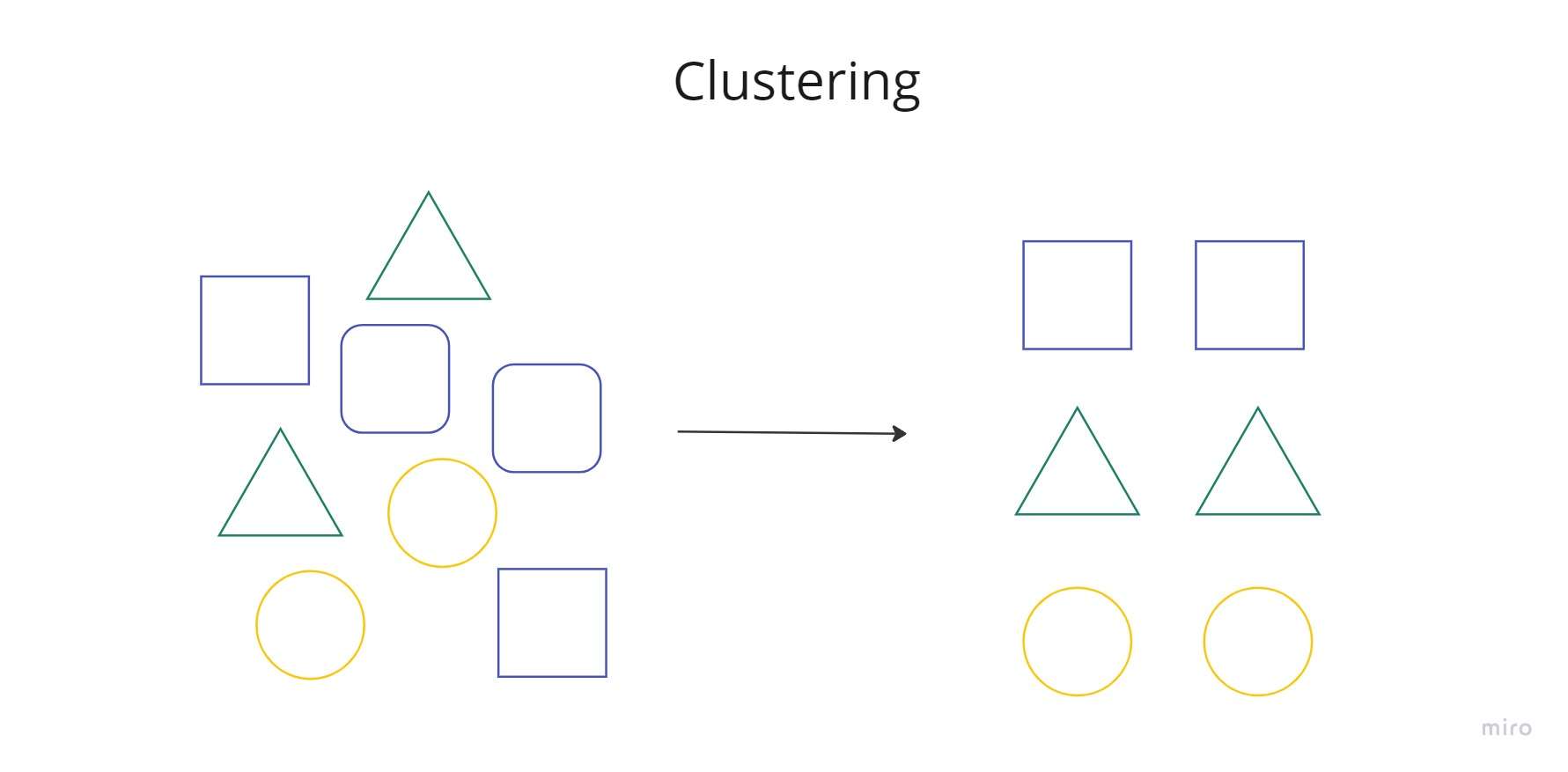

Gruppering

Clustering er uten tvil den mest brukte tilnærmingen til uovervåket læring. Denne tilnærmingen plasserer relaterte dataelementer i tilfeldig genererte klynger.

I seg selv oppdager en ML-modell alle mønstre, likheter og/eller forskjeller i en ukategorisert datastruktur. En modell vil kunne oppdage alle naturlige grupperinger eller klasser i data.

Typer

Det finnes flere former for clustering som kan brukes. La oss se på de viktigste først.

- Eksklusiv klynging, noen ganger kjent som "hard" klynging, er en type gruppering der et enkelt stykke data tilhører bare en klynge.

- Overlappende clustering, ofte kjent som "myk" clustering, gjør at dataobjekter kan tilhøre mer enn én klynge i varierende grad. Videre kan probabilistisk klynging brukes til å takle "myke" klyngings- eller tetthetsestimeringsproblemer, samt for å vurdere sannsynligheten eller sannsynligheten for datapunkter som tilhører visse klynger.

- Å lage et hierarki av grupperte dataelementer er målet med hierarkisk klynging, som navnet indikerer. Dataelementer dekonstrueres eller kombineres basert på hierarkiet for å generere klynger.

Bruk saker:

- Anomalideteksjon:

Enhver type avvik i data kan oppdages ved hjelp av klynging. Bedrifter innen transport og logistikk kan for eksempel bruke anomalideteksjon for å oppdage logistiske hindringer eller avsløre skadede mekaniske deler (prediktivt vedlikehold).

Finansinstitusjoner kan bruke teknologien til å oppdage uredelige transaksjoner og svare raskt, noe som potensielt kan spare mye penger. Lær mer om å oppdage avvik og svindel ved å se videoen vår.

- Segmentering av kunder og markeder:

Klyngealgoritmer kan hjelpe til med å gruppere personer som har lignende egenskaper og skape forbrukerpersonas for mer effektiv markedsføring og målrettede initiativer.

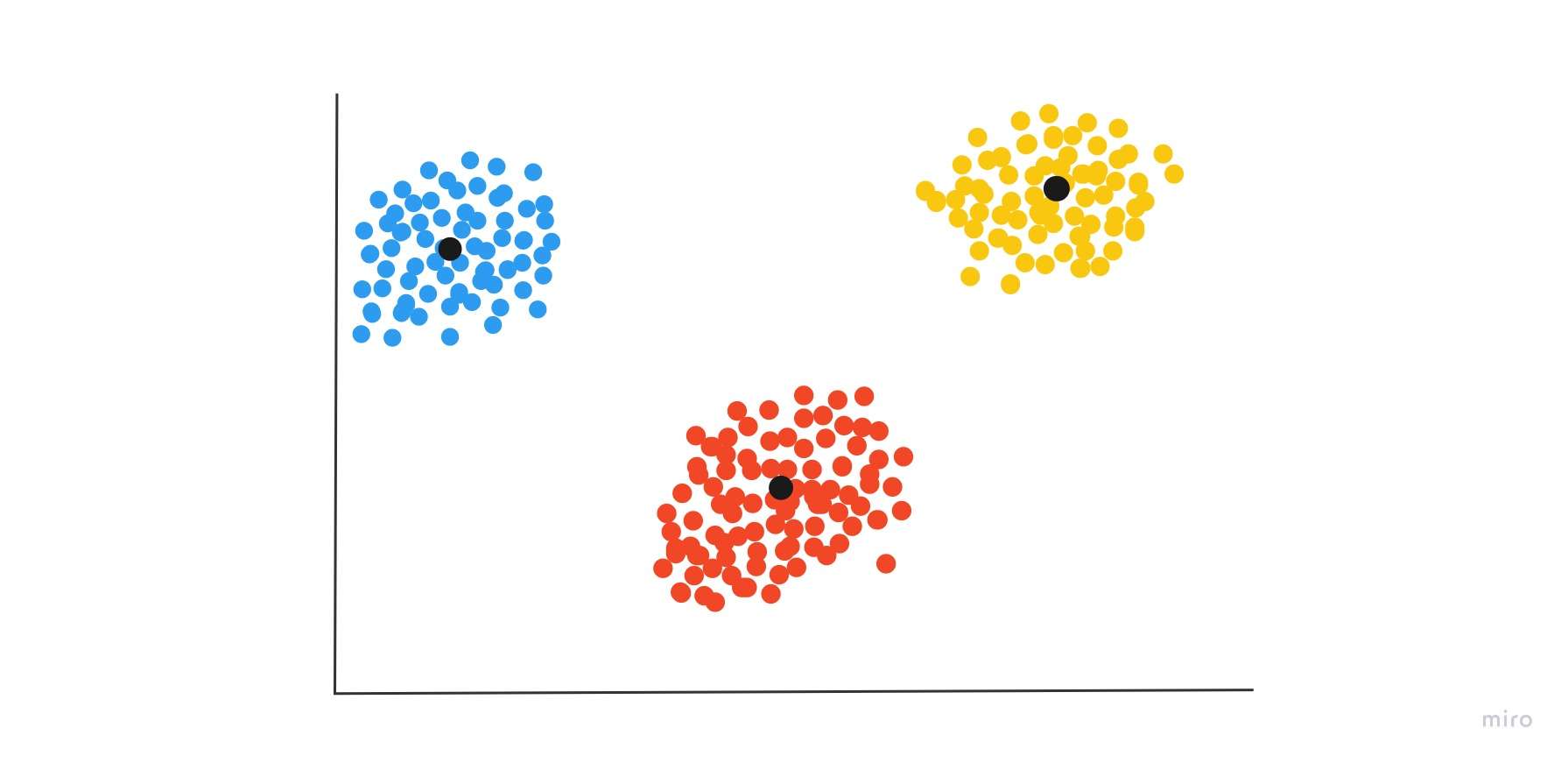

K-betyr

K-means er en klyngemetode som også er kjent som partisjonering eller segmentering. Den deler datapunktene inn i et forhåndsbestemt antall klynger kjent som K.

I K-means-metoden er K inngangen siden du forteller datamaskinen hvor mange klynger du vil identifisere i dataene dine. Hvert dataelement blir deretter tildelt det nærmeste klyngesenteret, kjent som en tyngdepunkt (svarte prikker i bildet).

Sistnevnte fungerer som datalagringsplasser. Klyngeteknikken kan gjøres flere ganger til klyngene er veldefinerte.

Fuzzy K-betyr

Fuzzy K-means er en utvidelse av K-means-teknikken, som brukes til å gjøre overlappende clustering. I motsetning til K-middel-teknikken, indikerer uklare K-midler at datapunkter kan tilhøre mange klynger med ulik grad av nærhet til hver.

Avstanden mellom datapunkter og klyngens tyngdepunkt brukes til å beregne nærhet. Som et resultat kan det være anledninger når ulike klynger overlapper hverandre.

Gaussiske blandingsmodeller

Gaussiske blandingsmodeller (GMM) er en metode som brukes i probabilistisk klynging. Fordi gjennomsnittet og variansen er ukjent, antar modellene at det er et fast antall Gauss-fordelinger, som hver representerer en distinkt klynge.

For å bestemme hvilken klynge et spesifikt datapunkt tilhører, brukes metoden i hovedsak.

Hierarkisk klynging

Den hierarkiske klyngestrategien kan begynne med hvert datapunkt tilordnet en annen klynge. De to klyngene som er nærmest hverandre blandes deretter til en enkelt klynge. Iterativ sammenslåing fortsetter til bare én klynge gjenstår på toppen.

Denne metoden er kjent som bottom-up eller agglomerativ. Hvis du begynner med alle dataelementer knyttet til samme klynge og deretter utfører splitting til hvert dataelement er tilordnet som en separat klynge, er metoden kjent som top-down eller divisive hierarkisk klynge.

Apriori algoritme

Markedskurvanalyse populariserte apriori-algoritmer, noe som resulterte i ulike anbefalingsmotorer for musikkplattformer og nettbutikker.

De brukes i transaksjonsdatasett for å finne hyppige varesett, eller grupperinger av varer, for å forutsi sannsynligheten for å konsumere ett produkt basert på forbruket til et annet.

For eksempel, hvis jeg begynner å spille OneRepublics radio på Spotify med «Counting Stars», vil en av de andre sangene på denne kanalen helt sikkert være en Imagine Dragon-sang, for eksempel «Bad Liar».

Dette er basert på mine tidligere lyttevaner samt andres lyttemønstre. Apriori-metoder teller varesett ved å bruke et hash-tre, og krysser datasettets bredde først.

Dimensjonsreduksjon

Dimensjonsreduksjon er en slags uovervåket læring som bruker en samling strategier for å minimere antall funksjoner – eller dimensjoner – i et datasett. Tillat oss å avklare.

Det kan være fristende å inkludere så mye data som mulig mens du lager din datasett for maskinlæring. Ikke misforstå oss: denne strategien fungerer bra siden mer data vanligvis gir mer nøyaktige funn.

Anta at data er lagret i N-dimensjonalt rom, der hver funksjon representerer en annen dimensjon. Det kan være hundrevis av dimensjoner hvis det er mye data.

Vurder Excel-regneark, med kolonner som representerer egenskaper og rader som representerer dataelementer. Når det er for mange dimensjoner, kan ML-algoritmer fungere dårlig og datavisualisering kan bli vanskelig.

Så det gjør det logisk å begrense egenskapene eller dimensjonene, og formidle akkurat relevant informasjon. Dimensjonsreduksjon er nettopp det. Det gir mulighet for en håndterbar mengde datainndata uten å kompromittere datasettets integritet.

Hovedkomponentanalyse (PCA)

Den viktigste komponentanalysen er en tilnærming til dimensjonalitetsreduksjon. Den brukes til å minimere antall funksjoner i enorme datasett, noe som resulterer i større dataenkelhet uten å ofre nøyaktigheten.

Datasettkomprimering oppnås ved hjelp av en metode kjent som funksjonsekstraksjon. Det indikerer at elementer fra det originale settet blandes til et nytt, mindre. Disse nye egenskapene er kjent som primære komponenter.

Selvfølgelig er det flere algoritmer du kan bruke i dine læringsapplikasjoner uten tilsyn. De som er oppført ovenfor er bare de mest utbredte, og det er derfor de blir diskutert mer detaljert.

Anvendelse av uovervåket læring

- Uovervåket læringsmetoder brukes til visuell persepsjonsoppgaver som gjenkjenning av objekter.

- Uovervåket maskinlæring gir kritiske aspekter til medisinske bildesystemer, som bildeidentifikasjon, klassifisering og segmentering, som brukes i radiologi og patologi for å diagnostisere pasienter raskt og pålitelig.

- Uovervåket læring kan bidra til å identifisere datatrender som kan brukes til å lage mer effektive krysssalgsstrategier ved å bruke tidligere data om forbrukeratferd. Under betalingsprosessen brukes dette av nettbaserte virksomheter for å foreslå de riktige tilleggene til klienter.

- Uovervåkede læringsmetoder kan sile gjennom enorme mengder data for å finne uteliggere. Disse unormalitetene kan øke varselet om utstyr som ikke fungerer, menneskelige feil eller sikkerhetsbrudd.

Problemer med uovervåket læring

Uovervåket læring er tiltalende på en rekke måter, fra potensialet til å finne viktig innsikt i data for å unngå kostbar datamerking operasjoner. Det er imidlertid flere ulemper ved å bruke denne strategien til å trene maskinlæringsmodeller som du bør være klar over. Her er noen eksempler.

- Siden inputdata mangler etiketter som fungerer som responsnøkler, kan resultatene til uovervåkede læringsmodeller være mindre presise.

- Uovervåket læring fungerer ofte med massive datasett, noe som kan øke beregningsmessig kompleksitet.

- Tilnærmingen krever bekreftelse av resultater fra mennesker, enten interne eller eksterne spesialister i undersøkelsesemnet.

- Algoritmer må undersøke og beregne alle mulige scenarioer gjennom treningsfasen, som tar litt tid.

konklusjonen

Effektiv datautnyttelse er nøkkelen til å etablere et konkurransefortrinn i et bestemt marked.

Du kan segmentere dataene ved å bruke uovervåkede maskinlæringsalgoritmer for å undersøke preferansene til målgruppen din eller for å finne ut hvordan en bestemt infeksjon reagerer på en bestemt behandling.

Det er flere praktiske bruksområder, og data forskere, ingeniører og arkitekter kan hjelpe deg med å definere dine mål og utvikle unike ML-løsninger for din bedrift.

Legg igjen en kommentar