Innholdsfortegnelse[Gjemme seg][Forestilling]

Vektordatabaser representerer et betydelig skifte i hvordan vi administrerer og tolker data, spesielt innen kunstig intelligens og maskinlæring.

Den grunnleggende funksjonen til disse databasene er å effektivt håndtere høydimensjonale vektorer, som er råmaterialet til maskinlæringsmodeller og inkluderer konvertering av tekst, bilde eller lydinndata til numeriske representasjoner i flerdimensjonalt rom.

For applikasjoner som anbefalingssystemer, objektgjenkjenning, bildehenting og svindeldeteksjon er denne transformasjonen mer enn bare lagring; det er en døråpning til kraftige funksjoner i likhetssøk og nærmeste nabospørringer.

Mer dypere er kraften til vektordatabaser i deres kapasitet til å oversette store mengder ustrukturerte, kompliserte data til vektorer som fanger konteksten og betydningen av det originale innholdet.

De forbedrede søkefunksjonene som er muliggjort ved å bygge inn modeller i denne kodingen inkluderer muligheten til å spørre rundt vektorer for å finne relaterte bilder eller setninger.

Vektordatabaser er unike ved at de er bygget på avanserte indekseringsteknikker som Inverted File Index (IVF) og Hierarchical Navigable Small World (HNSW), som forbedrer deres hastighet og effektivitet samtidig som de lokaliserer nærmeste naboer i N-dimensjonale rom.

Det er en klar forskjell mellom vektor- og klassiske databaser. Konvensjonelle databaser er gode til å organisere data i organiserte sett som er CRUD-optimalisert og overholder angitte skjemaer.

Men når man arbeider med den dynamiske og kompliserte naturen til høydimensjonale data, begynner denne stivheten å bli en hindring.

I motsetning til dette tilbyr vektordatabaser en grad av fleksibilitet og effektivitet som tradisjonelle ekvivalenter ikke kan like, spesielt for applikasjoner som er sterkt avhengige av maskinlæring og kunstig intelligens. De er ikke bare skalerbare og dyktige i likhetssøk.

Vektordatabaser er spesielt nyttige for generative AI-applikasjoner. For å garantere at det opprettede materialet beholder kontekstuell integritet, er disse applikasjonene – som inkluderer naturlig språkbehandling og bildegenerering – avhengig av rask gjenfinning og sammenligning av innebygginger.

Så i dette stykket vil vi se på de beste vektordatabasene for ditt neste prosjekt.

1. Milvus

Milvus er en banebrytende åpen kildekode-vektordatabase designet primært for AI-applikasjoner, inkludert innebygde likhetssøk og kraftige MLOps.

Det skiller seg fra konvensjonelle relasjonsdatabaser, som stort sett håndterer strukturerte data, på grunn av denne kapasiteten, som gjør den i stand til å indeksere vektorer på en enestående billionskala.

Milvus sin dedikasjon til skalerbarhet og høy tilgjengelighet demonstreres av måten den har utviklet seg fra sin første versjon til den fullt distribuerte, skybaserte Milvus 2.0.

Spesifikt viser Milvus 2.0 en fullstendig skybasert design som tar sikte på en forbløffende 99.9% tilgjengelighet mens den skaleres utover hundrevis av noder.

For de som leter etter en pålitelig vektordatabaseløsning, anbefales denne utgaven på det sterkeste siden den ikke bare legger til sofistikerte funksjoner som en multisky-tilkobling og et administrativt panel, men den forbedrer også datakonsistensnivåene for fleksibel applikasjonsutvikling.

En bemerkelsesverdig fordel med Milvus er dens fellesskapsdrevne tilnærming, som gir flerspråklig støtte og en omfattende verktøykjede skreddersydd etter kravene til utviklere.

I IT-sektoren gjør dens skyskalerbarhet og pålitelighet, sammen med dens høyytelses vektorsøkefunksjoner på store datasett, det til et populært alternativ.

I tillegg forbedrer den effektiviteten av operasjonene ved å bruke en hybrid søkefunksjon som blander vektorlikhetssøk med skalarfiltrering.

Milvus har et administrativt panel med en klar brukergrensesnitt, et komplett sett med APIer og en skalerbar og justerbar arkitektur.

Kommunikasjon med eksterne applikasjoner forenkles av tilgangslaget, mens lastbalansering og datahåndtering koordineres av koordinatortjenesten, som fungerer som sentral kommando.

Permanensen til databasen støttes av objektlagringslaget, mens arbeidernoder utfører aktiviteter for å sikre skalerbarhet.

Priser

Det er gratis å bruke for alle.

2. FAISS

Facebooks AI Research-team utviklet et banebrytende bibliotek kalt Facebook AI Similarity Search som er designet for å gjøre tett vektorklynger og likhetssøk mer effektivt.

Opprettelsen ble drevet av kravet om å forbedre Facebook AIs funksjoner for likhetssøk ved å bruke banebrytende grunnleggende metoder.

Sammenlignet med CPU-baserte implementeringer, kan FAISS sin toppmoderne GPU-implementering øke søketiden med fem til ti ganger, noe som gjør den til et uvurderlig verktøy for en rekke applikasjoner, inkludert anbefalingssystemer og identifisering av lignende betydninger i betydelige mengder. ustrukturerte datasett som tekst, lyd og video.

FAISS kan håndtere et bredt spekter av likhetsmålinger, for eksempel cosinuslikhet, indre produkt og den ofte brukte L2-metrikken (euklidisk avstand).

Disse målingene gjør det enklere å gjøre nøyaktige og fleksible likhetssøk på tvers av ulike datatyper. Funksjoner som batchbehandling, presisjonshastighets-avveininger og støtte for både presise og omtrentlige søk øker fleksibiliteten ytterligere.

I tillegg tilbyr FAISS en skalerbar metode for å håndtere massive datasett ved å la indekser lagres på disk.

Den inverterte filen, produktkvantiseringen (PQ) og forbedret PQ er bare noen av de innovative teknikkene som utgjør FAISSs forskningsgrunnlag og øker effektiviteten når det gjelder indeksering og søking av høydimensjonale vektorfelt.

Disse strategiene forsterkes av banebrytende tilnærminger som GPU-akselererte k-seleksjonsalgoritmer og forhåndsfiltrering av PQ-avstander, som garanterer FAISS sin kapasitet til å produsere raske og presise søkeresultater selv i milliardskala datasett.

Priser

Det er gratis å bruke for alle.

3. konglen

Pinecone er ledende innen vektordatabaser, og tilbyr en skybasert, administrert tjeneste som er spesielt bygget for å forbedre ytelsen til kraftige AI-applikasjoner.

Den er spesielt designet for å håndtere vektorinnbygginger, som er avgjørende for generativ AI, semantisk søk og applikasjoner som bruker massive språkmodeller.

AI kan nå forstå semantisk informasjon takket være disse innebyggingene, som effektivt fungerer som et langtidsminne for kompliserte oppgaver.

Pinecone er unik ved at den sømløst integrerer egenskapene til tradisjonelle databaser med den forbedrede ytelsen til vektorindekser, noe som muliggjør effektiv og storskala lagring og spørring av innebygginger.

Dette gjør det til det perfekte alternativet i situasjoner der kompleksiteten og volumet av data som er involvert gjør standard skalarbaserte databaser utilstrekkelige.

Pinecone tilbyr utviklere en problemfri løsning på grunn av sin administrerte tjenestetilnærming, som effektiviserer integrasjon og sanntidsdatainntaksprosedyrer.

Tallrike dataoperasjoner støttes av den, inkludert henting, oppdatering, sletting, spørring og oppheving av data.

Pinecone garanterer videre at spørringer som representerer sanntidsmodifikasjoner som opphevinger og slettinger gir korrekte svar med lav latens for indekser med milliarder av vektorer.

I dynamiske situasjoner er denne funksjonen avgjørende for å bevare relevansen og friskheten til søkeresultatene.

I tillegg øker Pinecones partnerskap med Airbyte via Pinecone-tilkoblingen dens allsidighet og fleksibilitet, noe som muliggjør jevn dataintegrasjon fra en rekke kilder.

Gjennom dette forholdet kan kostnader og effektivitet optimaliseres ved å sikre at kun nyinnhentet informasjon håndteres gjennom inkrementell datasynkronisering.

Koblingens design legger vekt på enkelhet, trenger bare et minimum av oppsettsparametere, og den kan utvides, noe som gir mulighet for fremtidige forbedringer.

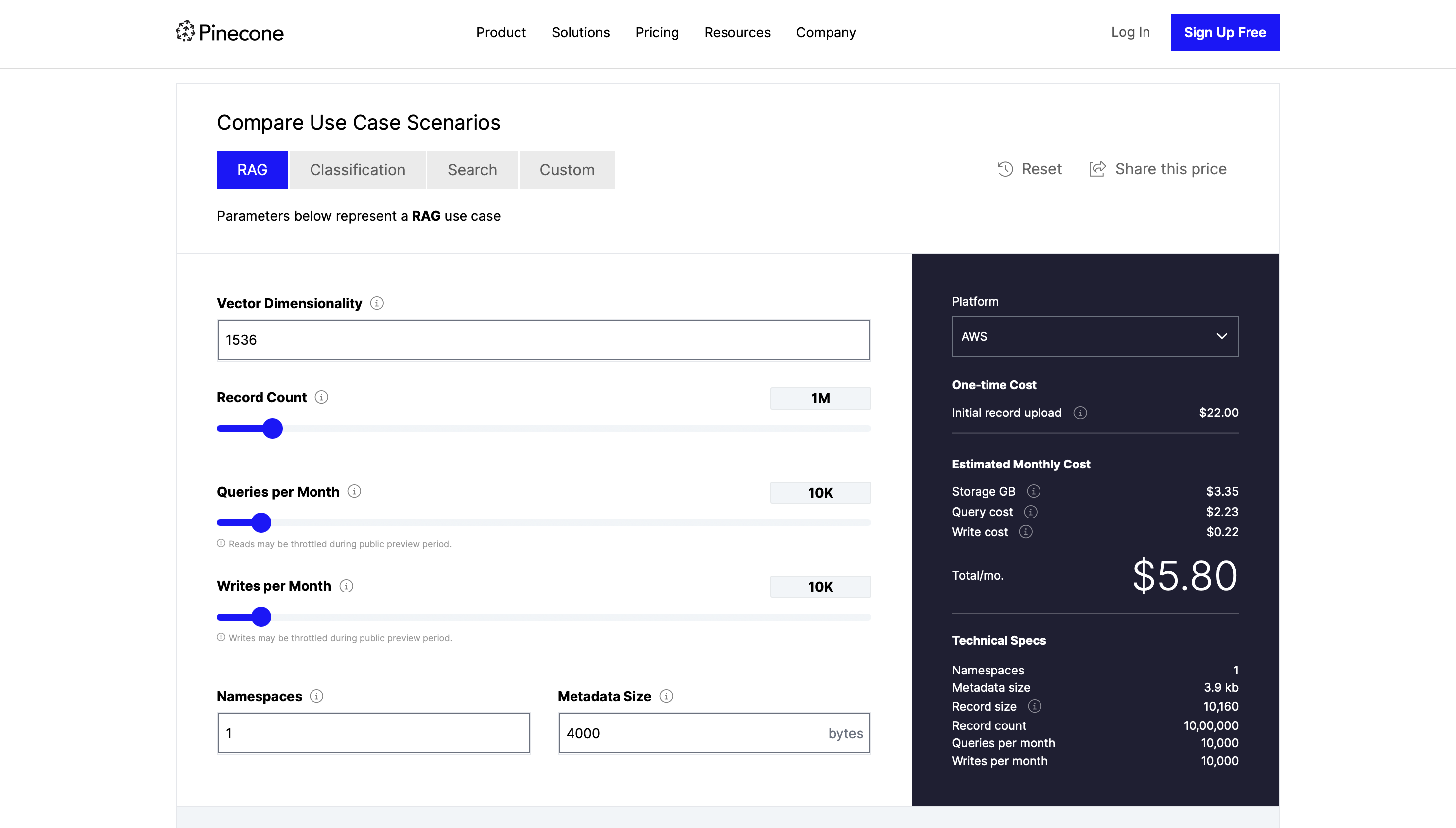

Priser

Premium-prisen starter fra $5.80/måned for RAG-brukssaken.

4. Vev

Weaviate er en innovativ vektordatabase som er tilgjengelig som åpen kildekode-programvare som forvandler måten vi får tilgang til og bruker data på.

Weaviate benytter seg av vektorsøkefunksjoner, som muliggjør sofistikerte, kontekstbevisste søk på tvers av store, kompliserte datasett, i motsetning til typiske databaser som er avhengige av skalarverdier og forhåndsdefinerte spørringer.

Med denne metoden kan du finne innhold basert på hvor likt det er annet innhold, noe som forbedrer intuitiviteten til søk og relevansen til resultatene.

Dens jevne integrasjon med maskinlæringsmodeller er en av dens primære egenskaper; dette lar den fungere som mer enn bare en datalagringsløsning; det lar også data forstås og analyseres ved hjelp av kunstig intelligens.

Weaviates arkitektur inkorporerer denne integrasjonen grundig, noe som gjør det mulig å analysere komplekse data uten bruk av tilleggsverktøy.

Dens støtte for grafdatamodeller gir også et annet syn på data som koblede enheter, og avslører mønstre og innsikt som kan gå glipp av i konvensjonelle databasearkitekturer.

På grunn av Weaviates modulære arkitektur kan kundene legge til funksjoner som datavektorisering og opprettelse av backup etter behov.

Den grunnleggende versjonen fungerer som en vektordataspesialistdatabase, og den kan utvides med andre moduler for å møte ulike behov.

Skalerbarheten er ytterligere forbedret av dens modulære design, som garanterer at hastigheten ikke vil bli ofret som svar på økende datamengder og spørringskrav.

En allsidig og effektiv metode for å samhandle med de lagrede dataene er muliggjort av databasens støtte for både RESTful og GraphQL APIer.

Spesielt er GraphQL valgt på grunn av sin kapasitet til raskt å utføre intrikate, grafbaserte spørringer, slik at brukere kan få nøyaktig de dataene de ønsker uten å skaffe for store eller utilstrekkelige mengder data.

Weaviate er mer brukervennlig på tvers av en rekke klientbiblioteker og programmeringsspråk takket være sin fleksible API.

For de som ønsker å utforske Weaviate videre, er det en mengde dokumentasjon og veiledninger tilgjengelig, fra å sette opp og konfigurere instansen din til dypdykk i funksjonene som vektorsøk, maskinlæringsintegrasjon og skjemadesign.

Du kan få tilgang til den samme potente teknologien som gjør informasjon dynamisk og handlingsdyktig uansett om du bestemmer deg for å operere Weaviate lokalt, i en cloud computing miljø, eller gjennom Weaviate-administrerte skytjeneste

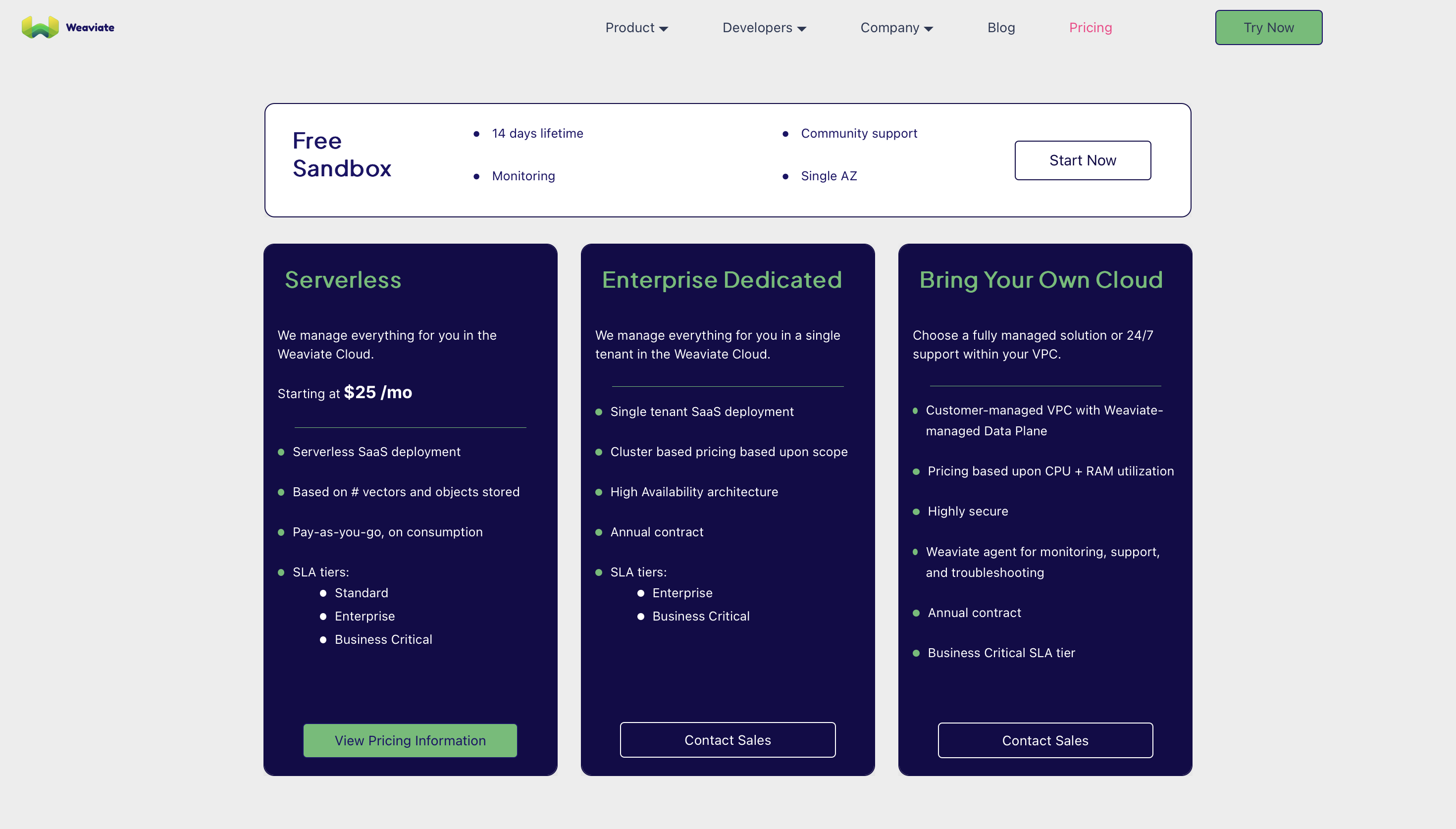

Priser

Premium-prisen på plattformen starter fra $25/måned for serverløs.

5. Chroma

Chroma er en banebrytende vektordatabase som har som mål å revolusjonere datainnhenting og lagring, spesielt for applikasjoner som involverer maskinlæring og kunstig intelligens.

Siden Chroma jobber med vektorer i stedet for skalare tall, i motsetning til standard databaser, er den veldig god til å administrere høydimensjonale, kompliserte data.

Dette er et stort fremskritt innen datainnhentingsteknologi siden det muliggjør mer sofistikerte søk basert på materialets semantiske likhet i stedet for nøyaktige søkeordtreff.

Et bemerkelsesverdig kjennetegn ved Chroma er dens evne til å jobbe med flere underliggende lagringsløsninger, som ClickHouse for skalerte innstillinger og DuckDB for frittstående installasjoner, noe som garanterer fleksibilitet og tilpasning til ulike brukstilfeller.

Chroma er laget med tanke på enkelhet, hastighet og analyse. Den er tilgjengelig for et bredt spekter av utviklere med SDK-er for Python og JavaScript/TypeScript.

I tillegg legger Chroma stor vekt på brukervennlighet, slik at utviklere raskt kan sette opp en permanent database støttet av DuckDB eller en database i minnet for testing.

Muligheten til å bygge samlingsobjekter som ligner tabeller i konvensjonelle databaser, hvor tekstdata kan settes inn og automatisk transformeres til innbygging ved bruk av modeller som all-MiniLM-L6-v2, øker denne allsidigheten ytterligere.

Tekst og innebygging kan integreres sømløst, noe som er avgjørende for applikasjoner som trenger å forstå datasemantikk.

Grunnlaget for Chromas vektorlikhetsmetode er de matematiske konseptene ortogonalitet og tetthet, som er avgjørende for å forstå representasjonen og sammenligningen av data i databaser.

Disse ideene lar Chroma utføre meningsfulle og effektive likhetssøk ved å ta hensyn til de semantiske koblingene mellom dataelementer.

Ressurser som veiledninger og retningslinjer er tilgjengelige for enkeltpersoner som ønsker å utforske Chroma videre. De inkluderer trinn-for-trinn-veiledning om hvordan du setter opp databasen, oppretter samlinger og kjører likhetssøk.

Priser

Du kan begynne å bruke det gratis.

6. Vespa

Vespa er en plattform som transformerer online håndtering av kunstig intelligens og store data.

Det grunnleggende formålet med Vespa er å muliggjøre beregninger med lav latens på tvers av store datasett, slik at du enkelt kan lagre, indeksere og analysere tekst, vektorer og strukturerte data.

Vespa utmerker seg ved sin evne til å gi raske svar i alle skalaer, uavhengig av arten av spørsmålene, valgene eller maskinlærte modellslutninger som håndteres.

Vespas fleksibilitet vises i den fullt funksjonelle søkemotoren og vektordatabasen, som muliggjør mange søk i et enkelt søk, alt fra vektor (ANN), leksikalsk og strukturert data.

Uavhengig av skala, kan du lage brukervennlige og responsive søkeapper med sanntids AI-funksjoner takket være denne integrasjonen av maskinlært modellslutning med dataene dine.

Vespa handler imidlertid om mer enn bare å søke; det handler også om å forstå og tilpasse møter.

Førsteklasses tilpasnings- og forslagsverktøy gir dynamiske, aktuelle anbefalinger tilpasset spesifikke brukere eller omstendigheter.

Vespa er en gamechanger for alle som ønsker å gå inn i samtale-AI-området også, siden den tilbyr infrastrukturen som trengs for å lagre og utforske tekst- og vektordata i sanntid, noe som muliggjør utvikling av mer avanserte og praktiske AI-agenter.

Med omfattende tokenisering og stemming, fulltekstsøk, nærmeste nabosøk og strukturerte dataspørringer støttes alle av plattformens omfattende spørringsmuligheter.

Den skiller seg ved at den effektivt kan håndtere kompliserte søk ved å kombinere flere søkedimensjoner.

Vespa er et beregningskraftverk for AI og maskinlæringsapplikasjoner fordi beregningsmotoren kan håndtere komplekse matematiske uttrykk over skalarer og tensorer.

I drift er Vespa laget for å være enkel å bruke og utvidbar.

Det strømlinjeformer repeterende prosesser, alt fra systemkonfigurasjon og applikasjonsutvikling til data- og nodeadministrasjon, noe som muliggjør sikker og uavbrutt produksjonsdrift.

Vespas arkitektur sørger for at den utvides med dataene dine, og opprettholder påliteligheten og ytelsen.

Priser

Du kan begynne å bruke det gratis.

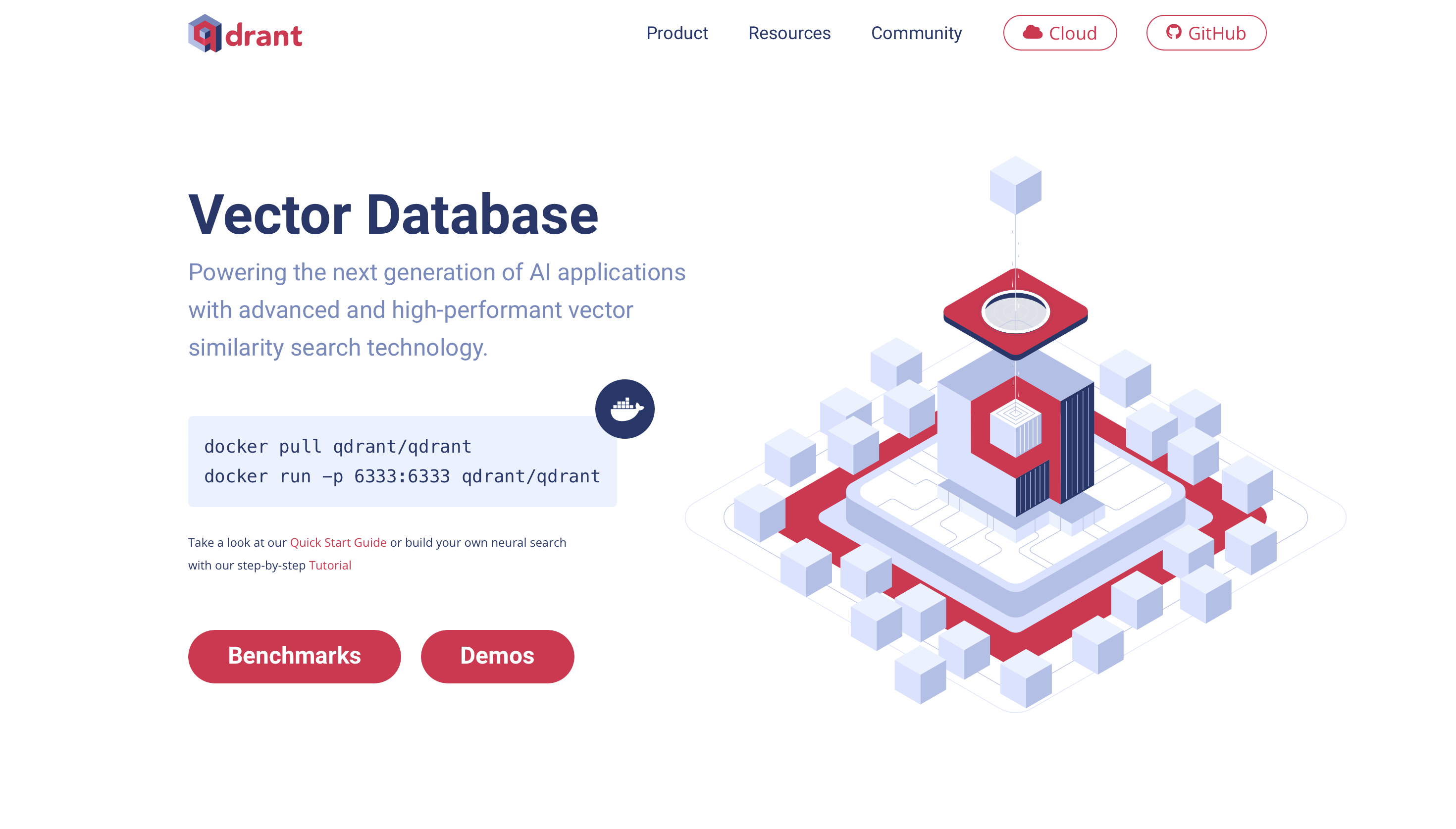

7. Quadrant

Qdrant er en fleksibel vektordatabaseplattform som gir et unikt sett med muligheter for å møte de økende kravene til AI og maskinlæringsapplikasjoner.

I utgangspunktet er Qdrant en søkemotor for vektorlikhet som gir en brukervennlig API for lagring, finne og vedlikehold av vektorer samt nyttelastdata.

Denne funksjonen er avgjørende for flere applikasjoner, for eksempel semantiske søk og anbefalingssystemer, som krever tolkning av kompliserte dataformater.

Plattformen er bygget med effektivitet og skalerbarhet i tankene, og er i stand til å håndtere massive datasett med milliarder av datapunkter.

Den sørger for flere avstandsberegninger, inkludert Cosine Similarity, Euclidian Distance og Dot Product, noe som gjør den tilpasningsbar på tvers av mange bruksscenarier.

Designet tilbyr kompleks filtrering, som streng, rekkevidde og geofiltre, for å møte ulike søkebehov.

Qdrant er tilgjengelig for utviklere på en rekke måter, inkludert et Docker-bilde for raske lokale oppsett, en Python-klient for de som er komfortable med språket, og en skytjeneste for et mer robust miljø i produksjonsgrad.

Qdrants tilpasningsevne tillater sømløs integrasjon med enhver teknologisk konfigurasjon eller prosessbehov.

Videre forenkler Qdrants brukervennlige grensesnitt vektordatabaseadministrasjon. Plattformen er ment å være enkel for brukere på alle ferdighetsnivåer, fra klyngeoppretting til generering av API-nøkler for sikker tilgang.

Muligheten for masseopplasting og asynkron API forbedrer effektiviteten, noe som gjør den til et veldig nyttig verktøy for utviklere som håndterer enorme mengder data.

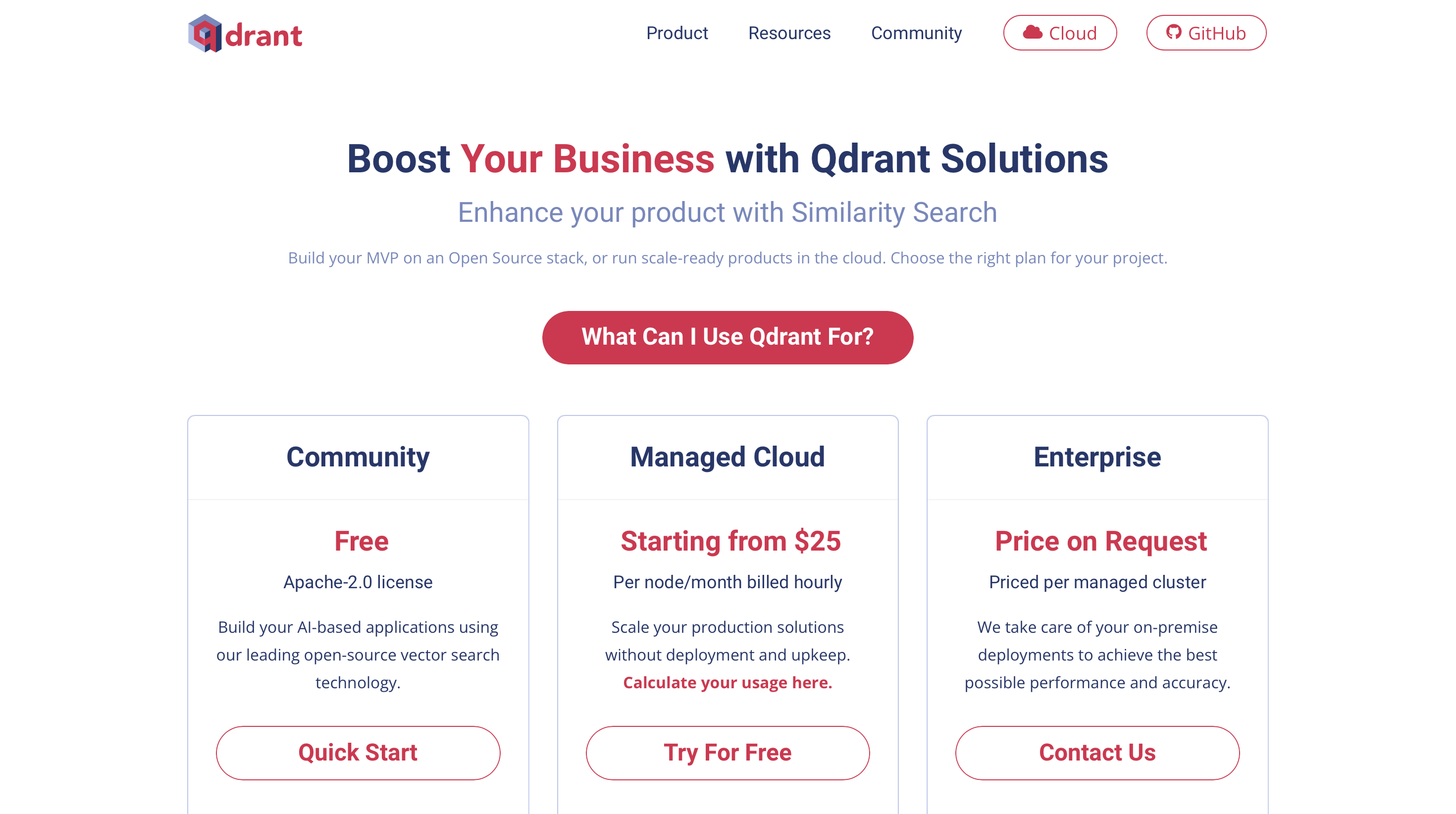

Priser

Du kan begynne å bruke det gratis og premiumpriser starter fra $25 per node/måned som faktureres hver time

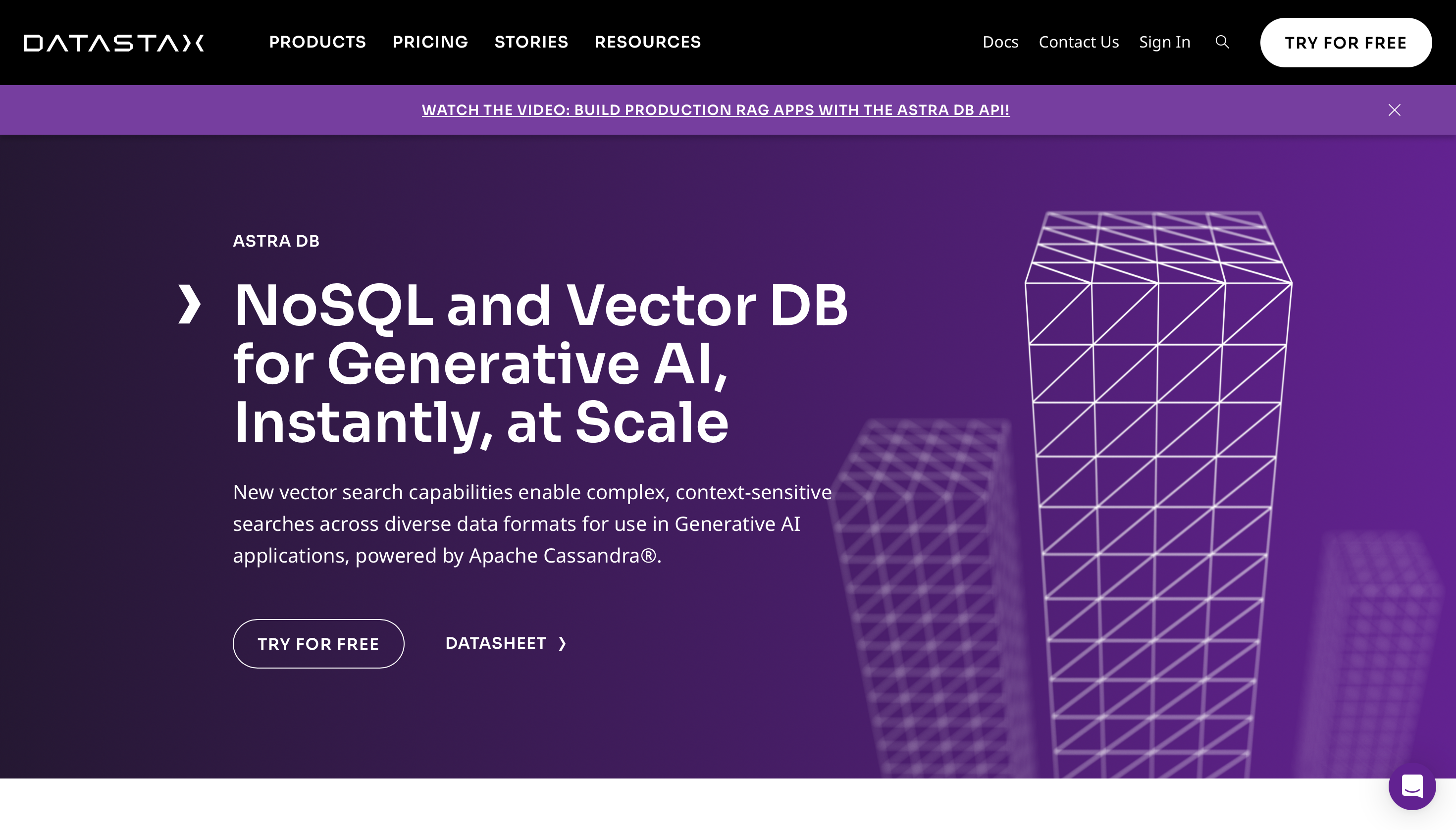

8. Astra

AstraDBs overlegne vektorsøkefunksjoner og serverløse arkitektur transformerer generative AI-applikasjoner.

AstraDB er et flott alternativ for å administrere intrikate, kontekstsensitive søk på tvers av en rekke datatyper siden det er bygget på det solide grunnlaget til Apache Cassandra og sømløst kombinerer skalerbarhet, stabilitet og ytelse.

Kapasiteten til AstraDB til å håndtere heterogene arbeidsbelastninger, inkludert strømming, ikke-vektor- og vektordata, samtidig som den bevarer ekstremt lav ventetid for samtidige spørringer og oppdateringsoperasjoner, er en av de mest bemerkelsesverdige fordelene.

Denne tilpasningsevnen er avgjørende for generative AI-applikasjoner, som krever strømming og sanntidsdatabehandling for å gi presise, kontekstbevisste AI-svar.

Den serverløse løsningen fra AstraDB gjør utviklingen enda enklere, og frigjør utviklere til å konsentrere seg om å lage innovative AI-applikasjoner i stedet for å administrere backend-infrastrukturen.

Fra hurtigstartveiledning til dybdeleksjoner om å lage chatboter og anbefalingssystemer, lar AstraDB utviklere raskt realisere AI-ideene sine gjennom pålitelige APIer og jevne grensesnitt med velkjente verktøy og plattformer.

Generative AI-systemer i bedriftsgrad må prioritere sikkerhet og samsvar, og AstraDB leverer på begge fronter.

Dype bedriftssikkerhetsfunksjoner og samsvarssertifiseringer leveres av den, og garanterer at AI-applikasjoner utviklet på AstraDB overholder de strengeste retningslinjene for personvern og databeskyttelse.

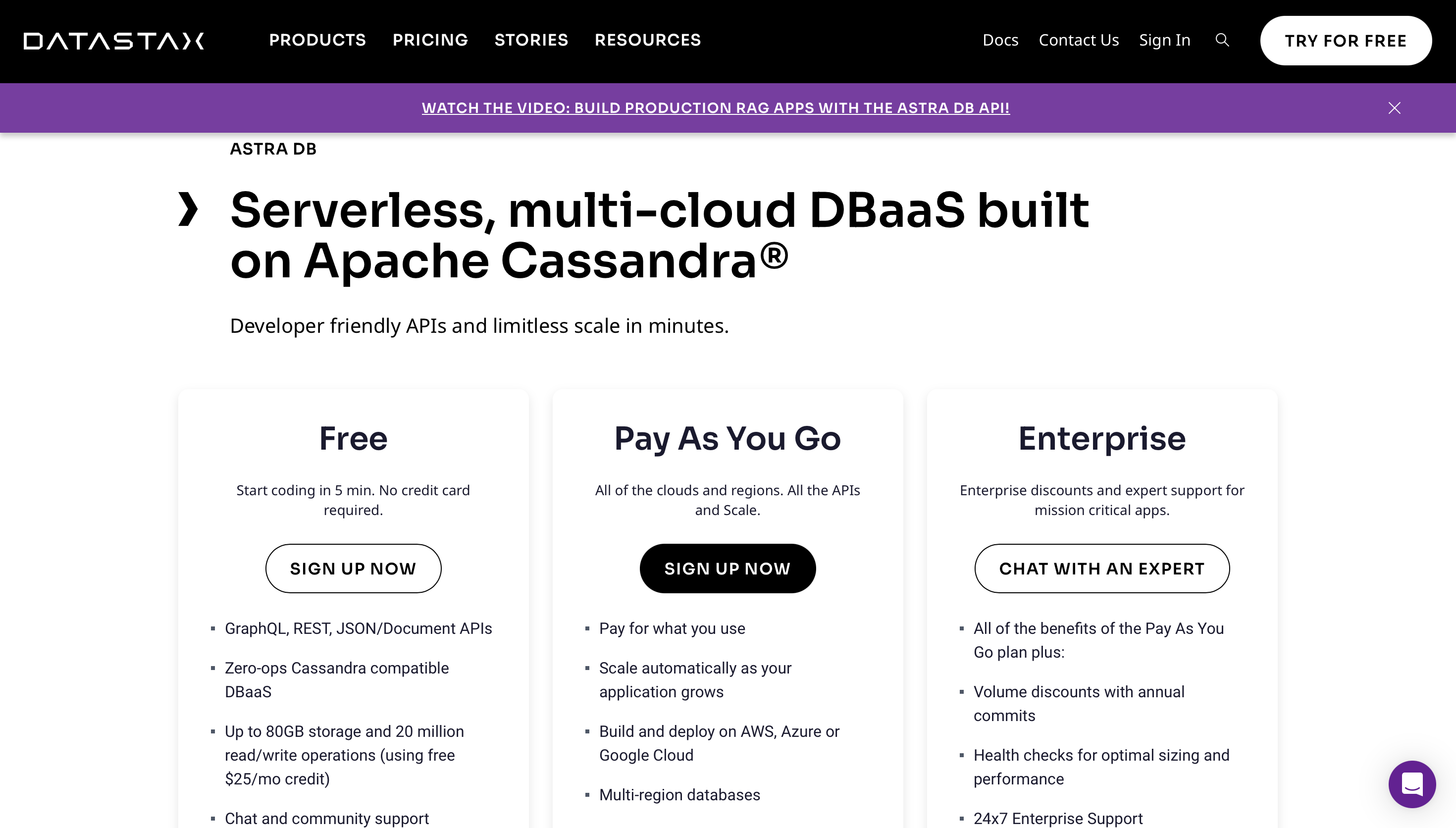

Priser

Du kan begynne å bruke den gratis, og den tilbyr en betal-som-du-gå-modell.

9. OpenSearch

OpenSearch fremstår som et attraktivt alternativ for de som utforsker vektordatabaser, spesielt for å utvikle tilpasningsdyktige, skalerbare og fremtidssikre AI-systemer.

OpenSearch er en altomfattende, åpen kildekode-vektordatabase som kombinerer kraften til analyse, sofistikert vektorsøk og konvensjonelt søk i ett sammenhengende system.

Ved å bruke innbyggingsmodeller for maskinlæring for å kode betydningen og konteksten til flere dataformer – dokumenter, bilder og lyd – til vektorer for likhetssøk, er denne integrasjonen spesielt nyttig for utviklere som ønsker å inkludere semantisk forståelse i søkeappene sine.

Selv om OpenSearch har mye å tilby, er det viktig å huske at sammenlignet med Elasticsearch har det vært mye færre kodeendringer, spesielt i kritiske moduler som skriptspråk og prosessorer for inntakspipeline.

Elasticsearch kan ha mer sofistikerte funksjoner på grunn av økt utviklingsinnsats, noe som fører til forskjeller i ytelse, funksjonssett og oppdateringer mellom de to.

OpenSearch kompenserer med et stort fellesskap som følger og en dedikasjon til ideer med åpen kildekode, noe som resulterer i en åpen og tilpasningsdyktig plattform.

Den støtter et bredt spekter av applikasjoner utover søk og analyse, som observerbarhet og sikkerhetsanalyse, noe som gjør det til et fleksibelt verktøy for dataintensive oppgaver.

Den fellesskapsdrevne strategien sikrer kontinuerlige forbedringer og integrasjoner for å holde plattformen oppdatert og unik.

Priser

Du kan begynne å bruke det gratis.

10. Azure AI-søk

Azure AI Search er en sterk plattform som forbedrer søkefunksjonene i generative AI-applikasjoner.

Den skiller seg ut fordi den støtter vektorsøk, en mekanisme for indeksering, lagring og henting av vektorinnbygginger i en søkeindeks.

Denne funksjonen hjelper deg med å oppdage sammenlignbare dokumenter i vektorrom, noe som resulterer i mer kontekstuelt relevante søkeresultater.

Azure AI Search utmerker seg ved sin støtte for hybridsituasjoner, der vektor- og nøkkelordsøk utføres samtidig, noe som resulterer i et enhetlig resultatsett som ofte overgår effektiviteten til hver teknikk som brukes alene.

Kombinasjonen av vektor- og ikke-vektormateriale i samme indeks gir en mer komplett og fleksibel søkeopplevelse.

Vektorsøkefunksjonen i Azure AI Search er allment tilgjengelig og gratis for alle Azure AI Search-nivåer.

Den er ekstremt fleksibel for en rekke brukstilfeller og utviklingspreferanser på grunn av støtten for flere utviklingsmiljøer, som tilbys via Azure-nettstedet, REST APIer, og SDK-er for blant annet Python, JavaScript og.NET.

Med sin dype integrasjon med Azure AI-økosystemet tilbyr Azure AI Search mer enn bare søk; det forbedrer også økosystemets potensial for generative AI-applikasjoner.

Azure OpenAI Studio for modellinnbygging og Azure AI Services for bildehenting er bare to eksempler på tjenestene som er inkludert i denne integrasjonen.

Azure AI Search er en fleksibel løsning for utviklere som ønsker å inkorporere sofistikerte søkefunksjoner i applikasjonene sine på grunn av dens omfattende støtte, som muliggjør et bredt spekter av applikasjoner, fra likhetssøk og multimodalt søk til hybrid søk og flerspråklig søk.

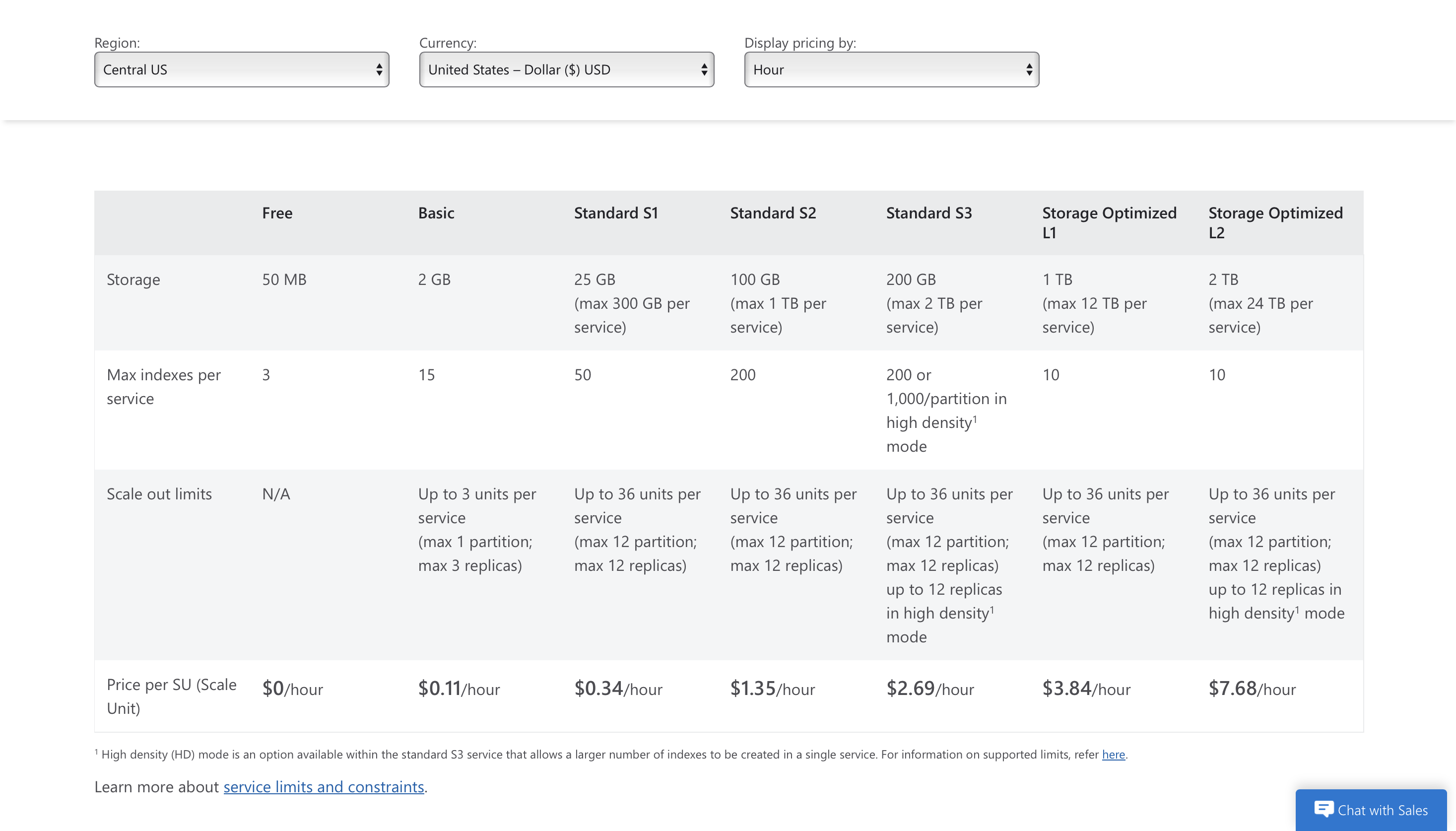

Priser

Du kan begynne å bruke det gratis og premiumpriser starter fra $0.11/time.

konklusjonen

Vektordatabaser transformerer dataadministrasjon i AI ved å administrere høydimensjonale vektorer, noe som gir mulighet for sterke likhetssøk og raske nærmeste nabospørringer i applikasjoner som anbefalingssystemer og svindeldeteksjon.

Med bruk av sofistikerte indekseringsalgoritmer konverterer disse databasene kompliserte ustrukturerte data til meningsfulle vektorer, samtidig som de gir hastigheten og fleksibiliteten som tradisjonelle databaser ikke gjør.

Bemerkelsesverdige plattformer inkluderer Pinecone, som skinner i generative AI-applikasjoner; FAISS, laget av Facebook AI for tett vektorklynger; og Milvus, som er kjent for sin skalerbarhet og skybaserte arkitektur.

Weaviate kombinerer maskinlæring med kontekstbevisst søk, mens Vespa og Chroma er bemerkelsesverdige for henholdsvis sine databehandlingsevner med lav latens og brukervennlighet.

Vektordatabaser er viktige verktøy for å utvikle AI og maskinlæringsteknologier siden plattformer som Qdrant, AstraDB, OpenSearch og Azure AI Search tilbyr en rekke tjenester fra serverløse arkitekturer til omfattende søke- og analysefunksjoner.

Legg igjen en kommentar