Innholdsfortegnelse[Gjemme seg][Forestilling]

Fremveksten av store språkmodeller har vist at algoritmer i dag er mer enn i stand til å etterligne menneskelig atferd på nettet.

A studere fra mars 2023 avslørte at deltakerne ikke kunne skille nøyaktig mellom menneskelig eller AI-tekst. Forskere bekymrer seg for at disse modellene kan brukes som et verktøy for ondsinnede handlinger.

Bedrifter som Microsoft har implementert rekkverk i sin AI for å forhindre at de blir brukt til feilinformasjon og andre typer opplegg. Imidlertid er mange av disse generative modellene åpen kildekode eller lekket, slik at alle kan bruke disse modellene for egen vinning.

Det blir stadig vanskeligere å bevise at enhver bruker du samhandler med på internett er en bot. Sosiale medieplattformer som f.eks Reddit og TikTok har allerede plassert fellesskapsregler som begrenser AI-innhold fra å sendes inn.

Etter hvert som livene våre blir mer avhengige av nettinteraksjoner, er det viktig for disse nettplattformene å etablere protokoller som kan bevise at en konto drives av et menneske.

I denne artikkelen vil vi forklare kravene til en slik protokoll og se på fremskritt utviklet av Web3-applikasjoner for å løse dette problemet med å bevise personlighet.

Hva er bevis på personlighet?

Bevis på personlighet eller PoP er en type protokoll som gjør det mulig for et nettverk å verifisere at et ekte menneske står bak en bestemt hendelse.

Desentraliserte systemer kan implementere PoP-mekanismer for å forhindre at ondsinnet aktivitet oppstår.

Hva skjer når a desentralisert nettverk mangler en måte å bekrefte menneskelighet på?

En av de vanskeligste Web3-utfordringene er å finne måter å forhindre en Sybil angrep. Denne typen trussel oppstår når en bruker finner en måte å bruke flere kontoer for å oppnå en urettferdig fordel i en plattform eller et nettverk.

For eksempel kan en angriper opprette flere falske kontoer på en plattform som Twitter eller Facebook. Etter å ha fått tilgang til et stort antall kontoer, kan angriperen bruke sin rekkevidde til å spre desinformasjon eller manipulere opinionen.

Eller i nettverk som lar hver bruker stemme, kan en angriper opprette flere falske identiteter for å manipulere resultatene.

Protokoller for bevis på personlighet kan forhindre Sybil-angrep ved å kreve at enkeltpersoner beviser at de er ekte mennesker før de lar dem delta i et nettverk.

Trusselen fra AI-modeller på gjeldende PoP-metoder

Du har kanskje allerede møtt en grunnleggende form for PoP med botdeteksjonstjenester som recaptcha. Nettsteder legger til disse testene for å sikre at personen som bruker tjenesten er et faktisk menneske. De krever ofte at du utfører en test som er enkel nok for et menneske å løse, men som er mye vanskeligere for datamaskiner.

For eksempel vil en vanlig recaptcha-test be brukeren om å velge alle rutene i et rutenett som har en bro, stoppskilt eller trapper.

Men ettersom AI-modeller blir mer avanserte når det gjelder bildegjenkjenning, blir denne typen tester sakte foreldet. Disse testene har også en kritisk begrensning: å løse testen beviser ikke at du er en unik bruker.

En riktig og sikker PoP-protokoll må ha en måte å pålitelig bevise at en profil tilhører en faktisk bruker og at brukeren ikke er i stand til å opprette flere kontoer for seg selv.

I den neste delen vil vi ta en dypere titt på hovedkravene for bevis på personlighetsmekanismer og hvordan disse egenskapene kan bidra til å sette opp globale desentraliserte identiteter.

Krav til bevis på personlighet

Her er noen nøkkelegenskaper for en ideell protokoll om personlighetsbevis.

- Protokollen må verdi privatliv. PoP-mekanismen må kunne holde brukeren anonym

- PoP-protokollen må også være motstandsdyktig mot svindel. Brukere skal ikke kunne opprette flere profiler på samme plattform.

- For at en PoP-protokoll skal oppnå global tilpasning, må selve nettverket være det skalerbar og desentralisert.

Før vi ser på noen lovende implementeringer av PoP-protokoller som tar sikte på å oppnå alle egenskapene ovenfor, la oss ta en titt på ulempene til noen av de mest populære metodene for bevis på personlighet.

Først, la oss ta en titt på Turing-testmetoden. Du har sikkert møtt en av disse testene før hvis du noen gang har måttet løse en captcha online.

Har du noen gang lagt merke til at disse testene blir mer kompliserte å løse? AI har nådd et punkt hvor utfordring-respons-tester som å forstå et bilde nå er en triviell oppgave. Ondsinnede aktører kan også bruke tjenester som er avhengige av et team av menneskelige brukere som får i oppdrag å løse disse testene i stor skala.

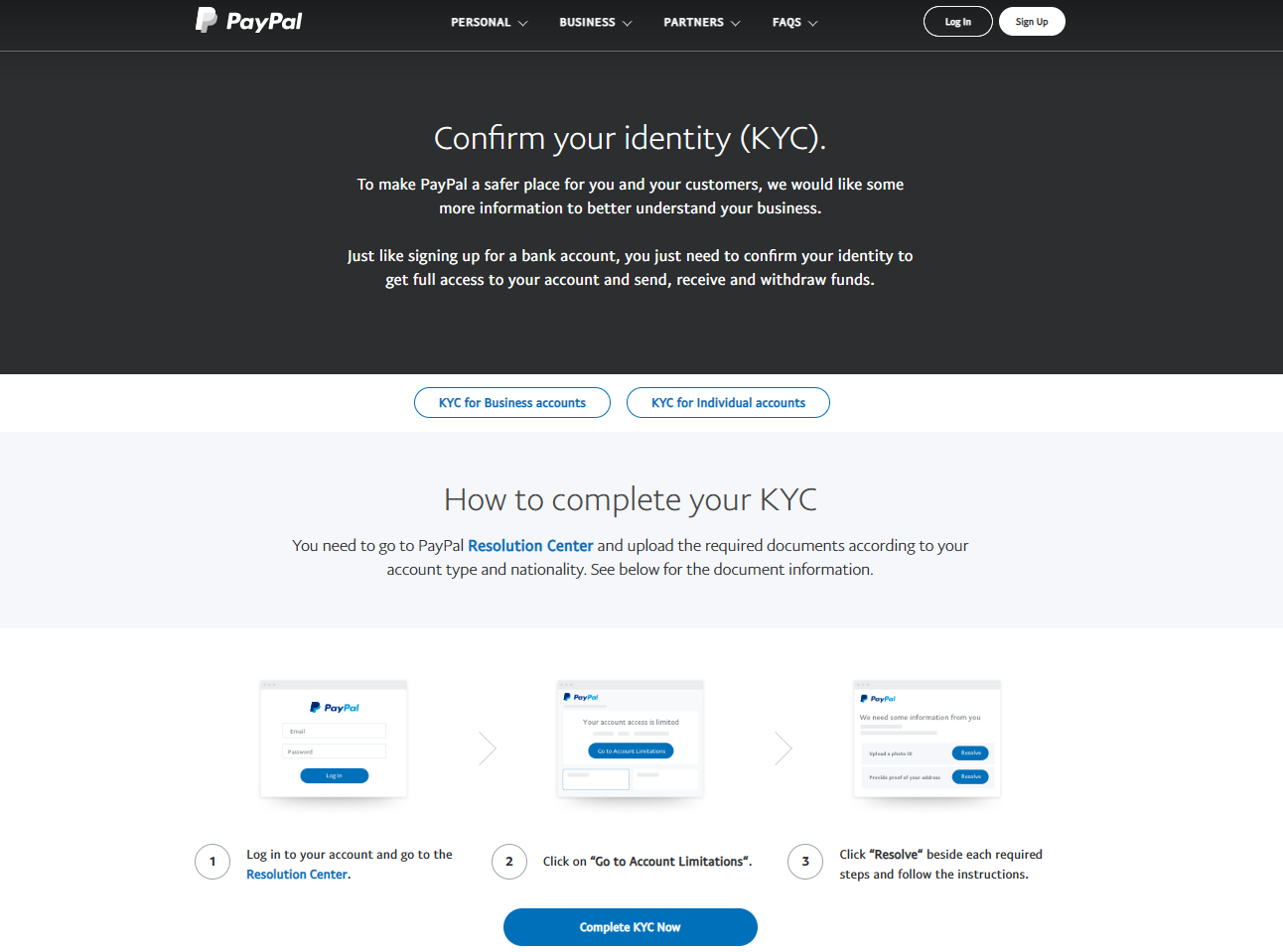

En annen vanlig PoP-tilnærming er identitetsverifisering. De fleste finansinstitusjoner følger en form for KYC (Know-Your-Customer) standard til administrere uredelig eller ondsinnet aktivitet på plattformen deres.

Anta at du vil opprette en ny konto i din lokale bank. Banken vil typisk kreve at du fremviser en form for offentlig ID. Sosiale medieplattformer som Facebook og Twitter bruker også en form for identitetsbekreftelse. Disse plattformene ber brukere om å bekrefte mobilnummeret eller e-posten for å forhindre at en enkelt bruker oppretter dusinvis av kontoer på plattformen deres.

Selv om denne metoden bidrar til å avskrekke ondsinnede aktører, er det fortsatt mange måter å omgå disse grensene på. For eksempel kan en ondsinnet aktør bruke teknikker som SMS-spoofing for å få tilgang til et stort antall kontoer.

I tillegg er KYC-identifikasjon vanskelig å implementere globalt siden ikke alle personer har en ID. Selv om en person hadde en ID, lagrer og kontrollerer en sentralisert instans fortsatt disse postene.

Mulige tilnærminger for bevis på personlighet

Nett av tillit

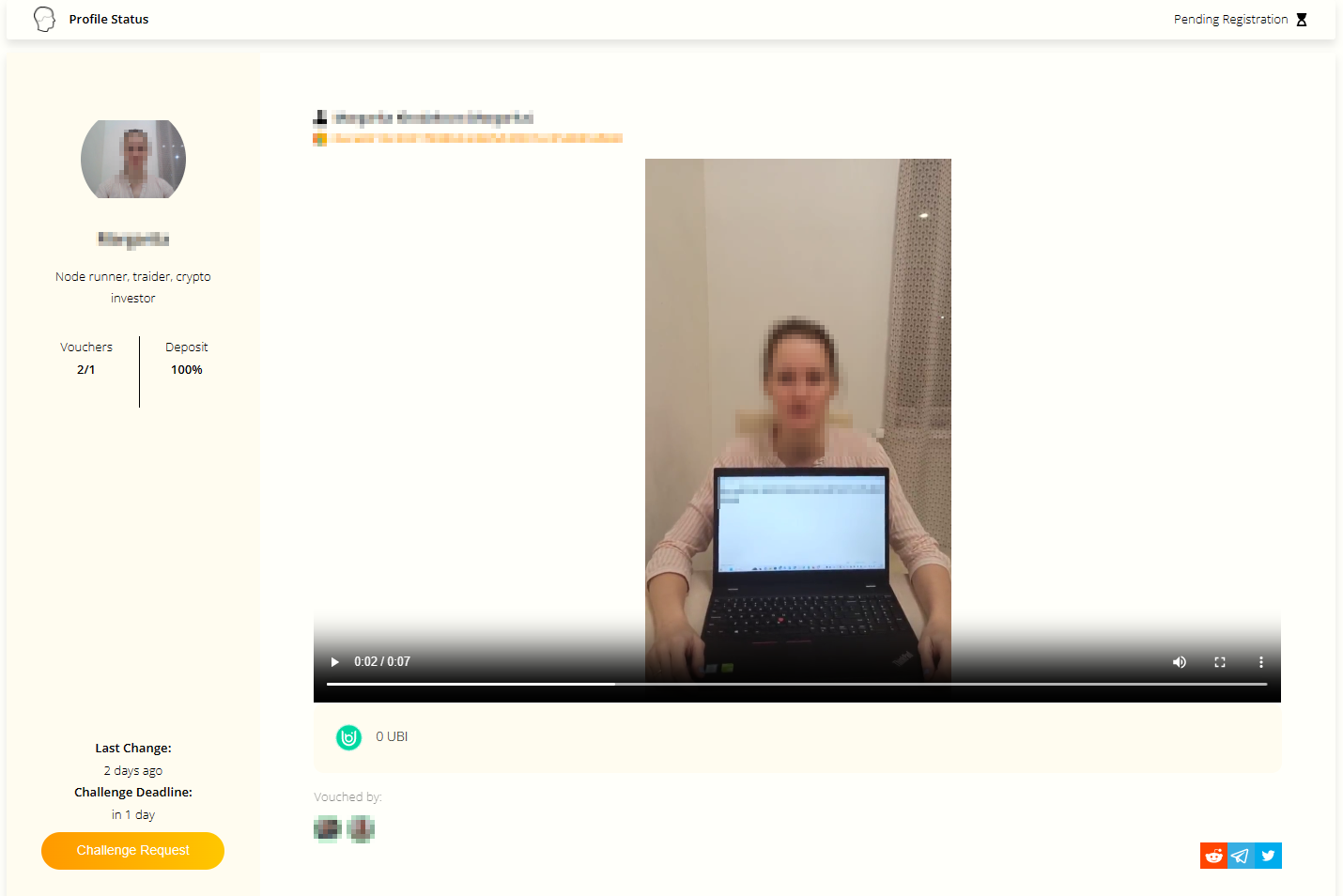

Nett av tillit tilnærming for bevis på personlighet er en desentralisert metode for identitetsverifisering.

I denne tilnærmingen oppretter og administrerer brukere sine egne digitale identiteter ved å lage digitale sertifikater på en offentlig plattform. Brukere venter deretter på at disse sertifikatene skal verifiseres av andre personer i fellesskapet som er klarert og verifisert. Denne prosessen skaper et "nett av tillit" som garanterer for individets identitet.

Jo flere personer som signerer en brukers sertifikat, desto mer pålitelig og bekreftet blir identiteten deres. Dette skaper et nettverk av tillit som kan bidra til å verifisere en persons identitet på nettet.

Prosjekter som Bevis for menneskeheten fokus på å bygge tillitsnett for Web3. Brukere må laste opp en video av dem som snakker med en Ethereum-adresse som er godt synlig på en enhet eller et papirark. Brukeren må sette inn et lite antall tokens som vil bli returnert når en registrert bruker har bekreftet identiteten din.

Biometri

Biometri er en autentiseringsmetode som er avhengig av et individs unike biologiske egenskaper for identitetsverifisering. Siden disse egenskapene ikke kan tapes eller glemmes, kan biometri brukes som en pålitelig metode for bevis på personlighet.

Det finnes flere metoder for biometri med varierende vanskelighetsgrad i implementering.

Fingeravtrykk biometri innebærer å bruke et individs unike fingeravtrykksmønstre for å bekrefte identiteten deres. Fingeravtrykksbiometri er allment akseptert som en praktisk metode for bevis på personlighet i myndigheter og forretningsmiljøer.

Brukere kan også bekrefte identiteten sin gjennom bruk av ansiktsbiometri. Plattformer kan bruke ansiktsgjenkjenningsteknologi for å matche en brukers ansikt med deres offentlig utstedte ID eller andre dokumenter. Suksessen til Apples Face ID-system har vist gjennomførbarheten av ansiktsbiometri på mobile enheter som et alternativ til passord og fingeravtrykkbiometri.

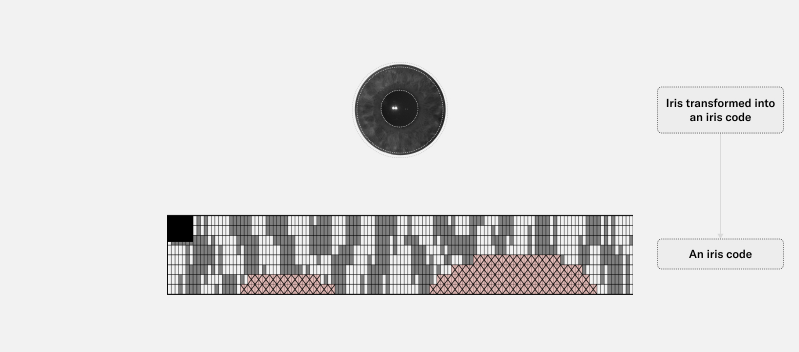

En annen potensiell metode er bruken av irisbiometri for å skanne de unike mønstrene som finnes i en persons iris. Forskere hevder at irisbiometri er mer nøyaktig enn ansiktsgjenkjenning og fingeravtrykkbiometri. Irismønstre er mer unike enn fingeravtrykk og forblir relativt ulenket etter hvert som individet eldes.

Et forbehold ved irisbiometri er at skanning av brukerens iris krever spesialiserte enheter.

Den personvernfokuserte digitale identitetsplattformen verdensmynt planlegger å bruke tilpasset maskinvare kalt "Orb". Enheten utsteder bevis på personopplysninger som AI vil ha en vanskelig tid å forfalske. Orb holder også brukerens informasjon trygg ved å slette alle bilder etter hver verifisering.

konklusjonen

Etter hvert som desentraliserte applikasjoner finner flere virkelige brukstilfeller, må utviklere integrere måter å forhindre ondsinnede aktører i å dra nytte av systemet. Bevis på personlighetsmekanismer er en nøkkeldel for å holde disse plattformene sikre og pålitelige.

Forskning på bevis på personlighet bør også fokusere på faren for at angripere bruker AI for å lure systemet. Hvis AI har evnen til å etterligne en persons ansikt og tale, kan nettplattformer risikere å bli overkjørt av uredelige og ondsinnede profiler som utgir seg for å være ekte mennesker.

Hva tror du er den beste måten å nærme seg spørsmålet om digitale identiteter i AI-tiden?

Legg igjen en kommentar