Innholdsfortegnelse[Gjemme seg][Forestilling]

Google har konsekvent holdt seg i forkant av AI-forskning, utnyttet sine enorme ressurser og ansatt et betydelig antall ingeniører med topptalent. Når det gjelder språkmodeller, var Googles innsats imidlertid sent ute.

Siden teknologigiganten Microsoft allerede drar fordel av et fruktbart partnerskap med OpenAI, hadde Google ikke noe annet valg enn å ta igjen.

På årets Google I/O-konferanse kunngjorde selskapet sitt svar på det generative AI-våpenkappløpet: PaLM 2. Vil denne nye modellen måle seg med ytelse sammen med OpenAIs GPT-4?

Hva er PaLM 2?

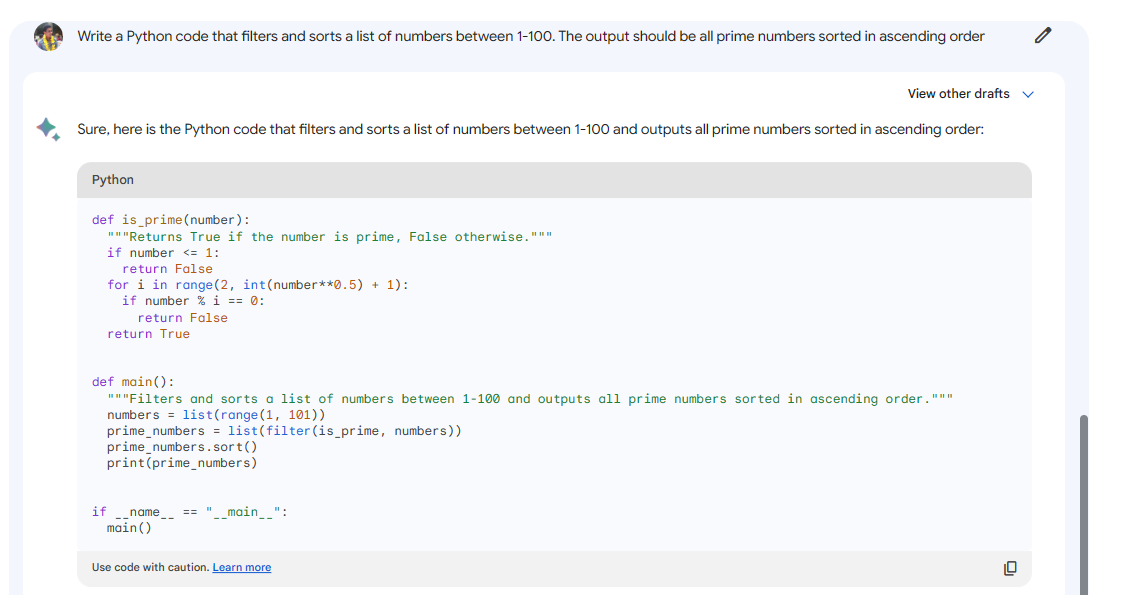

Google beskriver PALM 2 som en toppmoderne språkmodell som forbedrer deres eksisterende PaLM-modell først annonsert i 2022. I likhet med andre språkmodeller er PaLM 2 i stand til å utføre ulike tekstgenereringsoppgaver, slik som PaLM er i stand til å utføre et bredt spekter av oppgaver , inkludert å svare på spørsmål, oversette tekst, generere kode, Og mye mer.

Tester har vist at PaLM 2 allerede viser betydelige forbedringer, og overgår PaLM-modellen mens den bruker et mye lavere antall parametere.

PaLM 2 er en familie av modeller

Som andre språkmodeller er PaLM 2-prosjektet faktisk en familie av modeller som varierer i størrelse. Google vil levere PaLM 2-modellen i fire størrelser: Gecko, Otter, Bison og Unicorn.

Variasjonen i størrelser gjør det enkelt å distribuere PaLM 2 i ulike brukstilfeller. For eksempel er Gecko-modellen lett nok til at hele modellen kan passe i en mobilenhet og til og med kjøre offline.

PaLM 2s treningsdatasett

En av de viktigste aspektene ved en vellykket språkmodell er treningsdatasett. Opplæringsdatasettet må være mangfoldig nok til at modellen kan ha en dyp forståelse av emnet den er designet for.

For store språkmodeller (LLM) er det vanligvis ikke noe spesifikt tema modellen må trene på. LLM-er er i stedet bygget for å være modeller for generelle formål som må være egnet til å utføre en lang rekke oppgaver. Disse modellene bruker store tekstdatasett som fanger opp en stor del av nettet, samt publisert referansemateriale, litteratur og til og med kildekode.

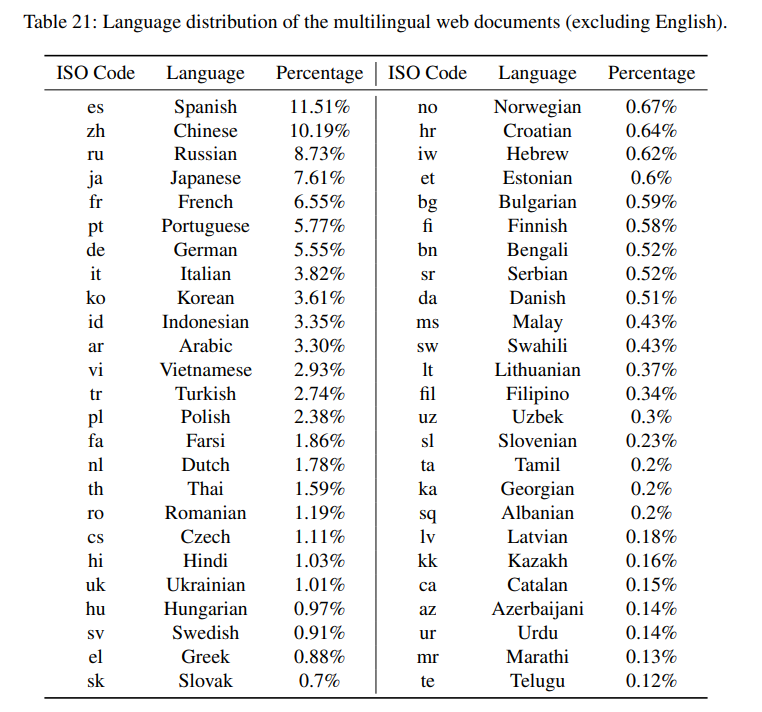

Hovedforskjellen mellom PaLM 2s treningsdatasett og andre modeller er inkluderingen av en høyere prosentandel av ikke-engelske data. Ifølge deres teknisk rapport, utvidelse av datasettet til å inkludere ikke-engelske tekster eksponerer modellen for et bredere utvalg av språk og kulturer.

PaLM 2-modellen ble også trent på parallelle flerspråklige data for å hjelpe modellen med å få muligheten til å oversette fra ett språk til et annet. Dataene inkluderer tekstpar der den ene oppføringen er på engelsk og den andre er en tilsvarende tekst på et annet språk.

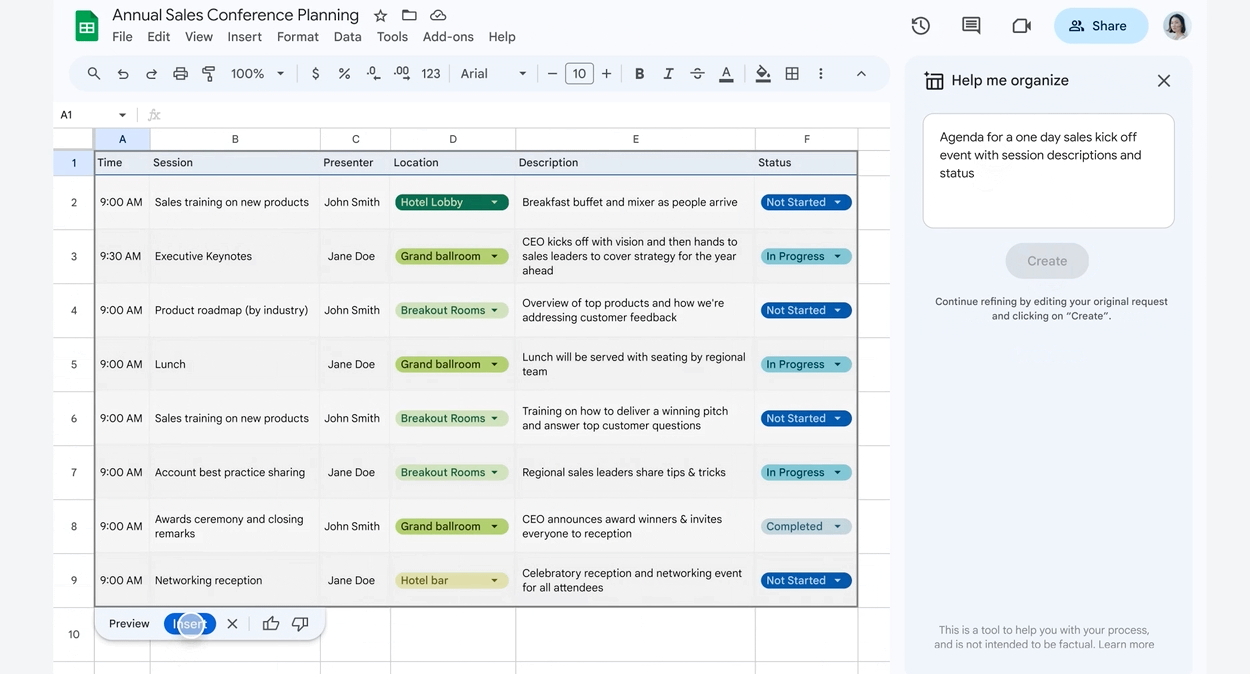

Tabellen over viser språkdistribusjonen til de flerspråklige webdokumentene som brukes til å trene PaLM 2.

PALM 2 Nøkkelfunksjoner

Her er noen av hovedområdene som PaLM 2 utmerker seg på sammenlignet med andre språkmodeller.

Argumentasjon

PaLM 2s datasett inkluderer kilder som vitenskapelige artikler og nettinnhold med matematiske uttrykk. Dette gir modellen forbedrede evner innen matematikk, sunn fornuft resonnement og logikk.

Forskere testet modellens matematiske resonneringsevner på matematiske spørsmål på grunnskole og videregående skole der den viser sammenlignbare resultater med GPT-4s matematiske evner.

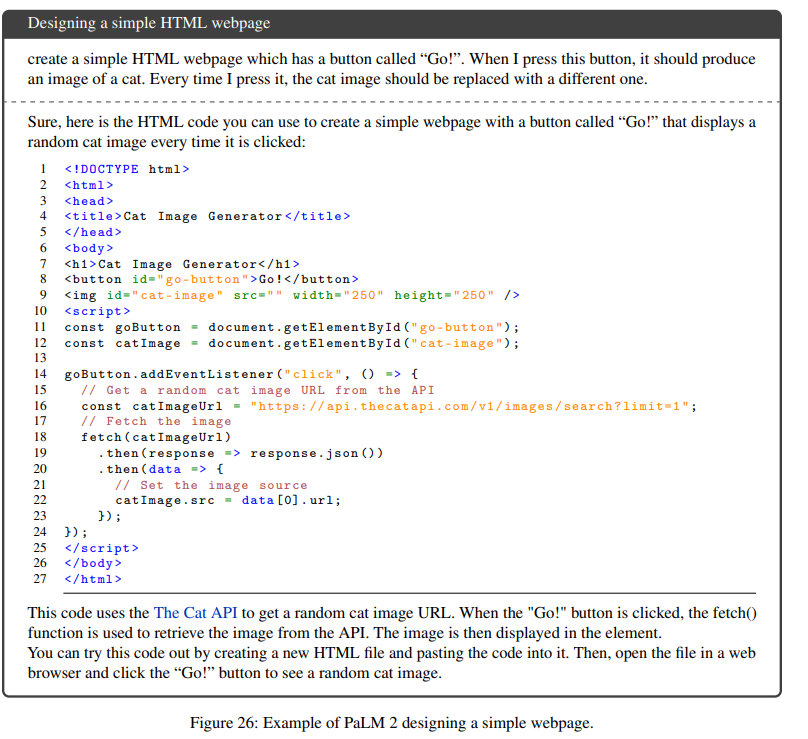

Koding

PaLM 2s treningsdata gir den også muligheten til å generere kode på en rekke programmeringsspråk. PALM 2-teamet laget en kodespesifikk PaLM 2-modell kalt PaLM 2-S* som ble trent på et kodetungt flerspråklig datasett.

Ikke bare er modellen i stand til kodegenerering, men den er også i stand til å håndtere oppgaver som involverer flere språk. Du kan for eksempel be PaLM 2 om å lage en Python-sorteringsfunksjon som legger til linje-for-linje-kommentarer på spansk.

Flerspråklighet

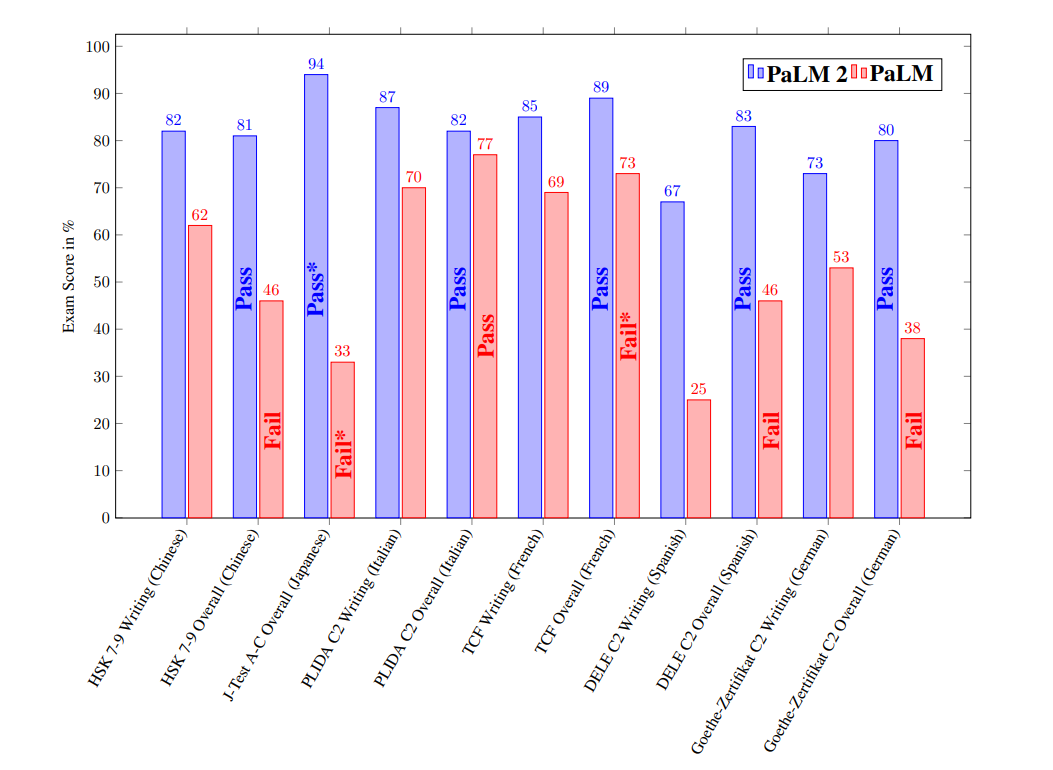

Siden modellen ble trent på et datasett som inkluderer over 100 språk, viser PaLM 2 ferdigheter i å forstå, generere og oversette tekst på tvers av flere språk.

For å teste flerspråklighet testet forskerne modellen på ulike språkferdighetstester på ulike språk. Resultatene viser at ikke bare PaLM 2 utkonkurrerer PaLM, men oppnådde også en bestått karakter for hvert evaluert språk.

PaLM 2 viser også sine flerspråklige evner ved sin evne til å forstå idiomer på forskjellige språk, forklare vitser, fikse skrivefeil og kan til og med lære å konvertere formell tekst til samtaleprat.

PaLM 2 driver Google-produkter

Google drar allerede nytte av PaLM 2s fremskritt ved å integrere modellen med andre produkter.

Bard

Modellens evne til å håndtere flerspråklige oppgaver driver nå Googles Bard eksperiment ettersom den utvides til over 180 land og territorier.

Bard bruker nå også PaLM 2s kodefunksjoner for å hjelpe til med programmerings- og programvareutviklingsoppgaver som kodegenerering og kodefeilsøking.

Duet AI for Google Workspace

Google planlegger også å legge til generative AI-funksjoner til sin Google Workspace-gruppe med applikasjoner. Gmail og Dokumenter vil snart inkludere en funksjon kalt Duett AI som vil hjelpe brukeren med å skrive utkast til svar og skrive ved hjelp av ledetekster.

Duet AI vil også tillate brukere å lage tilpassede planer i Google Sheets for oppgaver og prosjekter basert på spørsmål gitt av brukeren.

konklusjonen

Google håper absolutt å lukke gapet i markedet for AI-språkverktøy med deres PaLM 2-språkmodell. Selv om modellens API ennå ikke er offentlig tilgjengelig, viser resultatene fra deres forskning at modellen er konkurransedyktig nok til å matche GPT-4s ytelse.

Med Googles eksisterende brukerbase har de absolutt fordelen av massiv tilpasning hvis AI blir integrert i tjenestene deres, for eksempel søkemotoren eller suiten med produktivitetsverktøy.

Legg igjen en kommentar