Inhoudsopgave[Zich verstoppen][Laten zien]

Ik weet zeker dat je hebt gehoord van kunstmatige intelligentie, evenals van woorden als machine learning en natuurlijke taalverwerking (NLP).

Zeker als je werkt voor een bedrijf dat dagelijks honderden, zo niet duizenden klantcontacten afhandelt.

Gegevensanalyse van posts op sociale media, e-mails, chats, antwoorden op open enquêtes en andere bronnen is geen eenvoudig proces, en het wordt zelfs nog moeilijker wanneer het alleen aan mensen wordt toevertrouwd.

Daarom zijn veel mensen enthousiast over het potentieel van kunstmatige intelligentie voor hun dagelijkse werk en voor ondernemingen.

AI-aangedreven tekstanalyse maakt gebruik van een breed scala aan benaderingen of algoritmen om taal organisch te interpreteren, waaronder onderwerpanalyse, die wordt gebruikt om automatisch onderwerpen uit teksten te ontdekken.

Bedrijven kunnen onderwerpenanalysemodellen gebruiken om eenvoudige taken naar machines over te dragen in plaats van werknemers te overladen met te veel gegevens.

Bedenk hoeveel tijd uw team zou kunnen besparen en besteden aan essentiëler werk als een computer elke ochtend eindeloze lijsten met klantonderzoeken of ondersteuningsproblemen zou kunnen filteren.

In deze handleiding gaan we in op onderwerpmodellering, verschillende methoden voor onderwerpmodellering en doen we er praktische ervaring mee op.

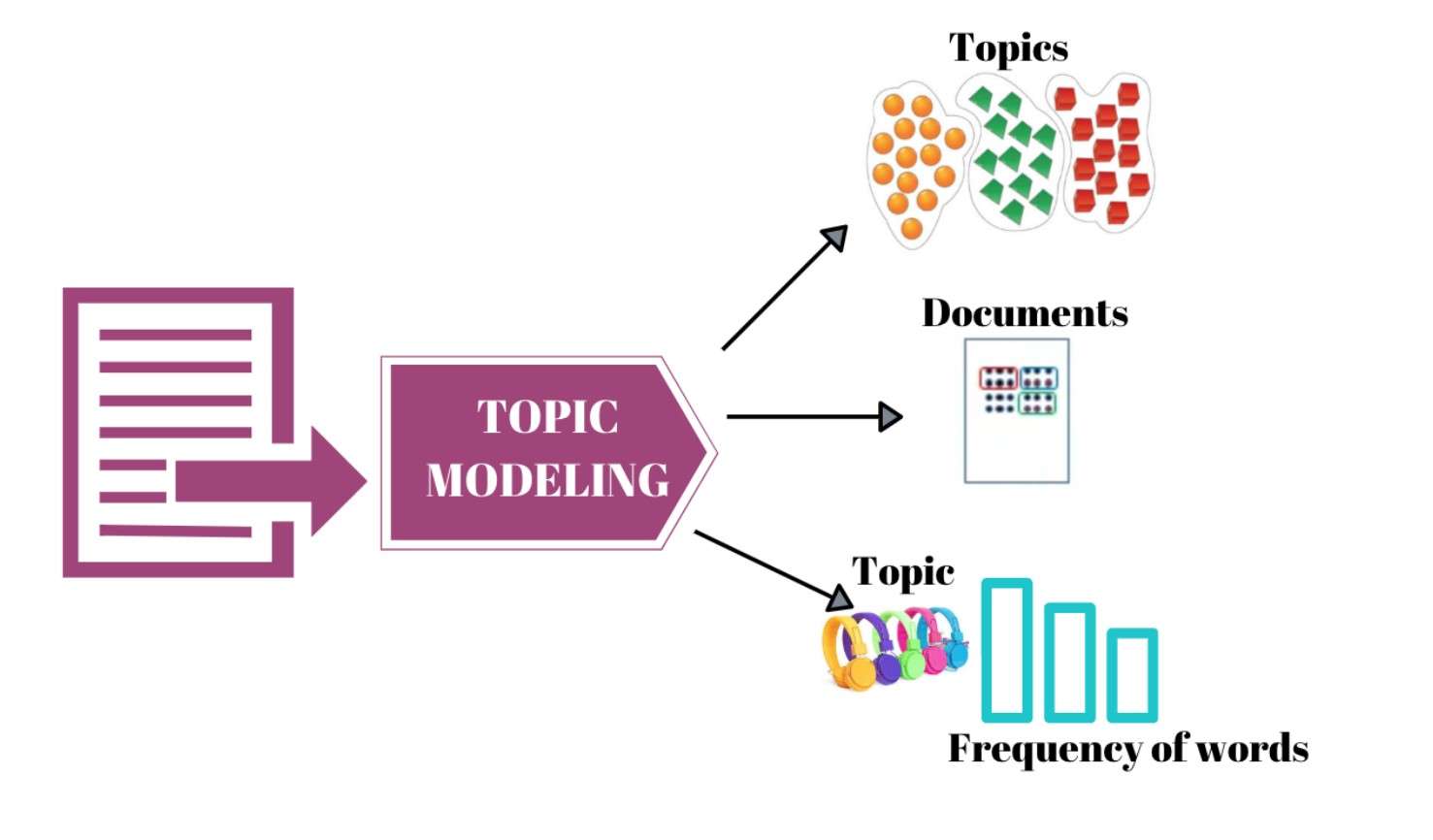

Wat is onderwerpmodellering?

Topic-modellering is een vorm van tekstmining waarbij niet-gecontroleerde en gecontroleerde statistische machine learning technieken worden gebruikt om trends in een corpus of een aanzienlijk volume ongestructureerde tekst te detecteren.

Het kan uw enorme verzameling documenten in beslag nemen en een overeenkomstmethode gebruiken om de woorden in clusters van termen te rangschikken en onderwerpen te ontdekken.

Dat lijkt een beetje ingewikkeld en moeilijk, dus laten we de modelleringsprocedure voor het onderwerp vereenvoudigen!

Stel dat u een krant leest met een set gekleurde markeerstiften in uw hand.

Is dat niet ouderwets?

Ik realiseer me dat tegenwoordig maar weinig mensen kranten in gedrukte vorm lezen; alles is digitaal en markeerstiften behoren tot het verleden! Doe alsof je je vader of moeder bent!

Dus als je de krant leest, markeer je de belangrijke termen.

Nog een aanname!

Je gebruikt een andere tint om de trefwoorden van verschillende thema's te benadrukken. U categoriseert de trefwoorden afhankelijk van de opgegeven kleur en onderwerpen.

Elke verzameling woorden gemarkeerd met een bepaalde kleur is een lijst met trefwoorden voor een bepaald onderwerp. Het aantal verschillende kleuren dat je hebt gekozen, geeft het aantal thema's weer.

Dit is de meest fundamentele onderwerpmodellering. Het helpt bij het begrijpen, ordenen en samenvatten van grote tekstverzamelingen.

Houd er echter rekening mee dat geautomatiseerde onderwerpmodellen veel inhoud vereisen om effectief te zijn. Als je een kort papier hebt, wil je misschien old school gaan en markeerstiften gebruiken!

Het is ook nuttig om wat tijd te besteden aan het leren kennen van de gegevens. Dit geeft u een basisidee van wat het onderwerpmodel zou moeten vinden.

Dat dagboek kan bijvoorbeeld gaan over uw huidige en eerdere relaties. Dus ik verwachtte dat mijn robotmaatje voor tekstmining met soortgelijke ideeën zou komen.

Dit kan u helpen de kwaliteit van de door u geïdentificeerde onderwerpen beter te analyseren en, indien nodig, de trefwoordensets aan te passen.

Onderdelen van onderwerpmodellering

Probabilistisch model

Willekeurige variabelen en kansverdelingen worden opgenomen in de representatie van een gebeurtenis of fenomeen in probabilistische modellen.

Een deterministisch model biedt een enkele potentiële conclusie voor een gebeurtenis, terwijl een probabilistisch model een kansverdeling als oplossing biedt.

Deze modellen houden rekening met de realiteit dat we zelden volledige kennis van een situatie hebben. Er is bijna altijd een element van willekeur te overwegen.

Een levensverzekering is bijvoorbeeld gebaseerd op de realiteit dat we weten dat we zullen sterven, maar niet wanneer. Deze modellen kunnen gedeeltelijk deterministisch, gedeeltelijk willekeurig of volledig willekeurig zijn.

Informatie ophalen

Information retrieval (IR) is een softwareprogramma dat informatie uit documentopslagplaatsen organiseert, opslaat, ophaalt en evalueert, met name tekstuele informatie.

De technologie helpt gebruikers de informatie te vinden die ze nodig hebben, maar geeft niet duidelijk de antwoorden op hun vragen. Het informeert over de aanwezigheid en locatie van papieren die de nodige informatie kunnen verschaffen.

Relevante documenten zijn documenten die voldoen aan de behoeften van de gebruiker. Een foutloos IR-systeem retourneert alleen geselecteerde documenten.

Onderwerp Coherentie

Onderwerpcoherentie scoort een enkel onderwerp door de mate van semantische overeenkomst tussen de hoogscorende termen van het onderwerp te berekenen. Deze metrieken helpen bij het onderscheiden tussen onderwerpen die semantisch interpreteerbaar zijn en onderwerpen die statistische gevolgtrekkingsartefacten zijn.

Als een groep beweringen of feiten elkaar ondersteunt, is er sprake van coherentie.

Als gevolg hiervan kan een samenhangende verzameling feiten worden begrepen in een context die alle of de meeste feiten omvat. "Het spel is een teamsport", "het spel wordt gespeeld met een bal" en "het spel vereist een enorme fysieke inspanning" zijn allemaal voorbeelden van samenhangende feitenreeksen.

Verschillende methoden voor onderwerpmodellering

Deze kritische procedure kan worden uitgevoerd door een verscheidenheid aan algoritmen of methodologieën. Onder hen zijn:

- Latente Dirichlet-toewijzing (LDA)

- Niet-negatieve matrixfactorisatie (NMF)

- Latente semantische analyse (LSA)

- Probabilistische latente semantische analyse (pLSA)

Latente Dirichlet-toewijzing (LDA)

Om relaties tussen meerdere teksten in een corpus te detecteren, wordt het statistische en grafische concept van Latent Dirichlet Allocation gebruikt.

Met behulp van de Variational Exception Maximization (VEM)-benadering wordt de grootste waarschijnlijkheidsschatting van het volledige tekstcorpus bereikt.

Traditioneel worden de bovenste paar woorden uit een zak met woorden gekozen.

De zin is echter volkomen zinloos.

Volgens deze techniek wordt elke tekst weergegeven door een probabilistische verdeling van onderwerpen, en elk onderwerp door een probabilistische verdeling van woorden.

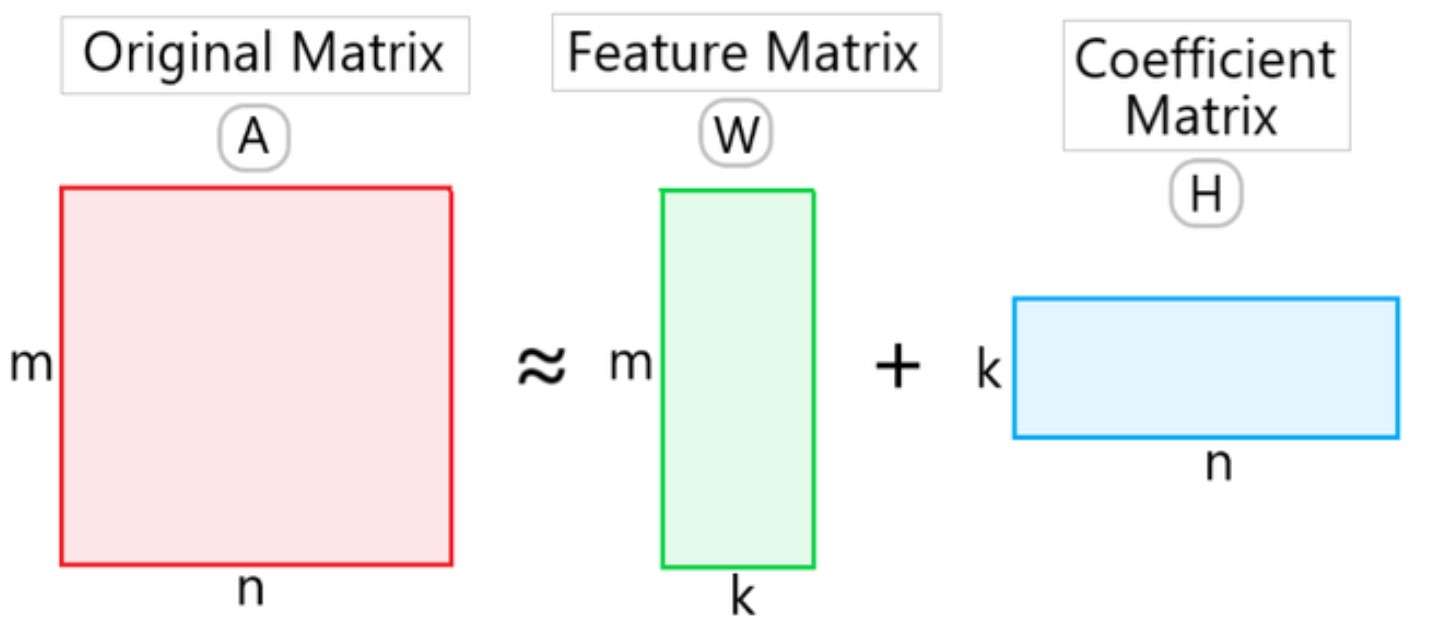

Niet-negatieve matrixfactorisatie (NMF)

Matrix met niet-negatieve waarden Factorisatie is een geavanceerde methode voor het extraheren van kenmerken.

Wanneer er veel kwaliteiten zijn en de attributen vaag of slecht voorspelbaar zijn, is NMF gunstig. NMF kan significante patronen, onderwerpen of thema's genereren door kenmerken te combineren.

NMF genereert elk kenmerk als een lineaire combinatie van de originele attributenset.

Elk kenmerk bevat een set coëfficiënten die het belang van elk kenmerk op het kenmerk weergeven. Elk numeriek kenmerk en elke waarde van elk categoriekenmerk heeft zijn eigen coëfficiënt.

Alle coëfficiënten zijn positief.

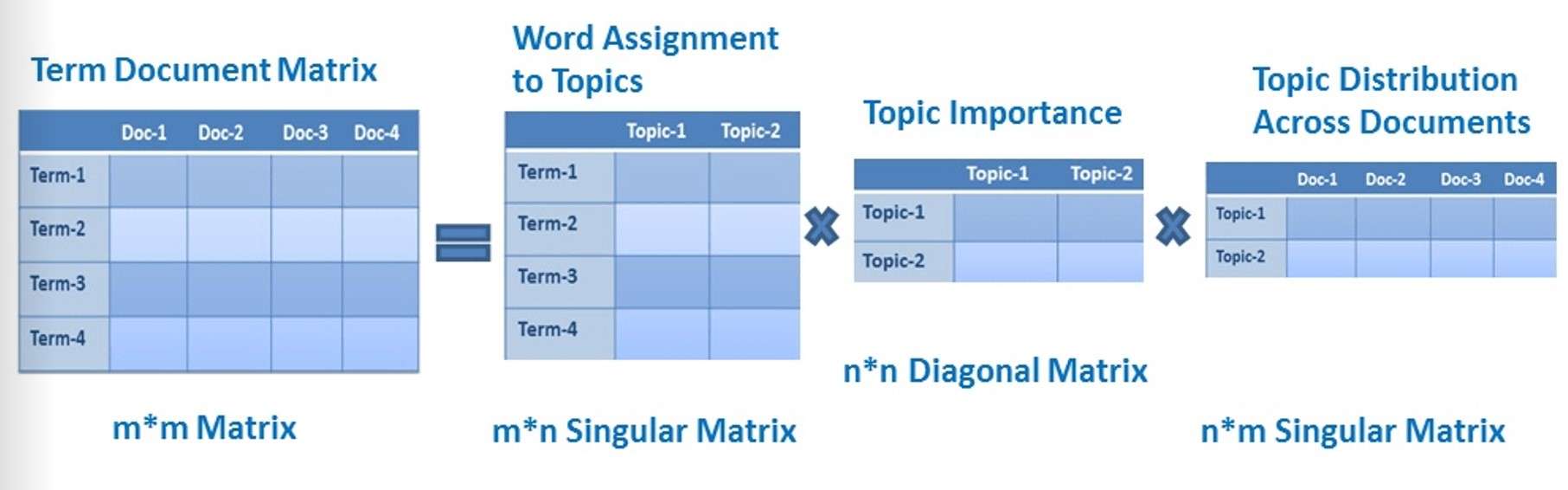

Latente semantische analyse

Het is een andere leermethode zonder toezicht die wordt gebruikt om associaties tussen woorden in een reeks documenten te extraheren, namelijk latente semantische analyse.

Dit helpt ons om de juiste documenten te kiezen. De primaire functie ervan is om de dimensionaliteit van het enorme corpus aan tekstgegevens te verminderen.

Deze onnodige data dienen als achtergrondruis bij het verkrijgen van de benodigde inzichten uit de data.

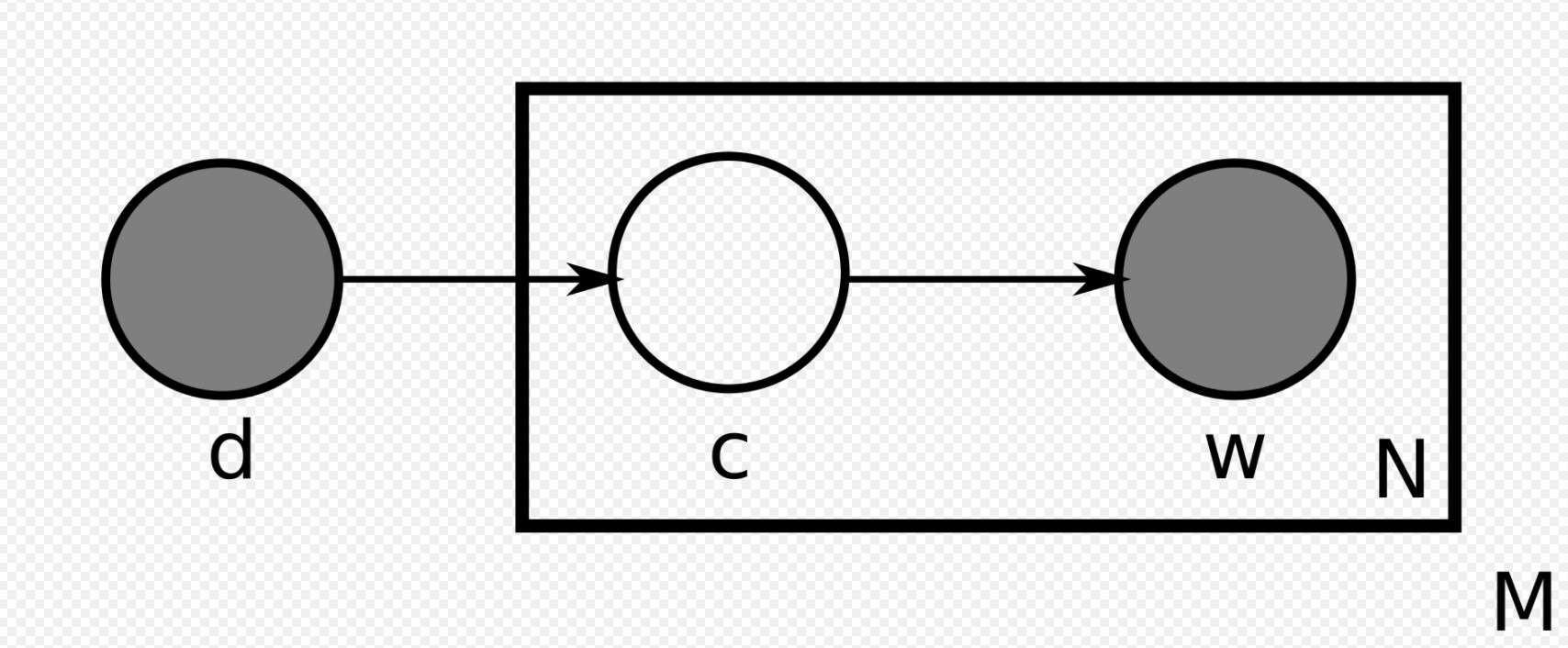

Probabilistische latente semantische analyse (pLSA)

Probabilistische latente semantische analyse (PLSA), ook wel bekend als probabilistische latente semantische indexering (PLSI, met name in kringen voor het ophalen van informatie), is een statistische benadering voor het analyseren van gegevens met twee modi en gelijktijdig voorkomen.

In feite, vergelijkbaar met latente semantische analyse, waaruit PLSA voortkwam, kan een laagdimensionale weergave van de waargenomen variabelen worden afgeleid in termen van hun affiniteit met bepaalde verborgen variabelen.

Hands-on met onderwerpmodellering in Python

Nu zal ik je door een opdracht voor het modelleren van een onderwerp leiden met de Python programmeertaal met behulp van een praktijkvoorbeeld.

Ik zal onderzoeksartikelen modelleren. De dataset die ik hier ga gebruiken is afkomstig van kaggle.com. U kunt hier gemakkelijk alle bestanden die ik in dit werk gebruik vandaan halen pagina.

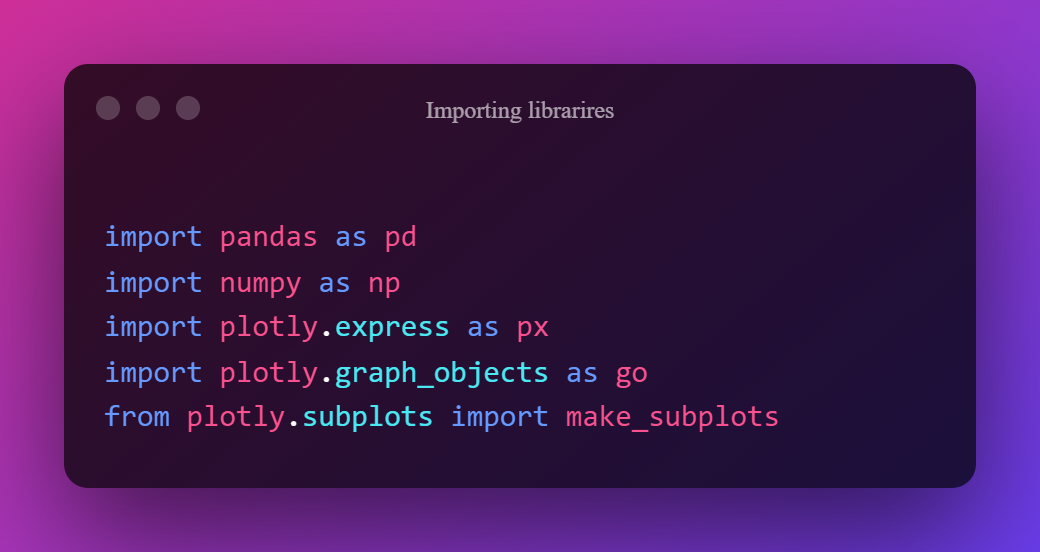

Laten we beginnen met Topic Modeling met Python door alle essentiële bibliotheken te importeren:

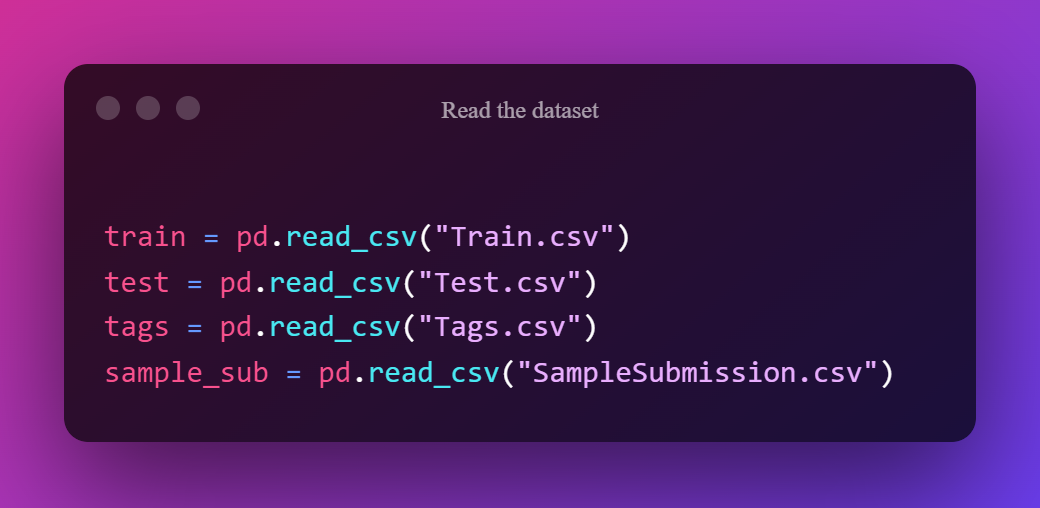

De volgende stap is om alle datasets te lezen die ik in deze taak zal gebruiken:

Verkennende gegevensanalyse

EDA (Exploratory Data Analysis) is een statistische methode die gebruik maakt van visuele elementen. Het maakt gebruik van statistische samenvattingen en grafische weergaven om trends, patronen en testaannames te ontdekken.

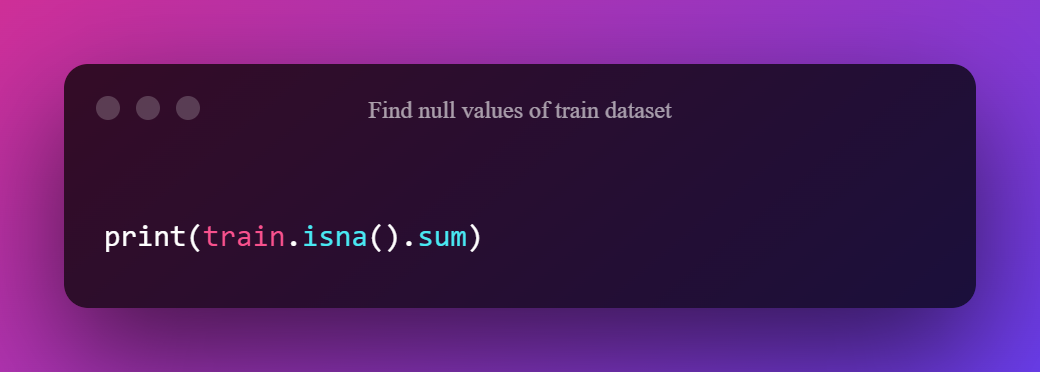

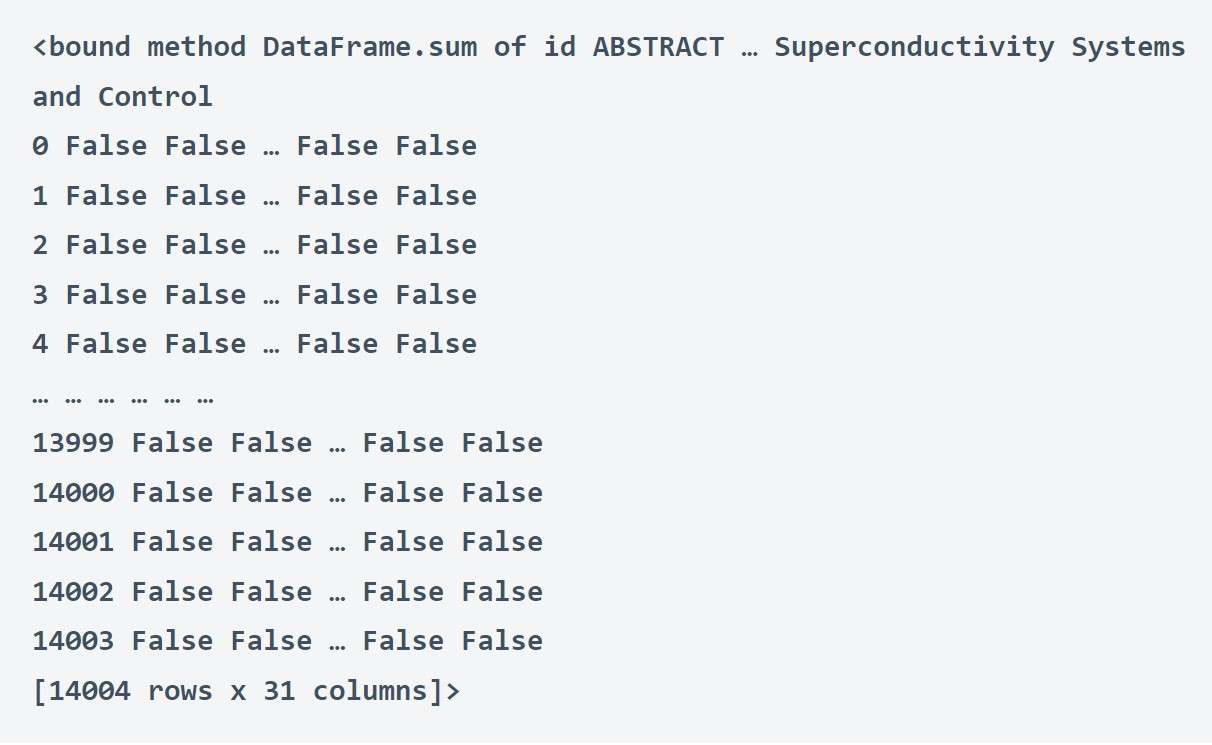

Ik zal wat verkennende gegevensanalyse doen voordat ik onderwerpmodellering begin om te zien of er patronen of relaties in de gegevens zijn:

Nu zullen we de null-waarden van de testdataset vinden:

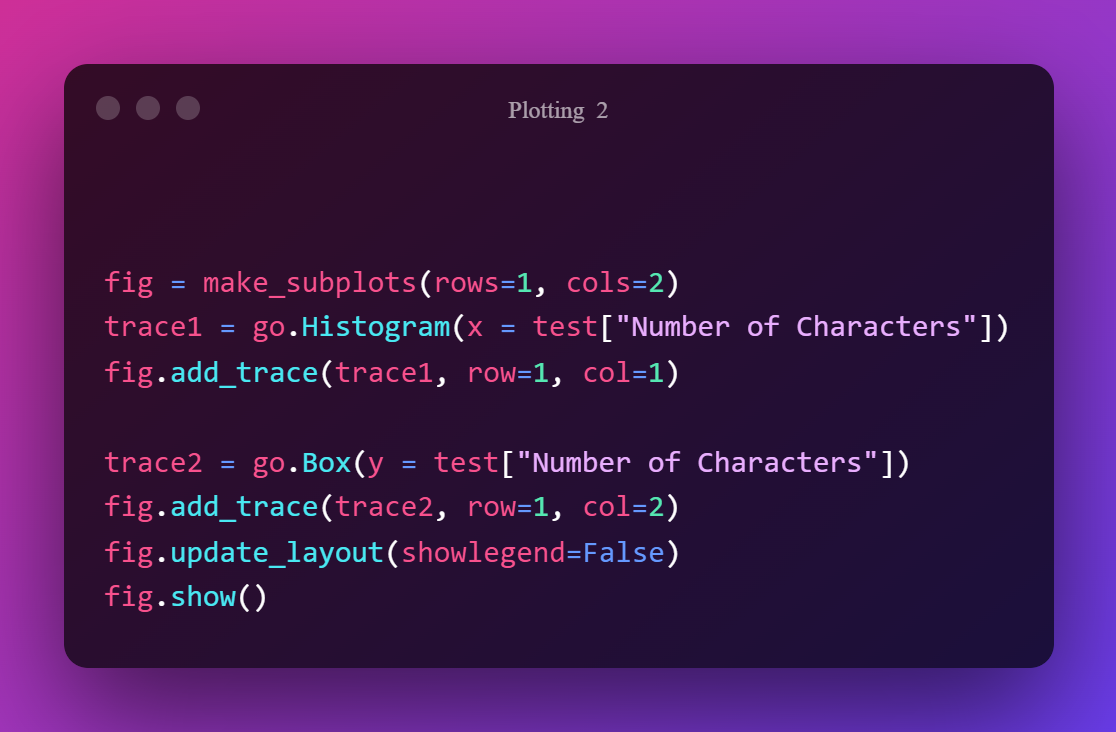

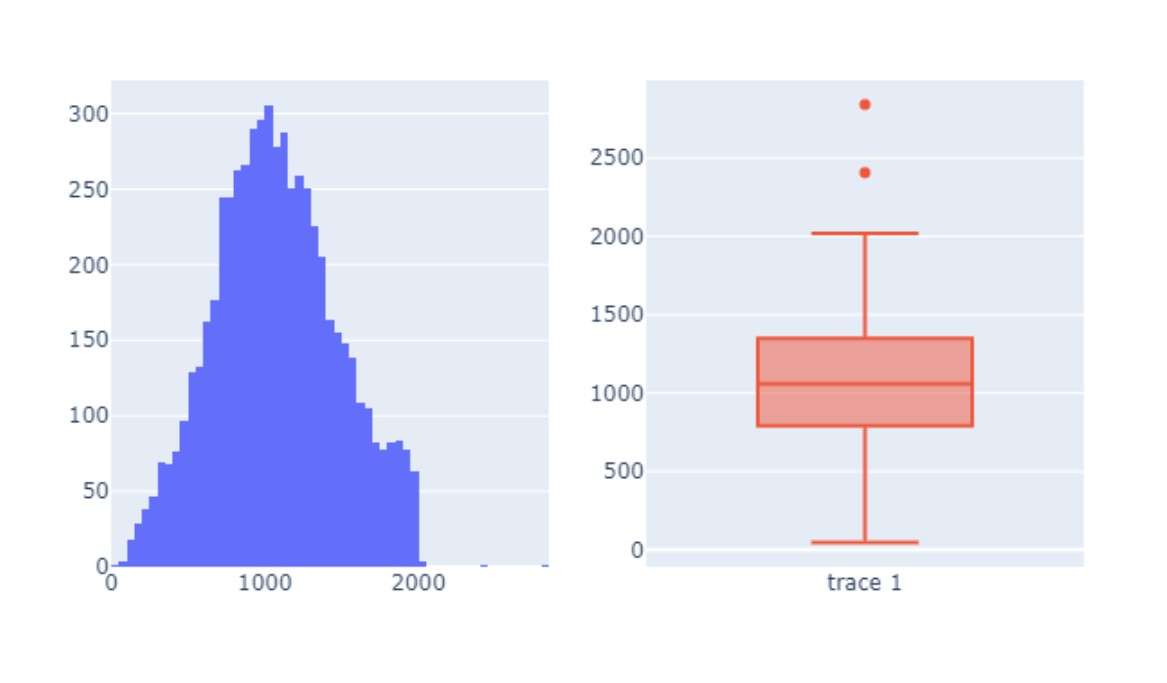

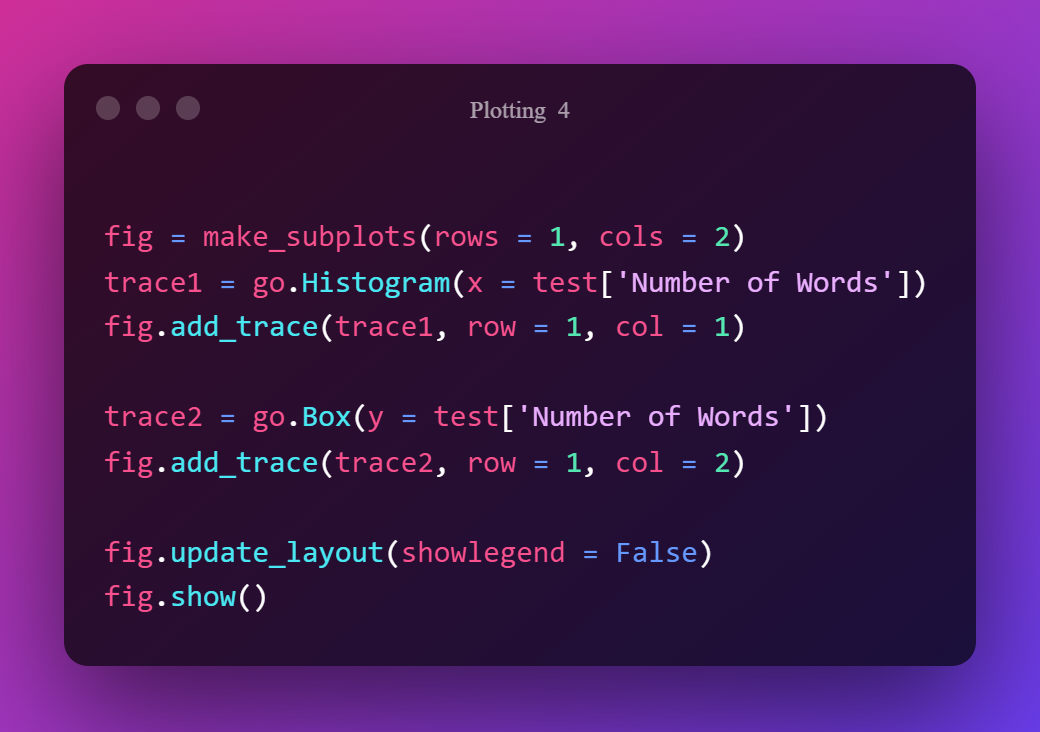

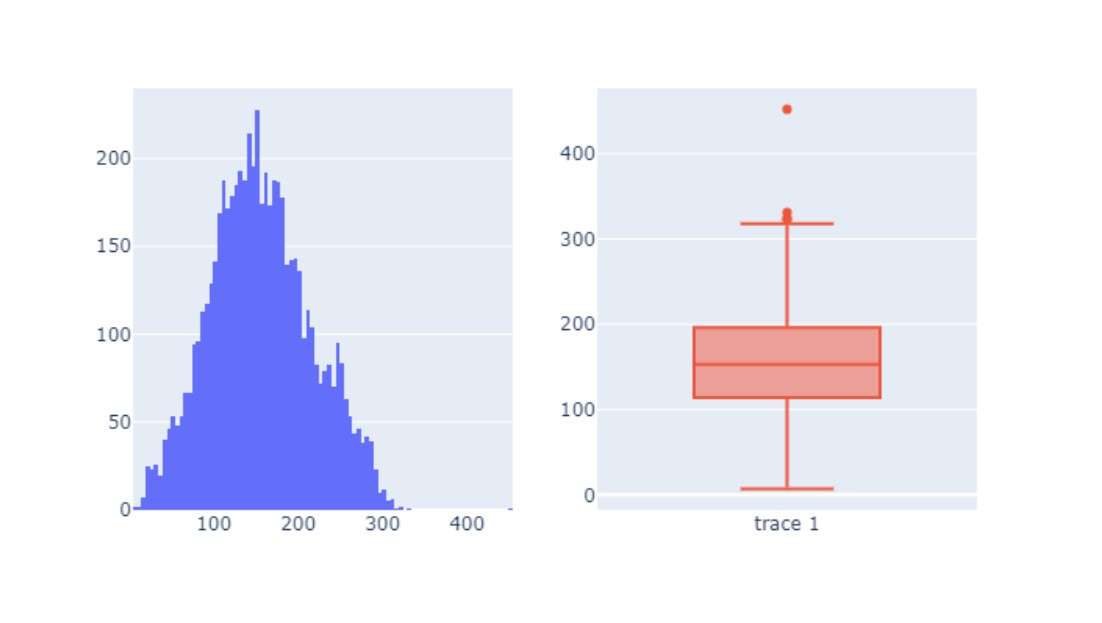

Nu ga ik een histogram en boxplot plotten om de relatie tussen de variabelen te controleren.

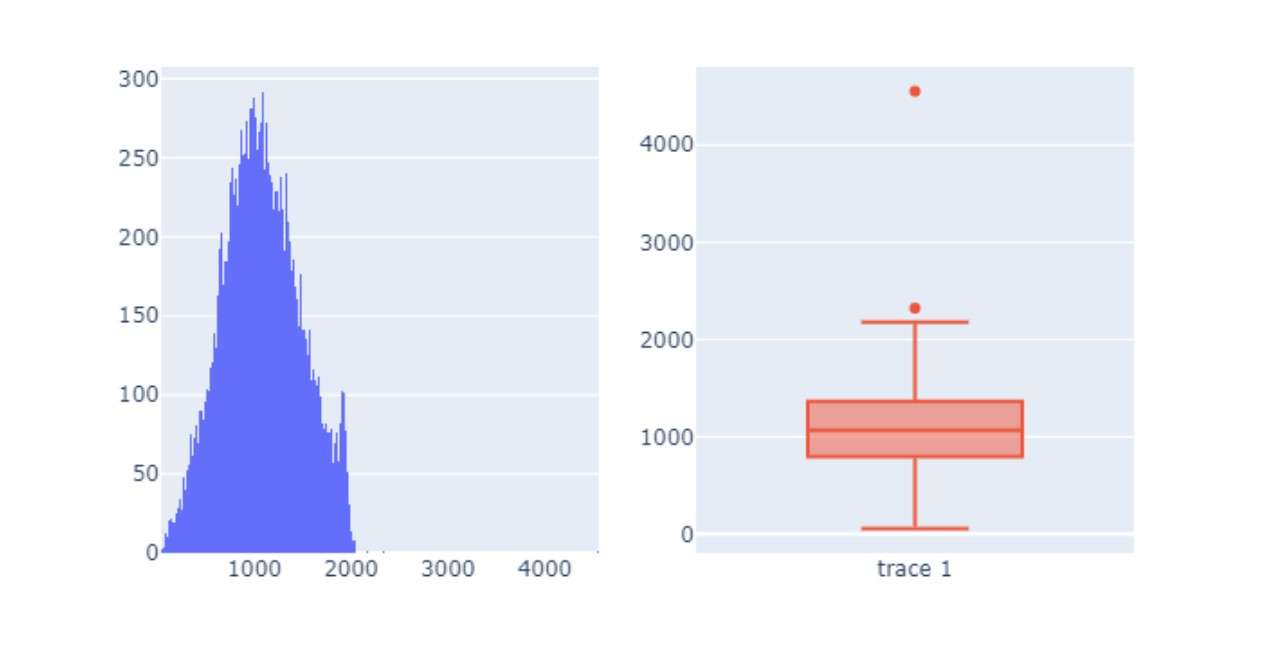

Het aantal personages in de set Abstracts of the Train varieert enorm.

In de trein hebben we minimaal 54 en maximaal 4551 tekens. 1065 is het gemiddelde aantal tekens.

De testset lijkt interessanter dan de trainingsset, aangezien de testset 46 tekens heeft en de trainingsset 2841.

Als resultaat had de testset een mediaan van 1058 karakters, vergelijkbaar met de trainingsset.

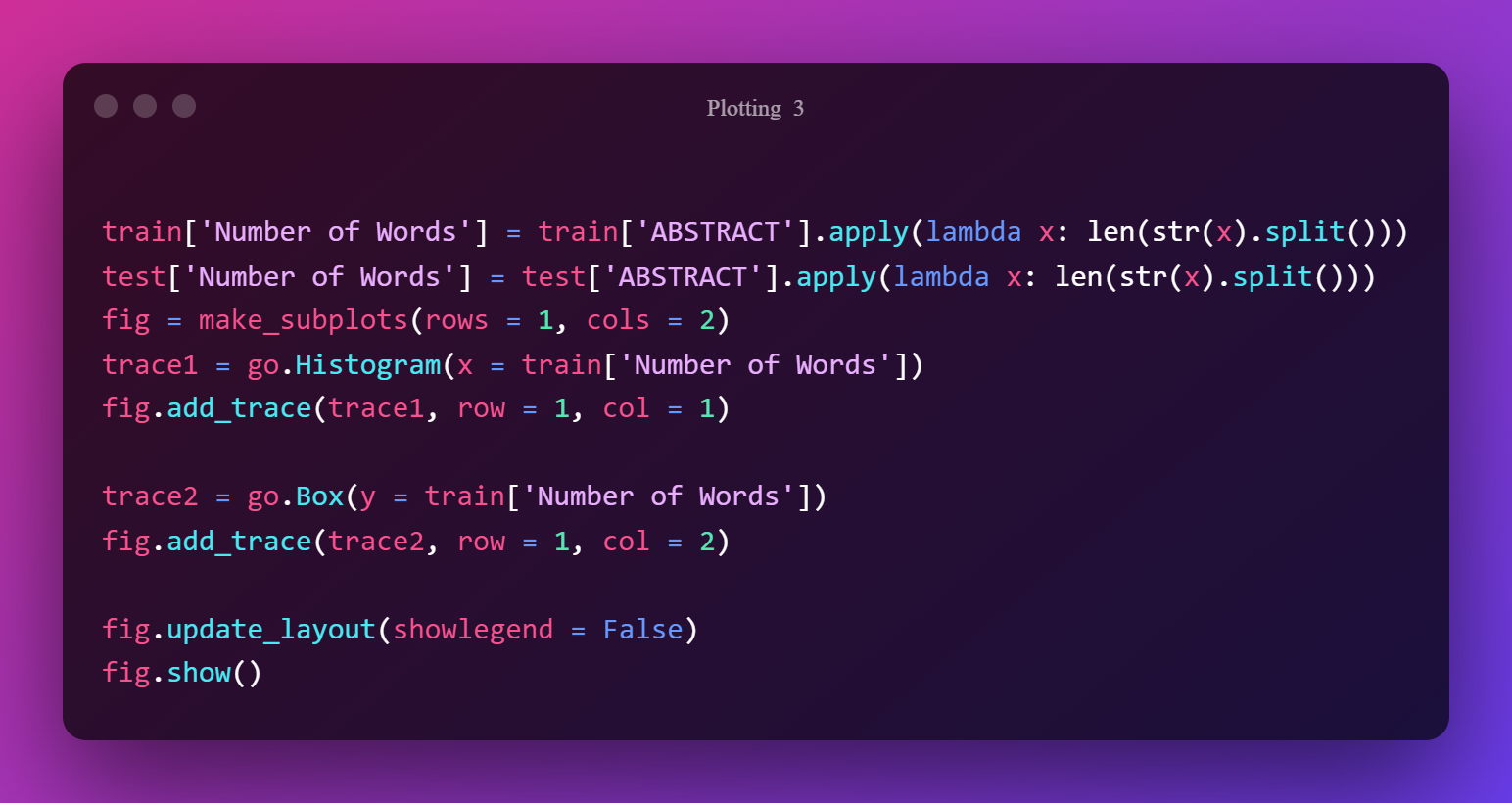

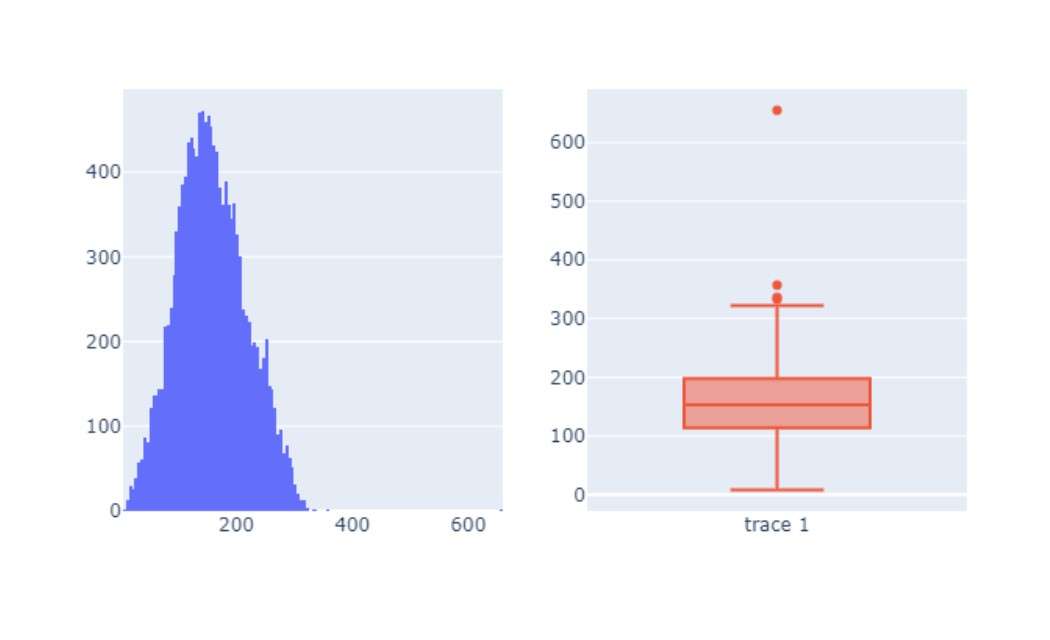

Het aantal woorden in de leerset volgt een soortgelijk patroon als het aantal letters.

Minimaal 8 woorden en maximaal 665 woorden zijn toegestaan. Als resultaat is het mediane aantal woorden 153.

Minimaal zeven woorden in een abstract en maximaal 452 woorden in de testset zijn vereist.

De mediaan is in dit geval 153, wat identiek is aan de mediaan in de trainingsset.

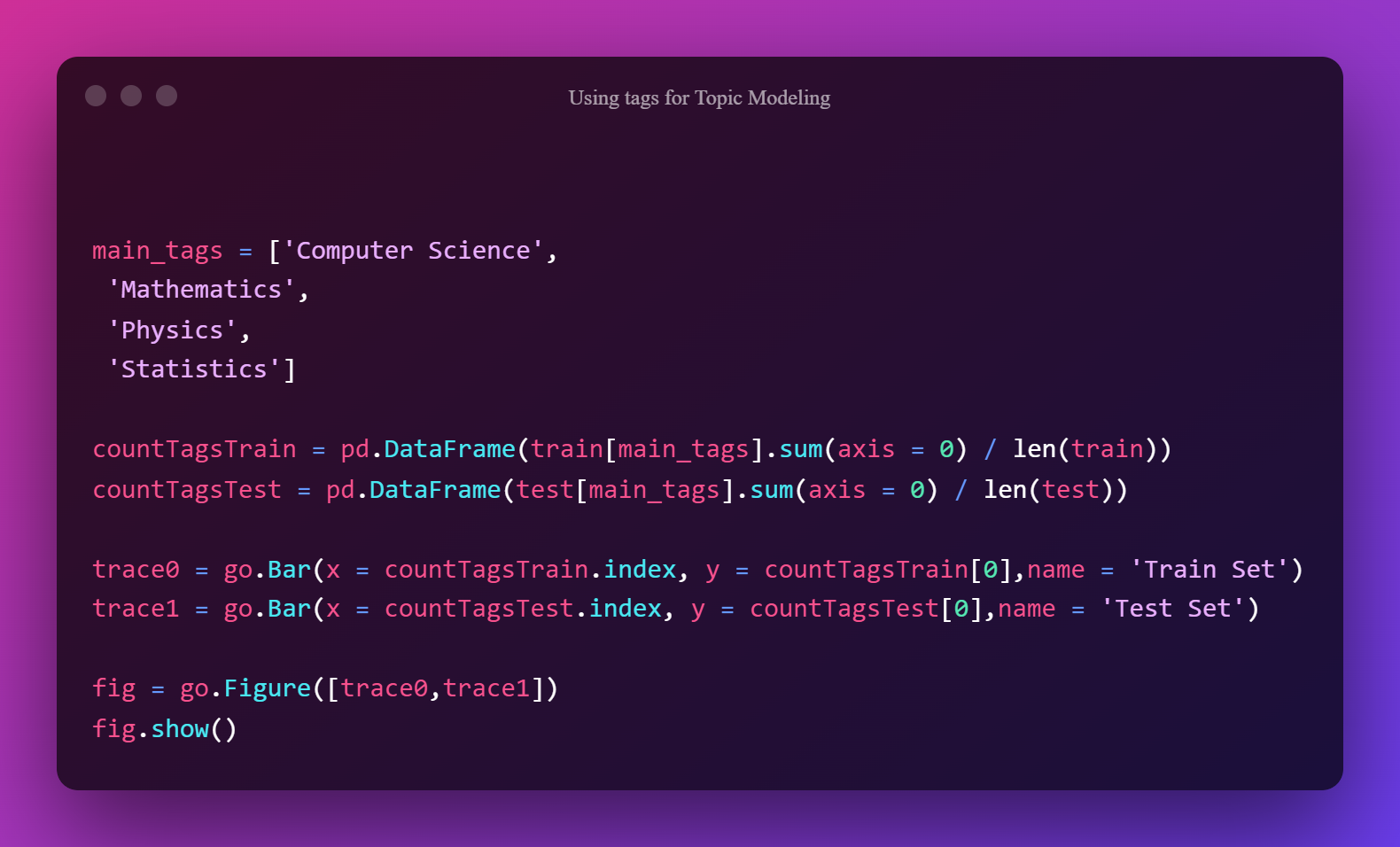

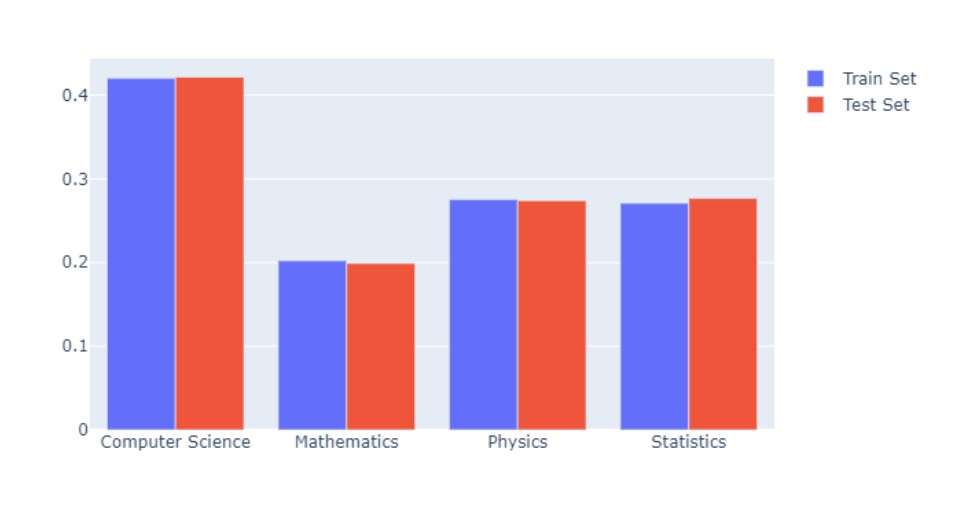

Tags gebruiken voor onderwerpmodellering

Er zijn verschillende strategieën voor onderwerpmodellering. Ik zal tags gebruiken in deze oefening; laten we eens kijken hoe we dit kunnen doen door de tags te bekijken:

Toepassingen van onderwerpmodellering

- Een tekstsamenvatting kan worden gebruikt om het onderwerp van een document of boek te onderscheiden.

- Het kan worden gebruikt om kandidaat-bias uit examenscores te verwijderen.

- Onderwerpmodellering kan worden gebruikt om semantische relaties tussen woorden op te bouwen in op grafieken gebaseerde modellen.

- Het kan de klantenservice verbeteren door trefwoorden in de vraag van de klant te detecteren en erop te reageren. Klanten hebben meer vertrouwen in je omdat je ze op het juiste moment en zonder problemen de hulp hebt geboden die ze nodig hebben. Als gevolg hiervan stijgt de klantentrouw enorm en neemt de waarde van het bedrijf toe.

Conclusie

Topic-modellering is een soort statistische modellering die wordt gebruikt om abstracte 'onderwerpen' te ontdekken die in een verzameling teksten voorkomen.

Het is een vorm van het statistische model dat wordt gebruikt in machine learning en natuurlijke taalverwerking om abstracte concepten te ontdekken die in een reeks teksten voorkomen.

Het is een tekstminingmethode die veel wordt gebruikt om latente semantische patronen in hoofdtekst te vinden.

Laat een reactie achter