Inhoudsopgave[Zich verstoppen][Laten zien]

De nieuwe en verbeterde AI heeft verbeterde mogelijkheden, begrip en het vermogen om afbeeldingen met een hogere resolutie te produceren. Misschien ben je de laatste tijd vreemde en grappige afbeeldingen tegengekomen die op internet rondzwerven.

Een Shiba Inu-hond is gekleed in een baret en een zwarte coltrui. En een zeeotter in de stijl van het 'Meisje met de parel' van de Nederlandse schilder Vermeer. En er is een kop soep die eruitziet als een wollig monster.

deze afbeeldingen niet zijn gemaakt door een menselijke kunstenaar.

In plaats daarvan heeft DALL-E 2, een nieuw AI-systeem dat tekstuele beschrijvingen in afbeeldingen kan omzetten, ze gemaakt.

Schrijf gewoon op wat u wilt zien en de AI zal het voor u creëren – met levendige details, geweldige kwaliteit en, in sommige gevallen, echte inventiviteit. In dit bericht gaan we dieper in op de nieuwste studie van OpenAI, DALL.E 2, hoe het werkt en nog veel meer. Laten we beginnen.

Wat is dat precies? DALL.E 2?

DALL-E 2 is een 'generatief model', een type machine learning-algoritme dat gecompliceerde uitvoer genereert in plaats van voorspellings- of classificatietaken uit te voeren op invoergegevens.

U geeft DALL-E 2 een schriftelijke beschrijving en het creëert een beeld dat daarmee overeenkomt. Door concepten, kwaliteiten en stijlen te combineren, kan DALLE 2 van OpenAI innovatieve, realistische afbeeldingen en kunst produceren op basis van een taalkundige basisbeschrijving.

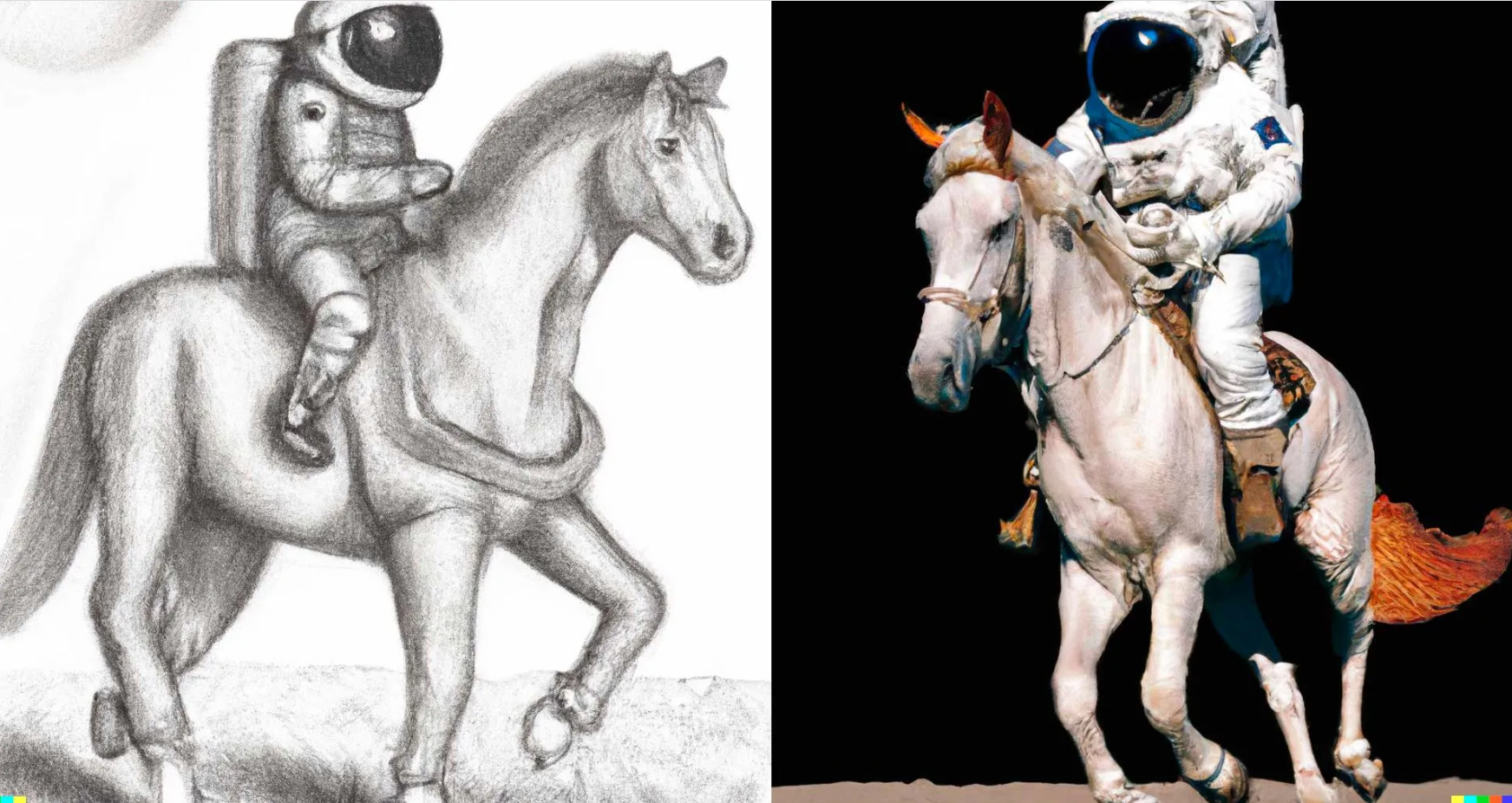

De nieuwste versie, DALLE 2, zou veelzijdiger zijn, in staat om foto's te maken van bijschriften met hogere resoluties en in een breder spectrum van creatieve stijlen. De onderstaande afbeeldingen (uit de DALL-E 2-blogpost) zijn bijvoorbeeld gemaakt door de beschrijving "Een astronaut op een paard".

De ene beschrijving concludeert, "als een potloodschets", terwijl de andere concludeert, "op een fotorealistische manier".

Het kan ook bestaande foto's met verbazingwekkende precisie veranderen. U kunt dus elementen toevoegen of verwijderen terwijl u kleuren, reflecties en schaduwen behoudt, terwijl u het uiterlijk van de originele afbeelding behoudt.

Hoe werkt het?

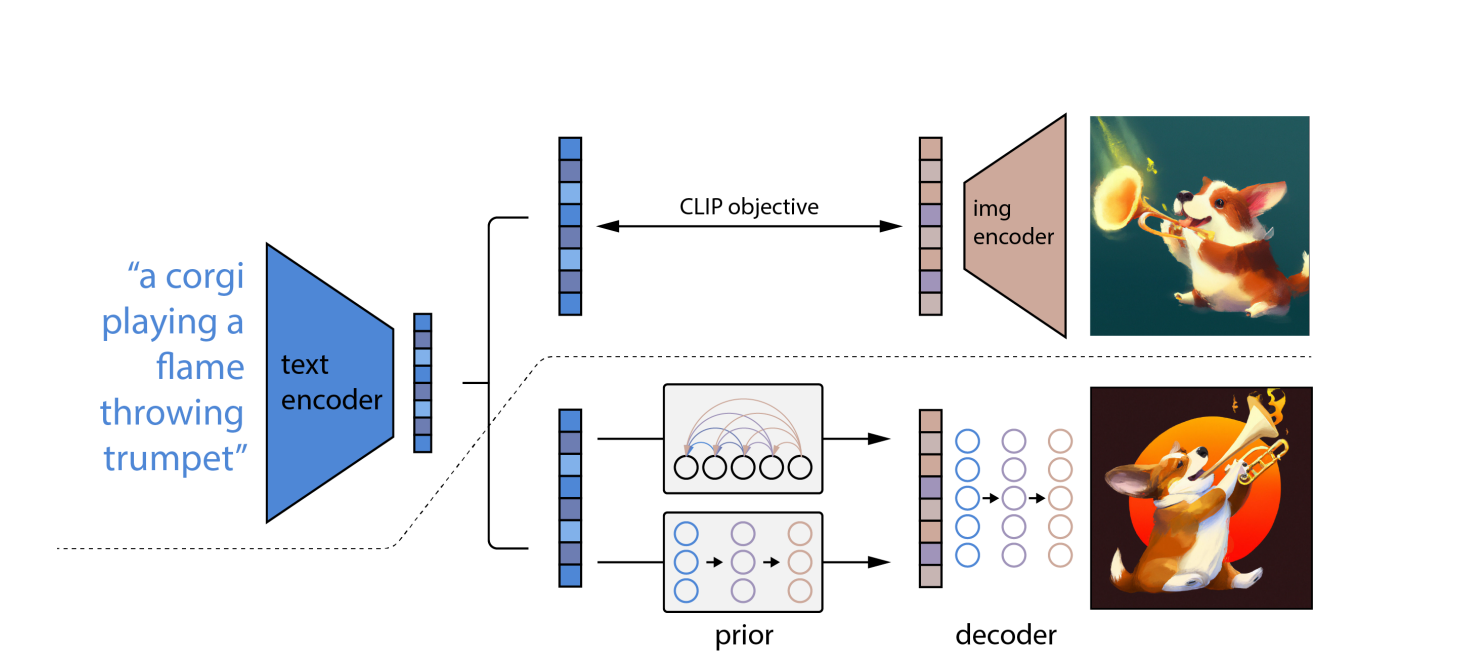

DALL-E 2 maakt gebruik van CLIP- en diffusiemodellen, twee geavanceerde diepgaand leren benaderingen die de afgelopen jaren zijn ontwikkeld. Het is echter gebaseerd op hetzelfde idee als alle andere deep neurale netwerken: representatie leren. CLIP traint er tegelijkertijd twee neurale netwerken op foto's en bijschriften.

Het ene netwerk leert de visuele representaties in de afbeelding, terwijl het andere de tekstrepresentaties leert. Tijdens de training proberen de twee netwerken hun parameters aan te passen zodat vergelijkbare afbeeldingen en beschrijvingen resulteren in vergelijkbare inbeddingen.

"Diffusion", een soort generatief model dat leert om afbeeldingen te maken door zijn trainingsvoorbeelden geleidelijk te ruisen en te denoiseren, is de andere machine learning-benadering die wordt gebruikt in DALL-E 2. Diffusiemodellen zijn vergelijkbaar met auto-encoders in die zin dat ze invoergegevens transformeren in een inbeddingsrepresentatie en vervolgens de inbeddingsinformatie gebruiken om de originele gegevens opnieuw te creëren.

OpenAI's gebruiken taalmodel CLIP, dat tekstuele beschrijvingen kan verbinden met foto's, vertaalt eerst de geschreven prompt in een tussenvorm die de cruciale eigenschappen bevat die een afbeelding zou moeten hebben om bij die prompt te passen (volgens CLIP).

Ten tweede creëert DALL-E 2 een CLIP-compatibel afbeelding met behulp van een diffusiemodel, wat een neuraal netwerk is.

Op vervormde foto's met willekeurige pixels worden diffusiemodellen aangeleerd. Ze leren hoe ze de originele vorm van de foto's kunnen herstellen. Diffusiemodellen kunnen synthetische beelden van hoge kwaliteit produceren, vooral wanneer ze worden gebruikt in combinatie met een leidende benadering die prioriteit geeft aan nauwkeurigheid boven diversiteit.

Als gevolg hiervan is de diffusiemodel neemt de willekeurige pixels en gebruikt CLIP om ze om te zetten in een nieuwe afbeelding die overeenkomt met de woordprompt. Door het diffusieconcept kan DALL-E 2 sneller beelden met een hogere resolutie produceren dan DALL-E.

DALL.E 2 gebruiksvoorbeeld

In de afgelopen twintig jaar, computer visie technologie is geëvolueerd van een eenvoudig idee naar een grote doorbraak. Ondanks deze vooruitgang worden modellen voor beeld- en objectherkenning in het dagelijks leven nog steeds geconfronteerd met aanzienlijke obstakels. Het ontbreken van datasets is een van de belangrijkste nadelen van beeldherkenning en computervisie. Omdat er aan beide kanten een tekort aan gegevens is, is het bijna moeilijk om modellen voor beeldherkenning te trainen om 100 procent nauwkeurige resultaten te geven.

Gelukkig kan het nieuwe machine learning-model van OpenAI de kloof in technologie overbruggen. DALLE 2 kan verbluffende afbeeldingen genereren op basis van tekstbeschrijvingen. Deze productie van nepfoto's kan gegevens leveren aan modellen voor beeldherkenning op basis van hun vereisten. Het ontbreken van data is een belangrijk struikelblok voor object- en foto-identificatie.

In het digitale tijdperk zijn datasets alomtegenwoordig, maar we zijn nog steeds op zoek naar kortere wegen om het AI-model te voeden, zodat het goede resultaten kan opleveren. Het is echter niet eenvoudig om een beeldherkenningsmodel te trainen. Het vereist een groot aantal datasets met kleine verschillen, die we misschien niet eenvoudig hadden kunnen achterhalen.

Dus, wat is het antwoord: het antwoord is DALLE 2. De OpenAI-beeldgenerator, met zijn capaciteit om afbeeldingen van teksten te produceren en bestaande te wijzigen, kan helpen om de kloof te overbruggen. Dit zal helpen bij het genereren van aanvullende trainingsgegevens en tegelijkertijd de vereiste hoeveelheid menselijke labels verminderen. Ondanks het aanzienlijke voordeel, moet u op uw hoede zijn voor frauduleuze beeldproducties en afbeeldingen die opname uitsluiten. Dit kan ertoe leiden dat beelddetectiemethoden vertekende resultaten opleveren.

Beperkingen

Volgens OpenAI kan DALL.E 2 een schadelijke invloed hebben als het in verkeerde handen valt. In de huidige wereld van diepe vervalsingen kan het model gemakkelijk worden gebruikt om valse informatie of racistische beelden te verspreiden. Daarom staat OpenAI ontwikkelaars alleen toe om DALL.2 op uitnodiging te gebruiken. Het model moet voldoen aan een strenge inhoudsbeperking voor alle suggesties die ze krijgt.

Om het potentieel uit te sluiten dat DALL.E 2 vijandige of gewelddadige afbeeldingen zou maken, is de dataset gemaakt zonder dodelijke wapens. Hoewel OpenAI heeft verklaard dat het van plan is het in de toekomst om te vormen tot een API, is het in het geval van DALL.E 2 bereid voorzichtig te werk te gaan.

Conclusie

DALL-E 2 is een andere interessante OpenAI-onderzoeksontdekking die de deur opent naar nieuwe toepassingen.

Een voorbeeld is het creëren van enorme datasets om een van de belangrijkste knelpunten van computervisie aan te pakken: data. Hoewel de economische argumenten voor veel op DALL-E gebaseerde apps zullen worden bepaald door de prijs en het beleid dat OpenAI vaststelt voor zijn API-gebruikers, zullen ze allemaal ongetwijfeld de beeldproductie bevorderen.

Laat een reactie achter