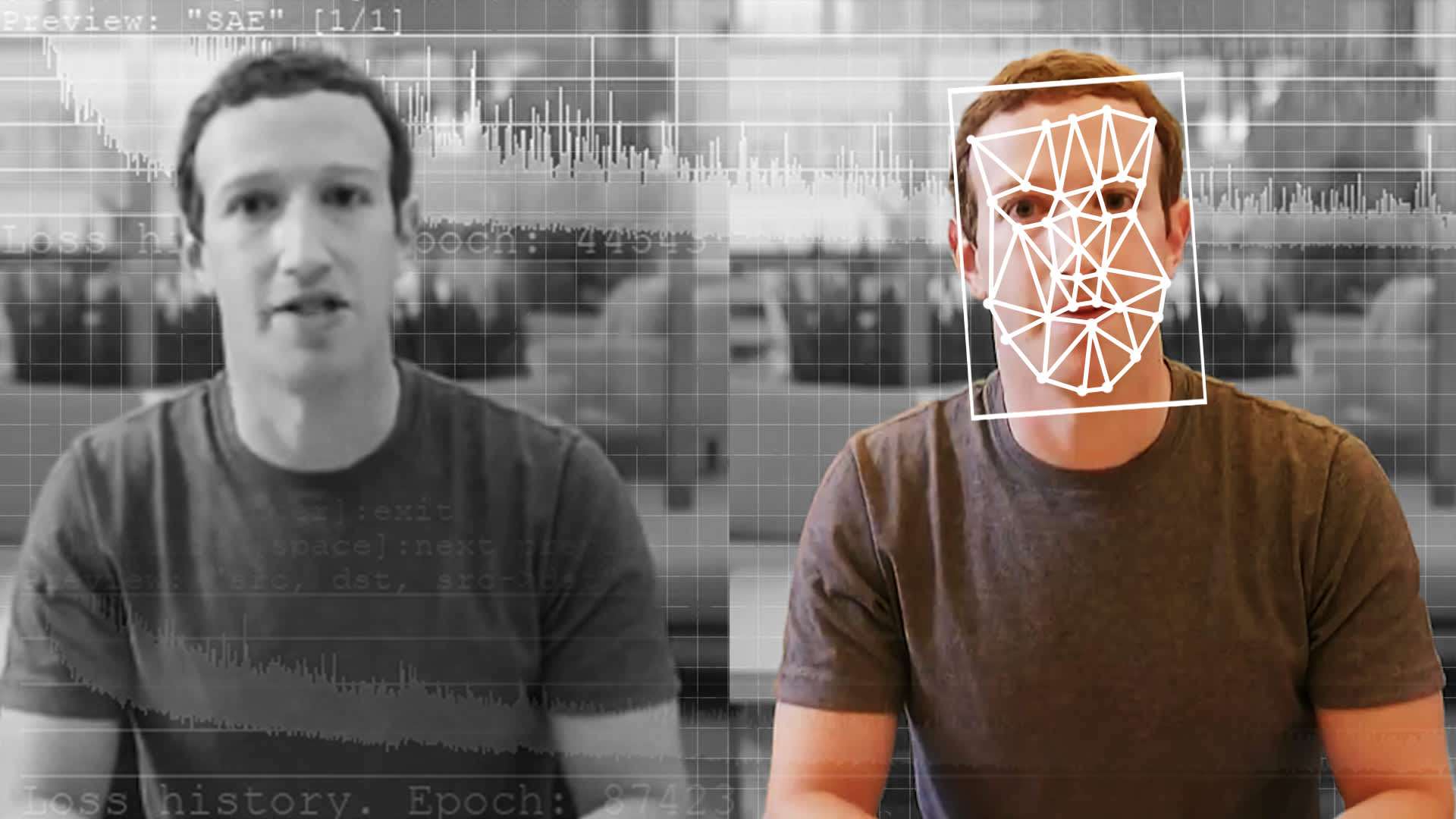

ဒေတာခိုးယူမှုကို အသိအမှတ်ပြုသည့် Mark Zuckerberg ၏ ဗီဒီယိုများနှင့် Donald Trump ကို အလွဲသုံးစားလုပ်သည့် Barack Obama သည် အင်တာနက်တွင် ပျံ့နှံ့နေသည်မှာ အချိန်အတော်ကြာနေပြီဖြစ်သည်။

ဤဗီဒီယိုများသည် Deepfake ဟုအမည်ပေးထားသော အလွန်အဆင့်မြင့်ပြီး အနာဂတ်တွင်ရှိသော AI နည်းပညာ၏ရလဒ်ဖြစ်သည်။

ရိုးရိုးရှင်းရှင်းပြောရလျှင် ၎င်းသည် ဗီဒီယိုအတွက် photoshop အခြားရွေးချယ်စရာတစ်ခုဖြစ်သည်။ တစ်ဖက်တွင်၊ ၎င်းသည် အမှန်တကယ်လူတစ်ဦးအတွက် လိုအပ်မှုကို ဖယ်ရှားခြင်းဖြင့် အီလက်ထရွန်းနစ်မီဒီယာကို တော်လှန်နိုင်သည်။

အခြားတစ်ဖက်တွင်၊ ၎င်းသည် ဗီဒီယိုတွင်မည်သူမဆိုပြောနိုင်သည့်အရာကို သင်ပြုလုပ်နိုင်သောကြောင့် လူတစ်ဦး၏အထောက်အထားကို ပြင်းထန်စွာခြိမ်းခြောက်သည်။

Deepfakes တွေသုံးတယ်။ နက်ရှိုင်းသောသင်ယူမှု ဖြစ်ရပ်အတုများ၏ ဓာတ်ပုံနှင့် ဗီဒီယိုများကို ဖန်တီးရန်၊ ထို့ကြောင့် Deepfake ဟု အမည်ပေးသည်။ ၎င်းသည် ရှိပြီးသားဗီဒီယိုများတွင် မျက်နှာများကို လဲလှယ်ရုံသာမက ဖရိမ်အသစ်များနှင့် ဗီဒီယိုများကို အစမှပြန်လည်ဖန်တီးနိုင်သည်။

Deepfakes ၏မူလအစ

ကျယ်ဝန်းသော ပညာရေးဆိုင်ရာသုတေသန ဓာတ်ပုံနှင့် ဗီဒီယို ခြယ်လှယ်ခြင်း၏ နယ်နိမိတ်များကို လွန်ခဲ့သည့် နှစ်အနည်းငယ်အတွင်း တွန်းပို့ခဲ့သည်။ Deepfake သည် ဤပညာရပ်ဆိုင်ရာ သုတေသနများ၏ ရလဒ်ဖြစ်သည်။

ဗီဒီယိုကို ခြယ်လှယ်ခြင်း၏ ပထမဆုံးဖြစ်ရပ်ကို 1997 ခုနှစ်တွင် အစီရင်ခံခဲ့သည်။ မတူညီသော အသံဖိုင်တွင်ပါရှိသော စကားလုံးများကို ပြောဆိုရန်အတွက် လူတစ်ဦး၏ ဗီဒီယိုကို ပြုပြင်မွမ်းမံခဲ့သည်။ ၎င်းသည် မျက်နှာကို ပြုပြင်ခြင်း၏ ပထမဆုံးသော ကိစ္စဖြစ်သည်။ စက်သင်ယူမှု နည်းစနစ်။

အမေရိကန်သမ္မတဟောင်း ဘားရက် အိုဘားမား၏ ဗီဒီယိုဖိုင်သည် မတူညီသော အသံလမ်းကြောင်းနှင့် ကိုက်ညီသော ကွဲပြားသော စကားလုံးများကို ပြောဆိုရန် ပြုပြင်မွမ်းမံလိုက်သောအခါတွင် သိသိသာသာ တိုးတက်မှု ရှိလာခဲ့သည်။

2018 ခုနှစ်တွင် Berkeley ကယ်လီဖိုးနီးယား တက္ကသိုလ်မှ သုတေသီများက ဖန်တီးနိုင်သည့် အက်ပ်တစ်ခုကို မိတ်ဆက်ခဲ့သည်။ နက်ရှိုင်းသောသင်ယူမှုကို အသုံးပြု၍ အကဗီဒီယိုအတု. ယခင်လက်ရာများသည် မျက်နှာများအတွက်သာ ကန့်သတ်ထားသောကြောင့်၊ ၎င်းသည် ခန္ဓာကိုယ်တစ်ခုလုံးတွင် အနက်ရောင်အတုများ ချဲ့ထွင်ခြင်းကို မှတ်သားထားသည်။

Deepfakes တွေကို ဘယ်လိုဖန်တီးသလဲ။

ကွန်ပြူတာတွင် တိုးတက်မှုများကြောင့် ယခုသင်သည် deepfakes များကို အလွယ်တကူနှင့် ကုန်ကျစရိတ်သက်သာစွာဖြင့် တီထွင်နိုင်ပြီဖြစ်သည်။ Deepfakes များထုတ်လုပ်ရန် အဓိကနည်းလမ်းနှစ်ခုကို အသုံးပြုသည်။

method ကို 1

လေ့ကျင့်ရပါလိမ့်မယ်။ အာရုံကြောကွန်ယက်ကို လူတစ်ယောက်ရဲ့ တကယ့်ဗီဒီယိုဖိုင်မှာ ဒါမှ ခွင့်ပြုမယ်။ အာရုံကြောကွန်ယက်ကို မတူညီသောထောင့်များနှင့် အလင်းရောင်အခြေအနေများတွင် အကြောင်းအရာ၏မျက်နှာသွင်ပြင်ကို နားလည်ရန်။

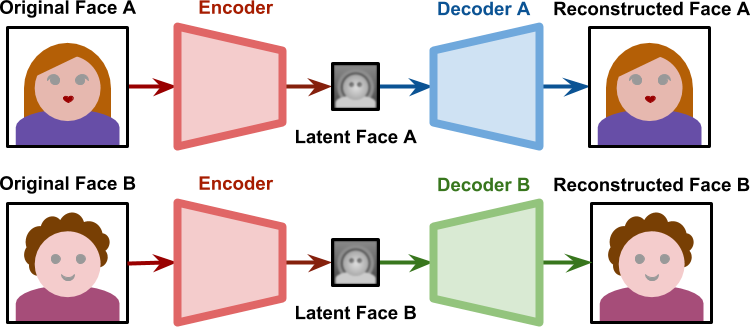

၎င်းနောက်၊ သင်သည် မူရင်းမျက်နှာနှင့် ငုပ်လျှိုးနေသောမျက်နှာ နှစ်ခုလုံးကို ကုဒ်ဝှက်ကိရိယာဟုခေါ်သော AI algorithm ဖြင့် လုပ်ဆောင်မည်ဖြစ်သည်။ ၎င်းသည် မျက်နှာနှစ်ခုကြားရှိ ကွဲပြားမှုနှင့် ဆင်တူမှုများကို တွေ့ရှိပြီး နှစ်ဖက်စလုံး၏ ဘုံအင်္ဂါရပ်များကို မျှဝေထားသော ချုံ့ထားသောပုံအဖြစ်သို့ လျှော့ချထားသည်။

ထို့နောက် ဖိသိပ်ထားသောပုံများမှ မျက်နှာများကို ပြန်လည်ရယူသည့် ဒုတိယ AI algorithm သည် decoder ဟုခေါ်သည်။ မျက်နှာနှစ်ခုလုံးကို မတူညီသော ဒီကုဒ်ကိရိယာနှစ်ခုဖြင့် ပြန်လည်ရယူသည်။

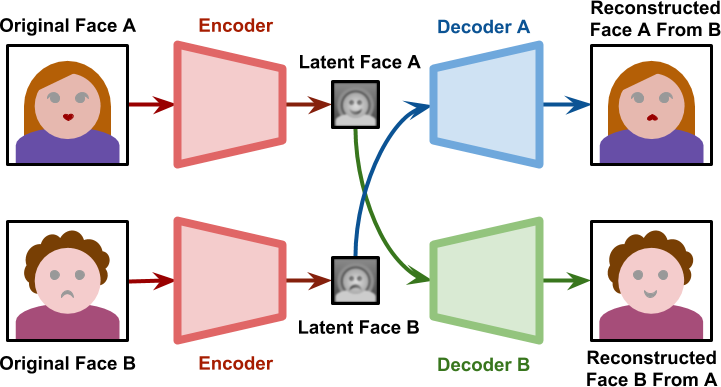

face swap ကိုလုပ်ဆောင်ရန်၊ သင်သည် ကုဒ်လုပ်ထားသော ပုံများကို အခြားသော ကုဒ်ဒါသို့ ထည့်ပေးရုံသာဖြစ်သည်။

ဥပမာအားဖြင့်၊ မျက်နှာ A ၏ ကုဒ်ပြောင်းကိရိယာ အထွက်ကို face B တွင် လေ့ကျင့်ထားသည့် ဒီကုဒ်ဒါသို့ ဖြည့်သွင်းပြီး မျက်နှာ B ၏ မျက်နှာသွင်ပြင်လက္ခဏာများနှင့် ပြန်လည်တည်ဆောက်ထားသည်။ ယုံကြည်စိတ်ချရသော ထွက်ပေါက်ရရှိရန်အတွက် ဗီဒီယိုဘောင်တိုင်းတွင် ၎င်းကို လုပ်ဆောင်ရမည်ဖြစ်သည်။

method ကို 2

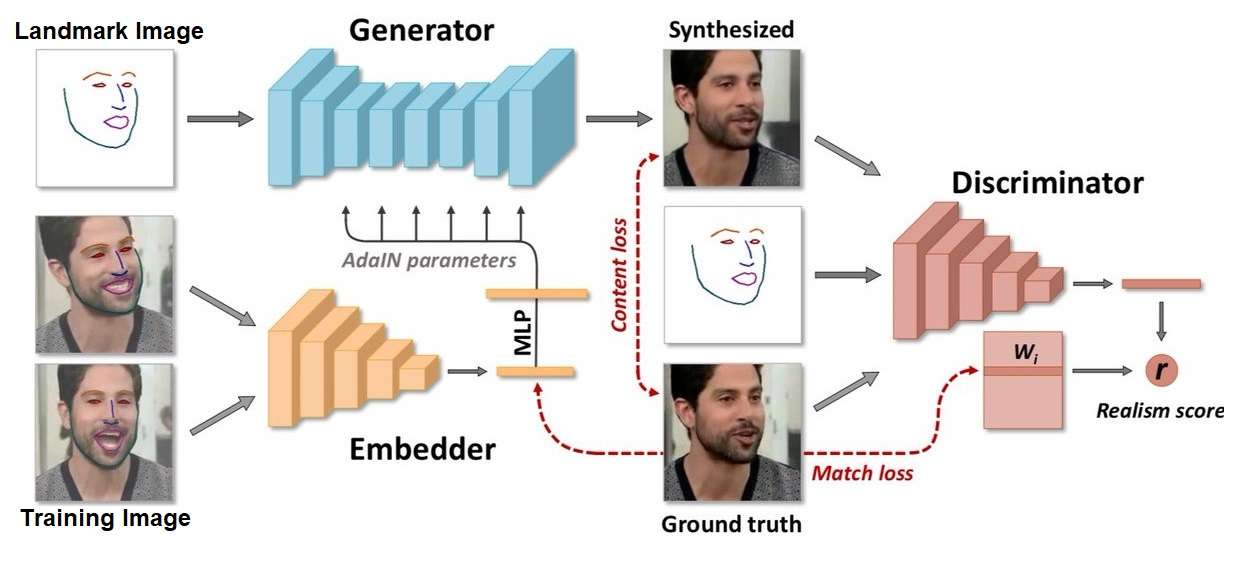

Deepfake များကိုထုတ်လုပ်ရန်နောက်ထပ်နည်းလမ်းမှာ Generative Adversarial Network (GAN) ဖြစ်သည်။

Deepfakes များထုတ်လုပ်ရန် ပြိုင်ဆိုင်သော algorithms နှစ်ခုကို သင်အသုံးပြုရပါမည်။ ပထမတစ်ခုသည် ပုံတစ်ပုံဖန်တီးရန် ကျပန်းဆူညံသံကို အသုံးပြုမည်ဖြစ်ပြီး ထို့ကြောင့် ၎င်းကို ဂျင်နရေတာဟုခေါ်သည်။ ဤပေါင်းစပ်ရုပ်ပုံအား ခွဲခြားဆက်ဆံခြင်းဟုခေါ်သော ဒုတိယ အယ်လဂိုရီသမ်တစ်ခုမှတစ်ဆင့် အစစ်အမှန်ရုပ်ပုံများစီးကြောင်းသို့ ပေးပို့သည်။

ခွဲခြားဆက်ဆံသူသည် တုံ့ပြန်ချက်နှင့်အညီ အခြားပုံတစ်ပုံကို ဖန်တီးပေးသည့် မီးစက်အား တုံ့ပြန်ချက်ပေးသည်။ ဤနည်းအားဖြင့်၊ အယ်လဂိုရီသမ်နှစ်ခုလုံးသည် ထပ်ခါတလဲလဲလုပ်ဆောင်ခြင်းဖြင့် တိုးတက်သောရလဒ်များကိုပေးသည်။ လိုအပ်သော တိကျမှုအဆင့်ကို မပြီးမချင်း ဤလုပ်ငန်းစဉ်ကို အကြိမ်များစွာ ထပ်ခါတလဲလဲ လုပ်ဆောင်သည်။

GAN သည် လုံး၀လက်တွေ့ကျသောရလဒ်များကို ပေးစွမ်းသော်လည်း ၎င်းသည် ခက်ခဲစွာလုပ်ဆောင်နိုင်ပြီး လေ့ကျင့်ရေးဒေတာနှင့် တွက်ချက်မှုစွမ်းအားများစွာ လိုအပ်ပါသည်။ ထို့ကြောင့် ဗီဒီယိုကလစ်များထက် ရုပ်ပုံများကို ဖန်တီးရန် ယေဘုယျအားဖြင့် ဦးစားပေးလေ့ရှိသည်။

Deepfakes ၏ယုံကြည်စိတ်ချရသောဥပမာအချို့

အင်တာနက်တစ်ဝိုက်တွင် လှည့်ပတ်နေသော အလွန်ယုံကြည်စရာကောင်းသော အတုအယောင်အချို့ရှိပြီး အများစုမှာ နာမည်ကြီးများဖြစ်သည်။

ဥပမာအားဖြင့်၊ Tom Cruise ၏ အတုအယောင်များအတွက်သာ ရည်ရွယ်ထားသော TikTok အကောင့်တစ်ခု ရှိပါသည်။ Cruise ဂေါက်ရိုက်ခြင်း သို့မဟုတ် မှော်လှည့်ကွက်ကို ပြသသည့် ဗီဒီယိုများ။

@deeptomcruise ခရီးသွား ! ????

နောက်ထပ် အလွန်ရှုပ်ထွေးသော Deepfake ကို Tom Cruise၊ Robert Downey Jr.၊ Jeff Goldblum၊ George Lucas နှင့် Ewan McGregor တို့နှင့်အတူ YouTube တွင် လွှင့်တင်ခဲ့သည်။ ၎င်းတွင် သိသာထင်ရှားသော ချို့ယွင်းချက်အချို့ရှိသော်လည်း ဗီဒီယိုတစ်ခုတွင် deepfakes 3 မှ 4 ခုကို တစ်ပြိုင်နက်တည်းလုပ်ဆောင်ခြင်းသည် သူ့ဘာသာသူလုပ်ဆောင်နိုင်မှုတစ်ခုဖြစ်သည်။

နောက်ဥပမာတစ်ခုကတော့ သမ္မတဟောင်း Barack Obama ရဲ့ အတုအယောင် ဗီဒီယိုတစ်ခုပါ။

ဤအရာသည် အကြောင်းအရာ၏ အသံများနှင့် အမူအရာများကို တုပနိုင်သော အယောင်ဆောင်သူများ၏ အသံများနှင့် အမူအရာများကို အသုံးပြုထားသောကြောင့် အံ့မခန်းယုံကြည်စရာဖြစ်သည်။

ယနေ့ခေတ် ခေတ်ရေစီးကြောင်း ဖျော်ဖြေရေးနယ်ပယ်တွင် နက်နဲသောအတုအယောင်များကို ကျွန်ုပ်တို့ တွေ့မြင်နေရသည်။

မင်းသားကြီး မထင်မှတ်ဘဲ သေဆုံးသွားပြီးနောက် Fast and Furious 7 တွင် Paul Walker ၏ ပြကွက်များကို ရိုက်ကူးရန် အသုံးပြုခဲ့သည်။ Deepfake ကို သူ့အစ်ကိုအပေါ် ထူးထူးခြားခြား တိကျစွာ အသုံးပြုခဲ့သည်။

Deepfakes က ဘာကို စားပွဲဆီ ယူဆောင်လာတာလဲ။

Deepfakes သည် မီဒီယာနှင့် ဖျော်ဖြေရေးတွင် တော်လှန်ရေးကို ယူဆောင်လာရန် အလွန်ယုံကြည်စိတ်ချရသော နည်းပညာတစ်ခုဖြစ်ကြောင်း သက်သေပြခဲ့သည်။

"Man of Steel" တွင် Henry Cavill ၏နှုတ်ခမ်းမွှေးကို CGI မှဖယ်ရှားခဲ့ပြီး ဘေးဥပဒ်တစ်ခုဖြစ်ခဲ့သည်ကို သင်မှတ်မိပါသလား။

ယခု အလားတူ ရလဒ်များကို ပိုမိုယုံကြည်စိတ်ချရသော ဒေါ်လာ ထောင်ဂဏန်းရှိသော ကွန်ပျူတာများတွင် လုပ်ဆောင်နိုင်ပြီဖြစ်သည်။

ယခု သင်ကွယ်လွန်သွားသော ဘိုးဘေးများနှင့် ချစ်ရသူများနှင့် တွေ့ဆုံနိုင်ပါပြီ။ Albert Einstein ကိုယ်တိုင်က Physics ဟောပြောပွဲကိုတောင် တက်ရောက်နိုင်ပါတယ်။

ဒါတွေအားလုံးအပြင်၊ Deepfake ကို ရည်ရွယ်ထားတဲ့ပုံစံနဲ့ လုံးဝအသုံးမပြုပါဘူး။ အင်တာနက်ပေါ်ရှိ အတုအယောင်များ၏ 96% ခန့်သည် အများသဘောတူမဟုတ်သော ညစ်ညမ်းရုပ်ပုံများဖြစ်သည်။

နာမည်ကြီးများအတွက် ရရှိနိုင်သော လေ့ကျင့်ရေးဒေတာ အမြောက်အမြားကြောင့် ၎င်းတို့သည် deepfakes များ၏ ပစ်မှတ်အထားဆုံး သားကောင်များဖြစ်လာစေသည်။

၎င်းသည် ကျွန်ုပ်တို့အား အန္တရာယ်ရှိသော သို့မဟုတ် အပေးအယူလုပ်နိုင်သော အခြေအနေများတွင် ထားနိုင်စေခဲ့ပြီး ထို့ကြောင့် လူတိုင်းအတွက် ကြီးစွာသောအန္တရာယ်ဖြစ်စေပါသည်။

Audio deepfakes များကို scam corporations များတွင် အသုံးပြုသည်ဟု အစီရင်ခံထားပါသည်။ 2019 ခုနှစ်တွင် အယောင်ဆောင်သူတစ်ဦးသည် ကုမ္ပဏီ၏မိခင်ကုမ္ပဏီအမှုဆောင်အရာရှိကို အယောင်ဆောင်ကာ ဟန်ဂေရီဘဏ်သို့ ယူရို 220,000 လွှဲပြောင်းရန် ယူကေအခြေစိုက်ကုမ္ပဏီ CEO တစ်ဦးအား ညွှန်ကြားရန် နက်နဲသောအသံအတုကို အသုံးပြုခဲ့သည်။

Malicious Deepfakes ကို ဘယ်လို တန်ပြန်မလဲ။

ပုံမှန်အားဖြင့်၊ သင်သည် ဘောင်အလိုက် ဘောင်ကို အလေးအနက်ထား၍ အတုအယောင် ဗီဒီယိုများကို ရှာဖွေနိုင်ပြီး အတုအယောင်များနှင့် မမှန်မှုများကို ရှာဖွေနိုင်သည်။

သို့သော်၊ ၎င်းသည် တန်ပြန်အလိုလိုသိနိုင်သော လုပ်ငန်းစဉ်တစ်ခုဖြစ်ပြီး ကုမ္ပဏီများစွာသည် algorithms နှင့် software များကို လုပ်ဆောင်နေပါသည်။ deepfakes ကိုရှာဖွေပါ။.

Facebook သည် deepfake detector ကိုတည်ဆောက်ရန်အတွက် Berkeley၊ Oxford နှင့် အခြားအဖွဲ့အစည်းများမှ သုတေသီများကို ခေါ်ယူခဲ့သည်။ အလားတူပင်၊ YouTube သည် US ရွေးကောက်ပွဲ၊ မဲပေးခြင်းဆိုင်ရာ လုပ်ထုံးလုပ်နည်းများ သို့မဟုတ် 2020 ခုနှစ် အမေရိကန်သန်းခေါင်စာရင်းဆိုင်ရာ နက်ရှိုင်းသောအတုအယောင်ဗီဒီယိုများကို လက်ခံမည်မဟုတ်ကြောင်း ကြေညာခဲ့သည်။

အစရှိတဲ့ ပရိုဂရမ်တွေကိုလည်း အသုံးပြုနိုင်ပါတယ်။ Reality Defender နှင့် Deeptrace သည် deepfakes ကိုရှာဖွေရန်။

နိုင်ငံများသည် ယေဘုယျအားဖြင့် deepfakes အသုံးပြုခြင်းနှင့် ပတ်သက်၍ ဥပဒေပြုရာတွင်လည်း အလုပ်ရှုပ်နေကြသည်။ အမေရိကန်သည် လွန်ခဲ့သည့်နှစ်အတွင်း အတုလုပ်ခြင်းဆိုင်ရာ ဥပဒေအများအပြားကို အကောင်အထည်ဖော်ခဲ့သည်။

အပြီးသတ်သည်

Deepfake သည် AI ၏တိုးတက်မှု၏ရှင်သန်ရပ်တည်ချက်ဖြစ်သည်။ ၎င်းသည် အနာဂတ်၏ နယ်နိမိတ်ကို ပိုမိုမှုန်ဝါးစေသော်လည်း၊ ၎င်းသည် အင်တာနက်ပေါ်ရှိ ဗီဒီယိုဂရပ်ဖစ်အကြောင်းအရာများ၏ ယုံကြည်စိတ်ချရမှုကို ခြိမ်းခြောက်မှုတစ်ခုဖြစ်သည်။

အင်တာနက်ပေါ်ရှိ ဗီဒီယိုတိုင်းကို လူအများက သံသယဝင်လာပြီး ကျွန်ုပ်တို့သည် နောက်ထပ်မသေချာမရေရာသည့်ခေတ်သို့ တွန်းပို့ခံရမည့်အချိန်တစ်ခုဖြစ်သည်။

တစ်ဦးစာပြန်ရန် Leave