Можеби сте слушнале за тоа колку моќни станаа моделите со вештачка интелигенција текст-во-слика во изминатите неколку години. Но, дали знаевте дека истата технологија може да помогне да се направи скок од 2D во 3D?

3D моделите генерирани со вештачка интелигенција имаат широка употреба во денешниот дигитален пејзаж. Видео игри и филмот се потпираат на вешти 3D уметници и софтвер за моделирање, како што е Blender, за да создадат 3D средства за да ги населат сцените генерирани од компјутер.

Сепак, дали е можно индустријата да користи машинско учење за да создаде 3Д средства со помалку напор, слично како што 2Д уметниците денес почнуваат да ја прифаќаат технологијата како што се DALL-E и Средно патување?

Оваа статија ќе истражи нов алгоритам кој се обидува да создаде ефективен модел од текст во 3D користејќи постоечки модели на дифузија.

Што е Dreamfusion?

Еден главен проблем со креирањето на дифузен модел кој директно генерира 3D средства е тоа што едноставно нема многу достапни 3D податоци. Моделите на 2D дифузија станаа толку моќни поради огромниот сет на слики пронајдени на Интернет. Истото не може да се каже со 3D средства.

Некои 3D генеративни техники работат околу овој недостаток на податоци со искористување на ова изобилство на 2D податоци.

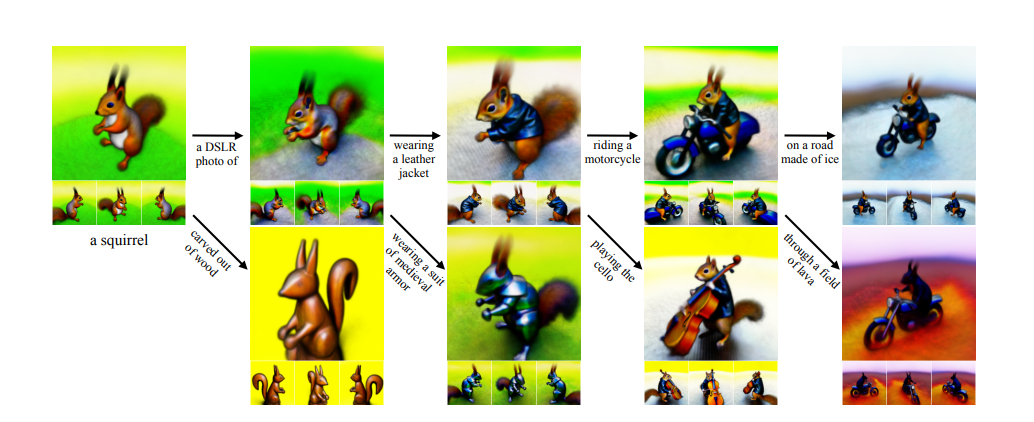

DreamFusion е генеративен модел кој може да креира 3D модели врз основа на обезбеден текстуален опис. Моделот DreamFusion користи претходно обучен модел на дифузија од текст во слика за да генерира реални тродимензионални модели од текстуални инструкции.

И покрај тоа што нема 3D податоци за обука, овој пристап генерира кохерентни 3D средства со висок изглед и длабочина.

Како работи?

Алгоритмот DreamFusion се состои од два главни модели: 2D дифузен модел и невронска мрежа што може да конвертира 2D слики во кохезивна 3D сцена.

Моделот „Текст во слика“ на „Имиџен“ на „Гугл“.

Првиот дел од алгоритмот е моделот на дифузија. Овој модел е одговорен за конвертирање на текст во слики.

Сликата е дифузен модел кој може да генерира голем примерок од варијации на сликата на одреден објект. Во овој случај, нашите варијации на сликата треба да ги покриваат сите можни агли на дадениот објект. На пример, ако сакаме да генерираме 3Д модел на коњ, би сакале 2Д слики од коњот од сите можни агли. Целта е да се користи Imagen за да се обезбедат што е можно повеќе информации (бои, рефлексии, густина) за следниот модел во нашиот алгоритам.

Креирање 3D модели со NeRF

Следно, Dreamfusion користи модел познат како a Неврално зрачење поле или NeRF за всушност да се создаде 3D модел од генерираниот сет на слики. NeRF се способни да создаваат сложени 3D сцени со сет на податоци од 2D слики.

Ајде да се обидеме да разбереме како функционира NeRF.

Моделот има за цел да создаде континуирана волуметриска функција на сцената оптимизирана од обезбедената база на податоци од 2D слики.

Ако моделот креира функција, кои се влезните и излезните?

Функцијата на сцената зема 3D локација и 2D насока на гледање како влез. Функцијата потоа дава боја (во форма на RGB) и одредена густина на волуменот.

За да генерира 2Д слика од одредена гледна точка, моделот ќе генерира множество од 3D точки и ќе ги помине тие точки низ функцијата на сцената за да врати збир на вредности за густина на боја и волумен. Техниките за рендерирање на јачината на звукот потоа ќе ги претворат тие вредности во 2D излез на слика.

Заедно користење NeRF и 2D дифузија модели

Сега кога знаеме како функционира NeRF, ајде да видиме како овој модел може да генерира точни 3D модели од нашите генерирани слики.

За секое обезбедено текстуално известување, DreamFusion тренира случајно иницијализиран NeRF од нула. Секоја итерација избира случајна позиција на камерата во збир на сферични координати. Помислете на моделот спакуван во стаклена сфера. Секој пат кога ќе генерираме нова слика на нашиот 3D модел, ќе избираме случајна точка во нашата сфера како гледна точка на нашиот излез. DreamFusion ќе избере и случајна позиција на светлина l да се користи за рендерирање.

Откако ќе имаме позиција на камера и светлина, ќе се прикаже моделот NeRF. DreamFusion, исто така, по случаен избор ќе избира помеѓу рендер во боја, рендер без текстура и рендерирање на албедото без никакво засенчување.

Претходно спомнавме дека сакаме нашиот модел текст-на-слика (Imagen) да произведе доволно слики за да создаде репрезентативен примерок.

Како Dreamfusion го постигнува ова?

Dreamfusion едноставно малку го модифицира влезното известување за да ги постигне предвидените агли. На пример, можеме да постигнеме високи агли на височина со додавање „надземен поглед“ на нашата порака. Можеме да генерираме други агли со додавање фрази како „преден поглед“, „страничен поглед“ и „заден поглед“.

Сцените постојано се прикажуваат од случајни позиции на камерата. Овие рендери потоа минуваат низ функцијата за губење на дестилација. Едноставен пристап со спуштање со градиент полека ќе го подобри 3Д модел додека не се совпадне со сцената опишана во текстот.

Откако ќе го рендерираме 3D моделот користејќи NeRF, можеме да го користиме Алгоритам за марширање коцки за излез на 3D мрежа од нашиот модел. Оваа мрежа потоа може да се увезе во популарни 3D рендери или софтвер за моделирање.

Ограничувања

Додека излезот на DreamFusion е доволно импресивен бидејќи ги користи постоечките модели на дифузија од текст во слика на нов начин, истражувачите забележаа неколку ограничувања.

Забележано е дека функцијата за губење на SDS произведува презаситени и преизмазнети резултати. Можете да го забележите ова во неприродната боја и недостатокот на прецизни детали пронајдени во излезите.

Алгоритмот DreamFusion е исто така ограничен со резолуцијата на излезот од моделот Imagen, кој е 64 x 64 пиксели. Ова води кон синтетизираните модели да немаат пофини детали.

Конечно, истражувачите забележаа дека постои вроден предизвик во синтетизирањето на 3D модели од 2D податоци. Постојат многу можни 3D модели кои можеме да ги генерираме од збир на 2D слики, што ја прави оптимизацијата доста тешка, па дури и двосмислена.

Заклучок

3D рендерите на DreamFusion работат толку добро поради способноста на моделите за дифузија од текст во слика да создадат кој било објект или сцена. Импресивно е како невронската мрежа може да разбере сцена во 3D простор без никакви 3D податоци за обука. Препорачувам да го прочитате цела хартија за да дознаете повеќе за техничките детали на алгоритмот DreamFusion.

Се надеваме дека оваа технологија ќе се подобри за на крајот да создаде фотореалистични 3D модели. Замислете цели видео игри или симулации кои користат средини генерирани од вештачка интелигенција. Може да ја намали бариерата за влез за развивачите на видео игри да создадат извонредни 3D светови!

Што мислите, каква улога ќе играат моделите од текст во 3Д во иднина?

Оставете Одговор