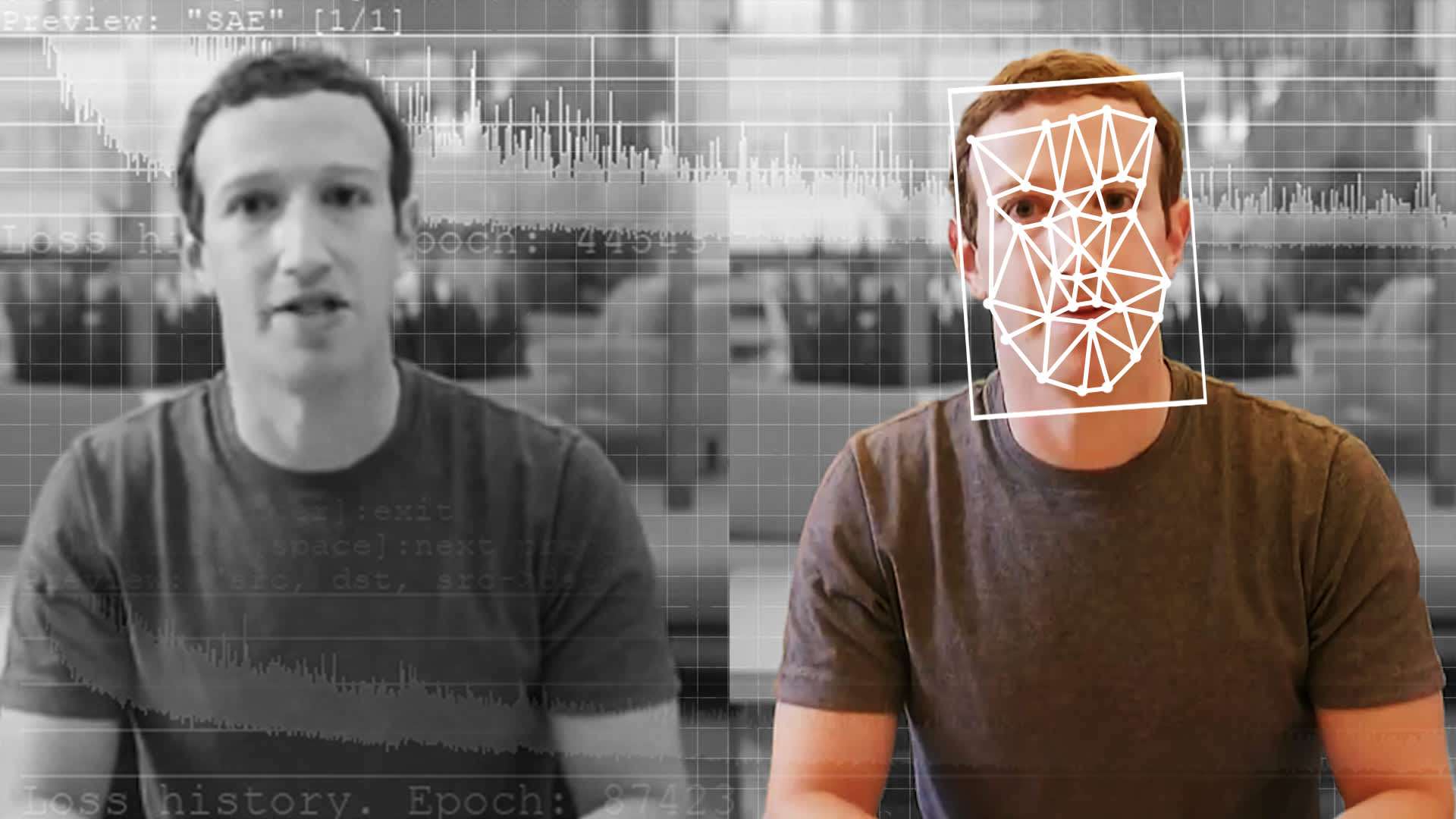

Vaizdo įrašai, kuriuose Markas Zuckerbergas pripažįsta duomenų vagystę ir Barackas Obama piktnaudžiauja Donaldu Trumpu, jau seniai sklando internete?

Šie vaizdo įrašai yra labai pažangios ir futuristinės AI technologijos, pavadintos Deepfake, rezultatas.

Paprasčiau tariant, tai yra „Photoshop“ alternatyva vaizdo įrašams. Viena vertus, tai gali pakeisti elektroninę žiniasklaidą, nes nebereikia tikro žmogaus.

Kita vertus, tai kelia rimtą grėsmę asmens tapatybei, nes vaizdo įraše galite priversti bet ką pasakyti.

Deepfakes naudojimas gilus mokymasis sukurti suklastotų įvykių nuotraukas ir vaizdo įrašus, todėl pavadinimas „deepfake“. Jis gali ne tik sukeisti veidus esamuose vaizdo įrašuose, bet ir kurti naujus kadrus bei vaizdo įrašus nuo nulio.

Deepfakes kilmė

Platus moksliniai tyrimai per pastaruosius kelerius metus peržengė nuotraukų ir vaizdo įrašų manipuliavimo ribas. Deepfake taip pat yra šių akademinių tyrimų rezultatas.

Pirmasis vaizdo manipuliavimo atvejis buvo praneštas 1997 m. Vaizdo įrašas, kuriame užfiksuotas asmuo, buvo pakeistas taip, kad ištartų žodžius, esančius kitame garso takelyje. Tai buvo pirmasis veido reanimacijos atvejis mašininis mokymasis technika.

2017 m. buvo padaryta dar didesnė pažanga, kai buvusio JAV prezidento Baracko Obamos vaizdo įrašas buvo pakeistas, kad būtų galima kalbėti skirtingus žodžius, atitinkančius skirtingą garso takelį.

2018 metais Kalifornijos universiteto Berklyje mokslininkai pristatė programėlę, kuri galėtų sukurti a netikras šokių vaizdo įrašas naudojant gilųjį mokymąsi. Tai reiškė gilių padirbinių išplėtimą visame kūne, nes ankstesni darbai apsiribojo veidais.

Kaip sukuriami „Deepfake“?

Dėl pažangos kompiuterijos srityje galite palyginti lengvai ir už mažą kainą sukurti giliuosius klastotes. Deepfake generuoti naudojami du pagrindiniai metodai.

Metodas 1

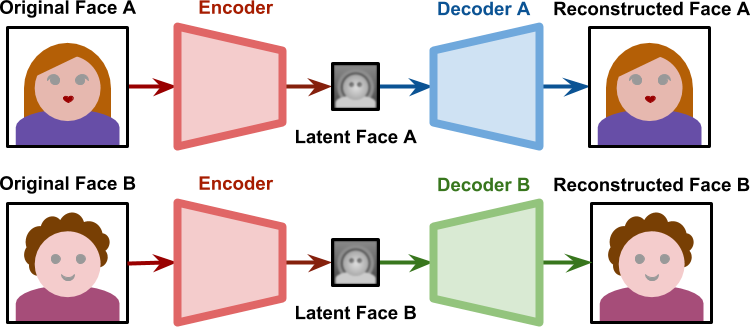

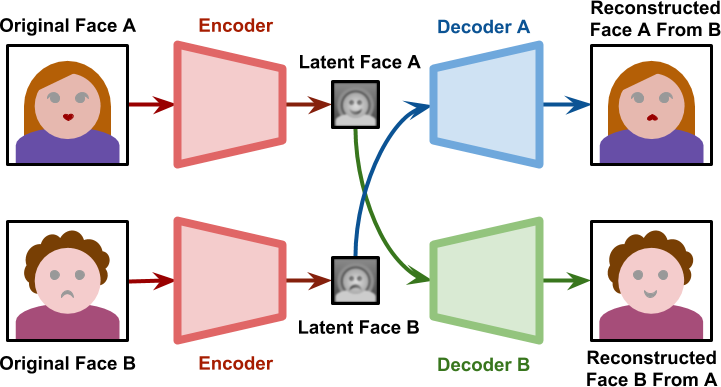

Teks treniruoti a neuroninis tinklas tikroje asmens vaizdo medžiagoje. Tai leis neuroninis tinklas suprasti tiriamojo veido bruožus skirtingais kampais ir apšvietimo sąlygomis.

Po to apdorosite pradinį ir latentinį veidą naudodami AI algoritmą, vadinamą koduotuvu. Jis suras ir išmoks dviejų veidų skirtumus ir panašumus, o abu veidai bus sutrumpinti iki suglaudinto vaizdo, turinčio bendras savybes.

Tada ateina antrasis AI algoritmas, vadinamas dekoderiu, kuris atkuria veidus iš suspaustų vaizdų. Abu veidus atkuria du skirtingi dekoderiai.

Norėdami pakeisti veidus, tiesiog įveskite užkoduotus vaizdus į kitą dekoderį.

Pavyzdžiui, A veido kodavimo įrenginio išvestis įvedama į B veidą apmokytą dekoderį, kuris vėliau atkuria veidą B su veido A veido bruožais. Tai turėsite atlikti kiekviename vaizdo įrašo kadre, kad išvestis būtų įtikinama.

Metodas 2

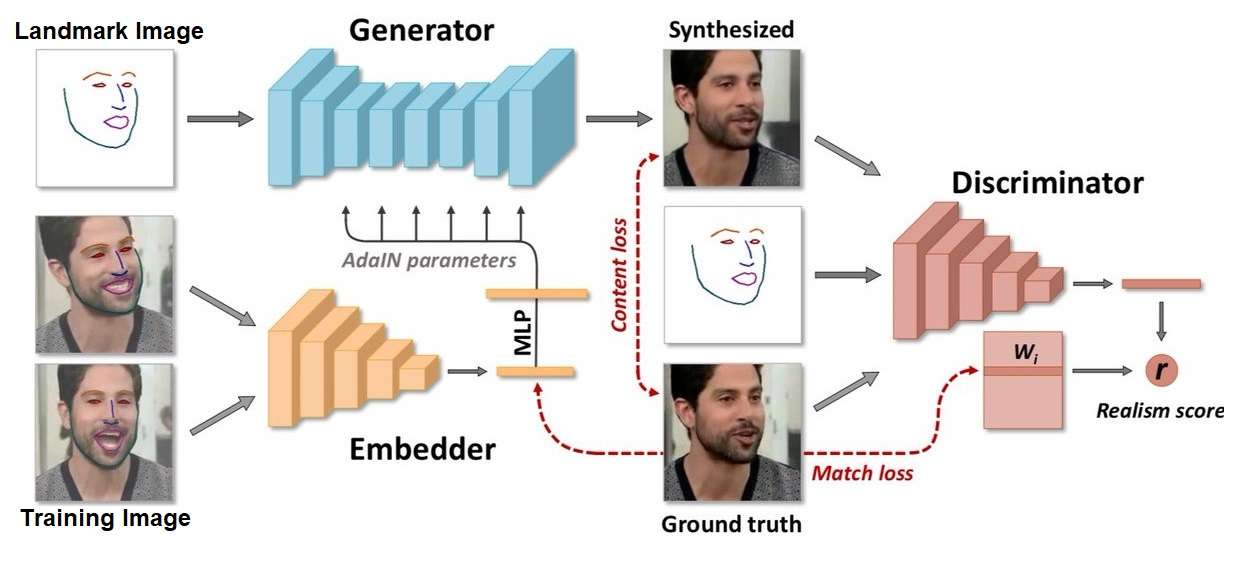

Kitas giliųjų klastotės generavimo būdas yra generatyvinis priešpriešinis tinklas (GAN).

Norėdami generuoti gilius klastojimus, turėsite naudoti du konkuruojančius algoritmus. Pirmasis naudos atsitiktinį triukšmą, kad sukurtų vaizdą, todėl jis vadinamas generatoriumi. Šis sintetinis vaizdas perduodamas realių vaizdų srautui per antrąjį algoritmą, vadinamą diskriminatoriumi.

Diskriminatorius pateikia grįžtamąjį ryšį generatoriui, kuris generuoja kitą vaizdą pagal grįžtamąjį ryšį. Tokiu būdu abu algoritmai suteikia geresnių rezultatų su kiekviena iteracija. Šis procesas kartojamas daug kartų, kol pasiekiamas reikiamas tikslumo lygis.

GAN duoda visiškai tikroviškus rezultatus, tačiau su ja dirbti sunku ir reikalingas didžiulis treniruočių duomenų kiekis ir skaičiavimo galia. Štai kodėl jis dažniausiai naudojamas vaizdams, o ne vaizdo klipams kurti.

Keletas įtikinamų Deepfakes pavyzdžių

Internete sukasi keletas labai įtikinamų padirbinių, ir dauguma jų yra įžymybių.

Pavyzdžiui, yra „TikTok“ paskyra, skirta tik Tomo Cruise'o klastotėms. Vaizdo įrašuose rodomas Kruizas, žaidžiantis golfą arba demonstruojantis magišką triuką.

@deeptomcruise Kelionė! ????

Kitas labai sudėtingas padirbinys buvo įkeltas į „YouTube“ kartu su Tomu Cruise'u, Robertu Downey jaunesniuoju, Jeffu Goldblumu, George'u Lucasu ir Ewanu McGregoru. Jis turi tam tikrų akivaizdžių trūkumų, tačiau vienu metu apdoroti 3–4 gilius klastotes vaizdo įraše yra pats žygdarbis.

Kitas pavyzdys – buvusio prezidento Baracko Obamos vaizdo įrašas.

Tai stulbinamai įtikinama, nes jame naudojami apsimetinėlių balsai ir gestai, galintys imituoti subjekto balsus ir gestus.

Šiuolaikinėje pramogų pramonėje dabar matome gilias klastotes.

Jis buvo naudojamas filmuojant Paulo Walkerio scenas filme „Greiti ir įsiutę 7“ po netikėtos aktoriaus mirties. Deepfake buvo panaudotas jo broliui nepaprastai tiksliai.

Ką „Deepfakes“ pateikia ant stalo?

Deepfakes pasirodė esąs labai patikima technologija, sukėlusi žiniasklaidos ir pramogų revoliuciją.

Ar prisimenate, kai Henry Cavill ūsus pašalino CGI filme „Žmogus iš plieno“ ir tai buvo nelaimė?

Tą patį dabar galima padaryti naudojant kelis tūkstančius dolerių kainuojančius kompiuterius ir gauti daug įtikinamesnių rezultatų.

Dabar galite susitikti su savo mirusiais protėviais ir artimaisiais. Jūs netgi galite lankyti paties Alberto Einšteino fizikos paskaitą.

Be viso to, „deepfake“ nebuvo visiškai panaudotas taip, kaip buvo numatyta. Maždaug 96 % padirbinėjimo internete yra pornografija be sutikimo.

Dėl didelio įžymybių mokymo duomenų kiekio jos tapo tiksliniausiomis giliųjų klastočių aukomis.

Tai leido mums patekti į pavojingus arba pavojingus scenarijus, todėl tai kelia didelį pavojų visiems.

Pranešama, kad garso klastotės buvo naudojamos korporacijoms apgauti. 2019 m. apsimetėlis panaudojo gilų netikrą garsą, norėdamas nurodyti JK įsikūrusios įmonės generaliniam direktoriui pervesti 220,000 XNUMX EUR į Vengrijos banką, apsimetant įmonės pagrindinės įmonės vadovu.

Kaip kovoti su kenkėjiškomis giliosiomis klastotėmis?

Paprastai galite aptikti netikrus vaizdo įrašus atidžiai stebėdami kadrą po kadro ir ieškodami artefaktų bei pažeidimų.

Tačiau tai prieštarauja intuityviam procesui, todėl daugelis įmonių dirba su algoritmais ir programine įranga aptikti gilius klastojimus.

„Facebook“ pasamdė tyrėjus iš Berklio, Oksfordo ir kitų institucijų, kad sukurtų gilaus padirbinėjimo detektorių. Panašiai „YouTube“ paskelbė, kad nepriims netikrų vaizdo įrašų, susijusių su JAV rinkimais, balsavimo procedūromis ar 2020 m. JAV surašymu.

Taip pat galite naudoti tokias programas kaip Realybės gynėjas ir Deeptrace, kad aptiktų gilius klastojimus.

Šalys taip pat yra užsiėmusios įstatymų leidyba, susijusia su giliųjų klastočių naudojimu apskritai. Per pastaruosius metus JAV įgyvendino keletą įstatymų, susijusių su giliomis klastotėmis.

Apvynioti

Deepfake yra gyvas AI pažangos įsikūnijimas. Tai dar labiau ištrina ateities ribas, tačiau tai gali kelti grėsmę vaizdo grafinio turinio internete patikimumui.

Ateis laikas, kai žmonės pradės abejoti kiekvienu vaizdo įrašu internete, ir mes būsime nustumti į tolesnio netikrumo erą.

Palikti atsakymą