Turinys[Slėpti][Rodyti]

Ateitis yra čia. Ir šioje ateityje mašinos suvoks juos supantį pasaulį taip pat, kaip ir žmonės. Kompiuteriai gali vairuoti automobilius, diagnozuoti ligas ir tiksliai numatyti ateitį.

Tai gali atrodyti kaip mokslinė fantastika, tačiau gilaus mokymosi modeliai paverčia tai realybe.

Šie sudėtingi algoritmai atskleidžia paslaptis dirbtinis intelektas, leidžiantis kompiuteriams savarankiškai mokytis ir tobulėti. Šiame įraše pasinersime į giluminio mokymosi modelių sritį.

Ir mes ištirsime didžiulį jų potencialą pakeisti mūsų gyvenimą. Pasiruoškite sužinoti apie pažangiausias technologijas, kurios keičia žmonijos ateitį.

Kas iš tikrųjų yra giluminio mokymosi modeliai?

Ar kada nors žaidėte žaidimą, kuriame turite nustatyti dviejų vaizdų skirtumus?

Tačiau tai smagu, bet gali būti ir sunku, tiesa? Įsivaizduokite, kad galite išmokyti kompiuterį žaisti tą žaidimą ir kiekvieną kartą laimėti. Gilaus mokymosi modeliai būtent tai ir pasiekia!

Giluminio mokymosi modeliai yra panašūs į ypač išmaniąsias mašinas, kurios gali ištirti daugybę vaizdų ir nustatyti, ką jie turi bendro. Jie tai pasiekia išardydami vaizdus ir tyrinėdami kiekvieną atskirai.

Tada jie taiko tai, ką išmoko, kad nustatytų modelius ir prognozuotų naujus vaizdus, kurių jie niekada anksčiau nematė.

Giluminio mokymosi modeliai yra dirbtiniai neuroniniai tinklai, kurie gali išmokti ir išgauti sudėtingus modelius bei charakteristikas iš didžiulių duomenų rinkinių. Šiuos modelius sudaro keli susietų mazgų arba neuronų sluoksniai, kurie analizuoja ir keičia gaunamus duomenis, kad sukurtų išvestį.

Giluminio mokymosi modeliai ypač tinka darbams, kuriems reikalingas didelis tikslumas, pavyzdžiui, vaizdo identifikavimas, kalbos atpažinimas, natūralios kalbos apdorojimas ir robotika.

Jie buvo naudojami visur – nuo savarankiškai važiuojančių automobilių iki medicininės diagnostikos, rekomendacijų sistemų ir nuspėjamoji analizė.

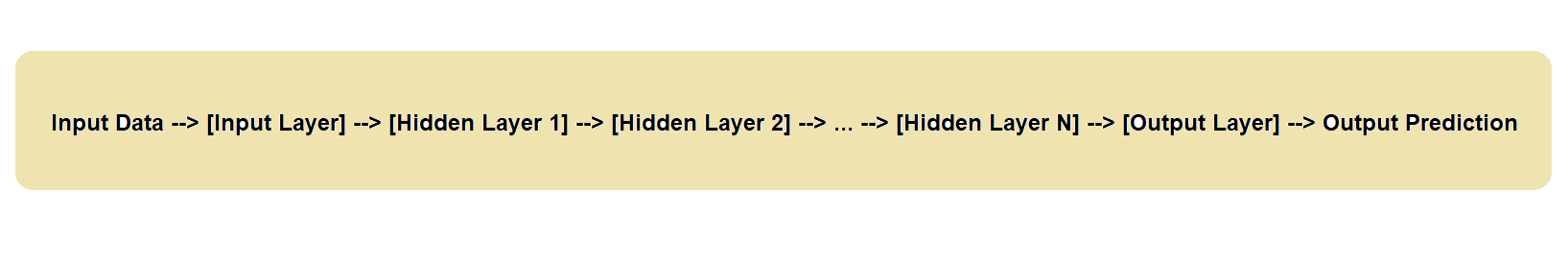

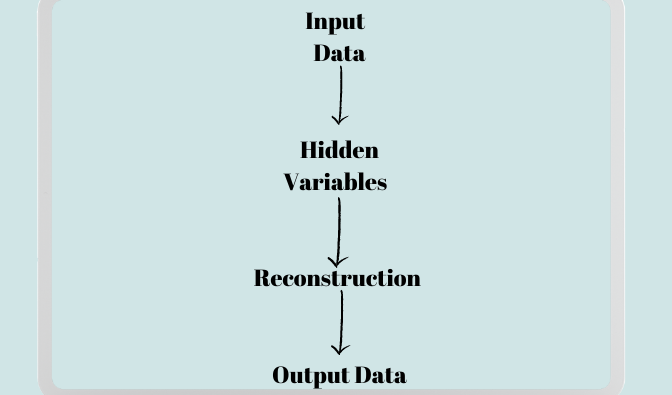

Štai supaprastinta vizualizacijos versija, skirta iliustruoti duomenų srautą gilaus mokymosi modelyje.

Įvesties duomenys patenka į modelio įvesties sluoksnį, kuris tada perduoda duomenis per keletą paslėptų sluoksnių prieš pateikdamas išvesties prognozę.

Kiekvienas paslėptas sluoksnis atlieka keletą matematinių operacijų su įvesties duomenimis, prieš perduodamas juos kitam sluoksniui, kuris pateikia galutinę prognozę.

Dabar pažiūrėkime, kas yra giluminio mokymosi modeliai ir kaip galime juos panaudoti savo gyvenime.

1. Konvoliuciniai neuroniniai tinklai (CNN)

CNN yra gilaus mokymosi modelis, pakeitęs kompiuterinio matymo sritį. CNN naudojami vaizdams klasifikuoti, objektams atpažinti ir vaizdams segmentuoti. Žmogaus regėjimo žievės struktūra ir funkcija lėmė CNN dizainą.

Kaip jie veikia?

CNN yra sudarytas iš kelių konvoliucinių sluoksnių, telkinių sluoksnių ir visiškai susietų sluoksnių. Įvestis yra vaizdas, o išvestis yra vaizdo klasės etiketės numatymas.

CNN konvoliuciniai sluoksniai sukuria funkcijų žemėlapį, atlikdami taškinį sandaugą tarp įvesties paveikslėlio ir filtrų rinkinio. Sujungimo sluoksniai sumažina objekto žemėlapio dydį sumažindami jo atranką.

Galiausiai, objektų žemėlapį naudoja visiškai sujungti sluoksniai, kad nuspėtų vaizdo klasės etiketę.

Kodėl CNN yra svarbūs?

CNN yra būtini, nes jie gali išmokti aptikti vaizdų modelius ir ypatybes, kurias žmonėms sunku pastebėti. CNN galima išmokyti atpažinti tokias charakteristikas kaip kraštai, kampai ir tekstūros naudojant didelius duomenų rinkinius. Sužinojęs apie šias savybes, CNN gali jas naudoti, kad nustatytų objektus naujose nuotraukose. CNN pademonstravo pažangiausią našumą įvairiose vaizdo identifikavimo programose.

Kur mes naudojame CNN

Sveikatos priežiūra, automobilių pramonė ir mažmeninė prekyba yra tik keli sektoriai, kuriuose dirba CNN. Sveikatos priežiūros pramonėje jie gali būti naudingi diagnozuojant ligas, kuriant vaistus ir analizuojant medicininį vaizdą.

Automobilių sektoriuje jie padeda aptikti eismo juostas, objekto aptikimas, ir autonominis vairavimas. Jie taip pat labai naudojami mažmeninėje prekyboje vizualinei paieškai, vaizdiniais produktų rekomendacijoms ir atsargų kontrolei.

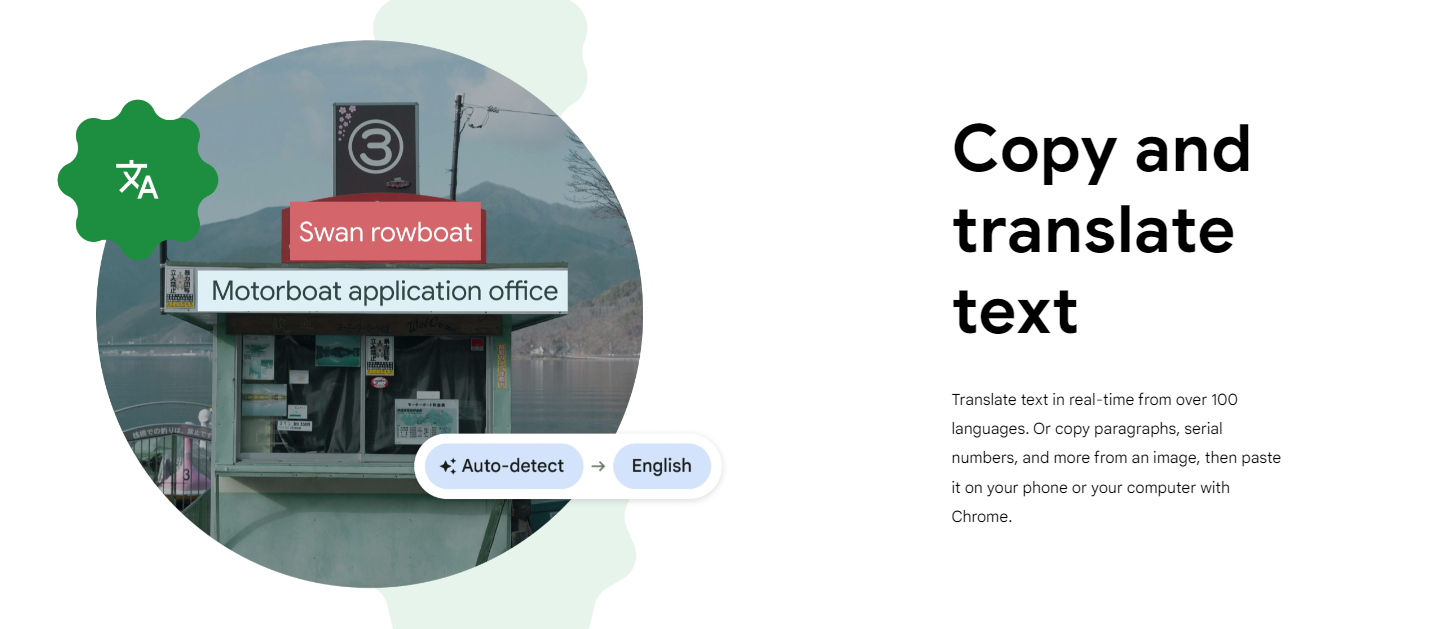

Pavyzdžiui; „Google“ naudoja CNN įvairiose programose, įskaitant "Google" objektyvas, mėgstama vaizdo identifikavimo priemonė. Programa naudoja CNN, kad įvertintų nuotraukas ir pateiktų vartotojams informaciją.

Pavyzdžiui, „Google Lens“ gali atpažinti daiktus vaizde ir pasiūlyti išsamios informacijos apie juos, pvz., gėlės tipą.

Jis taip pat gali išversti iš paveikslėlio ištrauktą tekstą į kelias kalbas. „Google Lens“ gali suteikti vartotojams naudingos informacijos, nes CNN padeda tiksliai identifikuoti elementus ir išgauti iš nuotraukų charakteristikas.

2. Ilgosios trumpalaikės atminties (LSTM) tinklai

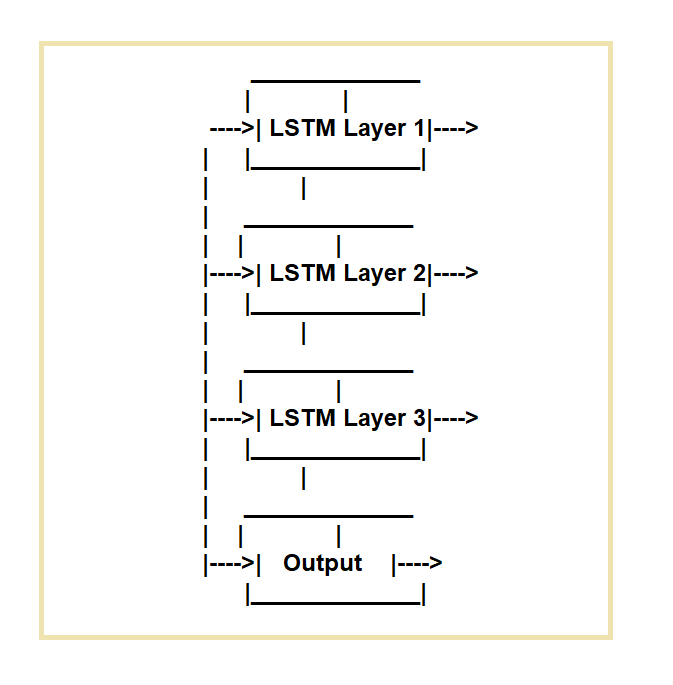

Ilgos trumpalaikės atminties (LSTM) tinklai yra sukurti siekiant pašalinti reguliarių pasikartojančių neuroninių tinklų (RNN) trūkumus. LSTM tinklai idealiai tinka užduotims, kurioms reikia apdoroti duomenų sekas per tam tikrą laiką.

Jie veikia naudodami tam tikrą atminties ląstelę ir tris blokavimo mechanizmus.

Jie reguliuoja informacijos srautą į ląstelę ir iš jos. Įvesties vartai, užmiršimo vartai ir išvesties vartai yra trys vartai.

Įvesties vartai reguliuoja duomenų srautą į atminties langelį, užmiršimo vartai – duomenų ištrynimą iš ląstelės, o išvesties vartai – duomenų srautą iš ląstelės.

Kokia jų reikšmė?

LSTM tinklai yra naudingi, nes jie gali sėkmingai reprezentuoti ir prognozuoti duomenų sekas, turinčias ilgalaikius ryšius. Jie gali įrašyti ir išsaugoti informaciją apie ankstesnes įvestis, todėl gali tiksliau prognozuoti būsimas įvestis.

Kalbos atpažinimas, rašysenos atpažinimas, natūralios kalbos apdorojimas ir paveikslėlių antraštės yra tik keletas programų, kurios naudojo LSTM tinklus.

Kur mes naudojame LSTM tinklus?

Daugelyje programinės įrangos ir technologijų taikomųjų programų naudojami LSTM tinklai, įskaitant kalbos atpažinimo sistemas, natūralių kalbų apdorojimo įrankius, pvz nuotaikos analizė, mašininio vertimo sistemos ir teksto bei paveikslėlių generavimo sistemos.

Jie taip pat buvo naudojami kuriant savarankiškai važiuojančius automobilius ir robotus, taip pat finansų pramonėje, siekiant nustatyti sukčiavimą ir numatyti vertybinių popierių rinkos judesiai.

3. Generative Adversarial Networks (GAN)

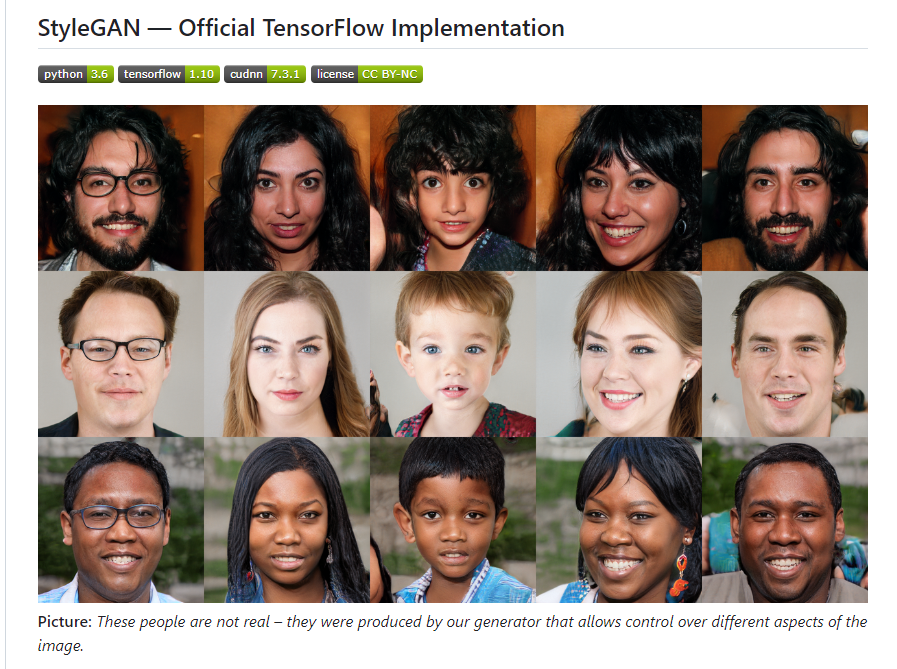

GAN yra a gilus mokymasis metodas, naudojamas naujiems duomenų pavyzdžiams, panašiems į tam tikrą duomenų rinkinį, generuoti. GAN yra sudaryti iš dviejų neuroniniai tinklai: toks, kuris išmoksta gaminti naujus pavyzdžius, ir tas, kuris išmoksta atskirti tikrus ir sugeneruotus pavyzdžius.

Taikant panašų metodą, šie du tinklai yra mokomi kartu, kol generatorius gali generuoti pavyzdžius, kurių negalima atskirti nuo tikrųjų.

Kodėl mes naudojame GAN

GAN yra svarbūs dėl jų gebėjimo gaminti aukštos kokybės sintetiniai duomenys kurie gali būti naudojami įvairioms programoms, įskaitant nuotraukų ir vaizdo įrašų kūrimą, teksto generavimą ir net muzikos generavimą.

GAN taip pat buvo naudojami duomenims papildyti, tai yra generavimas sintetiniai duomenys papildyti realaus pasaulio duomenis ir pagerinti mašininio mokymosi modelių veikimą.

Be to, sukurdami sintetinius duomenis, kurie gali būti naudojami modeliams mokyti ir bandymams imituoti, GAN gali pakeisti tokius sektorius kaip medicina ir vaistų kūrimas.

GAN programos

GAN gali papildyti duomenų rinkinius, kurti naujas nuotraukas ar filmus ir netgi generuoti sintetinius duomenis moksliniams modeliavimui. Be to, GAN gali būti naudojami įvairiose srityse – nuo pramogų iki medicinos.

amžius ir vaizdo įrašai. Pavyzdžiui, NVIDIA StyleGAN2 buvo naudojamas kuriant aukštos kokybės įžymybių ir meno kūrinių nuotraukas.

4. Gilių įsitikinimų tinklai (DBN)

Deep Belief Networks (DBN) yra dirbtinis intelektas sistemos, kurios gali išmokti pastebėti duomenų šablonus. Jie tai atlieka suskirstydami duomenis į vis mažesnes dalis, išsamiau suvokdami juos kiekviename lygyje.

DBN gali mokytis iš duomenų, nebūdami informuoti, kas tai yra (tai vadinama „neprižiūrimu mokymusi“). Dėl to jie labai vertingi nustatant duomenų modelius, kuriuos asmeniui būtų sunku arba neįmanoma įžvelgti.

Kas daro DBN reikšmingus?

DBN yra svarbūs dėl jų gebėjimo išmokti hierarchinių duomenų atvaizdų. Šios vaizdinės gali būti naudojamos įvairioms programoms, tokioms kaip klasifikavimas, anomalijų aptikimas ir matmenų mažinimas.

DBN gebėjimas atlikti neprižiūrimą išankstinį mokymą, kuris gali padidinti giluminio mokymosi modelių našumą naudojant minimalius pažymėtus duomenis, yra didelė nauda.

Kokie yra DBN pritaikymai?

Viena iš svarbiausių programų yra objekto aptikimas, kuriame DBN naudojami tam tikrų tipų daiktams, pvz., lėktuvams, paukščiams ir žmonėms, atpažinti. Jie taip pat naudojami vaizdų generavimui ir klasifikavimui, judesio aptikimui filmuose ir natūralios kalbos supratimui balso apdorojimui.

Be to, DBN dažniausiai naudojami duomenų rinkiniuose, siekiant įvertinti žmogaus laikyseną. DBN yra puikus įrankis įvairioms pramonės šakoms, įskaitant sveikatos priežiūrą ir bankininkystę bei technologijas.

5. Gilaus sustiprinimo mokymosi tinklai (DRL)

giliai Stiprinimo mokymasis Tinklai (DRL) integruoja giluminius neuroninius tinklus su sustiprinimo mokymosi metodais, kad agentai galėtų mokytis sudėtingoje aplinkoje bandymų ir klaidų būdu.

DRL yra naudojami mokyti agentus, kaip optimizuoti atlygio signalą sąveikaujant su aplinka ir mokantis iš savo klaidų.

Kas daro juos nuostabiais?

Jie buvo efektyviai naudojami įvairiose programose, įskaitant žaidimus, robotiką ir autonominį vairavimą. DRL yra svarbūs, nes jie gali mokytis tiesiogiai iš neapdorotos jutimo įvesties, todėl agentai gali priimti sprendimus, pagrįstus jų sąveika su aplinka.

Svarbios programos

DRL naudojami realiomis aplinkybėmis, nes jie gali išspręsti sudėtingas problemas.

DRL buvo įtraukti į keletą žinomų programinės įrangos ir technologijų platformų, įskaitant „OpenAI's Gym“, „Unity“ ML agentaiir Google DeepMind Lab. AlphaGo, sukūrė Google DeepMindPavyzdžiui, naudoja DRL, kad galėtų žaisti stalo žaidimą „Go“ pasaulio čempiono lygiu.

Kitas DRL panaudojimas yra robotikoje, kur jis naudojamas valdyti robotų rankų judesius, kad būtų galima atlikti tokias užduotis kaip sugriebti daiktus ar sukrauti blokus. DRL naudojami daugeliu atvejų ir yra naudinga priemonė mokyti agentus mokytis ir priimti sprendimus sudėtingose situacijose.

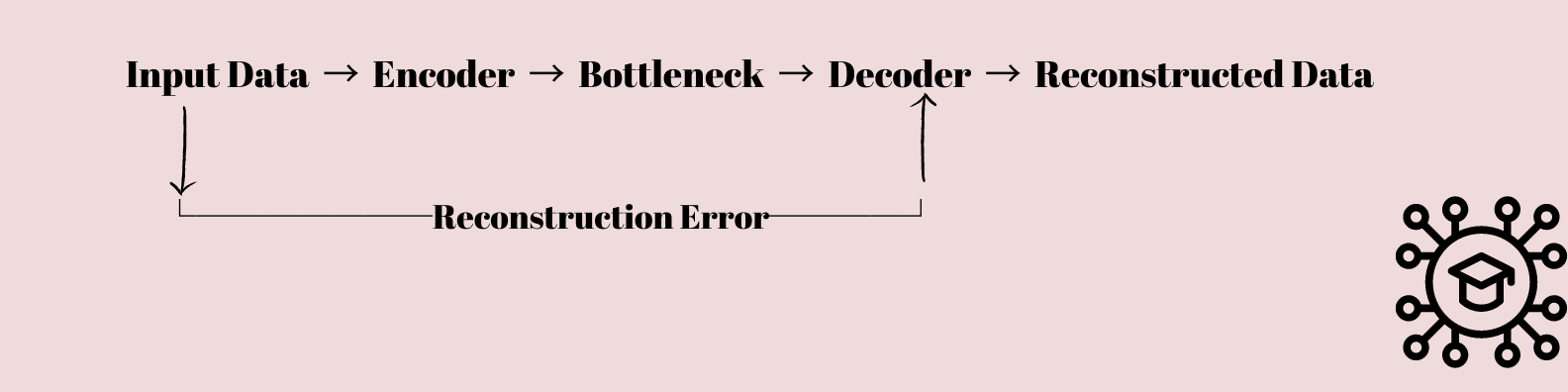

6. Automatiniai kodavimo įrenginiai

Automatiniai kodavimo įrenginiai yra įdomus tipas neuroninis tinklas tai sudomino ir mokslininkus, ir duomenų mokslininkus. Jie iš esmės yra skirti išmokti suspausti ir atkurti duomenis.

Įvesties duomenys pateikiami iš eilės sluoksnių, kurie palaipsniui mažina duomenų matmenis, kol jie suspaudžiami į kliūties sluoksnį, kuriame yra mažiau mazgų nei įvesties ir išvesties sluoksniai.

Tada šis suspaustas vaizdas naudojamas atkurti pradinius įvesties duomenis naudojant sluoksnių seką, kuri palaipsniui didina duomenų matmenis į pradinę formą.

Kodėl tai svarbu?

Automatiniai kodavimo įrenginiai yra esminis komponentas gilus mokymasis nes jie leidžia išgauti funkcijas ir sumažinti duomenis.

Jie gali identifikuoti pagrindinius gaunamų duomenų elementus ir paversti juos suglaudinta forma, kurią vėliau galima pritaikyti kitoms užduotims, pvz., klasifikavimui, grupavimui ar naujų duomenų kūrimui.

Kur mes naudojame automatinius kodavimo įrenginius?

Anomalijų aptikimas, natūralios kalbos apdorojimas ir kompiuterio vizija yra tik keletas disciplinų, kuriose naudojami automatiniai kodavimo įrenginiai. Pavyzdžiui, automatiniai kodavimo įrenginiai gali būti naudojami vaizdo glaudinimui, vaizdo triukšmo mažinimui ir vaizdo sintezei kompiuteriniame regėjime.

Galime naudoti automatinius kodavimo įrenginius tokiose užduotyse kaip teksto kūrimas, teksto skirstymas į kategorijas ir teksto apibendrinimas apdorojant natūralią kalbą. Jis gali nustatyti anomalią duomenų veiklą, kuri nukrypsta nuo anomalijos nustatymo normos.

7. Kapsuliniai tinklai

Capsule Networks yra nauja gilaus mokymosi architektūra, kuri buvo sukurta kaip konvoliucinių neuronų tinklų (CNN) pakaitalas.

Kapsulių tinklai yra pagrįsti smegenų vienetų, vadinamų kapsulėmis, grupavimu, kurie yra atsakingi už tam tikro elemento egzistavimą vaizde ir jo atributų, tokių kaip orientacija ir padėtis, kodavimą savo išvesties vektoriuose. Todėl kapsulių tinklai gali geriau valdyti erdvinę sąveiką ir perspektyvos svyravimus nei CNN.

Kodėl mes renkamės kapsulių tinklus, o ne CNN?

Kapsulių tinklai yra naudingi, nes jie įveikia CNN sunkumus fiksuojant hierarchinius ryšius tarp elementų paveikslėlyje. CNN gali atpažinti įvairaus dydžio daiktus, bet sunkiai suvokia, kaip šie elementai jungiasi vienas su kitu.

Kita vertus, kapsulių tinklai gali išmokti atpažinti daiktus ir jų dalis, taip pat jų erdvinį išdėstymą vaizde, todėl jie gali tapti perspektyviu varžovu kompiuterinio regėjimo programoms.

Taikymo sritys

„Capsule Networks“ jau parodė daug žadančius rezultatus įvairiose programose, įskaitant vaizdų klasifikavimą, objektų identifikavimą ir paveikslėlių segmentavimą.

Jie buvo naudojami atskirti daiktus medicininėse nuotraukose, atpažinti žmones filmuose ir netgi sukurti 3D modelius iš 2D vaizdų.

Siekiant padidinti jų našumą, kapsulių tinklai buvo sujungti su kitomis gilaus mokymosi architektūromis, tokiomis kaip generatyvūs priešpriešiniai tinklai (GAN) ir variaciniai automatiniai kodavimo įrenginiai (VAE). Prognozuojama, kad kapsulių tinklai vaidins vis svarbesnį vaidmenį tobulinant kompiuterinio matymo technologijas, tobulėjant gilaus mokymosi mokslui.

Pavyzdžiui; Nibabelis yra gerai žinomas Python įrankis, skirtas skaityti ir rašyti neurovaizdinių failų tipus. Vaizdo segmentavimui jis naudoja kapsulių tinklus.

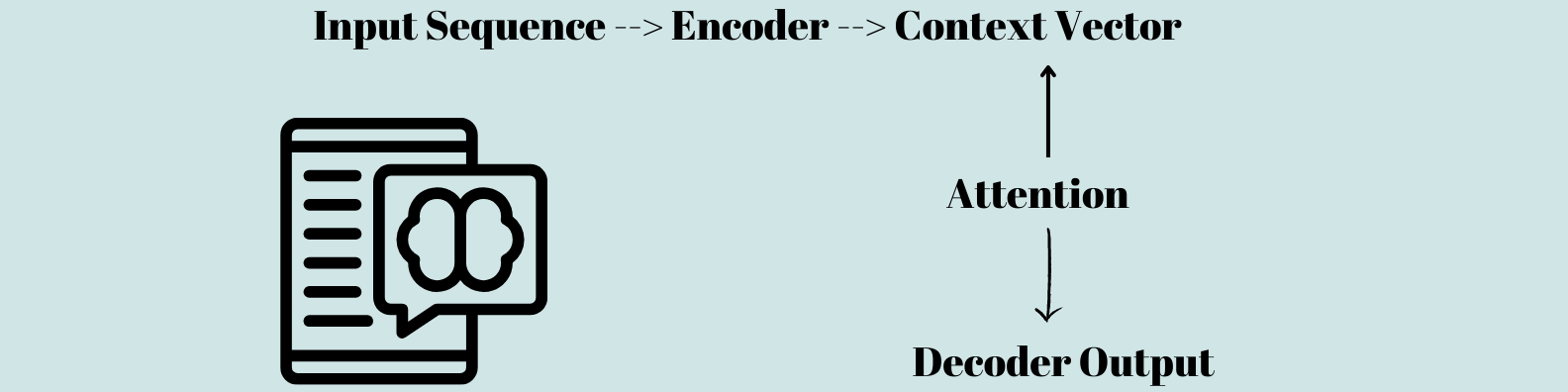

8. Dėmesio modeliai

Giluminio mokymosi modeliai, žinomi kaip dėmesio modeliai, taip pat žinomi kaip dėmesio mechanizmai, siekia padidinti informacijos tikslumą. mašinų mokymosi modeliai. Šie modeliai veikia sutelkdami dėmesį į tam tikras gaunamų duomenų savybes, todėl apdorojimas yra efektyvesnis ir efektyvesnis.

Natūralios kalbos apdorojimo užduotyse, tokiose kaip mašininis vertimas ir sentimentų analizė, dėmesio metodai pasirodė esantys gana sėkmingi.

Koks jų reikšmingumas?

Dėmesio modeliai yra naudingi, nes leidžia efektyviau ir efektyviau apdoroti sudėtingus duomenis.

Tradiciniai neuroniniai tinklai įvertinti visus įvesties duomenis kaip vienodai svarbius, todėl apdorojimas lėtėja ir tikslumas sumažėja. Dėmesys sutelkiamas į esminius įvesties duomenų aspektus, todėl galima greičiau ir tiksliau prognozuoti.

Naudojimo sritys

Dirbtinio intelekto srityje dėmesio mechanizmai turi platų pritaikymo spektrą, įskaitant natūralios kalbos apdorojimą, vaizdo ir garso atpažinimą ir net transporto priemones be vairuotojo.

Pavyzdžiui, dėmesio skyrimo metodai gali būti naudojami mašininiam vertimui pagerinti natūralios kalbos apdorojimo metu, nes sistema gali sutelkti dėmesį į tam tikrus žodžius ar frazes, kurios yra būtinos kontekstui.

Autonominiuose automobiliuose gali būti naudojami dėmesio skyrimo metodai, padedantys sistemai sutelkti dėmesį į tam tikrus daiktus ar iššūkius, esančius jos aplinkoje.

9. Transformatorių tinklai

Transformatorių tinklai yra gilaus mokymosi modeliai, kurie tiria ir sukuria duomenų sekas. Jie veikia apdorodami įvesties seką po vieną elementą ir sukurdami tokio paties arba skirtingo ilgio išvesties seką.

Transformatorių tinklai, skirtingai nei standartiniai sekos į seką modeliai, neapdoroja sekų naudojant pasikartojančius neuroninius tinklus (RNN). Vietoj to, jie naudoja savęs dėmesio procesus, kad sužinotų ryšius tarp sekos dalių.

Kokia yra transformatorių tinklų svarba?

Transformatorių tinklų populiarumas pastaraisiais metais išaugo dėl geresnių natūralios kalbos apdorojimo darbų rezultatų.

Jie ypač tinka teksto kūrimo užduotims, tokioms kaip kalbos vertimas, teksto apibendrinimas ir pokalbių kūrimas.

Transformatorių tinklai yra daug efektyvesni skaičiavimo požiūriu nei RNN modeliai, todėl jie yra tinkamiausias pasirinkimas didelio masto programoms.

Kur galite rasti transformatorių tinklus?

Transformatorių tinklai plačiai naudojami įvairiose programose, ypač natūralios kalbos apdorojime.

GPT (Generative Pre-Tained Transformer) serija yra ryškus transformatoriumi pagrįstas modelis, kuris buvo naudojamas tokioms užduotims kaip kalbos vertimas, teksto apibendrinimas ir pokalbių robotų generavimas.

BERT (Bidirectional Encoder Representations from Transformers) yra dar vienas įprastas transformatoriumi pagrįstas modelis, kuris buvo naudojamas natūralios kalbos supratimo programoms, tokioms kaip atsakymas į klausimus ir nuotaikų analizė.

Abu GPT ir BERT buvo sukurti su „PyTorch“, atvirojo kodo gilaus mokymosi sistema, kuri buvo populiari kuriant transformatorių modelius.

10. Apribotos Boltzmann mašinos (ŽSM)

Apribotos Boltzmann mašinos (RBM) yra tam tikras neprižiūrimas neuroninis tinklas, kuris mokosi generatyviu būdu. Dėl savo gebėjimo mokytis ir išskirti esmines charakteristikas iš didelės apimties duomenų, jie buvo plačiai naudojami mašininio mokymosi ir giluminio mokymosi srityse.

ŽSM sudaro du sluoksniai, matomi ir paslėpti, kiekvienas sluoksnis susideda iš neuronų grupės, sujungtos svertiniais kraštais. ŽSM yra skirti išmokti tikimybių skirstinį, apibūdinantį įvesties duomenis.

Kas yra apribotos Boltzmann mašinos?

ŽSM naudoja generatyvią mokymosi strategiją. ŽSM matomas sluoksnis atspindi įvesties duomenis, o palaidotas sluoksnis koduoja įvesties duomenų charakteristikas. Matomų ir paslėptų sluoksnių svoris parodo jų jungties stiprumą.

ŽSM koreguoja svorį ir poslinkius tarp sluoksnių treniruotės metu, naudodami metodą, vadinamą kontrastiniu skirtumu. Kontrastinis nukrypimas yra neprižiūrima mokymosi strategija, kuri maksimaliai padidina modelio numatymo tikimybę.

Kokia yra apribotų Boltzmann mašinų reikšmė?

ŽSM yra svarbūs mašininis mokymasis ir gilus mokymasis, nes jie gali išmokti ir išgauti atitinkamas charakteristikas iš didelio duomenų kiekio.

Jie labai veiksmingi atpažįstant vaizdą ir kalbą ir buvo naudojami įvairiose programose, tokiose kaip rekomendacijų sistemos, anomalijų aptikimas ir matmenų mažinimas. ŽSM gali aptikti modelius didžiuliuose duomenų rinkiniuose, todėl gaunamos puikios prognozės ir įžvalgos.

Kur gali būti naudojamos apribotos Boltzmann mašinos?

ŽSM programos apima matmenų mažinimo, anomalijų aptikimo ir rekomendacijų sistemas. ŽSM yra ypač naudingi atliekant nuotaikų analizę ir temos modeliavimas natūralios kalbos apdorojimo kontekste.

Giliųjų įsitikinimų tinklai, savotiškas neuroninis tinklas, naudojamas balso ir vaizdo atpažinimui, taip pat naudoja ŽSM. „Deep Belief Network Toolbox“, TensorFlowir Theano yra keletas konkrečių programinės įrangos ar technologijų, kuriose naudojami ŽSM, pavyzdžiai.

Apvynioti

Giluminio mokymosi modeliai tampa vis svarbesni įvairiose pramonės šakose, įskaitant kalbos atpažinimą, natūralios kalbos apdorojimą ir kompiuterinį regėjimą.

Konvoliuciniai neuroniniai tinklai (CNN) ir pasikartojantys neuroniniai tinklai (RNN) pasirodė esantys perspektyviausi ir yra plačiai naudojami daugelyje programų, tačiau visi gilaus mokymosi modeliai turi savo privalumų ir trūkumų.

Tačiau mokslininkai vis dar tiria Restricted Boltzmann mašinas (RBM) ir kitas giluminio mokymosi modelių rūšis, nes jie taip pat turi ypatingų pranašumų.

Tikimasi, kad bus sukurti nauji ir kūrybingi modeliai, nes gilaus mokymosi sritis ir toliau tobulėja, kad būtų galima išspręsti sudėtingesnes problemas

Palikti atsakymą