Inhaltsverzeechnes[Verstoppen][Show]

Vector Datenbanken representéieren eng bedeitend Verréckelung a wéi mir Daten verwalten an interpretéieren, besonnesch an de Beräicher vun der kënschtlecher Intelligenz a Maschinnléieren.

D'fundamental Funktioun vun dësen Datenbanken ass effektiv héichdimensional Vektoren ze handhaben, déi d'Rohmaterial vu Maschinnléiere Modeller sinn an d'Konversioun vun Text, Bild oder Audioinput an numeresch Representatioune am multidimensionalen Raum enthalen.

Fir Uwendungen wéi Empfehlungssystemer, Objekterkennung, Bildophuelung a Bedrucherkennung ass dës Transformatioun méi wéi just Lagerung; et ass eng Dier zu mächtege Fäegkeeten an Ähnlechkeetssich an noosten Noperen Ufroen.

Méi déif ass d'Kraaft vu Vektordatenbanken an hirer Kapazitéit fir grouss Quantitéiten vun onstrukturéierten, komplizéierten Daten a Vektoren ze iwwersetzen, déi de Kontext an d'Bedeitung vum originelle Inhalt erfaassen.

Déi verstäerkte Sichfunktiounen, déi méiglech gemaach ginn duerch d'Inbedding vun Modeller an dëser Kodéierung enthalen d'Fäegkeet fir ronderëm Vektoren ze froen fir verwandte Biller oder Ausdréck ze fannen.

Vektordatenbanken sinn eenzegaarteg an datt se op fortgeschratt Indexéierungstechnike wéi Inverted File Index (IVF) an Hierarchical Navigable Small World (HNSW) gebaut sinn, wat hir Geschwindegkeet an Effizienz verbessert wärend déi noosten Noperen an N-dimensionalen Raum lokaliséieren.

Et gëtt e kloeren Ënnerscheed tëscht Vektor a klassesch Datenbanken. Konventionell Datenbanken si super fir Daten an organiséiert Sets z'organiséieren déi CRUD-optimiséiert sinn an un de gesate Schemaen halen.

Wéi och ëmmer, wann Dir mat der dynamescher a komplizéierter Natur vun héichdimensionalen Donnéeën handelt, fänkt dës Steifheet un en Hindernis ze ginn.

Am Géigesaz, bidden Vecteure Datenbanken e Grad vu Flexibilitéit an Effizienz déi traditionell Äquivalenten net gläiche kënnen, besonnesch fir Uwendungen déi staark op vertrauen Maschinn léieren a kënschtlech Intelligenz. Si sinn net nëmme skalierbar a kompetent an Ähnlechkeetssich.

Vector Datenbanken si besonnesch nëtzlech fir generativ AI Uwendungen. Fir ze garantéieren datt dat erstallt Material kontextuell Integritéit behält, hänken dës Uwendungen - déi natierlech Sproochveraarbechtung a Bildgeneratioun enthalen - vun der schneller Erhuelung an dem Verglach vun Embeddingen of.

Also an dësem Stéck wäerte mir déi Top Vektordatenbanken fir Ären nächste Projet kucken.

1. Milvus

Milvus ass eng pionéierend Open-Source Vecteure Datebank haaptsächlech fir AI Uwendungen entwéckelt, dorënner embedded Ähnlechkeet Sich a mächteg MLOps.

Et ënnerscheet sech vun konventionelle relationalen Datenbanken, déi meeschtens handhaben strukturéiert Daten, Wéinst dëser Kapazitéit, déi et et erméiglecht Vecteure op enger eemoleger Billioun Skala ze indexéieren.

Dem Milvus seng Engagement fir Skalierbarkeet an héich Disponibilitéit gëtt bewisen duerch d'Art a Weis wéi et vu senger éischter Versioun op déi voll verdeelt, Cloud-native Milvus 2.0 entwéckelt gouf.

Speziell weist de Milvus 2.0 e komplett Cloud-native Design deen op eng erstaunlech 99.9% Disponibilitéit zielt wärend iwwer Honnerte vu Wirbelen skaléiert.

Fir déi, déi no enger zouverléisseger Vektor-Datebank-Léisung sichen, ass dës Editioun héich recommandéiert, well se net nëmmen raffinéiert Features wéi eng Multi-Cloudverbindung an eng administrativ Panel bäidréit, mee et verbessert och Datenkonsistenzniveauen fir flexibel Applikatiounsentwécklung.

En bemierkenswäerte Virdeel vu Milvus ass seng Gemeinschaftsgedriwwen Approche, déi Multi-Sprooch Ënnerstëtzung an eng extensiv Toolchain un d'Ufuerderunge vun den Entwéckler ubitt.

Am IT Secteur, seng Cloud Skalierbarkeet an Zouverlässegkeet, zesumme mat sengen High-Performance Vektor Sichfäegkeeten op grouss Datesätz, maachen et eng populär Optioun.

Zousätzlech verbessert et d'Effizienz vu sengen Operatiounen mat Hëllef vun enger Hybrid Sichkapazitéit déi Vector Ähnlechkeet Sich mat scalar Filterung vermëscht.

Milvus huet eng administrativ Rot mat enger kloer User Interface, e komplette Set vun APIen, an eng skalierbar an ofstëmmbar Architektur.

D'Kommunikatioun mat externen Uwendungen gëtt vun der Zougangsschicht erliichtert, während d'Laaschtbalancéierung an d'Datemanagement vum Koordinatorservice koordinéiert ginn, deen als zentrale Kommando déngt.

D'Permanenz vun der Datebank gëtt vun der Objektspeicherschicht ënnerstëtzt, während Aarbechternoden Aktivitéiten ausféieren fir Skalierbarkeet ze garantéieren.

Tarifikatioun

Et ass gratis fir jiddereen ze benotzen.

2. FAISS

Facebook's AI Research Team huet eng modernst Bibliothéik mam Numm Facebook AI Similarity Search entwéckelt, déi entwéckelt ass fir dichte Vektorclusteren an Ähnlechkeetssich méi effektiv ze maachen.

Seng Kreatioun gouf gedriwwen duerch d'Ufuerderung fir d'Facebook AI Ähnlechkeetssichfäegkeeten ze verbesseren andeems se modernst fundamental Methodologien benotzen.

Am Verglach mat CPU-baséiert Implementatiounen, FAISS's modernste GPU Implementatioun kann d'Sichzäite vu fënnef bis zéng Mol beschleunegen, sou datt et en onschätzbare Tool fir eng Vielfalt vun Uwendungen mécht, dorënner Empfehlungssystemer an d'Identifikatioun vun ähnlechen Bedeitungen a sizable. onstrukturéiert Datesätz wéi Text, Audio a Video.

FAISS kann eng breet Palette vun Ähnlechkeetsmetriken handhaben, sou wéi Cosinus Ähnlechkeet, bannescht Produkt, an déi allgemeng benotzt L2 Metrik (Euklidesch Distanz).

Dës Miessunge maachen et méi einfach präzis a flexibel Ähnlechkeetssich iwwer verschidden Datenaarten ze maachen. Features wéi Batchveraarbechtung, Präzisioun-Geschwindegkeet Trade-offs, an Ënnerstëtzung fir präzis an ongeféier Recherchen erhéijen seng Flexibilitéit weider.

Zousätzlech bitt FAISS eng skalierbar Method fir massiv Datesätz ze handhaben andeems Indexen op Disk gespäichert ginn.

Déi ëmgedréint Datei, Produktquantiséierung (PQ) a verbessert PQ sinn nëmmen e puer vun den innovativen Techniken, déi d'FAISS Fuerschungsfondatioun ausmaachen an zu senger Effizienz bäidroen wann et ëm d'Indexéierung an d'Sich vun héichdimensionalen Vektorfelder kënnt.

Dës Strategie ginn verstäerkt duerch opzedeelen Approche wéi GPU-beschleunegt K-Selektioun Algorithmen a Pre-Filterung vu PQ Distanzen, garantéiert d'FAISS Kapazitéit fir séier a präzis Sichresultater ze produzéieren och a Milliarde-Skala Datesätz.

Tarifikatioun

Et ass gratis fir jiddereen ze benotzen.

3. Kieferkegel

Pinecone ass e Leader a Vektordatenbanken, bitt e Cloud-native, verwalteten Service dee besonnesch gebaut ass fir d'Performance vun héich ugedriwwenen AI Uwendungen ze verbesseren.

Et ass speziell entwéckelt fir Vector Embeddings ze handhaben, déi wesentlech sinn fir generativ AI, semantesch Sich, an Uwendungen mat massive Sproochmodeller.

AI kann elo semantesch Informatioun verstoen dank dësen Embeddings, déi effektiv als laangfristeg Erënnerung fir komplizéiert Aufgaben handelen.

Pinecone ass eenzegaarteg datt et d'Fäegkeeten vun traditionellen Datenbanken nahtlos integréiert mat der verstäerkter Leeschtung vu Vektorindexen, wat d'effizient a grouss Skala Späicheren an Ufroen vun Embeddingen erméiglecht.

Dëst mécht et déi perfekt Optioun a Situatiounen wou d'Komplexitéit an de Volume vun den Donnéeën déi involvéiert sinn, Standard scalar-baséiert Datenbanken net genuch maachen.

Pinecone bitt Entwéckler eng problemfräi Léisung wéinst senger verwalteter Service Approche, déi d'Integratioun an d'Echtzäitdatenaufnahme Prozeduren streamlines.

Vill Dateoperatioune ginn dovun ënnerstëtzt, dorënner d'Daten sichen, Aktualiséierung, Läschen, Ufroen an Upserting.

Pinecone garantéiert weider datt Ufroen, déi Echtzäitmodifikatioune representéieren, wéi Upserts a Läschen, korrekt, niddereg latency Äntwerte fir Indizes mat Milliarde Vecteure ubidden.

An dynamesche Situatiounen ass dës Feature wesentlech fir d'Relevanz an d'Frëschheet vun de Queryresultater ze erhalen.

Zousätzlech erhéicht d'Pinecone Partnerschaft mat Airbyte iwwer d'Pinecone Verbindung seng Villsäitegkeet a Flexibilitéit, wat eng glat Datenintegratioun aus enger Rei vu Quellen erlaabt.

Duerch dës Relatioun kënnen d'Käschte an d'Effizienz optimiséiert ginn andeems se suergen, datt nëmmen nei kritt Informatioun duerch inkrementell Datesynchroniséierung gehandhabt gëtt.

Den Design vum Connector betount d'Einfachheet, brauch just minimale Setupparameter, an et ass verlängerbar, wat zukünfteg Verbesserungen erlaabt.

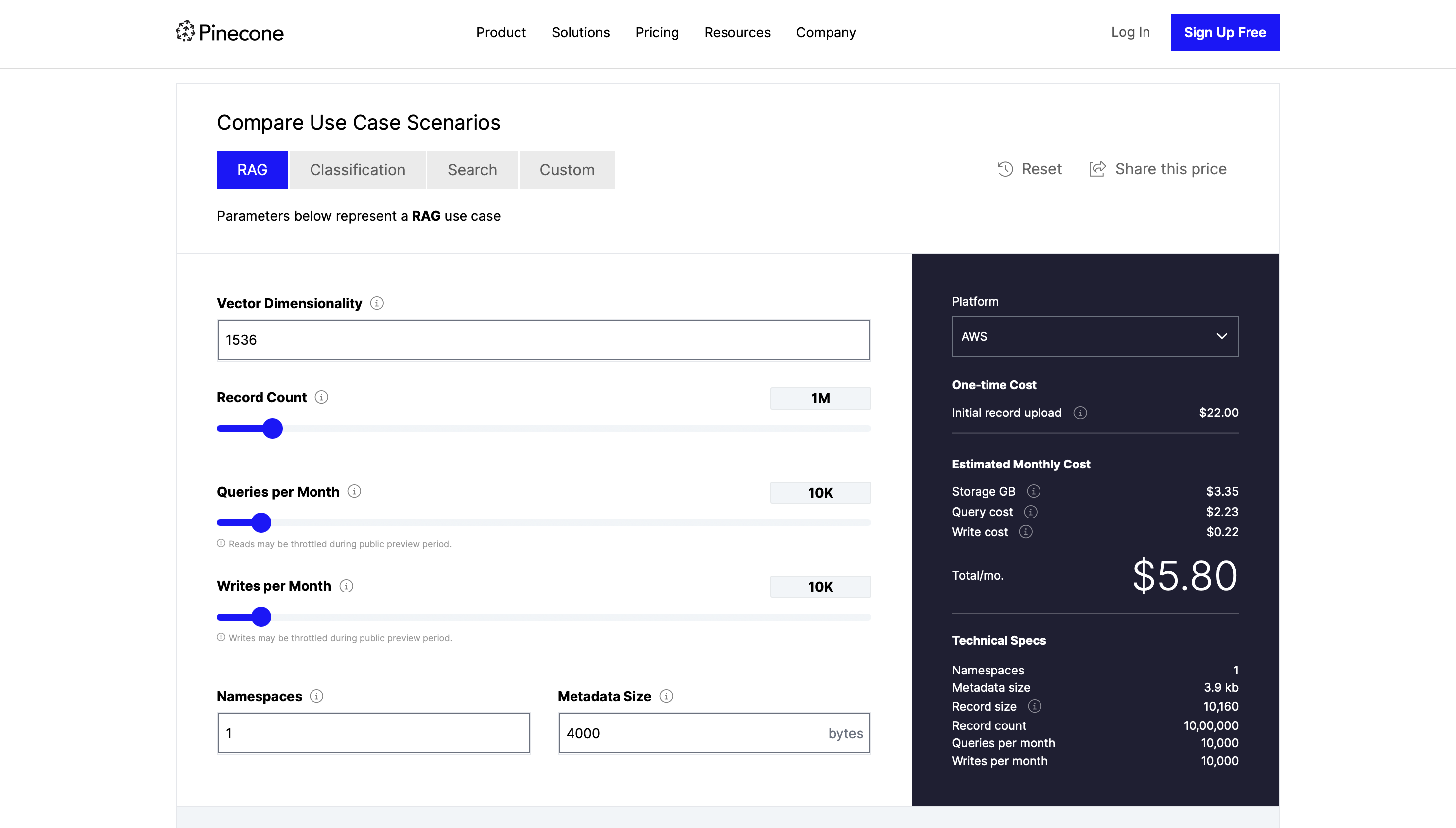

Tarifikatioun

D'Präispräisser fänken un $ 5.80 / Mount fir de RAG Benotzungsfall.

4. Weaviate

Weaviate ass eng innovativ Vecteure Datebank déi verfügbar ass als Open Source Software déi d'Art a Weis wéi mir Zougang a benotzen Daten transforméieren.

Weaviate benotzt Vektorsuchfäegkeeten, déi raffinéiert, kontextbewosst Sichen iwwer grouss, komplizéiert Datesätz erméiglechen, am Géigesaz zu typeschen Datenbanken, déi op skalar Wäerter a virdefinéiert Ufroen ofhänken.

Mat dëser Method kënnt Dir Inhalter lokaliséieren op Basis wéi ähnlech et mat aneren Inhalt ass, wat d'Intuitivitéit vun de Sich an d'Relevanz vun de Resultater verbessert.

Seng glat Integratioun mat Maschinn Léieren Modeller ass eng vu senge primäre Charakteristiken; dëst erlaabt et als méi wéi nëmmen eng Datespäicherléisung ze funktionéieren; et erlaabt och Daten mat Hëllef vu kënschtlecher Intelligenz ze verstoen an ze analyséieren.

D'Architektur vun Weaviate integréiert dës Integratioun grëndlech, wat et méiglech mécht komplex Donnéeën ze analyséieren ouni zousätzlech Tools ze benotzen.

Seng Ënnerstëtzung fir Grafikdatenmodeller bitt och en anere Standpunkt op Daten als verlinkte Entitéiten, exponéiert Musteren an Abléck déi a konventionell Datebankarchitekturen vermësst kënne ginn.

Wéinst der modulärer Architektur vun Weaviate kënnen d'Clienten Fäegkeeten addéieren wéi Datevektoriséierung a Backup-Creatioun wéi néideg.

Seng fundamental Versioun funktionéiert als Vektordatenspezialist Datebank, an et kann mat anere Moduler erweidert ginn fir verschidde Bedierfnesser ze treffen.

Seng Skalierbarkeet gëtt weider verbessert duerch säi modulare Design, wat garantéiert datt d'Geschwindegkeet net geaffert gëtt als Äntwert op d'Erhéijung vun Datequantitéiten an Ufrofuerderungen.

Eng villsäiteg an effektiv Method fir mat de gespäicherten Donnéeën ze interagéieren ass méiglech gemaach duerch d'Ënnerstëtzung vun der Datebank fir béid RESTful a GraphQL APIs.

Besonnesch GraphQL gëtt gewielt wéinst senger Kapazitéit fir séier komplizéiert, grafesch-baséiert Ufroen auszeféieren, wat d'Benotzer et erméiglecht präzis d'Donnéeën ze kréien déi se wëllen ouni exzessiv oder net genuch Quantitéiten un Daten ze kréien.

Weaviate ass méi userfrëndlech iwwer eng Vielfalt vu Clientbibliothéiken a Programméierungssproochen dank senger flexibeler API.

Fir déi, déi de Weaviate weider wëllen entdecken, gëtt et eng Onmass vun Dokumentatioun an Tutorials verfügbar, vun der Ariichten an der Konfiguratioun vun Ärer Instanz bis déif Tauchen a seng Fäegkeeten wéi Vektor Sich, Maschinnléieren Integratioun, a Schema Design.

Dir kënnt Zougang zu der selwechter potenter Technologie kréien, déi Informatioun dynamesch an handlungsfäeg mécht, egal ob Dir decidéiert Weaviate lokal ze bedreiwen, an engem Wollek Rechenzäit Ëmfeld, oder duerch de Weaviate geréiert Cloud Service

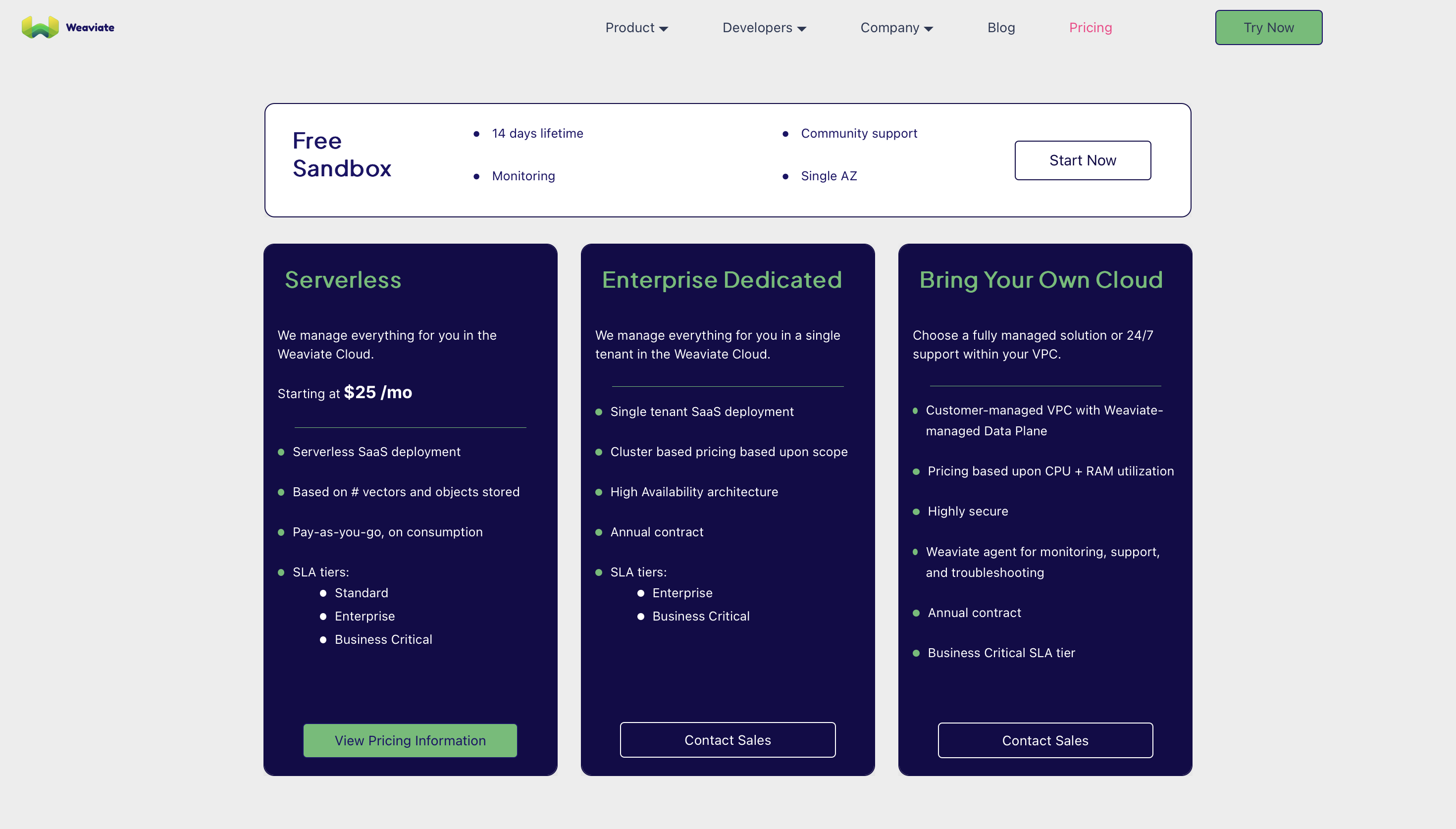

Tarifikatioun

De Premiumpräis vun der Plattform fänkt vu $ 25 / Mount fir Serverlos un.

5. Chroma

Chroma ass eng modernste Vektordatenbank, déi zielt fir d'Datenerzéiung a Lagerung ze revolutionéieren, besonnesch fir Uwendungen mat Maschinnléieren a kënschtlecher Intelligenz.

Zënter Chroma schafft mat Vektoren anstatt scalar Zuelen, am Géigesaz zu Standarddatenbanken, ass et ganz gutt fir héichdimensional, komplizéiert Daten ze managen.

Dëst ass e wesentleche Fortschrëtt an der Dateschutztechnologie well et méi sophistikéiert Sich erméiglecht baséiert op der semantescher Ähnlechkeet vum Material anstatt präzise Schlësselwuert Mätscher.

Eng bemierkenswäert Charakteristik vu Chroma ass seng Fäegkeet fir mat verschiddenen ënnerierdesche Späicherléisungen ze schaffen, sou wéi ClickHouse fir skaléiert Astellungen an DuckDB fir Standalone Installatiounen, déi Flexibilitéit an Adaptatioun u verschidde Benotzungsfäll garantéieren.

Chroma gëtt mat Einfachheet, Geschwindegkeet an Analyse am Kapp gemaach. Et ass verfügbar fir e breet Spektrum vun Entwéckler mat SDKs fir Python a JavaScript / TypeScript.

Zousätzlech leet Chroma e staarken Akzent op d'Benotzerfrëndlechkeet, wat d'Entwéckler erlaabt séier eng permanent Datebank opzestellen, ënnerstëtzt vun DuckDB oder eng In-Memory Datebank fir Testen.

D'Kapazitéit fir Sammlungsobjekter ze bauen déi Dëscher a konventionellen Datenbanken ähnelen, wou Textdaten kënnen agebaut ginn an automatesch an Embeddings transforméiert ginn mat Modeller wéi all-MiniLM-L6-v2, erhéicht dës Villsäitegkeet weider.

Text an Embeddings kënnen nahtlos integréiert sinn, wat essentiell ass fir Uwendungen déi Datesemantik musse begräifen.

D'Fundament vun der Chroma's Vector Ähnlechkeetsmethod ass déi mathematesch Konzepter vun der Orthogonalitéit an der Dicht, déi wesentlech sinn fir d'Representatioun an d'Vergläiche vun Daten an Datenbanken ze verstoen.

Dës Iddien erlaben Chroma sënnvoll an effizient Ähnlechkeetssich auszeféieren andeems se déi semantesch Verbindungen tëscht Datenelementer berücksichtegt.

Ressourcen wéi Tutorials a Richtlinnen sinn zougänglech fir Eenzelen déi Chroma weider wëllen entdecken. Si enthalen Schrëtt-fir-Schrëtt Orientatioun iwwer wéi d'Datebank opzestellen, Sammlungen erstellen an Ähnlechkeetssiche lafen.

Tarifikatioun

Dir kënnt ufänken et gratis ze benotzen.

6. Vespa

Vespa ass eng Plattform déi den Online Handhabung vun AI a grouss Daten transforméiert.

D'fundamental Zweck vun Vespa ass niddereg-latency Berechnungen iwwer grouss Datesätz z'erméiglechen, wat Iech erlaabt Text, Vecteure a strukturéiert Daten einfach ze späicheren, indexéieren an analyséieren.

Vespa ënnerscheet sech duerch seng Kapazitéit fir séier Äntwerten op all Skala ze liwweren, onofhängeg vun der Natur vun den Ufroen, Choixen oder Maschinn geléiert Modellinferenzen déi gehandhabt ginn.

D'Flexibilitéit vum Vespa gëtt a senger voll funktioneller Sichmotor a Vektordatenbank gewisen, déi vill Sich an enger eenzeger Ufro erméiglechen, rangéiert vu Vektor (ANN), lexikalesch a strukturéiert Daten.

Onofhängeg vun der Skala, kënnt Dir User-frëndlech a reaktiounsfäeger Sich Apps mat Echtzäit AI Fähegkeeten erstellen dank dëser Integratioun vun Maschinn geléiert Modell Inferenz mat Ären Donnéeën.

Wéi och ëmmer, Vespa ass iwwer méi wéi einfach ze sichen; et geet och drëm d'Begeeschterung ze verstoen an ze personaliséieren.

Top-notch Personnalisatioun a Virschlag Tools bidden dynamesch, aktuell Empfehlungen fir spezifesch Benotzer oder Ëmstänn.

Vespa ass e Spillwechsel fir jiddereen deen och de Gespréichs-AI Raum anzeginn, well et d'Infrastruktur ubitt fir Text- a Vektordaten an Echtzäit ze späicheren an z'entdecken, wat d'Entwécklung vu méi fortgeschratt a prakteschen AI Agenten erlaabt.

Mat ëmfaassender Tokeniséierung a Stemmung, Volltext Sichen, noosten Noper Sichen, a strukturéiert Datesufroen ginn all ënnerstëtzt vun der Plattform hir extensiv Ufroméiglechkeeten.

Et ënnerscheet sech an datt et effektiv komplizéiert Ufroen handhaben kann andeems verschidde Sichdimensioune kombinéiert ginn.

Vespa ass e computational Powerhouse fir AI a Maschinnléieren Uwendungen well säi Berechnungsmotor komplex mathematesch Ausdréck iwwer Skalaren an Tensoren handhaben kann.

An der Operatioun ass Vespa gemaach fir einfach ze benotzen an erweiterbar ze sinn.

Et streamlines repetitive Prozesser, rangéiert vu Systemkonfiguratioun an Uwendungsentwécklung bis Daten an Nodemanagement, wat sécher an onënnerbrach Produktiounsoperatioune erméiglecht.

D'Architektur vum Vespa suergt dofir datt se mat Ären Donnéeën erweidert, seng Zouverlässegkeet an Leeschtung behalen.

Tarifikatioun

Dir kënnt ufänken et gratis ze benotzen.

7. Quadrant

Qdrant ass eng flexibel Vecteure Datebank Plattform déi en eenzegaartege Set vu Fäegkeeten ubitt fir déi wuessend Ufuerderunge vun AI a Maschinnléieren Uwendungen z'erreechen.

A senger Grënnung ass Qdrant e Vektor Ähnlechkeet Sichmotor deen eng einfach ze benotzen API bitt fir Vektoren ze späicheren, ze fannen an z'erhalen, souwéi Notzlaaschtdaten.

Dës Feature ass entscheedend fir verschidden Uwendungen, wéi semantesch Sich- a Empfehlungssystemer, déi komplizéiert Dateformater interpretéieren.

D'Plattform ass mat Effizienz a Skalierbarkeet am Kapp gebaut, fäeg massiv Datesätz mat Milliarden Datenpunkten ze handhaben.

Et bitt verschidde Distanzmetriken abegraff Cosinus Ähnlechkeet, Euklidesch Distanz, a Punktprodukt, wat et adaptéierbar mécht a ville Benotzungsszenarien.

Den Design bitt komplex Filteren, wéi String, Range, a Geo-Filtere, fir verschidde Sichbedierfnesser ze treffen.

Qdrant ass zougänglech fir Entwéckler op verschidde Manéieren, dorënner en Docker-Bild fir séier lokal Opstellungen, e Python Client fir déi bequem mat der Sprooch, an e Cloud-Service fir e méi robusten, Produktiounsgrad Ëmfeld.

Dem Qdrant seng Adaptabilitéit erlaabt eng nahtlos Integratioun mat all technologeschen Konfiguratioun oder Prozessbedierfnesser.

Ausserdeem vereinfacht d'Benotzerfrëndlech Interface vum Qdrant Vecteure Datebank Gestioun. D'Plattform ass geduecht fir einfach ze sinn fir Benotzer vun alle Fäegkeetsniveauen, vu Clusterkreatioun bis zur Generatioun vun API Schlësselen fir sécheren Zougang.

Seng bulk eropluede Kapazitéit an asynchrone API verbesseren seng Effizienz, mécht et e ganz nëtzlecht Tool fir Entwéckler mat enormen Quantitéiten un Daten.

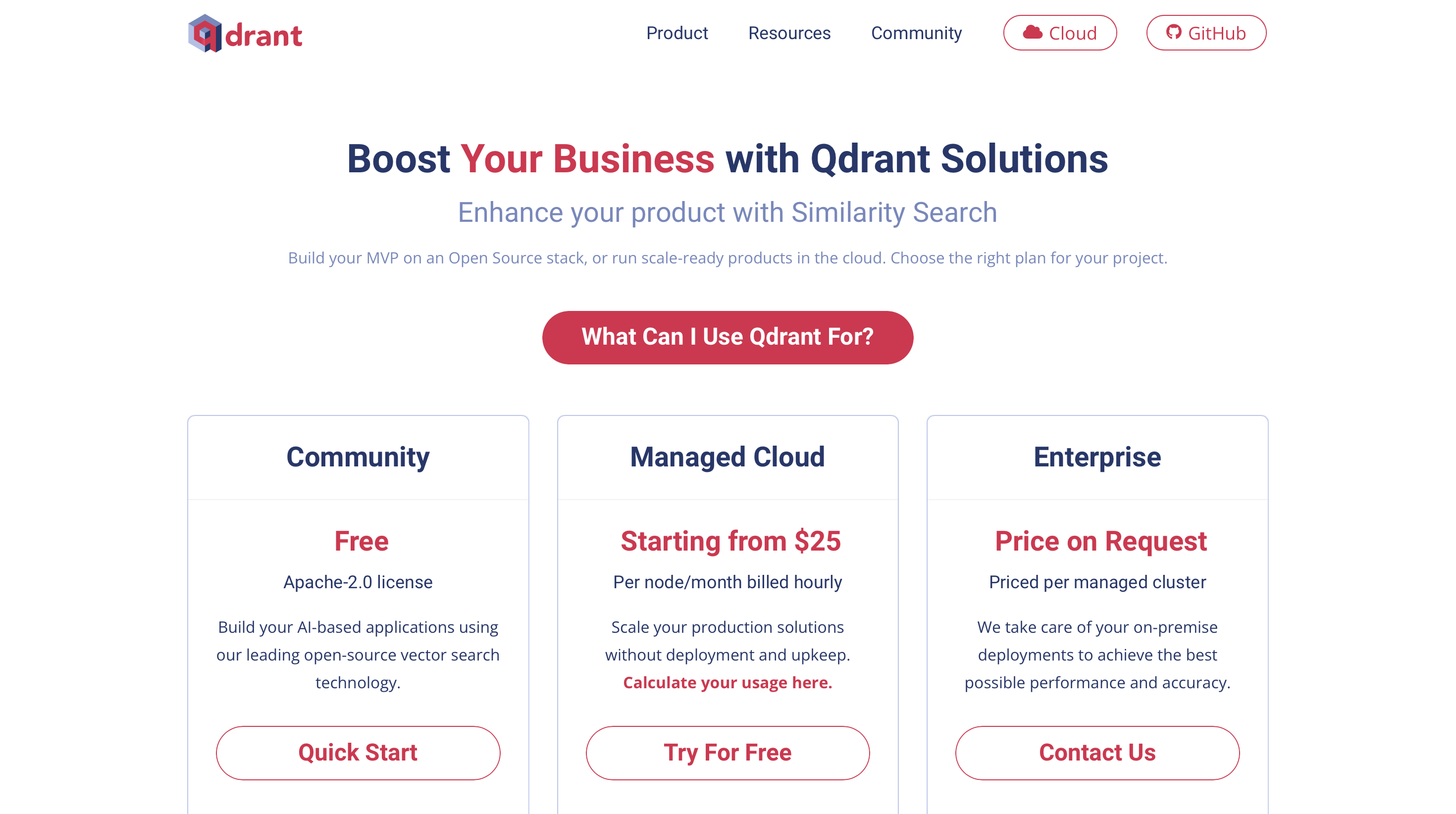

Tarifikatioun

Dir kënnt ufänken et gratis ze benotzen an Premium Präisser fänken un $ 25 pro Node / Mount all Stonn

8. Astra

AstraDB's superior Vektorsichfäegkeeten a Serverlos Architektur transforméieren generativ AI Uwendungen.

AstraDB ass eng super Optioun fir komplizéiert, kontextsensibel Sichen iwwer eng Vielfalt vun Datentypen ze managen, well se op der zolitter Basis vun Apache Cassandra gebaut ass an nahtlos Skalierbarkeet, Stabilitéit a Leeschtung kombinéiert.

D'Kapazitéit vun AstraDB fir heterogen Aarbechtslaaschten ze handhaben, inklusiv Streaming, Net-Vektor, a Vektordaten, wärend extrem geréng Latenz fir simultan Ufroen an Update Operatiounen erhalen, ass ee vu senge bemierkenswäerte Virdeeler.

Dës Adaptabilitéit ass wesentlech fir generativ AI Uwendungen, déi Streaming an Echtzäit Datenveraarbechtung erfuerderen fir präzis, kontextbewosst AI Äntwerten ze bidden.

Déi serverlos Léisung vun AstraDB mécht d'Entwécklung nach méi einfach, befreit d'Entwéckler sech op d'Schafe vun innovativen AI Uwendungen ze konzentréieren anstatt d'Backend Infrastruktur ze managen.

Vun Quickstart Leedung bis déif Lektioune fir Chatbots a Empfehlungssystemer ze kreéieren, AstraDB erméiglecht d'Entwéckler séier hir AI Iddien duerch zouverléisseg APIen a glat Interfaces mat bekannten Tools a Plattformen ze realiséieren.

Enterprise-Grad generativ AI Systemer musse Sécherheet a Konformitéit prioritär stellen, an AstraDB liwwert op béide Fronte.

Déif Firmesécherheetsfeatures a Konformitéitszertifizéierunge ginn dovun geliwwert, garantéiert datt AI Uwendungen, déi op AstraDB entwéckelt goufen, un déi strengste Privatsphär an Dateschutz Richtlinnen halen.

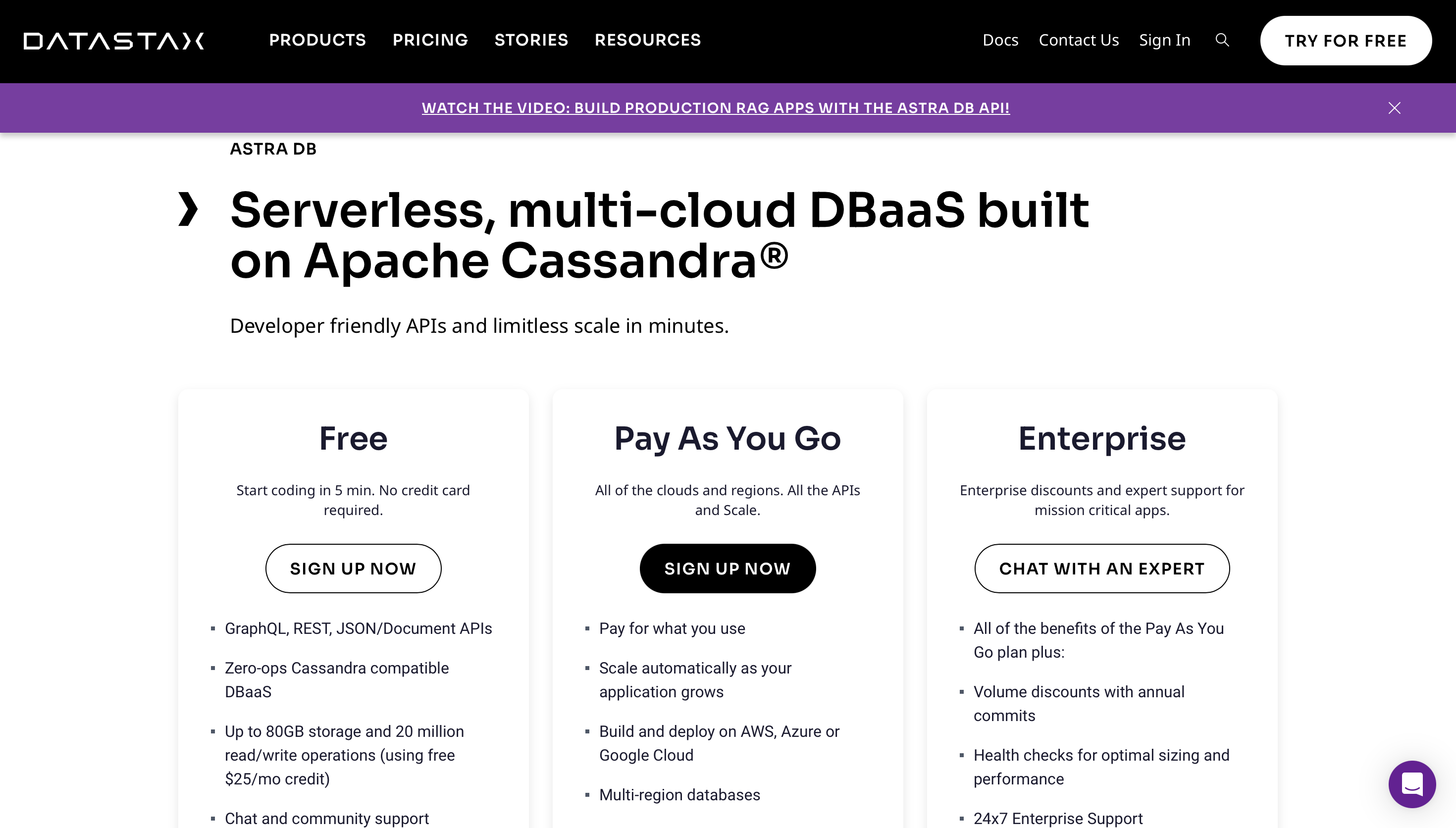

Tarifikatioun

Dir kënnt ufänken et gratis ze benotzen an et bitt e Pay-as-You-Go Modell.

9. OpenSearch

OpenSearch erschéngt als eng attraktiv Optioun fir déi, déi Vektordatenbanken entdecken, besonnesch fir adaptéierbar, skalierbar an zukünfteg-proof AI Systemer z'entwéckelen.

OpenSearch ass eng all-inklusiv, Open-Source Vektor-Datebank, déi d'Kraaft vun der Analyse kombinéiert, raffinéiert Vektorsich, a konventionell Sich an ee kohäsive System.

Andeems Dir Maschinn Léieren Embedding Modeller benotzt fir d'Bedeitung an de Kontext vu multiple Dateformen - Dokumenter, Fotoen an Audio - a Vektore fir Ähnlechkeetssich ze codéieren, ass dës Integratioun besonnesch hëllefräich fir Entwéckler déi semantesch Verständnis an hir Sichapps enthalen.

Och wann OpenSearch vill ze bidden huet, ass et wichteg ze erënneren datt am Verglach zu Elasticsearch, et vill manner Code Ännerungen goufen, besonnesch a kriteschen Moduler wéi Skriptsproochen an Intake Pipeline Prozessoren.

Elasticsearch ka méi sophistikéiert Fäegkeeten hunn wéinst verstäerkter Entwécklung Effort, wat zu Differenzen an der Leeschtung, Feature Set an Updates tëscht deenen zwee féiert.

OpenSearch kompenséiert mat enger grousser Gemeinschaft no an engem Engagement fir Open-Source Iddien, wat zu enger oppener an adaptéierbarer Plattform resultéiert.

Et ënnerstëtzt eng breet Palette vun Uwendungen iwwer Sich an Analyse, sou wéi Observabilitéit a Sécherheetsanalyse, sou datt et e flexibelen Tool fir datintensiv Aufgaben ass.

Déi Gemeinschaftsgedriwwe Strategie garantéiert kontinuéierlech Verbesserungen an Integratiounen fir d'Plattform aktuell an eenzegaarteg ze halen.

Tarifikatioun

Dir kënnt ufänken et gratis ze benotzen.

10. Azure AI Sich

Azure AI Search ass eng staark Plattform déi Sichfäegkeeten bannent generativen AI Uwendungen verbessert.

Et steet eraus well et Vektor Sich ënnerstëtzt, e Mechanismus fir Indexéierung, Späicheren an Erhuelung Vektor Embeddings bannent engem Sichindex.

Dës Feature hëlleft vergläichbar Dokumenter am Vektorraum z'entdecken, wat zu méi kontextuell relevante Sichresultater resultéiert.

Azure AI Search ënnerscheet sech duerch seng Ënnerstëtzung fir Hybrid Situatiounen, an deenen Vektor- a Schlësselwuert Sich gläichzäiteg duerchgefouert ginn, wat zu engem vereenegt Resultat-Set resultéiert, deen dacks d'Effizienz vun all Technik eleng benotzt.

D'Kombinatioun vu Vektor an Net-Vektormaterial am selwechten Index erlaabt eng méi komplett a flexibel Sicherfahrung.

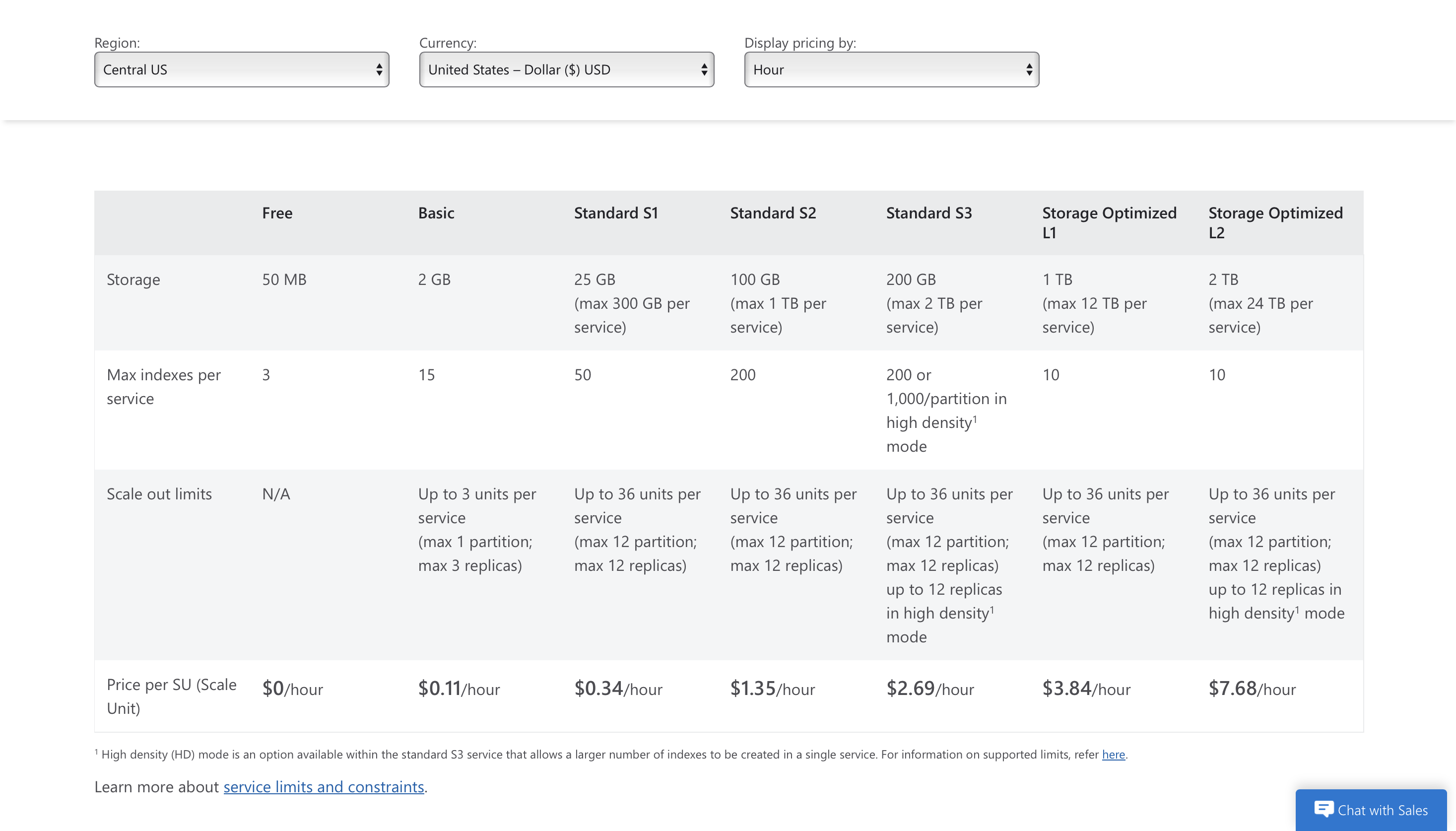

D'Vector Sich Feature an Azure AI Search ass wäit zougänglech a gratis fir all Azure AI Search Tier.

Et ass extrem flexibel fir eng Rei vu Benotzungsfäll an Entwécklungsvirléiften wéinst senger Ënnerstëtzung fir verschidden Entwécklungsëmfeld, déi iwwer den Azure Site geliwwert gëtt, REST APIen, an SDKs fir Python, JavaScript, an.NET, ënner anerem.

Mat senger déiwer Integratioun mam Azure AI-Ökosystem bitt Azure AI Search méi wéi einfach Sich; et verbessert och d'Potenzial vum Ökosystem fir generativ AI Uwendungen.

Azure OpenAI Studio fir Modell Embedding an Azure AI Services fir Bildrecuperatioun sinn nëmmen zwee Beispiller vun de Servicer déi an dëser Integratioun abegraff sinn.

Azure AI Search ass eng flexibel Léisung fir Entwéckler déi raffinéiert Sichfunktiounen an hiren Uwendungen wëllen opbauen wéinst senger extensiv Ënnerstëtzung, déi eng breet Palette vun Uwendungen erméiglecht, vun Ähnlechkeetssich a multimodal Sich bis Hybrid Sich a méisproocheg Sich.

Tarifikatioun

Dir kënnt ufänken et gratis ze benotzen an Premium Präisser fänken un $ 0.11 / Stonn.

Konklusioun

Vector Datenbanken transforméieren d'Datemanagement an AI andeems se héichdimensional Vektore verwalten, wat fir staark Ähnlechkeetssich a séier noosten Noperen Ufroen an Uwendungen wéi Empfehlungssystemer a Bedruchdetektioun erlaabt.

Mat der Notzung vu sophistikéierten Indexalgorithmen konvertéieren dës Datenbanken komplizéiert onstrukturéiert Daten a sënnvoll Vektoren, wärend d'Geschwindegkeet an d'Flexibilitéit ubidden, déi traditionell Datenbanken net maachen.

Notabele Plattformen enthalen Pinecone, déi an generativen AI Uwendungen blénkt; FAISS, erstallt vu Facebook AI fir dichte Vektorcluster; a Milvus, déi bekannt ass fir seng Skalierbarkeet a Cloud-native Architektur.

Weaviate kombinéiert Maschinnléiere mat kontextbewosst Sich, wärend Vespa a Chroma bemierkenswäert sinn fir hir Low-latency Rechenfäegkeeten respektiv einfach ze benotzen.

Vector Datenbanken si vital Tools fir d'Entwécklung vun AI a Maschinnléiere Technologien zanter Plattformen wéi Qdrant, AstraDB, OpenSearch, an Azure AI Search eng Vielfalt vu Servicer ubidden, vu serverlosen Architekturen bis extensiv Sich- an Analysefäegkeeten.

Hannerlooss eng Äntwert