Inhaltsverzeechnes[Verstoppen][Show]

Kënschtlech Intelligenz (AI) gouf ursprénglech als wäit ewech geduecht, eng Technologie fir d'Zukunft, awer dat ass net méi de Fall.

Wat eemol e Fuerschungsthema war, explodéiert elo an der realer Welt. AI gëtt elo a ville Plazen fonnt, dorënner Är Aarbechtsplaz, Schoul, Banken, Spideeler, a souguer Ären Telefon.

Si sinn d'Ae vu selbstfahrenden Gefierer, dem Siri seng an dem Alexa seng Stëmmen, d'Gedanken hannert Wiederprevisioune, d'Hänn hannert Roboter-assistéiert Chirurgie, a méi.

kënschtlech Intelligenz (AI) gëtt eng allgemeng Feature vum modernen Liewen. An de leschte Joren ass AI als e grousse Spiller an enger breet Palette vun IT Technologien entstanen.

Schlussendlech gëtt den neurale Netzwierk vun AI benotzt fir nei Saachen ze léieren.

Also haut léiere mir iwwer Neural Netzwierker, wéi et funktionnéiert, hir Aarte, Uwendungen a vill méi.

Wat ass Neural Netzwierk?

In Maschinn léieren, en neuralt Netzwierk ass e softwareprogramméiert Netzwierk vu kënschtlechen Neuronen. Et probéiert de mënschleche Gehir ze imitéieren andeems se vill Schichten vun "Neuronen" hunn, déi ähnlech wéi d'Neuronen an eisem Gehir sinn.

Déi éischt Schicht vun Neuronen akzeptéiert Fotoen, Video, Toun, Text an aner Inputen. Dës Donnéeë fléissen duerch all Niveauen, mat der Ausgang vun enger Schicht an déi nächst. Dëst ass kritesch fir déi schwieregst Aufgaben, sou wéi natierlech Sproochveraarbechtung fir Maschinnléieren.

Wéi och ëmmer, an anere Fäll ass d'Ziel fir Systemkompressioun fir d'Modellgréisst ze reduzéieren wärend d'Genauegkeet an d'Effizienz behalen. En neuralt Netzwierk ze prunen ass eng Kompressiounsmethod déi d'Gewiichte vun engem geléierte Modell erofhuelen. Betruecht e kënschtlech Intelligenz neuralt Netzwierk dat trainéiert gouf fir Leit vun Déieren z'ënnerscheeden.

D'Bild gëtt an hell an donkel Deeler vun der éischter Schicht vun Neuronen opgedeelt. Dës Donnéeë ginn an déi folgend Schicht weiderginn, déi bestëmmen wou d'Kante sinn.

Déi nächst Layer wäert probéieren d'Formen ze erkennen, déi d'Kantekombinatioun generéiert huet. No den Donnéeën op déi se trainéiert goufen, wäerten d'Donnéeën duerch vill Schichten op eng ähnlech Manéier passéieren fir ze bestëmmen ob d'Bild dat Dir presentéiert hutt vun engem Mënsch oder engem Déier ass.

Wann d'Donnéeën an en neuralt Netzwierk ginn, fänkt se un ze veraarbecht. Duerno ginn d'Donnéeën iwwer seng Niveauen veraarbecht fir dat gewënschte Resultat ze kréien. En neuralt Netzwierk ass eng Maschinn déi aus strukturéierten Input léiert an d'Resultater weist. Et ginn dräi Aarte vu Léieren déi an neurale Netzwierker stattfannen kënnen:

- Iwwerwaacht Léieren - Input an Ausgänge ginn un d'Algorithmen mat markéierten Donnéeën. Nodeems se geléiert gi wéi d'Daten analyséiere kënnen, prognostizéiere se dat virgesinnt Resultat.

- Unsupervised Learning - Eng ANN léiert ouni d'Hëllef vun engem Mënsch. Et gi keng markéiert Daten, an den Ausgang gëtt entscheet duerch Mustere fonnt an den Ausgangsdaten.

- Verstäerkung Léieren ass wann en Netzwierk léiert aus dem Feedback deen et kritt.

Wéi funktionnéieren Neural Netzwierker?

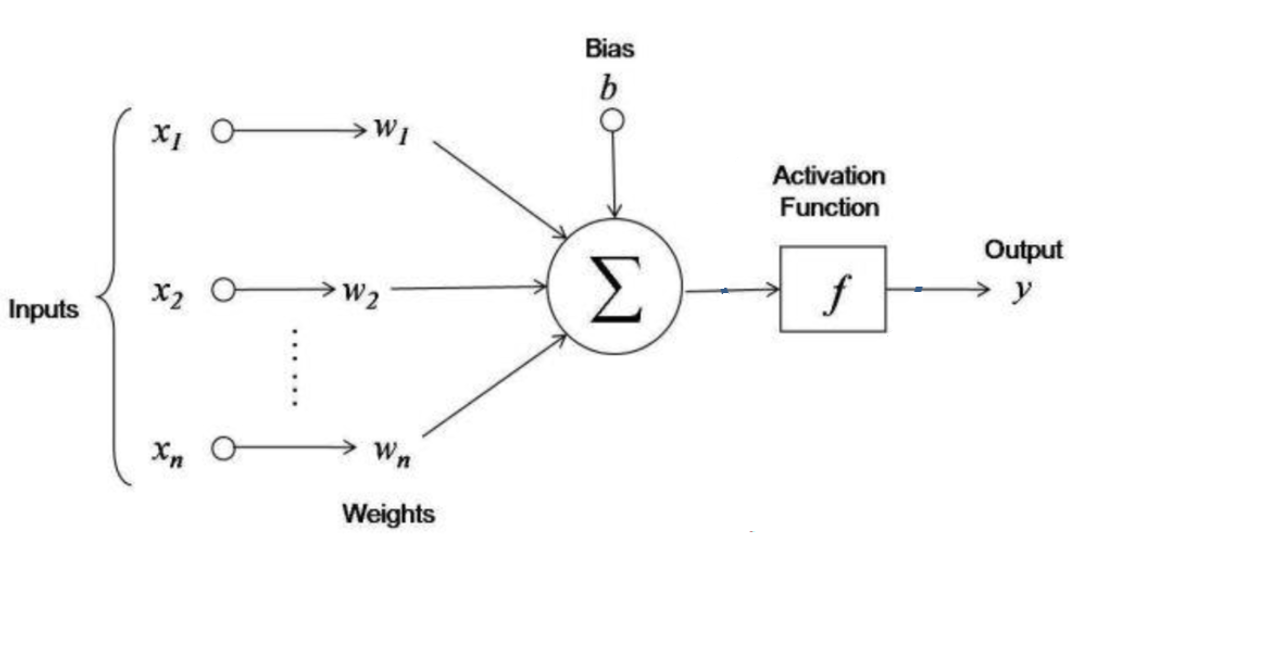

Kënschtlech Neuronen ginn an neuralen Netzwierker benotzt, déi sophistikéiert Systemer sinn. Déi kënschtlech Neuronen, och bekannt als Perceptronen, besteet aus de folgende Komponenten:

- Input

- Gewiicht

- Bias

- Aktivéierung Funktioun

- Däischterheet

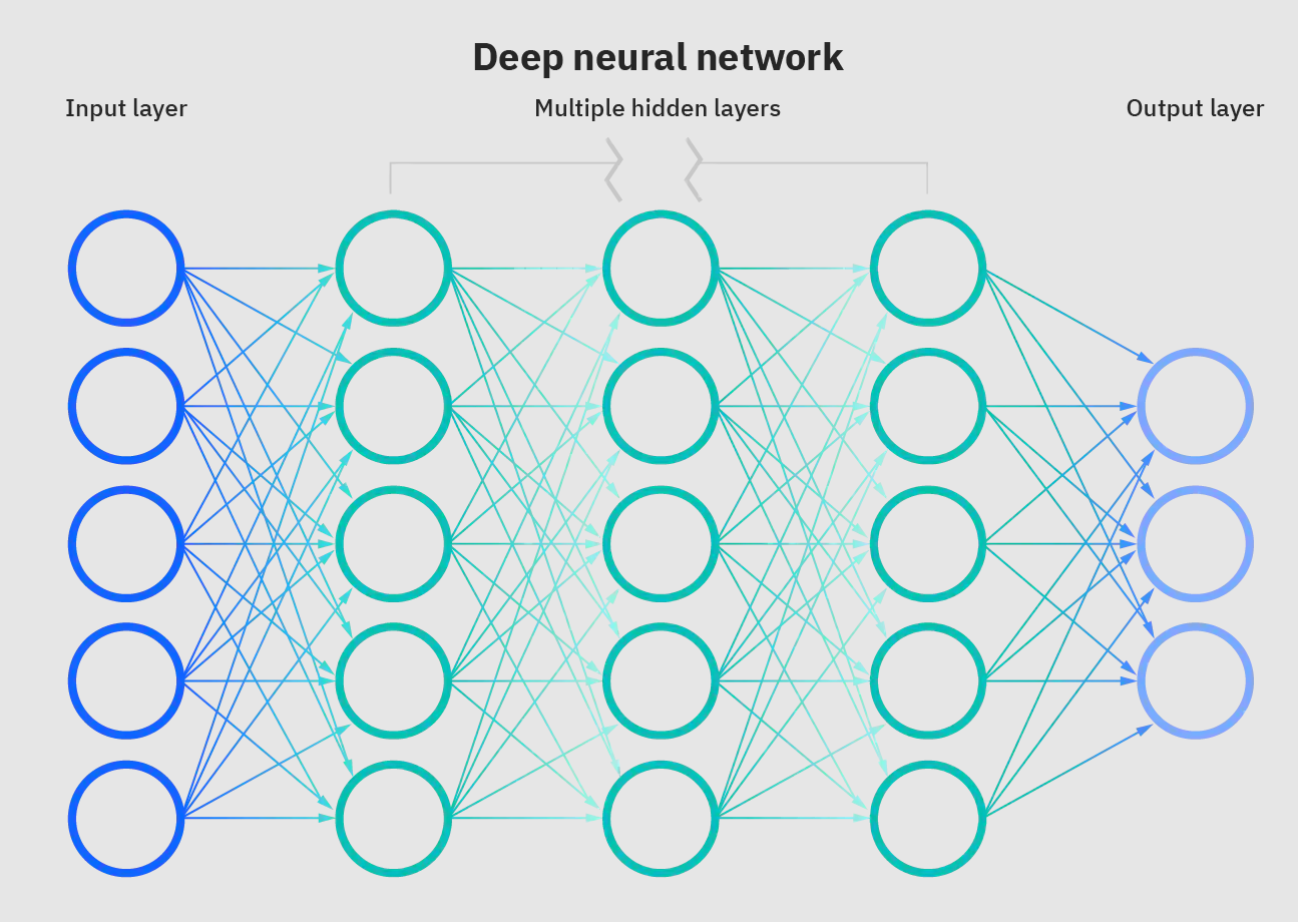

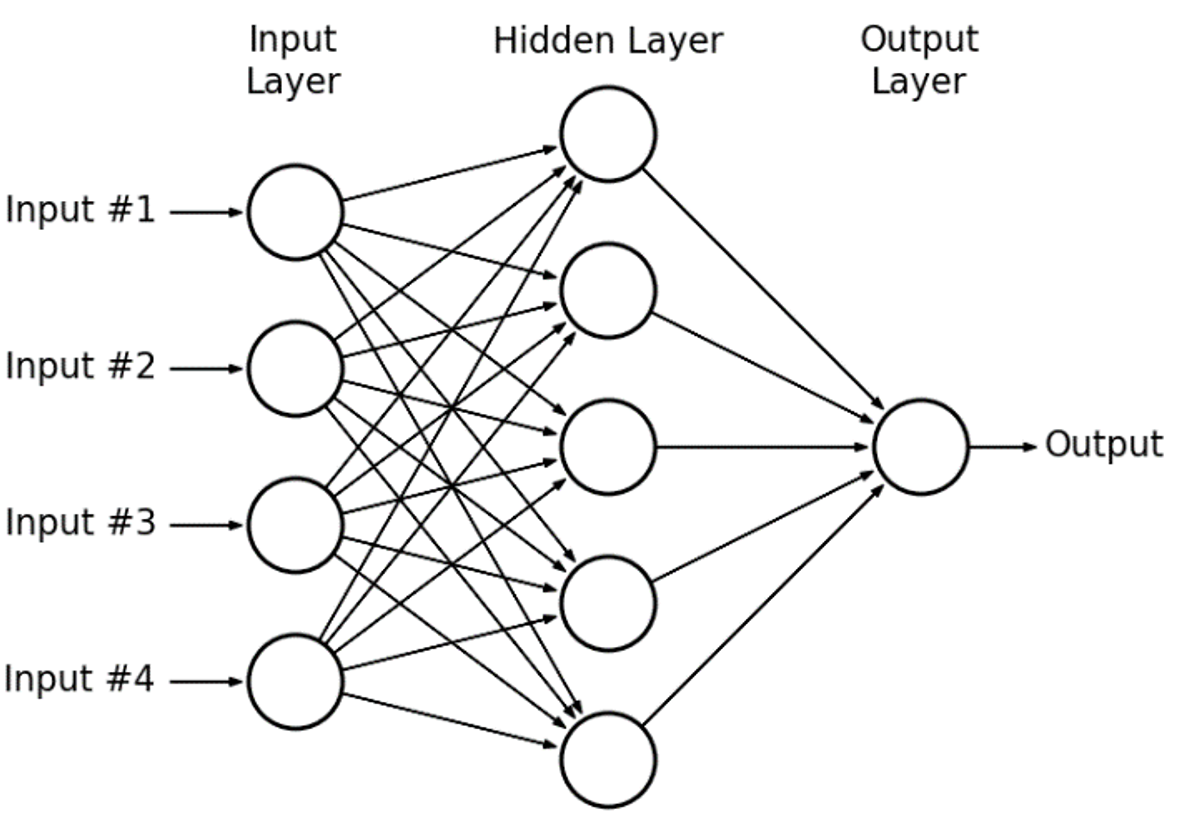

D'Schichten vun Neuronen déi neural Netzwierker ausmaachen. En neuralt Netzwierk besteet aus dräi Schichten:

- Input Layer

- Verstoppt Layer

- Ausgangsschicht

Daten a Form vun engem numeresche Wäert ginn op d'Inputschicht geschéckt. Déi verstoppte Schichten vum Netz sinn déi, déi am meeschte Berechnunge maachen. D'Ausgabschicht, lescht awer net zulescht, prognostizéiert d'Resultat. Neuronen dominéieren een aneren an engem neurale Netzwierk. Neuronen gi benotzt fir all Schicht ze konstruéieren. Daten ginn op déi verstoppte Schicht geréckelt nodeems d'Inputschicht et kritt.

Gewiichter ginn op all Input applizéiert. Bannent de verstoppte Schichten vun engem neurale Netzwierk ass d'Gewiicht e Wäert deen erakommen Daten iwwersetzt. Gewiichter funktionnéieren andeems d'Inputdaten mam Gewiichtwäert an der Inputschicht multiplizéiert ginn.

Et fänkt dann de Wäert vun der éischter verstoppt Layer un. D'Inputdaten ginn transforméiert an iwwer déi verstoppte Schichten an déi aner Layer weiderginn. D'Outputschicht ass verantwortlech fir d'Endresultat ze generéieren. D'Inputen a Gewiichter ginn multiplizéiert, an d'Resultat gëtt un déi verstoppte Schichtneuronen als Zomm geliwwert. All Neuron gëtt eng Bias gegeben. Fir den Total ze berechnen, füügt all Neuron d'Inputen un déi se kritt.

Duerno passéiert de Wäert iwwer d'Aktivéierungsfunktioun. D'Resultat vun der Aktivéierungsfunktioun bestëmmt ob en Neuron aktivéiert ass oder net. Wann en Neuron aktiv ass, schéckt se Informatioun un déi aner Schichten. D'Donnéeën ginn am Netz erstallt bis den Neuron d'Ausgangsschicht mat dëser Method erreecht. Forward Verbreedung ass en anere Begrëff fir dëst.

D'Technik fir Daten an en Input Node ze fidderen an den Ausgang duerch en Output Node ze kréien ass bekannt als Feed-Forward Verbreedung. Wann d'Inputdaten vun der verstoppter Schicht akzeptéiert ginn, geschitt Feed-Forward Verbreedung. Et gëtt no der Aktivéierungsfunktioun veraarbecht an dann un d'Ausgab weiderginn.

D'Resultat gëtt vum Neuron an der Ausgangsschicht mat der héchster Wahrscheinlechkeet projizéiert. Réckpropagatioun geschitt wann d'Ausgab falsch ass. Gewiichter ginn op all Input initialiséiert wärend en neuralt Netzwierk erstallt. Backpropagation ass de Prozess fir d'Gewiichter vun all Input nei unzepassen fir Feeler ze reduzéieren an e méi genee Output ze bidden.

Aarte vun Neural Netzwierker

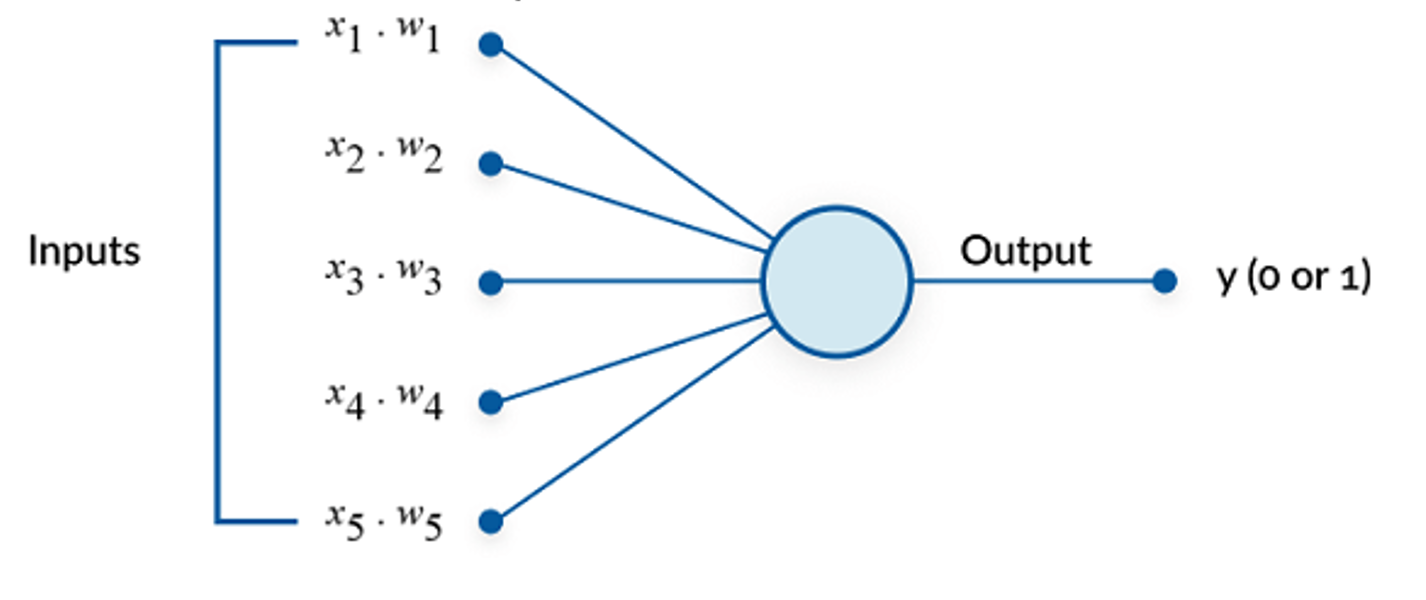

1. Perceptron

De Minsky-Papert Perceptronmodell ass ee vun den einfachsten an eelsten Neuronmodeller. Et ass déi klengst Eenheet vun engem neurale Netzwierk dat bestëmmte Berechnungen ausféiert fir Charakteristiken oder Geschäftsintelligenz an erakommen Daten z'entdecken. Et hëlt gewiichten Inputen an applizéiert d'Aktivéierungsfunktioun fir dat lescht Resultat ze kréien. TLU (Threshold Logic Unit) ass en aneren Numm fir Perceptron.

Perceptron ass e binäre Klassifizéierer deen e iwwerwaachte Léiersystem ass deen Daten an zwou Gruppen opdeelt. Logesch Gates wéi AND, ODER, an NAND kënne mat Perceptronen ëmgesat ginn.

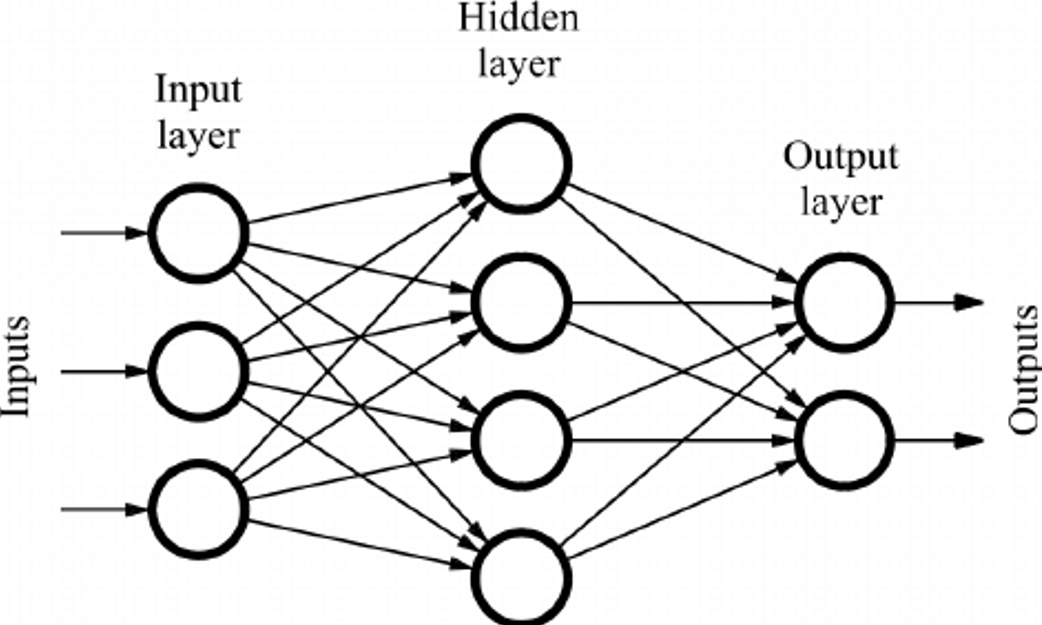

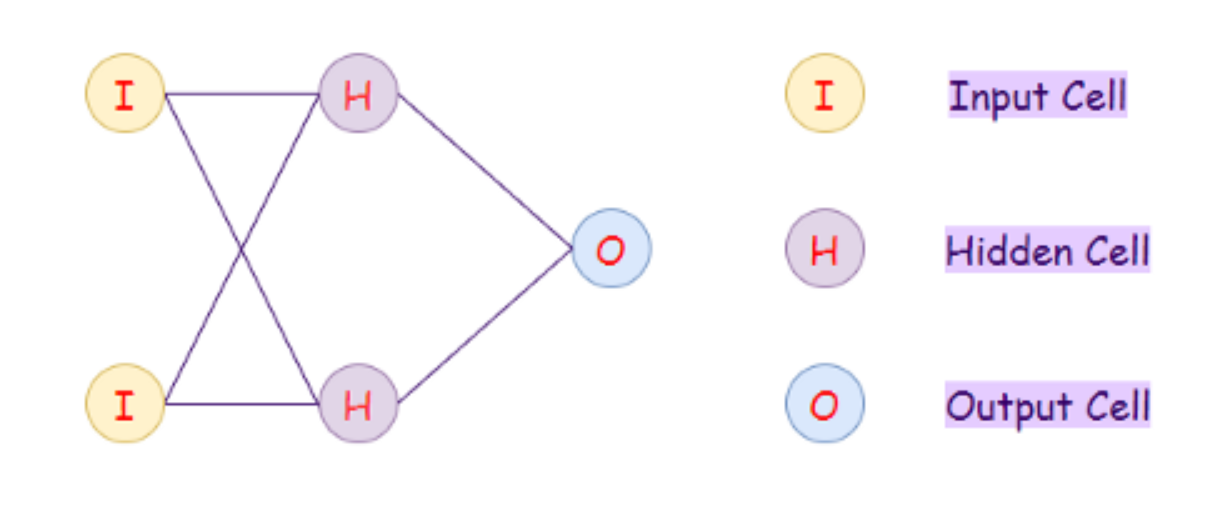

2. Feed-Forward Neural Network

Déi meescht Basis Versioun vun neuralen Netzwierker, an deenen d'Inputdaten exklusiv an eng Richtung fléissen, passéiert iwwer kënschtlech neural Wirbelen a geet duerch Ausgangsnoden eraus. Input- an Outputschichten sinn op Plazen präsent wou verstoppte Schichten präsent sinn oder net. Si kënne charakteriséiert ginn entweder als een-Schichten oder Multi-Layer Feed-Forward neuralt Netzwierk baséiert op dësem.

D'Zuel vun de Schichten benotzt gëtt vun der Komplexitéit vun der Funktioun bestëmmt. Et propagéiert nëmme vir an eng Richtung a propagéiert net no hannen. Hei bleiwen d'Gewiichter konstant. Input gi mat Gewiichter multiplizéiert fir eng Aktivéierungsfunktioun ze fidderen. Eng Klassifikatioun Aktivéierungsfunktioun oder eng Schrëtt Aktivéierungsfunktioun gëtt benotzt fir dëst ze maachen.

3. Multi-Layer Perceptron

Eng Aféierung an sophistikéiert neural Netz, an deenen Inputdaten iwwer vill Schichten vu kënschtlechen Neuronen geréckelt ginn. Et ass e komplett verlinkt neuralt Netzwierk, well all Node ass mat all Neuronen an der folgender Schicht verbonnen. Multiple verstoppte Schichten, dh op d'mannst dräi oder méi Schichten, sinn an den Input- an Outputschichten präsent.

Et besëtzt bidirektional Ausbreedung, dat heescht datt et sech no vir an no hanne kann propagéieren. D'Inpute ginn duerch Gewiicht multiplizéiert an an d'Aktivéierungsfunktioun geschéckt, wou se iwwer Backpropagatioun geännert ginn fir de Verloscht ze minimiséieren.

Gewiichter si Maschinn geléiert Wäerter vun Neural Networks, fir et einfach ze soen. Ofhängeg vun der Disparitéit tëscht erwaarten Ausgängen an Trainingsinputen, passen se sech selwer un. Softmax gëtt als Output Layer Aktivéierungsfunktioun no net-linear Aktivéierungsfunktiounen benotzt.

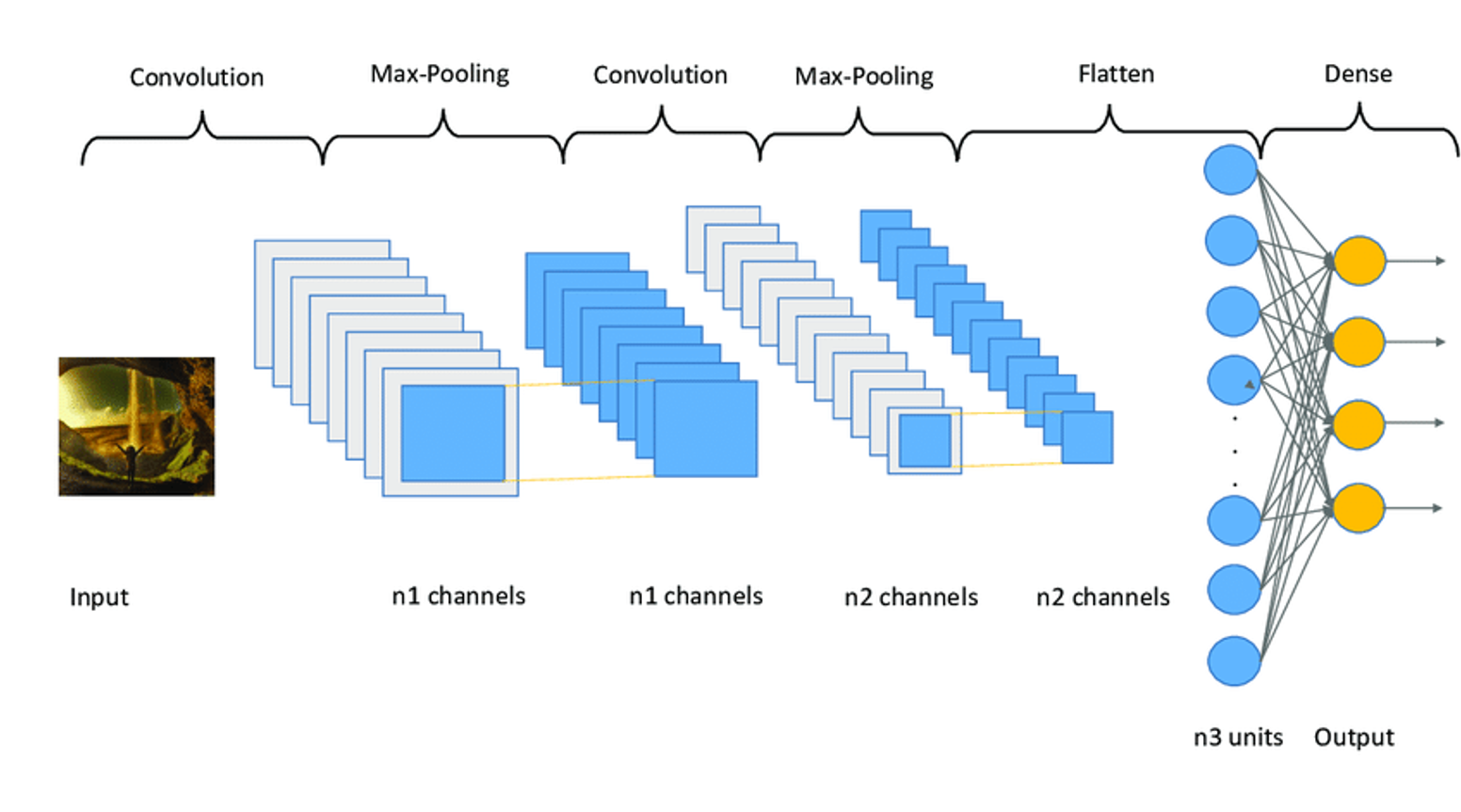

4. Convolutional Neural Network

Am Géigesaz zu der traditioneller zweedimensionaler Array huet e Konvolutiounsneuralnetz eng dreidimensional Konfiguratioun vun Neuronen. Déi éischt Schicht ass bekannt als Konvolutionschicht. All Neuron an der convolutionaler Schicht veraarbecht nëmmen Informatioun aus engem limitéierten Deel vum visuelle Feld. Wéi e Filter ginn Input Feature am Batchmodus geholl.

D'Netzwierk versteet Biller a Sektiounen a kann dës Aktiounen e puer Mol ausféieren fir déi ganz Bildveraarbechtung ofzeschléissen.

D'Bild gëtt wärend der Veraarbechtung vun RGB oder HSI a Greyscale ëmgewandelt. Weider Variatiounen am Pixelwäert hëllefen d'Kanten z'entdecken, a Biller kënnen a verschidde Gruppen zortéiert ginn. Unidirektional Ausbreedung geschitt wann e CNN eng oder méi Konvolutiounsschichten enthält, gefollegt vu Pooling, a bidirektional Ausbreedung geschitt wann d'Ausgab vun der Konvolutiounsschicht an e komplett verbonne neuralt Netzwierk fir Bildklassifikatioun geschéckt gëtt.

Fir verschidden Elementer vun engem Bild ze extrahieren, gi Filtere benotzt. Am MLP ginn d'Inputen gewiicht an an d'Aktivéierungsfunktioun geliwwert. RELU gëtt a Konvolutioun benotzt, wärend MLP eng net-linear Aktivéierungsfunktioun benotzt gefollegt vu Softmax. A Bild- a Videoerkennung, semantescher Parsing, a Paraphrase Detektioun, konvolutional neural Netzwierker produzéieren exzellent Resultater.

5. Radial Bias Network

En Inputvektor gëtt gefollegt vun enger Schicht vu RBF Neuronen an enger Ausgangsschicht mat engem Node fir all Kategorie an engem Radial Basis Funktiounsnetz. Den Input gëtt klasséiert andeems se et mat Datenpunkten aus dem Trainingsset vergläicht, wou all Neuron e Prototyp ënnerhält. Dëst ass ee vun de Beispiller vum Trainingsset.

All Neuron berechent d'Euklidesch Distanz tëscht dem Input a sengem Prototyp wann e frëschen Inputvektor [den n-dimensionalen Vektor deen Dir versicht ze kategoriséieren] muss klasséiert ginn. Wa mir zwou Klassen hunn, Klass A a Klass B, ass den neien Input fir ze kategoriséieren méi ähnlech wéi Klass A Prototypen wéi Klass B Prototypen.

Als Resultat kann et als Klass A bezeechent oder kategoriséiert ginn.

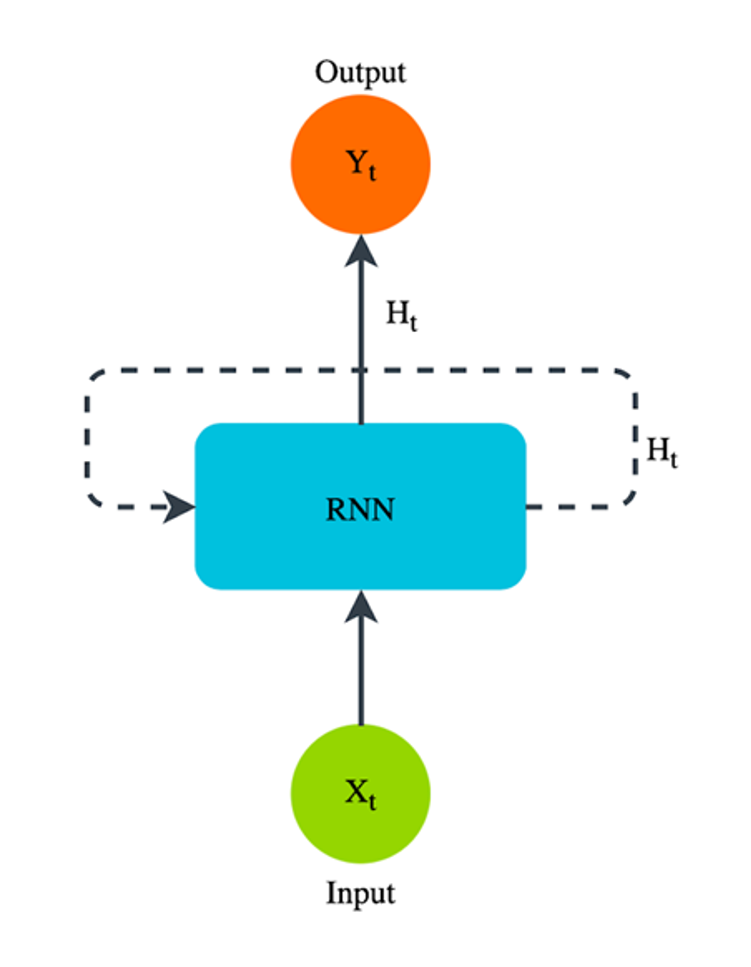

6. Widderhuelend Neural Netzwierk

Widderhuelend Neural Netzwierker sinn entwéckelt fir den Output vun enger Schicht ze späicheren an dann an den Input ze fidderen fir d'Prognosen vun der Schicht ze hëllefen. E Feed-Forward neural Netz ass normalerweis déi initial Schicht, gefollegt vun enger widderhuelender neuraler Netzwierkschicht, wou eng Erënnerungsfunktioun en Deel vun der Informatioun erënnert, déi se am virege Zäitstuf hat.

Dëse Szenario benotzt Forward Verbreedung. Et späichert Daten déi an Zukunft gebraucht ginn. Am Fall wou d'Prognose falsch ass, gëtt de Léierrate benotzt fir kleng Upassungen ze maachen. Als Resultat, wéi d'Réckpropagatioun weidergeet, wäert et ëmmer méi korrekt ginn.

Applicatioun

Neural Netzwierker gi benotzt fir Datenproblemer a verschiddene Disziplinnen ze handhaben; e puer Beispiller sinn ënnert gewisen.

- Gesiichtserkennung - Gesiichtserkennungsléisungen déngen als effektiv Iwwerwaachungssystemer. Unerkennungssystemer bezéien digital Fotoen op mënschlech Gesiichter. Si ginn a Büroe fir selektiv Entrée benotzt. Sou verifizéieren d'Systemer e mënschlecht Gesiicht a vergläichen et mat enger Lëscht vun IDen, déi a senger Datebank gespäichert sinn.

- Aktie Prediction - Investitiounen sinn u Maartrisiken ausgesat. Et ass praktesch schwéier fir zukünfteg Entwécklungen am extrem volatile Börsemaart virauszesoen. Virun neurale Netzwierker waren déi stänneg verännerend bullish a bearish Phasen onberechenbar. Awer, wat huet alles geännert? Natierlech schwätze mir iwwer neural Netzwierker ... E Multilayer Perceptron MLP (eng Zort Feedforward kënschtlech Intelligenz System) gëtt benotzt fir eng erfollegräich Aktieprognose an Echtzäit ze kreéieren.

- Sozial Medien - Egal wéi corny et kléngt, soziale Medien hunn de weltleche Wee vun der Existenz geännert. D'Behuele vu soziale Medien Benotzer gëtt mat kënschtlechen Neural Netzwierker studéiert. Fir kompetitiv Analyse ginn Daten, déi all Dag iwwer virtuell Interaktioune geliwwert ginn, opgestapelt an iwwerpréift. D'Aktiounen vun de soziale Medien Benotzer ginn duerch neural Netzwierker replizéiert. D'Behuelen vun Individuen kënne mat de Ausgabemuster vun de Leit verbonne ginn wann d'Donnéeën iwwer soziale Medien Netzwierker analyséiert ginn. Date vu soziale Medienapplikatioune gi mat Multilayer Perceptron ANN ofgebaut.

- Gesondheetsariichtung - Eenzelpersounen an der heiteger Welt benotzen d'Virdeeler vun der Technologie an der Gesondheetsindustrie. Am Gesondheetsgeschäft gi Convolutional Neural Networks fir Röntgendetektioun, CT Scans an Ultraschall benotzt. Déi medizinesch Imagingdaten, déi vun den uewe genannten Tester kritt goufen, ginn evaluéiert a bewäert mat neuralen Netzwierkmodeller, well CNN an der Bildveraarbechtung benotzt gëtt. An der Entwécklung vu Stëmmerkennungssystemer gëtt och de recurrent neurale Netzwierk (RNN) benotzt.

- Wiederbericht - Virun der Ëmsetzung vun der kënschtlecher Intelligenz waren d'Projektioune vum meteorologeschen Departement ni präzis. D'Wiederprevisioun gëtt gréisstendeels gemaach fir d'Wiederkonditiounen virauszesoen déi an Zukunft optrieden. Wiederprevisiounen gi benotzt fir d'Wahrscheinlechkeet vun Naturkatastrophen an der moderner Period virzegoen. D'Wiederprevisioun gëtt mat Multilayer Perceptron (MLP), convolutional neural Netzwierker (CNN) a recurrent neural Netzwierker (RNN) gemaach.

- Verdeedegung - Logistik, bewaffnete Attentat Analyse, an Element Location all benotzen neural Netzwierker. Si sinn och a Loft- a Mierpatrullen beschäftegt, souwéi fir autonom Dronen ze managen. Kënschtlech Intelligenz gëtt der Verteidegungsindustrie dee vill gebrauchte Boost déi se brauch fir seng Technologie opzebauen. Fir d'Existenz vun Underwater Minen z'entdecken, ginn Convolutional Neural Networks (CNN) benotzt.

Virdeeler

- Och wann e puer Neuronen an engem neurale Netzwierk net richteg funktionnéieren, generéieren déi neural Netzwierker nach ëmmer Ausgänge.

- Neural Netzwierker hunn d'Fäegkeet an Echtzäit ze léieren an un hir verännerend Astellungen unzepassen.

- Neural Netzwierker kënne léieren eng Vielfalt vun Aufgaben ze maachen. Fir dat richtegt Resultat op Basis vun den geliwwerten Donnéeën ze liwweren.

- Neural Netzwierker hunn d'Kraaft a Fäegkeet fir verschidden Aufgaben zur selwechter Zäit ze verschaffen.

Nodeeler

- Neural Netzwierker gi benotzt fir Probleemer ze léisen. Et verroden net d'Erklärung hannert "firwat a wéi" et huet d'Urteeler gemaach, déi et gemaach huet wéinst der Komplikatioun vun den Netzwierker. Als Resultat kann d'Netzvertrauen erodéiert ginn.

- D'Komponente vun engem neurale Netzwierk sinn interofhängeg vuneneen. Dat ass ze soen, neural Netzwierker verlaangen (oder sinn extrem ofhängeg vun) Computere mat genuch Rechenkraaft.

- En neurale Netzwierkprozess huet keng spezifesch Regel (oder Daumenregel). An enger Test-a-Fehler-Technik gëtt eng korrekt Netzwierkstruktur etabléiert andeems Dir den optimalen Netz probéiert. Et ass eng Prozedur déi vill Feintuning erfuerdert.

Konklusioun

D'Gebitt vun neural Netzwierker ass séier ausgebaut. Et ass kritesch d'Konzepter an dësem Secteur ze léieren an ze verstoen fir mat hinnen ëmzegoen.

Déi vill Aarte vun neuralen Netzwierker goufen an dësem Artikel ofgedeckt. Dir kënnt neural Netzwierker benotze fir Datenproblemer an anere Felder unzegoen wann Dir méi iwwer dës Disziplin léiert.

Hannerlooss eng Äntwert