Inhaltsverzeechnes[Verstoppen][Show]

Cloud GPUs si grouss Nofro wéi nei Technologien wéi Deep Learning, AI, a Maschinnléieren entstinn.

GPUs (Graphics Processing Units) si spezialiséiert Prozessoren, déi gemaach gi fir déi enorm Datesets a komplizéierte Berechnungen ze handhaben, déi néideg sinn fir Aktivitéite wéi Computergrafik a Gaming. Si sinn elo entscheedend fir den Terrain vun Kënschtlech Intelligenz (AI) och, awer, wéi spéit.

Traditionell CPUs (Central Processing Units) sinn net fäeg der Nofro z'erreechen well AI Modeller eng bedeitend Quantitéit un Rechenkraaft erfuerderen fir ze trainéieren a lafen.

Op der anerer Säit, well se gebaut gi fir d'parallel Veraarbechtung z'ënnerstëtzen, sinn GPUs méi effektiv fir déi massiv Volumen vun Daten an komplizéierte Berechnungen ze managen, déi fir AI Operatiounen néideg sinn.

Wann Dir am Tech sidd, musst Dir iwwer Cloud GPU Servicer héieren hunn. Fir déi, déi net matgoen.

E Cloud-baséiert Service deen de Benotzer online Zougang zu potente GPU Ressourcen gëtt ass bekannt als Cloud GPU Service fir AI. Amplaz hir eege GPU Hardware ze kafen an z'erhalen, erlaben dës Servicer Clienten GPU Ressourcen ze lounen wéi néideg.

Dëst mécht et machbar fir Leit an Organisatiounen d'Veraarbechtungskapazitéit vun de GPUs ze benotzen ouni eng bedeitend initial Investitioun ze maachen oder weider Ënnerhaltkäschten ze bezuelen.

D'Majoritéit vun de Cloud GPU Servicer fir AI bitt eng breet Varietéit vu GPU Optiounen, dorënner verschidde Modeller a Konfiguratiounen an d'Flexibilitéit fir op oder erof ze skaléieren wéi néideg. Dir kënnt elo déi ideal GPU Ressourcen fir hir eenzegaarteg Ufuerderungen a Projeten dank dësem Service auswielen.

Zousätzlech kommen d'Servicer dacks mat anere Fäegkeeten, dorënner Netzwierker, Späicheren a Software Tools fir Clienten an hiren AI Projeten ze hëllefen. An dësem Post wäerte mir déi Top Cloud GPU Servicer fir AI kucken.

1. Linode

Linode bitt GPUs op Ufro fir Aarbechtslaaschten wéi Videoveraarbechtung, wëssenschaftlech Informatik, Maschinn léieren, kënschtlech Intelligenz, an anerer.

Et bitt GPU-optimiséiert virtuell Maschinnen (VMs) déi op NVIDIA Quadro RTX 6000, Tensor, a RT Cores lafen a benotzt CUDA Kapazitéit fir ze maachen ze léieren, Ray Tracing Aarbechtslaascht, a komplexe Berechnungen.

Andeems Dir Är Kapitalausgaben an eng Operatiounskäschte ëmgewandelt hutt, kënnt Dir d'GPU-Kapazitéit vun der Linode GPU an de reelle Wäert vun der Wollek benotzen.

Zousätzlech befreit Linode Iech vun der Hardware ze këmmeren fir datt Dir op Är stäerkste Fäegkeeten konzentréiere kënnt.

Mat Linode GPUs ass et elo méiglech se fir sophistikéiert Uwendungen wéi Videostreaming, kënschtlech Intelligenz a Maschinnléieren ze benotzen.

Zousätzlech, ofhängeg vun der Quantitéit vun der Veraarbechtungskraaft, déi fir erwaart Aarbechtslaascht néideg ass, kënnt Dir bis zu 4 Kaarte fir all Instanz kréien.

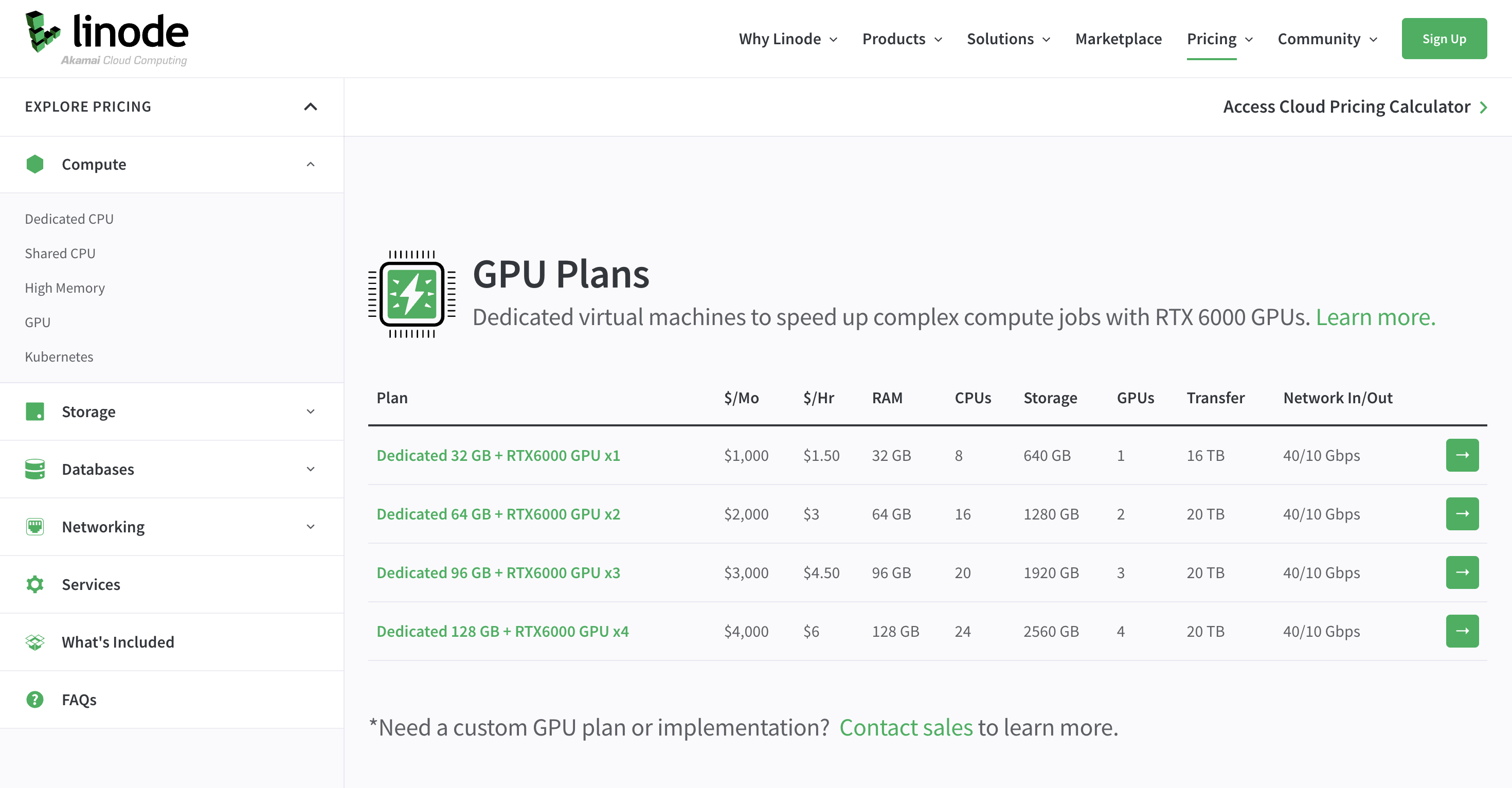

Tarifikatioun

Präisser fänken un $ 1.5 / Stonn fir den dedizéierten RTX6000 GPU Plang. Fänkt mat Linode gratis un.

2. Grouss AI

Vast AI ass e weltwäite Maartplaz wou d'Benotzer preiswerte GPUs kënne lounen fir an High-Performance Computing ze benotzen.

Si reduzéieren d'Käschte vu computationally schwéieren Aufgaben andeems d'Host et erlaben hir GPU-Hardware ze leasen, wat d'Benotzer erlaabt hiren Online Sichinstrument ze benotzen fir déi bëllegst Präisser fir Informatik am Aklang mat hire Bedierfnesser ze fannen an Kommandoen auszeféieren oder SSH Verbindungen ze starten.

Si bidden SSH Instanzen, Jupyter Instanzen mat der Jupyter GUI, oder Kommando-nëmmen Instanzen, a weisen eng einfach User Interface.

Eng Deep Learning Performance Funktioun (DLPerf), déi eng geschätzte Deep Learning Task Leeschtung prognostizéiert, gëtt och zur Verfügung gestallt.

D'Systeme benotzt vu Vast AI sinn Ubuntu-baséiert a bidden keng Remote Desktops. Si bedreiwen och Instanzen déi verfügbar sinn op Ufro fir eng spezifesch Frais, déi vum Host etabléiert ass.

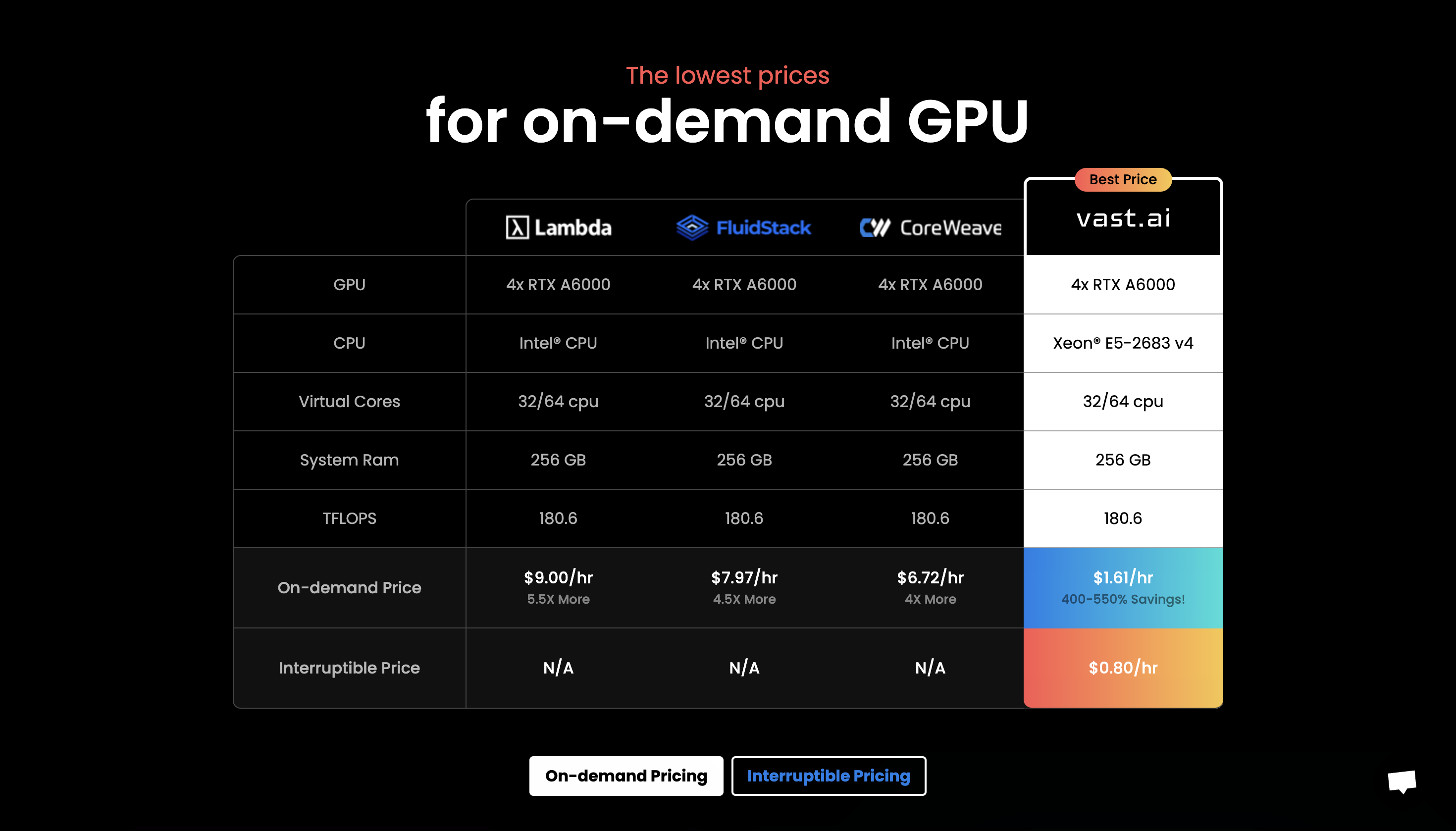

Tarifikatioun

De Präis fänkt bei $ 0.80 / Stonn fir 4x RTX A6000 un.

3. AWS & NVIDIA

Zesummen, AWS an NVIDIA liwweren konsequent GPU-baséiert Léisungen déi bezuelbar, adaptéierbar a mächteg sinn.

Et enthält NVIDIA GPU-ugedriwwen Amazon EC2 Instanzen a Servicer wéi AWS IoT Greengrass déi mat NVIDIA Jetson Nano Moduler installéiert.

Fir virtuell Aarbechtsstatiounen, Maschinn Léieren (ML), Internet of Things (IoT) Servicer, an High-Performance Computing, benotzen d'Benotzer AWS an NVIDIA. Skalierbar Leeschtung gëtt vun den NVIDIA GPUs zur Verfügung gestallt, déi Amazon EC2 Instanzen ubidden.

Zousätzlech benotzt AWS IoT Greengrass fir NVIDIA-baséiert Randgeräter mat den AWS Cloud Servicer ze verbannen.

Amazon EC2 P4d Instanzen ginn ugedriwwen vun NVIDIA A100 Tensor Core GPUs, déi d'Industrie déi niddregst Latenzvernetzung an héchsten Duerchsatz ubidden.

Ähnlech zu dësem ginn et aner verschidden Instanzen verfügbar fir gewëssen Ëmstänn, sou wéi Amazon EC2 P3, Amazon EC2 G4, etc.

Tarifikatioun

Dir kënnt e gratis Test ufroen a kontaktéiert w.e.g. de Verkeefer fir seng Präisser.

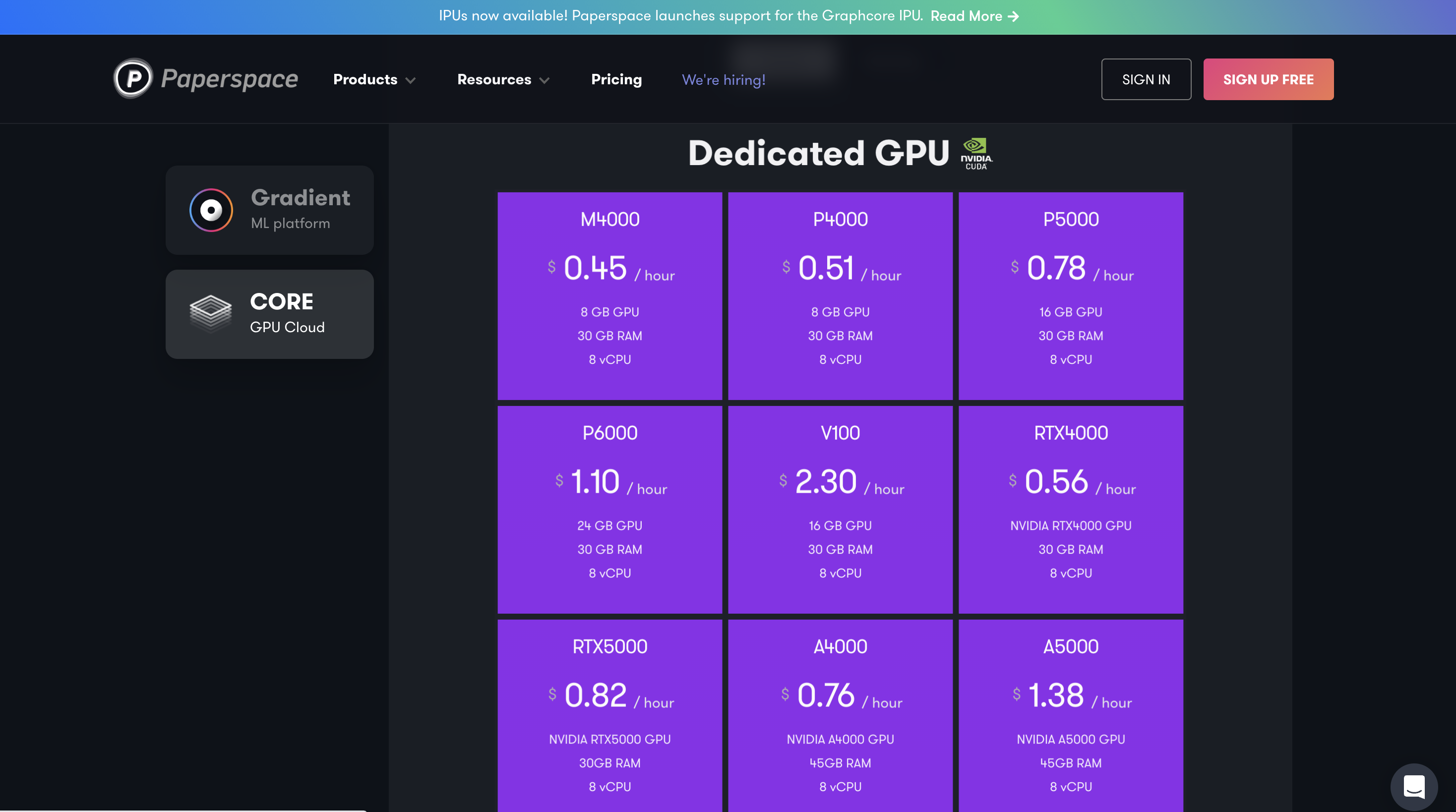

4. Paperspace CORE

E CORE ass eng voll geréiert Cloud GPU Plattform erstallt vu Paperspace déi einfach, kosteneffektiv a beschleunegt Informatik fir eng Vielfalt vun Uwendungen ubitt.

Benotzt déi modernst beschleunegt Recheninfrastruktur, déi vum Paperspace CORE zur Verfügung gestallt gëtt, fir organisatoresch Prozesser ze beschleunegen. Fir séier Onboarding, kollaborativ Tools, an Desktop Uwendungen fir Mac, Linux a Windows, bitt et eng userfrëndlech an onkomplizéiert Interface.

Benotzt et fir exigent Programmer op eng onendlech Betrag vun der Veraarbechtungskraaft auszeféieren. CORE bitt e super-schnell Netzwierk, séier Bestëmmung, Ënnerstëtzung fir 3D Apps, an e komplette API fir programmateschen Zougang.

Mat engem einfach ze benotzen an intuitive GUI, kritt e komplett Bild vun Ärer Infrastruktur op enger Plaz.

Zousätzlech kritt Dir exzellent Kontroll dank der CORE Administratiounsinterface, déi mächteg Tools ubitt an Iech erlaabt Maschinnen, Netzwierker a Benotzer ze filteren, ze sortéieren, ze verbannen oder ze kreéieren.

Tarifikatioun

Präisser fänken un $ 0.45 / Stonn fir déi engagéiert M4000 GPU.

5. Alibaba Elastic GPU Service

Alibaba Elastic GPU Service (EGS) benotzt GPU Technologie fir parallel a mächteg Veraarbechtungsfäegkeeten ze liwweren. Vill Uwendungen, dorënner Videoveraarbechtung, Visualiséierung, wëssenschaftlech Informatik, an Deep Learning, si gutt dofir gëeegent.

EGS benotzt eng Zuel vu GPUs, dorënner AMD FirePro S7150, NVIDIA Tesla M40, NVIDIA Tesla V100, NVIDIA Tesla P4, an NVIDIA Tesla P100.

Dir hutt Zougang zu Virdeeler abegraff online déif Léieren Inferenz Servicer an Training, Inhalt Identifikatioun, Bild a Stëmm Unerkennung, HD Medien coding, Video Konferenzen, Quell Film Restauratioun, an 4K / 8K HD Live.

Kritt Alternativen wéi Video Rendering, Berechnungsfinanzen, Klimaprognose, Kollisiounssimulatioun, Gentechnik, net-linear Redaktioun, Fernausbildungsapplikatiounen, an Ingenieursdesign, och.

Tarifikatioun

Et bitt e gratis Test- a Pay-as-You-Go Abonnementplang, dat heescht datt Dir nëmmen Instanzen oder GPUs benotzt.

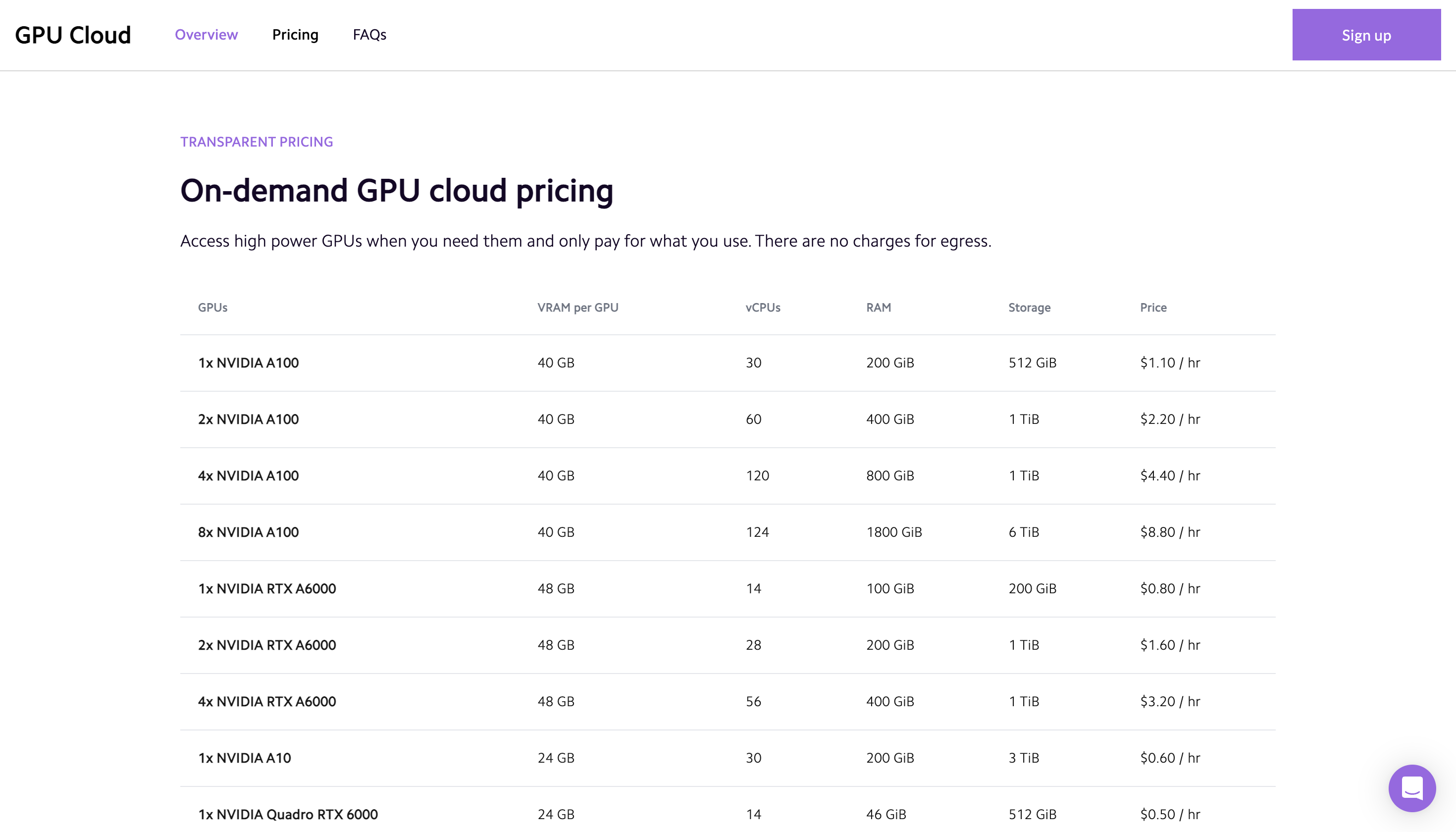

6. Genesis Cloud

Genesis Cloud bitt eng héich kosteneffektiv Cloud GPU Plattform. Si schaffen an Zesummenaarbecht mat verschiddenen effektiven Datenzenteren op der ganzer Welt fir eng breet Varietéit vun Uwendungen ze bidden.

Genesis Cloud bitt eng breet Palette vun nëtzlechen Fonctiounen ouni zousätzlech Käschten, dorënner Snapshots fir Är Aarbecht ze backen, Sécherheetsgruppen fir Netzverkéier, Späichervolumen fir grouss Datesets, FastAI, PyTorch, Preset Biller, an eng ëffentlech TensorFlow API.

Si beschleunegen d'Berechnung mat der Hëllef vun NVIDIA GeForce RTX 3090, RTX 3080, RTX 3060 Ti, an GTX 1080 Ti Technologien an hire Cloud GPU Instanzen.

Dir kënnt d'Kraaft vum GPU Computing benotze fir animéiert Filmer ze produzéieren oder ze trainéieren neural Netzwierker.

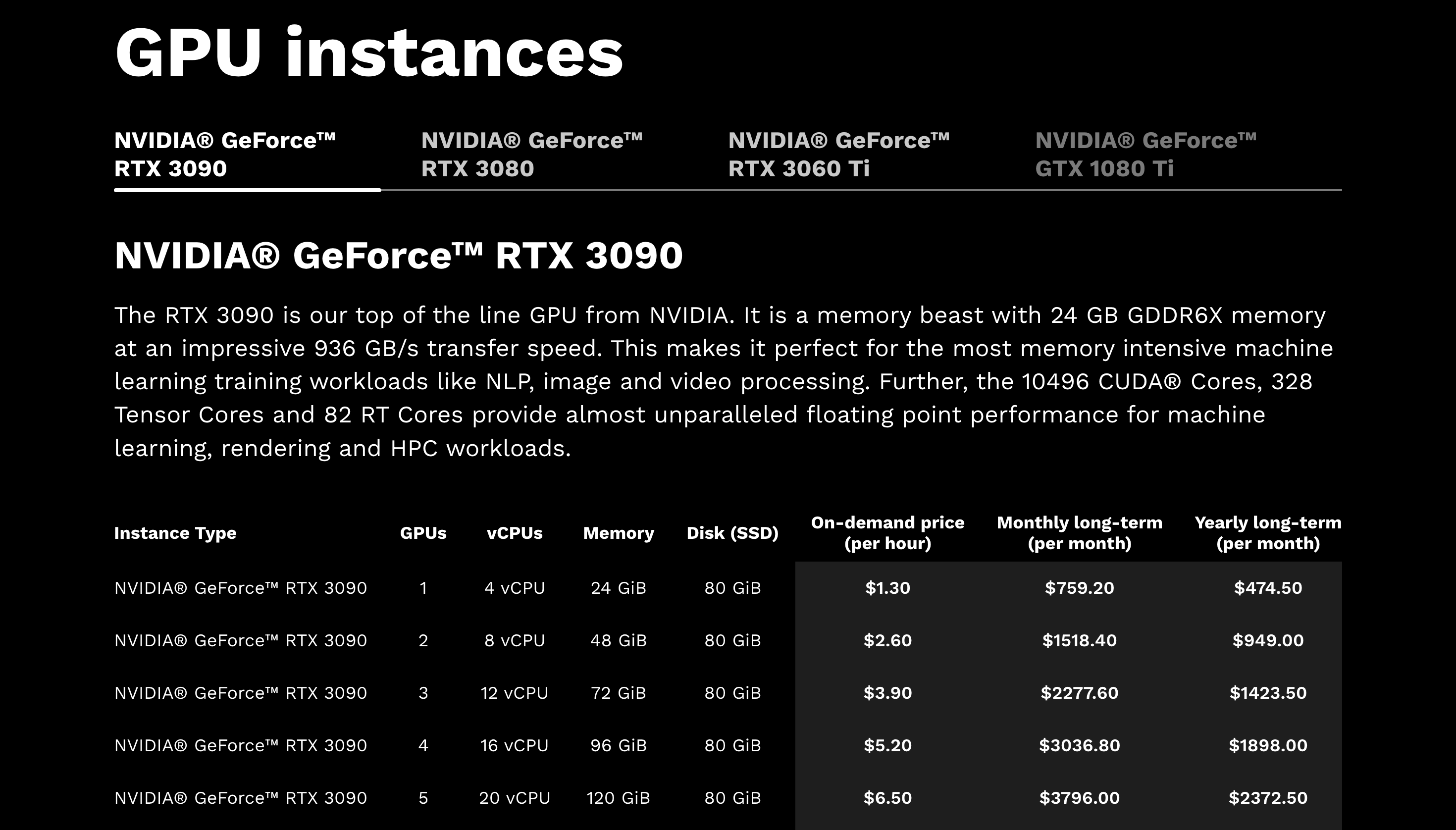

Tarifikatioun

De Präis fänkt bei $ 1.30 / Stonn fir NVIDIA® GeForce™ RTX 3090 un.

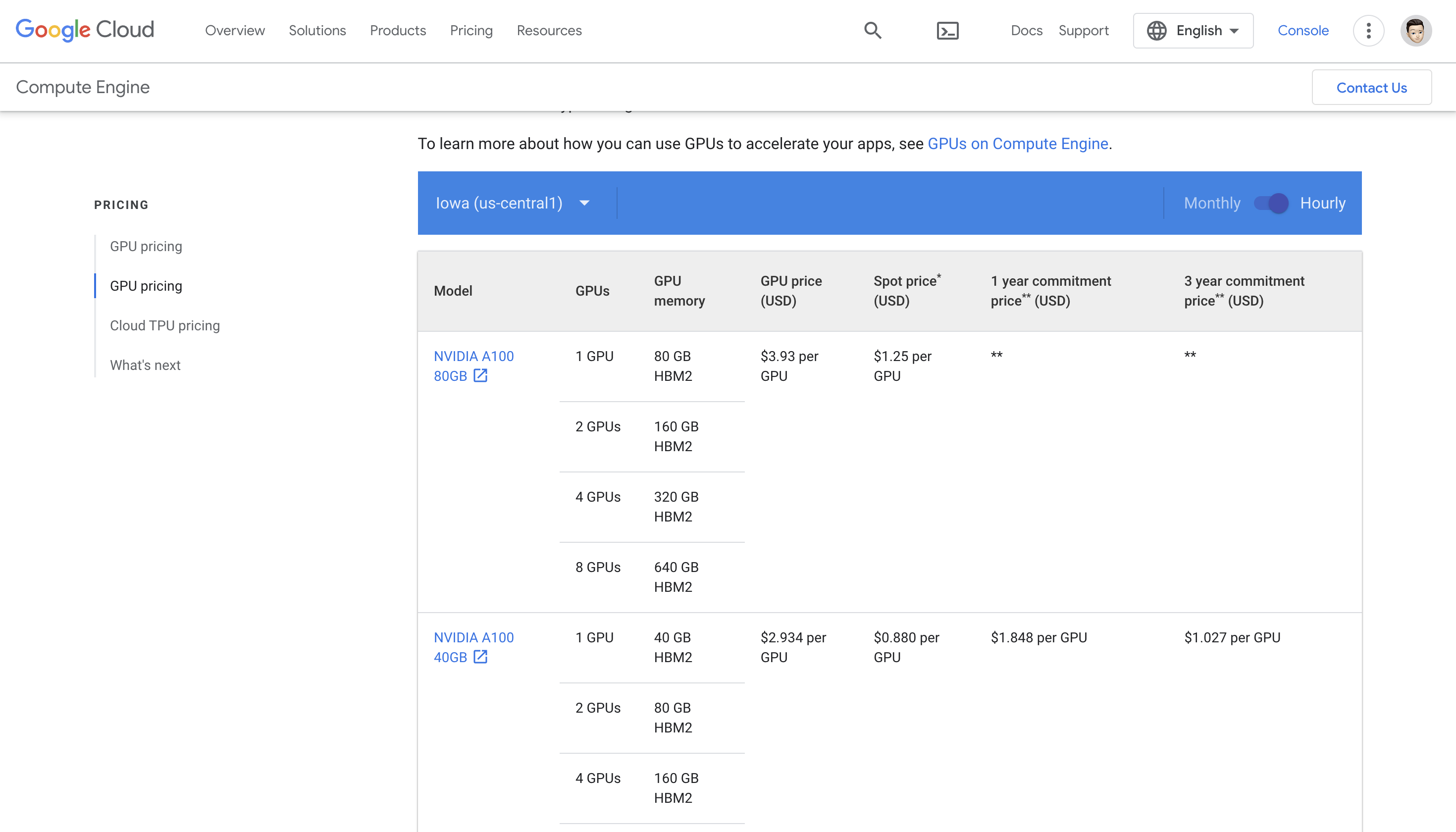

7. Google Cloud GPU

Google Cloud Plattform (GCP) bitt eng Zuel vu GPU Instanzen déi benotzt kënne fir Prozesser wéi Maschinnléieren, Deep Learning an High-Performance Computing (HPC) ze beschleunegen.

Duerch dës GPU Instanzen, déi vun NVIDIA, AMD, an Intel GPUs ënnerstëtzt ginn, ass et méiglech Zougang zu CUDA an cuDNN Bibliothéiken ze kréien, déi dacks fir GPU-beschleunegt Informatik benotzt ginn.

Wéinst Maschinnmodifikatiounen, flexibel Präisser, an eng grouss Gamme vu GPU Méiglechkeeten, kéint HPC méi produktiv sinn.

Zousätzlech kann et Iech hëllefen Är Aarbechtsbelaaschtung ze erliichteren. Ënnert de GPUs déi se ubidden sinn d'NVIDIA K80, P4, V100, A100, T4 a P100. Nëmmen eng kleng Unzuel vun Zonen, déi iwwer verschidde Plazen verspreet sinn, hunn Zougang zu den GPUs.

Tarifikatioun

D'Käschte variéieren op Basis vun der Regioun, der GPU déi Dir gewielt hutt, an der Maschinntyp. Fir den NVIDIA A100 fänken d'Präisser bei $ 3.93 pro GPU un.

8. NVIDIA GPU Cloud

D'NVIDIA GPU Cloud (NGC) ass eng Cloud-baséiert Plattform déi Benotzer Zougang zu enger Vielfalt vu GPU-beschleunegt Software gëtt, wéi Visualiséierungsinstrumenter, HPC Programmer, an ze léieren Kaderen.

Entwéckler, Daten Wëssenschaftler, a Fuerscher kënnen elo einfach d'Rechenkraaft vun NVIDIA GPUs an der Wollek benotzen ouni sech iwwer d'Infrastruktur oder d'Ënnerhalt ze këmmeren déi néideg ass fir hir Apps ze bedreiwen dank NGC.

Eng Bibliothéik vu vir-konfiguréierte Softwarecontainer ass mat NGC abegraff a ka séier op eng Rei vun Wollek Rechenzäit Infrastrukturen, dorënner Amazon Web Services, Google Cloud Plattform a Microsoft Azure.

Zougang zu NGC gëtt Benotzer och Zougang zu NVIDIA's Deep Learning Plattform, déi mat enger Rei vu Programmer a Ressourcen kënnt fir déif Léiermodeller ze kreéieren an ëmzesetzen, dorënner TensorRT, cuDNN, an CUDA-X AI.

Tarifikatioun

Ofhängeg vun de spezifesche Servicer a Ressourcen déi Dir benotzt, ännert d'NVIDIA GPU Cloud (NGC) Präis. Wärend verschidde NGC Servicer, wéi den Deep Learning Software Stack, gratis sinn ze benotzen, anerer, wéi d'HPC Applikatioun Container, kënnen e Präis bezuelen. Kuckt w.e.g. den NGC Katalog.

9. Lambda GPU Cloud

Lambda bitt Cloud GPU Instanzen fir déif Léiermodell Training a Skalierbarkeet vun engem eenzege kierperleche Computer op vill virtuell Maschinnen.

Vum Dashboard, direkt Zougang zu all Maschinn spezialiséiert Jupyter Notizbuch programméiere Ëmfeld. Fir direkten Zougang benotzt SSH direkt mat engem vun den SSH Schlësselen oder verbënnt iwwer de Web Terminal op der Cloud Dashboard.

E Maximum vun 10 Gbps vun der Inter-Node Konnektivitéit gëtt vun all Instanz ënnerstëtzt, wat et erlaabt verdeelt Training mat Kadere wéi Horovod ze benotzen.

D'Skaléierung vun der Unzuel vun de GPUs op enger oder méi Instanzen kann hëllefen d'Modelloptimiséierung ze beschleunegen. D'Plattform ënnerstëtzt GPU Instanzen vun NVIDIA RTX 6000, Quadro RTX 6000, an Tesla V100s.

Tarifikatioun

De Präis fänkt bei $ 1.10 / Stonn fir NVIDIA A100 un.

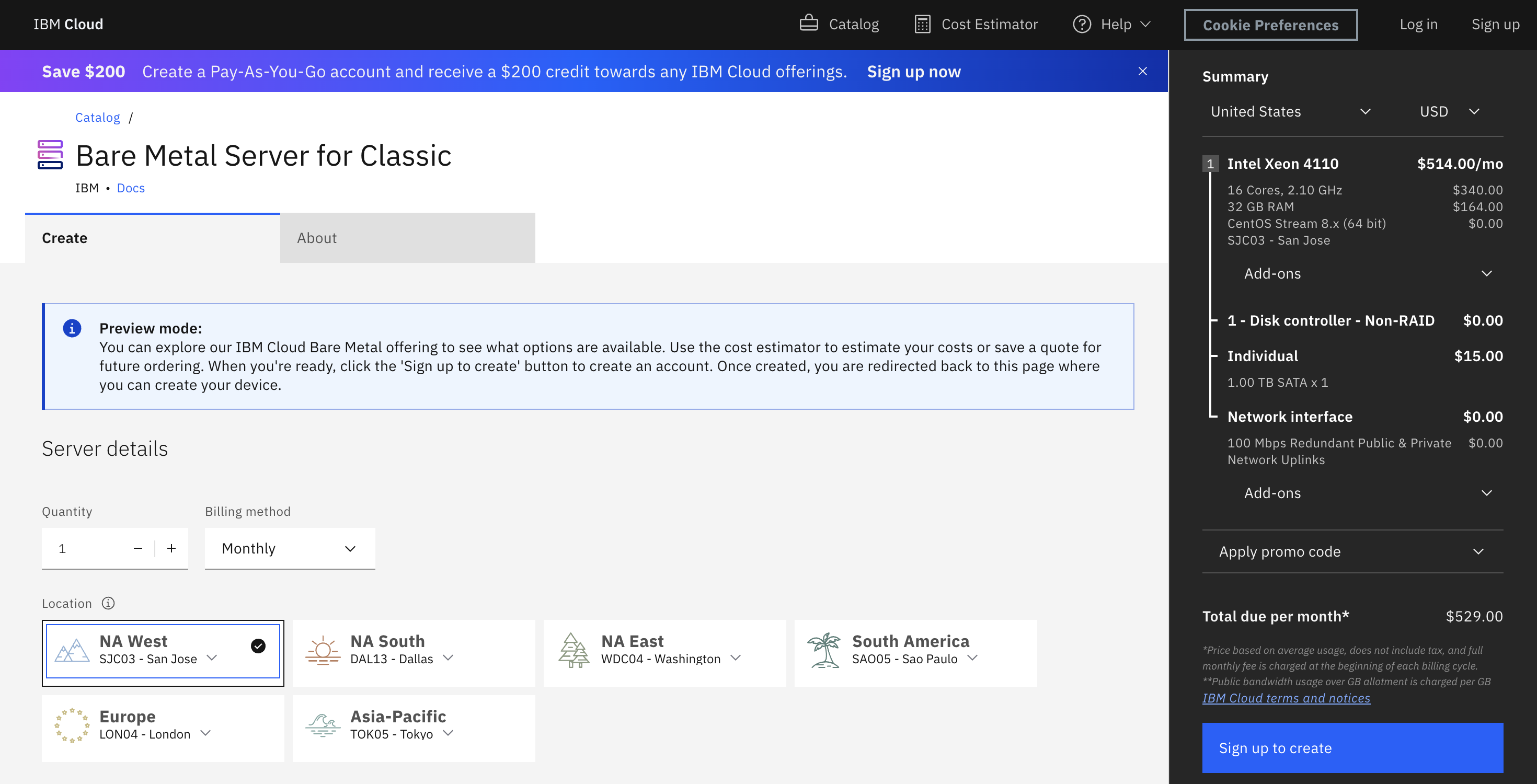

10. IBM Cloud GPU

D'IBM Cloud GPU benotzt e weltwäit verspreet Netzwierk vun Datenzenter fir flexibel Serverauswielprozeduren a glat Konnektivitéit mat der IBM Cloud Architektur, APIen an Uwendungen ze bidden.

Mat Intel Xeon 4210, Xeon 5218, an Xeon 6248 GPU Instanzen, bitt et déi Bare-Metal Server GPU Optioun.

Dir kënnt High-Performance, latency-empfindlech, spezialiséiert a konventionell Aarbechtslaascht direkt op Server-Hardware ausféieren mat Bare-Metal Instanzen, sou wéi se mat on-premise GPUs kéinten.

Fir hir Bare-Metal Server Optioun, si bidden och Instanzen mat NVIDIA T4 GPUs an Intel Xeon Prozessoren mat bis zu 40 Cores, souwéi Instanzen fir hir virtuell Server Alternativen mat NVIDIA V100 a P100 Modeller.

Tarifikatioun

De Präis fänkt bei $ 514 / Mount fir Intel Xeon4110 un.

Konklusioun

Schlussendlech sinn déi feinste Cloud GPU Servicer fir AI déi déi staark GPU Ressourcen ubidden, adaptéierbar Präiswahlen an einfache Skaléieren.

All d'Firmen déi GPU Instanzen fir AI Workloads ubidden - AWS, NVIDIA, IBM, a GCP - hunn exzellent Produktlinnen a punkto Leeschtung a Funktionalitéit.

Déi bescht Optioun gëtt schlussendlech vun Ären eenzegaartegen Ufuerderunge bestëmmt, finanziell Aschränkungen, Infrastruktur déi schonn op der Plaz ass, a Verkeefervirléiften.

Hannerlooss eng Äntwert