Table of Contents[Hide][Show]

Intelligentia artificialis (AI) primum visum est somnium procul esse, technicae tempus futurum, sed hoc iam non est.

Quod investigationis argumentum olim fuit, nunc in rerum natura disputo. AI in variis locis nunc invenitur, inclusa fabrica, schola, fretus, valetudinaria, nec non telephonium tuum.

Oculi vehiculorum auto-activi sunt, voces Siri et Alexa, mentes post tempestatum praevidentes, manus chirurgiae roboticae adiutae, et magis.

artificialis intelligentia, (AI) Commune fit vitae hodiernae notam. Praeteritis pluribus annis, AI in amplis technologiarum IT amplis lusor emersit.

Demum retis neuralis ab AI ad novas res discendas adhibetur.

Hodie ergo de Networks Neural discemus, quomodo opera, rationes, applicationes, et multum plus operatur.

Quid est Neural Network?

In doctrina apparatus, network neural est retis programmatum neuronum artificialium. Cerebrum humanum imitari nititur, numerosis stratis "neurons" habens, quae sunt similes in cerebro nostro neurono.

Primum stratum neuronum accipiet imagines, video, sonum, textum, et alia initibus. Haec notitia per omnes gradus fluit, uno influente in proximum strati output. Haec critica pro difficilioribus operibus est, sicut processus linguae naturalis ad apparatus discendi.

Sed in aliis casibus, attenta pressionibus systematis ad redigendum exemplar magnitudine, servata accuratione et efficacia potior est. Putatio retis neuralis est modus compressionis quae includit pondera removenda ab exemplari erudito. Intelligentia artificialis retis neuralis considerate, quae exercitata est ad discernendos homines ab animalibus.

Pictura in partes lucidas et obscuras primo neuronorum strato dividetur. Haec notitia in sequentem tabulatum transibit, quae ubi extremae sunt determinabit.

Proximus tabulatum illud agnoscere conabitur formas quas oras 'compositione generavit'. Iuxta data institutus est, per plures stratorum notitia simili modo transibit, si imago, quam praesentasti, hominis vel animalis est.

Cum data in retis neuralis datur, incipit processus eius. Postea, data est per gradus suos ad optatum exitum procedendum. Retis neural machina est machina quae ab input structa discit et eventus ostendit. Tria sunt genera studiorum quae in reticulis neutris locum habere possunt;

- Cognitio procuratio - Inputationes et outputs algorithms data sunt utentes intitulatum. Postquam edocti sunt quomodo notitias resolvere, exitus intentos praenuntiant.

- Discentes insatiabiles – ANN sine ope humana discit. Nulla intitulata notitia est, et output per rationes inventas in output data decernitur.

- Doctrina supplementum est cum retis discit ex videre quod recipit.

Quomodo retiaculis Neural operantur?

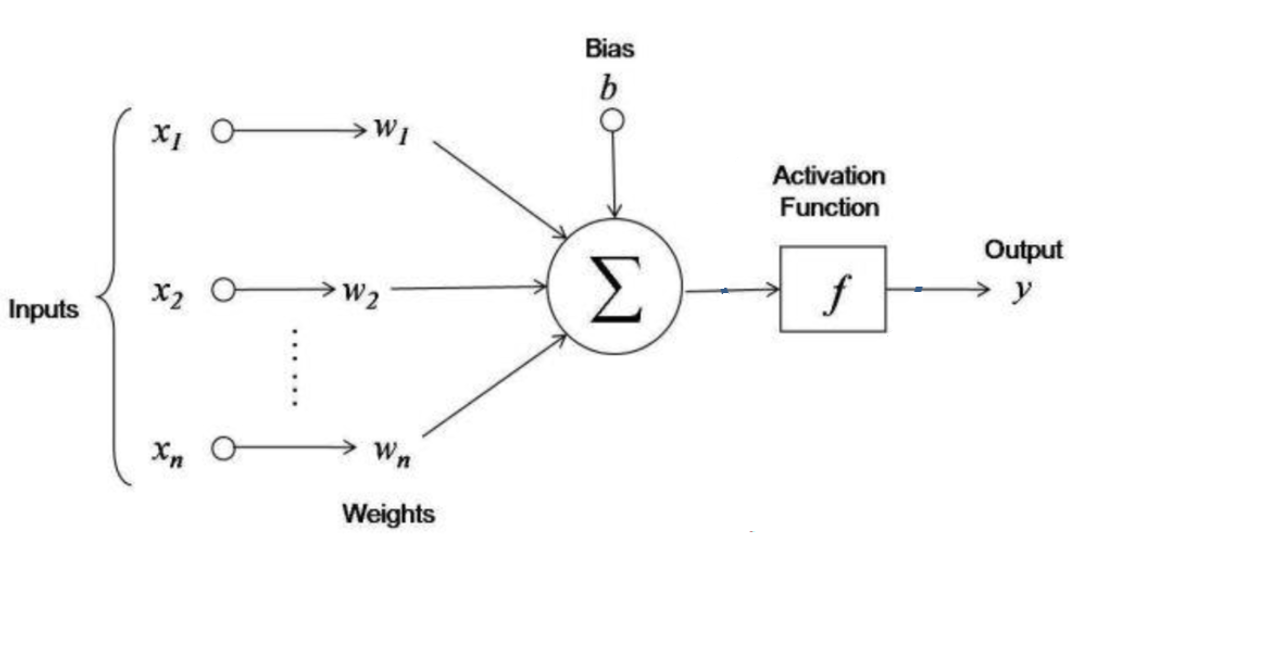

Neurona artificialia adhibentur in retiacula neurali, quae sunt systemata sophistica. Neurona artificialia, quae etiam perceptrona vocantur, ex his constant;

- initus

- Pondus

- prospectumque Bias

- Activation Function

- Output

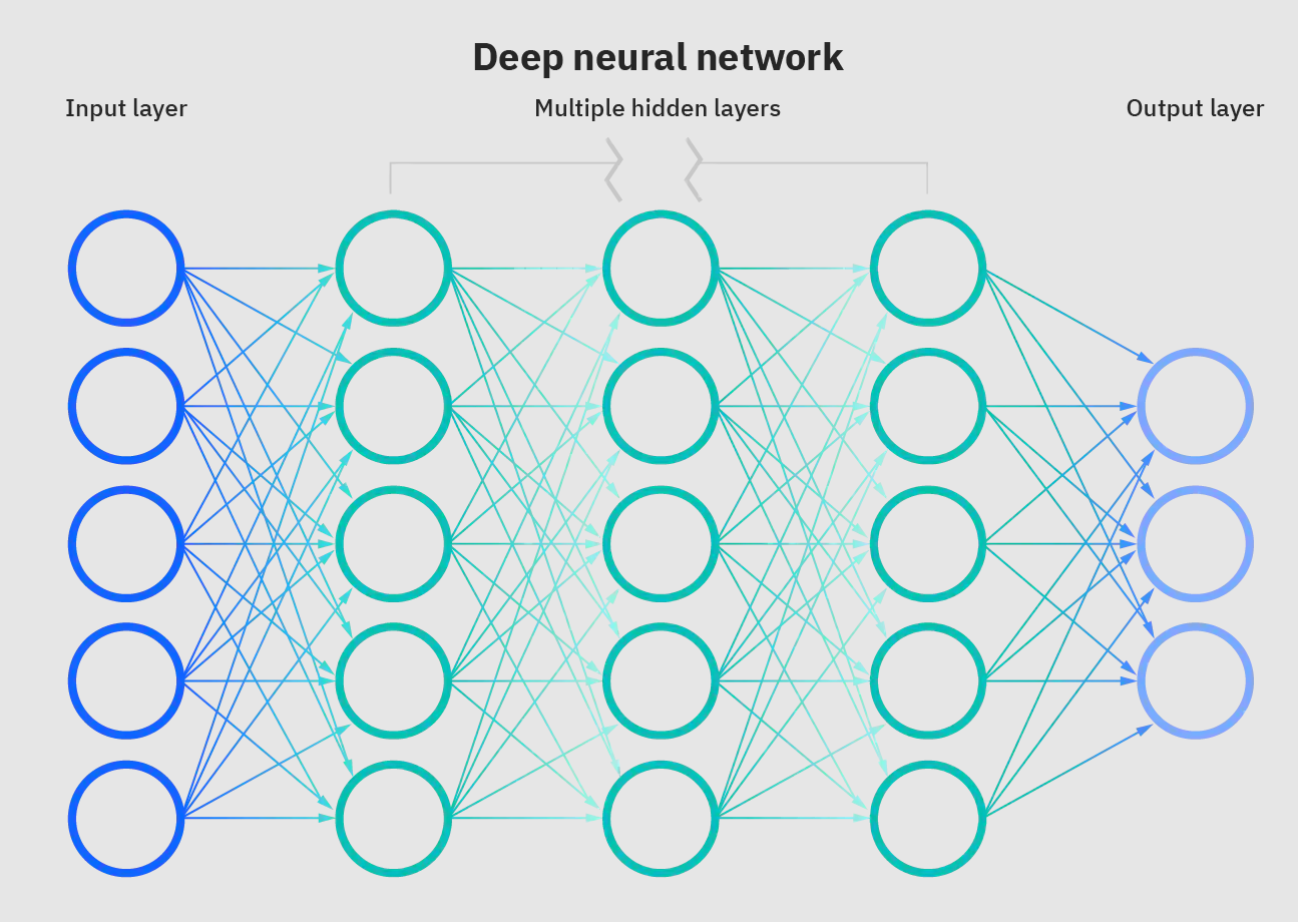

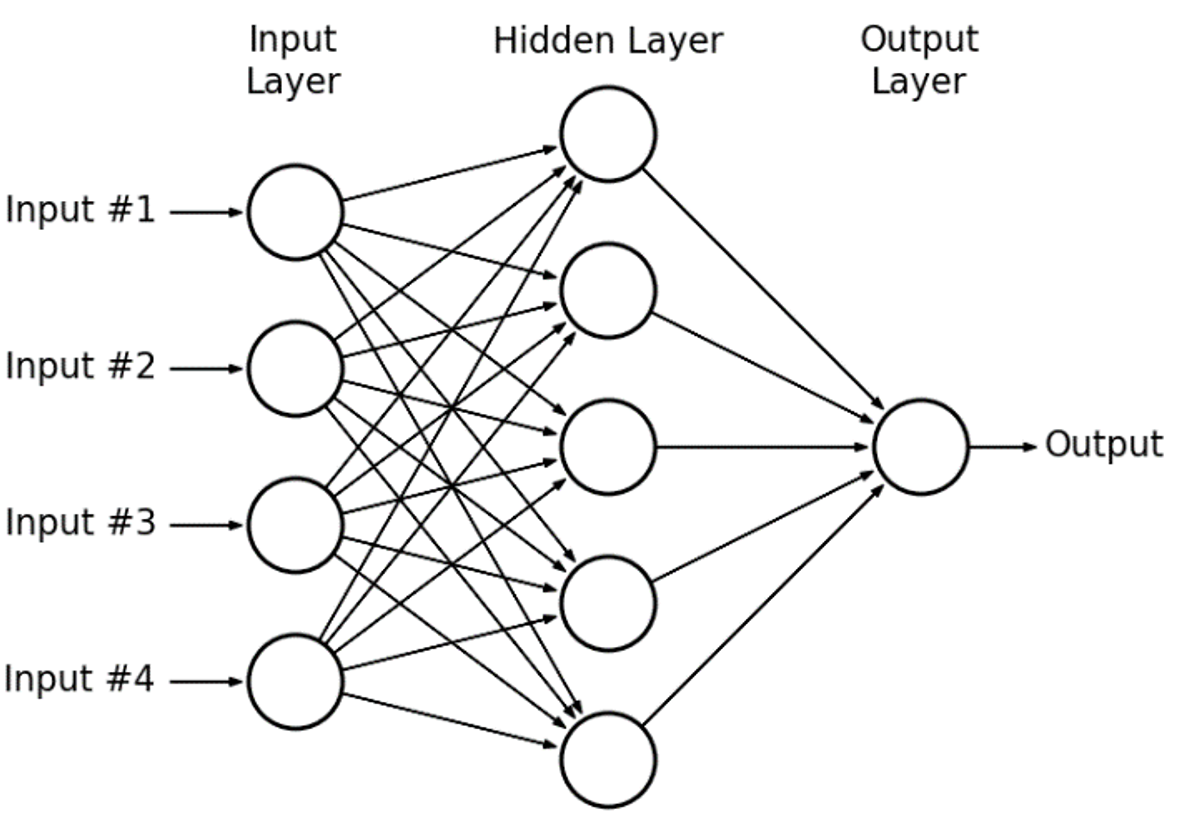

In accumsan neurons id, rutrum nec ligula. A neural network constat ex tribus ordinibus:

- Input accumsan

- Occulta accumsan

- Output accumsan

Data in forma valoris numerici ad input iacum mittitur. Strati retis absconditi sunt qui maxime calculos faciunt. In accumsan output, auctor egestas nulla, eu consequat ante. Neurons inter se dominentur in reticulo neurali. Neurons construere singulas tabulas solent. Data fugatur in stratum absconditum postquam input iactum adipiscatur.

Pondera adhibentur singulis input. In stratis occultis reticuli neuralis, pondus est valor notitiarum advenientis. Pondera operantur multiplicando input notitias per pondus valorem in in iacuit input.

Hoc igitur primum iacuit occultum valorem incipit. Input data transfiguratur et ad alterum stratum per stratis absconditis transit. In accumsan output est reus finalis eventus generandi. Inputationes et pondera multiplicata sunt, et effectus stratum neuronum absconditum in summa traditur. Quisque neuron est studium. Ad summam computare, singula neuron adiungit initibus recipiendis.

Post hoc, valor munus activationis per transit. Effectus functionis activationis determinat utrum neuronum reducitur necne. Cum neuron est activum, informationes mittit ad alias stratas. Data in retiaculis creatur donec neuron ad output stratum hoc utens methodo perveniat. Propagatio deinceps est alius terminus ad hoc.

Ars pascendi data in nodi inputationis et obtinendae output per nodi output cognoscitur sicut propagationis feed-antea. Cum input data accipitur ab strato occulto, propagatio ante feed. Discursum est secundum munus activationis et ad output transivit.

Eventus neuron in strato output cum probabilissime proiectus est. Backpropagatio fit cum output falsa. Pondera initialized unicuique initus sunt, dum reticulum neural creant. Provocatio est processus legendi pondera uniuscuiusque input ad errores reducere et accuratiorem output praebere.

Genera Neural Network

1. Perceptron

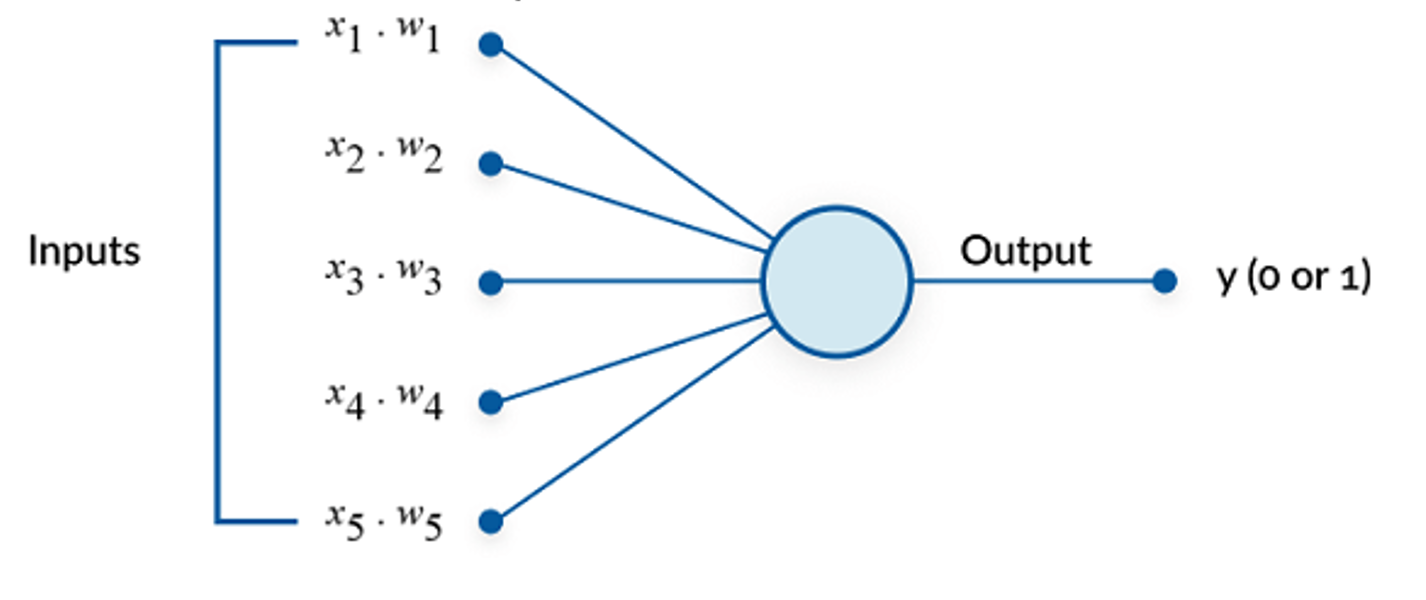

Exemplar perceptron Minsky-Papert unum ex exemplaribus neuronis simplicissimis et vetustissimis est. Minima unitas retis neuralis est quae certas calculos facit ad inveniendas notas vel res intelligentiae in ineunte notitia. Gravis initibus accipit et applicat munus activationis ad exitum obtinendum. TLU (linea logicae unitatis) aliud nomen perceptronum est.

Perceptron est binarium classificans quod est ratio studiorum praefecti quae data in duos circulos dividit. Logicae Portae ut AC, OR, NAND impleri possint perceptrons.

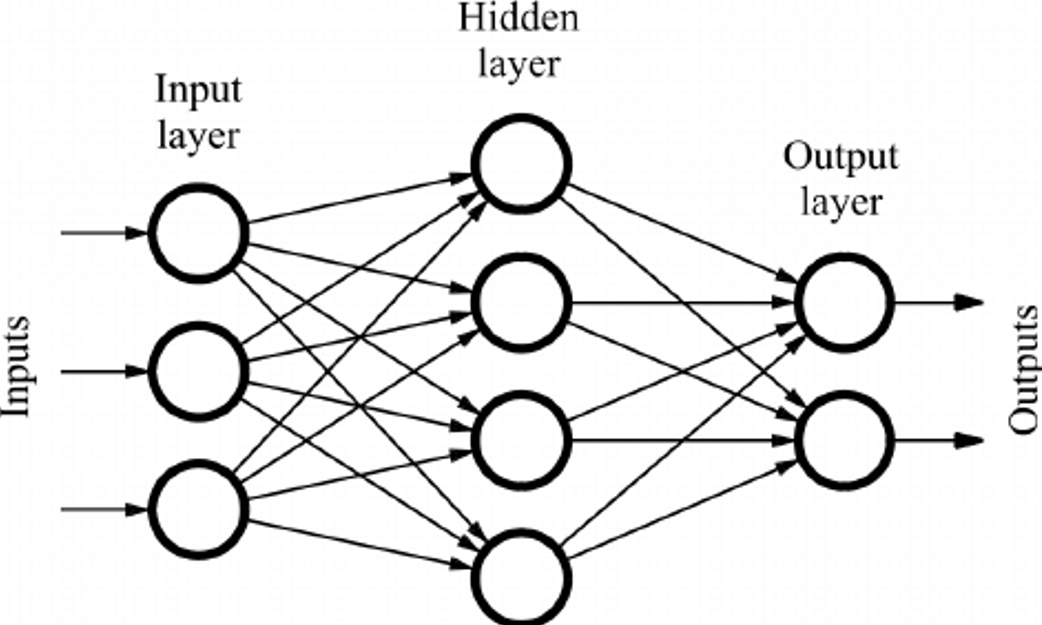

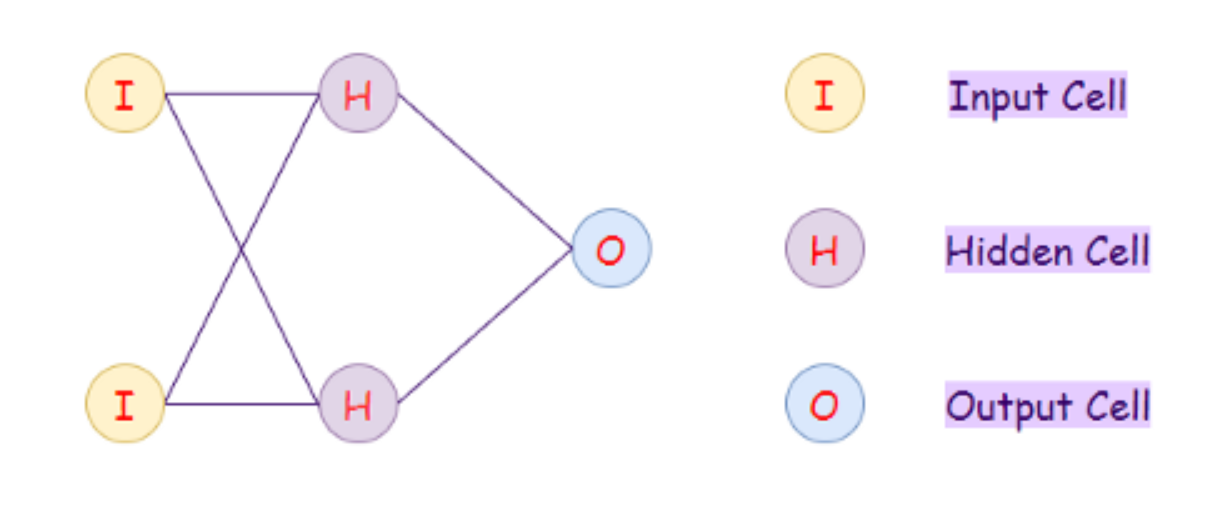

2. Pasce-Accede Neural Network

Praecipua versio reticulorum neuralis, in qua input data solum in unam partem fluit, per nodos artificiales neuralis transit et per nodos output exit. Strati input et output adsunt in locis ubi strata abscondita adesse possunt vel non possunt. Possunt denotari ut vel unius stratis vel multi-strati cibarii retis neuralis deinceps innixi.

Numerus stratorum usus per complexionem functionis determinatur. Sola in unam partem propagatur et retro non propagat. Hic, pondera constant. Inputationes multiplicatae sunt ponderibus ad munus activationis pascendum. Munus activationis vel divisio gradatim ad hoc munus activum adhibetur.

3. Multi accumsan perceptron

Introductio ad sophisticated neural retiain quo input data per multos stratos neuronum artificialium funditur. Retis neuralis omnino connexus est, cum omnis nodi omnibus neurons in sequenti tabulato coniungitur. Multiplices stratis occultis, id est, saltem tribus vel pluribus stratis, in strati input et output adsunt.

Propagationem bidirectionalem possidet, quae modo tam ante quam retro potest propagare. Inputationes multiplicantur per pondera et ad munus activum mittuntur, ubi mutantur per backpropagationem ad damnum minuendum.

Pondera sunt valores apparatus-doctos a Networks Neural, ut simpliciter ponas. Prout disparitas inter expectationes et disciplinas initiorum, ipsi se componunt. Softmax usus est ut tabulatum activationis output munus post functiones activationis nonlineares.

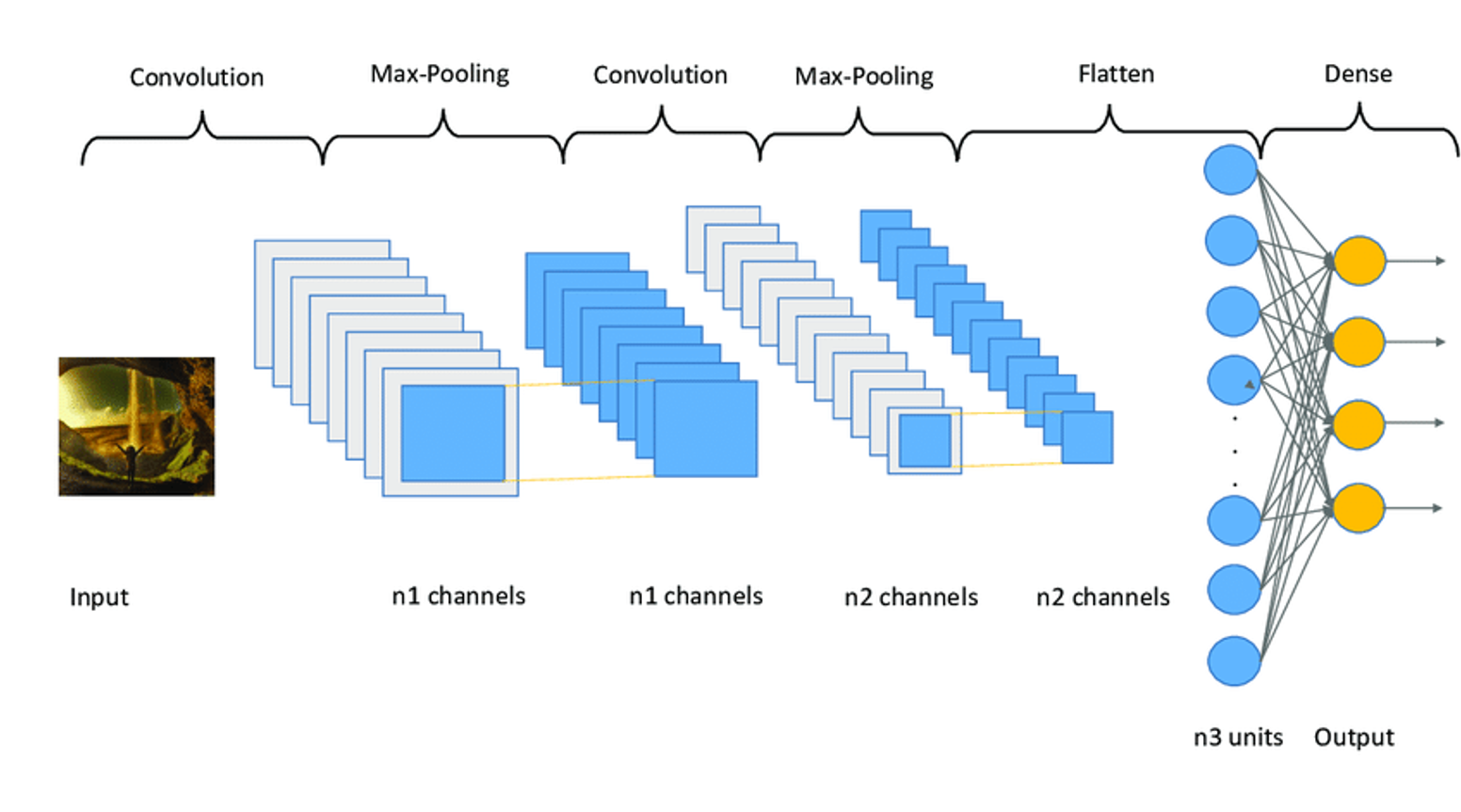

4. Convolutionis Neural Network

Contra traditum duo dimensiva ordinata, convolutio retis neuralis tria dimensiva conformationem neuronorum habet. Accumsan primis accumsan accumsan eros dictumst. Quodlibet neuronum in strato convolutionis solum informationes procedit ex limitata portione agri visualis. Sicut filtrum, lineamenta inputa modo batch capiuntur.

Retis picturas in sectionibus intelligit et has actiones pluries praestare potest ut totam imaginem processus perficiat.

Pictura convertitur ex RGB vel HSI ad greyscale durante processui. Variationes praeterea in valore pixel adiuvabunt in marginibus deprehendendis, et picturae in plures circulos disponi possunt. Propagatio unidirectionalis fit cum rhoncus unum vel plures stratas convolutionum quas sequitur collatio contineat, et propagatio bidirectionalis fit cum expositio strati convolutionis mittitur ad reticulum neurale plene connexum pro classificatione imaginis.

Ad quaedam imaginis elementa extrahenda, Filtra adhibentur. In MLP, inputationes ponderantur et supplentur in munus activationis. RELU in convolutione adhibetur, dum MLP functione nonlineari quam sequitur softmax adhibet. In pictura et recognitione video, parsing semantica, et deprehensio paraphrasis, retiacula convolutionis neuralis optimos proventus efficiunt.

5. Radial Bias Network

Vector initus sequitur iacum RBF neuronum et stratum output cum uno nodo pro singulis categoriis in Basis Radialis Function Network. Input indicatur comparando contra data puncta ex institutione posita, ubi unumquodque neuron conservat prototypum. Hoc unum est de disciplina scriptorum exemplorum.

Singula neuron computat distantiam Euclideae inter input et eius prototypum cum recens vector initus [vectoris n dimensiva categorizes conaris] poni debet. Si duas classes habemus, Classem A et Classem B, novum initus generandi similius est classi A prototypis quam classis B prototypa.

Quo fit, ut classis A intitulatum vel categoricum fieri possit.

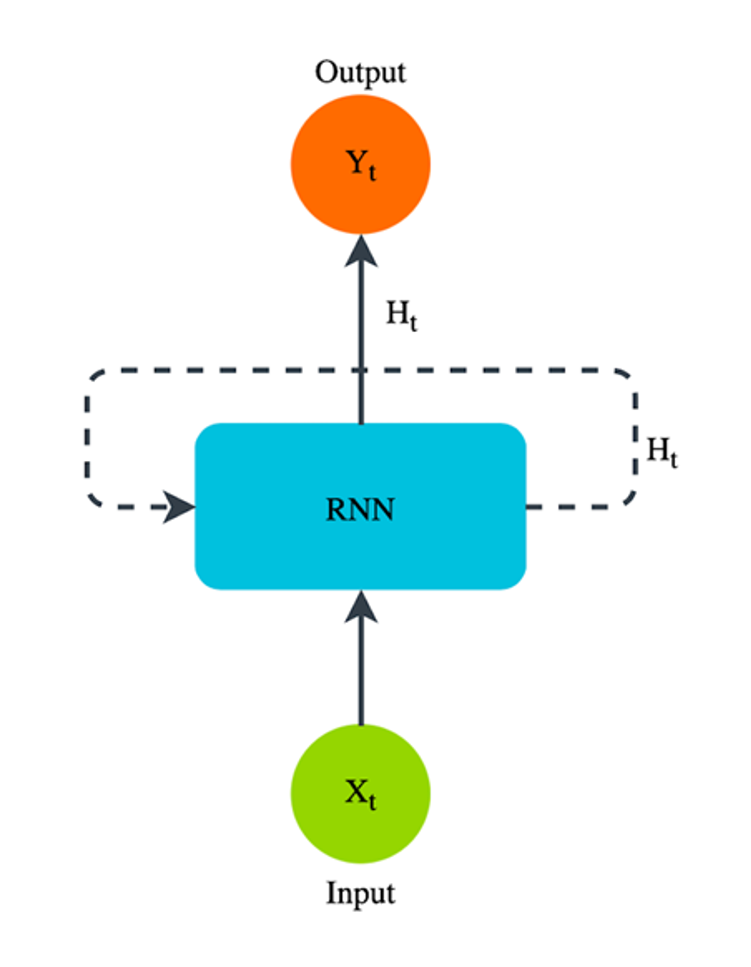

6. Recurrentes Neural Network

Recurrentes Neural Networks ordinantur ad conservandum output iacuit et eam in input pascunt ut exitum sortis prospiciant. A feed-ante network neural iacuit initialis plerumque, stratum retis neural recurrente sequitur, ubi memoria muneris meminit partem informationis quam in priore tempore passum habuit.

Hoc missionis deinceps propagatione utitur. Data servat quae in futurum necessaria erunt. In eventu quod falsum praedictum est, litteratura usus est ad minorem adaptationem. Quam ob rem, dum progressio progreditur, magis magisque accurate fiet.

Applications

Retia neuralis in variis disciplinis data problemata tractanda sunt; exempla quaedam infra ostenduntur.

- Facialis Recognitio – Facialis Recognitio Solutiones sunt ut efficax custodiae ratio. Recognitio systemata digitales ad facies humanas spectant. Adhibentur in officiis ad ingressum selectivam. Ita systemata humanam faciem comprobant et eam cum indice IDs in datorum datorum thesauris comparant.

- Stock Praedictio - Investments periculis foro obnoxia sunt. Prope difficile est futuras progressus praevidere in foro stirpis maxime volatili. Ante retiacula neural, semper instabiles gradus bullientes et inconditi vagus erant. Sed quid mutarunt omnia? Utique loquimur de retiacula neural… Multilayer Perceptron MLP (typum systematis intelligentiae artificialis feedforward) ponitur felix stirpe praecognoscere creare in real-time.

- Social Media — Pro quo corny sonet, socialis instrumentis mundanam exsistentiae viam mutavit. Mores instrumentorum socialium utentium studetur uti Networks artificialibus neutris. Ad analysin competitive, quae data cotidie per virtualem interationes subministrantur, cumulantur et examinantur. Actiones instrumentorum socialium usorum per retiacula neuralis replicantur. Singulorum mores coniungi possunt cum exemplaribus expendendis semel datae per instrumenta communicationis socialis resolvitur. Data ex instrumentis socialibus adhibitis per Multilayer Perceptron ANN.

- Curis – Singuli in mundo hodierno utuntur beneficiis technologiarum in industria curationis. In negotiis sanitatis, Networks Convolutionales Neural pro detectione X radius, CT scans, et ultrasonus adhibentur. Medicae imaginatio notitiae ex praedictis probatis aestimantur et aestimantur adhibitis exemplaribus retis neuralis, sicut rhoncus in processu imaginis adhibetur. In progressione vocis systematis agnitionis, reticulum recurrente neural (RNN) adhibetur.

- Tempestas Report – Ante ad exsequendam intelligentiam artificialem, proiectiones meteorologicae numquam praecisae fuerunt. Tempestas praenuntiatio late facta est praedicere condiciones tempestatum quae in futuro erunt. Tempestates praedictiones usui sunt ad futuram calamitatum naturalium probabilitatem antecapere. Tempestas praevisa fit utens multilayer perceptron (MLP), retiacula convolutiva neuralis (CNN), recurrentes retiacula neuralis (RNN).

- Defensio - Logistics, analysis armata oppugnatio, item locus omnes retiacula neurali utuntur. Adhibentur etiam in circuitu aeris et maris et fuci sui iuris utentes. Intelligentia artificialis industriam defensionis dat quod multum opus est boost ut eius technologiam conscendat. Ad exsistentiam fodinae subaquarum detectae, Networks Convolutionale Neural (CNN) adhibita sunt.

commoda

- Etsi pauci neurones in retis neurali operando proprie non sunt, retiacula neuralis outputationes adhuc generabunt.

- Neural retiaculis facultatem habent discendi in real-time et mutandis suis occasus accommodandi.

- Neural retiacula varias operas facere discunt. Rectum exitum praebere in notitiis instructum.

- Retiacula neuralis vim habent et facultatem ad plura negotia simul tractandi.

Incommoda

- Neural retiaculis solvendis problemata adhibentur. Explicationem non indicat post "quare et quomodo" fecit iudicia quae ob perplexitatem reticulorum fecit. Quam ob rem fiducia retiacula exesa esse potest.

- Neuralis retis partes inter se dependentes sunt. Hoc est, retia neuralis postulare (vel maxime fidentes) computatores sufficienti potentia computandi.

- Neural retis processus regulam specificam (vel pollicis regulam non habet). In probatione et artificio erroris, structura retis rectis stabilitur cum retiacula optimalia temptat. Praesent sit amet elit magna.

Conclusio

Ager neural retiacula celeriter dilatatur. Discere et comprehendere notiones criticas in hac provincia ut cum illis agere possit.

Multae reticulorum neural genera in hoc articulo operta sunt. Neutralibus reticulis uti potes ad quaestiones datas in aliis campis occupandas, si plus de hac disciplina discas.

Leave a Reply